大模型实操与API调用 | 四十五、TGI模型部署

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

TGI(Train, Generate, and Inference)是一种模型部署的框架,它简化了从模型训练到生产部署的整个过程。本文将详细介绍如何使用TGI框架来部署模型,并提供一个高效且可扩展的AI服务。

一、准备工作

在开始部署TGI模型之前,请确保您的环境满足以下条件:

- 安装Python环境(推荐使用Python 3.6及以上版本)

- 安装必要的依赖库,如

tensorflow、keras等 - 准备一台性能较好的服务器或云主机,最好配备有GPU

以下为安装TensorFlow的命令:

pip install tensorflow

二、模型训练与保存

- 选择模型架构:根据您的需求选择合适的模型架构,例如卷积神经网络(CNN)或循环神经网络(RNN)。

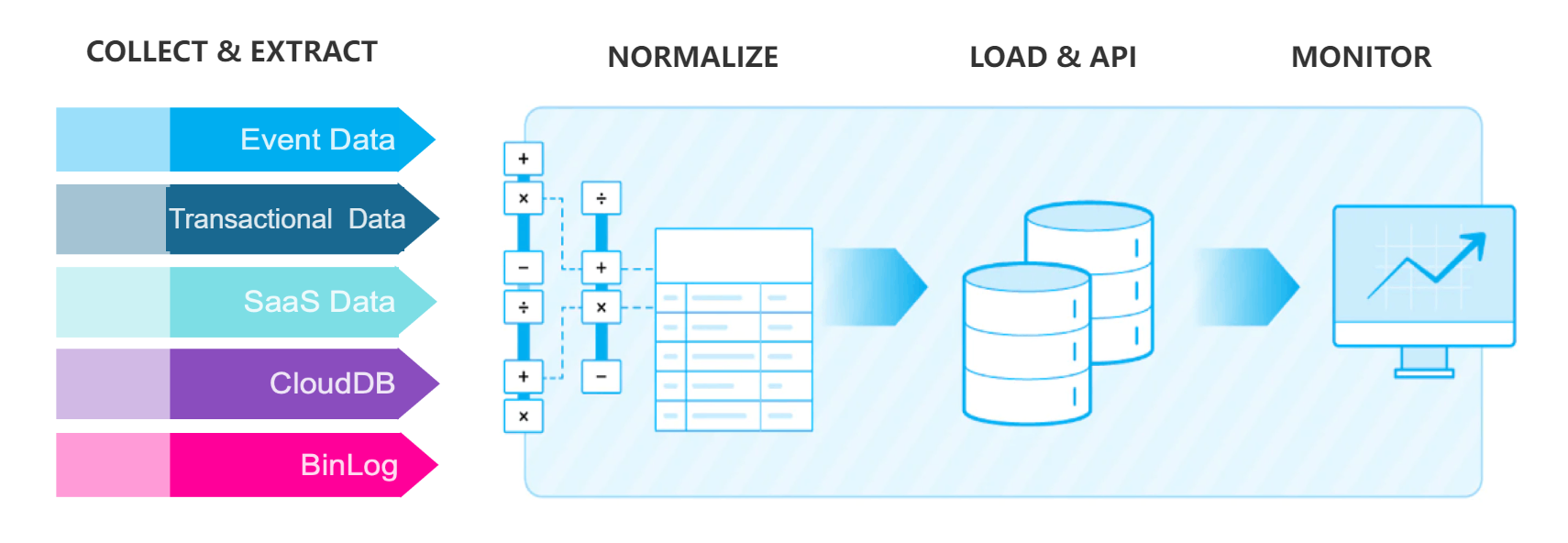

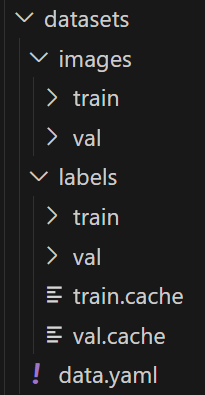

- 准备数据集:收集并预处理数据,确保数据格式适合模型训练。

- 训练模型:使用TensorFlow或Keras进行模型训练。

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Conv2D, Flatten

# 构建模型

model = Sequential([

Conv2D(32, kernel_size=(3, 3), activation='relu', input_shape=(28, 28, 1)),

Flatten(),

Dense(128, activation='relu'),

Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(train_images, train_labels, epochs=5)

- 保存模型:训练完成后,保存模型以便后续部署。

model.save('my_model.h5')

三、创建TGI配置文件

TGI部署模型需要一个配置文件,该文件定义了模型的输入输出和部署参数。

以下是一个基本的TGI配置文件示例:

model:

name: my_model

version: 1.0

input: image

output: label

path: /path/to/my_model.h5

四、部署模型

使用TGI框架提供的命令行工具来部署模型。

tgi deploy -c config.yaml

这将启动模型服务,使其准备好接收推理请求。

五、构建API服务

为了使模型可以被外部应用程序访问,我们需要构建一个API服务。

1)创建API服务:使用Flask或FastAPI等框架创建API服务。

以下是一个使用FastAPI的示例:

from fastapi import FastAPI

from pydantic import BaseModel

import numpy as np

from tensorflow.keras.models import load_model

app = FastAPI()

model = load_model('/path/to/my_model.h5')

class ImageIn(BaseModel):

image: str # Base64编码的图像数据

@app.post("/predict")

async def predict(image_in: ImageIn):

# 将Base64字符串解码为图像

image = decode_base64_image(image_in.image)

# 预处理图像

image = preprocess_image(image)

# 进行推理

predictions = model.predict(np.expand_dims(image, axis=0))

# 获取预测结果

predicted_label = np.argmax(predictions, axis=1)[0]

return {"predicted_label": predicted_label}

2)运行API服务:使用Uvicorn作为ASGI服务器来运行FastAPI应用。

uvicorn main:app --reload

六、测试API服务

使用curl或Postman等工具,向API发送POST请求以测试模型预测功能。

curl -X POST "http://127.0.0.1:8000/predict" -H "accept: application/json" -H "Content-Type: application/json" -d "{\"image\": \"base64_image_data\"}"

七、部署到生产环境

- 容器化:将应用和模型打包到Docker容器中。

- 云服务:将Docker容器部署到云服务,如AWS、Azure或Google Cloud。

- 负载均衡:使用负载均衡器来分配流量,确保服务的可用性和扩展性。

- 监控和日志:配置监控和日志记录,确保服务的稳定运行。

通过以上步骤,您已经成功使用TGI框架部署了一个高效且可扩展的AI模型服务。这种部署方式不仅适用于图像分类任务,还可以推广到其他类型的模型部署。随着技术的不断进步,TGI将更好地服务于各种AI应用场景。

最后

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

一、大模型全套的学习路线

L1级别:AI大模型时代的华丽登场

L2级别:AI大模型API应用开发工程

L3级别:大模型应用架构进阶实践

L4级别:大模型微调与私有化部署

达到L4级别也就意味着你具备了在大多数技术岗位上胜任的能力,想要达到顶尖水平,可能还需要更多的专业技能和实战经验。

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、大模型经典PDF书籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人在大模型时代,需要不断提升自己的技术和认知水平,同时还需要具备责任感和伦理意识,为人工智能的健康发展贡献力量。

有需要全套的AI大模型学习资源的小伙伴,可以微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)