一文搞懂深度学习模型压缩三大技术:剪枝+量化+知识蒸馏(动图详解)

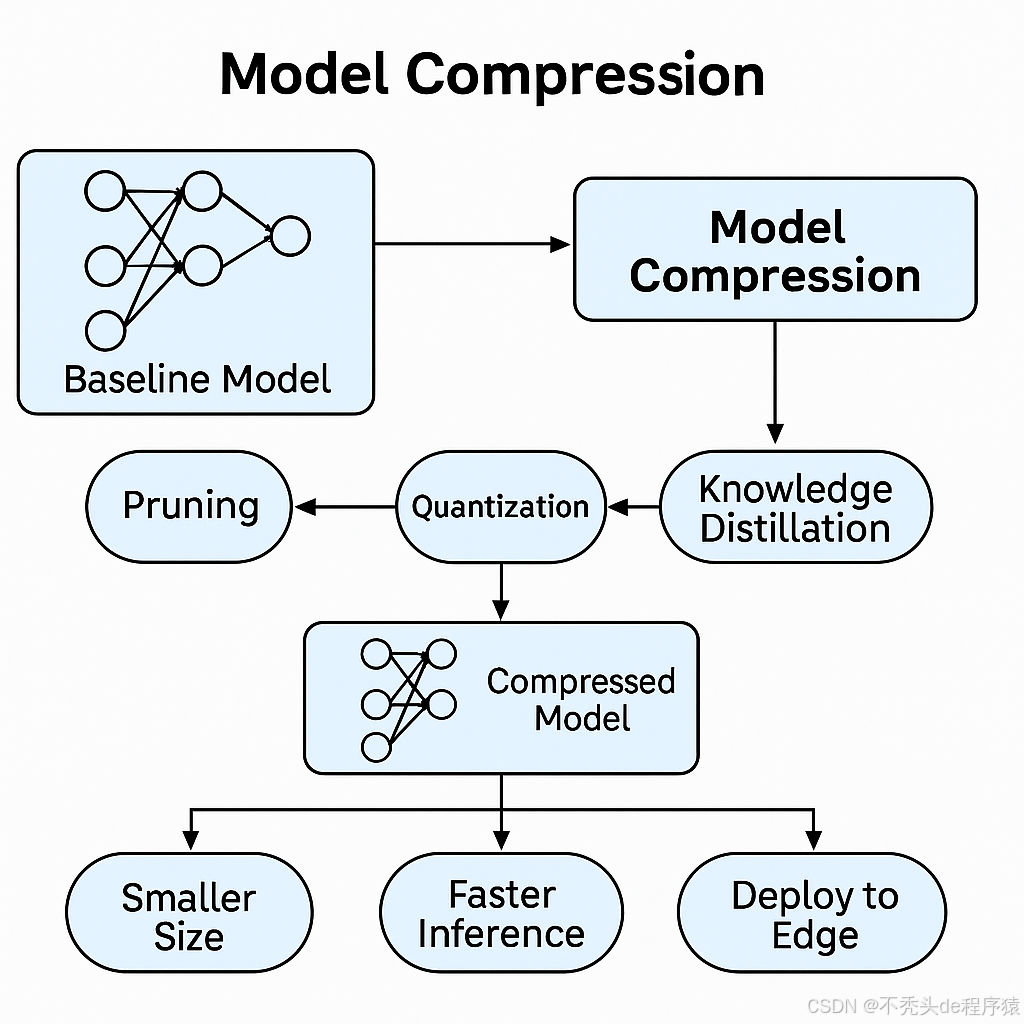

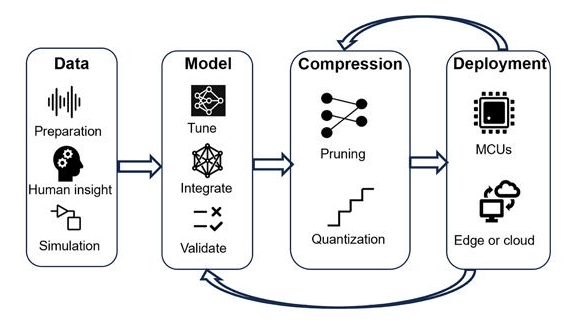

模型压缩技术正是为了解决这些问题而生,通过系统性的优化手段,将庞大的基线模型转换为轻量化的压缩模型(Compressed Model),最终实现三大关键目标: 更小的模型尺寸(Smaller Size)、更快的推理速度(Faster Inference)、边缘设备部署能力(Deploy to Edge)。

现代深度学习模型在追求高精度的同时,模型规模也在急剧增长。一个训练完成的基线模型(Baseline Model)虽然性能优异,但往往面临以下挑战:

(1)存储空间大:动辄几百MB甚至几GB的模型文件

(2)运行内存高:推理时需要大量内存存储中间结果

(3)计算复杂:推理延迟长,难以满足实时应用需求

(4)部署困难:无法在资源受限的边缘设备上运行

模型压缩技术正是为了解决这些问题而生,通过系统性的优化手段,将庞大的基线模型转换为轻量化的压缩模型(Compressed Model),最终实现三大关键目标: 更小的模型尺寸(Smaller Size)、更快的推理速度(Faster Inference)、边缘设备部署能力(Deploy to Edge)。

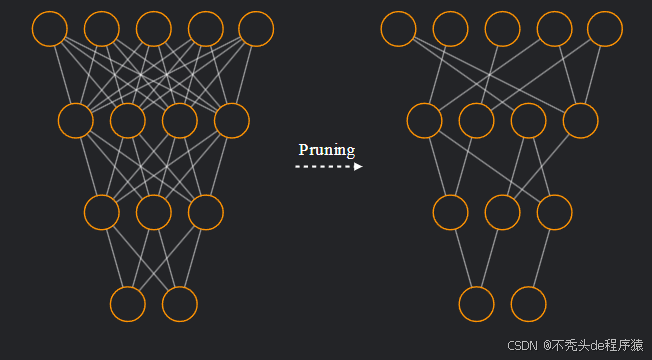

一、剪枝(Pruning):移除冗余连接

剪枝(Pruning)如何移除冗余连接?

剪枝技术基于一个重要发现:神经网络中存在大量对最终预测结果贡献微小的连接。通过识别并移除这些冗余连接,可以在保持模型性能的同时大幅减少参数量。

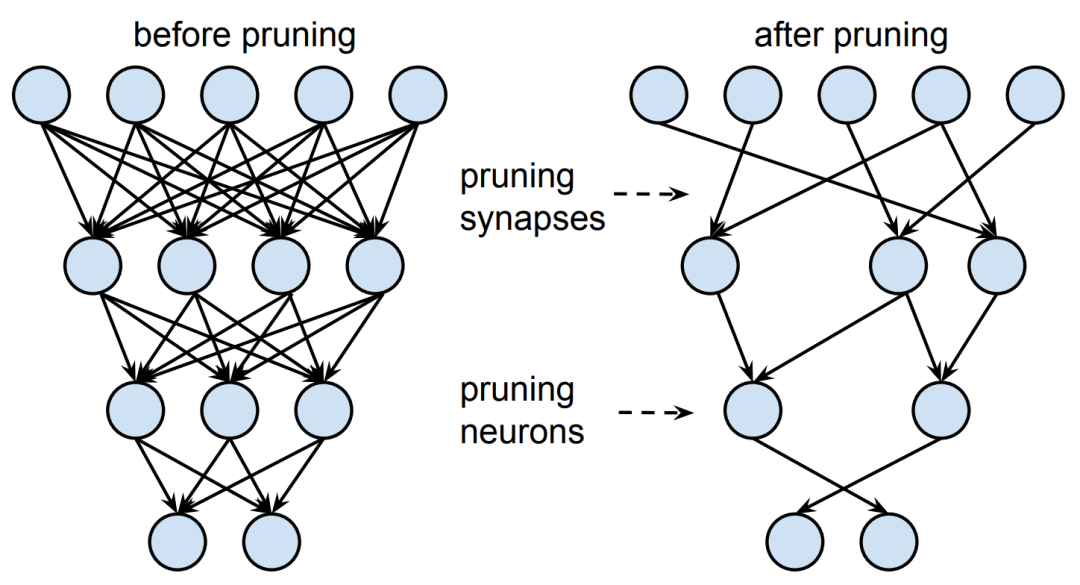

(1)结构化剪枝:移除整个神经元、通道或层

- 优势:保持规整的网络结构,便于硬件优化

- 劣势:压缩粒度较粗,压缩率相对较低

(2)非结构化剪枝:移除单个权重连接

- 优势:压缩粒度细,可以达到更高的压缩率

- 劣势:产生稀疏矩阵,硬件加速困难

1. 重要性评估 → 计算每个连接/神经元的重要性分数2. 剪枝策略制定 → 确定剪枝比例和优先级3. 执行剪枝 → 移除低重要性的连接4. 微调恢复 → 通过继续训练补偿性能损失5. 迭代优化 → 重复上述过程直到满足要求

二、量化(Quantization):降低数值精度

量化技术(Quantization)如何降低数值精度?

量化技术通过降低模型参数的数值精度来实现压缩。最常见的是将32位浮点数(FP32)转换为8位整数(INT8),在几乎不影响精度的情况下实现4倍的存储压缩和显著的计算加速。

(1)训练后量化(Post-training Quantization, PTQ)

- 特点:在已训练模型基础上直接量化

- 优势:实现简单,无需重新训练

- 适用:对精度要求不是极其严格的场景

(2)量化感知训练(Quantization-aware Training, QAT)

- 特点:训练过程中模拟量化操作

- 优势:精度损失更小,效果更好

- 适用:对精度要求严格的关键应用

三、知识蒸馏(Knowledge Distillation):师生传承

知识蒸馏(Knowledge Distillation)如何进行师生传承?

知识蒸馏采用"教师-学生"模式,让大模型(教师)指导小模型(学生)学习。关键创新在于使用"软标签"而非传统的"硬标签"进行训练。

(1)传统硬标签:[1, 0, 0] - 只告诉模型正确答案

(2)软标签概率:[0.8, 0.15, 0.05] - 还包含类别间的相似性信息

软标签包含了教师模型的"经验知识",帮助学生模型更好地理解数据的内在分布和特征关系。

损失函数 = α × 蒸馏损失(软标签) + (1-α) × 任务损失(硬标签)

通过平衡两种损失,学生模型既能学习真实任务目标,又能继承教师模型的知识经验。

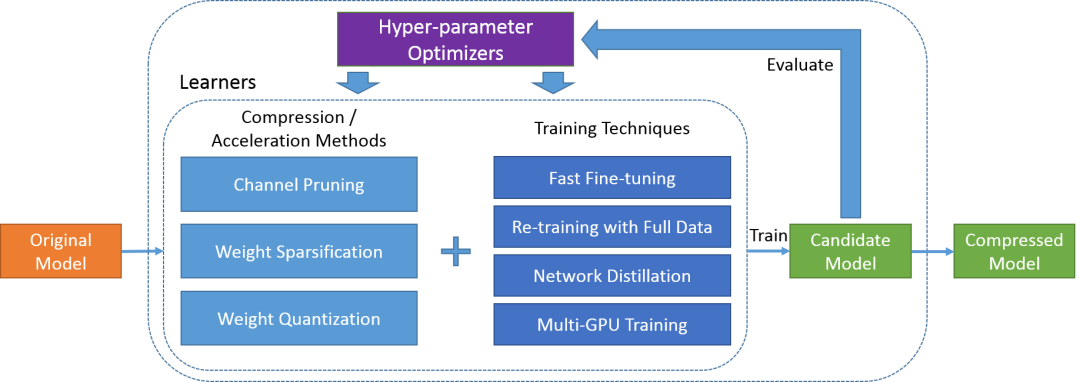

四、技术组合(蒸馏 + 剪枝 + 量化)

如何进行技术组合(蒸馏 + 剪枝 + 量化)?

虽然每种压缩技术都有其独特优势,但单独使用往往难以达到最佳效果。

- 仅剪枝:主要减少参数量,但精度表示仍然冗余

- 仅量化:降低存储和计算开销,但网络结构仍然复杂

- 仅知识蒸馏:获得紧凑模型,但可能还有进一步优化空间

根据实践经验,推荐的技术组合顺序为:知识蒸馏 → 剪枝 → 量化。

第一阶段:知识蒸馏

- 从基线模型开始,训练得到结构优化的小模型

- 这一步解决了网络架构冗余问题

- 为后续优化提供更好的起点

第二阶段:剪枝优化

- 在蒸馏得到的小模型基础上进行剪枝

- 移除剩余的冗余连接和神经元

- 进一步减少参数量和计算量

第三阶段:量化压缩

- 对剪枝后的模型进行量化

- 实现最终的存储和计算优化

- 获得部署就绪的压缩模型

实际应用案例有哪些?

案例1:移动端图像分类(手机相册自动分类功能)

(1)原始模型:ResNet-50,98MB,95%准确率,150ms推理时间

(2)优化流程:

- 知识蒸馏:ResNet-50→MobileNet-v3,25MB,93%准确率

- 结构化剪枝:移除30%通道,18MB,92.5%准确率

- INT8量化:最终6MB,92%准确率,35ms推理时间

最终效果:

- 模型大小:98MB → 6MB(16倍压缩)

- 推理速度:150ms → 35ms(4.3倍加速)

- 准确率:95% → 92%(3%下降,用户无感知)

案例2:边缘设备语音识别(智能音箱离线语音识别)

(1)原始模型:Transformer语音模型,200MB,延迟300ms

2)优化策略:

- 知识蒸馏:12层→6层,减少一半参数

- 注意力头剪枝:16头→8头,保持关键信息

- 混合精度量化:重要层INT8,一般层INT4

部署效果:

- 模型大小:200MB → 15MB(13倍压缩)

- 响应延迟:300ms → 80ms(3.8倍提升)

- 识别准确率:96% → 94%(2%下降,满足需求)

- 支持完全离线工作,无需网络连接

**

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)