FlexGen: 在单个GPU上高效运行大型语言模型

FlexGen的出现为在有限硬件资源下运行大型语言模型提供了新的可能性。它不仅降低了LLM应用的硬件门槛,也为吞吐量导向的场景提供了高效的解决方案。随着技术的不断进步,我们可以期待FlexGen在未来为更多创新应用铺平道路,推动大型语言模型的普及和应用。无论您是研究人员、开发者还是对LLM感兴趣的爱好者,FlexGen都值得您深入了解和尝试。让我们一起期待FlexGen为人工智能领域带来更多突破性

FlexGen:突破硬件限制,让大模型在单GPU上高效运行

随着大型语言模型(LLM)的快速发展,其巨大的计算和内存需求使得只有拥有多个高端加速器的机构才能负担得起推理成本。然而,一个名为FlexGen的创新项目正在改变这一现状,为在有限硬件资源下运行LLM开辟了新的可能性。

FlexGen的核心理念

FlexGen是由来自斯坦福大学、加州大学伯克利分校等机构的研究人员开发的高吞吐量生成引擎。其核心理念是通过灵活的内存管理和优化技术,在有限的GPU资源下实现LLM的高效运行。

FlexGen的主要特点包括:

-

灵活的资源聚合:可以灵活地聚合GPU、CPU和磁盘的内存和计算资源。

-

智能的张量存储和访问:通过求解线性规划问题,搜索高效的张量存储和访问模式。

-

高效的压缩技术:将权重和注意力缓存压缩到4位,几乎不损失精度。

-

大批量处理:支持更大的批处理空间,显著提高最大吞吐量。

这些技术使FlexGen能够在单个商用GPU上运行如OPT-175B等超大模型,为吞吐量导向的场景提供了新的可能性。

FlexGen的应用场景

FlexGen主要针对吞吐量导向的场景进行优化,这些场景对延迟不敏感,但需要处理大量数据。典型的应用包括:

- 基准测试:如运行HELM基准测试

- 信息提取:从大规模文档中提取结构化信息

- 数据整理:处理和转换大量非结构化数据

- 表单处理:自动化处理大量表单文档

在这些场景中,FlexGen可以充分发挥其高吞吐量的优势,在单个GPU上实现高效的批处理。

FlexGen的性能表现

在实际测试中,FlexGen展现出了令人印象深刻的性能:

- 在单个16GB的T4 GPU上运行OPT-175B模型,实现了1 token/s的生成吞吐量,有效批处理大小为256。

- 在运行OPT-30B模型时,FlexGen的吞吐量比现有的离线系统高出10倍以上。

- 在HELM基准测试中,FlexGen可以在21小时内用16GB GPU完成30B模型的7个代表性子场景的测试。

这些性能数据充分证明了FlexGen在有限资源下运行大型语言模型的能力。

FlexGen的工作原理

FlexGen采用了一系列创新技术来实现高效的LLM推理:

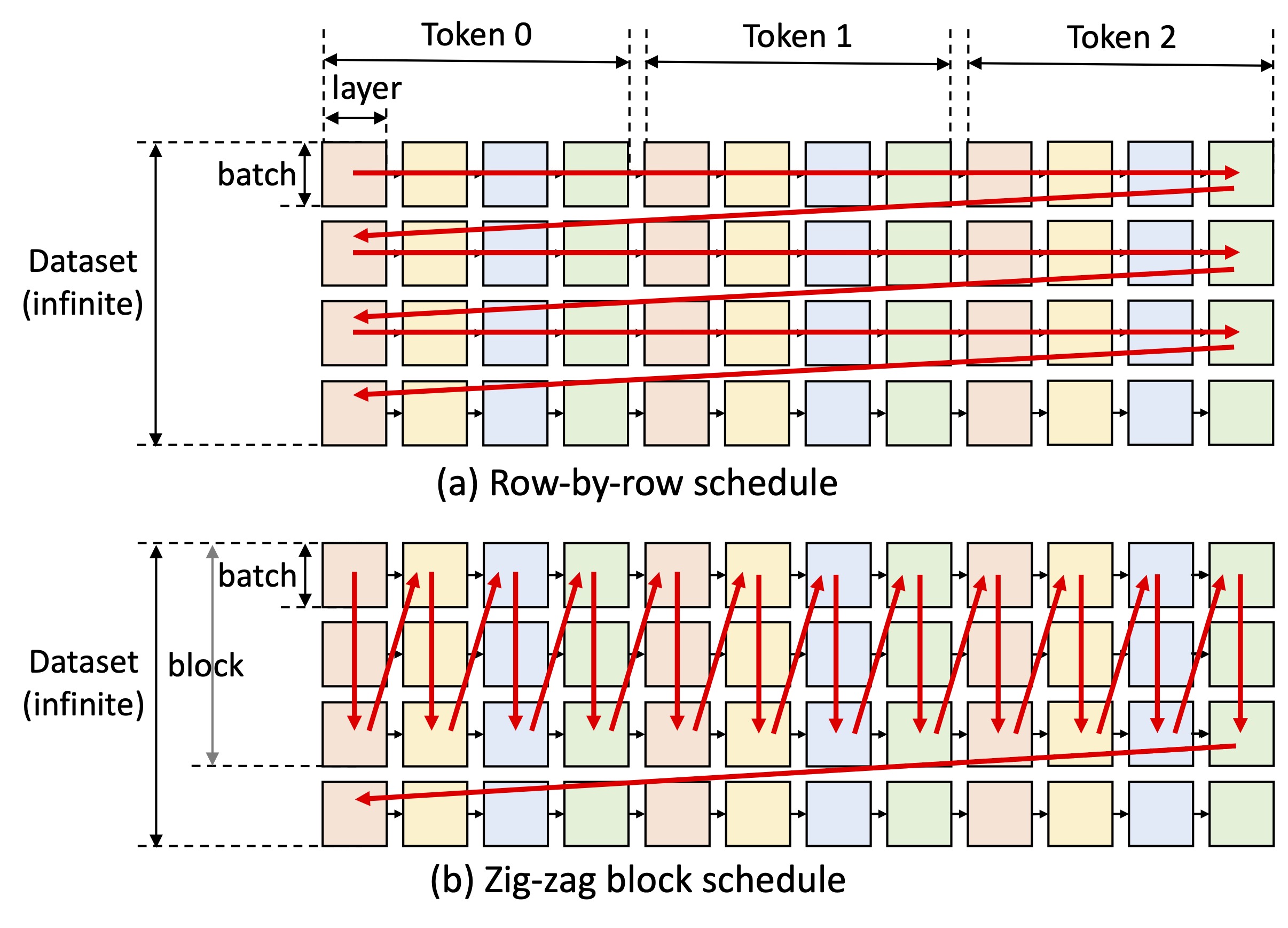

- 块调度:通过重用权重和重叠I/O与计算来提高效率。

- 线性规划优化:搜索最佳的张量存储和访问模式。

- 4位量化:对权重和KV缓存进行压缩,几乎不损失精度。

- 延迟-吞吐量权衡:牺牲一定的延迟来换取更高的吞吐量。

这些技术的结合使FlexGen能够在有限的硬件资源下实现LLM的高效运行。

FlexGen的使用方法

FlexGen提供了简单易用的API,使用者可以通过以下步骤快速上手:

- 安装FlexGen:

pip install -e .

- 运行示例:

python3 -m flexgen.flex_opt --model facebook/opt-1.3b

- 对于更大的模型,可以使用CPU卸载:

python3 -m flexgen.flex_opt --model facebook/opt-30b --percent 0 100 100 0 100 0

FlexGen还提供了丰富的配置选项,用户可以根据自己的硬件资源和需求进行灵活调整。

FlexGen的未来发展

作为一个开源项目,FlexGen正在不断发展和完善。未来的发展方向包括:

- 优化多GPU同机性能

- 支持更多模型(如BLOOM、CodeGen、GLM等)

- 发布成本模型和策略优化器

- 支持Macbook(M1和M2)和AMD平台

这些改进将进一步提升FlexGen的性能和适用性,使其能够服务于更广泛的应用场景。

结语

FlexGen的出现为在有限硬件资源下运行大型语言模型提供了新的可能性。它不仅降低了LLM应用的硬件门槛,也为吞吐量导向的场景提供了高效的解决方案。随着技术的不断进步,我们可以期待FlexGen在未来为更多创新应用铺平道路,推动大型语言模型的普及和应用。

无论您是研究人员、开发者还是对LLM感兴趣的爱好者,FlexGen都值得您深入了解和尝试。让我们一起期待FlexGen为人工智能领域带来更多突破性的进展。

文章链接:www.dongaigc.com/a/flexgen-efficient-gpu-language-models

https://www.dongaigc.com/a/flexgen-efficient-gpu-language-models

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)