AFSim仿真系统—61 图像处理器

本栏目将对《AFSim 2.9中文参考手册》进行持续更新,欢迎关注交流!对本书全文和AFSIM其它资料感兴趣的伙伴,可联系作者领取~全部内容索引请看 ⬇️⬇️⬇️《AFSim 2.9中文参考手册》-CSDN博客编辑编辑https://blog.csdn.net/henggesim/article/details/145566384AFSIM配套视频教程请看 ⬇️⬇️⬇️。

本栏目将对《AFSim 2.9中文参考手册》进行持续更新,欢迎关注交流!

对本书全文和AFSIM其它资料感兴趣的伙伴,可联系作者领取~

全部内容索引请看 ⬇️⬇️⬇️

AFSIM配套视频教程请看 ⬇️⬇️⬇️afsim2.9官方培训视频教程https://space.bilibili.com/3546837967440641编辑https://space.bilibili.com/3546837967440641![]() https://space.bilibili.com/3546837967440641

https://space.bilibili.com/3546837967440641

processor <name> WSF_IMAGE_PROCESSOR

processor Commands ...

Platform Part Commands ...

... External Link Commands ...

... WSF_MESSAGE_PROCESSOR Commands ...

... WSF_SCRIPT_PROCESSOR Commands ...

coast_time ...

filter ... end_filter

reports_velocity

reports_side

reports_type

reports_bearing_elevation

message_length ...

message_priority ...

include_unstable_covariance ...

include_unstable_residual_covariance ...

target_recognition ...

... Target Recognition Commands ...

# Script Interface

on_initialize ... end_on_initialize

on_initialize2 .. end_on_initialize2

on_update ... end_on_update

script_variables ... end_script_variables

scripts ... end_script

... Other Script Commands ...

end_processor

WSF_IMAGE_PROCESSOR 概述

WSF_IMAGE_PROCESSOR 从成像传感器(如 WSF_EOIR_SENSOR 或 WSF_SAR_SENSOR)接收图像数据并生成轨迹。这提供了一种简单的能力来模拟分析员查看图像并生成可操作的信息。可以使用 WSF_MESSAGE_PROCESSOR 的功能通过延迟接收传入的图像消息来模拟处理延迟。

典型使用结构

在平台定义中,WSF_IMAGE_PROCESSOR 通常用于以下结构:

platform_type ...

sensor eoir WSF_EOIR_SENSOR

...

# 将图像转发到 'image_proc'

internal_link image_proc

end_sensor

processor image_proc WSF_IMAGE_PROCESSOR

...

# 将提取的 'tracks' 转发到 'track_proc'

internal_link track_mgr

end_processor

processor track_proc WSF_TRACK_PROCESSOR

...

# 隐式地从 'image_proc' 获取轨迹并更新 track_manager

end_processor

end_platform_type接受的消息类型

- WSF_IMAGE_MESSAGE:来自 WSF_SAR_SENSOR 在“spot”模式下操作的静态图像。

- WSF_VIDEO_MESSAGE:来自 WSF_EOIR_SENSOR 或 WSF_SAR_SENSOR 在“strip”模式下操作的视频流的单帧。

每个上述消息都包含一个 WsfImage 对象,反映了图像中可见的对象。处理器然后为图像中的每个对象创建或更新轨迹。

静态图像处理

对于静态图像,处理过程如下:

- 为图像中的每个对象创建一个新的临时轨迹,并分配新的轨迹 ID。

- 将轨迹中的报告位置设置为图像中的“测量”位置。

- 将轨迹中的报告速度设置为零。

- 如果需要,设置报告的类型和阵营。

- 发送包含新轨迹的 WSF_TRACK_MESSAGE。

注意,每个静态图像中的每个对象都会获得一个唯一的轨迹 ID,不会保留关于以前处理的静态图像的记忆。

视频流处理

对于视频流,以下过程针对图像中的每个对象重复:

- 如果对象没有现有轨迹,则创建轨迹,并在需要时启动过滤器。

- 如果定义了过滤器:

- 使用图像中对象的“测量”位置更新过滤器。

- 使用过滤器的位置信息和速度估计更新轨迹。

- 更新轨迹的状态和残差协方差(在过滤器未“成熟”时可能会抑制)。

- 如果未定义过滤器:

- 使用图像中对象的“测量”位置更新轨迹。

- 如果指定了 reports_velocity,则使用与对象关联的平台的真实速度更新轨迹。

- 如果需要,设置报告的类型和阵营。

- 发送包含新或更新轨迹的 WSF_TRACK_MESSAGE。

在处理完图像中的所有对象后,旧轨迹将被清除。任何自上次更新以来超过 coast_time 的轨迹将被清除,并发送 WSF_DROP_TRACK_MESSAGE。

目标识别

如果启用了 target_recognition 标志,WSF_IMAGE_PROCESSOR 将尝试基于评估图像中的像素数量和相关的 Johnson 标准方程进行目标检测、识别和分类。

注意事项

仅WSF_IMAGE_MESSAGE和WSF_VIDEO_MESSAGE消息类型由 WSF_IMAGE_PROCESSOR 处理。所有其他类型的传入消息将被丢弃。

轨迹管理命令

- coast_time <time-value>

指定在更新之间可能经过的最大时间,超过此时间轨迹将被丢弃。轨迹仅在接收到包含对象的消息时进行评估。

默认值:0 秒(无漂移时间)

过滤器命令

- filter <filter_type> <filter_parameters> end_filter

过滤器用于从传入的视频流中生成平滑的位置和速度估计。<filter-type> 可以是预定义的过滤器类型之一或从这些类型派生的过滤器,参见:4.5.4滤波器filter 。

默认值:无过滤器

注意:过滤器不应用于静态图像。

报告选项

- reports_velocity

指示是否在生成的轨迹中报告速度。此命令仅适用于输入为视频流且未定义过滤器的情况。在以下情况下将始终报告速度:

如果定义了过滤器,并且接收到足够的更新以生成可靠的速度。

对于静态图像,将报告速度为零。

- reports_type

指示是否在生成的轨迹中报告“类型”。

默认值:不报告“类型”。

- reports_side

指示是否在生成的轨迹中报告“阵营”。

默认值:不报告“阵营”。

- reports_bearing_elevation

指示轨迹是否应填充方位角和仰角而不是位置信息。

注意:此功能不应与过滤器一起使用。

默认值:报告位置而不是方位角和仰角。

消息配置

- message_length <data-size-value>

指定从图像创建的轨迹消息的逻辑长度。

默认值:0(使用从 message_table 派生的值,参见:4.14消息表message_table )

- message_priority <integer-priority>

指定从图像创建的轨迹消息的优先级。

默认值:0(使用从 message_table 派生的值,参见:4.14消息表message_table )

其他选项

- include_unstable_covariance <boolean-value>

- include_unstable_residual_covariance <boolean-value>

当使用过滤器时,状态协方差和残差协方差在初始创建期间以及可能在一两个更新中不可靠。当这些值为 false(默认值)时,这些不可靠的值不会传递到输出轨迹。

默认值:false

- target_recognition <boolean-value>

启用此处理器的目标识别功能,用于目标检测、分类和识别。参见:3.3.34.1目标识别命令Target Recognition Commands。

脚本接口

WSF_IMAGE_PROCESSOR 利用通用脚本接口、WSF_MESSAGE_PROCESSOR 和 WSF_SCRIPT_PROCESSOR 的功能。这些接口允许用户编写自定义脚本来处理和分析图像数据。

目标识别命令Target Recognition Commands

average_aspect_ratio ...

detection_scene_analysis_factor ...

classification_scene_analysis_factor ...

identification_scene_analysis_factor ...

minimum_detection_pixel_count ...

minimum_classification_pixel_count ...

minimum_identification_pixel_count ...

detection_delay_time ...

classification_delay_time ...

identification_delay_time ...

transition_coast_time ...

detection_coast_time ...

classification_coast_time ...

identification_coast_time ...

目标识别概述

在 WSF_IMAGE_PROCESSOR 中,当 target_recognition 标志设置为 true 时,启用目标识别功能。在此模式下,处理器尝试检测、分类和/或识别当前评估图像中的所有“对象”(平台)。这些决策基于对象平台占据的像素数量,使用以下 Johnson 标准方程:

检测标准

对象被声明为“检测到”,当满足以下条件时:

- 对象占据的像素数量达到 minimum_detection_pixel_count 指定的数量。

- 对象通过 Johnson 标准的“检测”标准。

- 对象满足这两个条件的时间至少达到 detection_delay_time 指定的最短时间。

分类标准

对象被声明为“已分类”,当满足以下条件时:

- 对象已经通过“检测到”状态。

- 对象占据的像素数量达到 minimum_classification_pixel_count 指定的数量。

- 对象通过 Johnson 标准的“分类”标准。

- 对象满足后两个条件的时间至少达到 classification_delay_time 指定的最短时间。

识别标准

对象被声明为“已识别”,当满足以下条件时:

- 对象已经通过“已分类”状态。

- 对象占据的像素数量达到 minimum_identification_pixel_count 指定的数量。

- 对象通过 Johnson 标准的“识别”标准。

- 对象满足后两个条件的时间至少达到 identification_delay_time 指定的最短时间。

轨迹更新

当一个对象被声明为“检测到”时,会通过内部链接发出代表该对象的轨迹。只要从成像传感器接收到更新,轨迹将继续被更新和发出。以下附加信息将包含在轨迹中以指示当前状态:

- 检测状态:指示对象当前已达到的识别状态(检测到、已分类、已识别)。

- 像素占用信息:对象在图像中占据的像素数量。

- 延迟时间信息:对象在特定状态下所需的最短时间。

|

State |

AuxDataDouble(“CLASSIFIED”) |

AuxDataDouble(“IDENTIFIED”) |

Type() |

|

DETECTED |

-1 |

-1 |

“UNKNOWN” |

|

CLASSIFIED |

<time> |

-1 |

<platform-type> |

|

IDENTIFIED |

<time> |

<time> |

<platform-type> |

在 WSF_IMAGE_PROCESSOR 中,aux_data 变量 CLASSIFIED 和 IDENTIFIED 表示对象最近一次被分类为该状态的时间。如果对象不在该状态,则其值为 -1。

实施注意事项

状态不可逆:在当前实现中,一旦对象达到某个状态(如检测到、已分类或已识别),它将不会被重置为较低的状态。这意味着一旦对象被标记为“已分类”或“已识别”,即使条件不再满足,它也不会自动降级到“检测到”或“未检测到”状态。

用户责任:用户需要检查数据并确定信息是否可用。这意味着在使用这些状态信息时,用户应根据具体应用场景和需求来判断数据的有效性和可靠性。

识别参数

- average_aspect_ratio <real-reference>

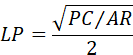

定义在将伪图像中的原始像素计数转换为线对数时使用的平均纵横比。如果 AR 是此命令定义的平均纵横比,而 PC 是伪图像中对象的原始像素计数,则线对数 LP 定义为:

默认值:4.0

场景分析因子

- detection_scene_analysis_factor <real-reference>

- classification_scene_analysis_factor <real-reference>

- identification_scene_analysis_factor <real-reference>

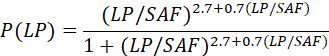

定义 Johnson 标准方程中用于检测、分类或识别的“场景分析因子”(SAF)。方程为:

其中 LP 是线对数,SAF 是适当的场景分析函数。

默认值:检测:1.0,分类:4.0,识别:6.4

最小像素计数

- minimum_detection_pixel_count <real-reference>

- minimum_classification_pixel_count <real-reference>

- minimum_identification_pixel_count <real-reference>

定义对象在图像中必须占据的最小像素数量,以便可能被检测、分类或识别。对象必须通过像素计数测试和 Johnson 标准测试才能达到给定状态。

默认值:0

延迟时间

- detection_delay_time <time-reference>

定义对象必须满足“检测”标准的时间量,直到其被声明为“检测到”。在延迟时间内,不满足“检测”标准的检测将导致状态重置为“未检测到”,除非定义了 transition_coast_time。

默认值:0 秒

- classification_delay_time <time-reference>

定义对象必须满足“分类”标准的时间量,直到其被声明为“已分类”。在延迟时间内,不满足“分类”标准的检测将导致状态重置为“检测到”或“未检测到”(取决于失败检测的质量),除非定义了 transition_coast_time。

默认值:0 秒

- identification_delay_time <time-reference>

定义对象必须满足“识别”标准的时间量,直到其被声明为“已识别”。在延迟时间内,不满足“识别”标准的检测将导致状态重置为“已分类”、“检测到”或“未检测到”(取决于失败检测的质量),除非定义了 transition_coast_time。

默认值:0 秒

漂移时间

- transition_coast_time <time-reference>

定义对象在状态之间的过渡期间(由 detection_delay_time、classification_delay_time 和 identification_delay_time 定义)可以“漂移”而不接收到“可接受检测”的时间量。“可接受检测”是至少满足目标状态检测标准的检测。

默认值:0 秒

- detection_coast_time <time-reference>

- classification_coast_time <time-reference>

- identification_coast_time <time-reference>

定义对象在没有接收到不满足该状态 Johnson 标准的检测的情况下可以保持在状态中的时间量。

默认值:0 秒

注意:这目前是一种调查能力,不影响生成的轨迹。

这些命令提供了详细的配置选项,以便在图像处理中实现精确的目标识别和状态管理。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)