大模型与边缘联邦学习在无线网络中的协同

摘要:基础模型(Foundation Models,简称FMs)是通用型人工智能模型,最近推动了多个全新生成式AI应用的发展。FMs的快速进步为下一代无线网络的愿景提供了重要的背景支持,在这些网络中,联邦学习(Federated Learning,简称FL)是分布式网络智能的关键使能技术。自然地,FMs有能力提升FL的性能,而FL也可以利用分散的数据和计算资源来辅助FMs的训练。特别是,我们讨论了

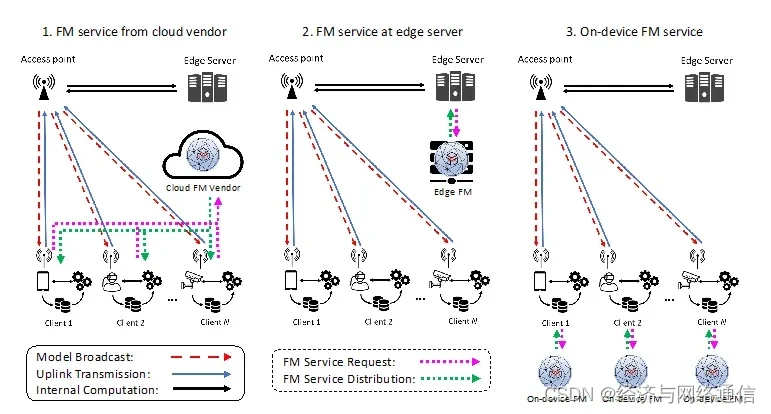

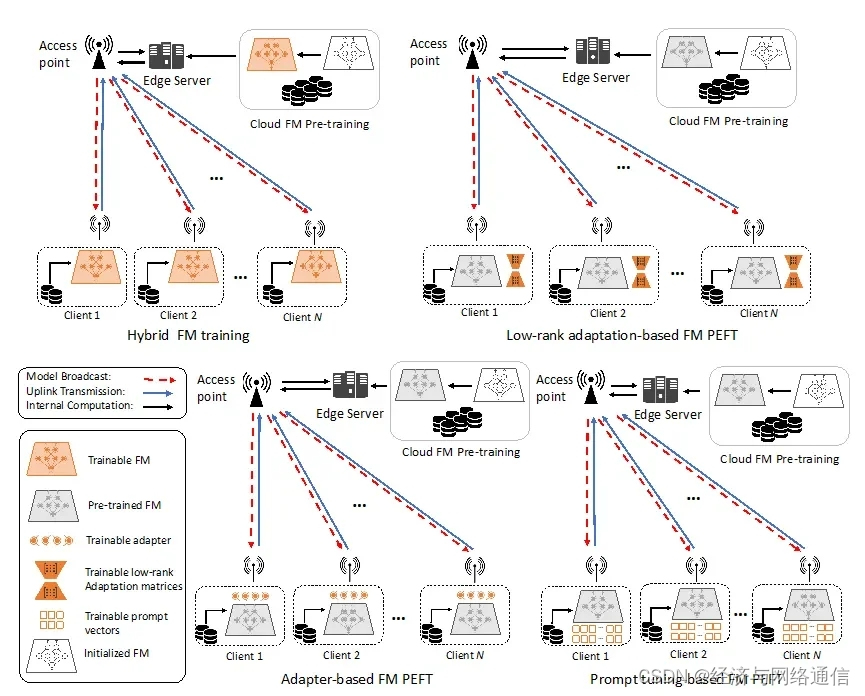

摘要:基础模型(Foundation Models,简称FMs)是通用型人工智能模型,最近推动了多个全新生成式AI应用的发展。FMs的快速进步为下一代无线网络的愿景提供了重要的背景支持,在这些网络中,联邦学习(Federated Learning,简称FL)是分布式网络智能的关键使能技术。目前,关于FMs与FL相互作用的研究仍处于初步阶段。自然地,FMs有能力提升FL的性能,而FL也可以利用分散的数据和计算资源来辅助FMs的训练。然而,FMs对计算资源、存储和通信开销的极高要求将对FL支持的无线网络带来关键挑战。本文探讨了FMs在无线网络中适用FL的程度,并概述了研究挑战和机遇。特别是,我们讨论了实现集成FMs和FL的未来智能网络的多种新范式,并整合了与这些范式相关的几个广泛的研究方向。

题目:The Role of Federated Learning in a Wireless World with Foundation Models

作者:Zihan Chen, Howard H. Yang, Y.C. Tay, Kai Fong Ernest Chong, Tony Q.S. Quek

论文PDF:https://arxiv.org/abs/2310.04003

论文PDF:https://arxiv.org/abs/2310.04003

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)