【论文泛读35】基于注意力的双向长短期记忆网络关系分类

贴一下汇总贴:论文阅读记录论文链接:《Attention-Based Bidirectional Long Short-Term Memory Networks for Relation Classification》一、摘要关系分类是自然语言处理领域中一项重要的语义处理任务。最先进的系统仍然依赖词汇资源,如WordNet或NLP系统,如依赖解析器和命名实体识别器(NER)来获得高级功能。另一个挑

贴一下汇总贴:论文阅读记录

论文链接:《Attention-Based Bidirectional Long Short-Term Memory Networks for Relation Classification》

一、摘要

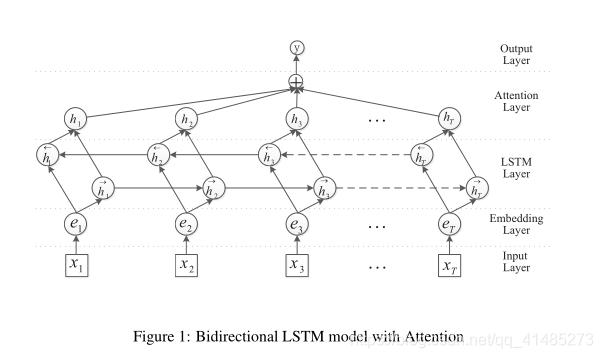

关系分类是自然语言处理领域中一项重要的语义处理任务。最先进的系统仍然依赖词汇资源,如WordNet或NLP系统,如依赖解析器和命名实体识别器(NER)来获得高级功能。另一个挑战是重要信息可以出现在句子的任何位置。为了解决这些问题,我们提出了基于注意的双向长短期记忆网络来获取句子中最重要的语义信息。在SemEval-2010关系分类任务上的实验结果表明,我们的方法优于现有的大多数方法,只有词向量。

二、结论

在这篇文章中,我们提出了一个新的神经网络模型,命名为Att-BLSTM,用于关系分类。该模型不依赖NLP工具或词汇资源来获取,它使用带有位置指示器的原始文本作为输入。通过对SemEval-2010关系分类任务模型的评估,验证了AttBLSTM的有效性。

三、模型分析

Bidirectional LSTM + Attention

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)