悬案:windows,在docker里运行ollama,一直没成功(一直是CPU跑,调不起来GPU),现在又突然好了。

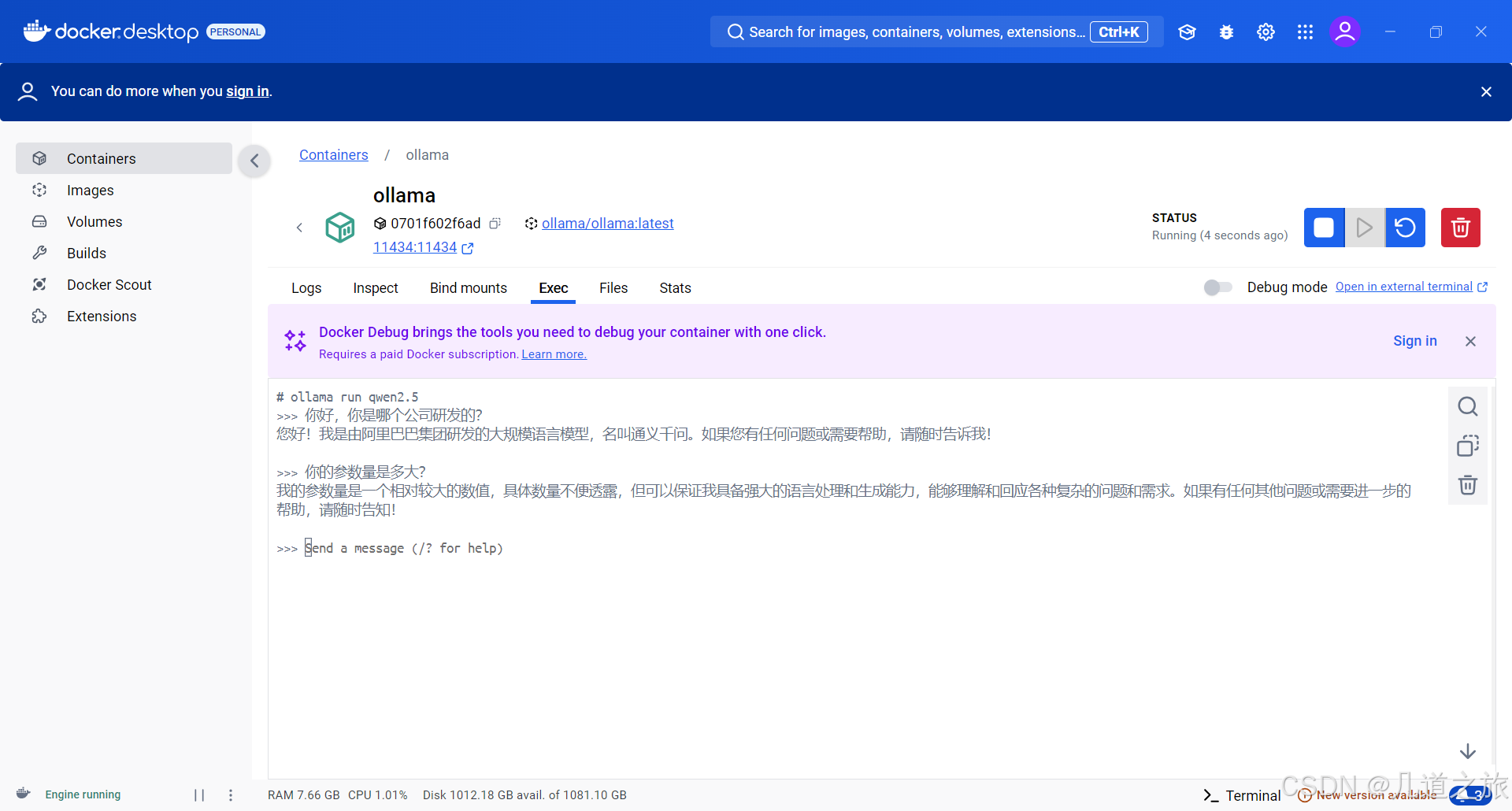

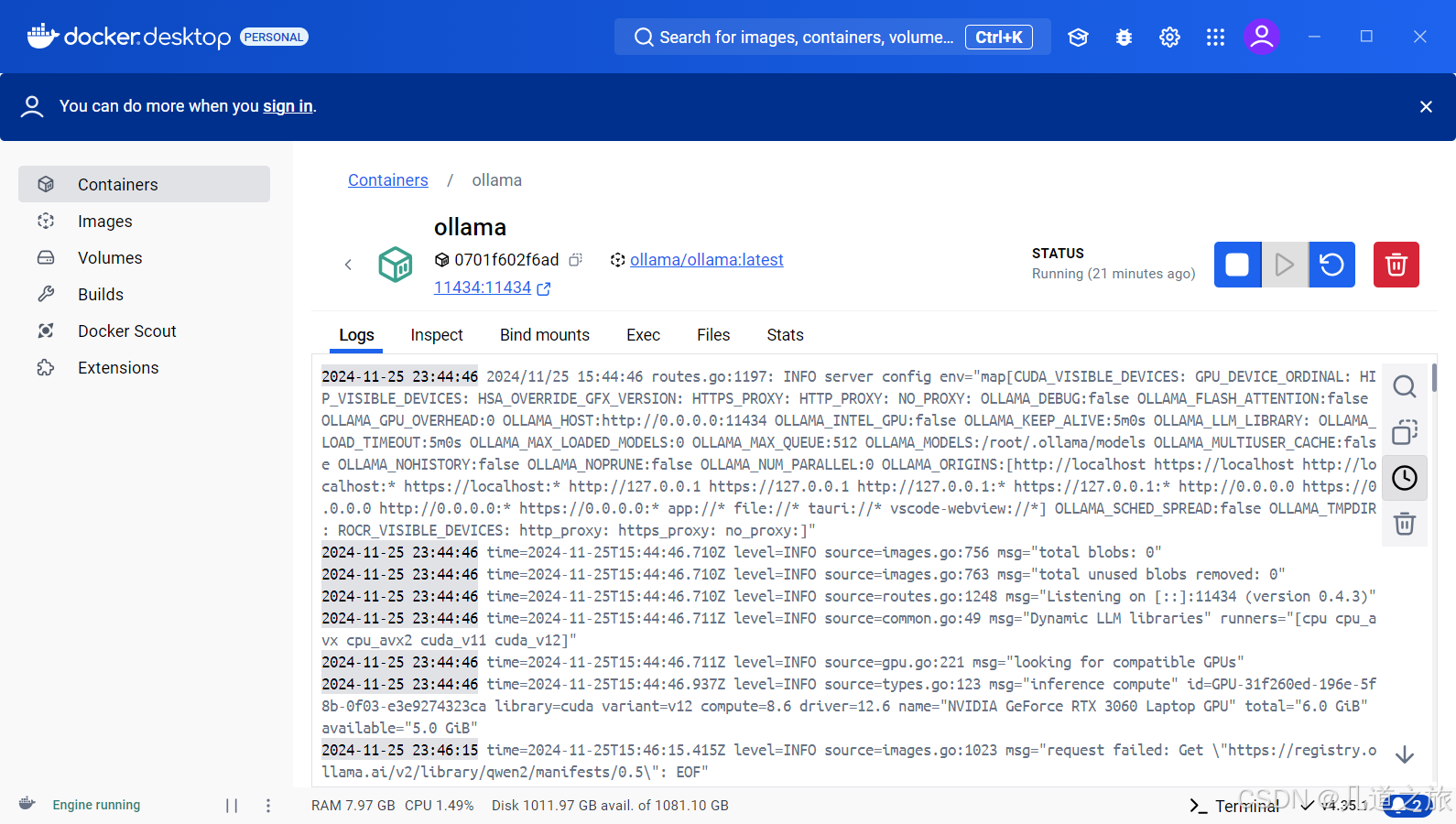

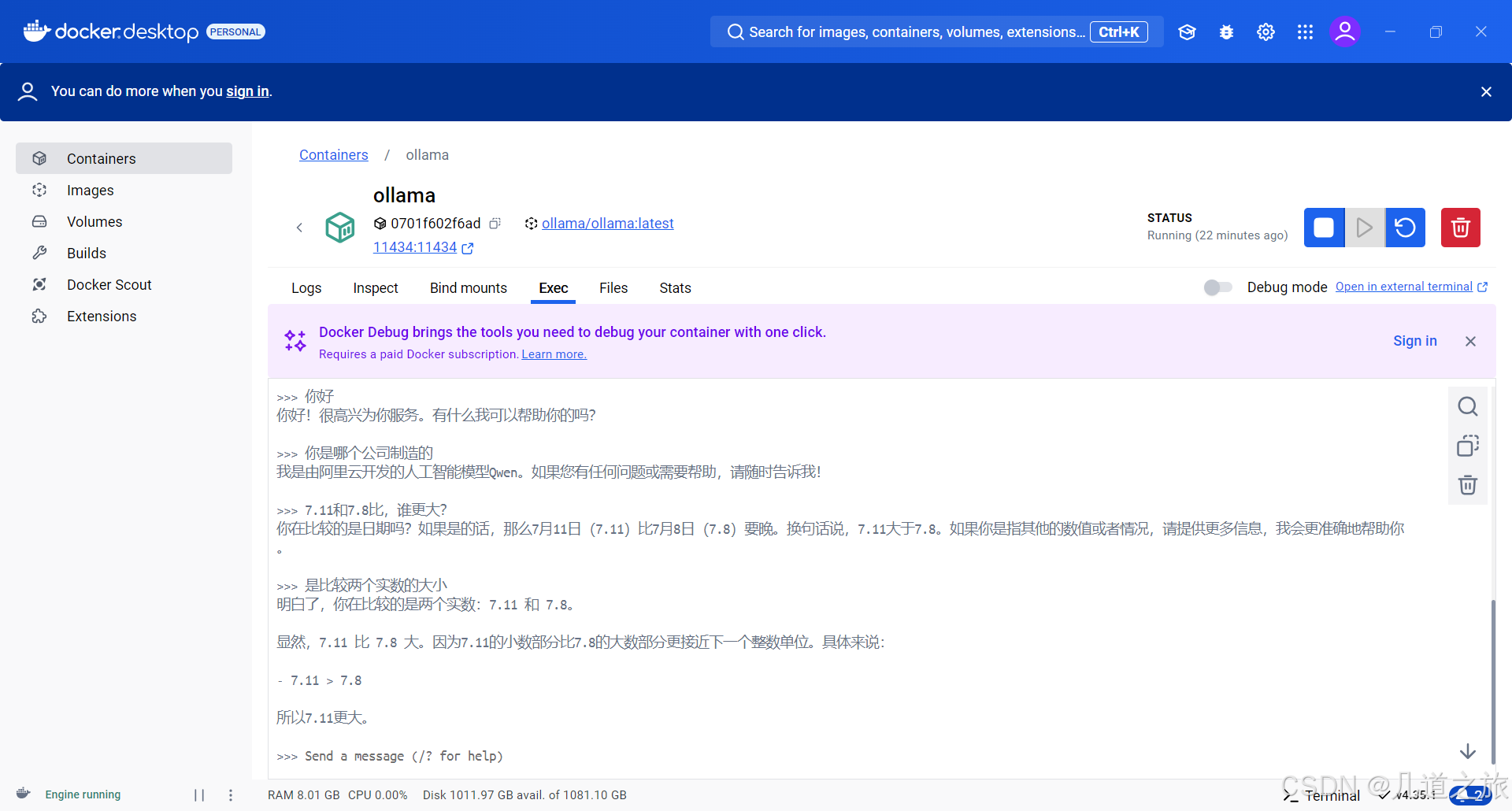

这些报错,可以在logs这里看到(我这个展示的是没报错的情况,只是告诉大家,可以检查一下这个位置是不是跟我下面的图一样,还是说包含了上面的这个错误,如果是后者,就要当心了。因为最开始,我的ollama总是无法调起GPU,只能用CPU来跑。比较恐怖的是,这个错误,不仅会影响ollama的运行,任何跟pytorch有关的都会报错。也在网上找了很久的解决方案,中文的英文的,都找遍了,也没解决。重装后,问

背景

上回说道,我们可以在windows上用docker desktop部署ollama。

具体的效果为:

但这事儿,在我这儿也没那么顺利。

因为最开始,我的ollama总是无法调起GPU,只能用CPU来跑。如今,这个错误已无法实现,具体的报错信息,只能参考下面这些当时的记录:

docker desktop可以运行nvidia-smi,但pytorch无法使用GPU

rom cudaGetDeviceCount(). Did you run some cuda functions before calling NumCudaDevices() that might have already set an error? Error 500: named symbol not found (Triggered internally at ../c10/cuda/CUDAFunctions.cpp:108.)

return torch._C._cuda_getDeviceCount() > 0

这些报错,可以在logs这里看到(我这个展示的是没报错的情况,只是告诉大家,可以检查一下这个位置是不是跟我下面的图一样,还是说包含了上面的这个错误,如果是后者,就要当心了。):

比较恐怖的是,这个错误,不仅会影响ollama的运行,任何跟pytorch有关的都会报错。当时真的是被折磨了很久。

也在网上找了很久的解决方案,中文的英文的,都找遍了,也没解决。

最后,我突发奇想,要不我重装docker吧!

重装后,问题莫名奇妙地被解决了。原来的错也无法被复现了。

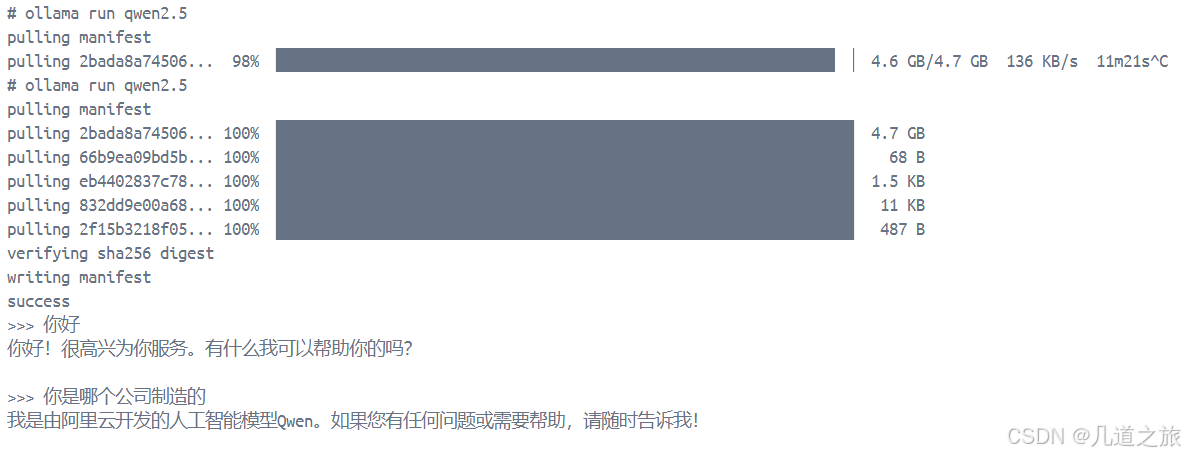

展示模型下载的情况

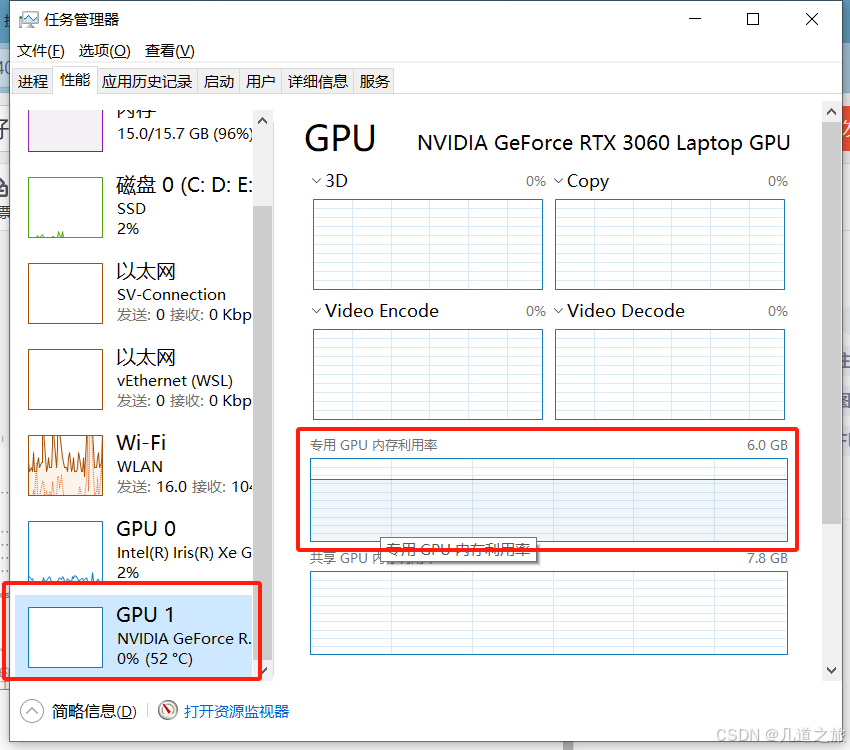

展示当前GPU已经被用起来了,之前一直不可以

展示Qwen2.5依然无法解决这道著名的问题

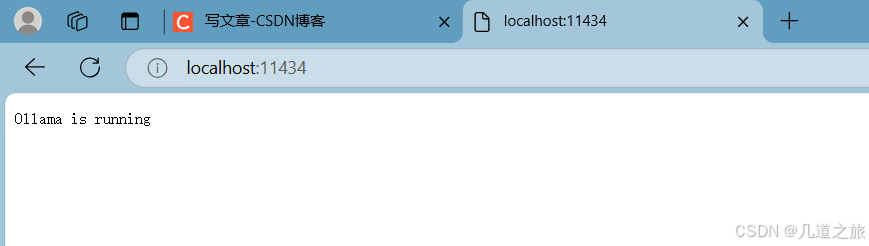

展示在浏览器中测试ollama的端口(11434)

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)