本地运行deepseek,给大家分享一下我的安装步骤:

1、进入Ollama官网。(图1)2、下载3、下载完毕后,在资源管理器找到它,双击运行4、点击install5、安装完毕后,在菜单或者桌面右下角托盘处可以找到它,打开。6、测试是否安装成功按下WIN+R键,打开“运行”对话框,输入cmd,然后按下回车键,打开命令提示符。通过运行ollama help命令,如果命令行没有报错,并且显示了上述帮助信息,说明Ollama安装成功。7、下载DeepSeek

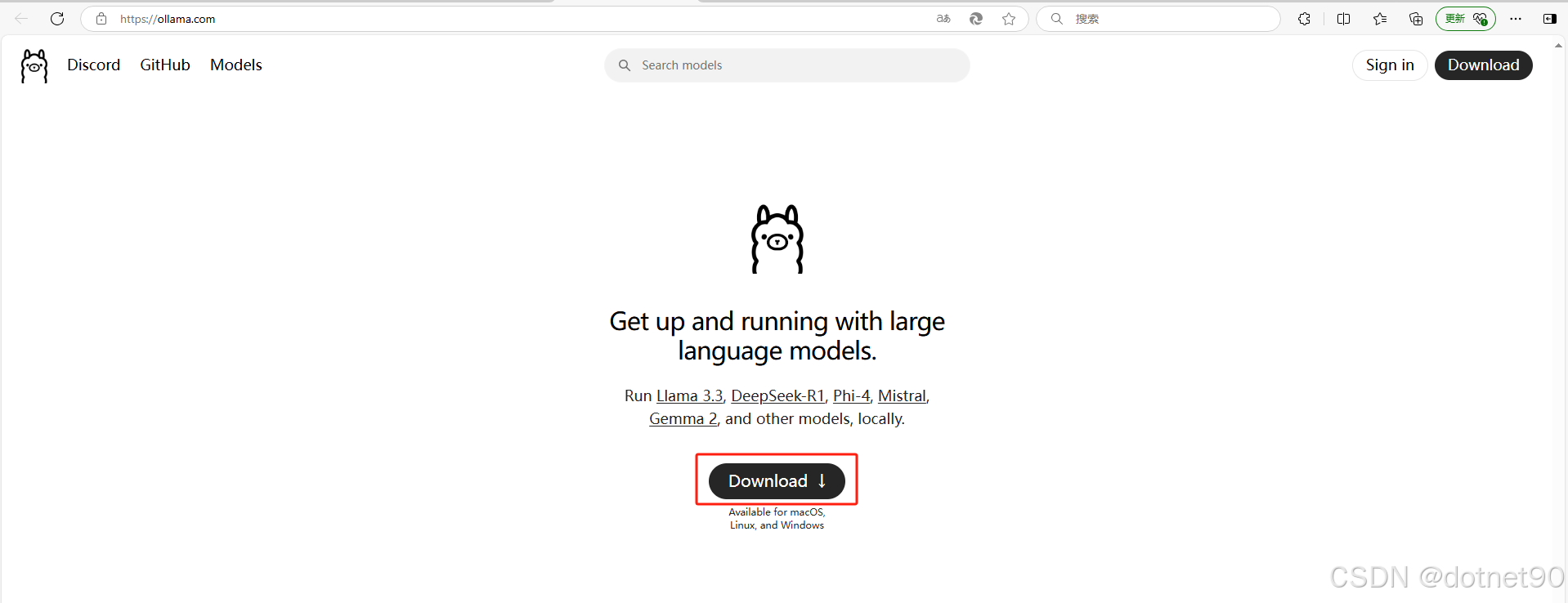

1、进入Ollama官网。(图1)

2、下载

3、下载完毕后,在资源管理器找到它,双击运行

4、点击install

5、安装完毕后,在菜单或者桌面右下角托盘处可以找到它,打开。

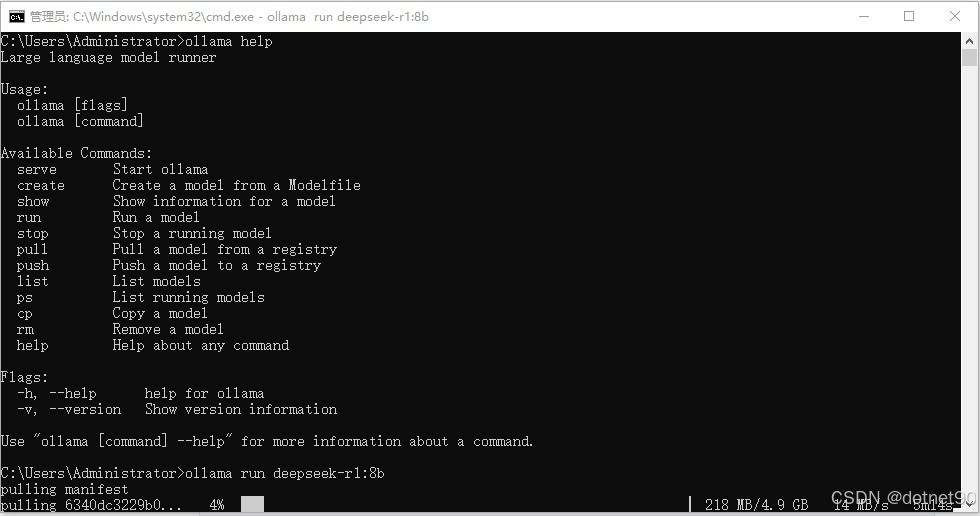

6、测试是否安装成功

按下WIN+R键,打开“运行”对话框,输入cmd,然后按下回车键,打开命令提示符。

通过运行ollama help命令,如果命令行没有报错,并且显示了上述帮助信息,说明Ollama安装成功。

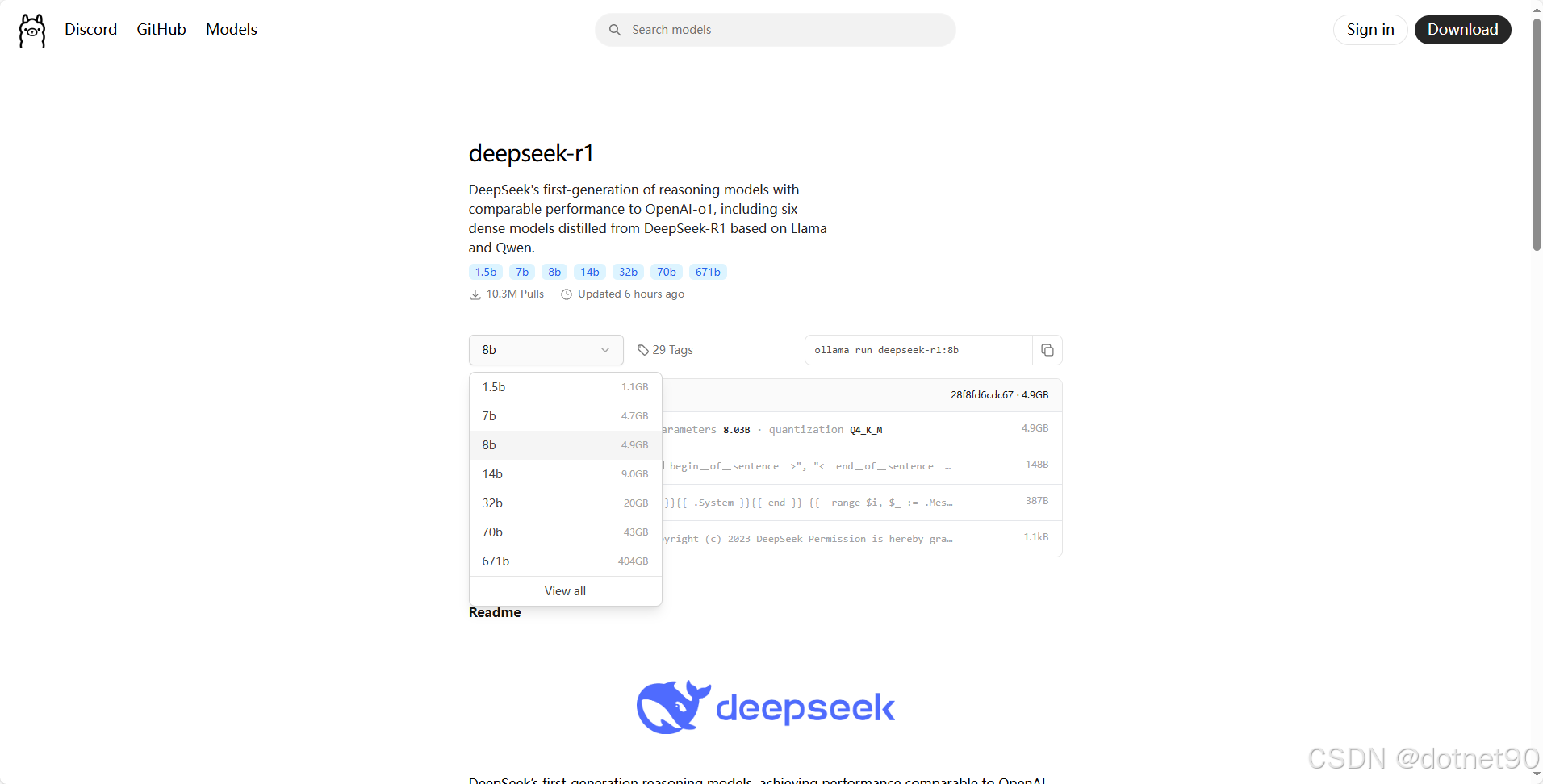

7、下载DeepSeek模型

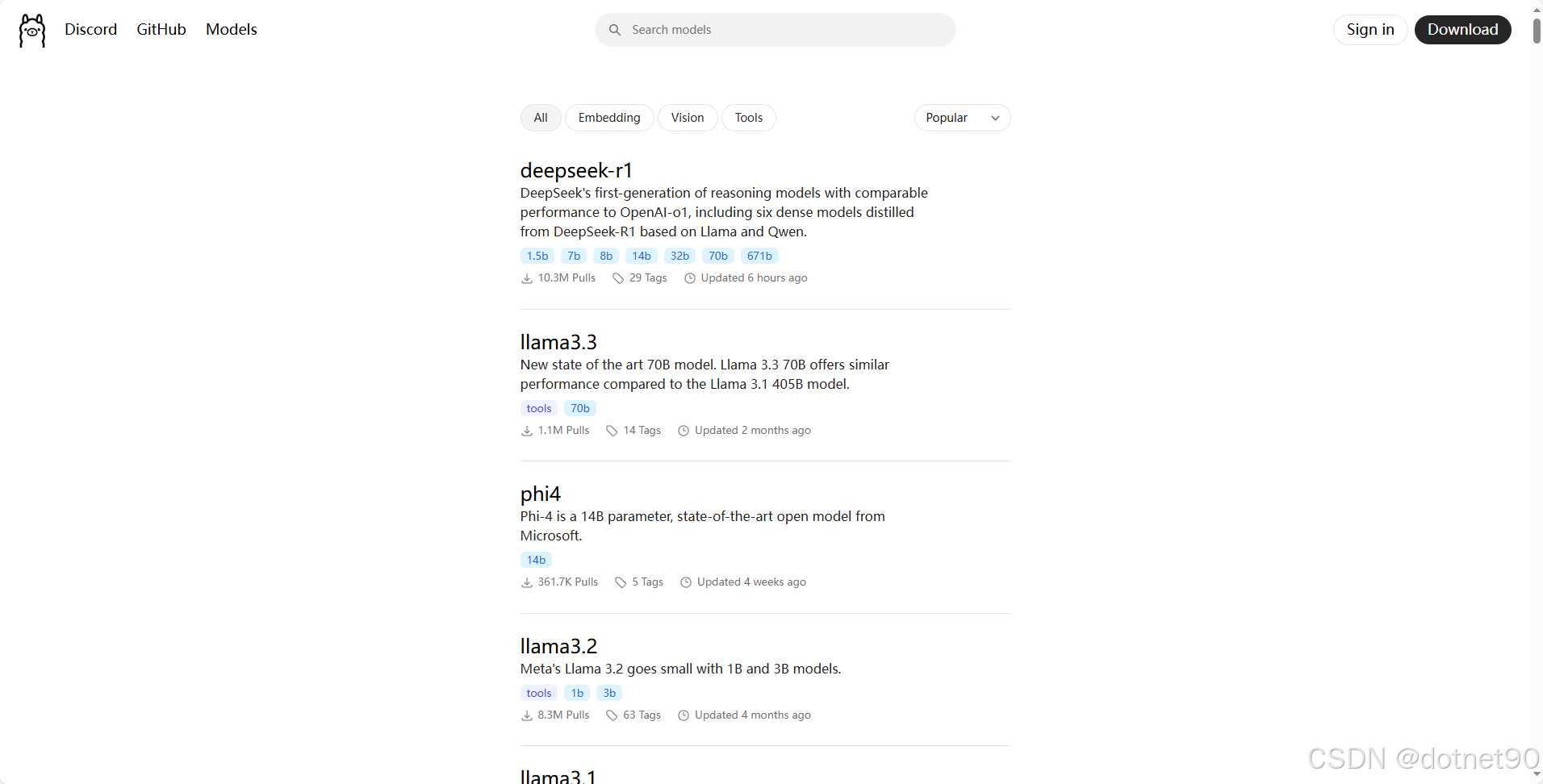

在ollama网站上找到并点击“models”链接,进入模型页面。第一个就是DeepSeek-r1

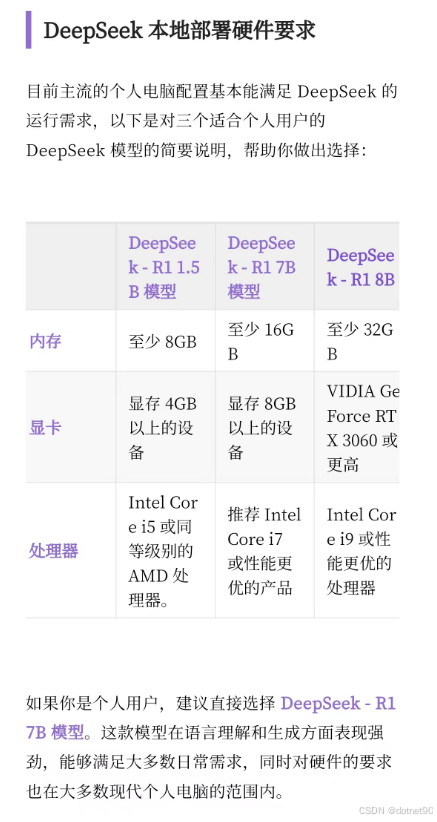

在Models页面中,找到并选择“DeepSeek”模型。DeepSeek模型提供了多个参数规模供用户选择,从1.5B到671B不等。根据你的电脑配置(特别是内存和显存)选择合适的模型规模:

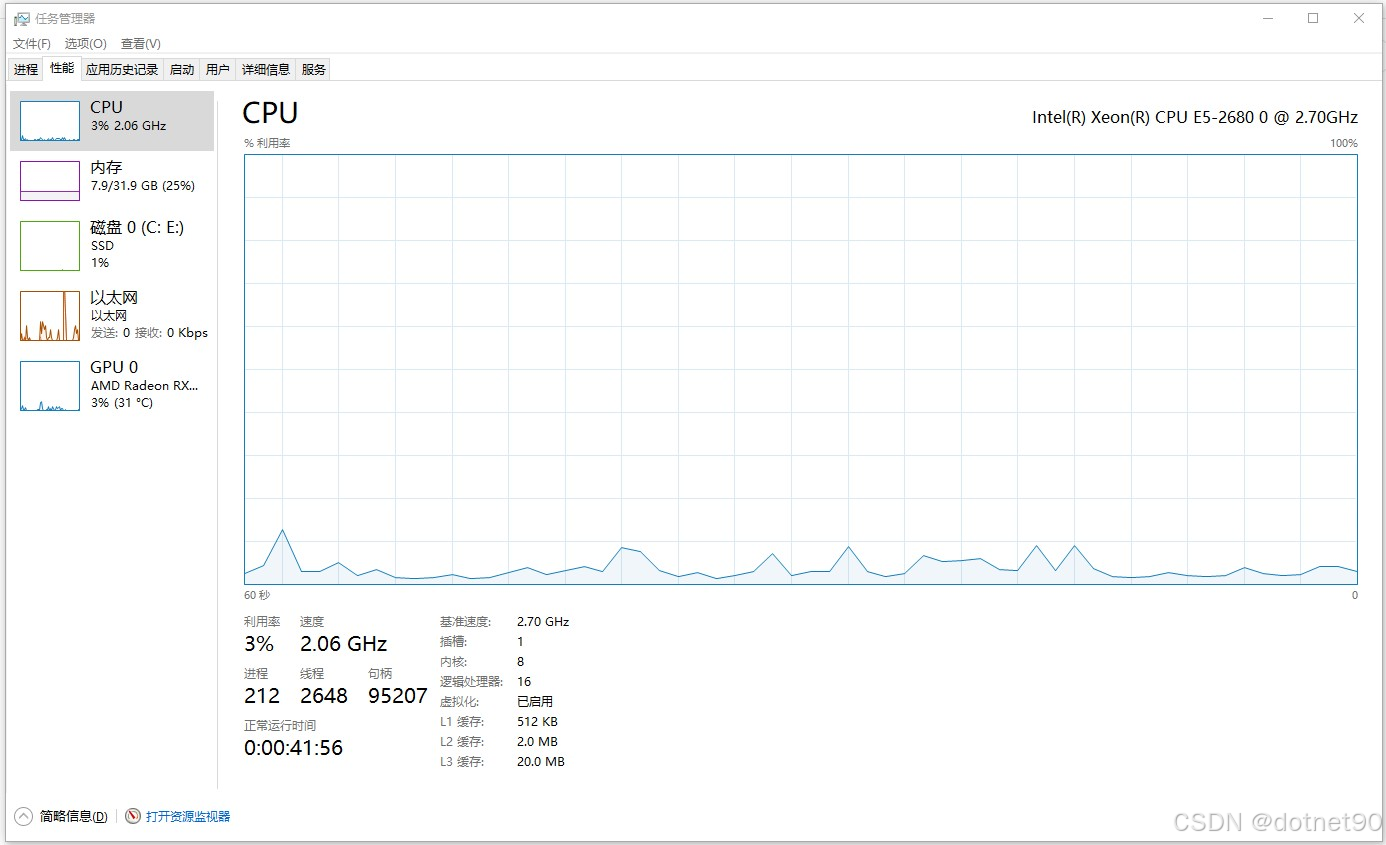

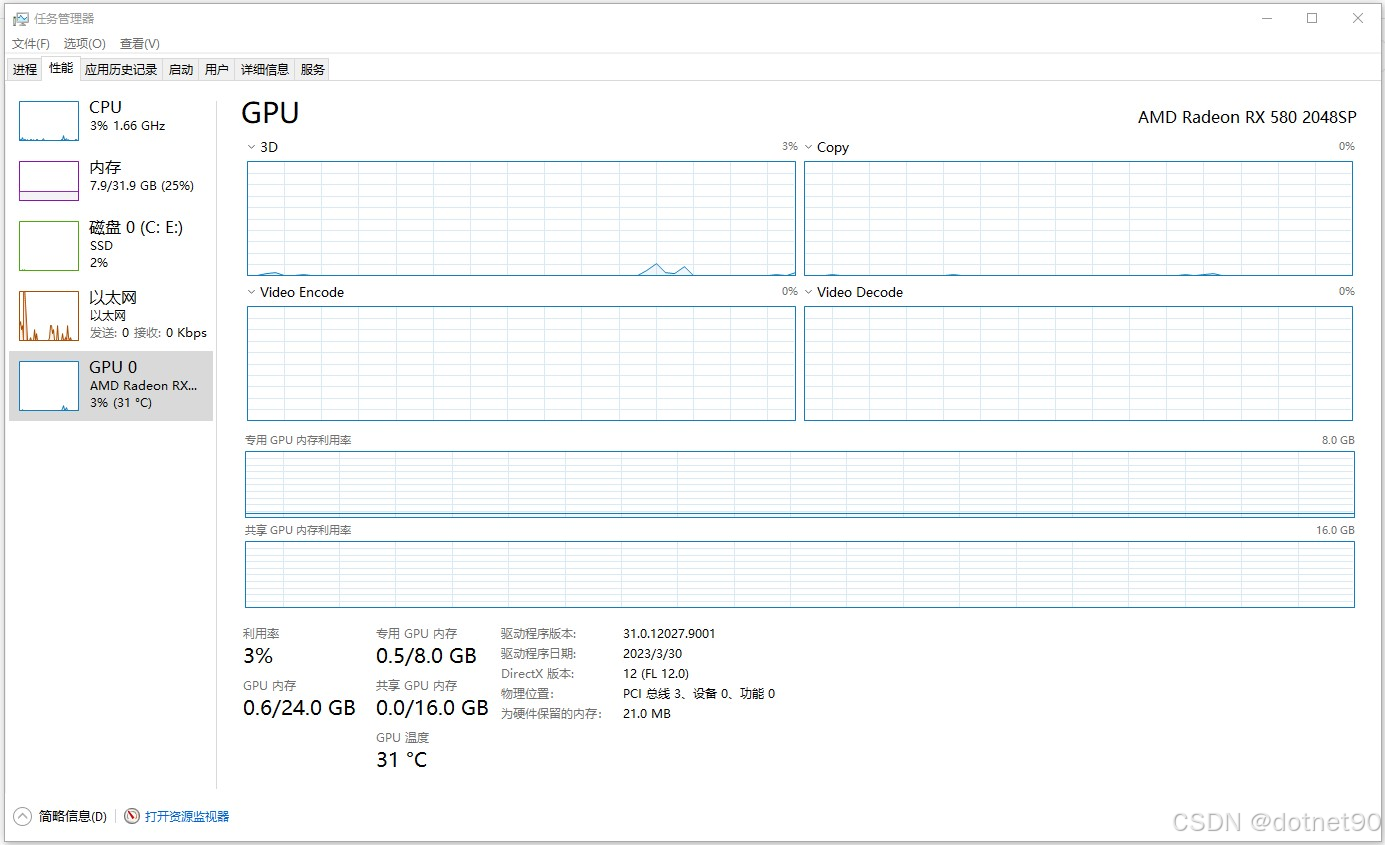

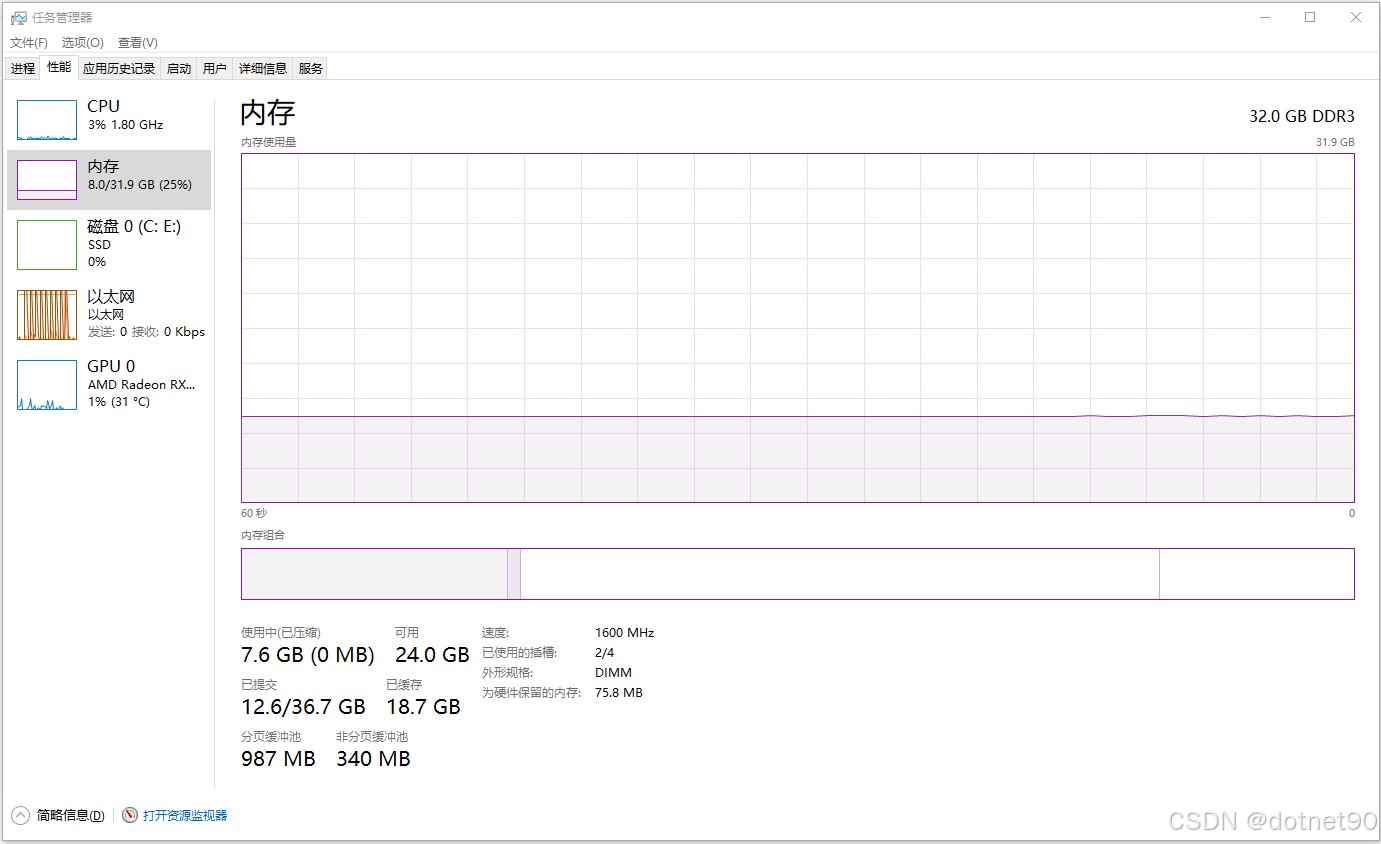

我的电脑配置

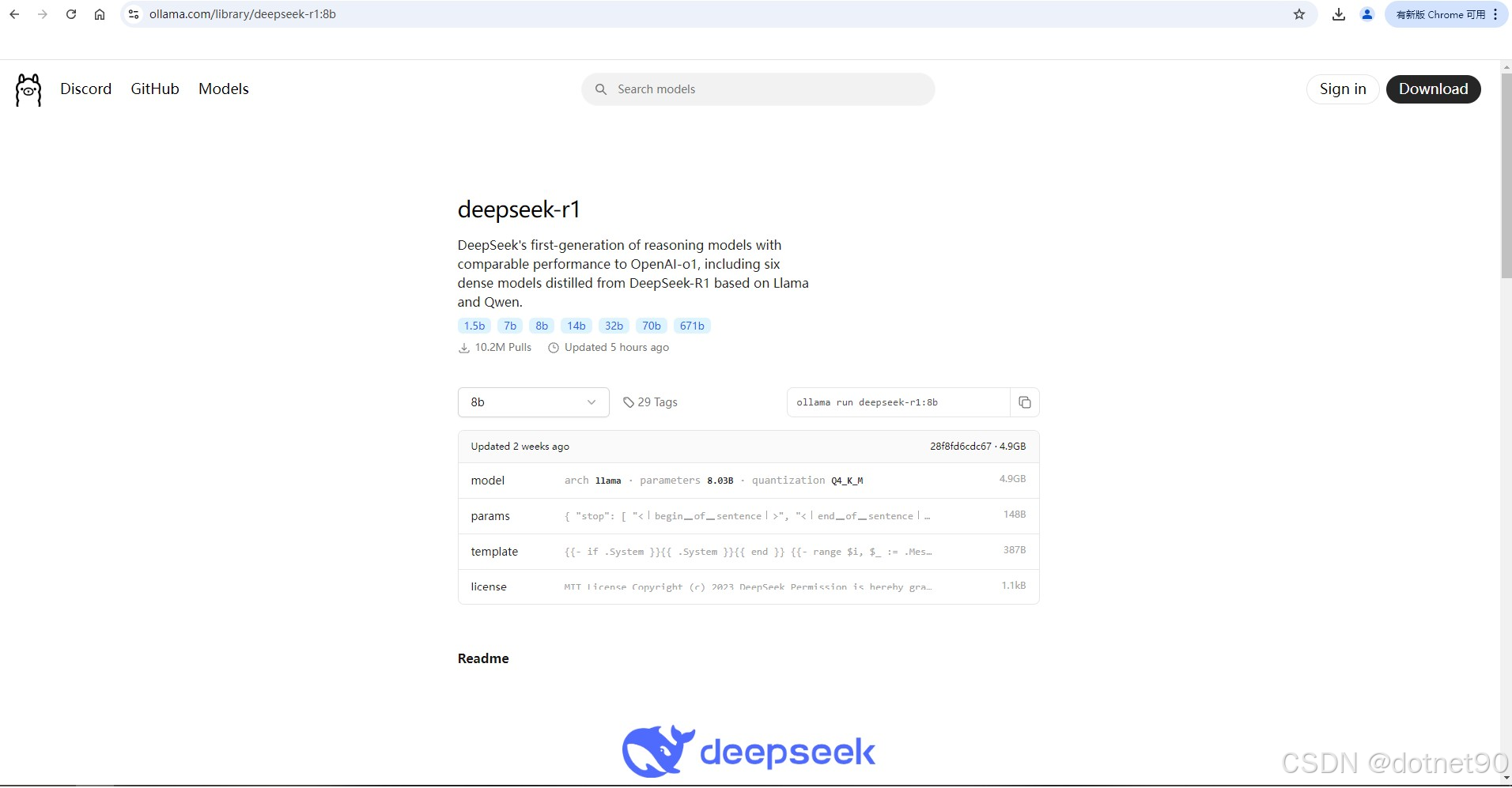

我选择了8B模型,选择好模型之后,复制右边的命令,到CMD中运行。

运行命令后,系统会开始下载模型,这个过程大概需要二十分钟(根据你自己的网速)。当看到提示“success”时,就表示安装成功了。

到这一步,DeepSeek就已经可以使用了,直接展开对话框即可开始使用。

适用场景

轻量级应用,需要快速响应需求可以选择1.5B、7B 这样的小模型可以快速加载和运行,能够在较短时间内给出结果,满足用户的即时需求,小模型适合一些对响应速度要求高、硬件资源有限的场景,如手机端的智能助手、简单的文本生成工具等;在科研、学术研究、专业内容创作等对准确性和深度要求较高的领域,选择70B、32B等大模型更适合。

- 671B:适用于对准确性和性能要求极高、对成本不敏感的场景,如大型科研机构进行前沿科学研究、大型企业进行复杂的商业决策分析等。

- 1.5B-7B:适合对响应速度要求高、硬件资源有限的场景,如移动端的简单智能助手、轻量级的文本生成工具等,可快速加载和运行。

- 8B-14B:可用于一些对模型性能有一定要求,但又没有超高性能硬件支持的场景,如小型企业的日常文本处理、普通的智能客服等。

- 32B-70B:能满足一些对准确性有较高要求,同时硬件条件相对较好的场景,如专业领域的知识问答系统、中等规模的内容创作平台等。

但是这个界面体验比较差,我们接下来安装可视化工具。

安装chatboxai可视化工具

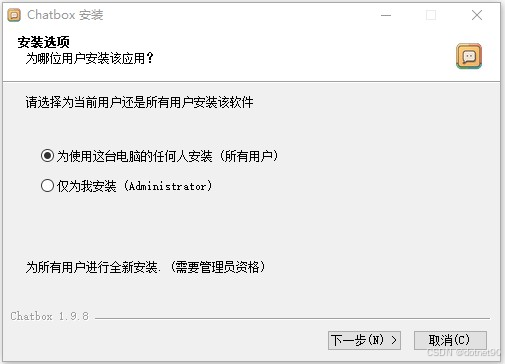

为了使DeepSeek R1的使用体验更加流畅,建议安装chatbox AI可视化工具,这将极大地提升操作的便捷性和直观性。

下载地址:

https://chatboxai.app/zh,下载适合自己操作系统的版本。

下载并安装完成后,首次启动时,系统会提示您添加模型。

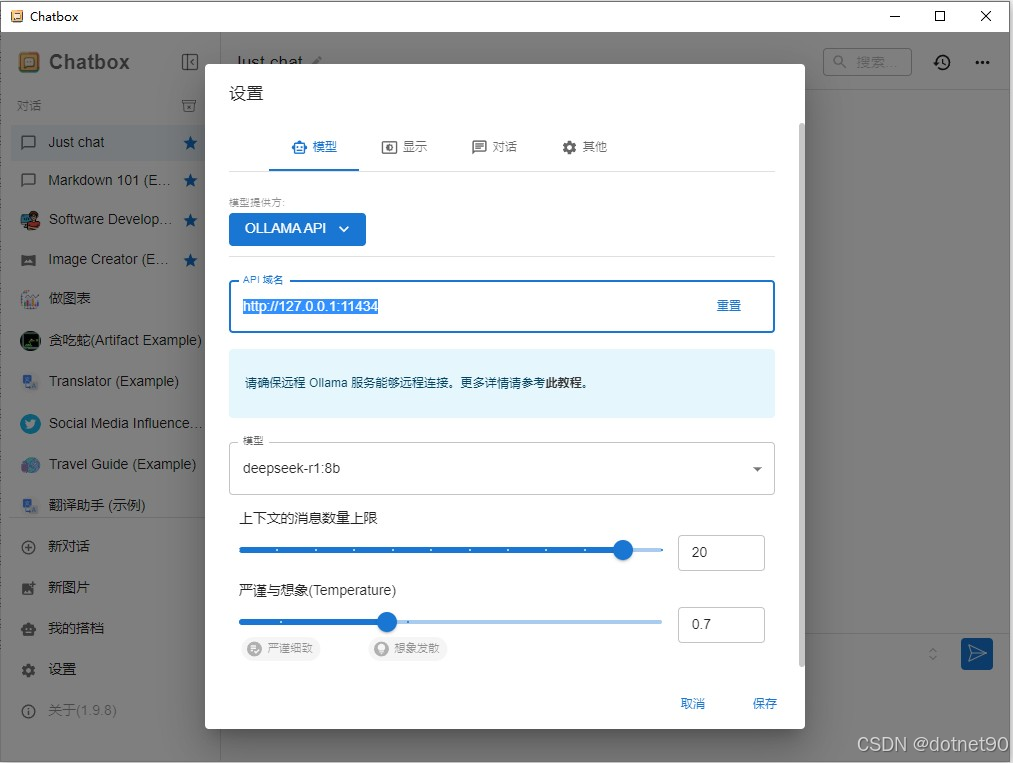

此时,需要选择“添加本地AI模型提供方”,并从中选择“Ollama API”。

接下来,选择模型。

在下拉菜单中找到并选择之前安装好的“deepseek-r:8b”模型,然后点击保存即可完成设置。

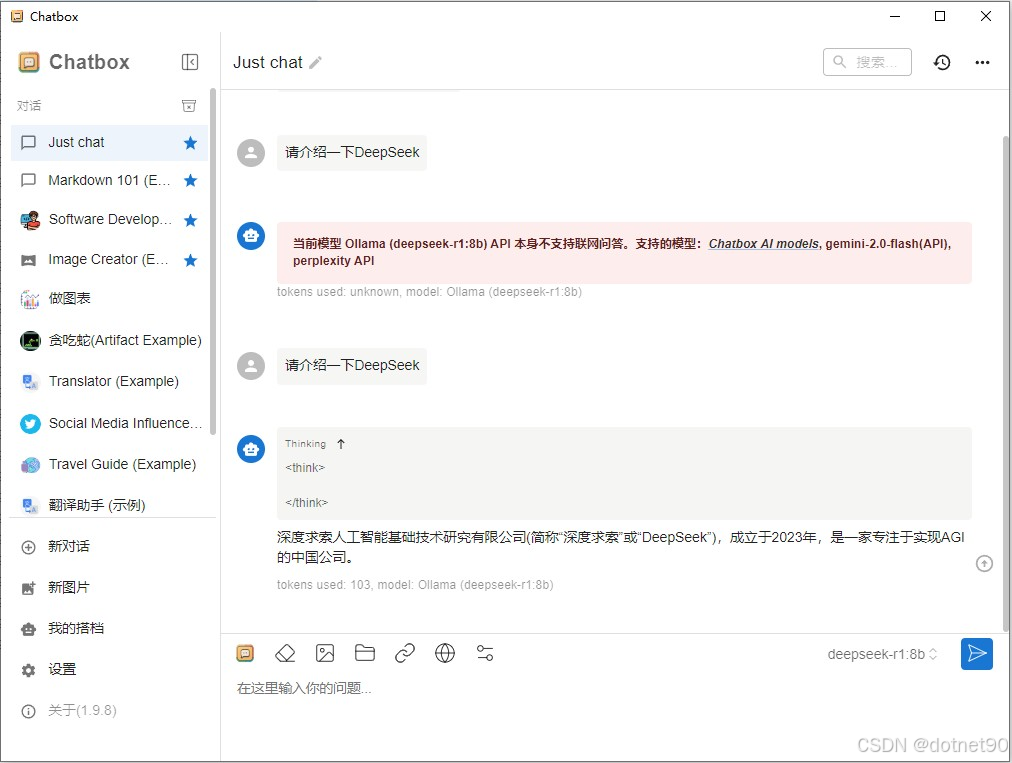

至此,整个安装流程已圆满完成。

经过实际体验,现在,您可以尽情的使用DeepSeek,无需再为访问受限而苦恼,畅享AI世界。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)