记录一下使用lora微调codellama遇到的问题

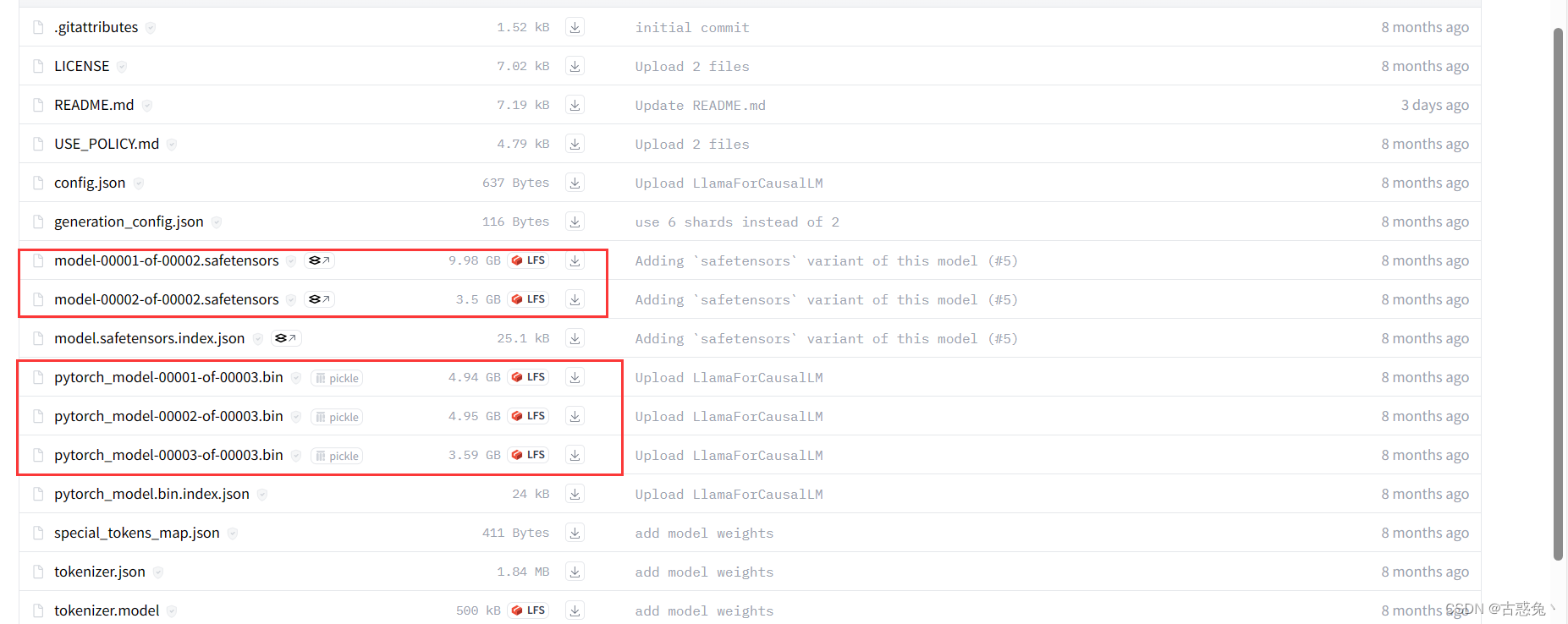

使用AutoModelForCausalLM加载模型会报错,改使用LlamaForCausalLM模型告知是因为模型参数没有下载完全导致的错误。在huggingface上下载模型文件的时候需要把红色框中内容全部下载。我使用的是safetensors。

·

### 问题1

RuntimeError: "normal_kernel_cpu" not implemented for 'Char'.

使用AutoModelForCausalLM加载模型会报错,改使用LlamaForCausalLM模型告知是因为模型参数没有下载完全导致的错误。在huggingface上下载模型文件的时候需要把红色框中内容全部下载。我使用的是safetensors

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)