DeepSeek + Ollama 本地部署,小白也能轻松搞定!

DeepSeek + Ollama 本地部署,小白也能轻松搞定!

文章目录

技术小白必看:

担心数据隐私外泄、怕数据上传云端?那么 Ollama 将是你的救星!你无需担心云端存储问题,Ollama 让你在本地笔记本上就能快速部署和运行 DeepSeek 模型。

解决方案:

Ollama 完全支持本地部署,支持 Mac/Win/Linux 系统,即使是没有显卡的普通CPU环境,也能流畅运行,不会造成任何性能瓶颈。这样,无论你是 律师 还是 研究员,都能在本地快速分析数据,确保隐私安全,同时提高工作效率。

适用人群:

- 律师:可以本地处理案件资料,确保客户隐私不被泄露。

- 研究员:可以离线处理实验数据,避免将敏感数据上传至云端,确保数据的保密性。

实际案例: 一家大型律师事务所通过 DeepSeek + Ollama,将所有案件卷宗本地化存储和处理,确保客户的隐私安全。律师们无需联网即可在本地进行深入分析,提升了工作效率,也降低了数据泄露的风险。

一、下载安装Ollama

1. DeepSeek 不同版本模型硬件要求

以下是 DeepSeek 不同版本模型的硬件要求,小伙伴们可以结合自己电脑配置选择版本

| 模型版本 | 参数量 | 显存需求 | 推荐 GPU(单卡) | 多卡支持 | 量化支持 | 适用场景 |

|---|---|---|---|---|---|---|

| DeepSeek-R1-1.5B | 15亿 | 3GB | GTX 1650(4GB显存) | 无需 | 支持 | 低资源设备部署(树莓派、旧款笔记本)、实时文本生成、嵌入式系统 |

| DeepSeek-R1-7B | 70亿 | 14GB | RTX 3070/4060(8GB显存) | 可选 | 支持 | 中等复杂度任务(文本摘要、翻译)、轻量级多轮对话系统 |

| DeepSeek-R1-8B | 80亿 | 16GB | RTX 4070(12GB显存) | 可选 | 支持 | 需更高精度的轻量级任务(代码生成、逻辑推理) |

| DeepSeek-R1-14B | 140亿 | 32GB | RTX 4090/A5000(16GB显存) | 推荐 | 支持 | 企业级复杂任务(合同分析、报告生成)、长文本理解与生成 |

| DeepSeek-R1-32B | 320亿 | 64GB | A100 40GB(24GB显存) | 推荐 | 支持 | 推荐 支持 高精度专业领域任务(医疗/法律咨询)、多模态任务预处理 |

| DeepSeek-R1-70B | 700亿 | 140GB | 2x A100 80GB/4x RTX 4090(多卡并行) | 必需 | 支持 | 科研机构/大型企业(金融预测、大规模数据分析)、高复杂度生成任务 |

| DeepSeek-671B | 6710亿 | 512GB+ 单卡显存需求极高,通常需要多节点分布式训练) | 8x A100/H100(服务器集群) | 必需 | 支持 | 国家级/超大规模 AI 研究(气候建模、基因组分析)、通用人工智能(AGI)探索 |

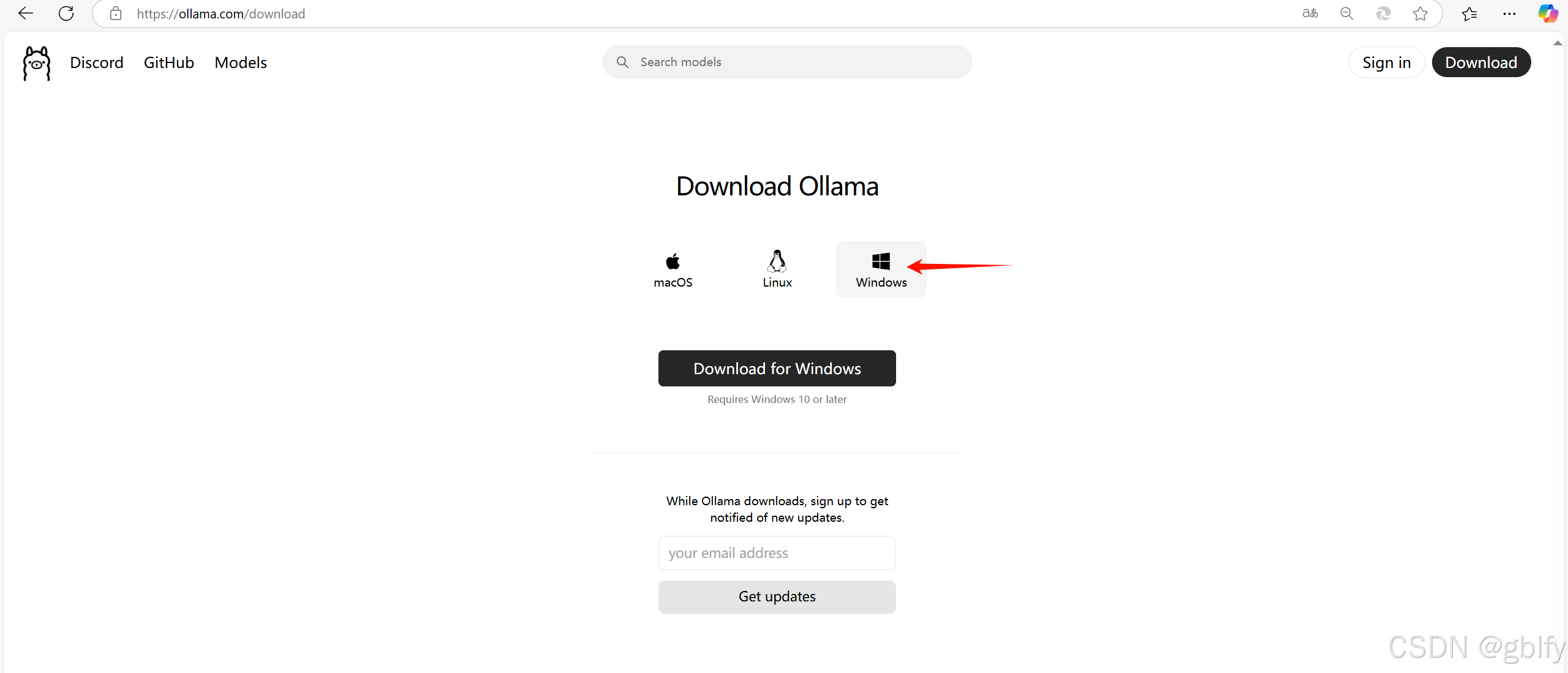

2. 下载Ollama

访问官网:https://ollama.com/download下载

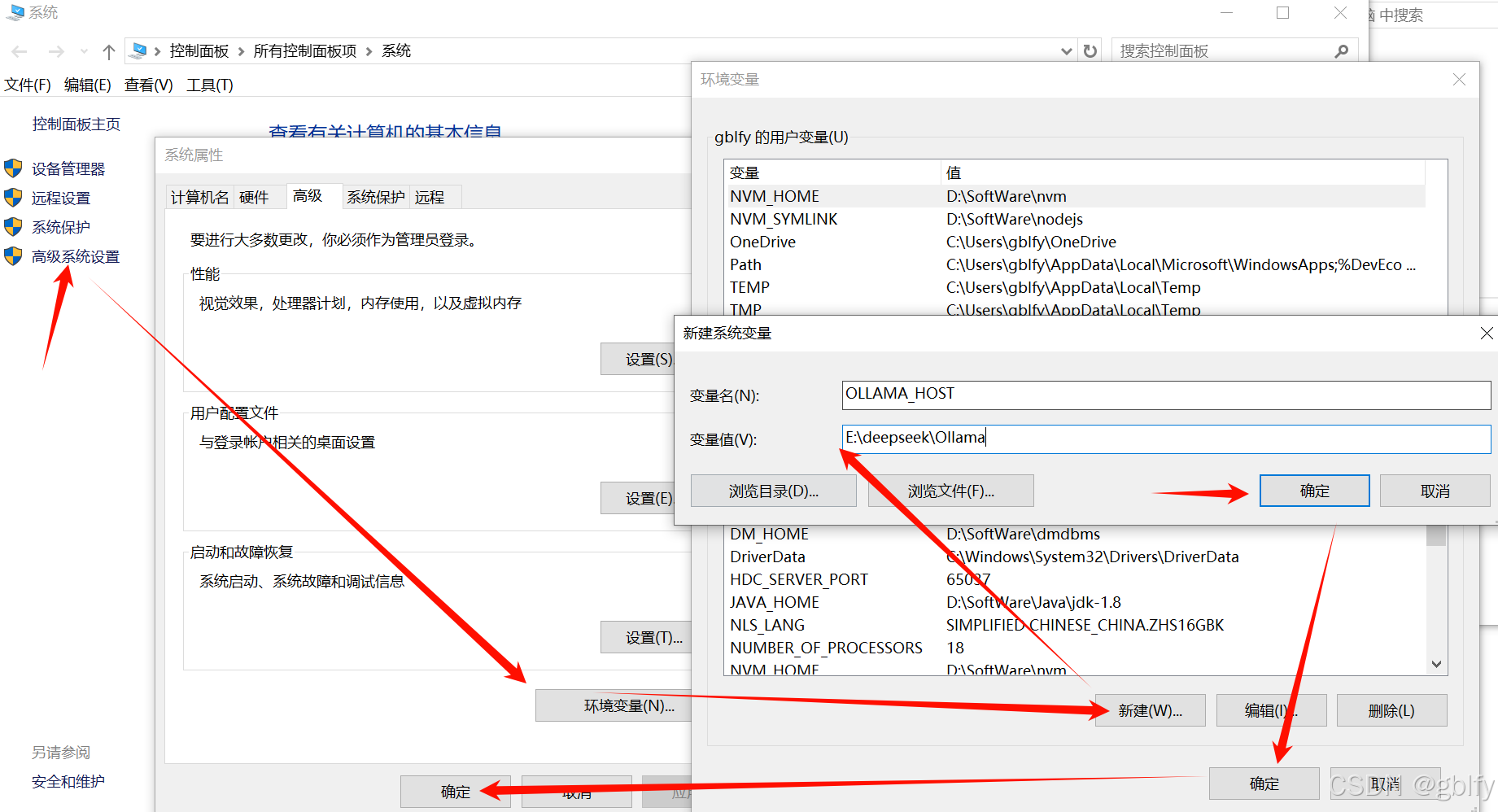

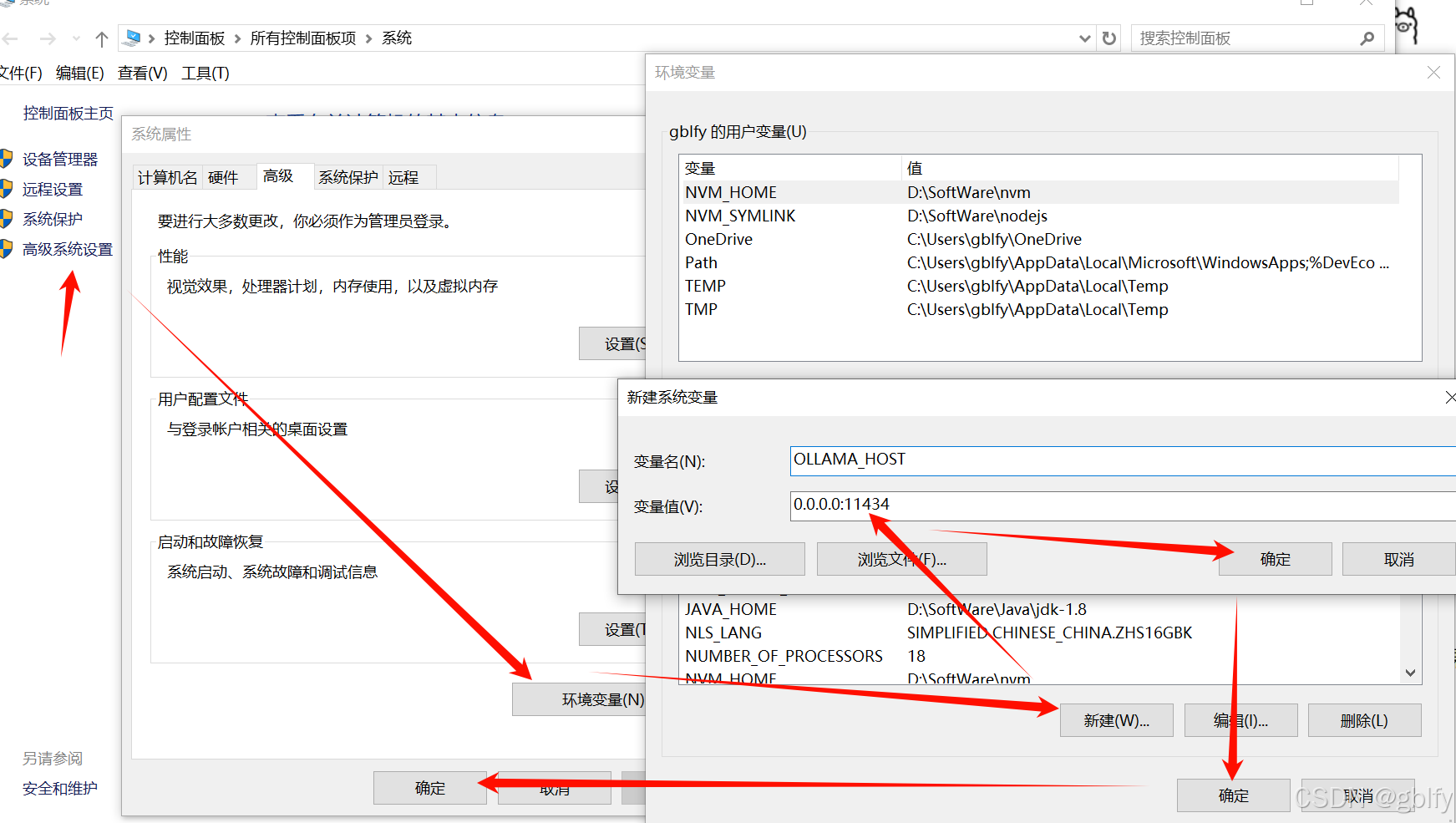

3. 配置环境变量

不配置环境变量,下载的模型默认安装到C盘,跳过此步骤不影响效果展现。

根据自己实际磁盘情况配置即可

OLLAMA_HOST=E:\deepseek\Ollama

OLLAMA_HOST=0.0.0.0:11434:让虚拟机里的程序能访问本机上运行的 Ollama 模型

OLLAMA_HOST=0.0.0.0:11434

注意配置之后保险起见一定要重启电脑

4. 安装Ollama

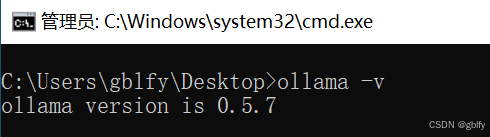

5. 检验Ollama是否安装成功

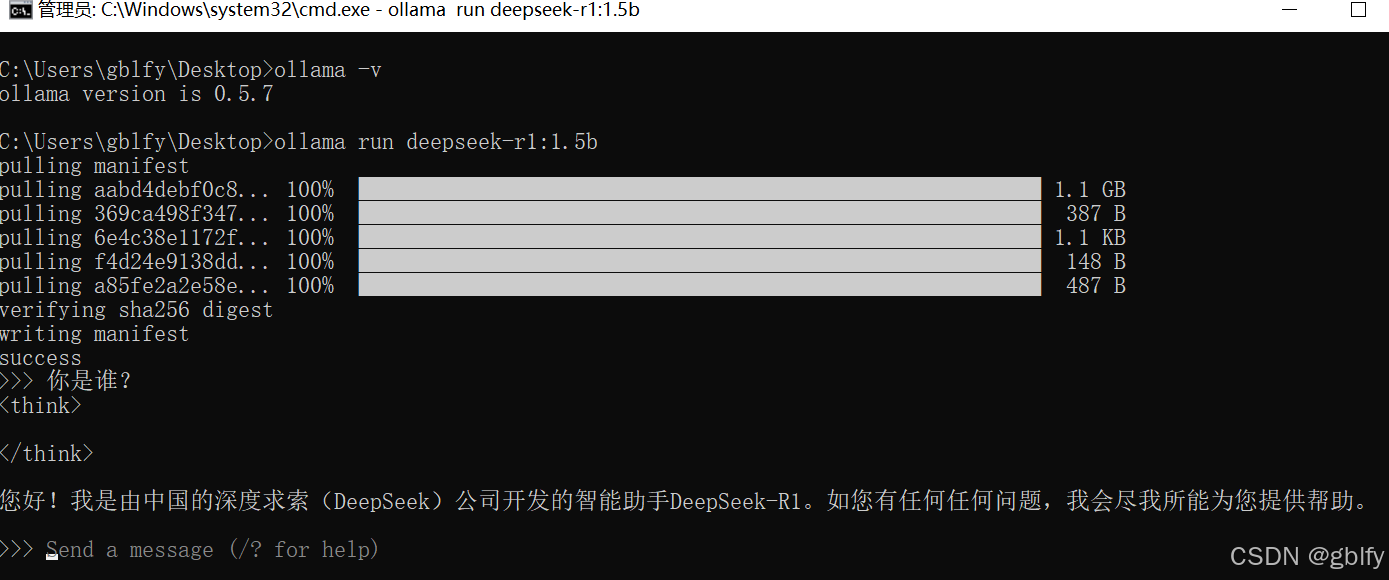

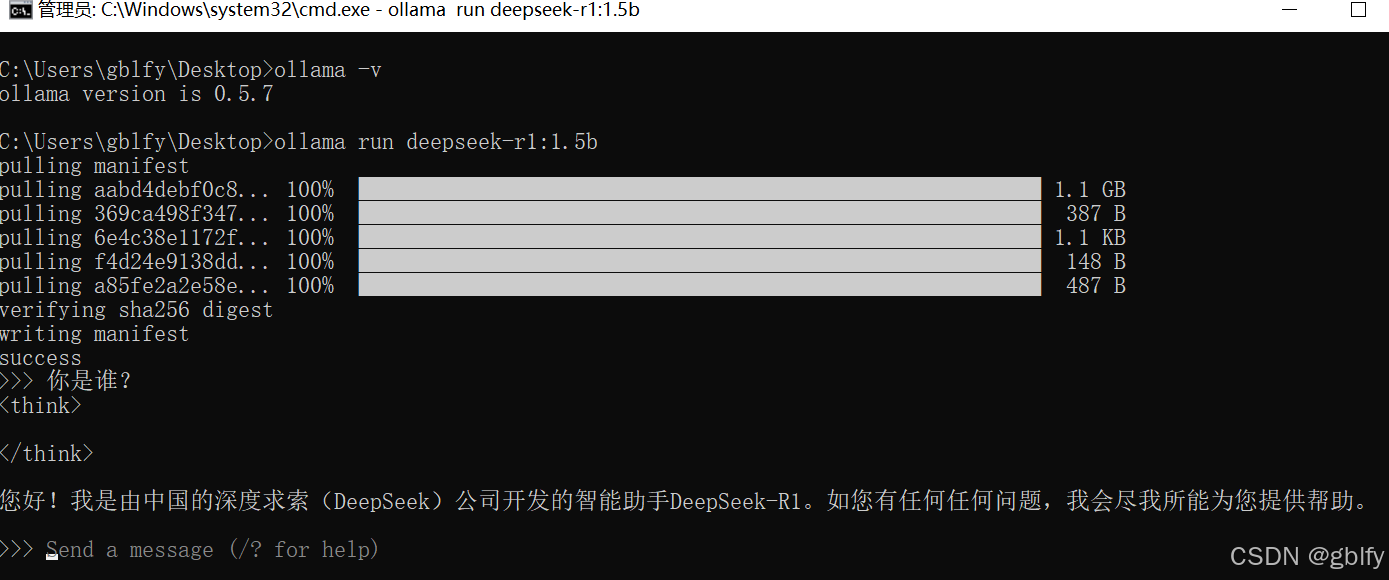

命令行输入 ollama -v 命令,出现如下版本号说明安装成功

ollama -v

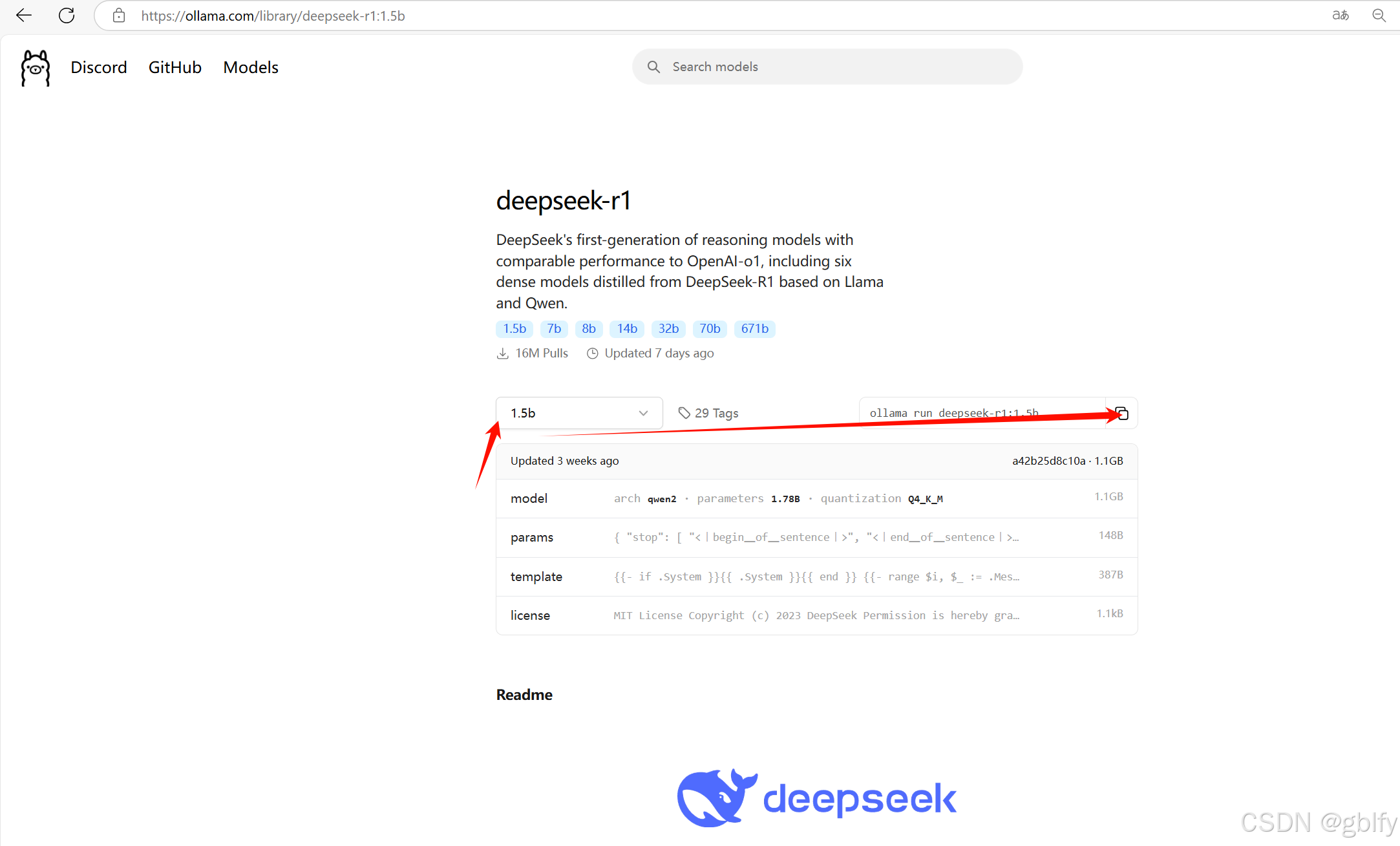

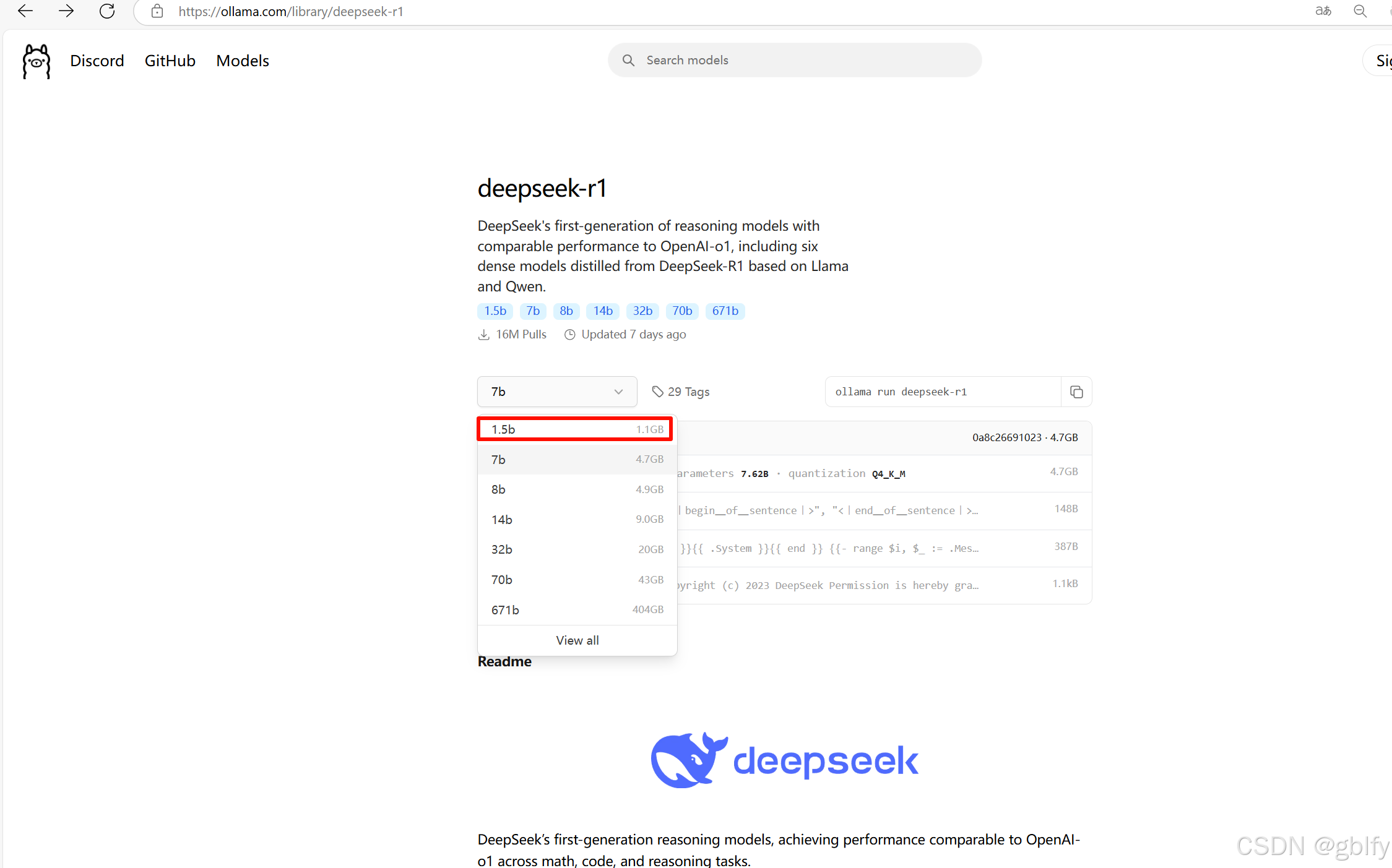

二、通过 Ollama 拉取 DeepSeek 模型

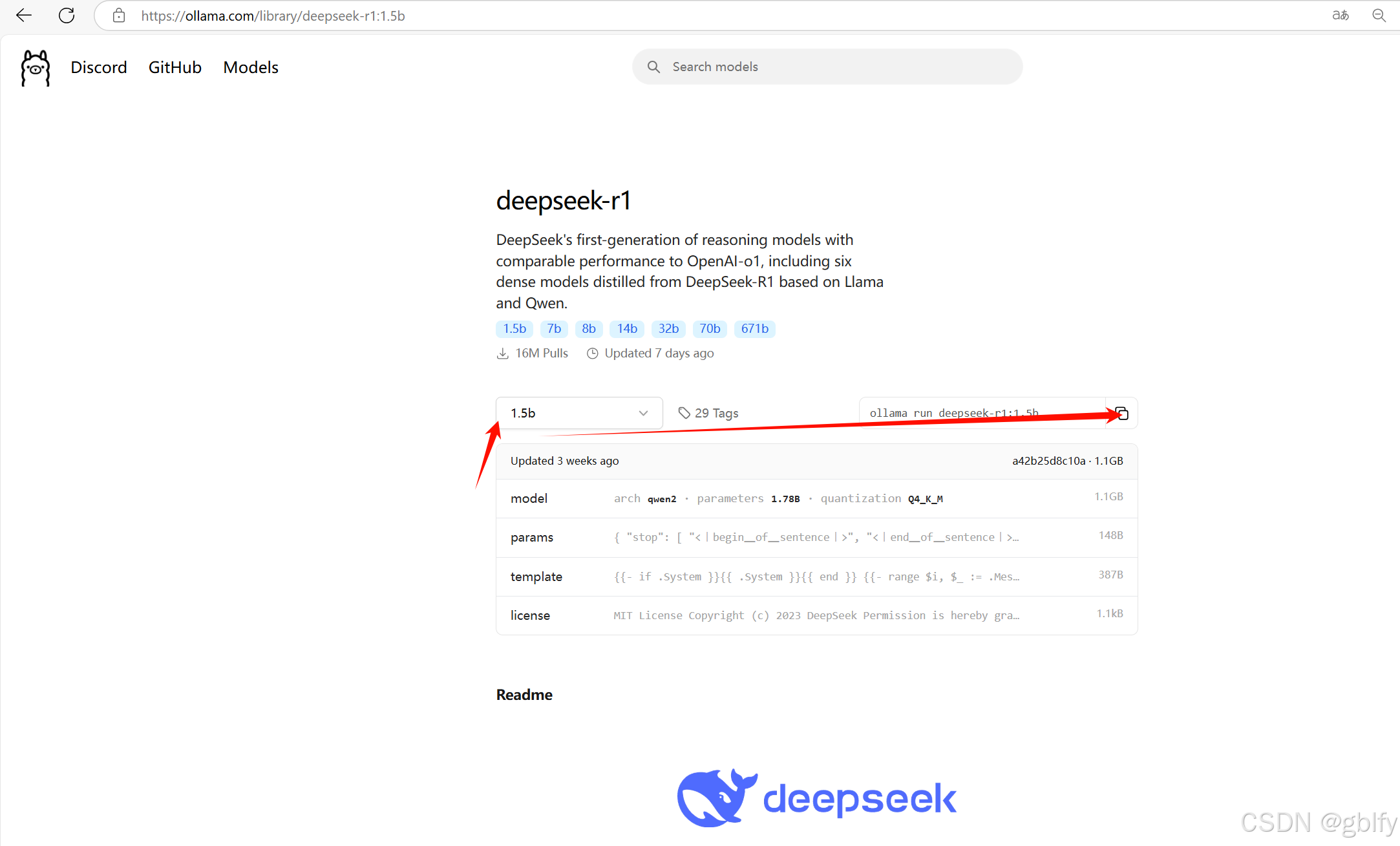

这里我选择是的1.5b,整个模型大小1.1 GB。

- 1.5B:适用于轻量级任务,如边缘设备(如智能手表、物联网设备)上的简单交互、小型智能问答系统等。目前开源的最小版本。

- 671B:主要用于大规模云端推理,适合科研分析、数据挖掘等需要处理海量数据的复杂任务。目前开源的最强版本

更多版本可以在这里查看:https://ollama.com/library/deepseek-r1

2.1. 下载deepseek-r1模型

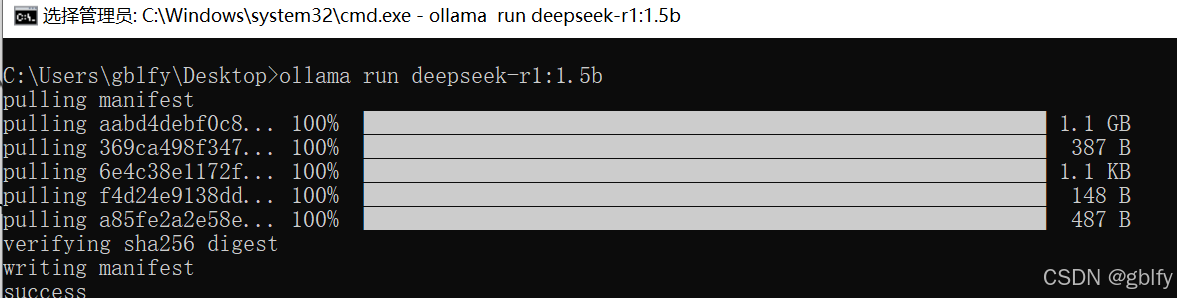

命令行输入:ollama run deepseek-r1:1.5b 拉取DeepSeek模型

ollama run deepseek-r1:1.5b

整个拉取过程还是比较丝滑的,5到6分钟后看到【success】字样,代表成功安装DeepSeek R1,然后就可以与DeepSeek对话了

2.2. 与DeepSeek对话

通过上面步骤之后,我们就可以愉快的与Deep Seek对话了,如输入:你是谁?

你是谁?

到此,本地部署DeepSeek + Ollama搞定了。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)