深度学习中的Epoch,Batchsize,Iterations图形解释

深度学习中的Epoch,Batchsize,Iterations图形解释

·

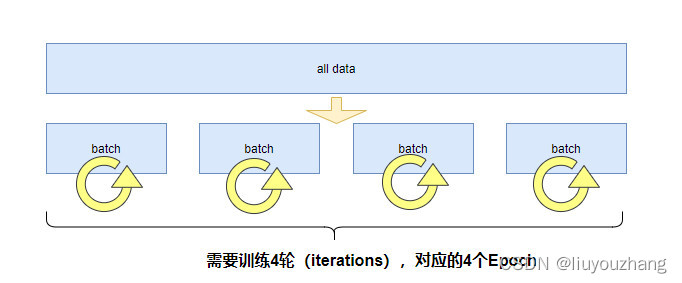

Epoch:轮询次数

Batch Size:每次训练的数据大小(因为整个数据被切分为了多次,所以有切分的大小的概念)。

Iteration:一次轮询,即使用这一batch的数据完成一次完整的训练的过程。

①所有的数据,数据量太大,无法一次载入机器进行训练,因此分为多份。 ---batch number

②每一份数据,进行一次完整的训练——即使用反向传播,梯度下降算法,把网络中每个节点的权重和偏置更新一遍。所进行的这一次完整的训练,就是Epoch。 所以Epoch 个数= batch number

③每个batch中的数据的大小,称为batch size

④理想情况下,batch siez=data size,即Epoch=1,训练的效果最好,但是往往做不到(数据量太大,而硬件资源有限) 【硬件资源不够,次数来凑】

⑤Epoch的个数,即把数据切分为几份训练多少次比较合适呢?没有统一的答案,epoch大小与数据集的多样化程度有关,多样化程度越强,epoch应该越大。

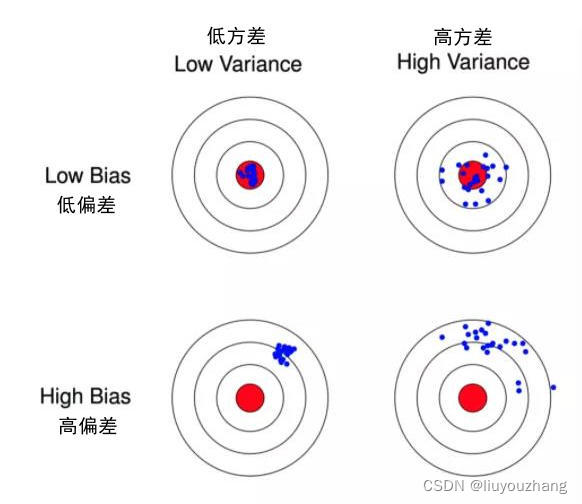

下图再帮助复习一下偏差和方差的区别:

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)