stable diffusion LoRA 原理

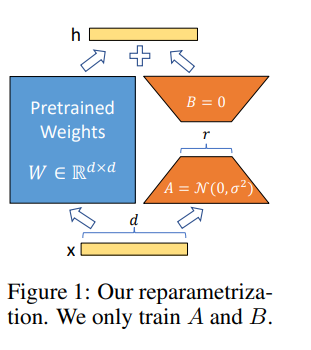

我们受到Li等人(2018a)以及Aghajanyan等人(2020)的启发,他们的研究表明,学习到的过参数化模型实际上位于一个低本征维度上。我们假设,在模型适应过程中权重的变化也具有低的“本征秩”,这促使我们提出了低秩适应(LoRA)方法。LoRA允许我们通过优化适应过程中密集层变化的秩分解矩阵来间接训练神经网络中的某些密集层,同时保持预训练权重不变。LoRA通过向这些密集层注入低秩矩阵来实现模

·

启发

我们受到Li等人(2018a)以及Aghajanyan等人(2020)的启发,他们的研究表明,学习到的过参数化模型实际上位于一个低本征维度上。我们假设,在模型适应过程中权重的变化也具有低的“本征秩”,这促使我们提出了低秩适应(LoRA)方法。LoRA允许我们通过优化适应过程中密集层变化的秩分解矩阵来间接训练神经网络中的某些密集层,同时保持预训练权重不变

LoRA的工作机制

LoRA的目标是在不改变预训练模型原始权重的情况下,通过优化低秩矩阵来调整模型以适应新的任务。这意味着原始模型的大部分权重被冻结,不会在训练过程中更新。

密集层的调整

在神经网络中,密集层(也称为全连接层)通常是模型中的关键组件之一。LoRA通过向这些密集层注入低秩矩阵来实现模型的适应。具体来说,它不是直接调整这些密集层的权重,而是通过优化这些低秩矩阵来间接地调整这些层。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)