传统NLP和大模型微调的区别(说人话)

传统NLP和大模型微调的区别(说人话)

·

🍃作者介绍:双非本科大四网络工程专业在读,阿里云专家博主,专注于Java领域学习,擅长web应用开发,目前开始人工智能领域相关知识的学习

🦅个人主页:@逐梦苍穹

📕所属专栏:人工智能

🌻gitee地址:xzl的人工智能代码仓库

✈ 您的一键三连,是我创作的最大动力🌹

一、先理解两个概念

1、传统NLP微调(2018年之前主流)

- 模型类型:像用Word2Vec词向量 + RNN/LSTM/CNN,或者早期小规模预训练模型(如ELMo)

- 工作方式:先预训练词向量(比如让"猫"和"狗"向量接近),然后针对具体任务(如文本分类)从头训练一个模型,或者微调预训练模型的少量参数

- 典型场景:训练一个酒店评论情感分析模型,用5000条标注数据

2、大语言模型微调(GPT为代表)

-

模型类型:基于Transformer Decoder的大模型(如GPT-3 1750亿参数)

-

工作方式:先用海量无标注文本预训练(学习预测下一个词),然后用少量标注数据微调整个模型或部分参数

-

典型场景:用500条医疗问答数据微调GPT-3,让它能专业回答医学问题

-

大白话的比喻就是:

- 传统NLP微调

- 就像自己炒菜,你要买各种食材(数据)、自己切菜、配调料(特征工程)、按菜谱一步步炒(训练模型)

- 缺点:换个菜(任务)就得重新买食材、研究新菜谱

- 例子:训练一个识别快递单号的模型

- 需要收集几千张快递单图片

- 手动标注哪里是单号、收件人

- 用CNN模型从头训练

- 大模型微调

- 就像吃火锅,火锅底料是现成的(预训练好的大模型)、你只需要准备少量食材(少量标注数据)、涮一涮就能吃(微调)

- 优点:同一锅底能涮牛肉、青菜、丸子(多任务通用)

- 例子:让ChatGPT学会写病历

- 给它100条医生写的标准病历

- 微调后直接生成规范文本

- 传统NLP微调

二、核心差异对比

1、模型能力来源不同

- 传统方法:主要依赖任务数据的特征工程(比如手动设计词性特征)

- 大模型:主要依赖预训练获得的世界知识(模型已内化大量常识和逻辑)

- 例子:处理"特朗普和拜登谁更高?"这个问题

- 传统方法:需要手动添加身高数据库

- 大模型:预训练时可能已经见过相关文本,直接给出答案

- NLP模型像刚毕业的大学生,只会课本知识。遇到新问题(比如“新冠疫苗有哪些种类?”)必须重新学习。

- 大模模型像读过图书馆所有书的博士,微调只是让它在这个基础上继续学习,比如即使没学过新冠疫苗,也能从已有知识推理

2、数据需求天差地别

- 传统方法:严重依赖标注数据,5000条起步

- 大模型:用提示工程(Prompt Engineering) 甚至零样本学习(Zero-Shot),10条样本就能微调

3、参数调整方式不同

| 传统方法 | 大模型微调 | |

|---|---|---|

| 可调参数数比例 | 如100%(整个模型) | 0.01%-100% |

| 典型技术 | 全参数微调 | LoRA/Adapter/P-Tuning |

| 显存消耗 | 小(1-2GB) | 极大(可能需要80GB显存) |

关键点:大模型常用参数高效微调,比如LoRA只改0.1%的参数就能达到90%的效果

4、任务适配逻辑不同

- 传统方法:每个任务独立设计模型结构

- 文本分类用CNN

- 序列标注用BiLSTM+CRF

- 大模型:统一架构通吃所有任务

- 通过修改输入prompt切换任务

- 同样的模型可以做翻译/摘要/代码生成

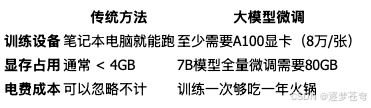

5、计算资源鸿沟

- 传统方法:个人电脑可训练

- 大模型微调:至少需要A100显卡,通常需要分布式训练

三、本质区别总结

| 维度 | 传统NLP微调 | 大模型微调 |

|---|---|---|

| 核心思想 | 任务特征驱动 | 预训练知识驱动 |

| 数据依赖 | 大量标注数据 | 少量标注/无标注 |

| 模型灵活性 | 序列化结构 | 统一架构+Prompt控制 |

| 可解释性 | 相关内容理解 | 黑箱操作 |

| 部署成本 | 低 | 极高 |

| 适用场景 | 尤其适合领域单任务 | 开放领域复杂任务 |

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)