阿里QwQ-32B来了,能力直逼满血版DeepSeek R1-671B。大模型应用的春天来了。

如果你的本地网速不好,或者下载经常失败,可以去魔塔社区找到QwQ-32B gguf格式下载到本地,使用ollama本地加载,本地测试和官方提供的能力差不多。话说,32B的参数级别,需要24GB的显存,也就是大大减低了使用成本,一般公司也可以负担的起了。而且,QwQ-32B在基准测试上的性能跑分,几乎拉开o1-mini一个身位。得出结果,后直接提交。完美运行,且打败了64.05%的人,效果还不错了。

凌晨3点,阿里开源了他们全新的推理模型。

QwQ-32B。

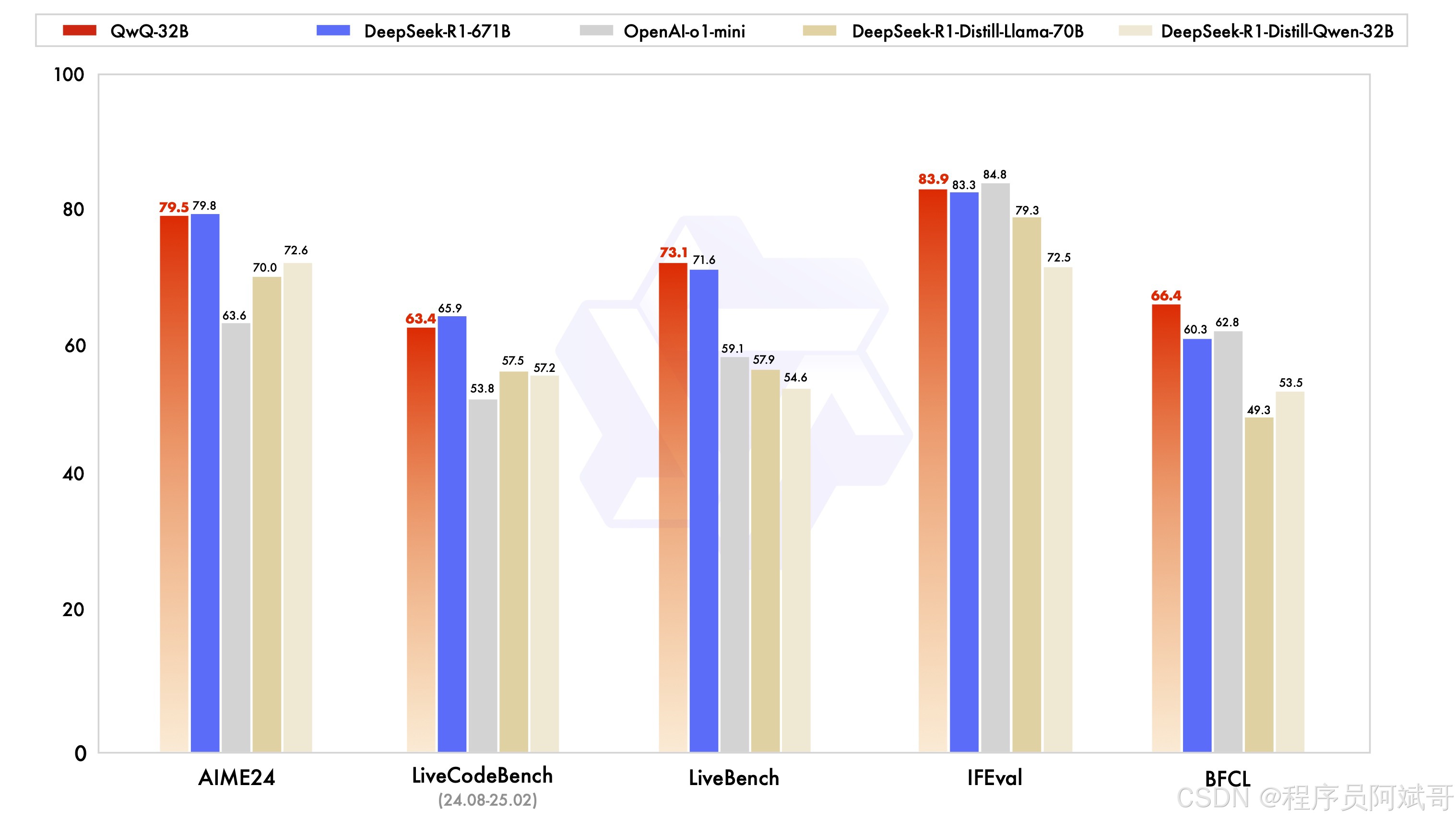

本来还有点意识模糊,当看到他们发出来的性能比对图,我人傻了。

在几乎所有数据集里,QwQ-32B 都已经能跟满血版DeepSeek R1(671B)表现相当了。尤其是作为QwQ-32B 的主攻方向的数学和代码。

而且,QwQ-32B在基准测试上的性能跑分,几乎拉开o1-mini一个身位。Qwen团队的强化学习上。因为,这能让模型自己学会一些关键的“思考习惯”。

QwQ-32B开源链接在此:

魔搭开源链接:https://modelscope.cn/models/Qwen/QwQ-32B

huggingface开源链接:https://huggingface.co/Qwen/QwQ-32B

当然如果想直接上手体验,官方也给出了在线体验的地址:

https://chat.qwen.ai/?models=Qwen2.5-Plus

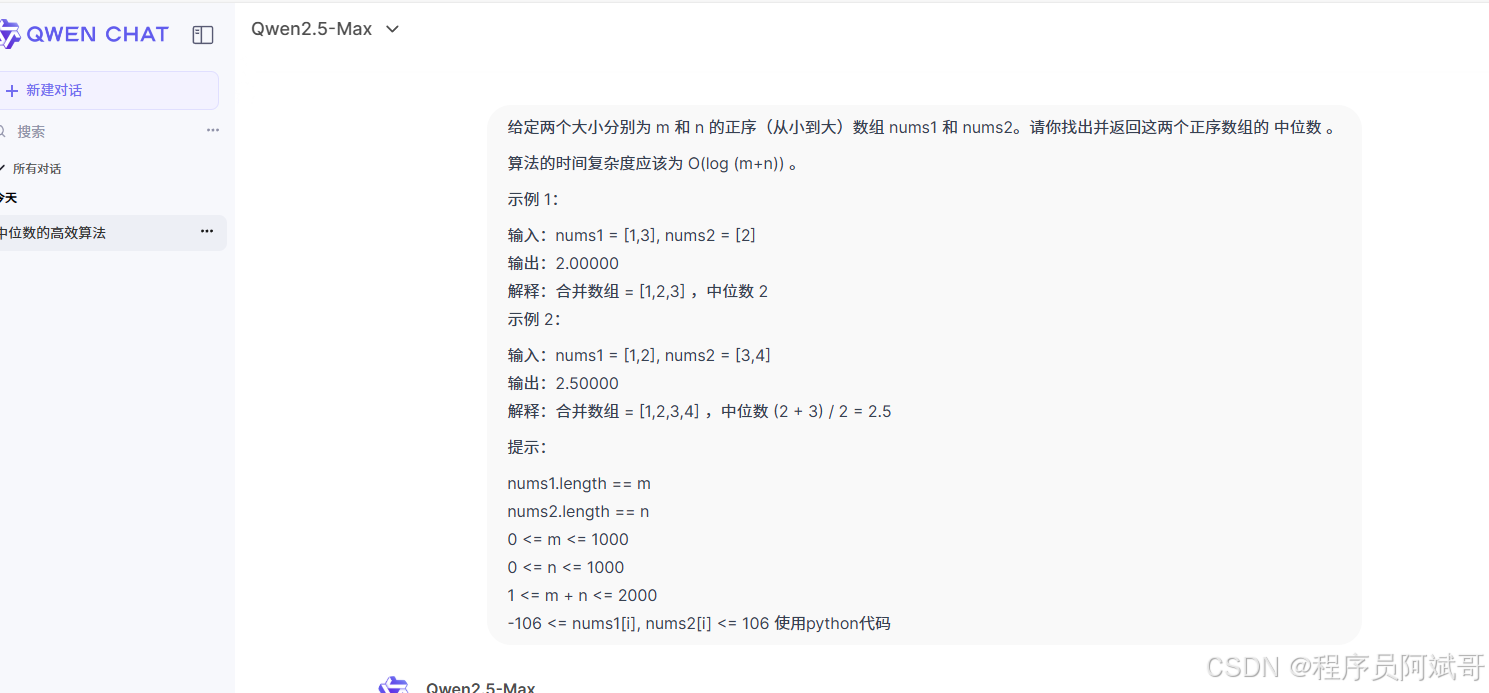

左上角模型选择Qwen2.5-Plus,然后开启Thinking(QwQ),就能用QwQ-32B了。

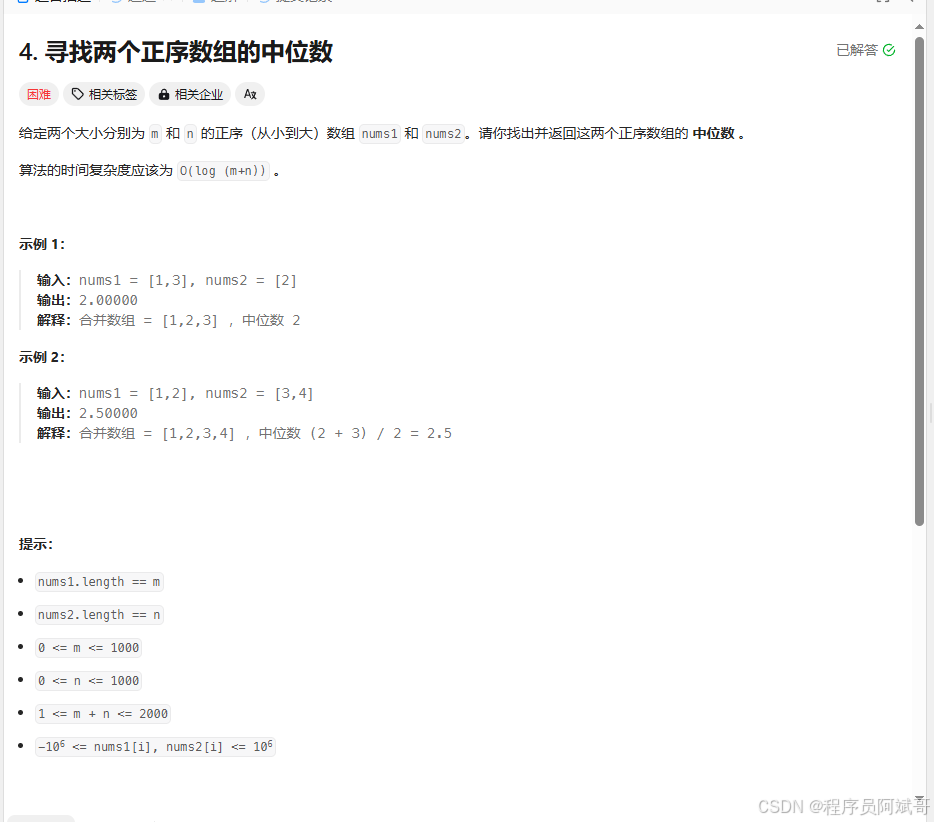

这里我们测试下。它的能力,直接leetcode找个困难的算法扔给他运行。

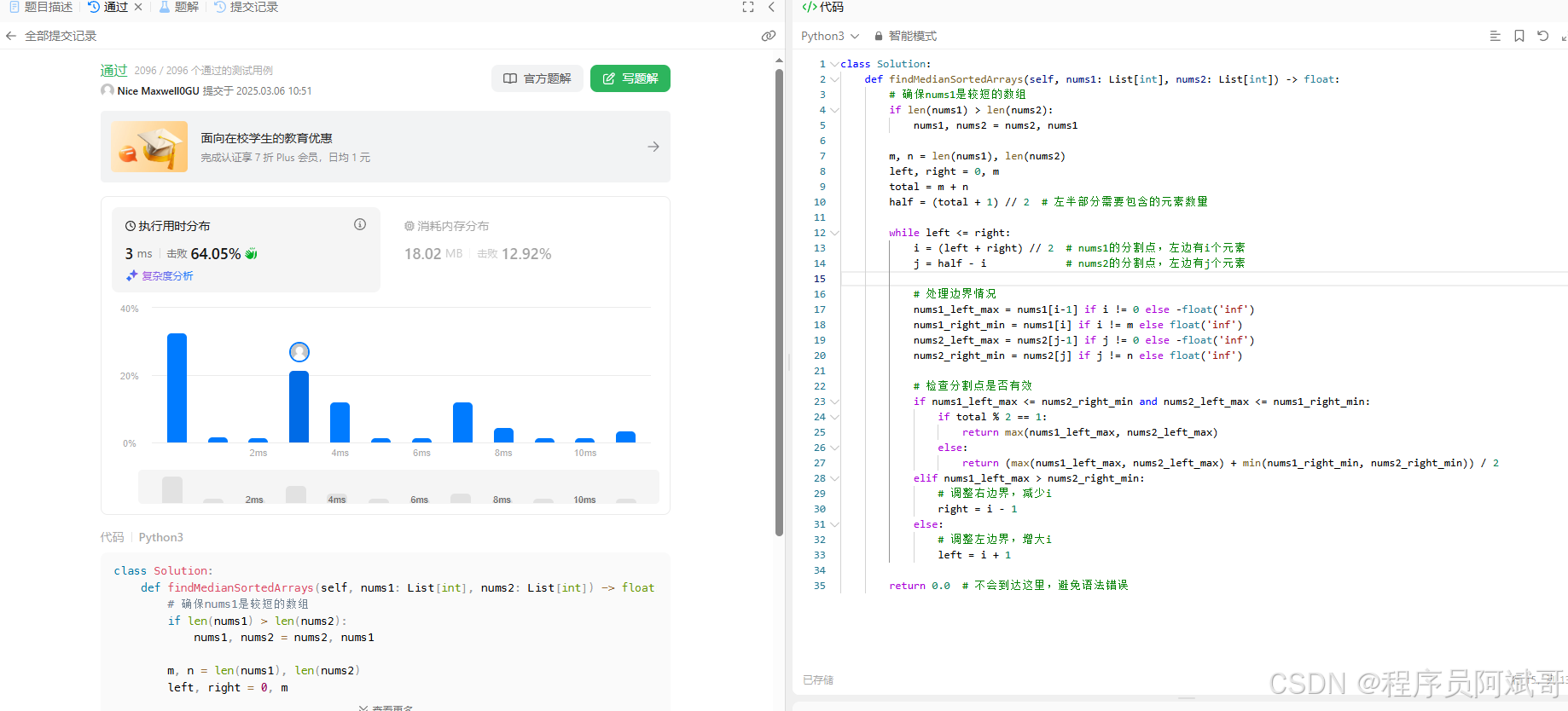

得出结果,后直接提交。完美运行,且打败了64.05%的人,效果还是不错的。现在还有谁还去刷算法题啊,你连ai都卷不过了。

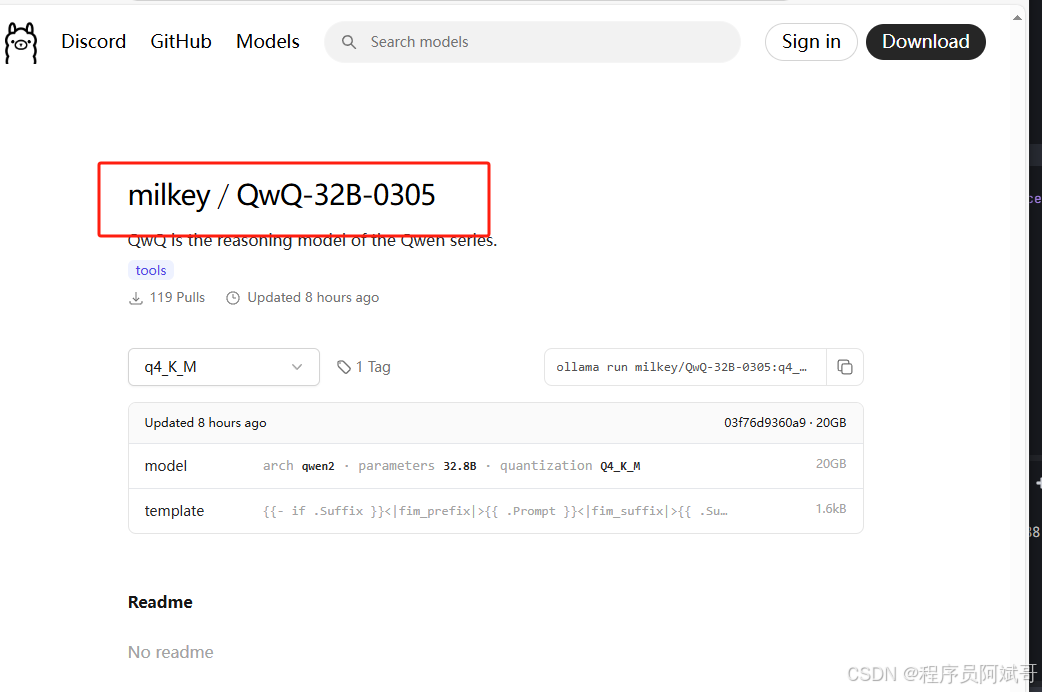

话说,32B的参数级别,24GB的显存就可以正常运行起来,这大大减低了使用成本,一般公司也可以负担的起了。ollama官网上没办法下载最新的该模型,但有私有上传的版本。

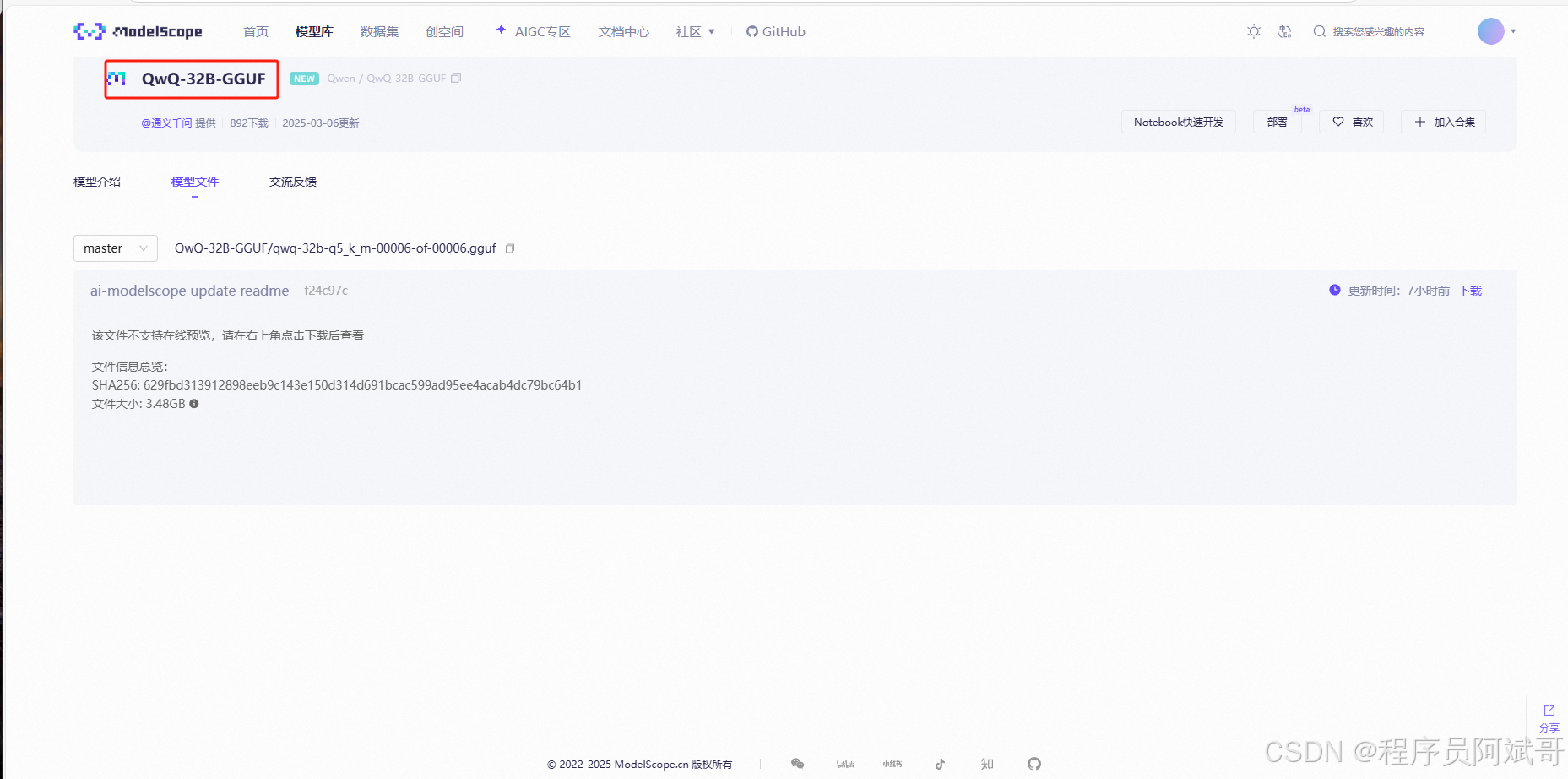

如果你的本地网速不好,或者下载经常失败,可以去魔塔社区找到QwQ-32B gguf格式下载到本地,使用ollama本地加载,本地测试和官方提供的能力差不多。具体如果使用gguf格式加载到ollama参考之前的博文:手把手教你,如果使用ollama本地部署deepseek R1模型,再也不用害怕代码泄漏了_ollama安装deepseek的gguf文件-CSDN博客

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)