BP神经网络(七)——正则化

神经网络的正则化,L2正则化,dropout正则化,一步步理解并实现全连接神经网络——正则化。

·

L2正则化

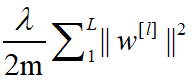

正则化用来处理过拟合的问题,神经网络的过拟合现象一般都会遇到,解决办法其中一个是正则化,另一个是准备更多的数据。第二种方法不可能的情况下,正则化可以有效解决过拟合。一般选择L2正则化 对w进行处理,正则化的代价函数需要在后面加上正则项为

其中 为范数平方,这个矩阵范数(即平方范数),被定义为参数矩阵中所有元素的平方求和。

为范数平方,这个矩阵范数(即平方范数),被定义为参数矩阵中所有元素的平方求和。

dropout正则化

除L2正则化外,还存在dropout正则化,dropout正则化通过设置节点概率,然后消除一些节点,从而得到一个更小的网络。dropout一大缺点就是代价函数J不再被明确定义,每次迭代,都会随机移除一些节点,如果再三检查梯度下降的性能,实际上是很难进行复查的。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)