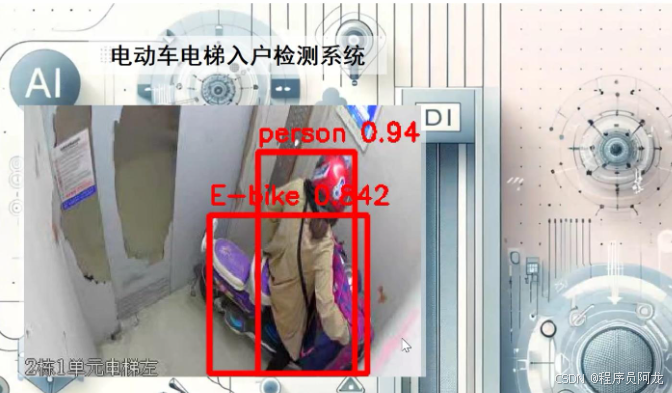

计算机毕业设计【改进YOLOv8】电动车电梯入户检测系统 YOLOv8+HGNetv2模型优化 实时监控 电动车违规检测 目标检测系统 数据分析 可视化 (源码+定制+开发)数据集合齐全!

博主介绍:✌ 我是阿龙,一名专注于Java技术领域的程序员,拥有超过10万粉丝的技术博主。作为CSDN特邀作者、博客专家、新星计划导师,我在计算机毕业设计开发方面积累了丰富的经验,致力于帮助更多学生解决技术难题并顺利完成毕业项目。同时,我也活跃在掘金、华为云、阿里云、InfoQ等平台,分享技术文章并获得广泛认可。技术领域:我擅长的技术栈包括但不限于:后端开发:SpringBoot、SSM、HLMT

博主介绍:

✌ 我是阿龙,一名专注于Java技术领域的程序员,拥有超过10万粉丝的技术博主。作为CSDN特邀作者、博客专家、新星计划导师,我在计算机毕业设计开发方面积累了丰富的经验,致力于帮助更多学生解决技术难题并顺利完成毕业项目。同时,我也活跃在掘金、华为云、阿里云、InfoQ等平台,分享技术文章并获得广泛认可。技术领域:

我擅长的技术栈包括但不限于:后端开发:SpringBoot、SSM、HLMT

前端开发:Vue、JSP、Node.js

跨平台开发:小程序、安卓APP

数据科学与人工智能:Python、机器学习、大数据

其他技术:PHP、爬虫、数据可视化、物联网等

无论是系统架构设计、开发难题,还是技术细节,遇到技术问题,我都乐意分享我的解决方案与心得。为什么选择阅读我的博客:

作为长期从事软件开发的技术博主,我不仅拥有扎实的编程能力,还具备丰富的实战经验。过去几年中,我辅导了上千名学生,帮助他们顺利完成毕业项目,并通过多平台的技术分享,吸引了超过50万粉丝关注。我的作品被CSDN、掘金、华为云、阿里云、InfoQ等多个知名平台推荐,并获得了博客之星等多个技术荣誉。在这里,您将获得最新的技术教程、实战案例分析和解决方案,让您的技术能力更上一层楼。

🍅 获取源码请在文末联系我 🍅

目录

区别之处在于,HRNet V2在该基网络的基 .项目数据集展示:

为什么选择我 博主提供的项目均为博主自己收集和开发的!所有的源码都经由博主检验过,能过正常启动并且功能都没有问题!同学们拿到后就能使用!且博主自身就是高级开发,可以将所有的代码都清晰讲解出来

一、详细操作演示视频

在文章的尾声,您会发现一张电子名片👤,欢迎通过名片上的联系方式与我取得联系,以获取更多关于项目演示的详尽视频内容。视频将帮助您全面理解项目的关键点和操作流程。期待与您的进一步交流!

1. 研究背景与意义

随着电动汽车的普及和人们环保意识的提高,电动汽车的使用量日益增加。然而,电动汽车的充电问题,尤其是在高层住宅区,依然面临着严峻的挑战。为了解决这一问题,电梯入户充电系统逐渐成为一种广泛采用的解决方案。然而,电梯入户充电系统的安全性与可靠性仍然是亟待解决的重要问题。

在电梯入户充电系统中,电动汽车的检测是一个核心环节。传统的检测方法主要依赖人工巡视,但这种方式存在诸如人力成本高、效率低、容易出错等问题。因此,开发一种高效、准确的电动车电梯入户检测系统显得尤为重要。

近年来,深度学习技术在计算机视觉领域取得了显著进展,特别是在目标检测方面。YOLO(You Only Look Once)算法因其快速和准确的特点,已经在多种应用场景中得到了广泛应用。然而,YOLO算法在电动车电梯入户检测中的应用仍存在一定问题。首先,YOLO算法对小目标的检测效果较差,而电动汽车通常较小,导致检测精度不足;其次,电梯入户场景背景复杂,容易干扰目标检测的准确性,因此需要改进算法以增强其鲁棒性。

为了解决上述问题,本研究提出了一种基于HGNetv2和改进YOLOv8算法的电动汽车电梯入户检测系统。HGNetv2是一种高效的特征提取网络,能够提取更丰富的特征信息,从而提高目标检测的精度;改进的YOLOv8算法则在YOLOv3的基础上进行了优化,通过引入注意力机制和多尺度特征融合,提升了算法在小目标和复杂背景下的检测能力。

本研究的意义体现在以下几个方面:

-

提升电动车电梯入户检测的准确性:通过融合HGNetv2和改进的YOLOv8算法,系统能够提取更加丰富的特征信息,并通过注意力机制和多尺度特征融合来提高检测准确性。这将有效减少误报和漏报,显著提升电动车电梯入户检测的可靠性。

-

提升电动车电梯入户检测的效率:改进后的YOLOv8算法具有更快的检测速度,可以实现实时电动汽车检测,从而提高电梯入户充电系统的整体使用效率,减少用户的等待时间。

-

降低电梯入户充电系统的维护成本:传统的人工巡视方式需要大量人力投入,而改进后的电动车电梯入户检测系统可以实现自动化检测,减少人力成本。此外,改进后的系统误报率较低,能够有效降低维护工作量。

综上所述,改进后的电动车电梯入户检测系统对于提升电梯入户充电系统的安全性、可靠性和效率具有重要意义。该系统的研究成果将为电动汽车充电问题的解决提供有力支持,促进电动汽车的普及,并进一步推动环保事业的发展。

展示效果

HRNet V2简介

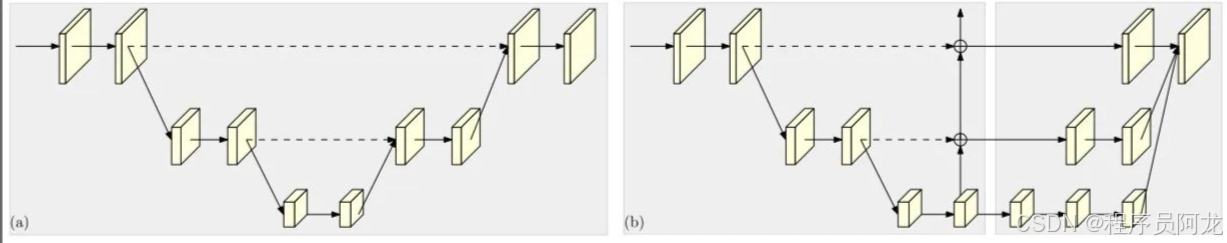

当前,设计高低分辨率融合的网络架构主要有以下四种思路:

-

对称结构:如U-Net、Hourglass等网络,这些结构通常通过先进行下采样后上采样的方式,保持上下采样过程的对称性。

-

级联金字塔:例如RefineNet等,在高低分辨率的融合过程中,采用卷积操作对不同分辨率的信息进行处理。

-

简单的基线方法:通过转置卷积(或反卷积)进行上采样。

-

扩张卷积:例如DeepLab等,使用扩张卷积来增大感受野,减少下采样次数,从而能够在不使用跳层连接的情况下实现上采样。

其中,第(b)和第(c)种方法通常会先通过复杂的网络(如ResNet、VGG)进行下采样,然后再用轻量级网络进行上采样。

HRNet V1是在第(b)种方法的基础上进行改进的,它通过从头到尾保持较高的分辨率表示来实现高效的特征融合。然而,HRNet V1最初仅应用于姿态估计领域。HRNet V2对其进行了小幅改进,使得该架构可以适用于更广泛的计算机视觉任务。这些改进仅带来了轻微的计算开销增加,但显著提升了准确度和性能。

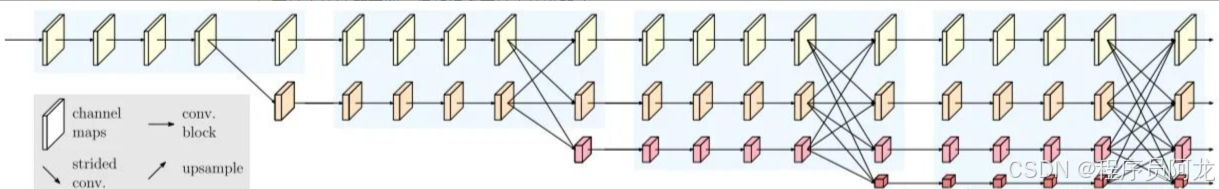

网络结构图

该网络结构图简洁明了,因此不再赘述。首先,图2中的输入是经过四倍下采样的特征图。图中的横向卷积块(conv block)指的是BasicBlock或Bottleneck,而不同分辨率之间的交叉线部分则表示多分辨率卷积(multi-resolution convolution)。

到此为止,HRNet V2与HRNet V1的结构是完全一致的。

区别之处在于,HRNet V2在该基网络的基础上增加了一个新的head。

此版本保留了原文的信息内容,但通过简化句式使其更加流畅,并突出了HRNet V2与V1的差异。

网络结构图

该网络结构图简洁明了,因此不再赘述。首先,图2中的输入是经过四倍下采样的特征图。图中的横向卷积块(conv block)指的是BasicBlock或Bottleneck,而不同分辨率之间的交叉线部分则表示多分辨率卷积(multi-resolution convolution)。

到此为止,HRNet V2与HRNet V1的结构是完全一致的。

区别之处在于,HRNet V2在该基网络的基 .

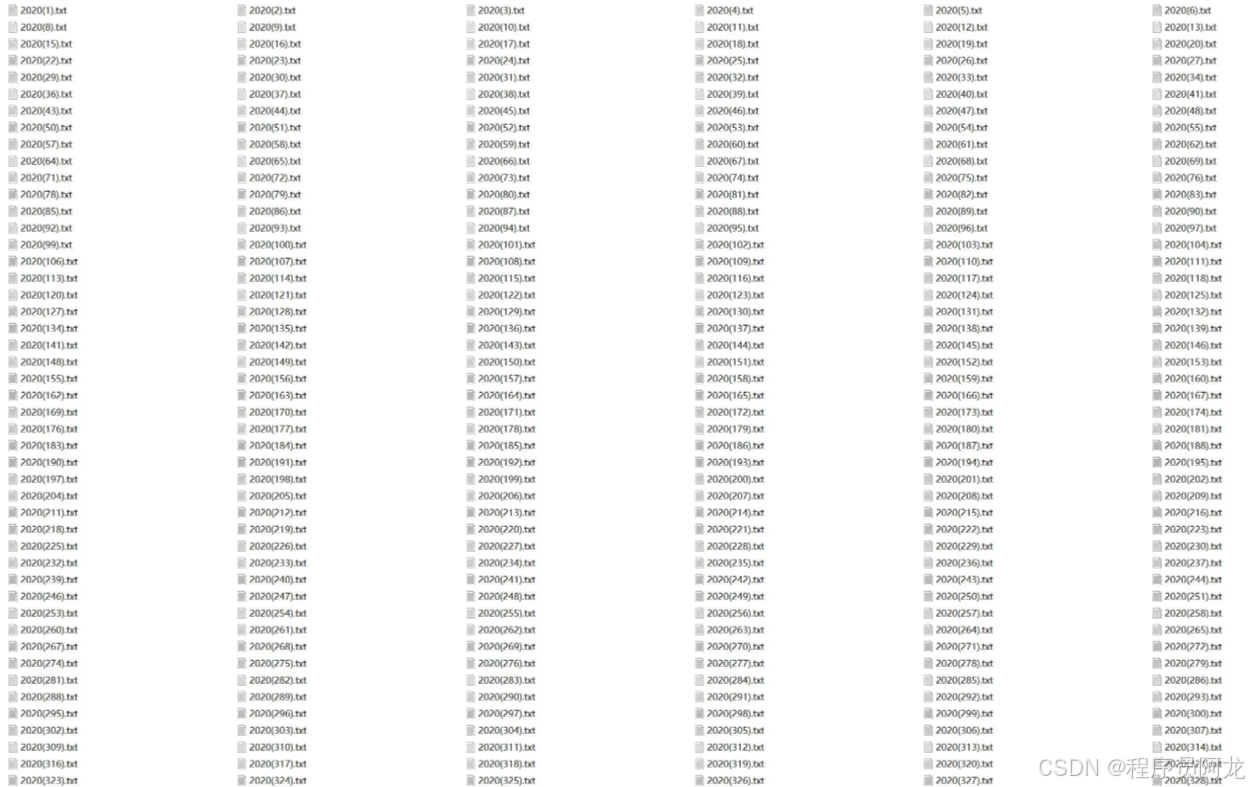

项目数据集展示:

数据集与标注工具

本系统的数据集合使用了 labelImg 进行标注。LabelImg 是一种图形化的图像标注工具,支持 VOC 和 YOLO 格式的输出。以下是使用 labelImg 将图片标注为 VOC 格式的步骤:

- 下载并安装 LabelImg:根据官方文档或开源平台获取并安装 LabelImg 工具。

- 选择图片目录:打开 LabelImg 并点击“Open Dir”按钮,选择需要标注的图片目录。

- 设置标签名称:为目标对象(如电动车或其他检测对象)定义标签。

- 绘制标注框:在图片上绘制矩形框,并为每个框分配对应的标签名称。

- 保存标注文件:完成标注后,保存信息,这将在图片目录下生成一个与图片同名的 XML 文件(VOC 格式)。

- 重复标注:对目录中所有图片重复以上步骤,直到标注工作完成。

通过上述步骤,可以高效地完成图片标注,并为后续模型训练提供标准化的标注数据。

项目核心代码:

#!/usr/bin/env python3

# -*- coding: utf-8 -*-

import os

import xml.etree.ElementTree as ET

# 初始化类别列表

classes = []

# 获取当前文件所在目录的路径

CURRENT_DIR = os.path.dirname(os.path.abspath(__file__))

# 定义坐标转换函数,将 VOC 格式坐标转换为 YOLO 格式

def convert(size, box):

"""

Convert bounding box coordinates from VOC format to YOLO format.

Parameters:

- size: Tuple of image width and height (width, height)

- box: Tuple of bounding box coordinates (xmin, xmax, ymin, ymax)

Returns:

- Tuple of YOLO format coordinates (x_center, y_center, width, height)

"""

dw = 1. / size[0]

dh = 1. / size[1]

x = (box[0] + box[1]) / 2.0

y = (box[2] + box[3]) / 2.0

w = box[1] - box[0]

h = box[3] - box[2]

return x * dw, y * dh, w * dw, h * dh

# 定义标注转换函数,将 XML 转换为 YOLO 格式

def convert_annotation(image_id):

"""

Convert annotations from VOC XML format to YOLO text format.

Parameters:

- image_id: The ID of the image (filename without extension)

Output:

- Writes a corresponding .txt file in the 'label_txt' directory.

"""

# 输入 XML 文件路径

in_file_path = os.path.join(CURRENT_DIR, 'label_xml', f'{image_id}.xml')

# 输出 TXT 文件路径

out_file_path = os.path.join(CURRENT_DIR, 'label_txt', f'{image_id}.txt')

# 打开输入文件和创建输出文件

with open(in_file_path, encoding='UTF-8') as in_file, open(out_file_path, 'w') as out_file:

tree = ET.parse(in_file)

root = tree.getroot()

# 获取图像尺寸信息

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

# 遍历 XML 中的所有目标对象

for obj in root.iter('object'):

cls = obj.find('name').text

if cls not in classes:

classes.append(cls) # 如果类别不存在,添加到类别列表中

cls_id = classes.index(cls) # 获取类别的索引值

# 获取目标的边界框坐标

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text),

float(xmlbox.find('ymin').text), float(xmlbox.find('ymax').text))

# 转换为 YOLO 格式

bb = convert((w, h), b)

# 写入 YOLO 格式的标注

out_file.write(f"{cls_id} {' '.join(map(str, bb))}\n")

# 创建输出目录(如果不存在)

output_dir = os.path.join(CURRENT_DIR, 'label_txt')

if not os.path.exists(output_dir):

os.makedirs(output_dir)

# 获取所有 XML 文件的文件名

xml_path = os.path.join(CURRENT_DIR, 'label_xml')

img_xmls = [f for f in os.listdir(xml_path) if f.endswith('.xml')]

# 遍历 XML 文件并进行标注转换

for img_xml in img_xmls:

label_name = os.path.splitext(img_xml)[0] # 去掉文件扩展名

print(f"Processing: {label_name}")

convert_annotation(label_name)

# 打印所有类别信息

print("\nClasses:")

print(classes)

5.核心代码讲解

封装为类后的代码如下:

from ultralytics.engine.predictor import BasePredictor

from ultralytics.engine.results import Results

from ultralytics.utils import ops

class DetectionPredictor(BasePredictor):

"""

自定义目标检测预测器,继承自 BasePredictor 并重写后处理方法。

"""

def postprocess(self, preds, img, orig_imgs):

"""

后处理检测结果,包括非极大值抑制和预测框尺寸的调整。

Args:

- preds: 模型的预测结果,形状为 [N, 6],包含边界框坐标和分类信息。

- img: 输入到模型中的图像张量。

- orig_imgs: 原始输入图像(未归一化或缩放)。

Returns:

- results: 一个包含检测结果的列表,每个元素为一个 `Results` 对象。

"""

# 非极大值抑制 (NMS) 以减少冗余检测框

preds = ops.non_max_suppression(

preds,

conf_thres=self.args.conf, # 置信度阈值

iou_thres=self.args.iou, # IoU 阈值

agnostic=self.args.agnostic_nms, # 是否类别无关的 NMS

max_det=self.args.max_det, # 每张图像的最大检测框数

classes=self.args.classes # 要检测的类别

)

# 确保 orig_imgs 是一个列表或批量的 numpy 数组

if not isinstance(orig_imgs, list):

orig_imgs = ops.convert_torch2numpy_batch(orig_imgs)

results = [] # 初始化结果列表

for i, pred in enumerate(preds): # 遍历每张图像的预测结果

orig_img = orig_imgs[i] # 获取原始图像

# 调整检测框的坐标以匹配原始图像的尺寸

pred[:, :4] = ops.scale_boxes(img.shape[2:], pred[:, :4], orig_img.shape)

# 获取图像路径

img_path = self.batch[0][i]

# 创建 Results 对象并添加到结果列表

results.append(Results(orig_img, path=img_path, names=self.model.names, boxes=pred))

return results

为什么选择我

博主提供的项目均为博主自己收集和开发的!所有的源码都经由博主检验过,能过正常启动并且功能都没有问题!同学们拿到后就能使用!且博主自身就是高级开发,可以将所有的代码都清晰讲解出来

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献31条内容

已为社区贡献31条内容

所有评论(0)