循环神经网络、注意力机制、Transformer——Paddle

本篇为《深度学习》系列博客的第十二篇,该系列博客主要记录深度学习相关知识的学习过程和自己的理解,方便以后查阅。

·

本篇为《深度学习》系列博客的第十二篇,该系列博客主要记录深度学习相关知识的学习过程和自己的理解,方便以后查阅。

本篇ppt来自于百度的《情感分析》课程,如想了解详情,请移步上述课程链接。

循环神经网络、注意力机制、Transformer

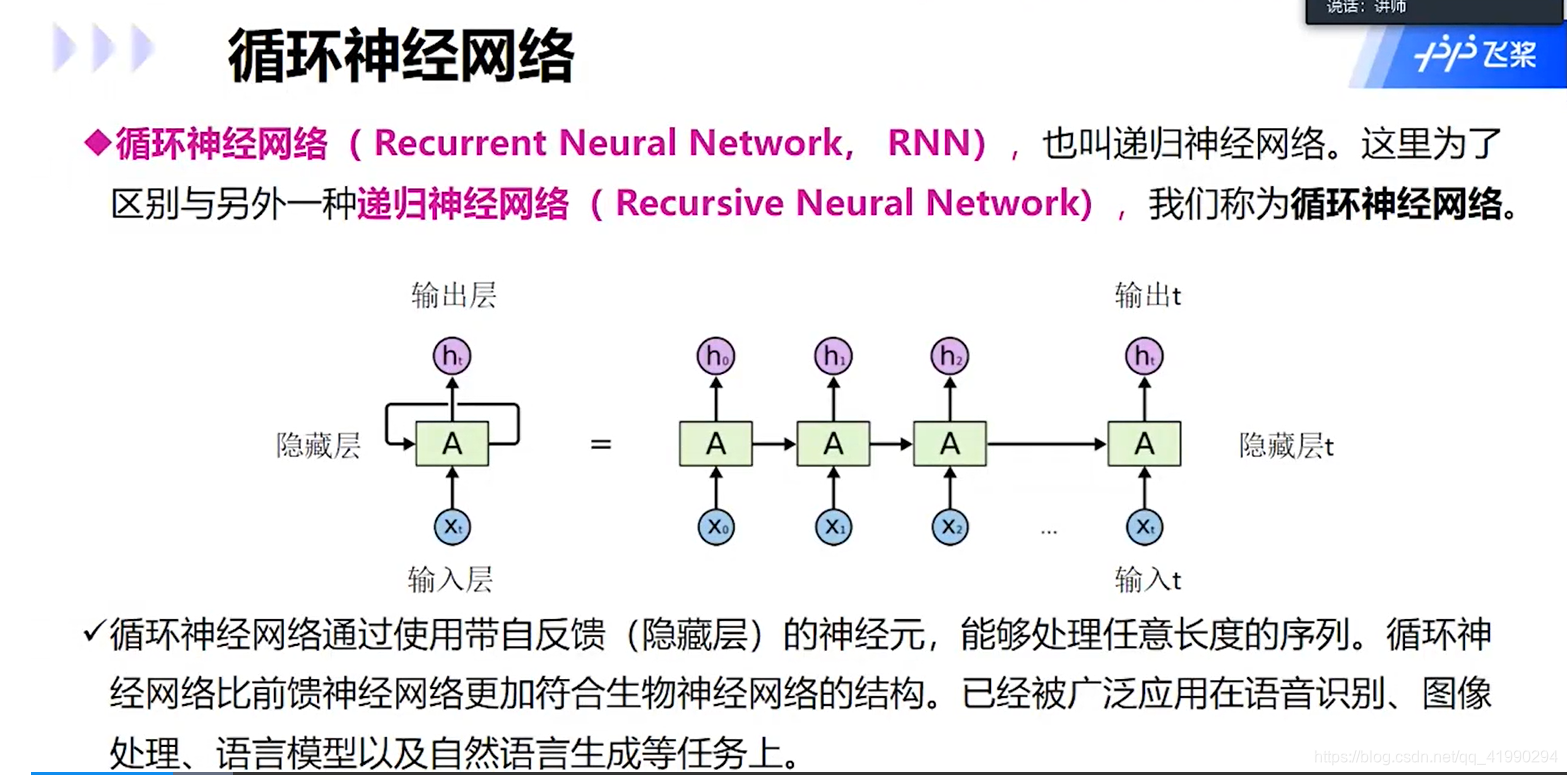

循环神经网络

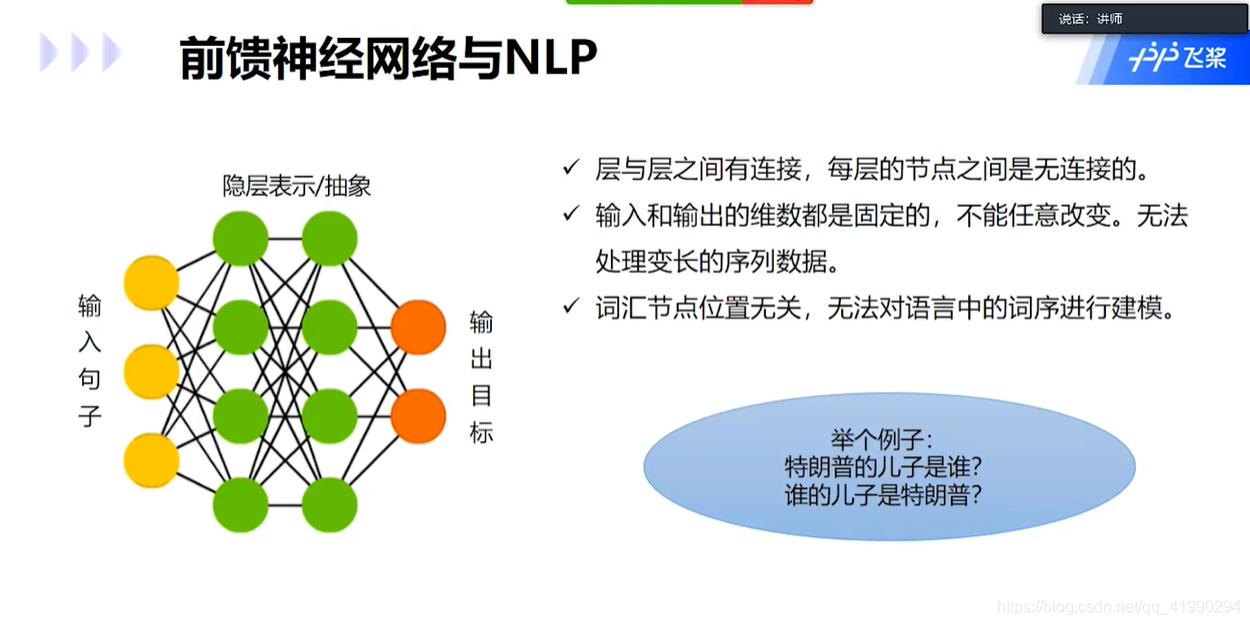

全连接神经网络的问题:

为了解决上述任务,所以提出了循环神经网络。

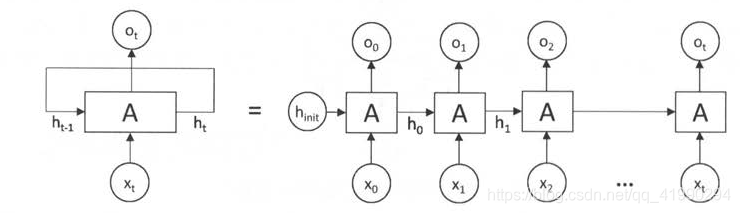

循环神经网络经典结构示意图:

循环神经网络按时间展开后的结构:

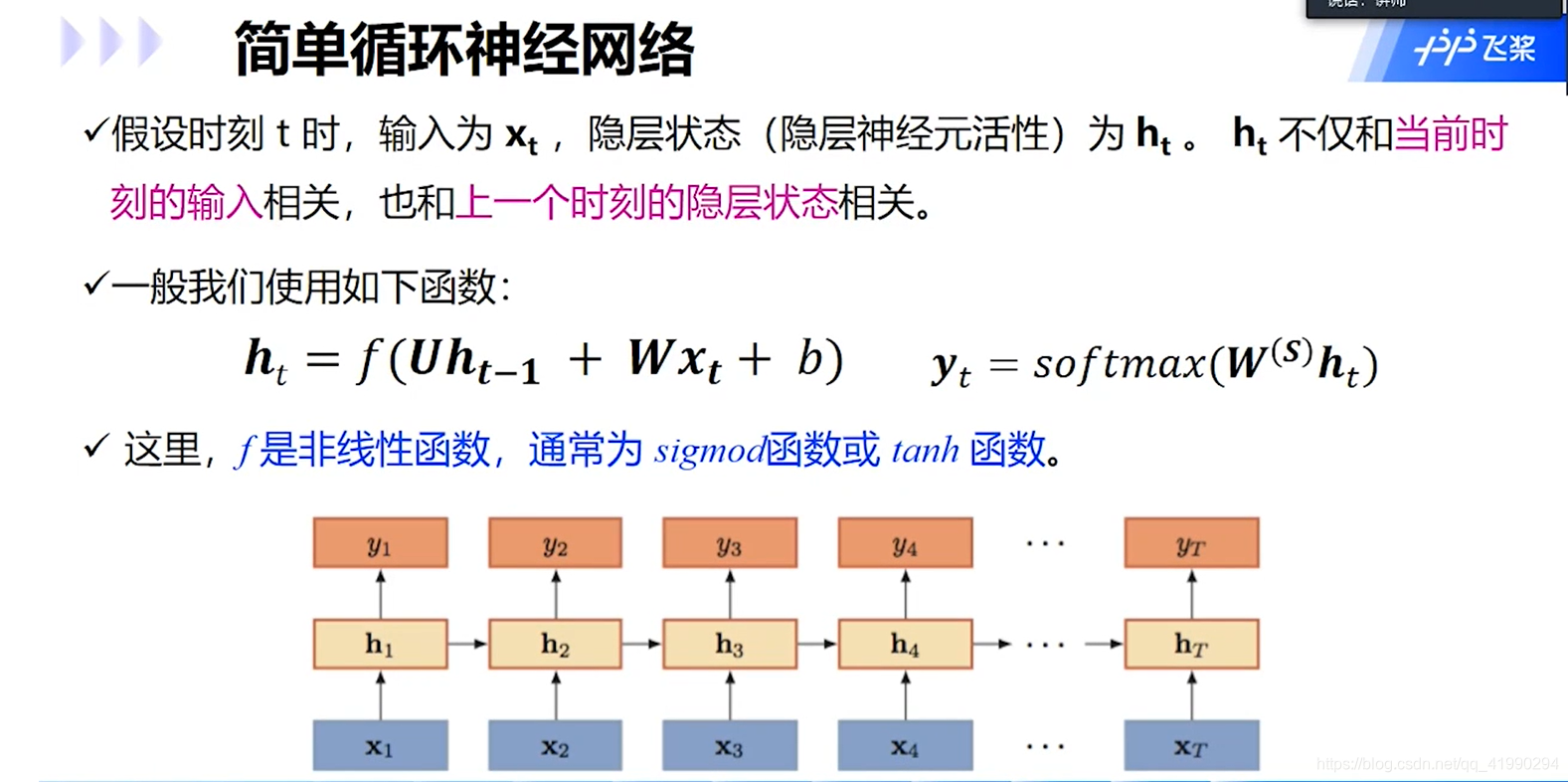

使用单层全连接神经网络作为循环体的循环神经网络结构图:

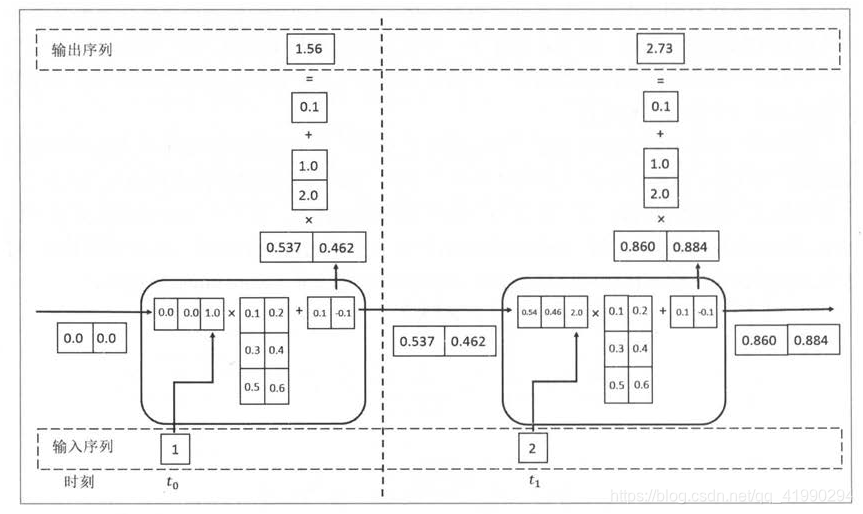

循环神经网络的前向传播的计算过程示意图:

使用单层全连接神经网络作为循环体的循环神经网络结构图:

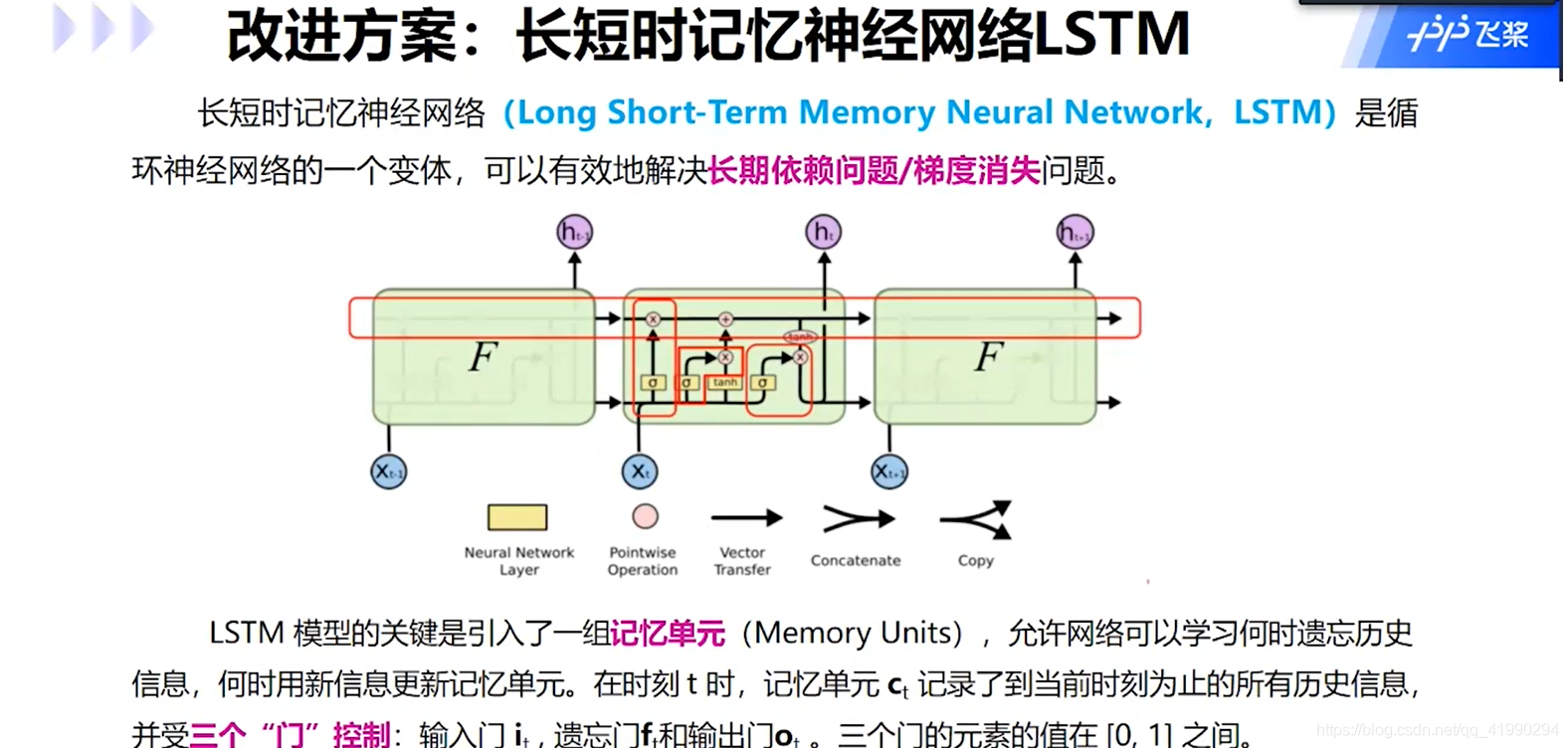

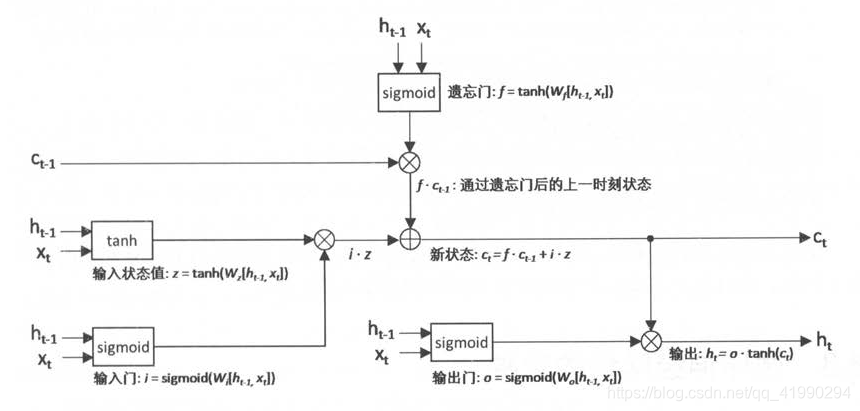

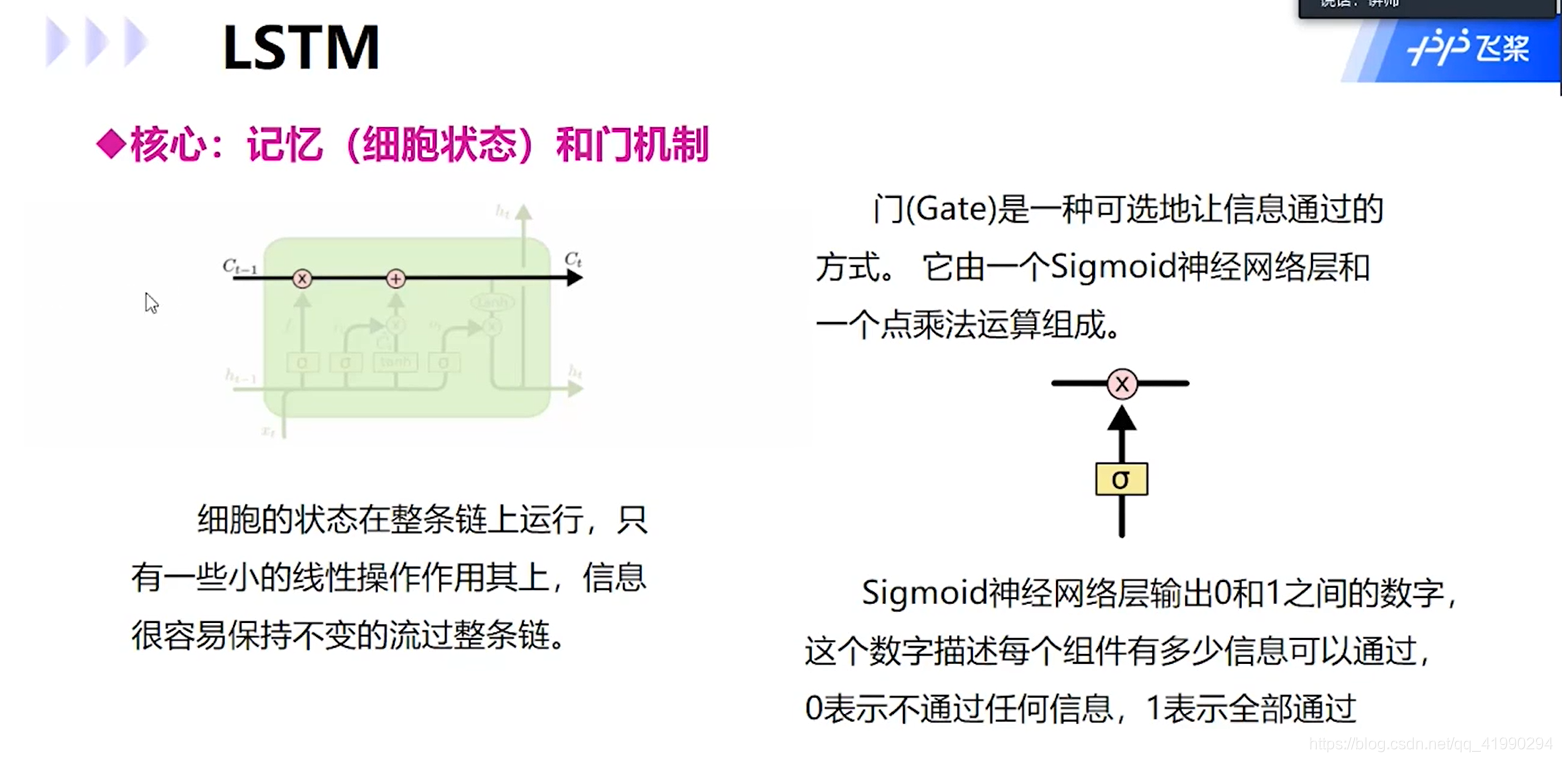

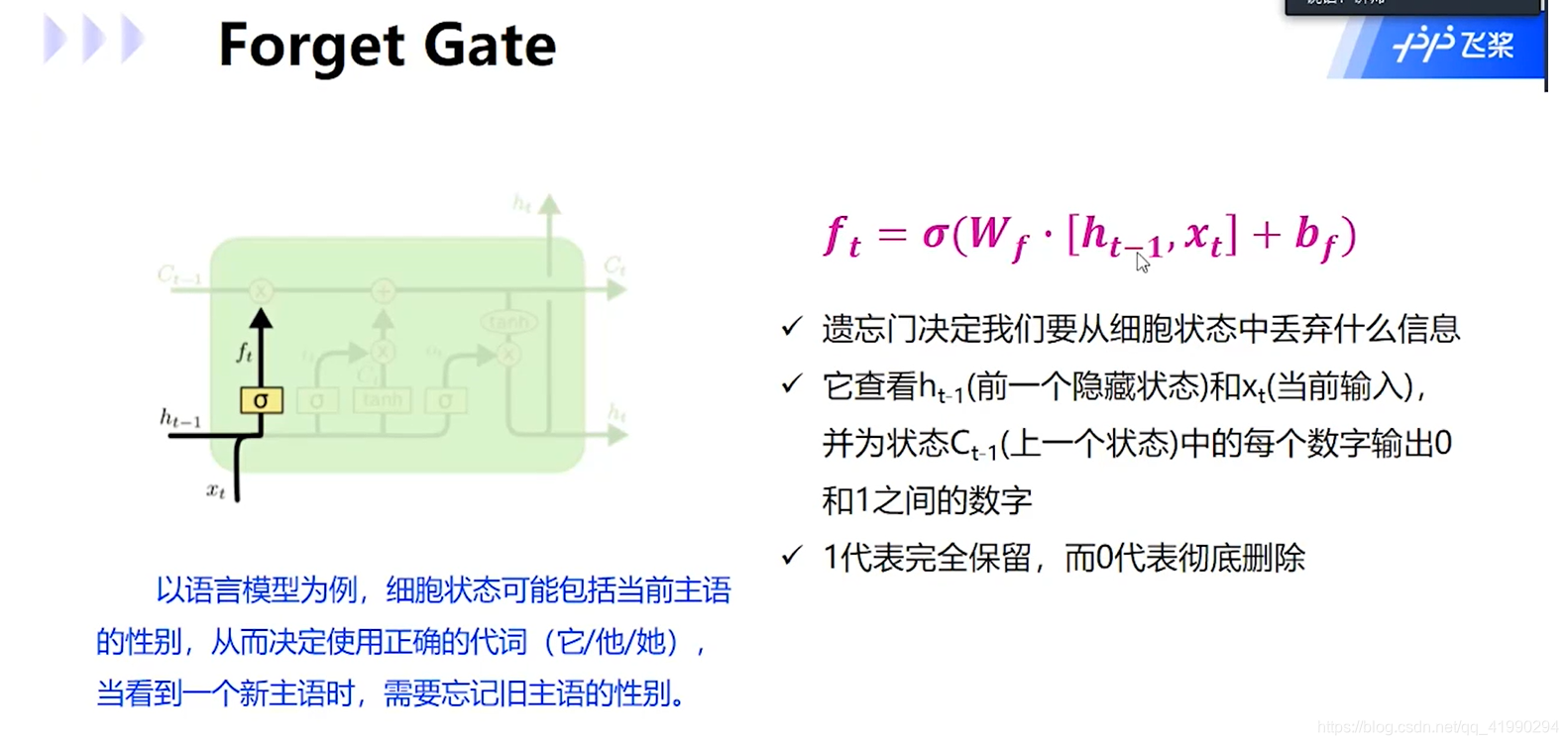

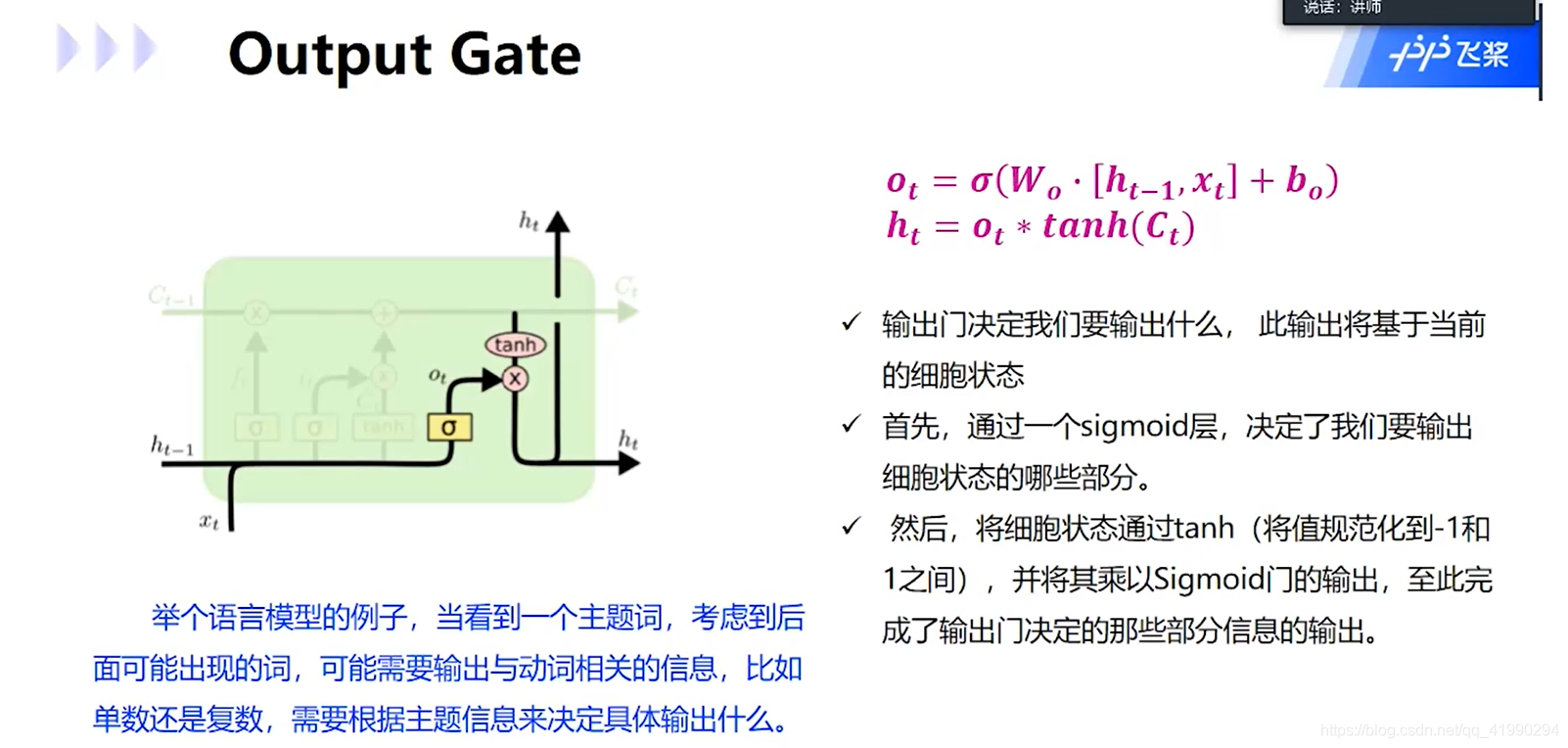

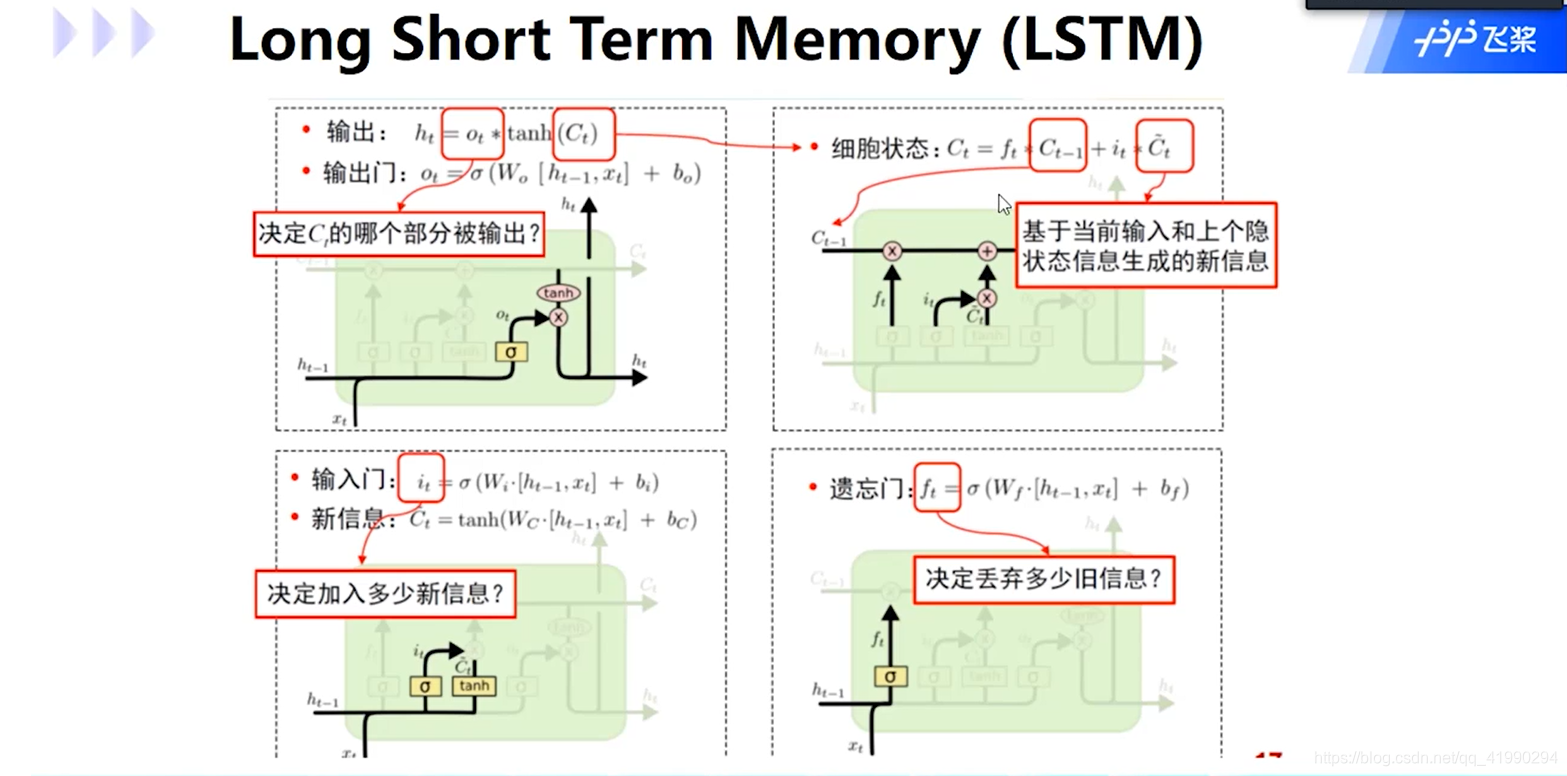

LSTM 单元细节图(输入: C t − 1 C_{t-1} Ct−1, h t − 1 h_{t-1} ht−1, X t X_{t} Xt, 输出: C t C_{t} Ct, h t h_{t} ht):

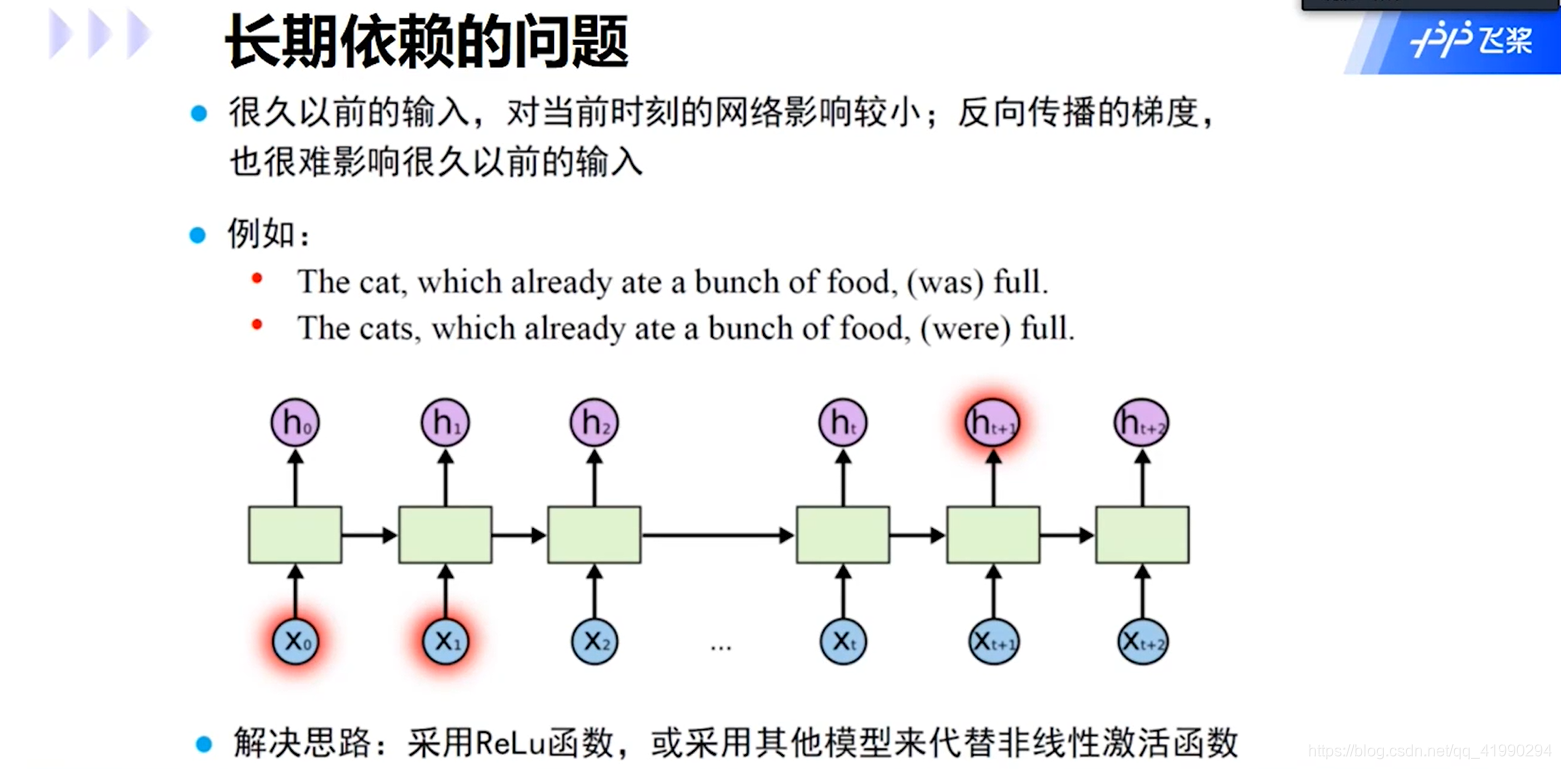

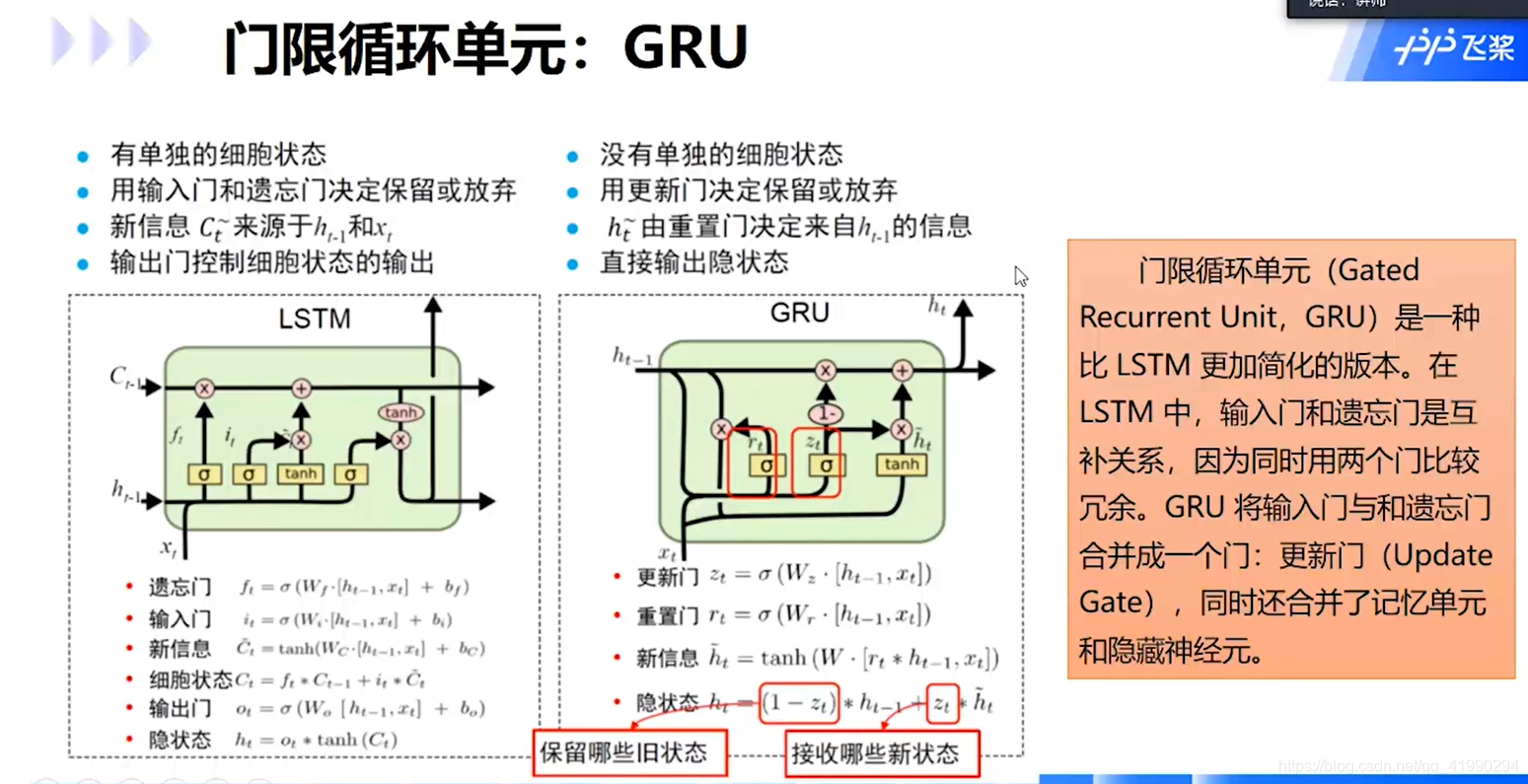

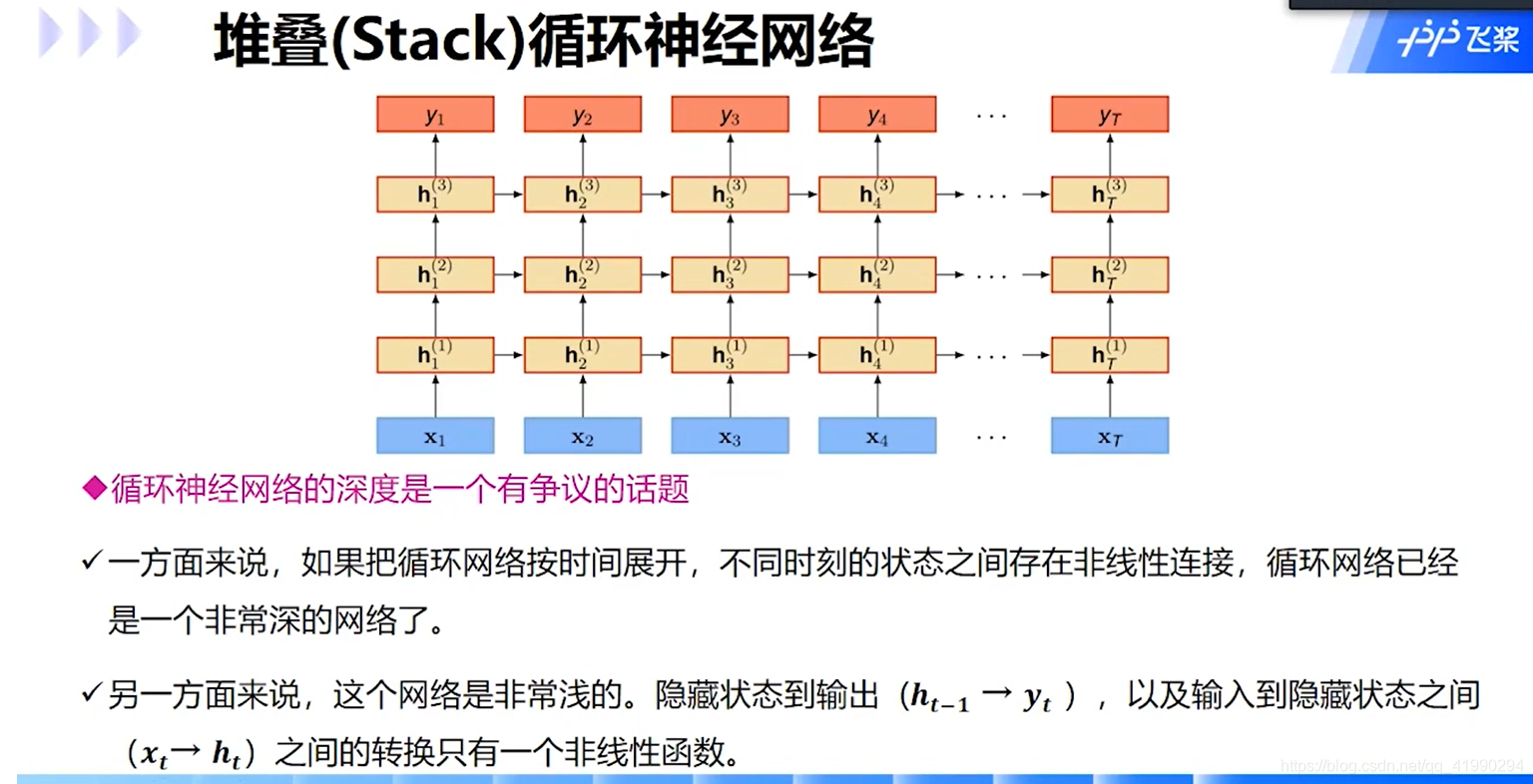

长短期记忆网络改进的总结:

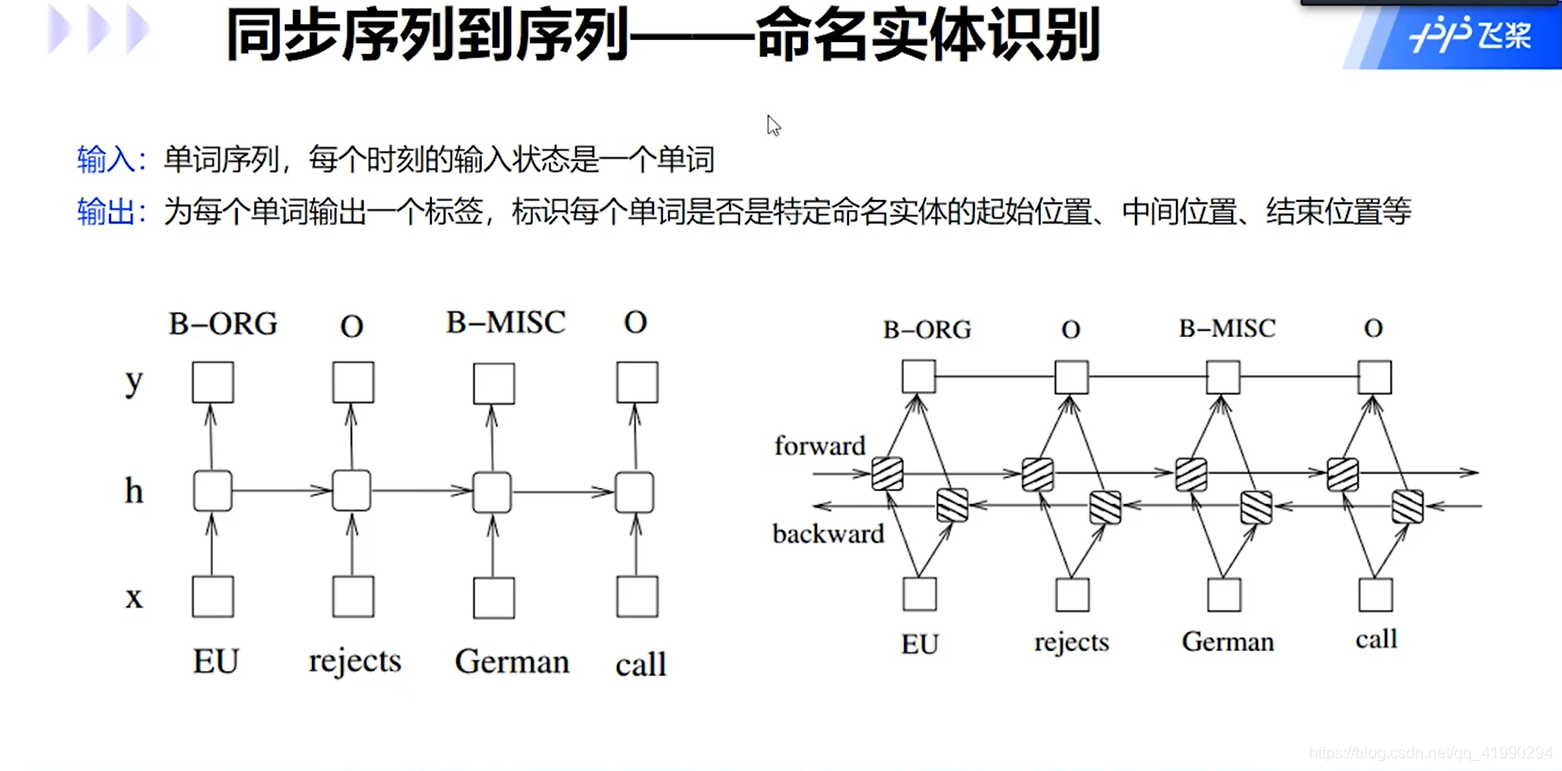

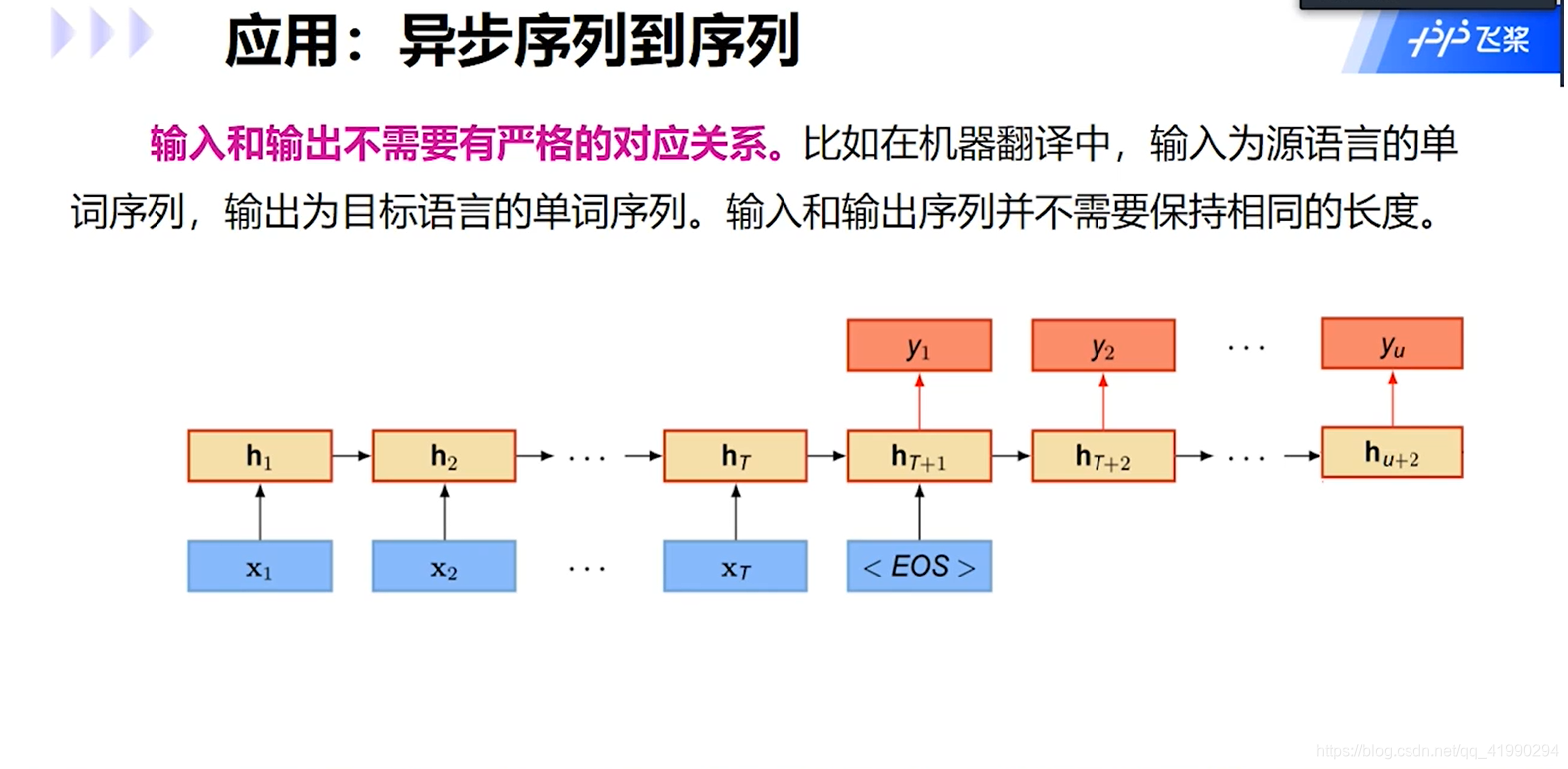

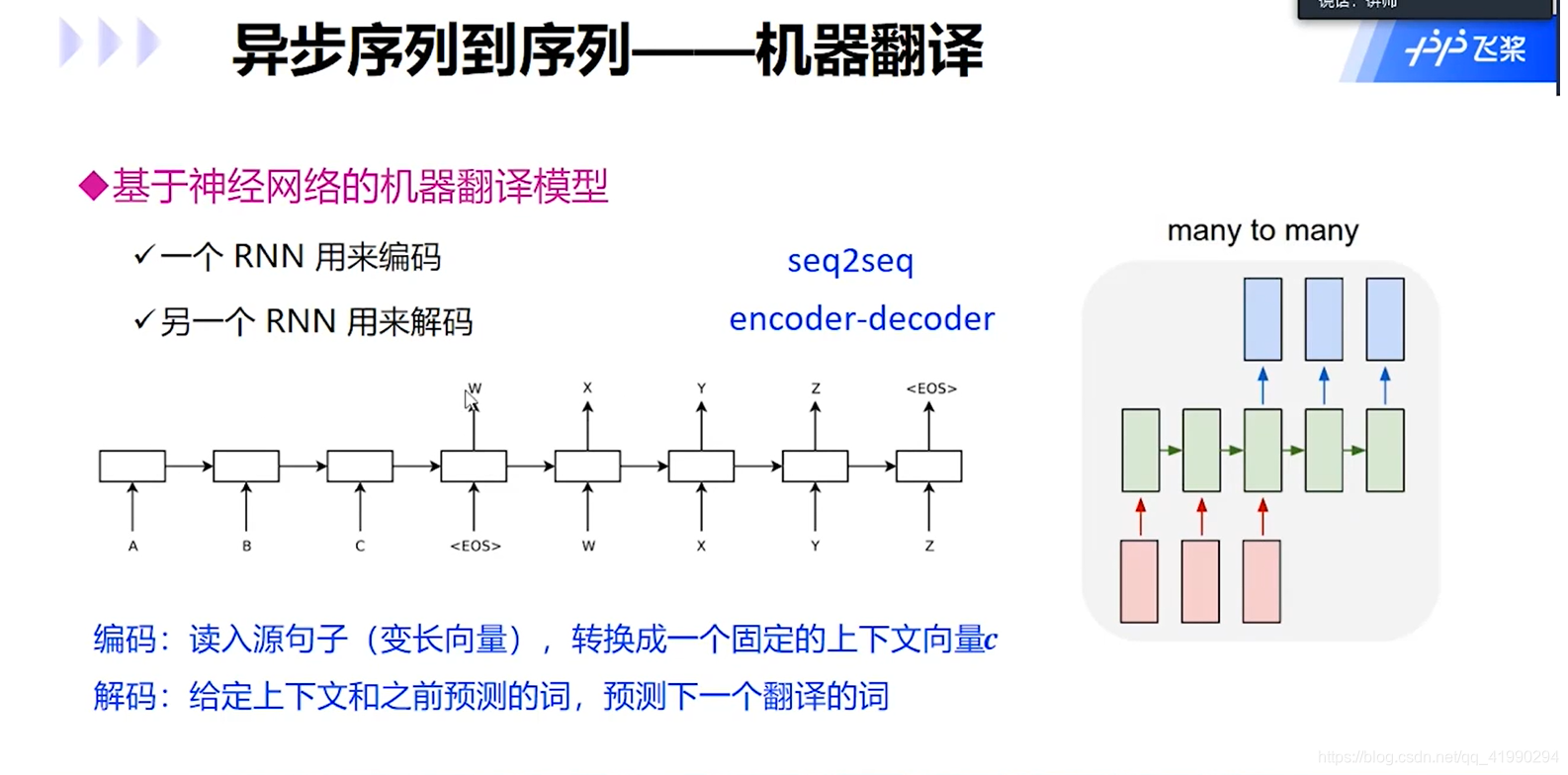

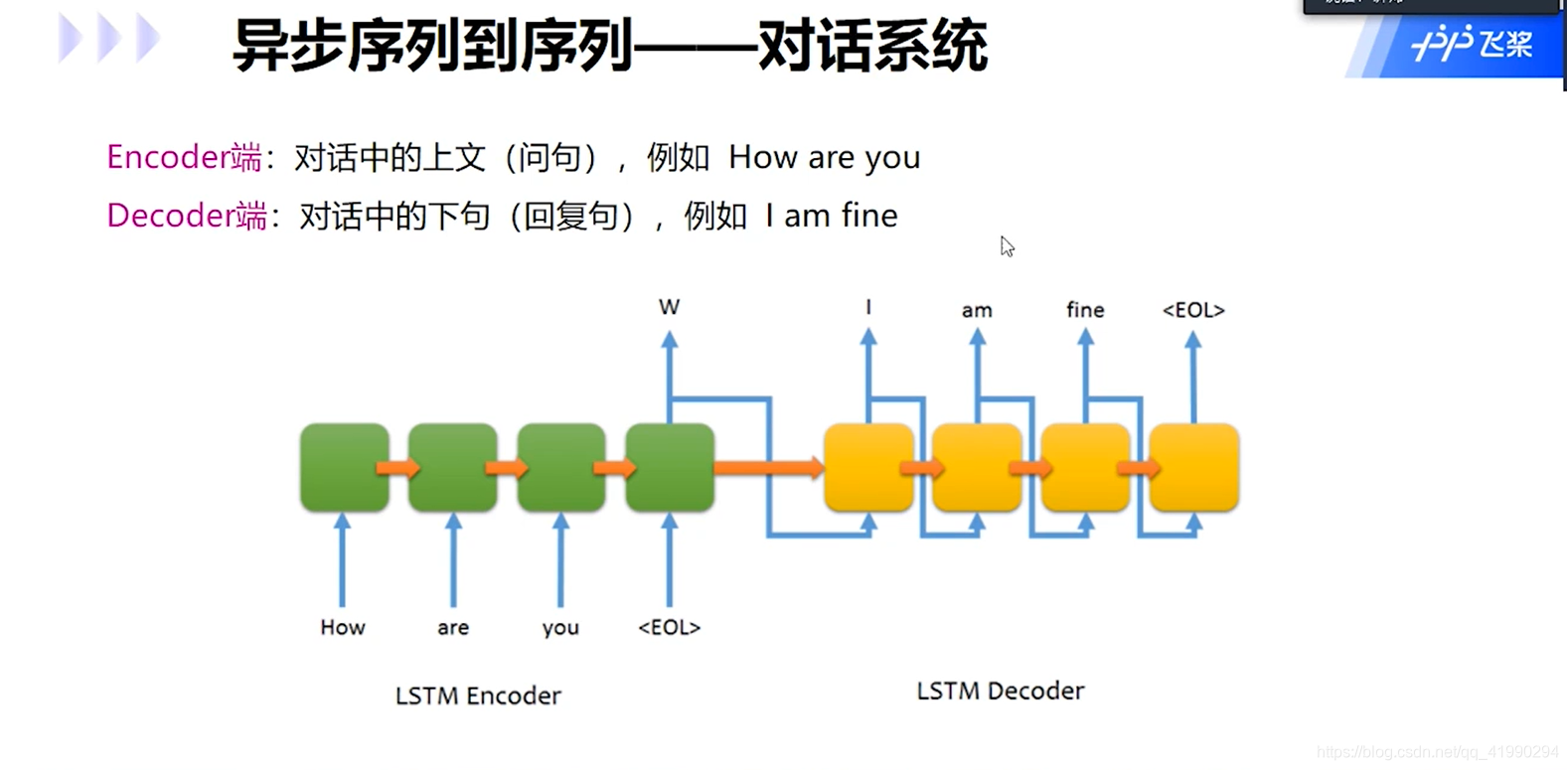

Seq2Seq 模型示意图:

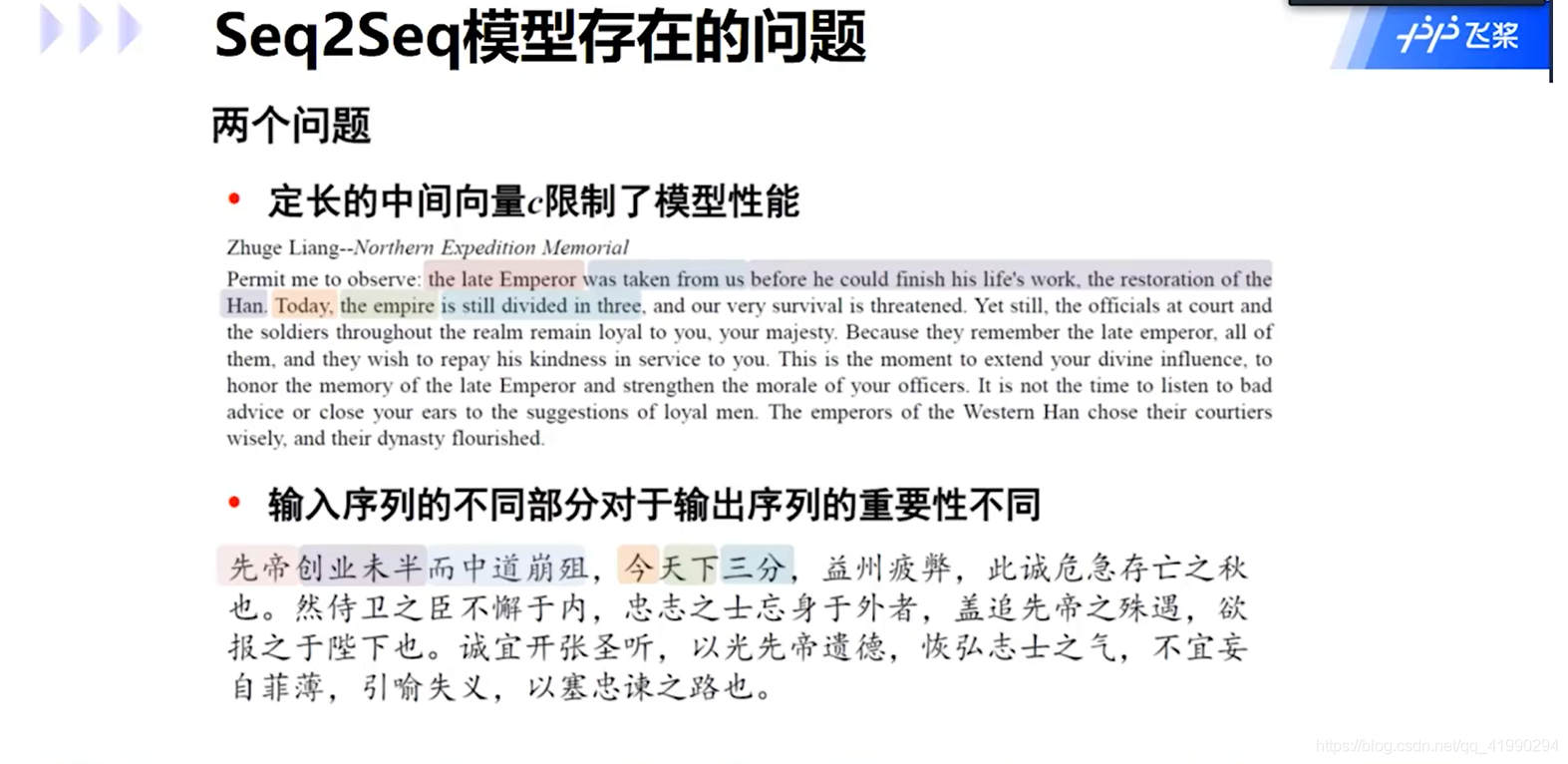

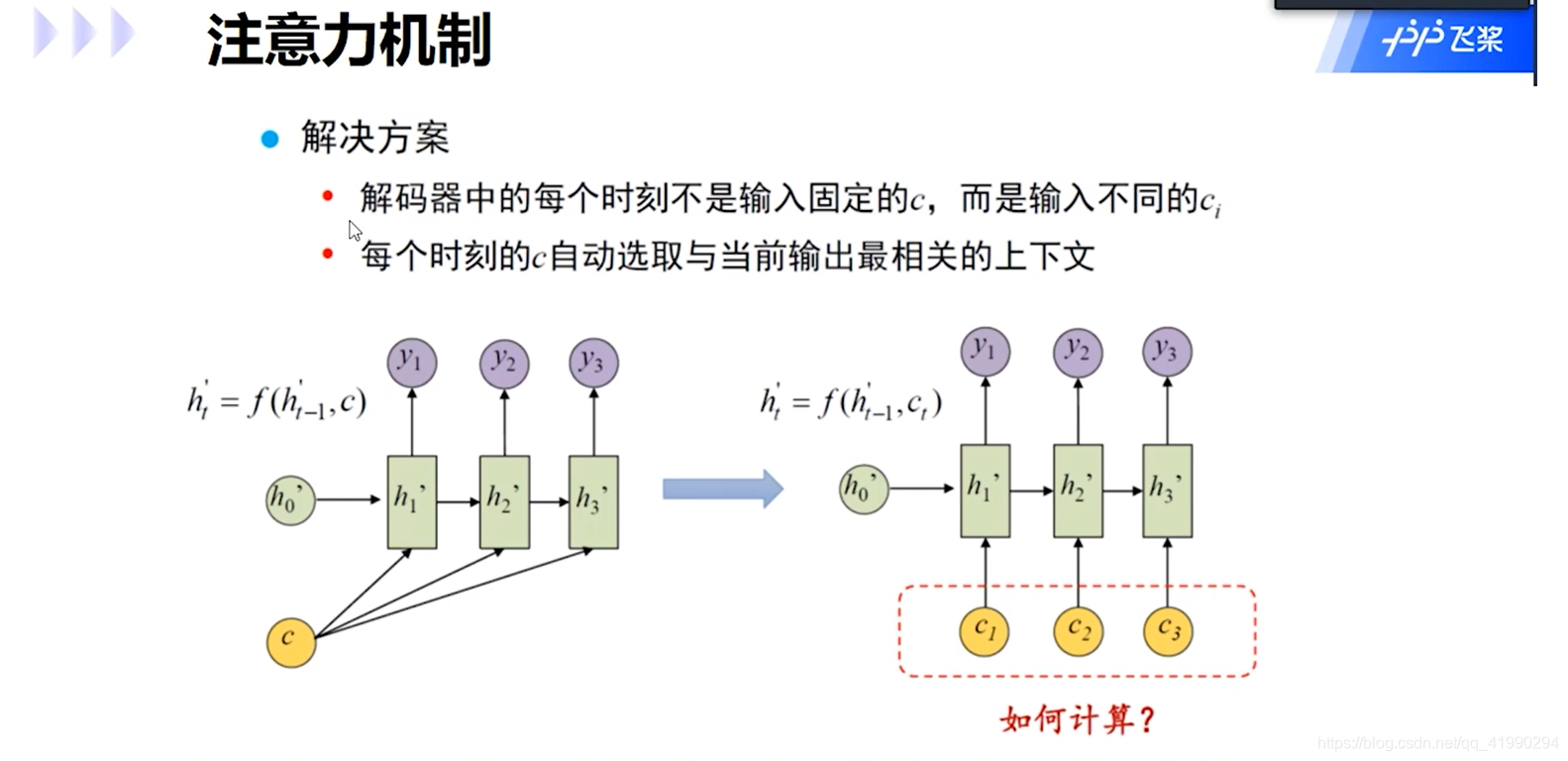

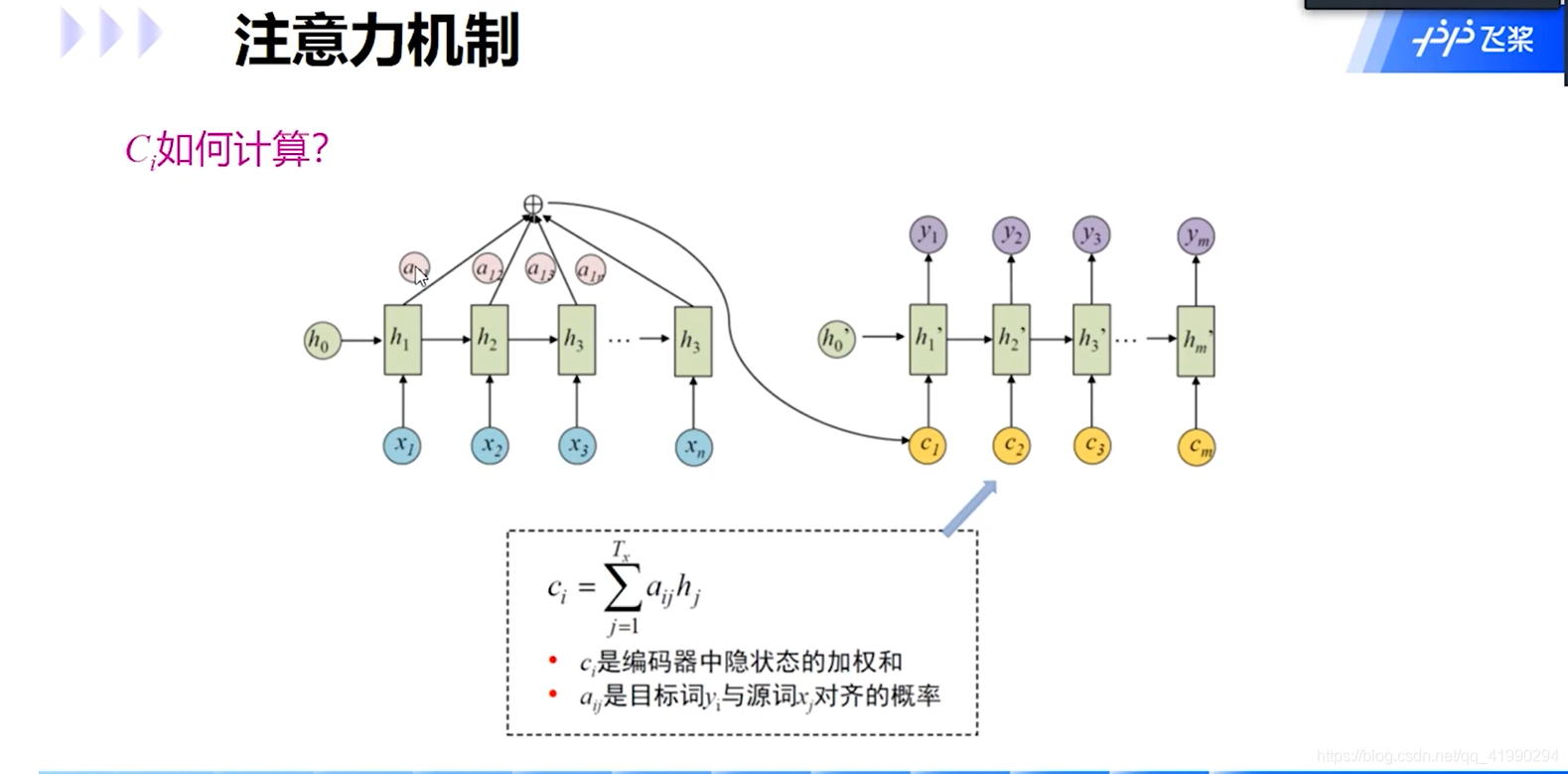

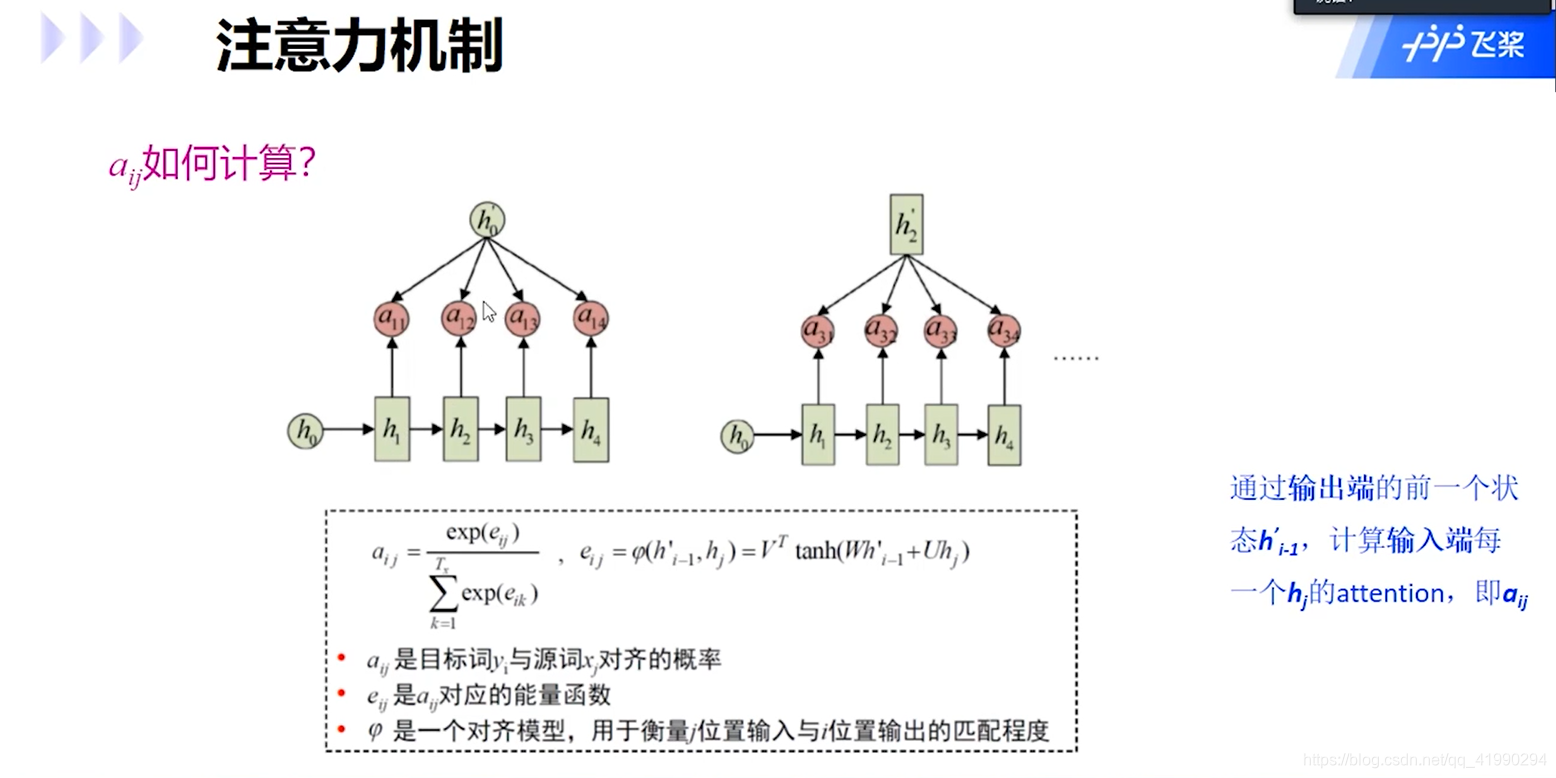

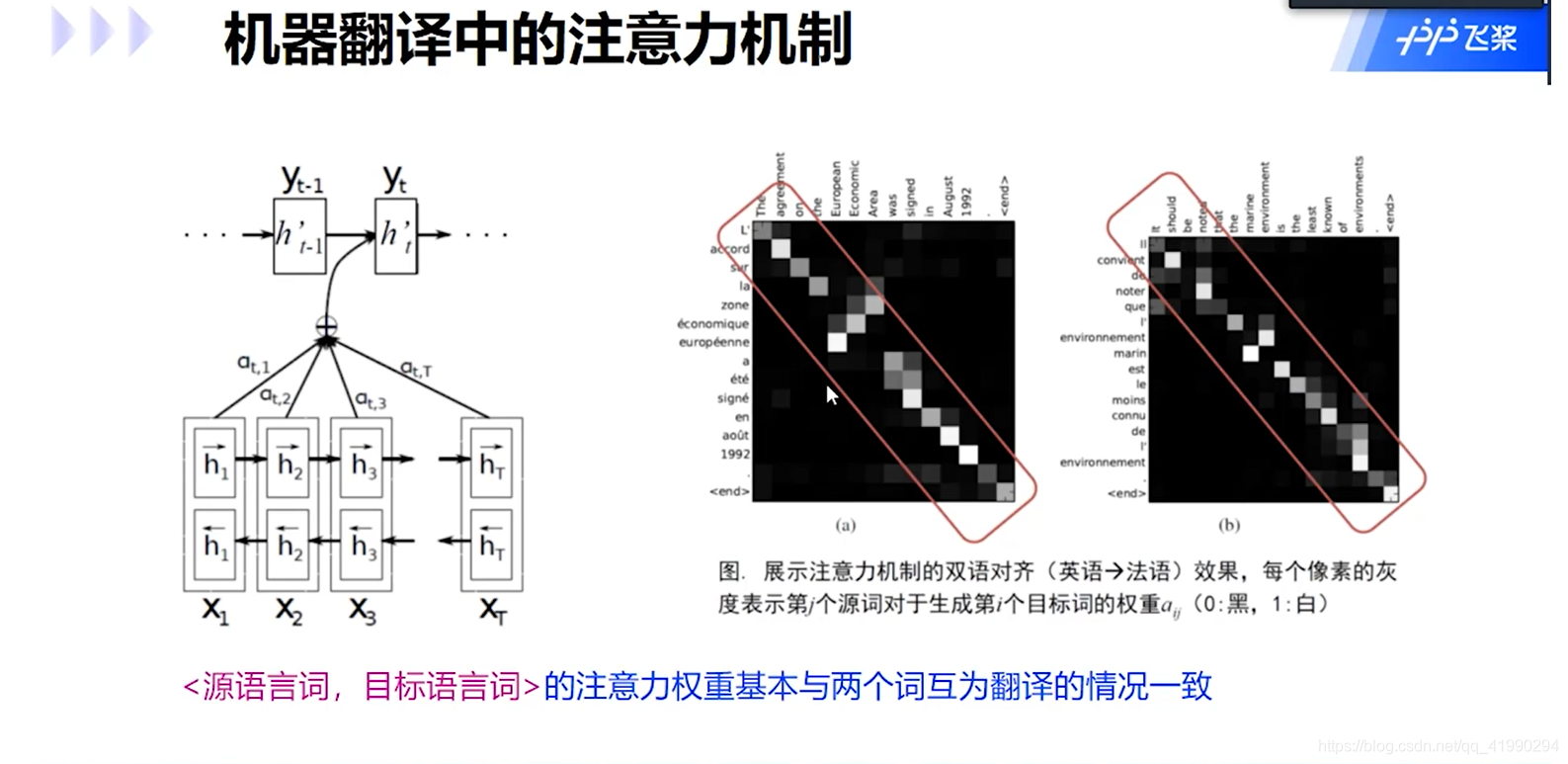

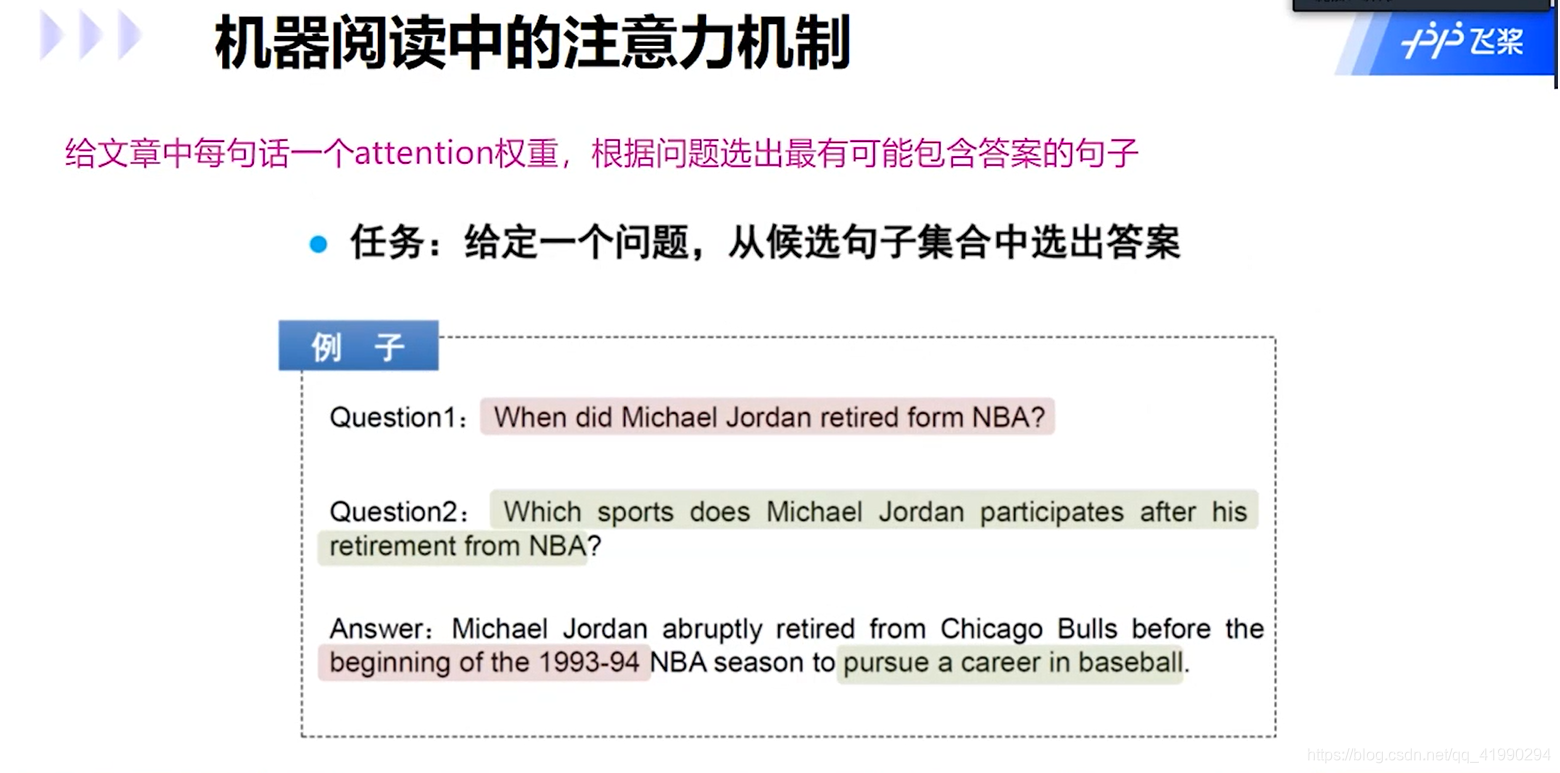

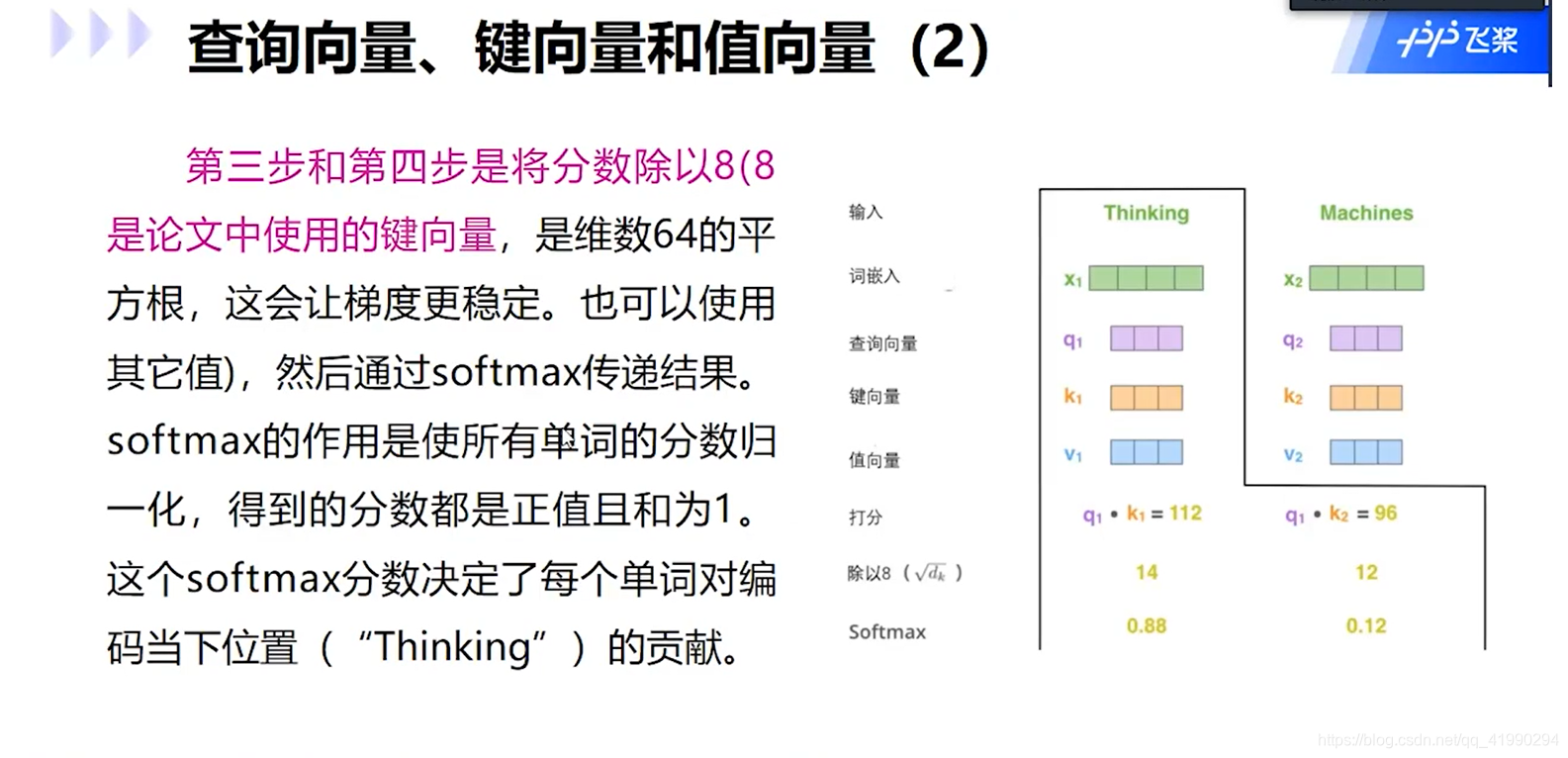

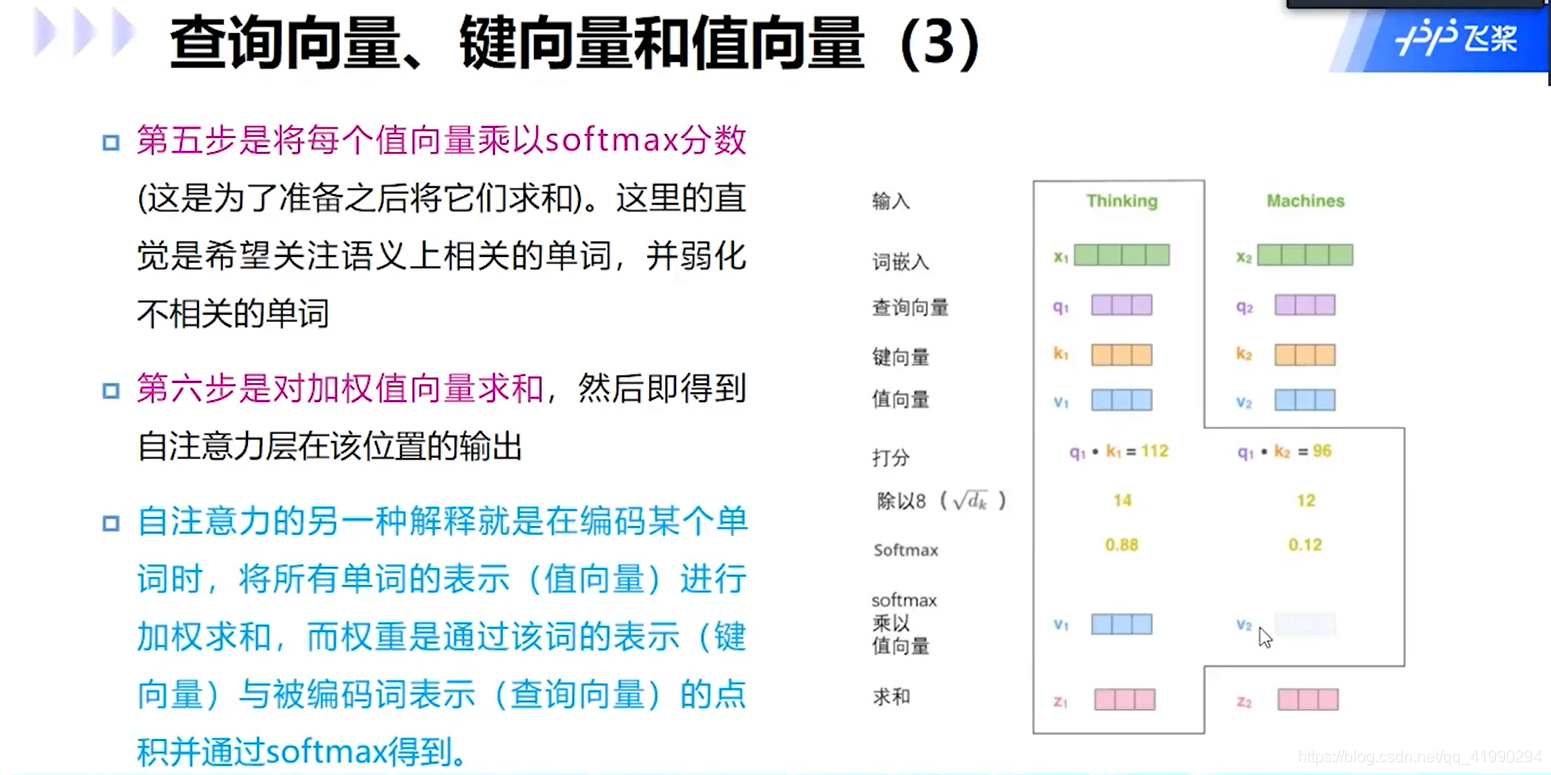

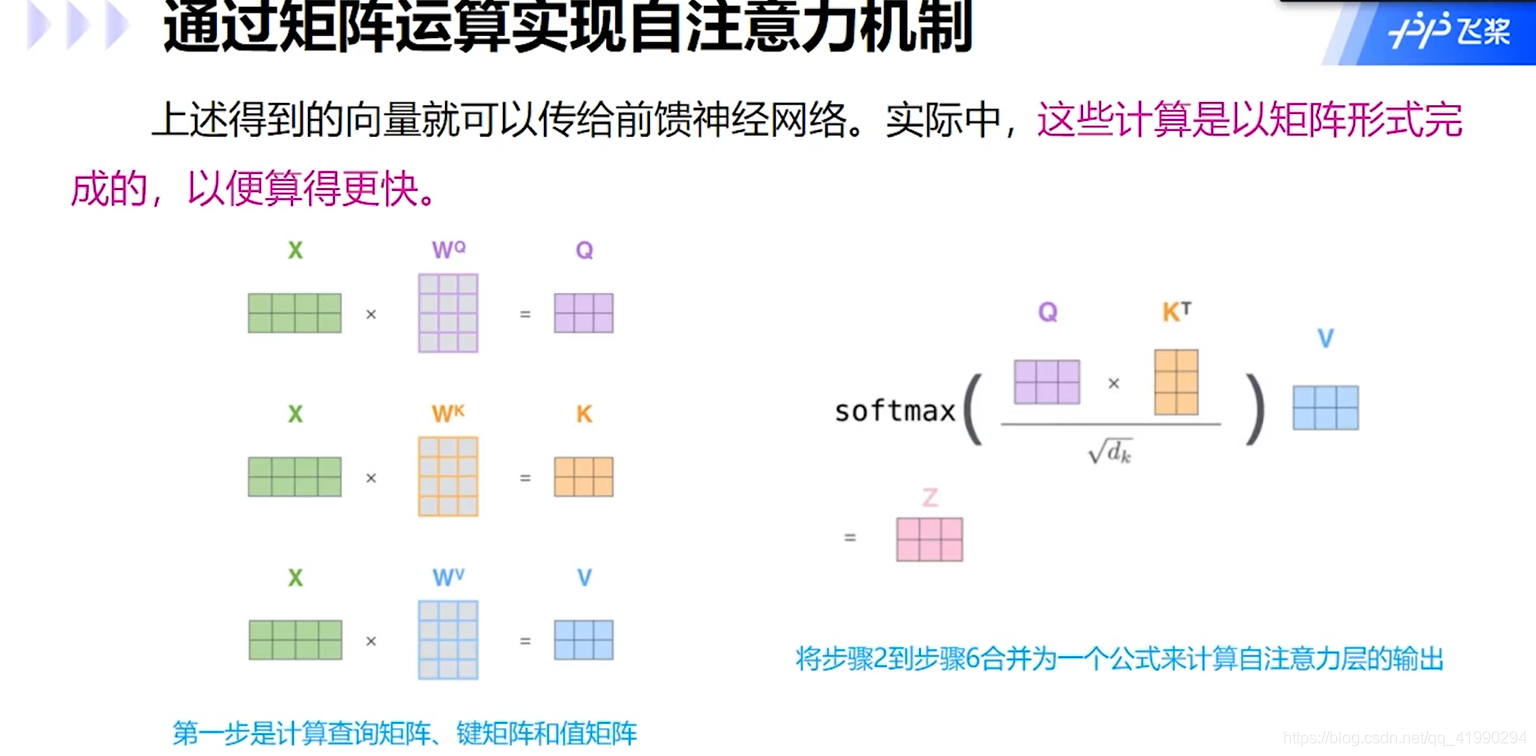

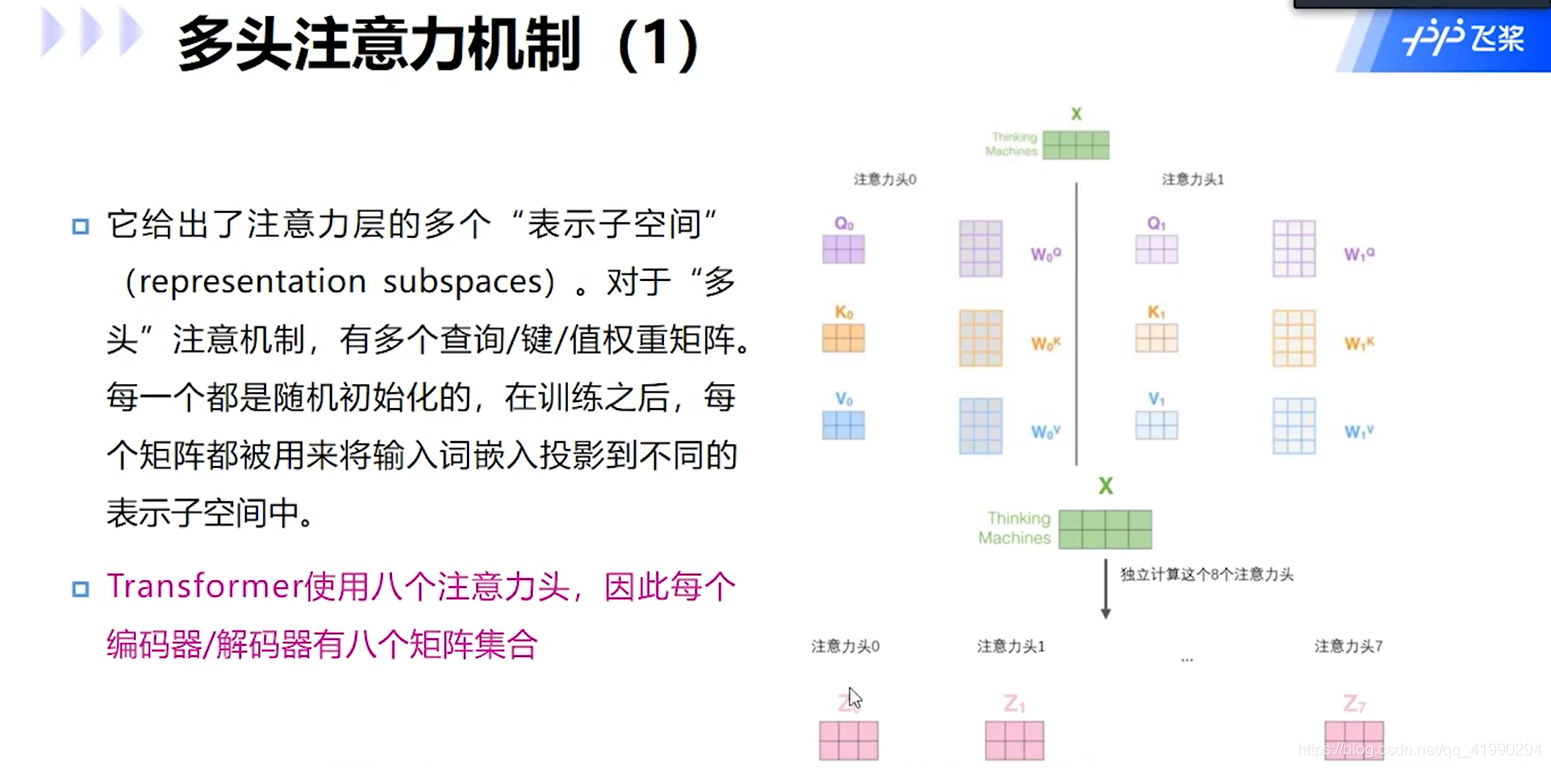

注意力机制

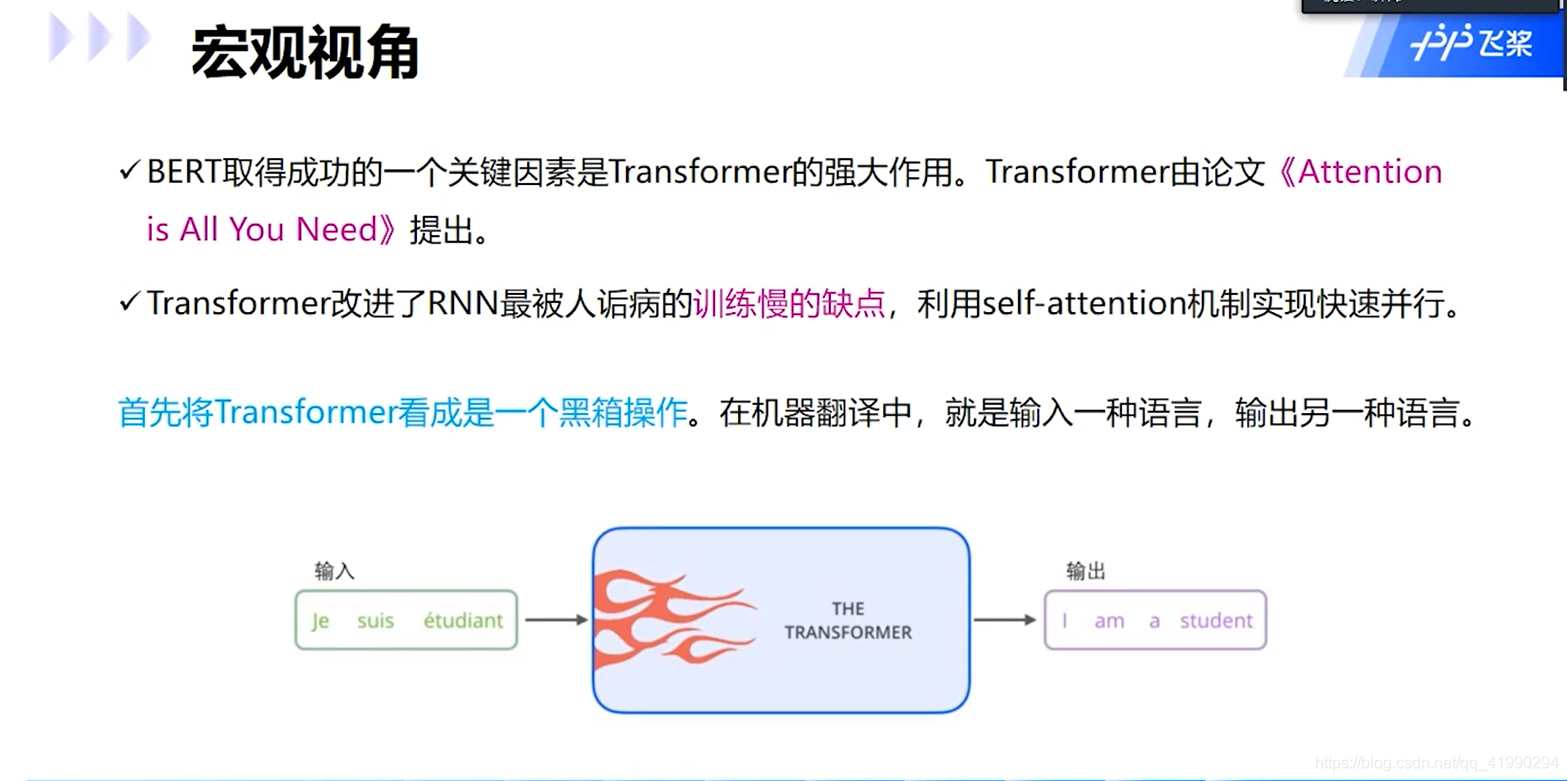

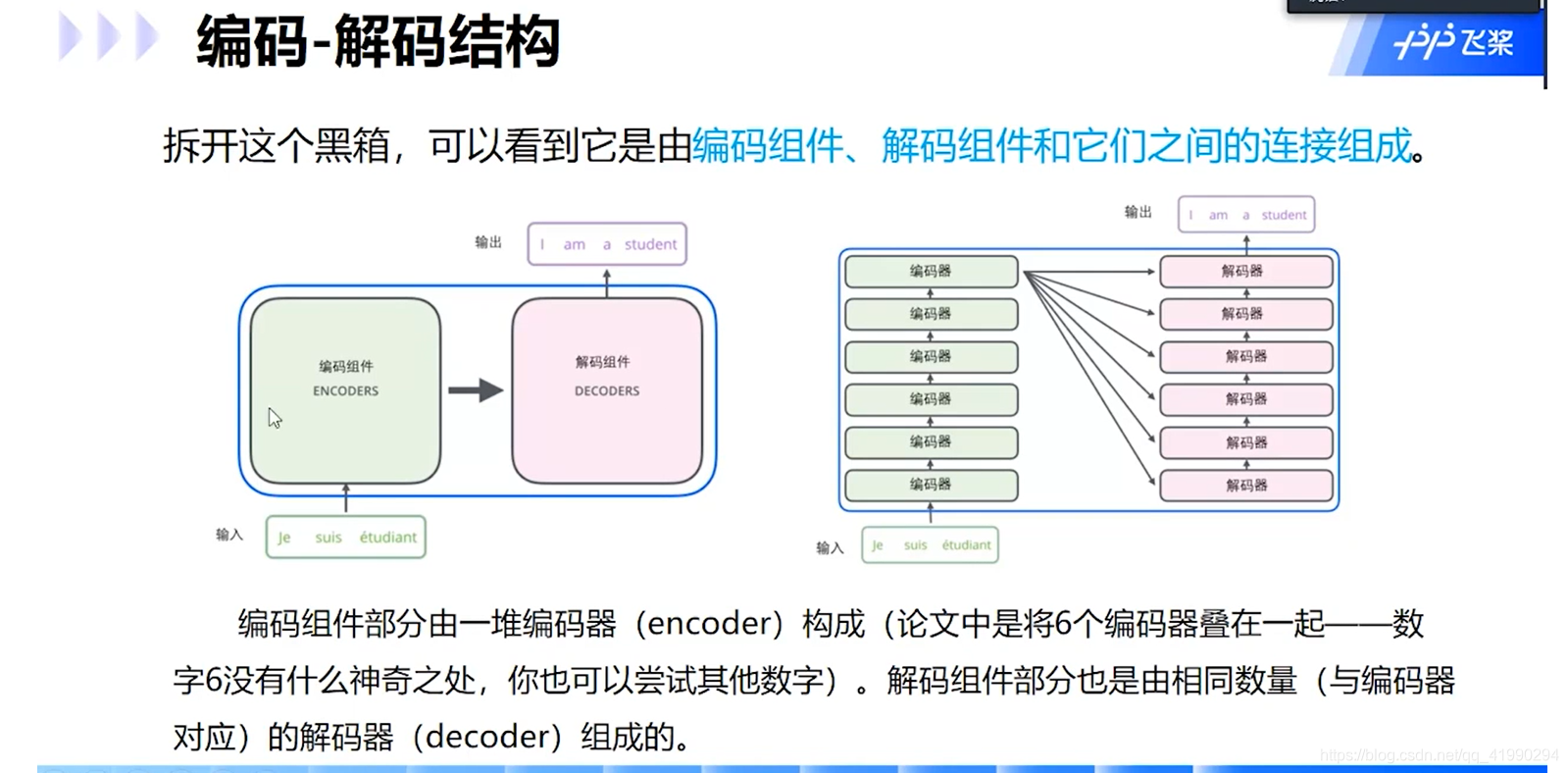

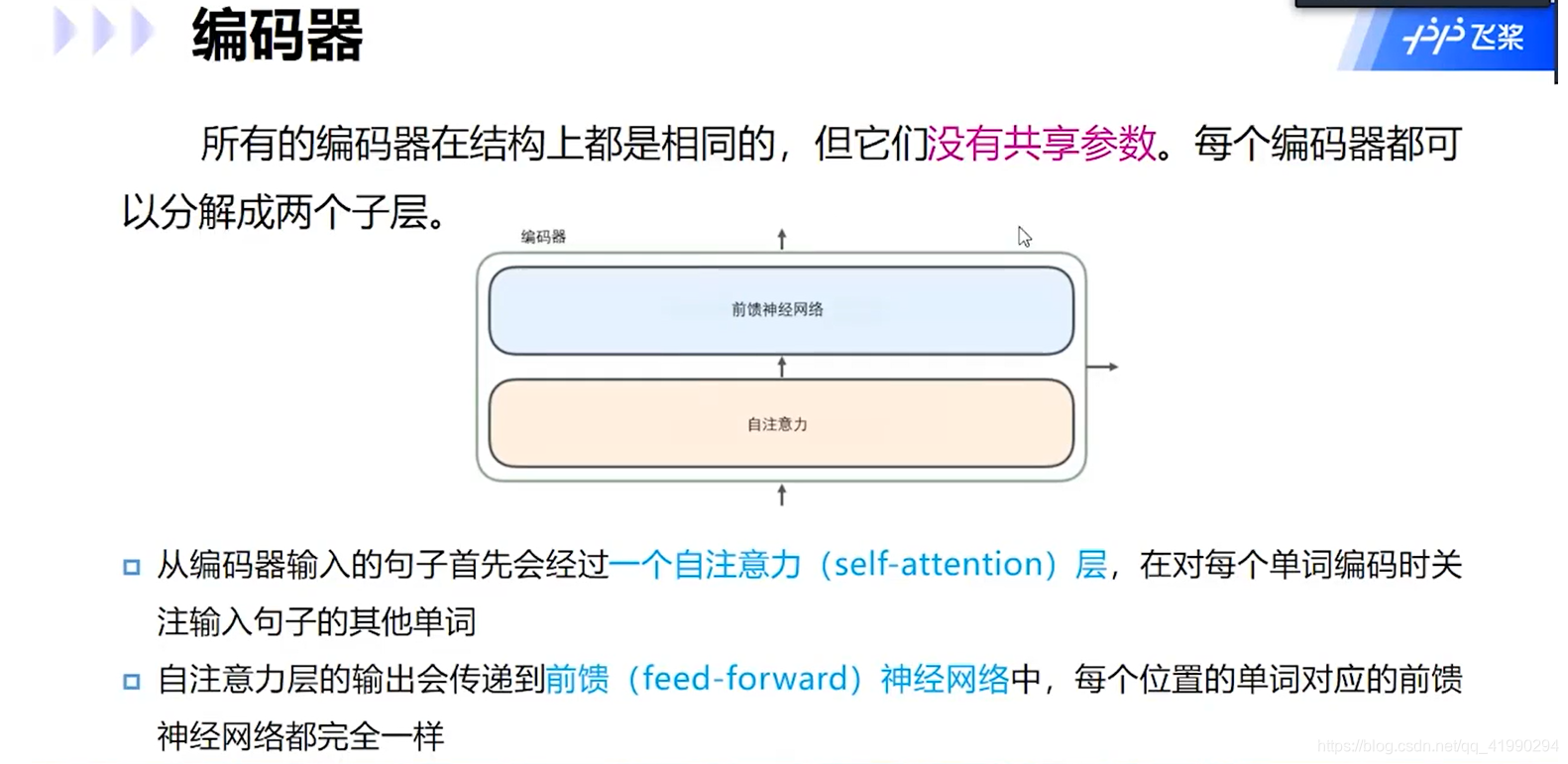

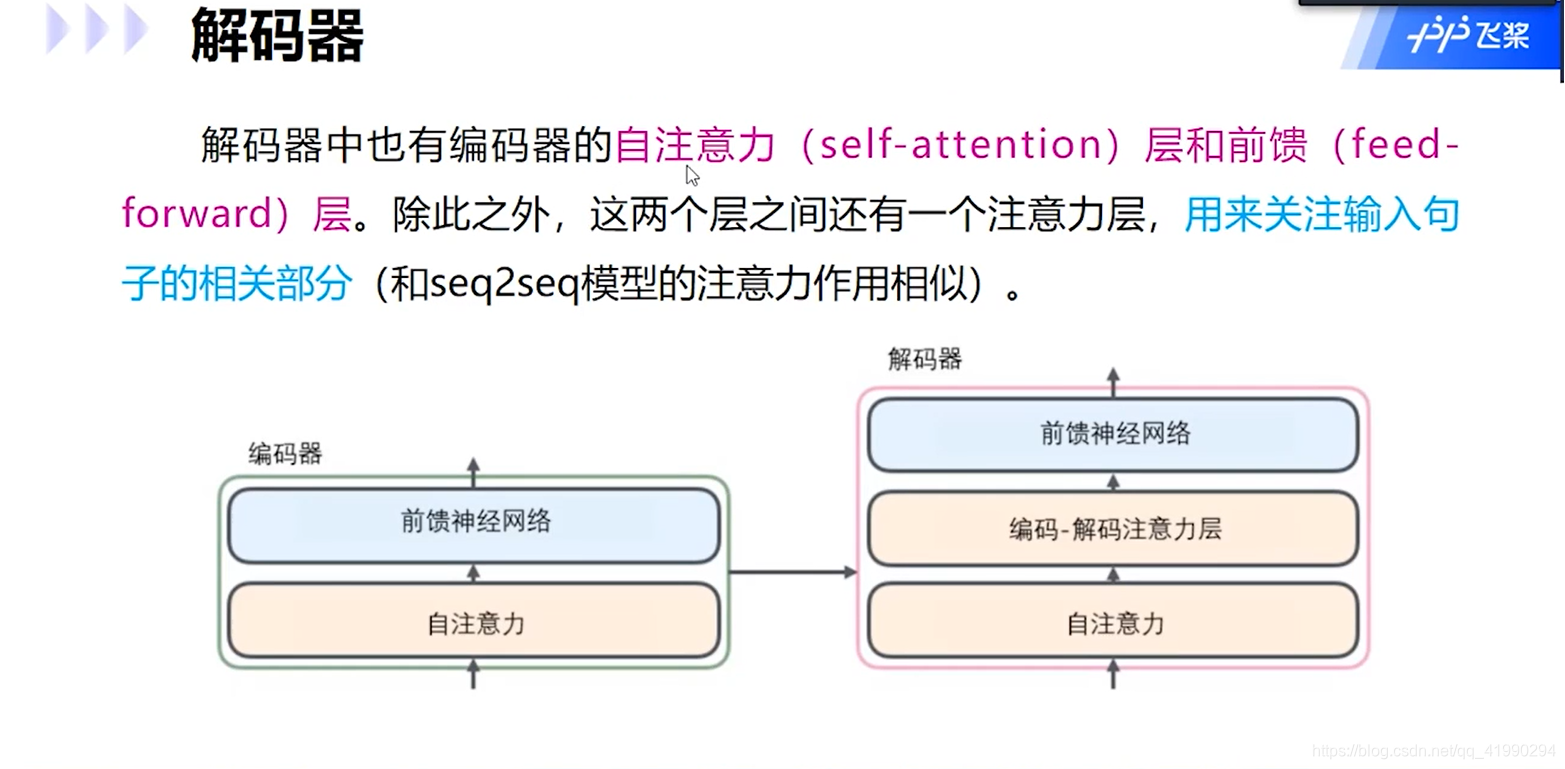

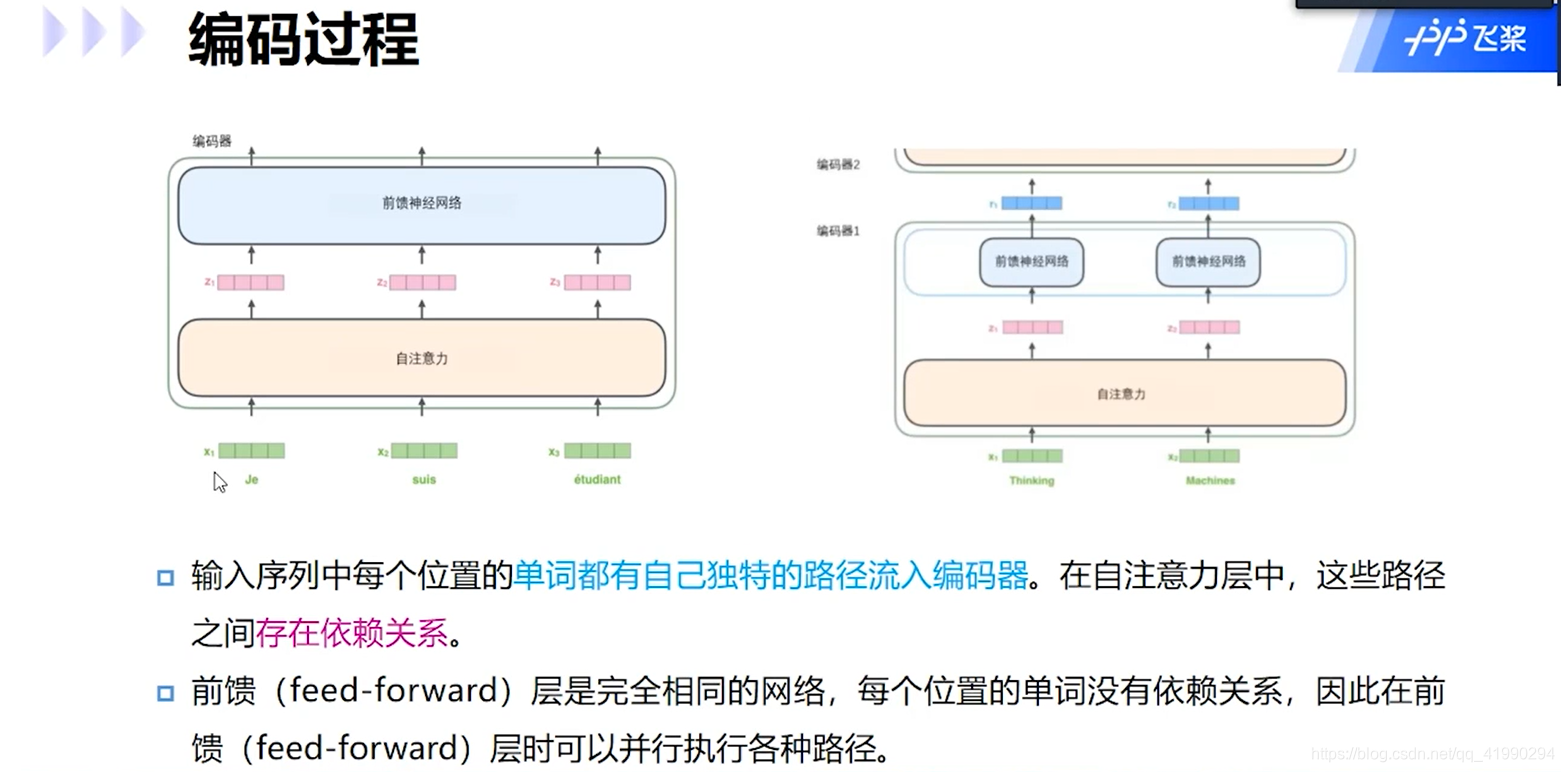

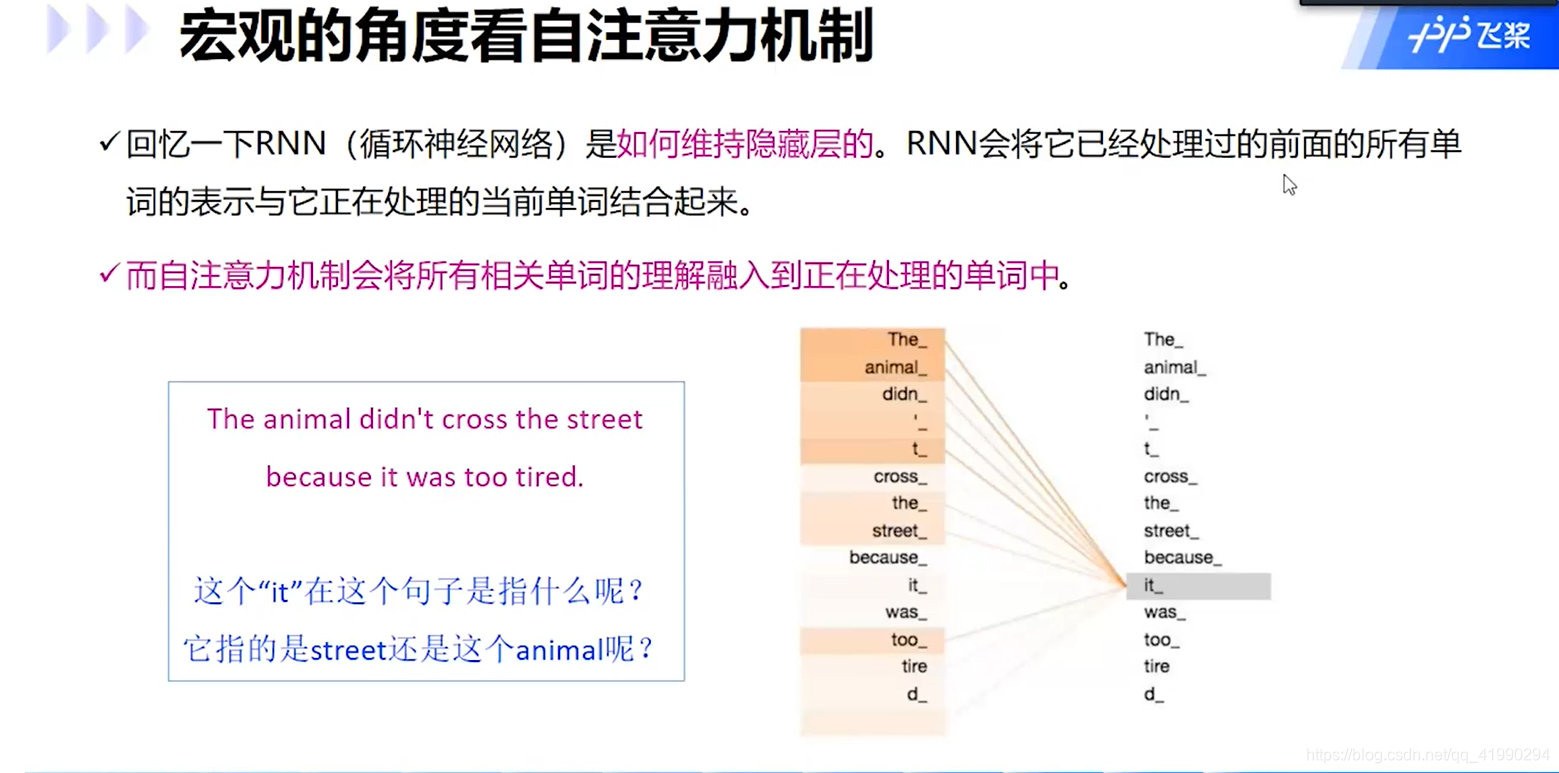

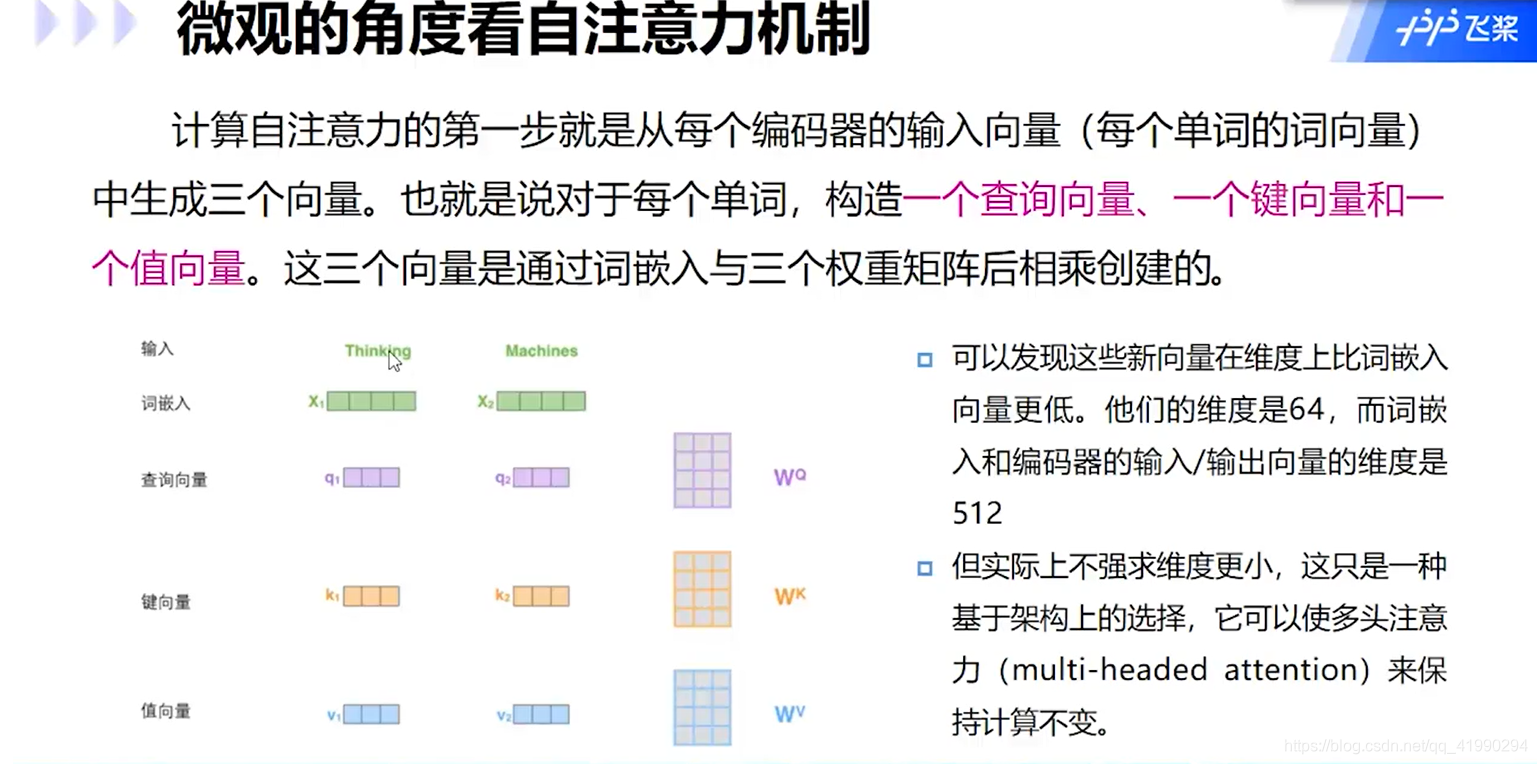

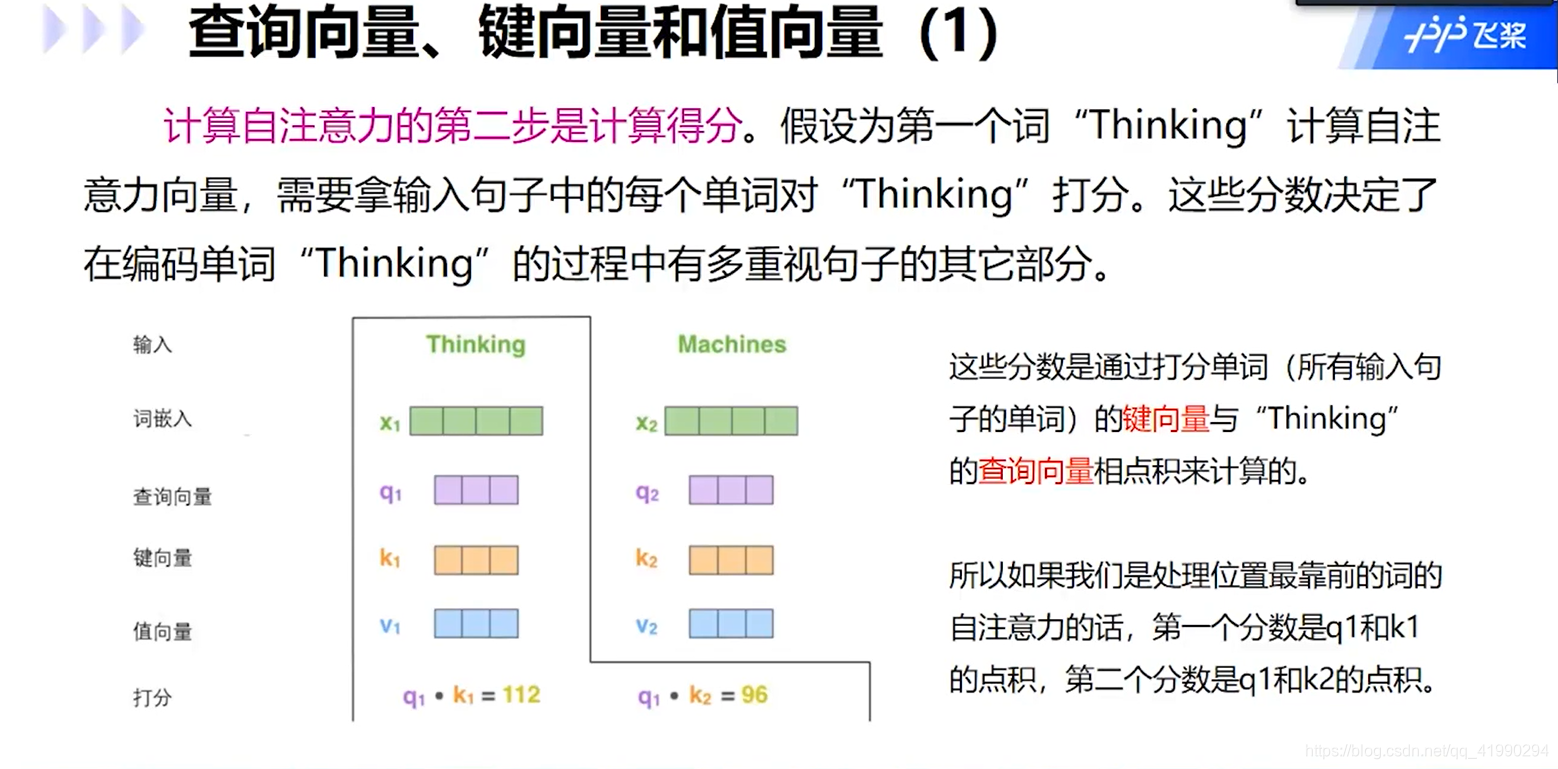

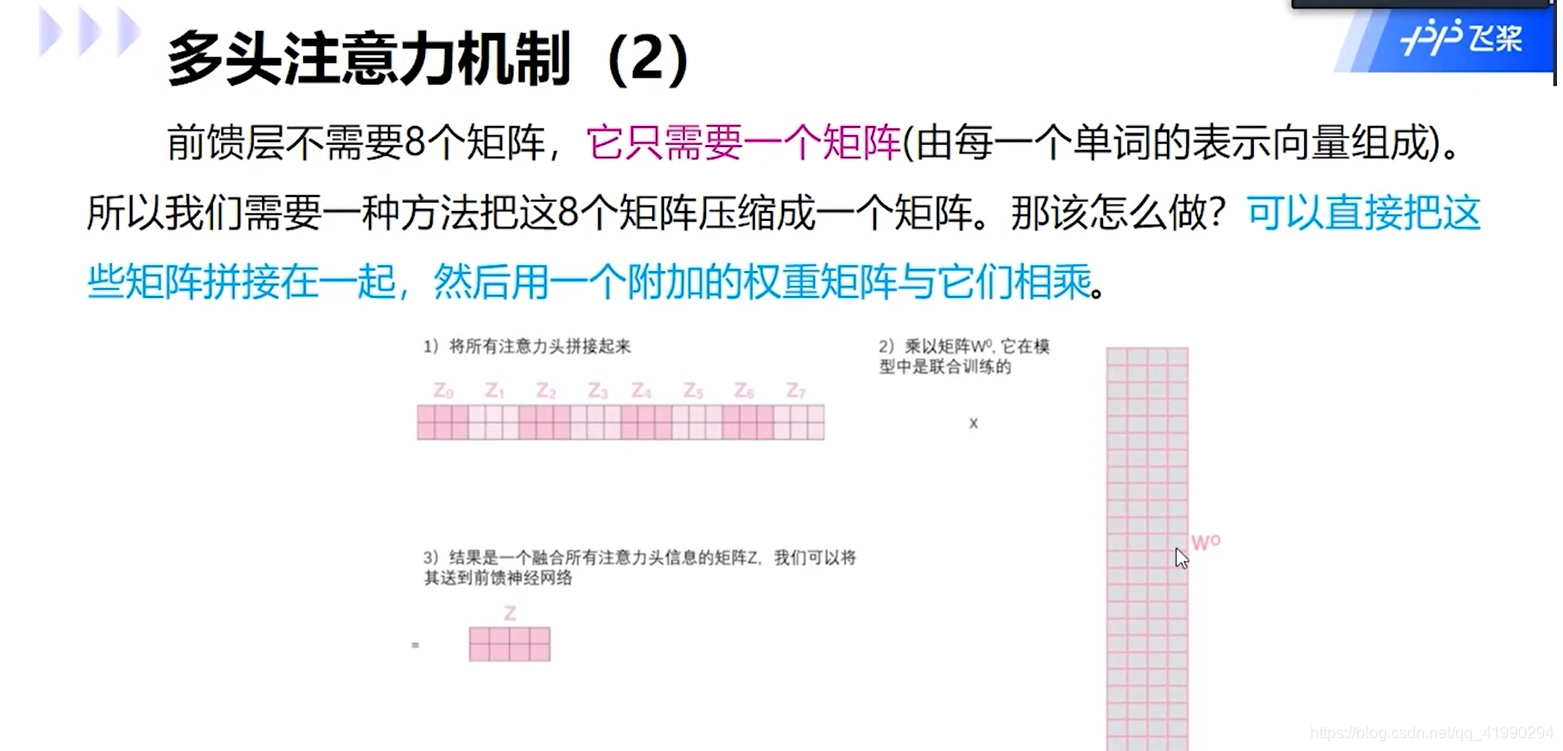

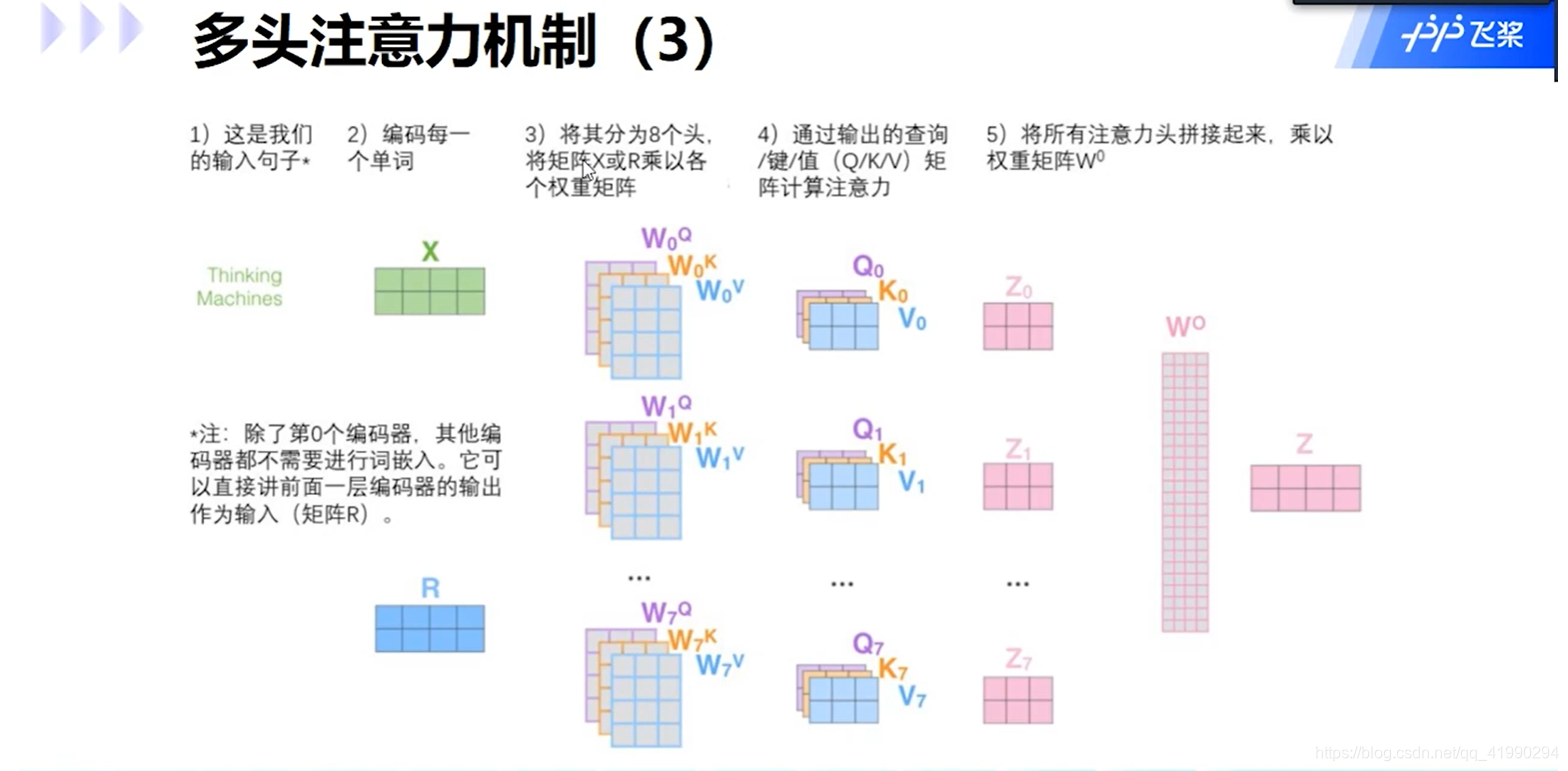

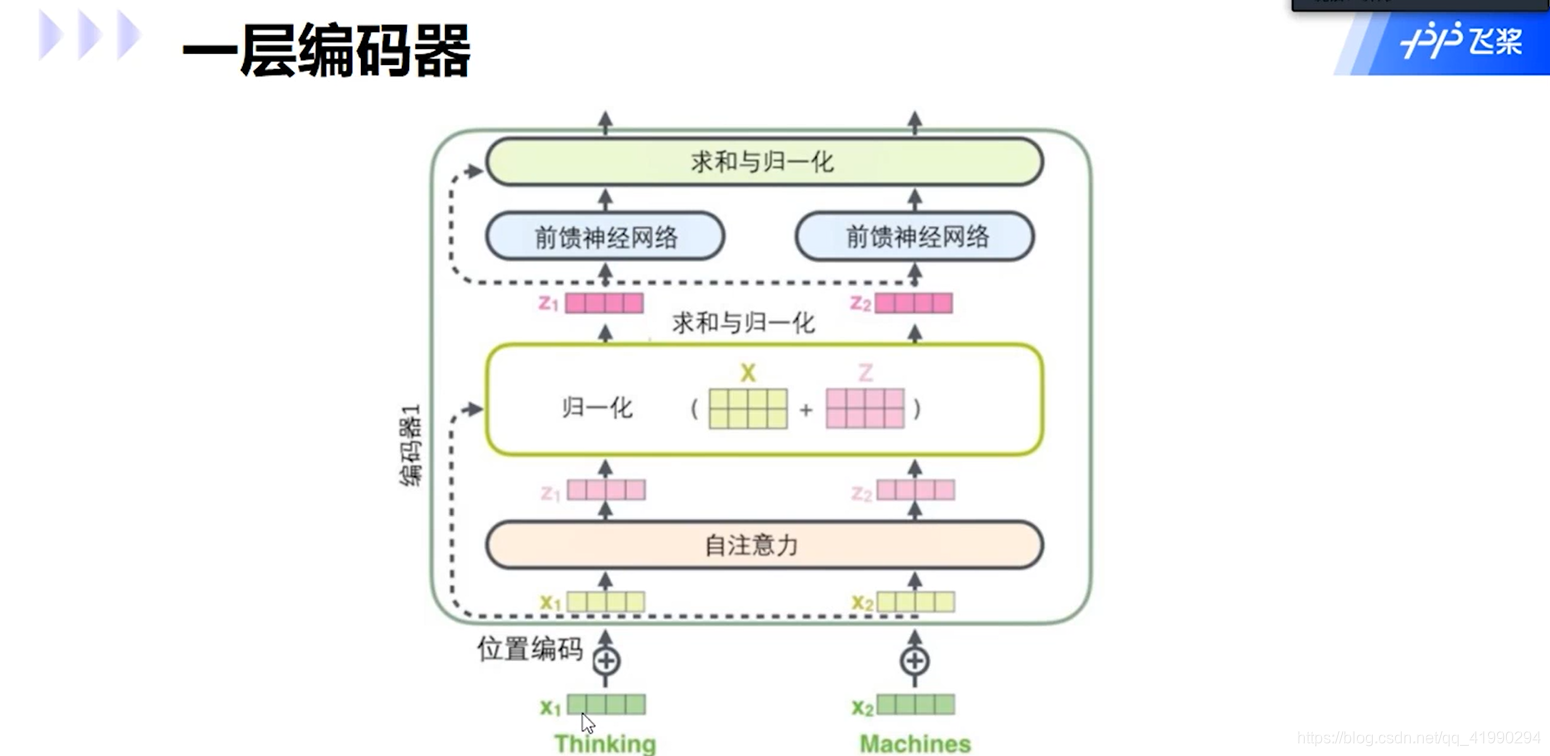

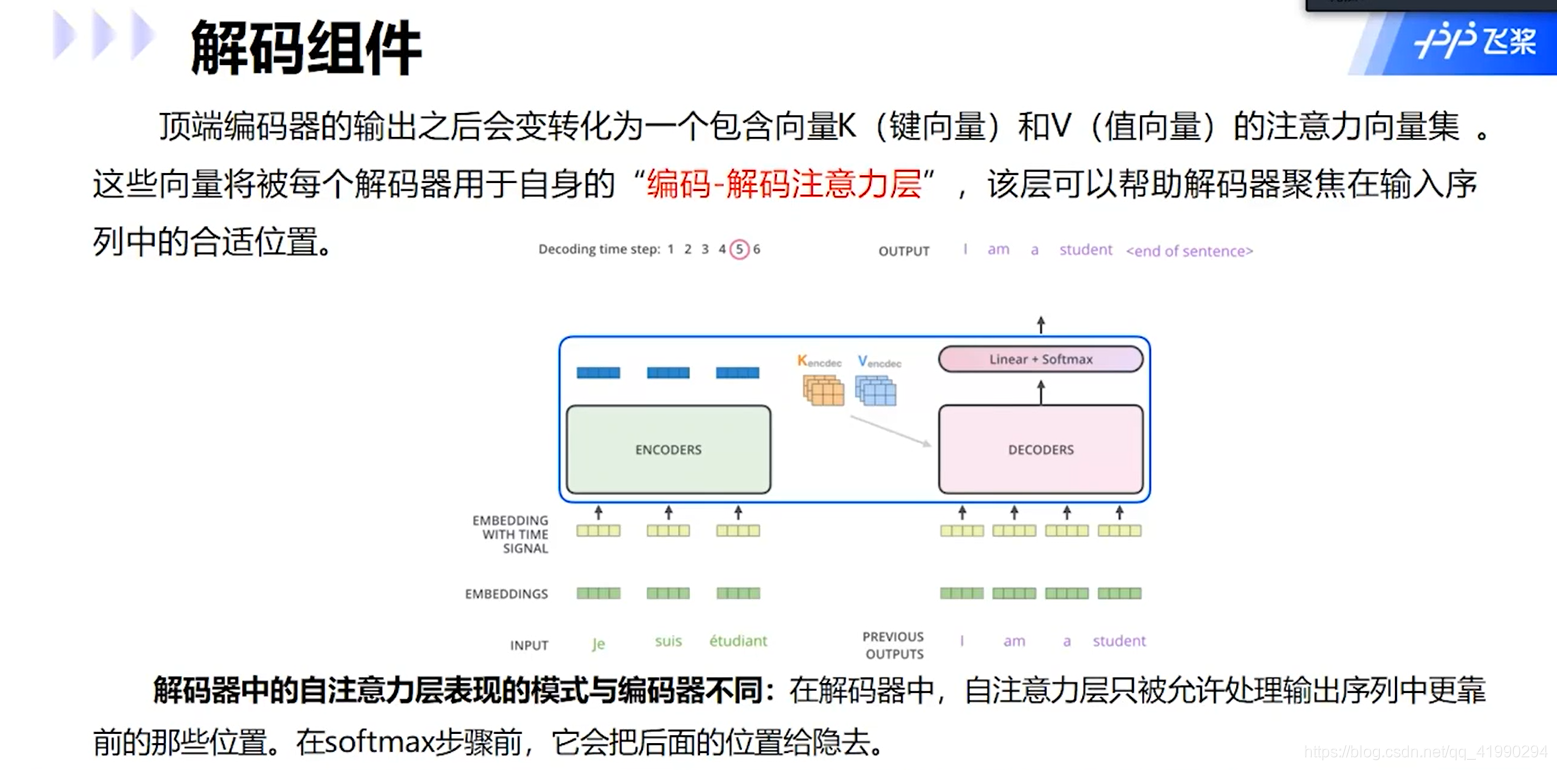

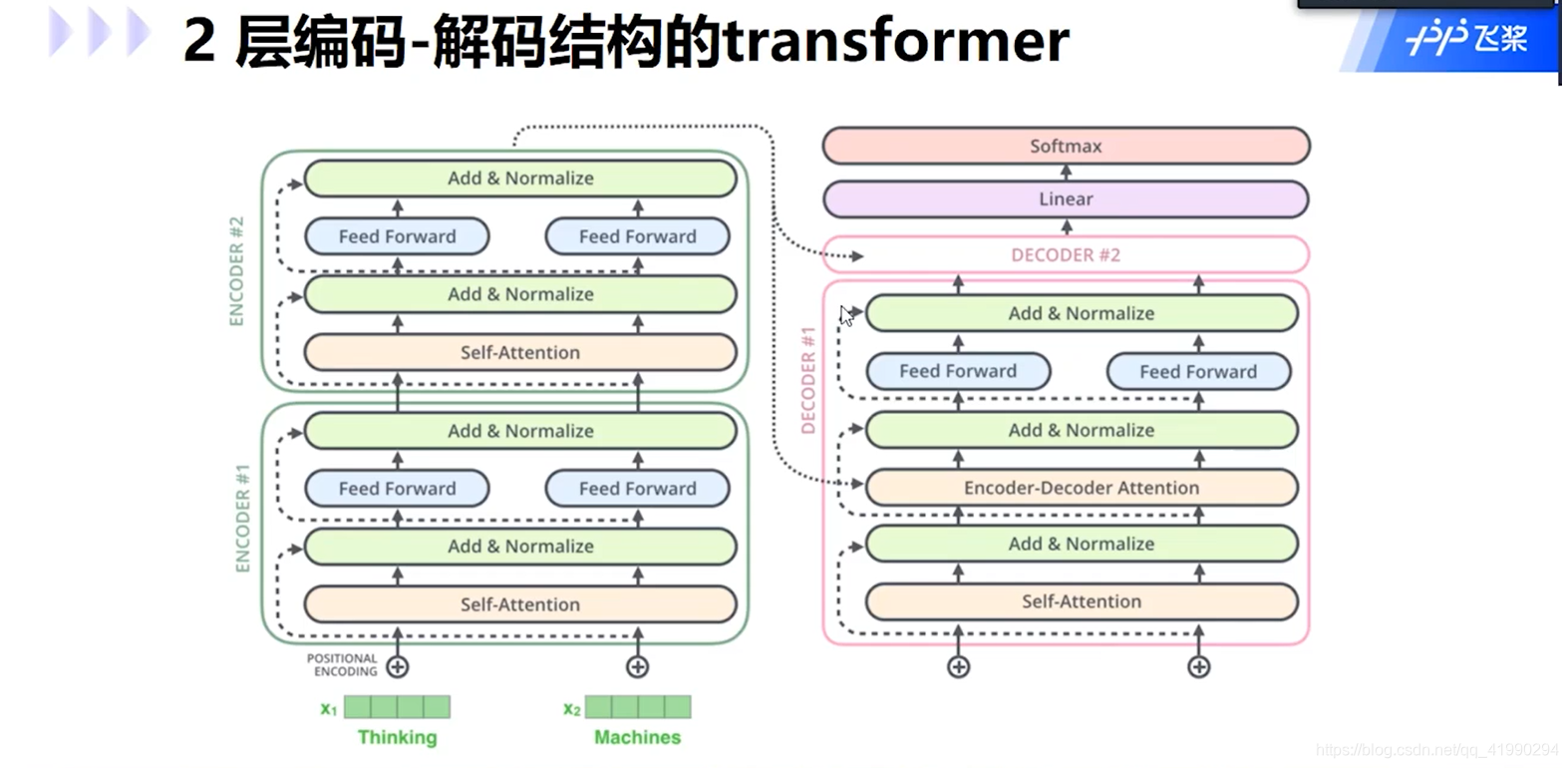

Transformer

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)