认识RNN-循环神经网络

摘要 循环神经网络(RNN)是一种专门处理序列数据的神经网络,通过引入时间维度和记忆机制捕捉序列元素间的依赖关系。其核心结构包括隐藏状态传递和展开计算,使用BPTT算法进行训练,但面临梯度消失/爆炸问题。改进方案包括双向RNN、深度RNN及门控结构(LSTM/GRU)。RNN广泛应用于自然语言处理、时间序列分析等领域,但存在长期依赖、计算效率等挑战。示例代码展示了PyTorch实现简单RNN进行时

一、RNN的基本概念与核心思想

RNN(Recurrent Neural Network)是一种专门设计用于处理序列数据的神经网络。其核心思想是引入“时间”维度,使网络能够学习序列中元素之间的依赖关系。与传统前馈神经网络(如MLP)不同,RNN中的神经元不仅接收当前输入,还会保留并传递之前的计算状态,从而形成一种“记忆”机制。

二、RNN的数学模型与结构

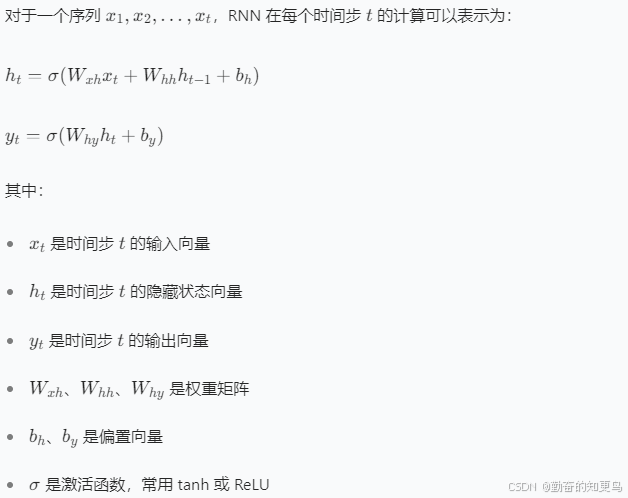

(一)数学表达式

(二)展开结构

RNN的循环结构可以在时间维度上展开,形成一个等效的前馈网络:

t=1 t=2 t=3 t=T

x1 ──→ [h1] ──→ [h2] ──→ [h3] ──→ ... ──→ [hT]

│ │ │ │

↓ ↓ ↓ ↓

y1 y2 y3 yT

这种展开结构清晰地展示了RNN如何通过隐藏状态在不同时间步之间传递信息。

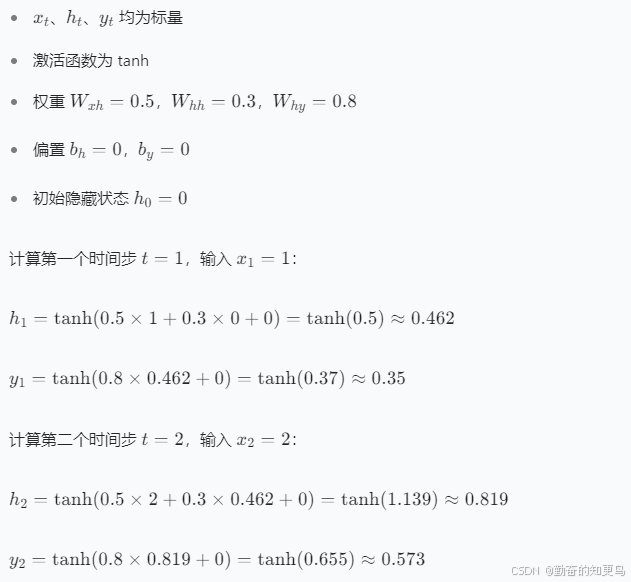

(三)简化计算示例

以一个简单的一维输入和隐藏状态为例,假设:

三、RNN的训练与优化

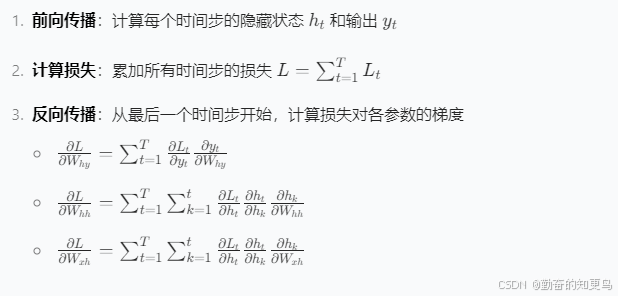

(一)BPTT算法(Backpropagation Through Time)

RNN的训练主要通过BPTT算法实现,其核心思想是将RNN在时间维度上展开后,应用标准的反向传播算法。具体步骤如下:

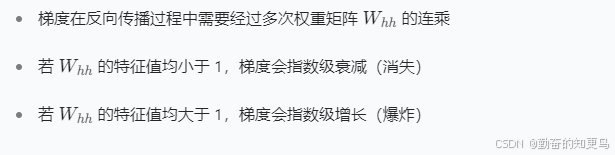

(二)梯度消失与梯度爆炸问题

BPTT在处理长序列时存在严重的梯度消失/爆炸问题,主要原因是:

四、RNN的变体与改进

(一)双向RNN(Bidirectional RNN)

双向RNN同时考虑序列的前后文信息,通过两个独立的RNN分别从前往后和从后往前处理序列:

正向:x1 → x2 → x3 → ... → xT

↓ ↓ ↓ ↓

输出:[h1] [h2] [h3] ... [hT]

反向:xT ← xT-1 ← xT-2 ← ... ← x1

↑ ↑ ↑ ↑

输出:[h'T] [h'T-1] [h'T-2] ... [h'1]

最终输出结合两个方向的隐藏状态:

[

h_t = [h_t; h’_t]

]

(二)深度RNN(Deep RNN)

深度RNN在每个时间步使用多层神经网络,增加模型的表达能力:

输入层:x_t

↓

隐藏层1:h_t^1 = f(W_1[h_{t-1}^1; x_t] + b_1)

↓

隐藏层2:h_t^2 = f(W_2[h_{t-1}^2; h_t^1] + b_2)

↓

...

↓

隐藏层L:h_t^L = f(W_L[h_{t-1}^L; h_t^{L-1}] + b_L)

↓

输出层:y_t

(三)LSTM与GRU

为解决梯度消失问题,LSTM(长短期记忆网络)和GRU(门控循环单元)引入了门控机制:

- LSTM:通过遗忘门、输入门和输出门控制信息流动

- GRU:简化LSTM结构,使用更新门和重置门

五、RNN的应用场景

(一)自然语言处理

- 语言模型:预测下一个词的概率

- 文本生成:如自动摘要、对话系统

- 机器翻译:将一种语言翻译成另一种语言

- 情感分析:判断文本的情感倾向

(二)时间序列分析

- 股票价格预测:根据历史价格预测未来走势

- 天气预测:分析气象数据预测天气变化

- 电力负荷预测:预测电网负荷需求

(三)其他领域

- 语音识别:将语音信号转换为文本

- 视频分析:理解视频内容,如动作识别

- 音乐生成:自动创作音乐旋律

六、RNN的局限性与挑战

(一)长期依赖问题

RNN难以捕捉序列中远距离的依赖关系,主要原因是梯度消失/爆炸问题导致模型无法学习长期依赖。

(二)计算效率问题

RNN的顺序计算特性使其难以并行化处理,在处理长序列时效率较低。

(三)内存瓶颈

RNN在每个时间步都需要保存完整的隐藏状态,处理超长序列时会导致内存占用过大。

七、RNN的实现示例

下面是一个使用PyTorch实现简单RNN的示例代码:

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

import matplotlib.pyplot as plt

# 定义一个简单的RNN模型

class SimpleRNN(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(SimpleRNN, self).__init__()

self.hidden_size = hidden_size

# RNN层:输入到隐藏,隐藏到隐藏

self.rnn = nn.RNN(input_size, hidden_size, batch_first=True)

# 输出层:隐藏到输出

self.fc = nn.Linear(hidden_size, output_size)

def forward(self, x, h0=None):

# x形状: (batch_size, seq_len, input_size)

batch_size = x.size(0)

# 初始化隐藏状态

if h0 is None:

h0 = torch.zeros(1, batch_size, self.hidden_size).to(x.device)

# RNN前向传播

# out形状: (batch_size, seq_len, hidden_size)

# hn形状: (1, batch_size, hidden_size)

out, hn = self.rnn(x, h0)

# 取最后一个时间步的输出

out = self.fc(out[:, -1, :])

return out, hn

# 生成简单的时间序列数据用于演示

def generate_data(n_samples=1000, seq_len=20):

# 生成正弦波数据

t = np.linspace(0, 2*np.pi, seq_len)

X = np.zeros((n_samples, seq_len, 1))

y = np.zeros((n_samples, 1))

for i in range(n_samples):

# 随机相位和频率

phase = np.random.uniform(0, 2*np.pi)

freq = np.random.uniform(0.5, 2.0)

# 生成正弦波

X[i, :, 0] = np.sin(freq * t + phase)

# 预测下一个时间步的值

y[i, 0] = np.sin(freq * (t[-1] + 2*np.pi/seq_len) + phase)

return torch.FloatTensor(X), torch.FloatTensor(y)

# 训练模型

def train_model(model, X_train, y_train, epochs=100, lr=0.01):

criterion = nn.MSELoss()

optimizer = optim.Adam(model.parameters(), lr=lr)

losses = []

for epoch in range(epochs):

# 前向传播

outputs, _ = model(X_train)

loss = criterion(outputs, y_train)

# 反向传播和优化

optimizer.zero_grad()

loss.backward()

optimizer.step()

losses.append(loss.item())

if (epoch+1) % 10 == 0:

print(f'Epoch [{epoch+1}/{epochs}], Loss: {loss.item():.4f}')

return losses

# 主函数

def main():

# 设置随机种子

torch.manual_seed(42)

np.random.seed(42)

# 生成数据

X, y = generate_data(n_samples=1000, seq_len=20)

# 划分训练集和测试集

train_size = int(0.8 * len(X))

X_train, X_test = X[:train_size], X[train_size:]

y_train, y_test = y[:train_size], y[train_size:]

# 初始化模型

input_size = 1 # 输入特征维度

hidden_size = 32 # 隐藏层大小

output_size = 1 # 输出维度

model = SimpleRNN(input_size, hidden_size, output_size)

# 训练模型

losses = train_model(model, X_train, y_train, epochs=100)

# 测试模型

model.eval()

with torch.no_grad():

test_outputs, _ = model(X_test)

test_loss = nn.MSELoss()(test_outputs, y_test)

print(f'Test Loss: {test_loss.item():.4f}')

# 可视化训练损失

plt.figure(figsize=(10, 6))

plt.plot(losses)

plt.title('Training Loss')

plt.xlabel('Epoch')

plt.ylabel('Loss')

plt.grid(True)

plt.show()

# 可视化预测结果

plt.figure(figsize=(10, 6))

plt.scatter(y_test.numpy(), test_outputs.numpy())

plt.plot([-1, 1], [-1, 1], 'r--')

plt.title('Prediction vs Actual')

plt.xlabel('Actual')

plt.ylabel('Prediction')

plt.grid(True)

plt.show()

if __name__ == '__main__':

main()

这个示例代码实现了一个简单的RNN模型,用于预测正弦波的下一个时间步值。代码包括:

- 模型定义:使用PyTorch的nn.RNN实现基本RNN结构

- 数据生成:生成带有随机相位和频率的正弦波数据

- 训练过程:使用MSE损失函数和Adam优化器

- 结果可视化:展示训练损失曲线和预测结果

八、总结

RNN作为处理序列数据的基础模型,虽然存在长期依赖和计算效率等问题,但它为后续更先进的序列模型(如LSTM、GRU、Transformer)奠定了基础。理解RNN的基本原理对于掌握深度学习在序列数据处理中的应用至关重要。在实际应用中,通常会选择LSTM或GRU等改进模型来解决长序列问题。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)