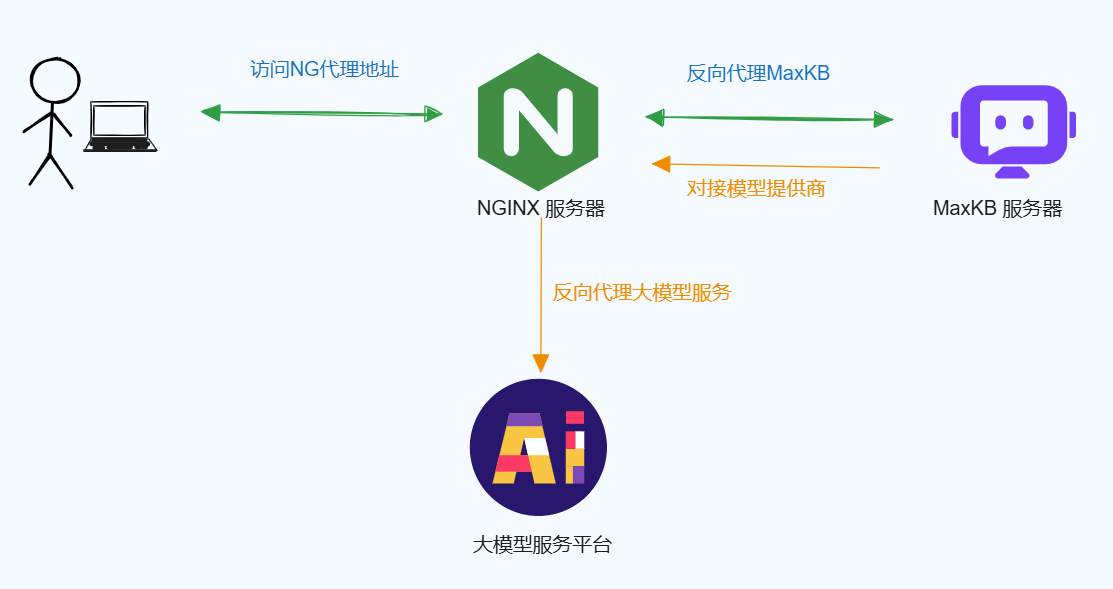

NGINX反向代理大模型和AI智能体

如果你反向代理之后,模型/智能体没有流式输出(打字机效果),请参考如下NGINX配置文件写法。OpenAI 等其他平台亦如此。

·

场景:

- 内部部署了智能体工具(如MaxKB、Dify),需要用NGINX反向代理一层

- 内部智能体网络无法直连外部MaaS(Model as a Service,模型即服务)平台

1.NGINX反向代理智能体

如果你反向代理之后,模型/智能体没有流式输出(打字机效果),请参考如下NGINX配置文件写法

server {

listen 80;

listen [::]:80;

server_name localhost;

location / {

# 重定向到目标服务器

proxy_pass http://192.168.11.13:8080;

# 开启流式传输并禁用缓存

proxy_buffering off; # 禁用代理缓冲

proxy_cache off; # 禁用缓存

proxy_set_header Host $host; # 传递原始 Host 头部

proxy_set_header X-Real-IP $remote_addr; # 传递真实客户端 IP

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for; # 传递转发的 IP

proxy_set_header X-Forwarded-Proto $scheme; # 传递协议信息

}

}

或

server {

listen 443;

server_name ai.abc.com; # 访问域名

ssl_certificate /path/to/abc.crt; # 证书文件路径

ssl_certificate_key /path/to/abc.key; # 私钥文件路径

location / {

# 重定向到目标服务器

proxy_pass http://192.168.11.13:8080;

# 开启流式传输并禁用缓存

proxy_buffering off; # 禁用代理缓冲

proxy_cache off; # 禁用缓存

proxy_set_header Host $host; # 传递原始 Host 头部

proxy_set_header X-Real-IP $remote_addr; # 传递真实客户端 IP

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for; # 传递转发的 IP

proxy_set_header X-Forwarded-Proto $scheme; # 传递协议信息

}

}

2.NGINX反向代理大模型

以阿里百炼为例。OpenAI 等其他平台亦如此

server

{

listen 80;

server_name 192.168.11.12; # 你自己的域名,需要解析到这台服务,没有域名这里写服务器ip

location / {

proxy_pass https://dashscope.aliyuncs.com/; # 反向代理https://dashscope.aliyuncs.com/这个地址

proxy_ssl_server_name on;

proxy_set_header Host dashscope.aliyuncs.com; # Host字段为dashscope.aliyuncs.com

chunked_transfer_encoding off;

proxy_buffering off;

proxy_cache off;

}

}

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)