「源力觉醒 创作者计划」_OpenWebUI + 文心大模型:企业零代码建 AI

本文探讨了如何利用Open WebUI与文心大模型构建低门槛、低成本的企业AI解决方案。Open WebUI提供零代码交互门户,支持多模型管理和本地知识库集成,5分钟即可完成部署;文心大模型则提供轻量化AI引擎,如3亿参数的ERNIE-4.5-0.3B量化版仅需2.1GB显存。两者结合可应用于制造业质检、金融文档处理和教育辅助等场景,通过量化技术和知识增强实现90%的部署成本降低,同时保持高性能。

文章目录

背景

在当今快速发展的数字化时代,人工智能已成为企业提升生产力、实现业务创新的核心驱动力。然而,高昂的开发成本、复杂的技术栈以及对专业AI人才的依赖,常常让许多企业望而却步。本文将深入探讨如何利用 Open WebUI 作为直观的交互入口,结合 文心大模型 的强大智能引擎,以极低的成本实现企业业务场景的智能化闭环,真正做到“无需一行代码,企业也能构建专属AI生产力”。

一、技术组合解析:Open WebUI + 文心大模型的“黄金搭档”

要理解如何在企业中实现AI普惠,首先需要剖析其背后的核心技术组件。Open WebUI 和文心大模型堪称一对“黄金搭档”,它们各自发挥优势,共同构建了一个高效、易用的AI应用生态。

1. Open WebUI:赋能业务人员的零代码交互门户

Open WebUI 不仅仅是一个简单的界面,它是一个专为大模型交互设计的本地化、类ChatGPT的用户界面,旨在降低AI应用的门槛,让非技术人员也能轻松驾驭AI。

- 核心定位:将复杂的AI模型操作转化为直观的对话式体验。它支持多模型管理、文档检索以及精细的权限控制,并且部署过程极为便捷,通常在5分钟内即可完成。

- 关键能力:

- 一键对接能力:能够无缝对接文心大模型API,实时生成文本、表格乃至图表,极大地简化了内容创作和数据分析的流程。

- 企业级安全与管理:提供强大的RBAC(基于角色的访问控制)权限管理功能,确保不同用户拥有合适的访问权限;同时支持对话记录加密存储,满足企业对数据隐私和合规性的严苛要求。

- 本地知识库集成(RAG):通过内置的检索增强生成(RAG)功能,企业用户可以直接上传PDF、Word文档等内部资料,模型能实时从中检索信息并生成回答,为内部知识管理和智能问答提供了强大支持。

- 部署成本:其部署过程极为轻量化,只需一条Docker命令即可启动,并支持GPU加速以提升性能:

docker run -d -p 3000:8080 --gpus all ghcr.io/open-webui/open-webui:cuda

这使得即使是资源有限的企业也能快速搭建起AI应用环境。

OpenWebui的具体部署教程

这里我只介绍使用docker进行部署,因为比较方便,其他方式有兴趣的朋友自己研究即可。

什么?电脑没有安装docker?mac电脑安装docker可以说是有手就会,我就不过多介绍了,实在不会的,参考这个教程:https://www.runoob.com/docker/macos-docker-install.html

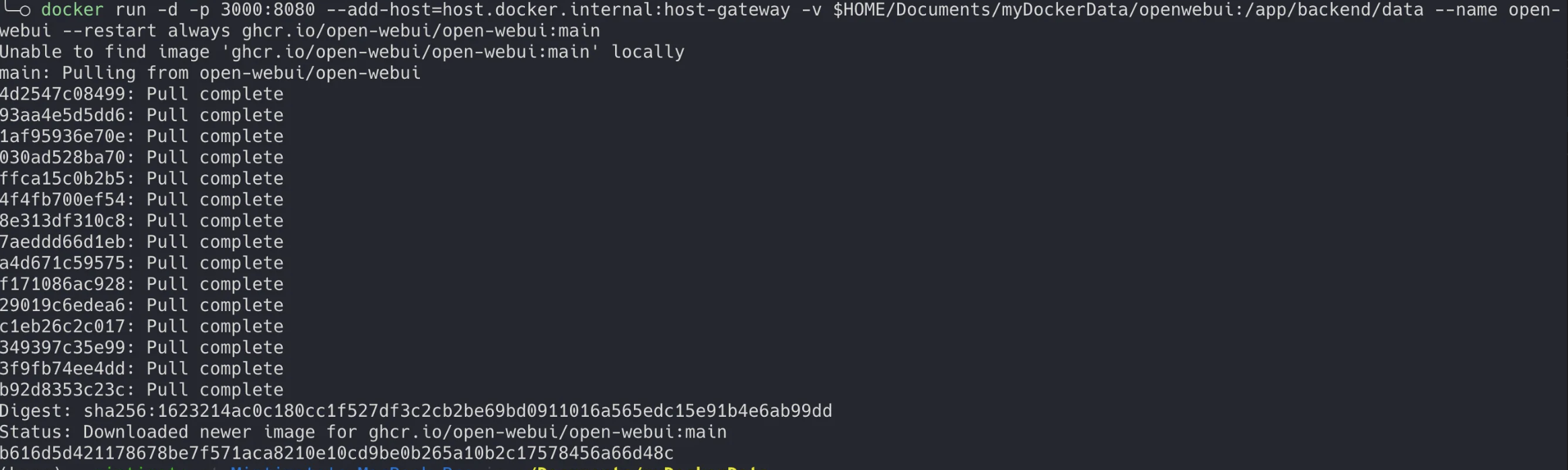

docker安装成功后,我们来使用docker安装Openwebui

# 拉取镜像并映射端口运行

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v $HOME/Documents/myDockerData/openwebui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

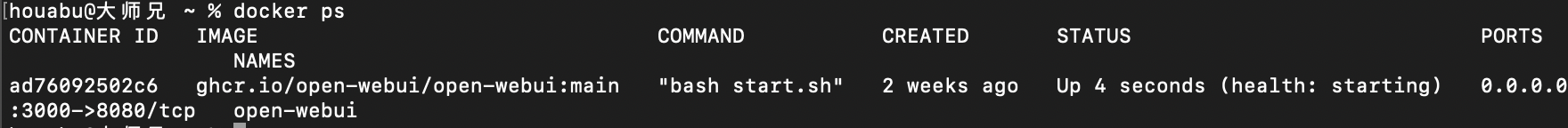

可以看到 已经拉取镜像成功,并且端口映射好,而且启动起来了

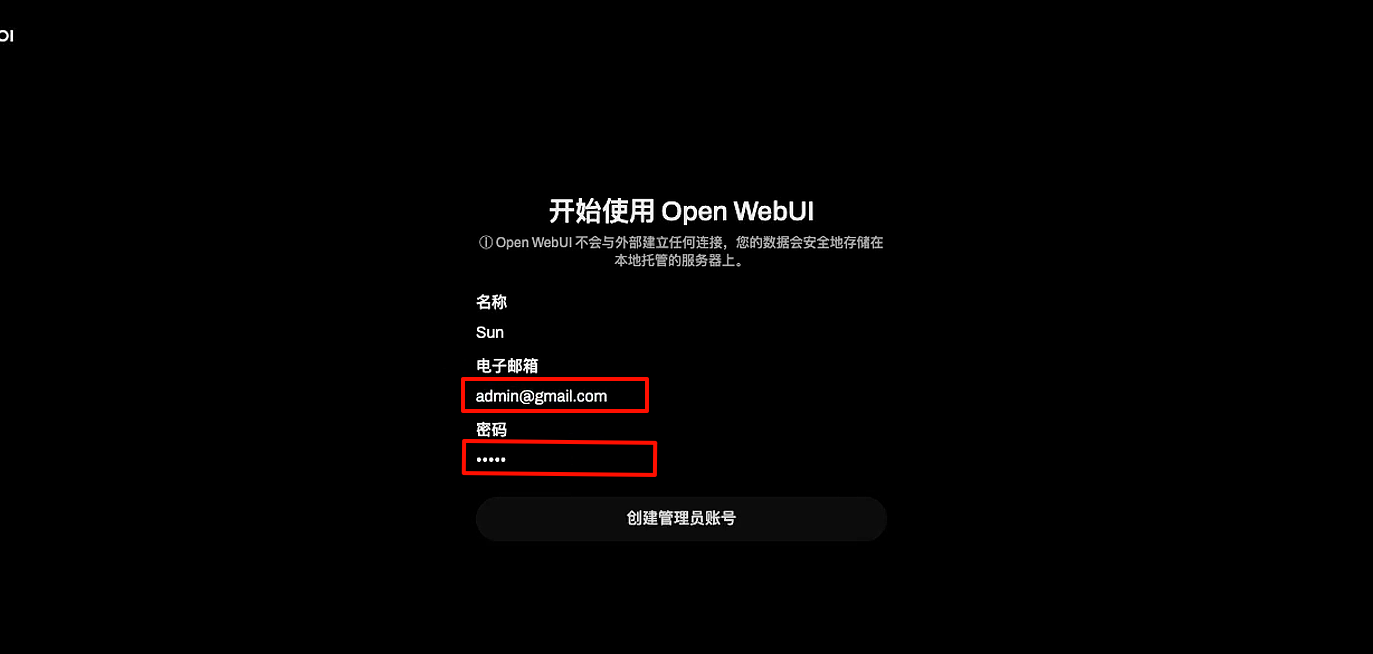

此时访问 http://localhost:3000/ 就可以进入到Openwebui的界面了。

首次进入可能需要稍微等待几分钟,然后就会出来界面,

点击开始使用,然后进行注册,登录即可使用。首次注册的账号即为管理员账号。

2. 文心大模型:轻量高效的AI智能引擎

文心大模型系列是百度研发的强大AI模型家族,其在企业级应用中展现出卓越的性能和成本效益。

- 选型优势:文心大模型针对不同应用场景提供了多种规模的模型,尤其在轻量化方面表现突出:

- ERNIE-4.5-0.3B:这款3亿参数的模型,在经过INT4量化后,单卡显存占用仅为2.1GB,却能实现高达291 tokens/秒的响应速度。这意味着它甚至可以在边缘设备上流畅运行,为企业节省大量算力成本。

- ERNIE-4.5-VL-28B:作为多模态模型,它支持图文混合分析能力,例如在工业缺陷识别领域,其准确率可达92%,为制造业的智能质检提供了坚实基础。

- 生态兼容性:

- 通过FastDeploy框架,文心大模型提供了OpenAI兼容API,这意味着它可以无缝对接Open WebUI以及其他支持OpenAI API标准的工具和平台,大大降低了集成难度。

- 更重要的是,文心大模型支持昇腾、寒武纪等国产芯片,这不仅符合国家信创战略的要求,也为企业提供了更多样化、更自主可控的硬件选择。

文心大模型的几种使用选择:

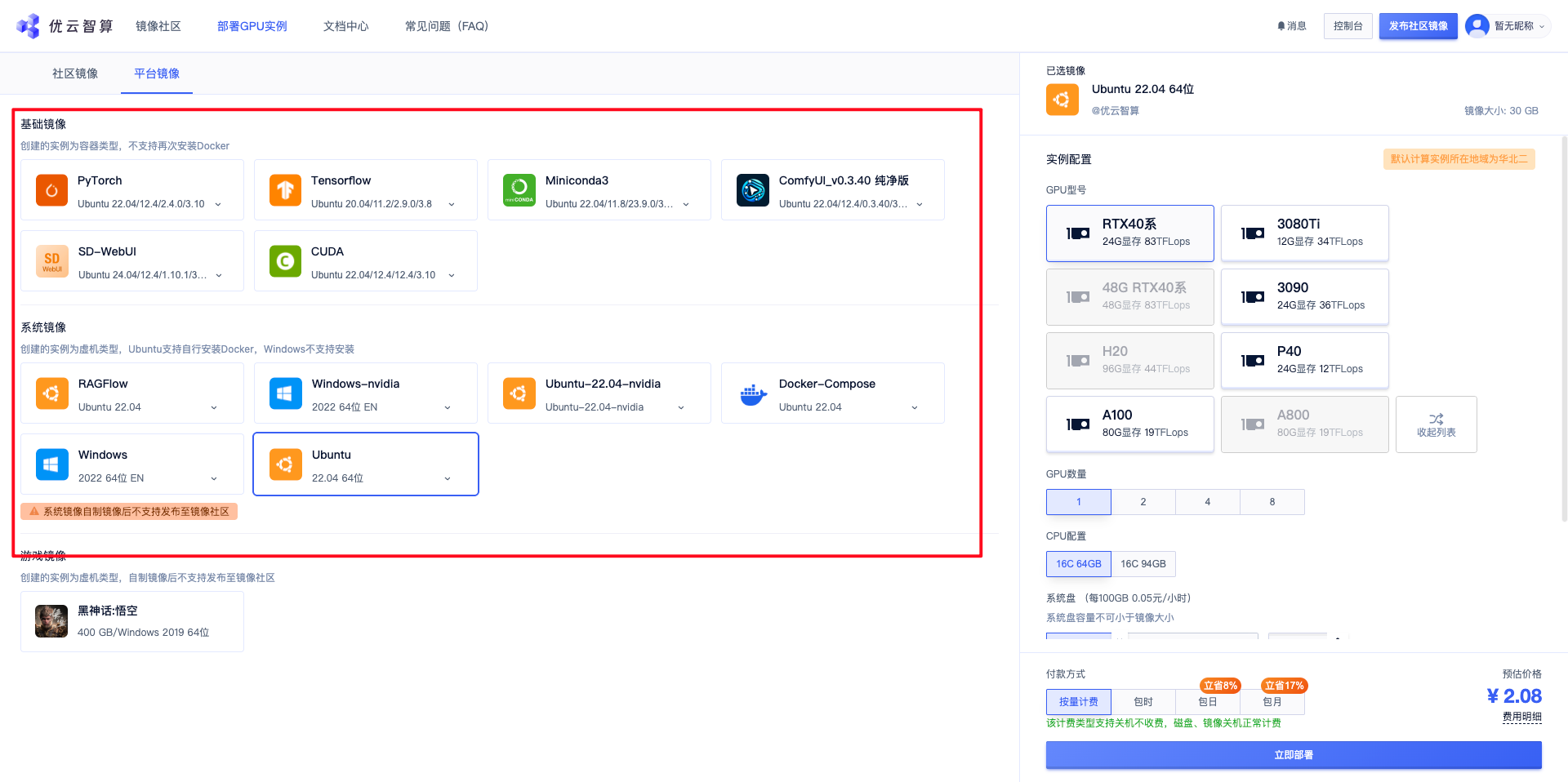

1.本地部署:在自己的电脑或者云服务器上进行部署文心大模型,然后提供服务,作为服务端。

这里大家可以参考我的这篇实操文章:

「源力觉醒 创作者计划」_文心开源模型(ERNIE-4.5-VL-28B-A3B-PT)部署使用心得

当然如果模型不符合自己预期的话,部署教程一抓一大把,大家可以自行进行搜索。

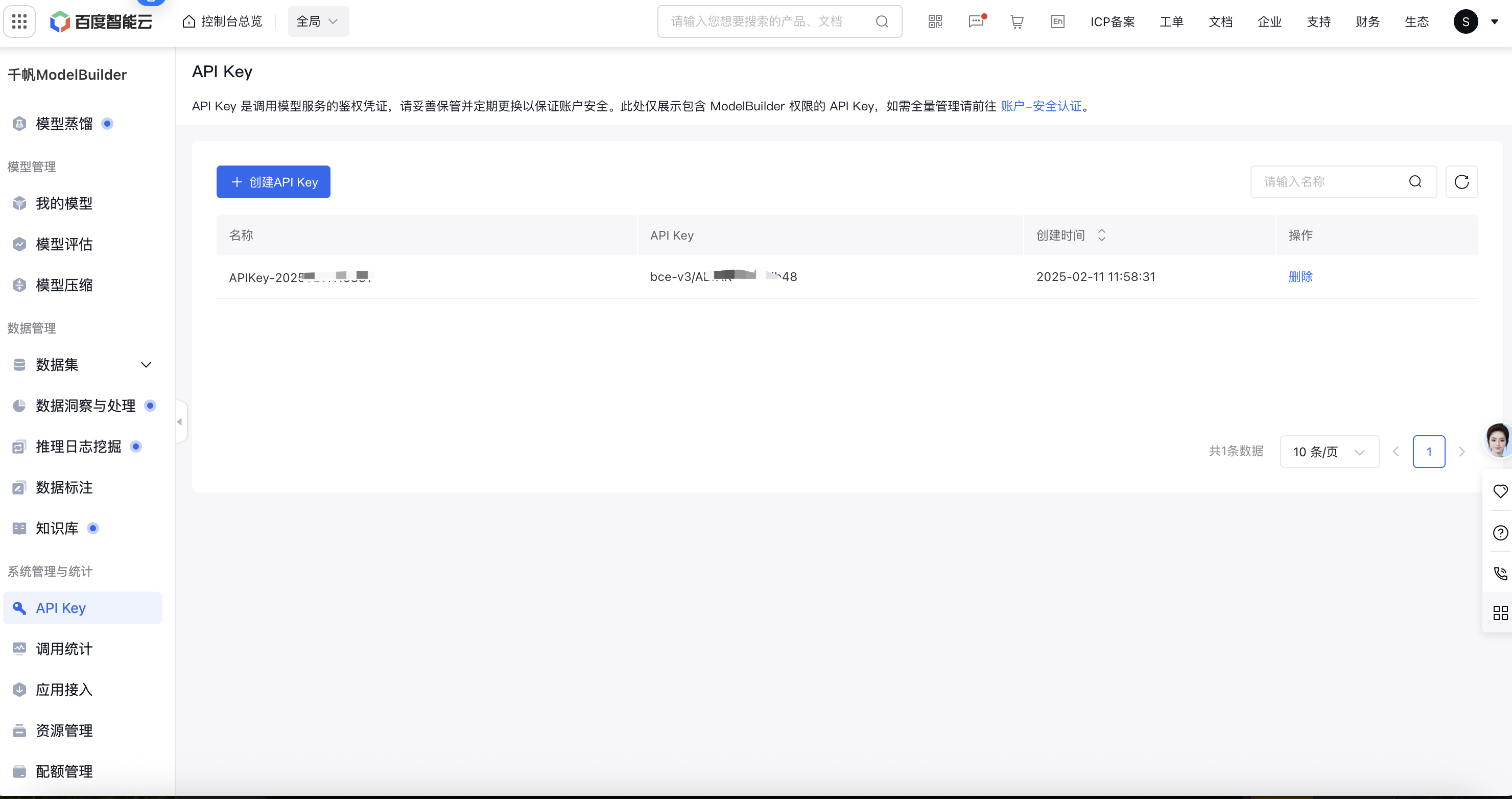

2.使用各大平台的API接口:百度千帆平台、飞桨平台、魔搭平台等,都提供了文心4.5模型系列的api接口,进行相应的认证以及付费就可以直接进行调用。

现在要用文心4.5模型,当然就用百度千帆平台的,不过这个api着实难找,我给大家一个传送门,点击后可以直接到API的页面,这个API就是兼容OpenAI接口的,可以直接在OpenWebui或Dify里面使用的。

二、行业应用方向:基于技术特性的实施建议

结合OpenWebUI的零代码交互能力与文心大模型的轻量化特性,以下从三个典型行业场景出发,提供一些可参考的应用思路,企业可根据自身需求探索适配方案:

场景1:制造业质检环节的智能化辅助

行业常见挑战

制造业质检常面临人工判断标准不一、重复劳动占比高、细微缺陷易遗漏等问题,尤其在批量生产场景中,效率与一致性难以平衡。

建议实施路径

- 可尝试通过OpenWebUI对接文心大模型的多模态能力(如ERNIE-4.5-VL系列),构建轻量化质检辅助工具;

- 上传企业产品的合格/缺陷样本图片、质检规范文档至OpenWebUI的本地知识库,形成专属参考库;

- 一线员工可通过拍照上传的方式,快速获取AI对缺陷的初步判断建议(如“疑似焊点气泡,建议参照XX标准复核”),辅助人工决策。

潜在价值参考

若落地得当,此类工具可能帮助减少人工重复判断的时间成本,提升质检标准的统一性,尤其适合中小批量、多品类的生产场景。

场景2:金融领域文档处理的效率优化

行业常见挑战

金融行业的合同审核、合规检查等工作依赖大量文档处理,存在条款提取耗时长、关键信息易遗漏、人工录入误差等问题。

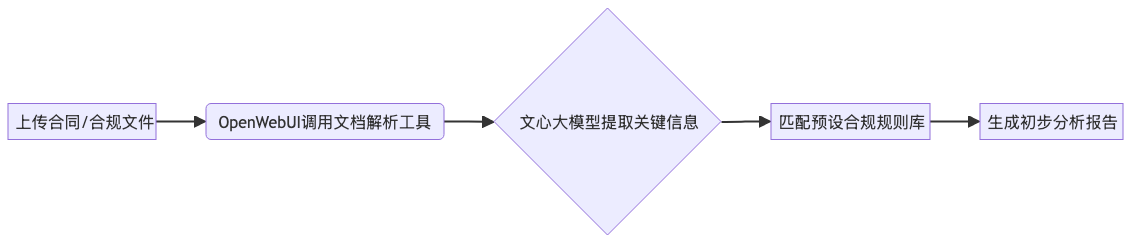

建议实施路径

- 可借助OpenWebUI的流程化交互能力,结合RAGFlow等文档解析工具,搭建低代码文档处理流:

- 利用文心大模型的语义理解能力,重点优化专业术语识别(如金融条款、法律条文)和逻辑关联分析(如条款与法规的对应关系)。

潜在价值参考

若配置合理,有望缩短文档处理周期,减少人工提取信息的误差,为后续的人工审核提供结构化数据支持,提升整体流程效率。

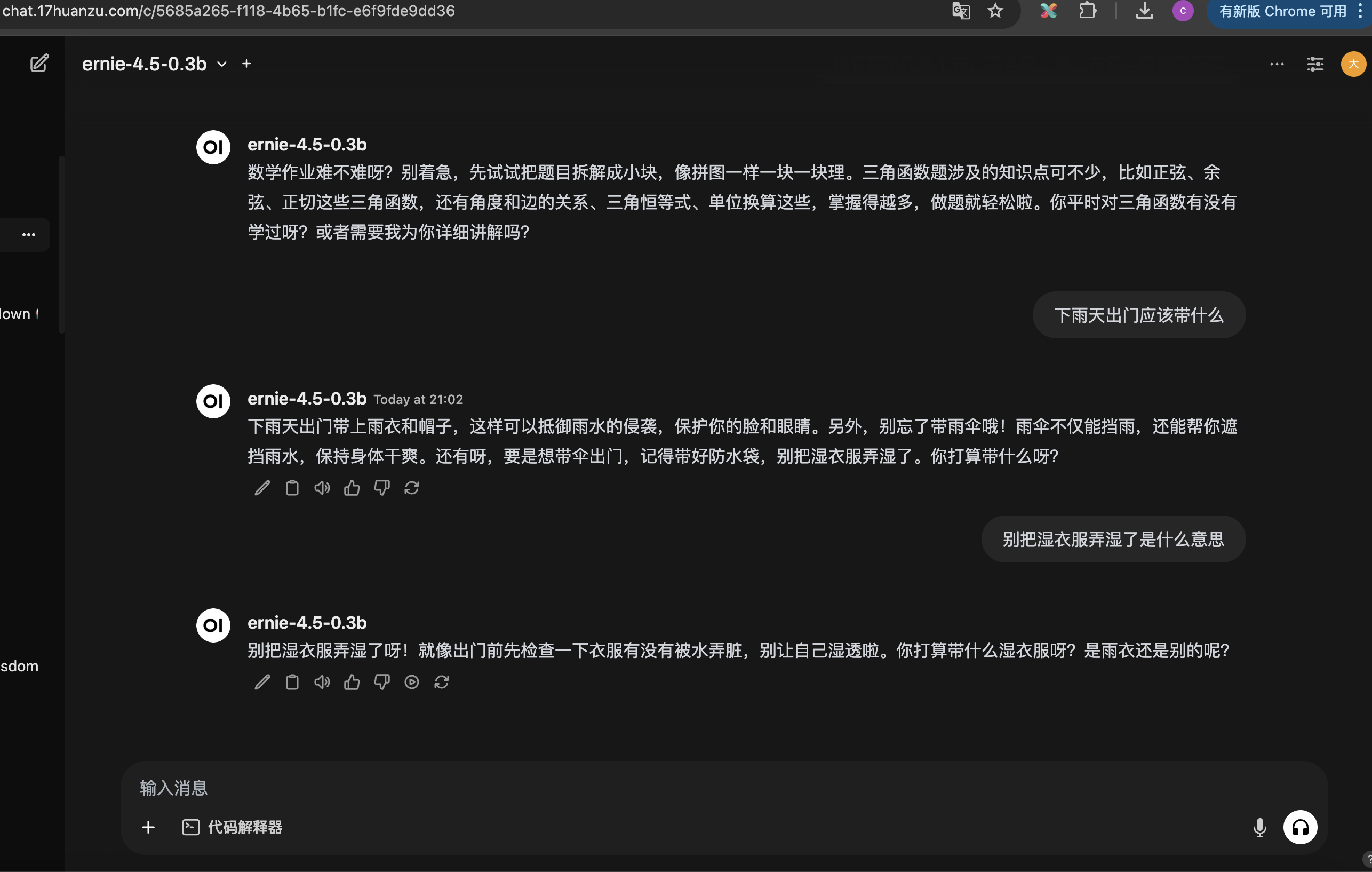

场景3:教育场景中的轻量化AI辅助工具

行业常见挑战

部分教育资源不均衡地区存在师资紧张、个性化辅导覆盖不足等问题,学生课后提问难以及时得到解答。

建议实施路径

- 可尝试在边缘设备(如树莓派等低功耗硬件)上,通过OpenWebUI部署轻量化文心大模型(如ERNIE-4.5-0.3B量化版本);

- 内置本地化的教材知识库,支持学生通过文字或语音提问,获取基础知识点讲解、解题思路提示等辅助内容;

- 选择离线部署模式,既能保障数据隐私,也可适应网络条件有限的环境。

潜在价值参考

若适配得当,可能帮助补充课后辅导资源,缓解基础知识点的重复答疑压力,为教师节省时间投入更深度的教学准备。

以上场景仅为结合技术特性的前瞻性建议,实际效果需企业根据自身业务复杂度、数据质量及部署条件进行测试验证。建议从高频、重复性高的业务场景入手,逐步探索适合自身的AI落地路径。

三、降本增效核心技术解析

上述成功案例的背后,离不开几项关键的技术支撑,它们共同构成了企业实现AI降本增效的基石。

1. 轻量化部署:成本降低90%的关键

- 文心0.3B量化技术:这是实现低成本部署的核心。文心大模型采用了先进的4-bit卷积码量化算法,将模型显存占用降低至原始的1/4,同时保持精度损失小于3%。此外,其动态路由机制能够按需激活专家模块,使得计算量减少85%,从而大幅降低了运行能耗和硬件要求。

- 边缘适配案例:以华为昇腾910B为例,文心大模型在其上能够实现42 tokens/s的吞吐量,而功耗却低于70W,展现了卓越的能效比,使得AI能力能够真正“下沉”到边缘。

2. 知识增强:解决行业术语难题

- 文心特色能力:文心大模型在中文理解和特定领域知识方面具有显著优势。例如,它对中文成语的理解准确率高达88%(如能准确关联“程门立雪”与程颐),在医疗术语识别方面也达到了96.2%的准确率,并内置了隐私过滤机制,确保敏感信息的安全处理。

- 企业定制方案:针对企业特有的行业术语和知识体系,可以通过ERNIEKit工具进行快速微调。通常只需百条数据,即可在3天内完成专科模型的适配,让AI更“懂”企业的业务。

3. 流程自动化:从交互到执行的闭环

- Open WebUI扩展策略:Open WebUI不只是一个交互界面,它还是一个强大的自动化枢纽。

- 通过集成如n8n等自动化工具,可以实现复杂的业务流程自动化,例如当模型识别出“高风险合同”时,系统能自动触发邮件告警通知法务部门。

- 对话记录可以同步到企业数据库,用于生成客户画像,从而持续优化服务策略和个性化推荐。

四、开发者实战指南:5步构建最小闭环

对于希望亲自动手实践的企业,以下是一个简明的5步指南,帮助您快速构建一个AI应用最小闭环。

- 模型选型:

- 对于轻量级文本生成场景,推荐选用ERNIE-4.5-0.3B(可通过GitCode下载,不过实测下来,可用性还是差强人意,语义理解和回答准确率都较差,作为辅助来用的话,还可以。)。

- 对于需要处理图像和文本的多模态场景,则选择ERNIE-4.5-VL-28B(需要至少24GB显存)。

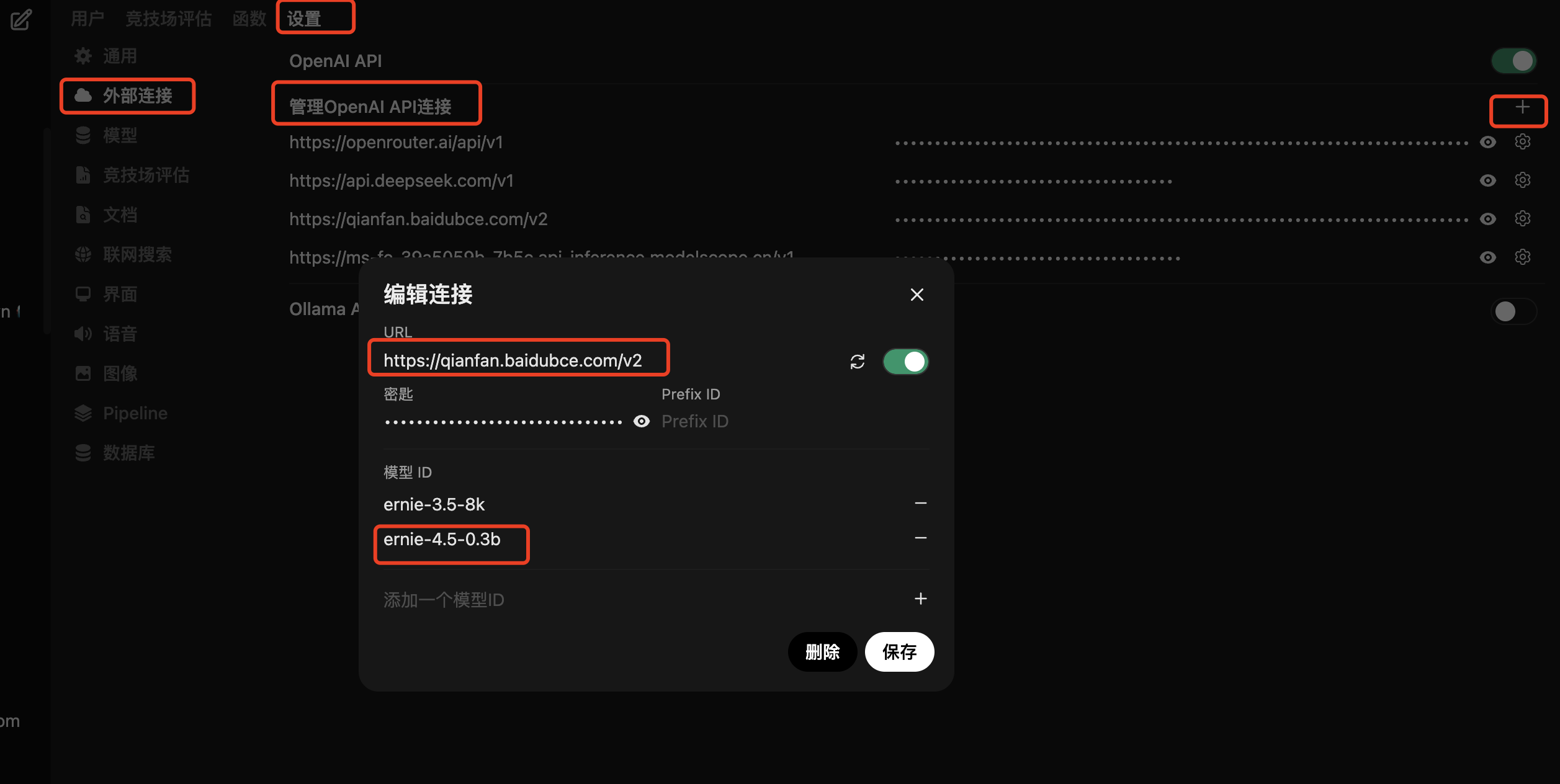

- Open WebUI部署:启动Docker容器,并将其与文心API服务关联起来。

# 启动容器并挂载文心API

docker run -d -p 3000:8080 -e OLLAMA_API_BASE_URL=http://<文心服务IP>:8180 ghcr.io/open-webui/open-webui

这里或者直接在管理员设置界面进行配置也可以:

此处我用的是千帆平台的api服务,并非本地搭建的,大家根据自己的情况自行替换即可。

- 文心API服务配置(FastDeploy):在服务器上启动文心模型API服务,以便Open WebUI能够调用。

# 单卡启动0.3B模型服务

python -m fastdeploy.entrypoints.openai.api_server \

--model baidu/ERNIE-4.5-0.3B-Paddle --port 8180

-

知识库注入:通过Open WebUI界面,直接上传企业的产品手册、合同模板等文档。系统将自动进行解析并构建向量索引,为RAG功能提供数据支持。

-

自动化扩展:配置自动化工具,如n8n,与Open WebUI结合,实现业务流程的自动化。例如,设置一个钉钉机器人,当模型识别出“高风险合同”时,自动通知法务人员。

五、未来展望:轻量化AI的规模化革命

“小模型+零代码”正成为企业AI落地的最短路径。这种模式不仅降低了技术门槛,更预示着一场深刻的AI普惠化变革。

- 技术趋势:

- 未来,文心大模型的MoE(Mixture of Experts)架构与边缘计算芯片的结合将更加紧密,有望催生出更多高性能、低功耗的嵌入式AI终端,例如智能工厂巡检机器人。

- Open WebUI的插件市场也将日益丰富,提供更多预置的行业工作流模板,如医疗问诊、金融尽职调查等,进一步降低行业解决方案的开发难度。

- 生态价值:

- 企业私有化部署的成本将降至传统云服务的1/10,彻底打破长期以来困扰企业的“数据出域”焦虑,确保数据安全与合规。

- 开发者可以通过利用文心大模型等开源模型(遵循Apache 2.0协议),在其基础上构建和发布闭源商业产品,加速技术创新成果向实际生产力的转化。

总结

当Open WebUI遇上文心大模型,企业AI落地不再是少数“技术特权”的专属,而是变成了人人可用的“普惠工具”。正如某制造企业CTO所言:“过去需要6人AI团队才能完成的任务,现在业务主管用浏览器就能轻松搞定。”

这场由零代码交互与轻量化模型共同驱动的效率革命,正在每个行业的土壤中生根发芽,并迅速壮大——智能,从未如此触手可及。拥抱这种新的AI范式,企业将能够在竞争激烈的市场中抢占先机,实现持续的创新与增长。

一起来轻松玩转文心大模型吧——文心大模型免费下载地址:

https://ai.gitcode.com/paddlepaddle/ERNIE-4.5-VL-424B-A47B-Paddle

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)