头部姿态估计的技术方法与发展趋势

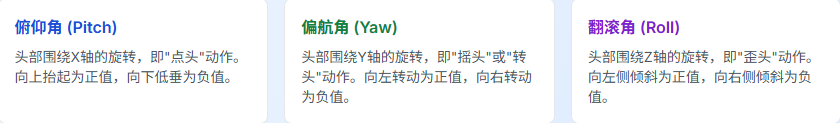

头部姿态估计(Head Pose Estimation, HPE)指根据图像或视频推断人头相对于摄像机的朝向(通常以欧拉角yaw偏航、pitch俯仰、roll翻滚表示)。作为非言语行为分析的重要组成,头部朝向能够反映注意力、意图等信息,广泛应用于驾驶员监控、人机交互、视线追踪等领域。早期方法主要依赖几何与经典机器学习技术,近年来深度学习推动了精度提升。总的来说,HPE方法大致分为基于2D关键点(两

常见技术方法概述

头部姿态估计(Head Pose Estimation, HPE)指根据图像或视频推断人头相对于摄像机的朝向(通常以欧拉角yaw偏航、pitch俯仰、roll翻滚表示)。作为非言语行为分析的重要组成,头部朝向能够反映注意力、意图等信息,广泛应用于驾驶员监控、人机交互、视线追踪等领域。早期方法主要依赖几何与经典机器学习技术,近年来深度学习推动了精度提升。总的来说,HPE方法大致分为基于2D关键点(两阶段)和直接图像回归(端到端)两大策略。研究表明,在深度学习助力下,端到端方法已显著超越传统的关键点两步法。下面按照方法原理对现有技术进行分类综述。

方法分类与原理

基于2D关键点的方法

这类传统方法先检测人脸2D特征点(如眼角、鼻尖、嘴角等),再利用这些关键点与预先定义的3D人脸模型点之间的对应关系,通过PnP(Perspective-n-Point)求解头部的旋转和平移。本质上,它将头部姿态估计转化为一个经典的空间几何问题:已知相机参数、若干3D-2D点对,求解旋转矩阵R和平移向量t。常用实现如OpenCV的solvePnP,配合平均人脸3D模型和关键点检测器(Dlib、人脸对齐网络等)即可得到姿态估计。

优点:无需训练专门的姿态模型,充分利用人脸关键点技术的成果;几何解算具有确定性,计算开销小,可实时运行。例如,Dlib的人脸关键点回归可在毫秒级定位68点,然后PnP解算出头部朝向。

缺点:

1)依赖关键点精度 – 如果面部关键点定位不准或遇到遮挡、大角度侧脸导致部分点无法检测,姿态计算会直接失败。这是两阶段方法的固有问题:第一步失败则整体失效。

2)相机参数未知 – 理论上PnP需要准确的相机内参,实际应用中往往难以获取,只能假设一个焦距等效内参,模型误差会引入姿态偏差。

3)个体差异 – 常用的3D人脸平均模型无法完全对应每个人的头部结构,不同人的面部尺度差异也会带来误差。

代表性方法:早年大量研究采用此范式。Murphy-Chutorian和Trivedi的综述总结了2000年代基于特征点和PnP的各种方案,包括基于检测面部器官形状、投影几何关系等方法。Nikolaidis等提出利用双眼和嘴角形成的等边三角形形变估计水平转角,Narayan等提出仅需少量特征点的通用几何模型提高了横摆角估计的效率。这些方法在 水平左右转头(yaw)范围内表现尚可,但面对 俯仰角 和 翻滚角 变化以及复杂现实条件时精度有限。

基于3D模型的方法

此类方法利用三维头部或人脸模型参与姿态估计,典型代表是 3D Morphable Model (3DMM) 拟合和3D人脸重建技术。3DDFA (Zhu等, 2016) 是开创性的工作,它训练CNN将单张RGB人脸图像回归到3D人脸形状和姿态参数,从而在大角度下仍能准确定位五官并输出头部姿态。3D模型方法通过匹配三维形状来推断姿态,天然具有抗遮挡和大姿态变化的优势:即使部分面部不可见,仍可通过匹配其余区域的3D模型来估计头部整体朝向。此外,构建个性化的3D人脸有助于提高姿态精度,因为考虑了个体头型差异。

另一种思路是不显式建模3D形状,而是直接回归3D姿态参数。例如,Hsu等提出QuatNet,以四元数表示头部旋转并设计多重损失同时优化四元数的各分量。四元数避免了欧拉角表示在某些姿态下的奇异(如万向锁)问题,确保姿态表示的连续平滑。又如近期的TriNet方法,用三个互相正交的向量(等价于旋转矩阵的三个轴)来表示头部朝向,并提出了向量平均误差(MAEV)作为评估指标,比直接角度误差更稳定。这种模型将姿态估计转化为对方向向量的回归,并增加了向量正交约束以确保物理有效性。

还有研究借助多视角或深度信息提高精度:Fanelli等利用Kinect深度相机获取人脸点云,训练随机森林实时回归头部的3D姿态。深度提供了尺度和3D结构信息,使得姿态估计鲁棒性提高。然而,深度/多视角方法需要特殊硬件或复杂的数据采集装置,应用受限。总体而言,3D模型驱动的方法优点在于利用物理三维约束,抗旋转和部分遮挡,输出姿态往往更稳定可信;缺点是对计算资源和数据要求更高(需要3D标注或模型),在实时性和灵活性上不如直接CNN回归。

代表性方法:除3DDFA外,近期还有Gu等将卡尔曼滤波思想与RNN结合,在视频中联合估计人脸特征点和头姿,实现对姿态的跟踪估计。Martin等针对消费级深度摄像头,结合头部深度特征与预先生成的头模型进行匹配,在宽视角范围内取得了高精度结果。这些都体现了将3D信息融入姿态估计的思路。

基于图像直接回归的方法

随着深度学习的发展,大量方法选择端到端地从图像直接预测姿态角度,避免了中间步骤。这类方法通常使用卷积神经网络(CNN)提取人脸图像特征,然后直接回归yaw/pitch/roll角度或相应的表示。由于头部姿态是一个连续回归问题,直接回归精确角度具有一定难度,一些工作改为分类回归混合策略来提高精度。

HopeNet(Ruiz等, 2018)是该方向的代表方法。它采用ResNet-50主干网络分别输出yaw、pitch、roll三个角度,每个输出头同时进行了角度范围离散分类和精细回归两种监督。具体来说,将每个角度离散成若干bins,用softmax分类获得概率分布,再根据概率加权求和得到回归角度。分类分支提供了对粗略方向的稳定判别,回归分支微调精细值,两者结合提高了角度预测的鲁棒性和精度。

然而,单级分类的离散误差仍可能影响最终精度。Wang等(2019)提出混合粗细分类框架,在HopeNet的基础上增加第二级精细分类器。他们将每个粗分类bin再细分为更小区间,由辅助分类器进一步区分。这种两级分类-回归策略有效减少了量化误差和过拟合,提高了大角度下的估计准确度。

另一突破是Yang等提出的FSA-Net (CVPR 2019)。FSA-Net设计了细粒度结构特征聚合模块,将不同卷积层的特征进行加权融合,并引入注意力评分机制筛选出对姿态最有判别力的特征。此外,它借鉴年龄估计中的SSR-Net方案,使用两个子网络分别回归粗略和精细姿态,再综合输出,从而在无需关键点的情况下实现高精度头姿估计。FSA-Net在当时多个数据集上刷新了精度纪录,证明了精细特征选择和多尺度回归的有效性。

随着对全姿态范围(特别是大角度后脑勺朝向)的需求增加,Zhou等提出WHENet(2020)。WHENet改进了损失函数和数据增广策略,使模型可以处理360°全方位的头部旋转。它通过在训练中加入全姿态分布的数据并调整网络输出层,使yaw角预测不局限于[-90°,90°],成功扩展到了头部完全背向也能估计角度的应用场景。WHENet被认为是首个单张RGB图像下适用全范围头部旋转的端到端方法。

近年来还有一些输出表示的改进。鉴于欧拉角在接近奇异位姿(例如俯仰接近±90°)时数值变化剧烈,一些工作采用连续角度表示:如用朝向向量、旋转矩阵元素或四元数替代直接预测欧拉角。QuatNet已证明四元数预测的有效性;还有方法通过回归6维旋转表示(两个3D单位向量)避免了角度的二义性。这些改进在很大程度上缓解了欧拉角表示的模糊和不连续问题。

优点:图像直接回归方法充分利用了深度神经网络强大的表征学习能力。在有充足训练数据情况下,它可以学习到鲁棒的特征直接映射到姿态,避免了关键点检测误差传播。许多研究报告显示这种端到端方法在非受限场景下取得了远超传统方法的精度。此外,推理时仅需一次网络前向,速度也较快,适合实时应用。

缺点:主要挑战在于对数据的依赖。头部姿态标注获取困难,导致公开数据集有限且规模不大。端到端模型需要大量带姿态标签的样本方能泛化良好,而标注误差或数量不足会严重制约性能。同时,对于超大角度(接近侧脸/profile甚至背对)的样本稀少,网络可能未学到足够模式,预测时容易出错。此外,直接回归欧拉角在角度接近边界(如从179°到-179°跨界)时会遇到学习困难,这就是为何许多方法引入分类辅助以稳定训练。总之,深度回归方法虽然强大,但需要配合充足而多样的数据以及合理的损失设计才能发挥最佳效果。

自监督和无监督方法

由于大规模标注头部姿态数据非常困难且昂贵,近几年出现了利用自监督/无监督方式进行头姿估计的探索。这类方法的核心思想是否定传统监督学习完全依赖标签的范式,通过设计代理任务或利用数据内部的结构与一致性来学习有助于姿态估计的特征。

一种途径是自监督预训练:在没有姿态标签的海量人脸数据上,让网络完成某种预文本质任务(pretext task),例如预测图像旋转角度(让模型判断输入人脸被旋转了多少度)、拼图排序(Jigsaw puzzle)或图像颜色填充等。这些任务逼迫模型学习与形状朝向相关的特征。研究表明,自监督预训练可以学到较好的中层特征用于姿态估计等下游任务。Pourmirzaei等(2021)比较了多种自监督方法对细粒度头姿估计的作用,发现用自监督预训练权重初始化然后微调,比直接用ImageNet预训练或随机初始化有明显提升,并且某些自监督任务(如预测旋转)还能在训练中以多任务形式辅助监督训练一起用。这将原本单一的监督回归拓展为半监督多任务学习框架,从而显著降低了对姿态标签规模和质量的依赖。

更进一步的是无监督联合训练方法:完全不使用姿态真值,通过构建图像间关系来学习模型。Zou等(2025)提出了一个创新框架,将人脸关键点检测和头姿估计联合起来在无标注数据上训练。其做法是引入一个可学习的3D人脸模板(一组3D关键点)和一个图像重建网络,让模型输出的关键点和姿态去重建同一个人的另一视角图像。具体而言,从一个未标注人脸A出发,随机生成一个仿射变换得到人脸A',要求模型在A上预测出3D关键点及头pose,在A'上也预测关键点,然后通过几何变换将A的预测结构重建出A'的图像。利用重建误差和几何约束误差作为训练信号,逼近模型学会正确的关键点定位和姿态变换。这种方法在公开人脸集上达到了接近有监督方法的精度,同时不需要任何姿态或关键点标注。

还有一些无监督方法利用图像序列的时空信息。例如,Mustikovela等(CVPR 2020)利用多个不同视角的人脸集合来学习视角变化的表示,通过对未对齐的人脸图像进行转换来推断姿态差异。此类方法通常假设我们有同一人的不同姿态照片或视频帧,利用姿态变化的等变(equivariance)性质:模型对一帧的预测若应用于另一帧,应与两帧之间的已知变换一致。通过这种变换一致性约束,可以在无标签下教会模型姿态的概念。例如,对视频中的连续两帧,若已知它们在时间上连续,可以假设头部姿态变化不大或者遵循某种平滑,这也能形成自监督信号。这方面的研究还包括结合生成对抗网络(GAN)来产生带有特定旋转的头像,与原图对比来推断真实姿态的尝试等。

优点:自监督/无监督方法最大亮点是摆脱对姿态人工标注的依赖,可以利用互联网海量人脸数据进行训练,从而潜在地学到更丰富多样的姿态特征。同时,由于不依赖人工标签,它避免了标签错误对模型的误导——很多公开数据集的姿态标注存在不准甚至错误,无监督方法不存在这一问题。并且,无监督训练往往让模型学到更通用的表示,可以更好地跨域泛化到新环境新人群。

缺点:完全无监督的框架设计复杂,需要巧妙的代理任务和损失函数来确保模型真正在学姿态而非陷入无意义解。例如,上述重建方法需要处理不同人的脸存在形变的情况,否则模型可能作弊地只学到重建平均脸而不是姿态变化。另外,目前无监督方法在精度上相对略逊于有监督(特别是在精细角度回归上),通常需要结合一些有限的有标签数据进行微调才能达到最优效果。不过随着研究推进,这一差距在不断缩小。

方法对比表

下面总结不同类别头部姿态估计方法的原理和特点:

| 方法类别 | 方法原理 | 优势 | 劣势 | 代表性工作 |

|---|---|---|---|---|

| 2D关键点法 | 检测2D人脸关键点后通过PnP解算姿态。 | 实现简单、高效;利用成熟的人脸关键点技术。 | 严重依赖关键点精度,关键点遮挡或检测失败则无法估计姿态;需假设相机内参,模型不准确导致误差。 | Dlib关键点+PnP (Kazemi等);Murphy-Chutorian等综述;Zhu & Ramanan (CVPR’12)。 |

| 3D模型法 | 构建3D头部/人脸模型匹配图像(如3DMM拟合);或直接回归姿态的三维参数(旋转矩阵/四元数)。 | 利用三维几何约束,抗大角度和遮挡;可输出连续平滑的姿态(避免欧拉角奇异)。 | 计算和实现复杂;需3D模型或特殊硬件(如深度相机)支持;模型不精准会影响姿态结果。 | 3DDFA(Zhu等, 2016);QuatNet(Hsu等, 2019);TriNet(Zhu等, 2021)。 |

| 图像回归法 | 深度CNN端到端从图像直接预测欧拉角或其参数化表示;可结合分类+回归多任务训练提高精度。 | 利用大数据学习复杂特征,精度高;推理快速,无需中间步骤。 | 依赖大量标注数据;欧拉角广范围表示有模糊,极端姿态学习困难;对遮挡和未见姿态的鲁棒性取决于训练分布。 | HopeNet(Ruiz等, CVPRW’18);FSA-Net(Yang等, CVPR’19);WHENet(Zhou等, arXiv’20);6DRepNet(Huang等, 2020)。 |

| 自监督/无监督 | 通过预训练代理任务(如预测图像旋转)学习姿态表征;或利用多视角/重建一致性在无标签数据上训练模型。 | 不需昂贵标注,可利用海量未标数据;避免标签误差影响模型;潜在跨域泛化能力强。 | 训练策略复杂,收敛难度高;纯无监督精度略低于有监督,需要精心设计损失确保学到姿态相关特征。 | RotateNet(3D目标姿态, 2018);Pourmirzaei等(2021)自监督预训练结合HPE;Zou等(无标注联合关键点+姿态, PR’25)。 |

近两年(2023-2024)研究趋势

-

跨域泛化与自适应:考虑到训练数据与实际应用场景可能差异巨大,近年来对域适应和泛化能力的关注上升。研究者致力于让模型适应不同人种、成像条件甚至模拟数据到真实数据的跨域迁移。例如,有方法通过在合成数据上预训练,然后在少量真实数据上微调,实现模型对真实世界的适应。还有半监督框架利用未标注的人脸视频进行训练,只在小部分数据上用姿态标签,从而提升在新域上的性能。这类工作迎合了实际需求,因为商用系统往往无法获取与训练集完全同分布的数据,模型必须具备一定自适应性。

-

多任务联合学习:将头姿估计与其他相关任务结合是近年一大趋势。多任务学习可以让模型共享特征、互相正则,从而提高各任务的准确度。在头姿领域,常见的是联合人脸关键点检测、表情识别、眨眼检测、身份识别等一起训练。例如,KEPLER方法使用改进的GoogLeNet同时预测人脸关键点和姿态,将粗略姿态作为先验提高关键点检测稳定性。又如近期一些驾驶员监控模型,输出包括头的朝向、低头打瞌睡检测、目光方向等多个指标,一并优化。多任务框架下,头姿作为辅助任务可以提升主任务性能,反之亦然。这一趋势说明头姿估计正从单一任务转变为计算机视觉系统中的一个模块,与其他任务协同发展。

-

新型模型与架构:Transformer等新一代网络架构也被引入头姿估计中,带来性能提升。例如CVPR 2023的TokenHPE方法,利用Vision Transformer捕捉人脸各局部区域之间的关系,以应对局部遮挡和外观差异。该方法引入了显式的“方向标记”令牌,配合一个引导式多损失函数来学习面部局部与整体朝向的对应关系,在多个基准上取得了优于CNN的精度。另外,轻量化网络持续受到关注。在边缘设备(如车辆ADAS系统、AR眼镜)上实时估计头姿需要模型高效低耗。为此,有工作探索知识蒸馏和神经架构搜索,以压缩模型大小同时保持精度。例如某些MobileNet变体或卷积Transformer混合结构被用于HPE,达到了在嵌入式设备上每秒数十帧的运行速度,而精度仅略微下降。总体而言,新模型的引入让头姿估计紧跟深度学习前沿,获得更强的表达能力和效率。

-

复杂场景与新任务设定:研究焦点正扩展到更复杂和极端的场景,催生出新任务变体。一个例子是多人场景的头姿估计:传统方法假定图像中有单一明确的人脸,而在监控、群体互动中需要同时估计多人头向。Zhou等提出了DirectMHP(arXiv 2023),这是一个端到端一阶段模型,可以在拥挤场景中直接检测每个人的头部并回归其姿态,而无需先做人脸检测。他们还从AGORA、CMU Panoptic等数据构建了首个全方位多人头姿标注基准,包含大量侧脸乃至后脑勺的样本,用于训练和评测。结果显示,以往依赖人脸检测的方法在多人、全视角情况下脆弱且低效,而DirectMHP通过将头检测和姿态回归融合,显著提升了复杂场景下的表现。

又如事件相机(Event Camera)的引入:事件相机具备高时间分辨率和宽动态范围,非常适合捕捉高速运动和极端光照下的头部动作。Yuan等在ECCV 2024提出了基于事件相机的头姿估计方法。他们构建了两个大规模事件相机头姿数据集(共282段序列,涵盖不同分辨率和场景),弥补了缺乏事件数据的空白。并设计了专门的事件数据网络模块(如空间-时间融合模块ESTF、运动注意模块EMPA)和结合角度与旋转矩阵的统一损失。实验表明,相比传统RGB方法,该事件相机方案在剧烈头动和极暗/极亮环境下依然保持出色的姿态估计性能。这开辟了头姿估计在高动态、非可见光等特殊领域的新路径。

另外,6DoF姿态(同时预测头部3D位置和朝向)也开始受到重视。ECCV 2022的一项研究显式讨论了以往方法对头部平移估计不足的问题,提出结合人脸几何先验来改善6自由度(旋转+平移)估计的方案。这种改进有利于AR/VR应用中精准定位头部在空间中的位置。总的来说,新场景和任务的提出(多人、事件相机、6DoF等)为成熟的头姿估计研究注入了新活力。

-

自监督与弱监督继续发展:在训练数据有限或标注困难的场景下,自监督/弱监督策略依然是研究热点。近两年有方法将对比学习用于头姿:设计正负样本使网络学习与姿态相关的嵌入表示,比如利用不同视频帧中同一人的头部作为正样本、不同时刻不同人的作为负样本,来学习区分姿态变化的特征。还有方法受Masked Image Modeling启发,通过让模型预测被遮挡部分的面部来学会头部的空间结构,从而辅助姿态推理。一些弱监督实例则利用低精度标签或代理标签训练:如使用粗略的“左/中/右”分类标签来学习回归出更精细的角度。这在标签获取容易的情况下提供了一种折中方案。总之,如何降低对昂贵姿态标签的依赖仍是研究重点之一,尤其在跨域和隐私需求下,获取标注更具挑战,自监督/弱监督提供了可行途径。

-

新数据集与评测基准:数据资源方面,虽然顶会论文减少,但社区在持续发布新数据集来推动进步。例如,针对安防监控场景,2021年发布的GOTCHA数据集收集了62人在室内外11种环境下的682段视频,包含13.7万帧标注,用Blender重建3D头模型获取了高精度的±40°yaw、±30°pitch范围内姿态真值。又如驾驶员头姿由于行业应用迫切,近年出现多个专门数据集和竞赛,使其成为一个相对独立的热门方向。除了数据集,新的评价指标也被提出。前文提到的MAEV(Mean Absolute Error of Vectors)就是为了更合理评估全角度下误差而设计。当涉及360°预测时,传统MAE可能因为±180°边界问题不恰当,MAEV将姿态当作方向单位向量计算误差,可避免角度奇异导致的评价偏差。这类改进有助于公平地比较算法在宽角度范围甚至全姿态空间的性能。随着新数据和新评测标准出现,我们预期未来的研究会朝着更全面、更复杂条件下的头姿估计发展。

-

融合生成模型:生成模型在计算机视觉的成功也开始渗透到头姿估计领域。一方面,以GAN、NeRF为代表的生成方法可以用于数据增强,生成不同姿态的逼真头像,缓解训练数据不足的问题。另一方面,将生成模型与判别模型结合,可以提升对极端情况的鲁棒性。Malakshan等工作首次探索了用GAN生成的人脸来辅助姿态估计,证明在极低分辨率(监控摄像头、人群远景)下,GAN生成的先验可以帮助模型仍然有效地推断头部朝向。这一成果提示,在超低像素或遮挡严重的情况下,传统判别模型提取特征可能不稳定,而生成模型可以补全细节或提供正则。今后可能出现更多这方面的尝试,比如用3D人脸重建模型产生不同角度的样本与真实图像对比训练,或通过生成逼真的极端姿态样本来挑战模型,提升其泛化能力。

总结

头部姿态估计技术从早期的几何方法演进到深度学习时代,取得了巨大进步,在受控环境下已达到很高精度。然而,在真实世界的非受限场景(光照、多姿态、遮挡等)中依然具有挑战。最近两年顶会相关论文减少,反映出该领域在学术热点上的阶段性转移:一方面基本问题趋于成熟,另一方面研究兴趣转向更广的方向和应用。但这并不意味着头姿估计不再重要,恰恰相反,它作为许多视觉系统的基础模块,正通过与其他任务融合和向新场景拓展而持续发展。

展望未来,几个方向可能成为推动头部姿态估计继续前进的关键:其一,更强的跨域适应能力,让模型能应对多样人群和环境;其二,更轻量高效的模型,满足移动端和实时应用需求;其三,无监督/自监督学习的突破,充分利用海量未标数据挖掘姿态信息;其四,专用场景子领域的发展(如驾驶安全、安防监控、多人物联网等),结合专门数据集和评测来孵化有针对性的技术。可以预见,头部姿态估计将继续作为计算机视觉领域的一个重要课题存在,并在新的时代要求下焕发出新的活力。

参考文献:

-

Murphy-Chutorian, E., & Trivedi, M. M. (2009). Head pose estimation in computer vision: A survey. IEEE Trans. Pattern Anal. Mach. Intell., 31(4), 607–626.

-

Shao, X., et al. (2020). A survey of head pose estimation methods. In Proc. IEEE iThings/GreenCom/CPSCom/SmartData/Cybermatics, pp. 787–796.

-

Ruiz, N., Chong, E., & Rehg, J. M. (2018). Fine-grained head pose estimation without keypoints. In Proc. CVPR Workshops.

-

Yang, T.-Y., et al. (2019). FSA-Net: Learning fine-grained structure aggregation for head pose estimation from a single image. In Proc. CVPR.

-

Hsu, H.-W., et al. (2019). QuatNet: Quaternion-based head pose estimation with multi-regression loss. IEEE Trans. Multimedia, 21(4), 1035–1046.

-

Zhou, Y., & Gregson, J. (2020). WHENet: Real-time fine-grained head pose estimation. arXiv:2005.10353.

-

Wang, H., Chen, Z., & Zhou, Y. (2019). Hybrid coarse-fine classification for head pose estimation. arXiv:1901.06778.

-

Zou, Z., et al. (2025). Towards unsupervised learning of joint facial landmark detection and head pose estimation. Pattern Recognition, 132, 111393.

-

Zhang, C., et al. (2023). TokenHPE: Learning orientation tokens for efficient head pose estimation via transformers. In Proc. CVPR, pp. 8896–8905.

-

Yuan, J., et al. (2024). Event-based head pose estimation: Benchmark and method. In Proc. ECCV (Poster).

-

Zhou, H., Jiang, F., & Lu, H. (2023). DirectMHP: Direct 2D multi-person head pose estimation with full-range angles. arXiv:2302.01110.

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)