(2026原创大数据项目)基于Hadoop+Spark+Hive的智能出行交通数据可视化分析系统 |大数据毕业设计定制(附源码+数据库+包远程调试运行好)

本文介绍了一个基于Hadoop+Spark的智能交通数据可视化分析系统。该系统整合交通流量、停车共享、绿色出行和交通安全等多维数据,采用Hadoop进行分布式存储,Spark进行快速处理分析,Hive实现高效查询。前端使用Vue和Echarts实现可视化展示,后端采用Django提供API接口。系统通过数据清洗、K-means算法聚类等功能,实现对交通状况的实时监控与多维度分析,为城市交通管理提供

🔥作者:雨晨源码🔥

💖简介:java、微信小程序、安卓;定制开发,远程调试 代码讲解,文档指导,ppt制作💖

精彩专栏推荐订阅:在下方专栏👇🏻👇🏻👇🏻👇🏻

Java精彩实战毕设项目案例

小程序精彩项目案例

Python大数据项目案例

💕💕文末获取源码

文章目录

本次文章主要是介绍基于Hadoop+Spark+Hive的智能出行交通数据可视化分析系统

1、智能出行交通数据可视化分析系统-前言介绍

1.1背景

随着全球城市化进程的加速,交通问题成为了影响现代城市发展的关键瓶颈。大城市中交通拥堵、交通事故频发、空气污染加剧等问题,给居民的日常出行带来了极大的困扰。尤其是在环境保护和可持续发展日益受到关注的今天,传统交通系统的不足更加凸显。为了缓解这一问题,智能交通系统作为一种新型的交通管理方式,通过大数据、物联网、人工智能等技术的应用,能够提高交通管理效率,优化出行模式,并有效降低交通拥堵、改善交通安全。然而,当前大多数智能交通系统仍然存在数据处理不够精准、分析维度有限、实时性差等问题,无法全面解决复杂的交通难题。因此,开发一个基于大数据的智能交通数据可视化分析系统,能够实现对交通流量、停车共享、绿色出行和交通安全等多方面数据的实时分析和可视化,为城市交通管理提供决策支持,已成为亟待解决的课题。

1.2课题功能、技术

本课题的目标是构建一个基于Hadoop+Spark+Hive的大数据平台,结合Python、Django、Vue、Echarts等技术,设计并实现一个智能出行交通数据可视化分析系统。该系统将通过高效的数据采集、清洗、存储和分析,整合交通流量、停车共享、绿色出行、交通安全等多维数据,进行实时监控与分析。系统采用Hadoop进行大规模数据的分布式存储,使用Spark进行数据的快速处理和分析,利用Hive进行高效查询,并通过Echarts实现可视化展示。系统前端采用Vue框架构建,确保良好的用户交互体验,实时展示交通流量变化、停车资源分布、绿色出行推荐和交通安全警示等信息。后端则使用Django框架提供API接口,支持大数据分析结果的实时查询和更新。通过这一系统,用户可以更加直观地了解城市交通状况,做出更合适的出行决策。

1.3 意义

本课题的研究具有深远的理论和实践意义。首先,该系统通过对交通流量、停车共享、绿色出行和交通安全的多维度分析,能够为城市交通管理者提供科学的决策依据,优化交通资源配置,减少交通拥堵和事故,提升交通效率。其次,绿色出行分析模块的设计,鼓励市民选择更加环保的出行方式,有助于减少碳排放,推动城市可持续发展。第三,系统的可视化功能使得复杂的交通数据能够更加直观地呈现,增强了用户的互动性与决策支持能力。此外,本课题通过将Hadoop、Spark、Hive等大数据技术应用于交通领域,推动了大数据在智能交通中的广泛应用,提升了数据处理和分析的能力。最后,随着系统的推广应用,能够为更多城市的交通管理提供技术支持,助力智慧城市的建设。通过全面分析交通状况,系统不仅有助于提升居民的出行体验,还能够为政策制定者提供更具前瞻性的交通管理方案,促进社会经济和环境的协同发展。

2、智能出行交通数据可视化分析系统-研究内容

(1)系统需求分析:本系统需要实现对交通流量、停车共享、绿色出行和交通安全等多个数据维度的实时分析与展示。用户可以查看交通实时状况、停车资源分布、出行方式推荐等,系统应支持高效的数据存储、快速查询与可视化展示,确保系统稳定、响应迅速。

(2)数据库设计:采用MySQL数据库存储用户信息、系统配置等小规模数据,使用Hadoop进行大规模交通数据的分布式存储。通过Hive进行数据查询和分析,设计表结构时考虑到数据的多维度性和灵活性,确保数据能够高效查询和处理。

(3)前端设计:前端界面基于Vue框架开发,用户可以直观地查看交通流量、停车资源和绿色出行的实时数据。Echarts用于绘制各类动态图表,如流量趋势图、停车热力图、绿色出行推荐图等,增强用户交互体验并实时展示分析结果。

(4)后端设计:后端使用Django框架提供API接口,负责数据的采集、处理和提供给前端展示。通过集成Hadoop、Spark和Hive,后端能够高效处理大规模数据,并支持对交通流量、停车数据和其他分析模块的实时查询和分析,保证系统的稳定性与扩展性。

(5)系统测试:系统测试包括功能测试、性能测试和安全性测试。功能测试确保系统能够正常处理交通数据、展示流量信息等。性能测试确保系统在高并发情况下仍能稳定运行。安全性测试则确保用户数据和系统操作的安全,防止信息泄露和非法访问。

3、智能出行交通数据可视化分析系统 -开发技术与环境

- 开发语言:Python

- 大数据:Hadoop+Spark+Hive

- 数据处理:pandas

- 后端框架:Django

- 前端:Vue

- 数据库:MySQL

- 算法:K-means算法

- 开发工具:Pycharm

4、智能出行交通数据可视化分析系统 -功能介绍

1、数据管理:信息列表展示。

2、词云图:词云图。

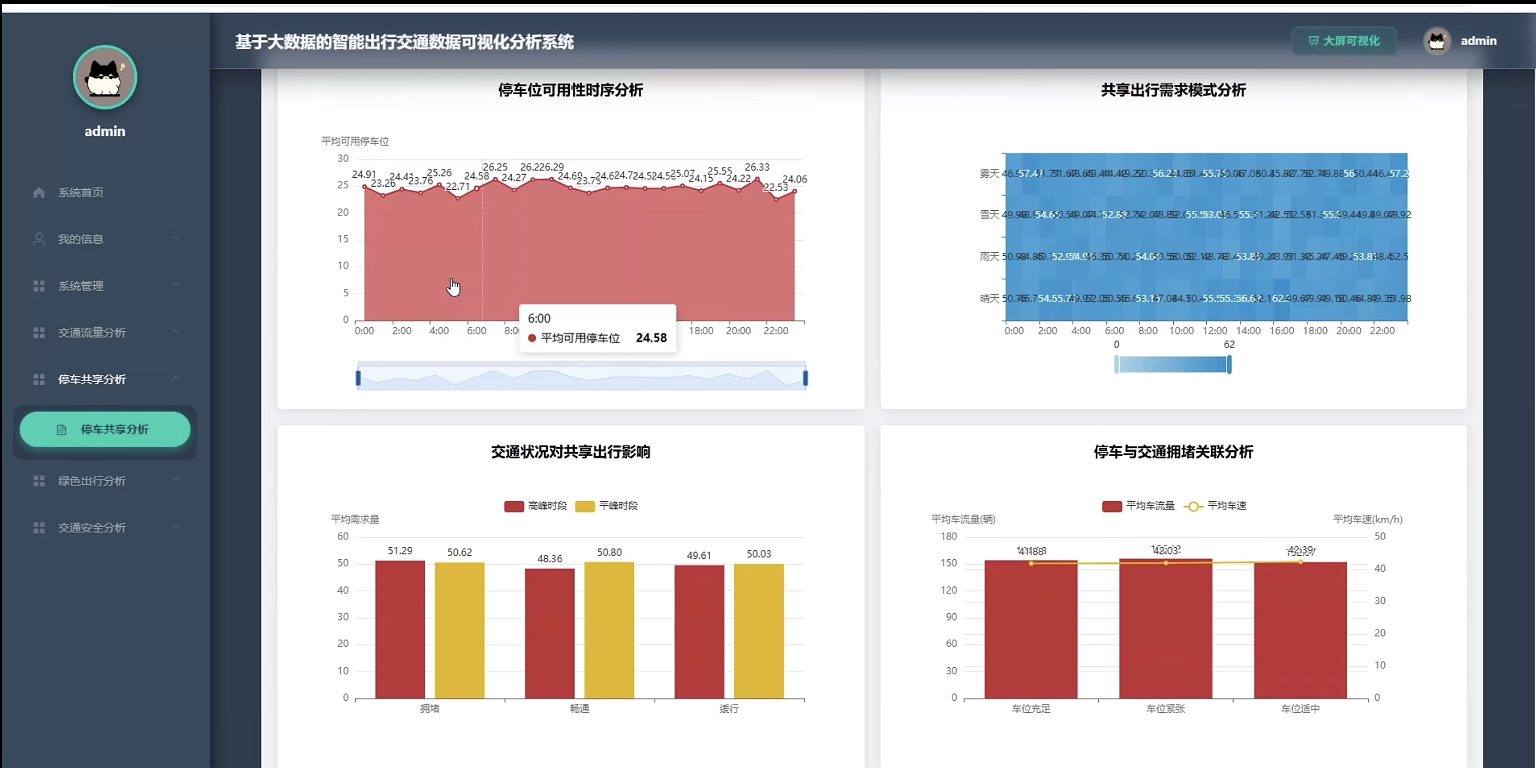

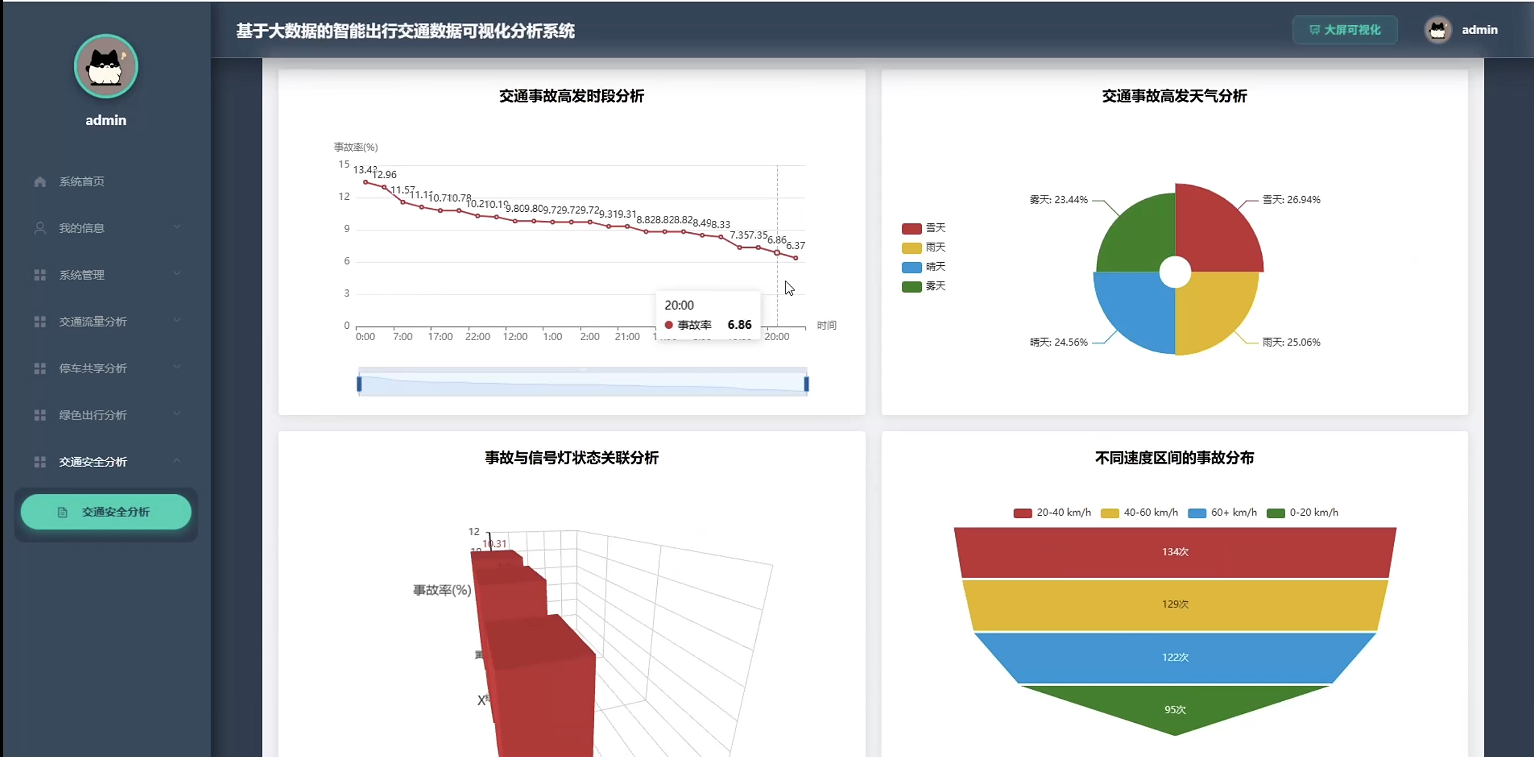

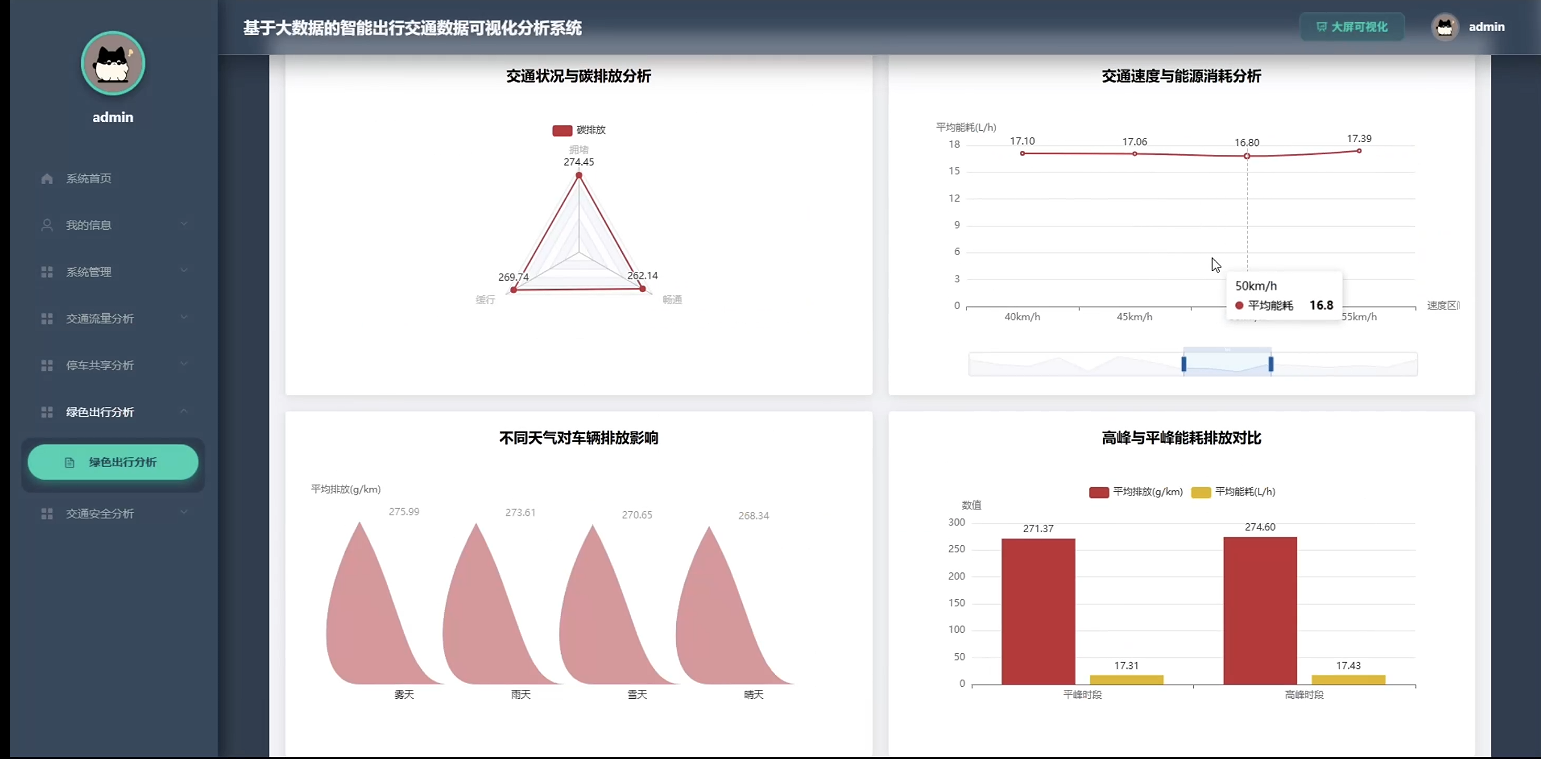

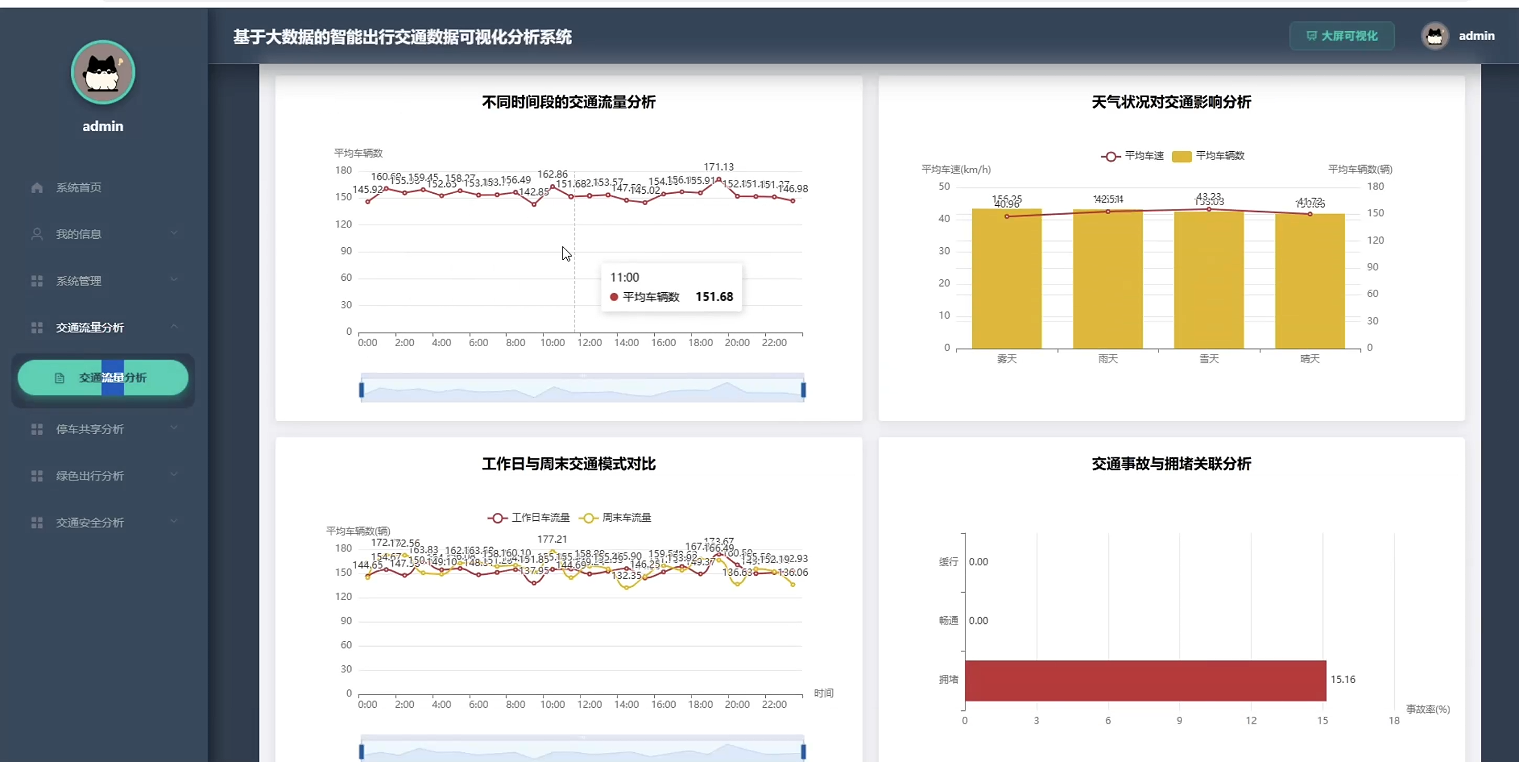

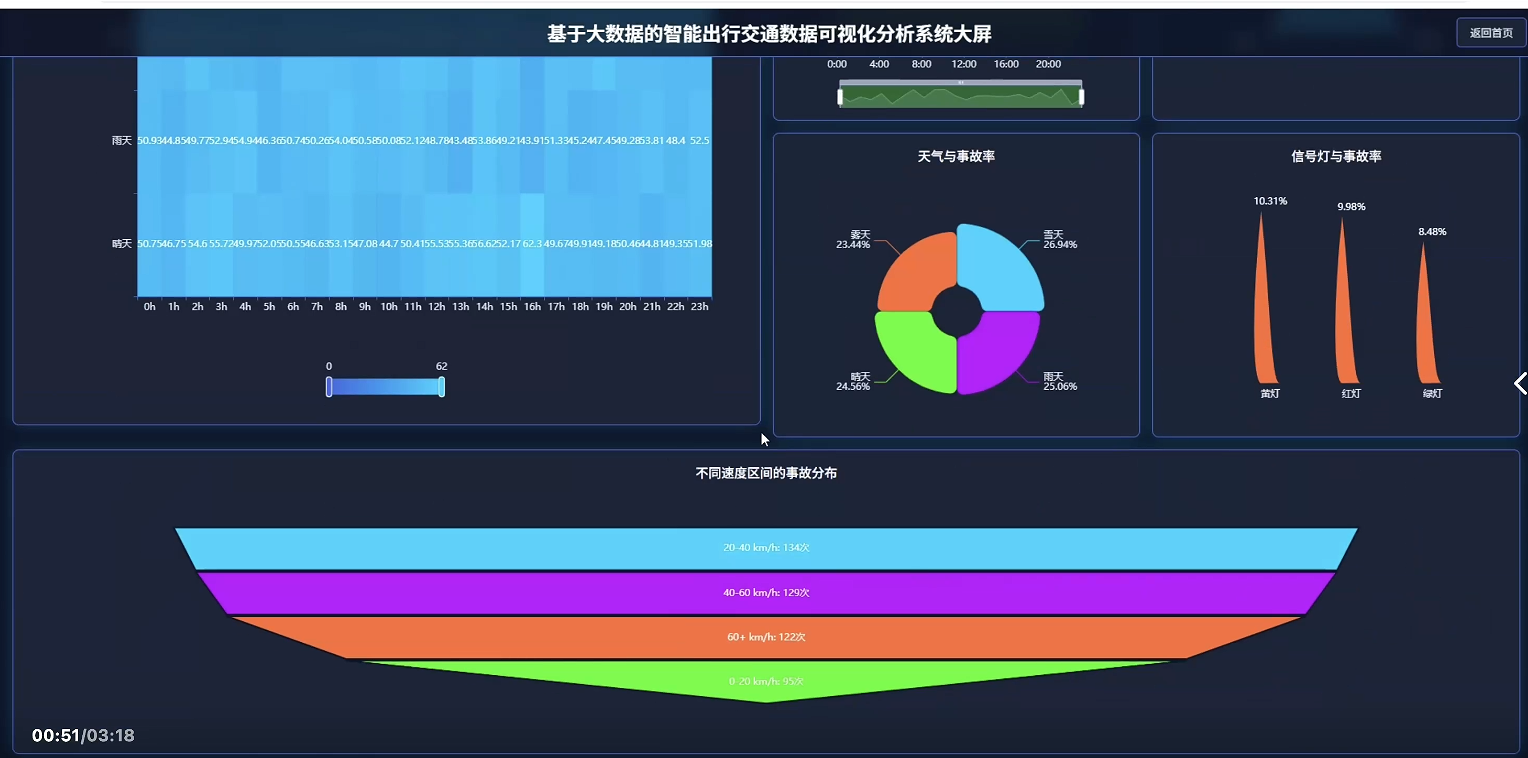

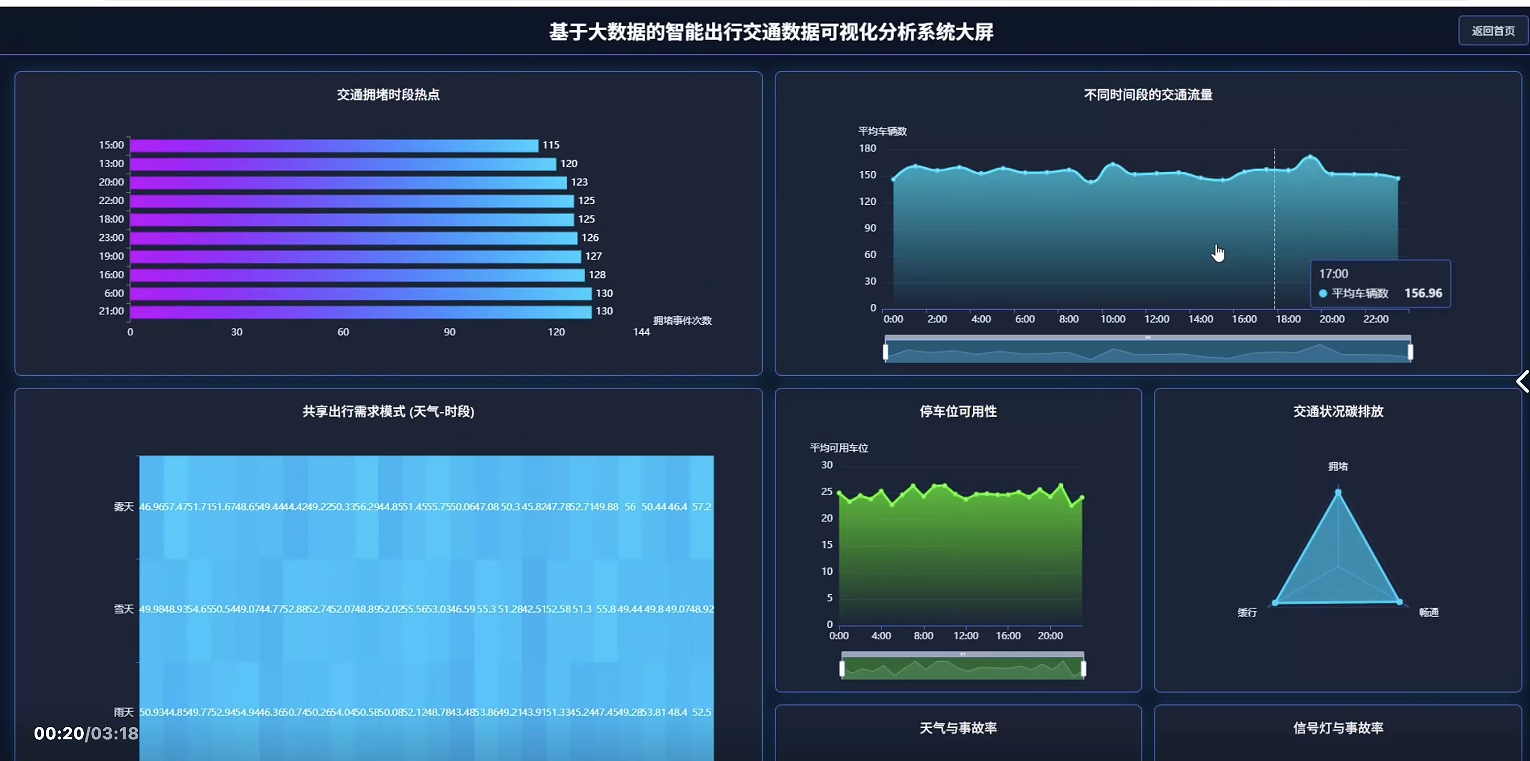

3、可视化分析:交通流量分析、停车共享分析、绿色出行分析、交通安全分析

4、系统管理:登录注册、个人信息修改。

5、智能出行交通数据可视化分析系统 -论文参考

6、智能出行交通数据可视化分析系统 -成果展示

6.1演示视频

23基于大数据的智能出行交通数据可视化分析系统_5k数据集

6.2演示图片

☀️首页☀️

☀️登录☀️

☀️可视化分析☀️

☀️大屏☀️

☀️XX数据管理☀️

7、代码展示

1.数据清洗【代码如下(示例):】

import pandas as pd

import numpy as np

# 读取数据

data = pd.read_csv('traffic_data.csv')

# 数据清洗函数

def clean_data(df):

# 删除重复数据

df.drop_duplicates(inplace=True)

# 处理缺失值:使用中位数填充数值型数据的缺失值

for column in df.select_dtypes(include=[np.number]).columns:

df[column].fillna(df[column].median(), inplace=True)

# 处理缺失值:使用众数填充分类数据的缺失值

for column in df.select_dtypes(include=[object]).columns:

df[column].fillna(df[column].mode()[0], inplace=True)

# 去除异常值:使用z-score方法去除异常值

from scipy import stats

numeric_cols = df.select_dtypes(include=[np.number]).columns

z_scores = np.abs(stats.zscore(df[numeric_cols]))

df = df[(z_scores < 3).all(axis=1)] # 去除 z-score 大于 3 的异常值

# 日期格式化

df['Date'] = pd.to_datetime(df['Date'], format='%Y-%m-%d')

# 标准化/归一化数据(如有需要)

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

df[numeric_cols] = scaler.fit_transform(df[numeric_cols])

# 极端值处理(如交通流量数据等)

df['Traffic'] = np.clip(df['Traffic'], 0, df['Traffic'].quantile(0.95)) # 限制交通流量

df['Price'] = np.clip(df['Price'], 0, df['Price'].quantile(0.95)) # 限制价格

# 将清洗后的数据类型转为适当的类型

df['Region'] = df['Region'].astype('category')

return df

# 调用清洗函数

cleaned_data = clean_data(data)

# 输出清洗后的数据前五行查看结果

print(cleaned_data.head())

# 保存清洗后的数据

cleaned_data.to_csv('cleaned_traffic_data.csv', index=False)

2.大数据处理【代码如下( 示例):】

from pyspark.sql import SparkSession

from pyspark.sql.functions import col, avg, max, min, sum, stddev_pop

from pyspark.sql.types import StructType, StructField, IntegerType, StringType, FloatType

import time

# 初始化 Spark 会话

spark = SparkSession.builder.appName("TrafficDataAnalysis").getOrCreate()

# 定义数据的 Schema

schema = StructType([

StructField("Region", StringType(), True),

StructField("Date", StringType(), True),

StructField("Traffic", FloatType(), True),

StructField("Price", FloatType(), True),

StructField("Temperature", FloatType(), True),

StructField("Rainfall", FloatType(), True)

])

# 加载数据

start_time = time.time()

data = spark.read.csv("traffic_data.csv", header=True, schema=schema)

# 显示数据基本信息

data.show(5)

# 数据清洗:去掉包含空值的行

cleaned_data = data.dropna()

# 异常值处理:剔除温度大于100度的记录

cleaned_data = cleaned_data.filter(col("Temperature") < 100)

# 计算区域的平均流量

average_traffic = cleaned_data.groupBy("Region").agg(avg("Traffic").alias("AverageTraffic"))

average_traffic.show()

# 计算交通流量的最大值和最小值

traffic_range = cleaned_data.agg(

max("Traffic").alias("MaxTraffic"),

min("Traffic").alias("MinTraffic")

)

traffic_range.show()

# 数据聚合:按日期计算各个地区的交通总量

daily_traffic = cleaned_data.groupBy("Date", "Region").agg(sum("Traffic").alias("TotalTraffic"))

daily_traffic.show()

# 使用 SQL 查询:查询交通流量大于1000的地区及其平均流量

cleaned_data.createOrReplaceTempView("traffic_data")

high_traffic_regions = spark.sql("""

SELECT Region, AVG(Traffic) as avg_traffic

FROM traffic_data

WHERE Traffic > 1000

GROUP BY Region

ORDER BY avg_traffic DESC

""")

high_traffic_regions.show()

# 计算每个地区交通流量的标准差,用于评估流量波动

traffic_stddev = cleaned_data.groupBy("Region").agg(

avg("Traffic").alias("AverageTraffic"),

stddev_pop("Traffic").alias("TrafficStdDev")

)

traffic_stddev.show()

# 结束时间

end_time = time.time()

print(f"Data processing time: {end_time - start_time} seconds")

# 保存处理后的数据

cleaned_data.write.csv("processed_traffic_data.csv", header=True)

8、结语(文末获取源码)

💕💕

Java精彩实战毕设项目案例

小程序精彩项目案例

Python大数据项目案例

💟💟如果大家有任何疑虑,或者对这个系统感兴趣,欢迎点赞收藏、留言交流啦!

💟💟欢迎在下方位置详细交流。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)