宇树G1开启“打工人”模式,Humanoid Everyday数据集重磅开源!

Humanoid Everyday 项目通过提供大规模、多样化的数据集和标准化的评测平台,为通用人形机器人研究奠定了坚实的基础。实验分析不仅揭示了现有模仿学习方法在处理高维、复杂人形机器人任务时的局限性,也证明了大规模、多样化的数据预训练是提升模型泛化能力的关键路径。面对当前机器人学习数据集主要集中于固定基座机械臂,而现有人形机器人数据集在任务多样性、环境复杂性及人机交互方面存在局限的现状,南加州

论文标题: Humanoid Everyday: A Comprehensive Robotic Dataset for Open-World Humanoid Manipulation

项目主页: https://humanoideveryday.github.io/

来源论文: https://arxiv.org/abs/2510.08807

一、核心思路与贡献

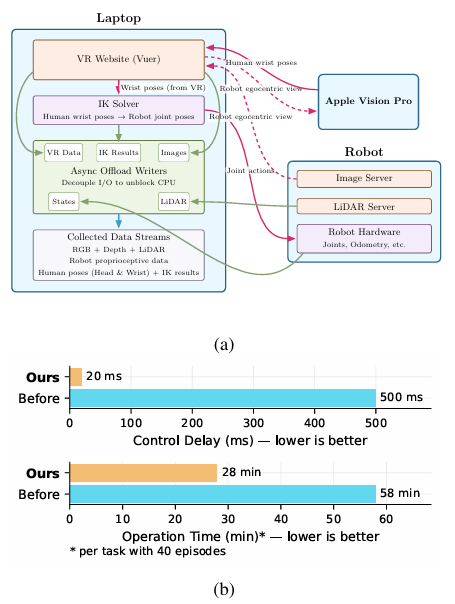

面对当前机器人学习数据集主要集中于固定基座机械臂,而现有人形机器人数据集在任务多样性、环境复杂性及人机交互方面存在局限的现状,南加州大学(USC)与丰田研究院(TRI)的研究团队提出了 Humanoid Everyday 项目。该项目旨在构建一个涵盖**“数据采集-策略训练-云端评测”**的完整闭环生态,为通用人形机器人操作研究提供一个大规模、多样化且标准化的实验平台。

核心贡献可归纳为三点:

- 大规模多模态数据集: 构建并发布了首个在多样化真实世界场景中采集的大规模多模态人形机器人操作数据集。

- 代表性策略分析: 对多种主流模仿学习策略在人形机器人任务中的表现进行了系统性评估与分析,揭示了它们在不同任务类别下的优势与局限。

- 标准化云端评测平台: 推出首个专为人形机器人设计的云端评估平台,使研究者能够在标准化的真实物理环境中远程部署和验证其算法策略,降低了研究门槛并确保了评估的公平性。

二、系统框架详解

Humanoid Everyday 的整体框架被设计为一个联动的三层系统,旨在打通从数据源到智能验证的完整链路。

1. 数据层 (Data Layer):高效、高保真的世界感知与数据采集

数据层是整个生态系统的基石,负责高质量地采集机器人在真实世界中的交互数据。

-

硬件平台: 采用两款宇树(Unitree)人形机器人——Unitree G1(配备三指灵巧手 Dex3-1)与 Unitree H1(配备 INSPIRE 灵巧手)。两款机器人均搭载了英特尔 RealSense RGB-D 相机和 Livox LiDAR 系统,其中 G1 的灵巧手还集成了触觉传感器,增强了数据的多模态性。

-

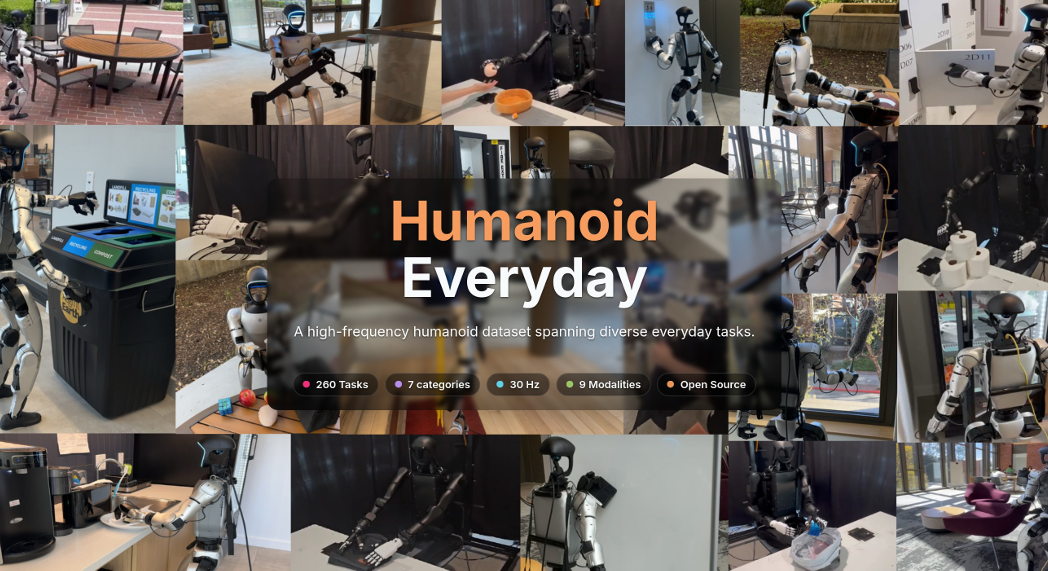

遥操作系统: 操作者佩戴 Apple Vision Pro 头显,利用其前置摄像头捕捉手腕姿态与手部指关节运动。手部动作通过

dex-retargeting系统映射至机器人灵巧手;手腕姿态则输入基于 Pinocchio 库 的逆运动学(IK)求解器,实现对机器人上身的全面控制。 -

数据采集架构创新: 针对官方遥操作方案中存在的延迟高、效率低的问题,团队重新设计了异步多进程遥操作管线 (Asynchronous Multi-processing Teleoperation Pipeline)。该架构将 I/O 数据流、逆运动学计算、机器人控制和数据写入等模块解耦至独立的进程或线程中,通过共享内存进行低延迟通信。这一优化使得系统:

- 控制延迟从 500ms 大幅降低至 20ms。

- 平均单任务采集效率提升一倍(40个回合的采集时间从58分钟缩短至28分钟)。

2. 策略层 (Policy Layer):模仿学习模型的横向评测

策略层负责利用采集到的数据训练和评估各类学习模型。团队选取了七种具有代表性的模仿学习算法进行基准测试,覆盖了当前主流的技术路线。

| 类别 | 模型名称 | 技术特点 |

|---|---|---|

| 扩散模型 (Diffusion) | Diffusion Policy (DP), 3D DP | 通过对动作序列进行扩散建模来生成连续的控制轨迹。 |

| Transformer 模型 | ACT | 将连续的动作序列分块(Chunking),并使用 Transformer 架构进行预测。 |

| 视觉-语言-动作 (VLA) 大模型 | OpenVLA, π⁰-FAST, π⁰.⁵, GR00T N1.5 | 统一建模视觉、语言和动作三模态信息,利用大规模预训练带来的先验知识提升泛化能力。 |

- 训练流程: 采用了两阶段微调 (Two-stage Finetuning) 策略。

- 阶段一(全局预训练): 在完整的 Humanoid Everyday 数据集上进行预训练,使模型掌握通用的感知与操作能力。

- 阶段二(任务级微调): 针对特定的下游任务(如折叠毛巾),使用该任务的数据对模型进行进一步微调。

3. 评测层 (Evaluation Layer):标准化、可复现的云端物理验证

为解决硬件依赖和评估标准不统一的问题,项目推出了一个云端评测平台,允许全球研究者在真实的机器人上验证算法。

- 工作流程:

- 研究者在本地部署其模型,并通过指定的 IP 和端口连接到云端评测服务器。

- 服务器将物理机器人(G1 或 H1)的实时传感器数据流(如 RGB 图像、深度信息、机器人状态)传输至客户端。

- 客户端模型在本地进行推理,并将生成的动作指令回传至服务器。

- 服务器在物理机器人上实时执行指令,同时将机器人的第一视角和第三方视角的画面反馈给研究者,并记录任务成功率等性能指标。

该平台可持续运行超过100分钟直至机器人电量耗尽,期间仅需极少的人工干预(如电机过热重启),展现了其高效和稳定性。

三、实验分析与结果

实验旨在评估不同模仿学习策略在复杂人形机器人任务中的泛化能力,并验证 Humanoid Everyday 数据集作为预训练先验知识的价值。

- 实验设置:

- 机器人平台: Unitree G1 & H1

- 控制频率: 30Hz

- 评测任务: 从七大类别中各选取一个代表性任务进行评估,每个任务重复10次试验。

1. 七大任务类别的挑战

数据集覆盖了从基础操作到复杂全身协调的七类任务,对模型的不同能力提出了挑战。

| 类别 | 任务代表 | 核心挑战 |

|---|---|---|

| 基础操作 | 将饺子玩具放入盘中 | 精准抓取、目标定位与路径规划 |

| 可形变物体操作 | 折叠毛巾 | 对柔性物体的理解与动态接触控制 |

| 关节物体操作 | 旋转椅子 | 力控制、多关节协调与姿态估计 |

| 工具使用 | 用橡皮擦擦拭桌面 | 工具与手部的协同、功能性理解 |

| 人机交互(HRI) | 向人类递送物体 | 人类意图识别、安全的物理交互 |

| 移动操作 | 走到门前并抓住门把手 | 全身协调、动态环境下的感知与导航 |

| 高精度操作 | 将玫瑰插入花瓶 | 精细的空间感知、微小动作控制 |

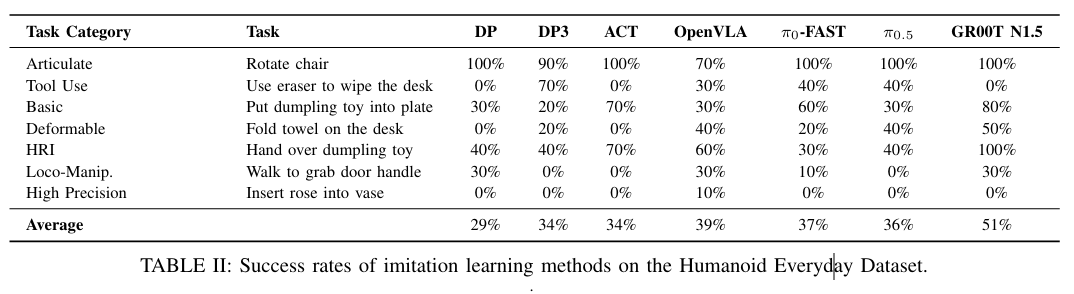

2. 整体性能对比

实验结果表明,在人形机器人这种高维(28自由度)动作空间下,所有端到端的模仿学习策略都面临巨大挑战。

| 模型 | 平均成功率 | 性能特点分析 |

|---|---|---|

| GR00T N1.5 | 51% | 表现最佳,其在多个人形数据集上的广泛预训练带来了强大的先验知识,泛化能力和稳定性最强。 |

| OpenVLA | 39% | 表现出一定的泛化能力,但在高频(30Hz)数据上生成的动作不平滑,需降采样至2Hz才能正常工作。 |

| π⁰-FAST | 37% | 采用 DCT 压缩动作,但高维动作压缩后 token 数量过多,易出现解码错误导致机器人卡顿。 |

| π⁰.⁵ | 36% | 生成的动作较为流畅,但倾向于过度拟合训练轨迹,对视觉反馈的适应性不足。 |

| ACT | 34% | 倾向于机械地复现训练轨迹,对视觉变化的适应能力较差,整体表现不佳。 |

| 3D Diffusion Policy (DP3) | 34% | 利用3D点云输入,在静态场景中表现出对环境变化的鲁棒性,但在移动操作任务中因点云剧变而性能下降。 |

| Diffusion Policy (DP) | 29% | 在应对环境扰动时稳定性较差,平均成功率最低。 |

3. 任务级成功率剖析

关键发现:

- 高精度任务的瓶颈: “将玫瑰插入花瓶”任务几乎所有模型均失败,暴露了当前模型在精细视觉空间感知和微操控制方面的严重不足。

- VLA模型的优势: 以 GR00T N1.5 为代表的 VLA 模型在需要泛化和理解任务逻辑的场景(如递送玩具、折叠毛巾)中表现出明显优势。

- 移动操作的挑战: “抓住门把手”这类移动操作任务对全身协调和实时感知要求极高,是所有模型的难点。

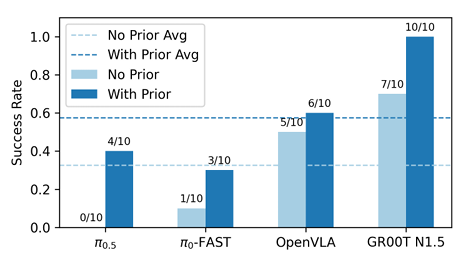

4. 消融实验:预训练的价值

为了验证 Humanoid Everyday 数据集的价值,研究团队对比了 VLA 模型在进行任务微调前是否经过 Humanoid Everyday 数据集预训练的性能差异。

结果表明,在 Humanoid Everyday 上进行预训练能够一致性地提升 VLA 模型在下游任务中的性能。这证明了该数据集能够为模型提供一种通用的具身先验知识 (Embodied Prior),从而增强其鲁棒性和稳定性。

四、结论与展望

Humanoid Everyday 项目通过提供大规模、多样化的数据集和标准化的评测平台,为通用人形机器人研究奠定了坚实的基础。实验分析不仅揭示了现有模仿学习方法在处理高维、复杂人形机器人任务时的局限性,也证明了大规模、多样化的数据预训练是提升模型泛化能力的关键路径。

尽管当前模型在部分高精度和移动操作任务上表现不佳,但该项目为未来开发更专门化、更鲁棒的人形机器人策略指明了方向,并有望成为推动该领域发展的“ImageNet”。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)