deepseek本地部署的详细步骤和方法?【图文详解】Windows部署本地大模型教程?个人电脑部署deepseek?

本文介绍了在本地电脑部署DeepSeek大模型的详细指南。针对用户常遇到的服务器繁忙问题,提供了完整的本地部署方案。首先说明硬件要求(建议16G内存+4G显存显卡)和软件准备(Ollama工具)。核心步骤包括:安装Ollama、下载DeepSeek模型、启动服务。还介绍了交互工具选择和性能优化技巧(GPU加速、内存管理)。最后强调按照流程操作即可成功部署,摆脱在线工具依赖。文末附有C盘清理建议,确

一、问题背景

咱想使用DeepSeek大模型的功能时,经常被「服务器繁忙,请稍后再试」搞得烦躁。故想着能不能在自己电脑部署一个DeepSeek 大模型,毕竟是免费开源的。

但一想到部署过程中可能会遇到的各种问题,就头大。先说说这些让人闹心的事儿 —— 首先是硬件门槛,要是电脑配置不够,要么装不上,要么装上了卡得要命,这不纯纯浪费时间嘛!

再说说安装过程,步骤又多又杂,一会儿要弄这软件,一会儿要配那环境,新手看了直接懵圈。而且就算勉强装好了,有时候功能还不正常,想聊个天、生成点内容都费劲。

更气人的是,官网下载模型时,网络老不稳定,下到一半断了,又得重新来,谁碰到这情况不崩溃啊?这些问题搁谁身上,都得愁得睡不着觉,真心希望有个简单的办法能解决!

二、解决方案

1、前期准备

在开始部署前,咱得先搞清楚电脑能不能扛得住,还有需要准备哪些软件,这就跟打仗前要摸清敌情一样重要。

-

硬件要求:

-

要是你就想简单试试,电脑有个 8G 内存、普通 CPU 就行;但要是想让模型跑快点、用得顺畅,那最好有 16G 以上内存,再配个 Nvidia 显卡(显存 4G 以上),这样体验才好。

-

-

软件要求:

-

得先装个 Windows 10 及以上系统,或者 Linux 系统也成。另外,还要准备好 Ollama 工具,这是部署模型的关键帮手,后面会说怎么装。

-

-

模型版本选择:

-

DeepSeek 有不同版本,比如 7B 参数版(普通版,适合普通电脑)、13B 参数版(高级版,需要配置好点的电脑),咱根据自己电脑配置选,别盲目选高版本,不然装不上就白忙活了。

-

2、核心步骤

这部分咱一步一步来,跟着做保准没错,千万别跳步骤哦!

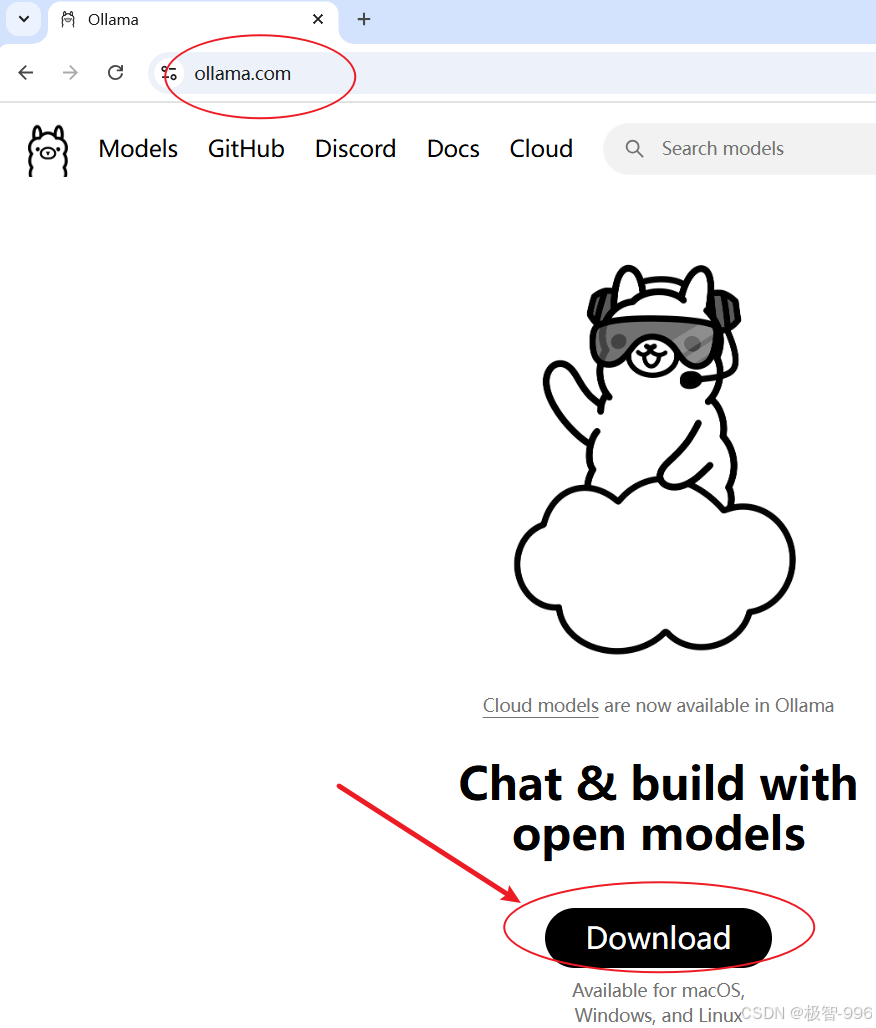

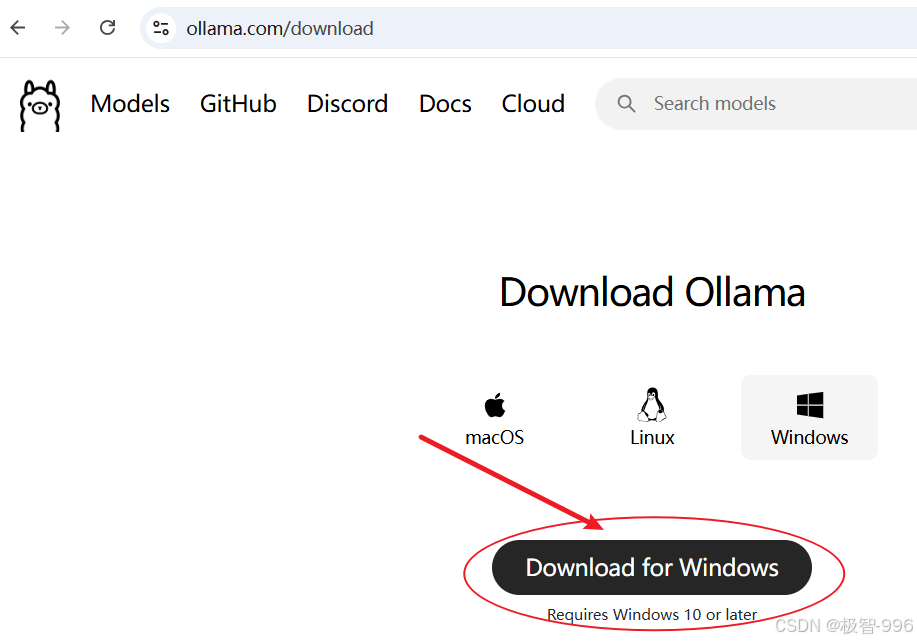

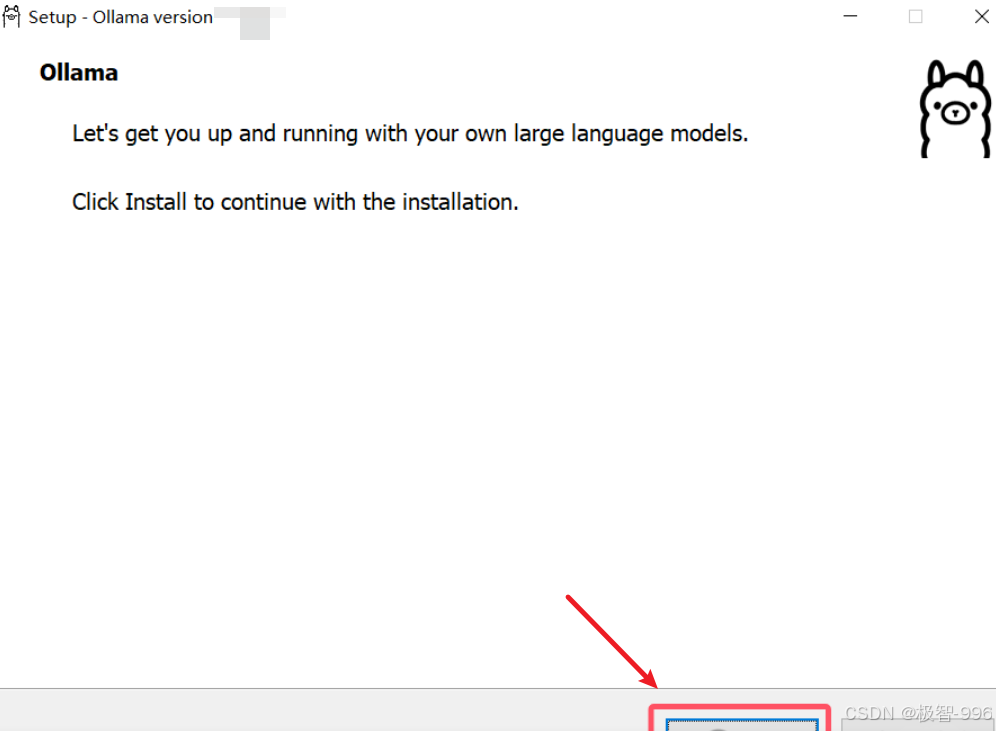

(1)安装 Ollama:基础工具先备好

-

第一步:打开浏览器,搜 “Ollama 官网”,找到官网后点击 “Download”,根据自己的系统(Windows 或 Linux)下载安装包,下载速度还挺快的,耐心等一会儿就好。

-

第二步:安装包下载好后,双击打开,跟着安装向导走,一路点 “下一步” 就行,不用额外设置啥复杂的,特别简单。

-

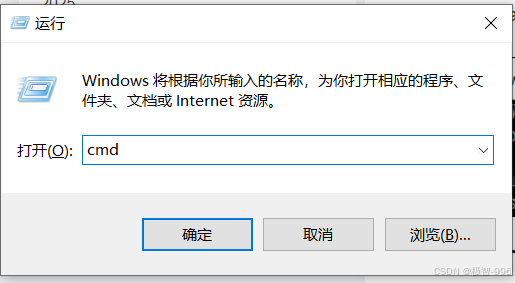

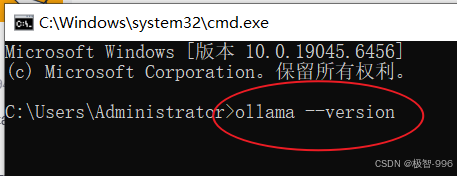

第三步:安装完成后,按 “Win+R” 打开运行窗口,输入 “cmd” 回车,打开命令提示符,然后输入 “ollama --version”,要是能显示版本号,就说明装成功了,是不是很 easy?

(2)下载 DeepSeek 模型:关键文件拿到手

-

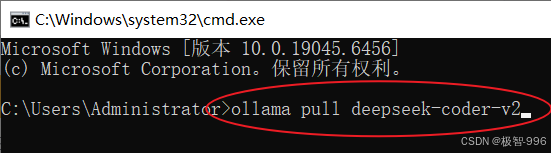

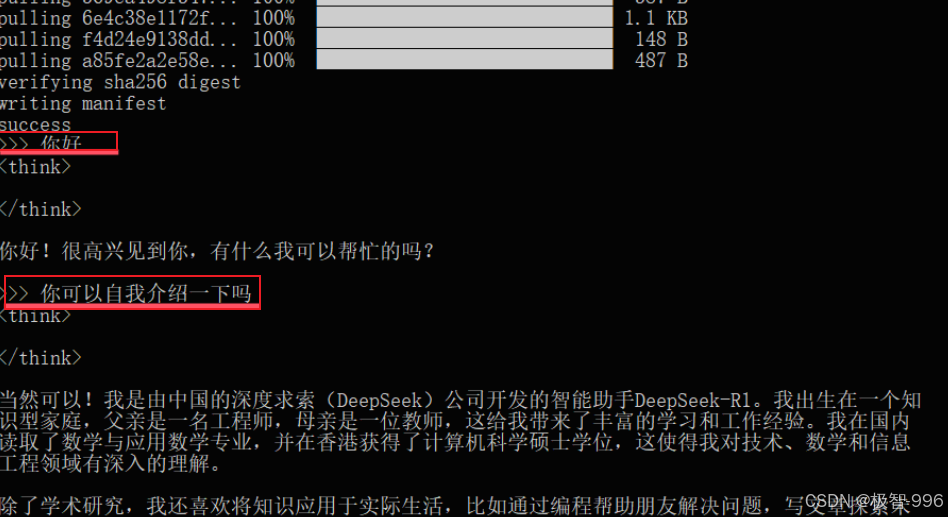

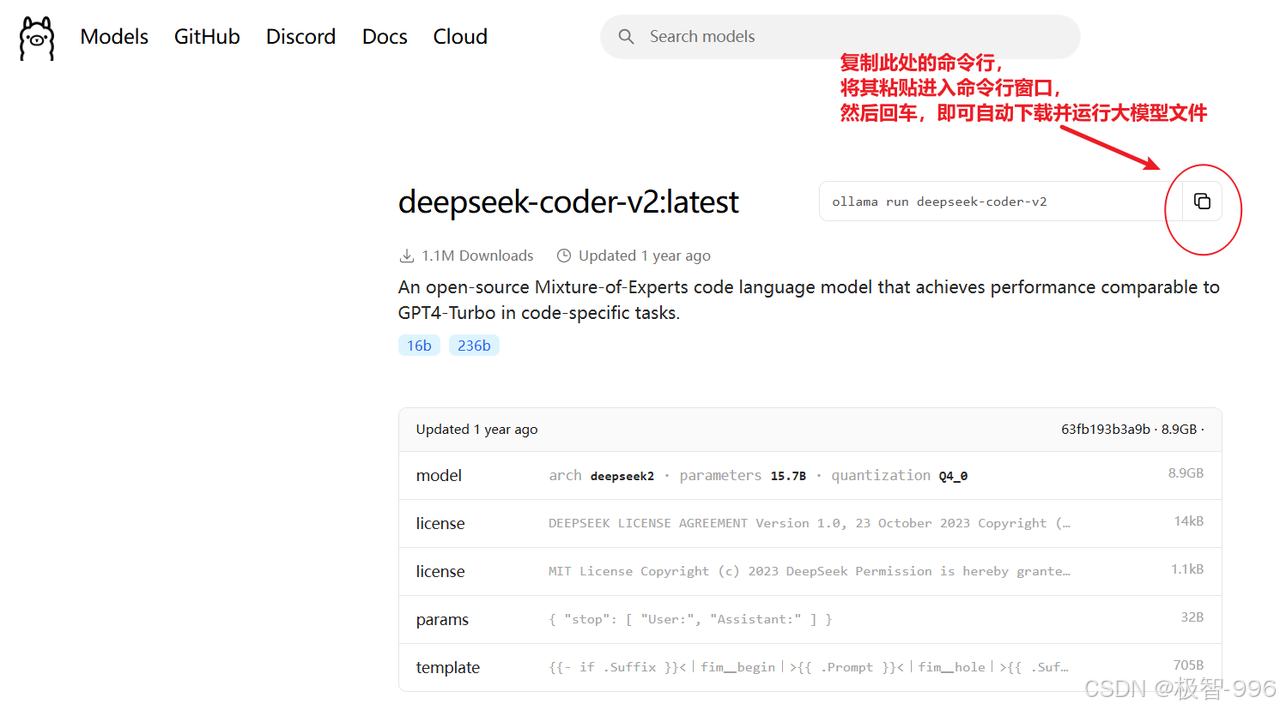

第一步:还是在命令提示符窗口,输入 “ollama pull deepseek-coder-v2”(这个是常用的模型版本,也可以换成你想装的其他版本),然后回车。

-

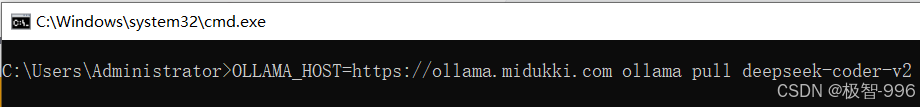

第二步:这时候就开始下载模型了,要是你觉得下载慢,也可以用国内镜像(比如输入 “OLLAMA_HOST=https://ollama.midukki.com ollama pull deepseek-coder-v2”),能快不少。下载的时候别关掉窗口,等着就行,要是看到 “success” 的提示,就说明下载好了。

(3)启动模型服务:让模型跑起来

-

第一步:在命令提示符窗口,输入 “ollama run deepseek-coder-v2”,回车后稍等片刻,模型就启动了。

-

第二步:启动后,你可以在窗口里输入问题试试,比如问 “怎么写一个简单的 Python 脚本”,模型会给你回复,这就说明服务正常运行啦!

温馨提示:

也可以在Ollama官网中,寻找大模型文件,并复制其安装运行的命令行。

3、交互与优化

(1)交互工具选择:选个自己喜欢的方式用

-

命令行交互:就是刚才在命令提示符窗口里和模型聊天,简单直接,适合喜欢简洁操作的人。

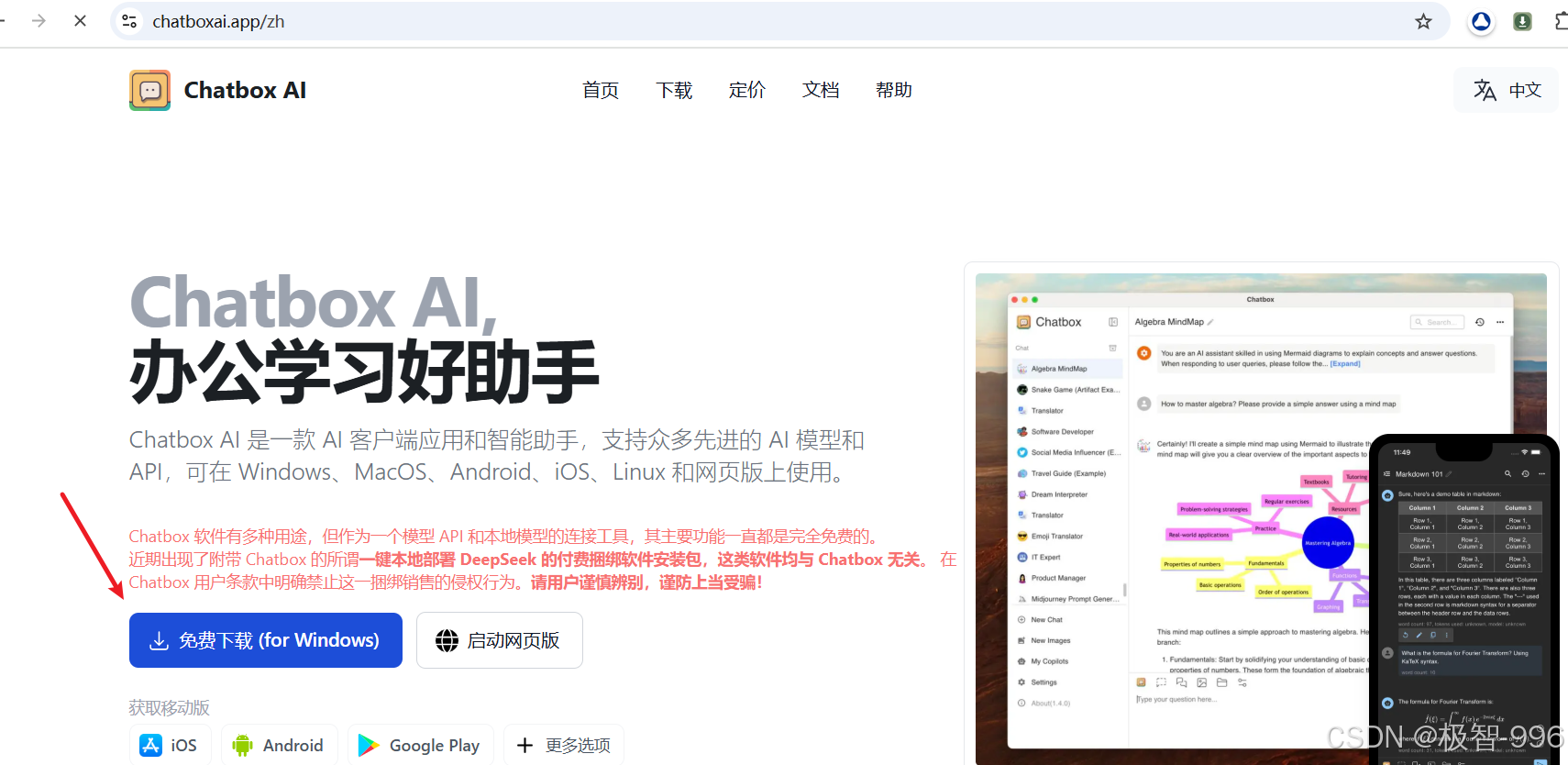

-

ChatBox 图形化客户端:搜 “ChatBox 官网” 下载安装,打开后选择 “Ollama”,再选 DeepSeek 模型,就能用鼠标点着和模型聊天了,界面很友好,新手也能很快上手。

温馨提示:

安装部署deepseek大模型过程中,会产生相关缓存垃圾,导致C盘空间不足,可以点击以下或者文章尾部的官网链接卡片,前往其官网并使用极智C盘清理软件的C盘瘦身功能来清理大模型垃圾缓存文件,保持电脑干净清爽。

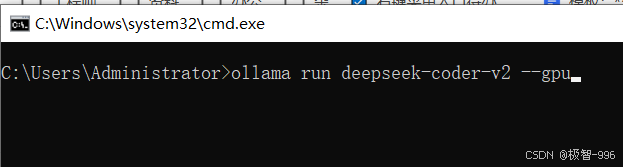

(2)进阶配置与优化:让模型跑得更快

-

GPU 加速:要是你有 Nvidia 显卡,先装个显卡驱动(官网能下),然后在命令提示符输入 “ollama run deepseek-coder-v2 --gpu”,这样模型就会用显卡跑,速度能快一倍不止,是不是很给力?

-

内存管理:要是电脑内存不够,在启动模型时输入 “ollama run deepseek-coder-v2 --memory 8g”(这里的 8g 可以换成你想分配的内存大小),能避免模型因为内存不够崩溃。

-

故障排查:要是启动模型时出错,先看看是不是 Ollama 没装好,再检查模型下载是不是完整,要是还不行,搜一下错误提示,一般都能找到解决办法,别慌!

三、总结

其实部署 DeepSeek 本地大模型,看着难,真跟着步骤做下来,也没那么吓人。

一开始可能会碰到硬件不够、安装出错这些问题,但只要做好前期准备,一步一步按流程来,再根据情况优化配置,很快就能让模型在自己电脑上跑起来。

等你成功部署后,不管是写代码、查资料,还是聊天互动,都特别方便,再也不用依赖在线工具了。赶紧试试吧,要是碰到问题,也可以跟大家分享,一起解决,相信你肯定能搞定!

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)