解决ollama下载deepseek模型进度条卡顿和回退问题

经过实际测试,在Windows环境下下载1.1G的模型耗时约2小时,而Linux服务器上则用了5小时。模型文件是分块下载的,当网络不稳定导致某块数据下载失败时,系统会丢弃未完整下载的数据块,导致已下载的进度需要重新计算,因此会出现百分比倒退的现象。在下载大型AI模型时,特别是使用ollama这类工具时,经常会遇到下载进度条卡住甚至回退的问题。最近我在下载1.5B参数的deepseek-r1模型时就

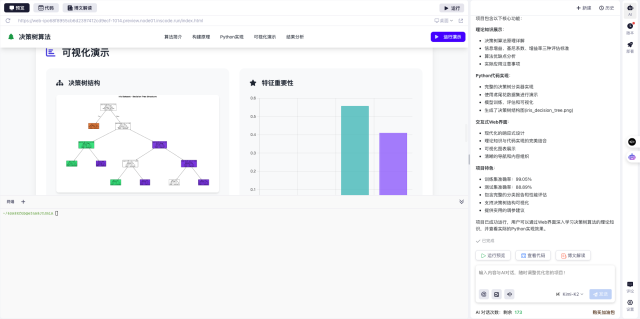

快速体验

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框输入如下内容

帮我开发一个AI模型下载监控工具,用于解决大模型下载过程中的进度异常问题。系统交互细节:1.实时显示下载进度和速度 2.自动检测网络状况 3.支持断点续传功能。注意事项:需兼容ollama等常见模型下载工具。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

在下载大型AI模型时,特别是使用ollama这类工具时,经常会遇到下载进度条卡住甚至回退的问题。最近我在下载1.5B参数的deepseek-r1模型时就遇到了这个困扰,分享一下我的解决经验。

-

问题现象分析 下载过程中最令人困惑的就是进度条异常表现:不仅长时间停滞,还会出现百分比倒退的情况。经过实际测试,在Windows环境下下载1.1G的模型耗时约2小时,而Linux服务器上则用了5小时。这种现象主要源于两个核心原因:本地网络状况不佳和官方下载源服务器响应缓慢。

-

进度回退的底层原理 这种看似异常的进度回退其实有其技术合理性。模型文件是分块下载的,当网络不稳定导致某块数据下载失败时,系统会丢弃未完整下载的数据块,导致已下载的进度需要重新计算,因此会出现百分比倒退的现象。这类似于BT下载中的分块校验机制。

-

实用解决方案 根据我的实际体验,推荐以下解决方法:

-

耐心等待法:选择网络使用低谷时段(如夜间)启动下载,让系统自动完成整个过程。虽然耗时较长,但最终能成功。

- 网络优化方案:改善本地网络环境或使用网络加速工具,但需注意遵守相关网络使用规定。

-

分时段下载:遇到进度停滞时,可以暂停后过段时间重新开始,利用ollama的断点续传功能。

-

平台环境差异 值得注意的是,不同操作系统环境下下载速度可能存在显著差异。在相同网络条件下,Windows系统往往比Linux服务器表现更好,这可能与系统底层的网络栈实现和资源调度机制有关。

-

社区经验参考 这个问题在开发者社区中相当普遍,百度贴吧等论坛上有大量相关讨论。建议遇到问题时先搜索社区经验,往往能找到针对特定模型的优化下载方案。

在实际使用InsCode(快马)平台时,我发现它的云端环境可以有效规避这类下载问题。平台内置的AI模型可以直接调用,省去了本地下载的麻烦,特别适合快速验证模型效果。对于需要长期运行的模型服务,还能一键部署为在线API,大大提升了开发效率。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)