在Windows系统编译llama-cpp-python

本文分享了在Windows系统下编译安装Llama-cpp-python库的经验。作者详细介绍了从Ubuntu迁移到Windows时遇到的编译问题,指出相比Pytorch,Llama-cpp-python的安装更为复杂。文中提供了具体的操作步骤:安装Visual Studio的C++开发组件、配置CUDA环境变量、使用VS命令提示窗设置编译参数并安装。文章还特别提到Windows下的编译效率问题,

近日笔者在将VLM_Live项目从Ubuntu平台迁移到Windows平台的时,遇到了Llama-cpp-python库编译的麻烦。

众所周知,直接使用pip指令安装深度学习库的时,在大部分情况下是无法获得GPU(CUDA/Rocm/NPU等)的支持的,纵使Pytorch,也需要在pytorch.org上复制对应架构的安装指令。

相较Pytorch而言,Llama-cpp-python的安装更显繁琐。在Linux平台上,我们可以通过系统自带的GCC等编译工具,轻松编译具有CUDA支持的llama-cpp-python并进行安装,但是在Windows系统上,我们还需要做出更多的努力。

在进行正式的教程前,先介绍一下笔者的环境:

System: Win11 24H2

GPU: RTX 4060 Laptop

Driver Version: 581.29

CUDA Version: 13.0下面是有关在Windows系统上进行Llama.cpp库的编译和安装的说明:

1.安装适用于 Windows 的 Visual Studio

适用于 Windows 的 Visual Studio C/C++ IDE 和编译器

对于我们的需求,我们无需安装完整的开发套件,只需要安装 使用 C++ 的桌面开发即可。

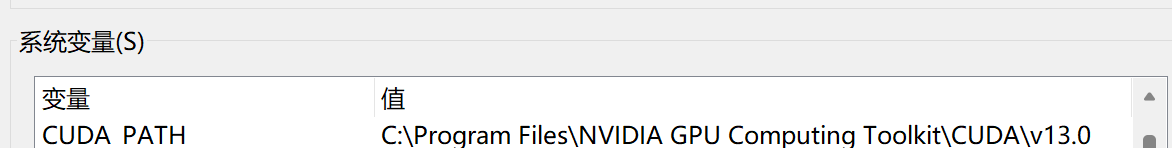

2.确认CUDA环境变量配置正常

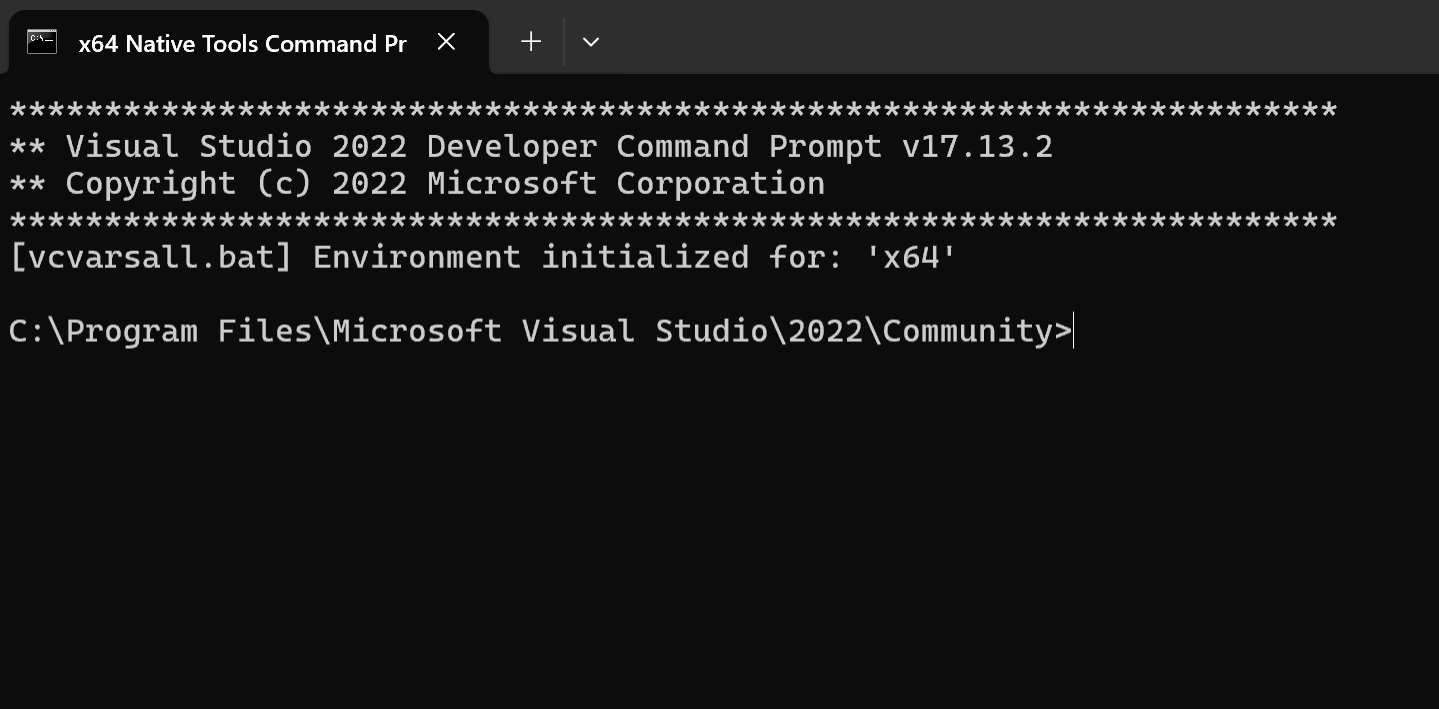

3.打开visual studio的命令提示窗,并开始安装

在开始菜单搜索并打开x64 Native Tools Command Prompt for VS 2022(或2026)

(如果需要在虚拟环境中安装,请先激活你的虚拟环境)

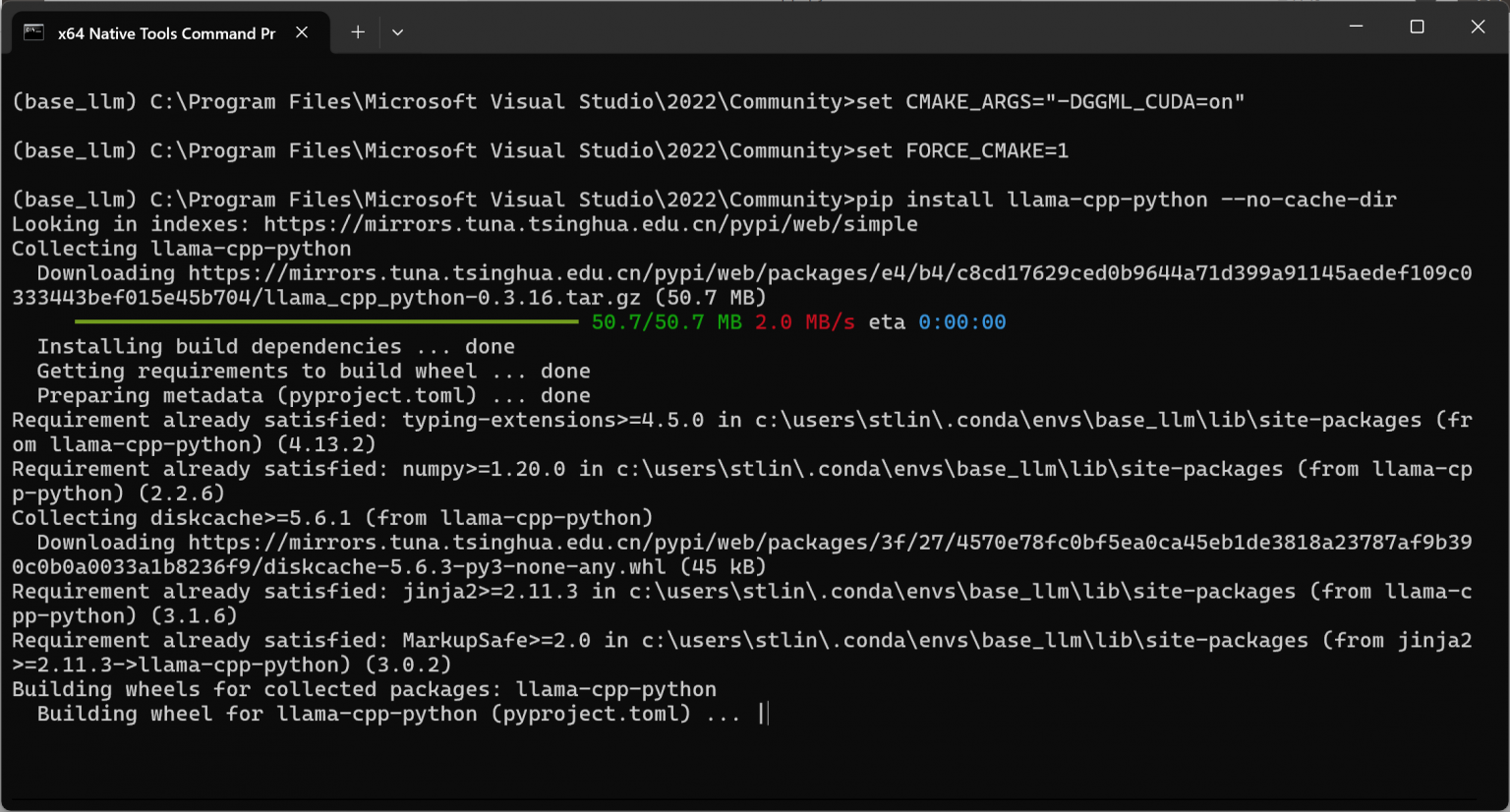

设置环境变量(强制编译并启用CUDA),并使用pip安装

set CMAKE_ARGS="-DGGML_CUDA=on"

set FORCE_CMAKE=1

pip install llama-cpp-python --no-cache-dir

等待编译成功并安装完成即可。

注:笔者在Ubuntu编译代码时,可以完整吃满16个线程,但是不知道为什么,在Windows系统下,CPU占用率只能到12%,导致编译时间很长(二十多分钟)

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)