基于Python+爬虫的在线教育平台学习数据可视化分析系统的设计与实现

本文介绍了基于Python+爬虫的在线教育平台学习数据可视化分析系统的设计与实现。系统采用Scrapy框架进行数据采集,结合Hadoop和Spark处理海量数据,使用ECharts实现数据可视化展示。系统包含管理员、用户和教师三种角色,提供课程管理、学习进度跟踪、社区互动等功能。前端采用Vue.js开发,后端使用Django框架,数据库采用MySQL,并运用协同过滤算法实现个性化推荐。该系统通过分

前言

🌞博主介绍:✌CSDN特邀作者、全栈领域优质创作者、10年IT从业经验、码云/掘金/知乎/B站/华为云/阿里云等平台优质作者、专注于Java、小程序/APP、python、大数据等技术领域和毕业项目实战,以及程序定制化开发、文档编写、答疑辅导等。✌🌞

👇🏻 精彩专栏 推荐订阅👇🏻

2025-2026年最值得选的微信小程序毕业设计选题大全:200个热门选题推荐✅2025-2026年最值得选的计算机毕业设计选题大全:500个热门选题推荐✅

微信小程序项目精品案例《200套》

🌞文末获取源码+数据库+文档🌞

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助更多的人

系统功能设计

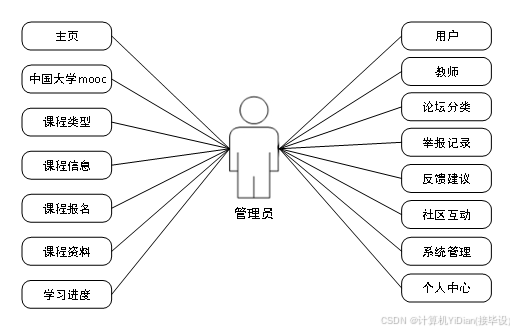

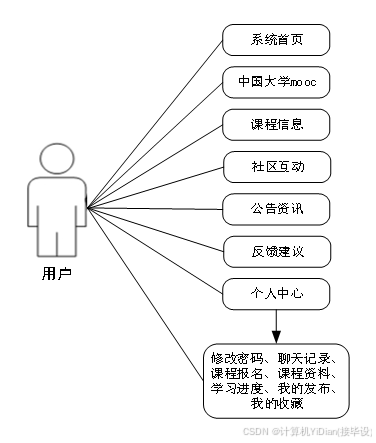

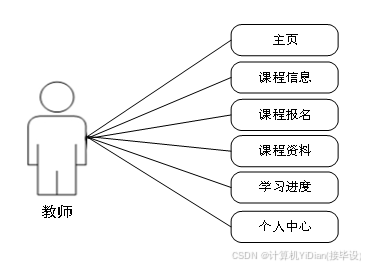

系统包括管理员、用户以及教师三种角色。

(1)管理员用例图如图所示;

(2) 用户用例图如图所示:

(3) 教师用例图如图3.2所示:

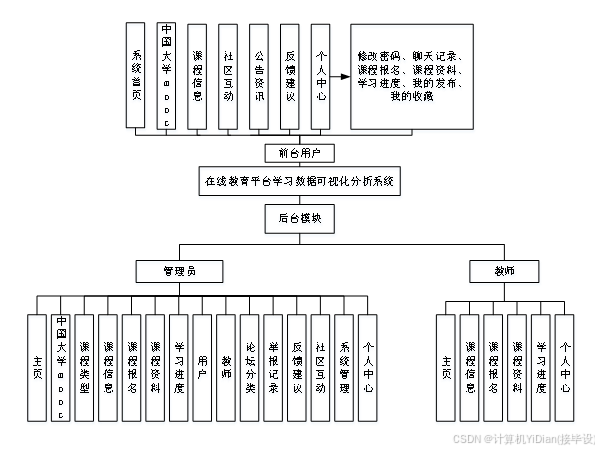

系统功能结构图是系统设计阶段,系统功能结构图只是这个阶段一个基础,整个系统的架构决定了系统的整体模式,是系统的根据。在线教育平台学习数据可视化分析系统的整个设计结构如图所示。

详细视频演示

❤文末卡片,滴滴我获取更详细的演示视频

系统实现效果

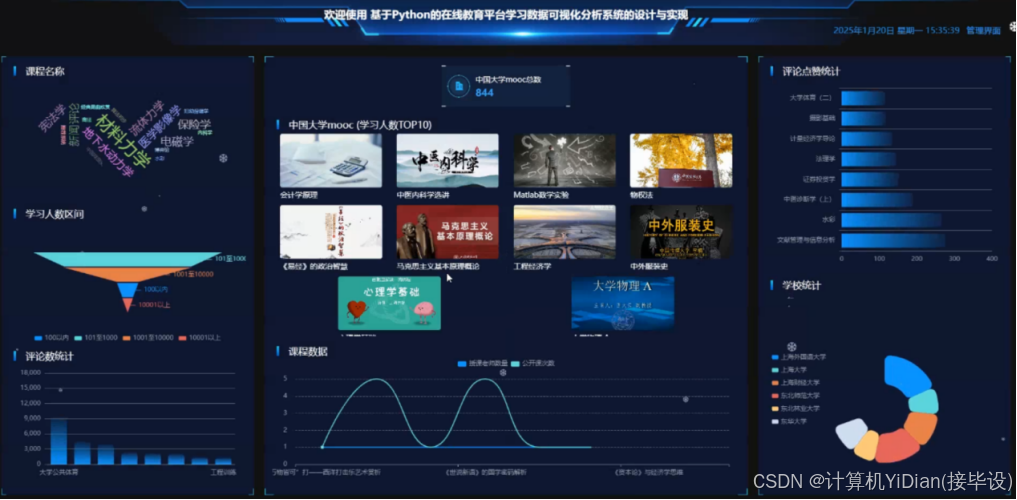

数据可视化分析看板展示

在线教育平台学习数据可视化分析系统基本情况分析看板展示,如图所示。

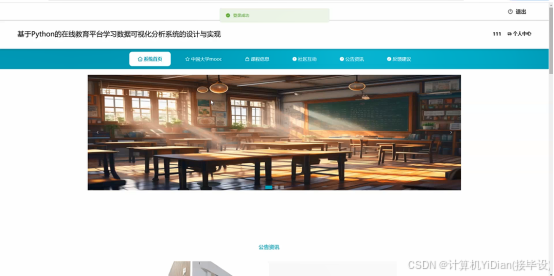

系统前台实现效果

当用户打开系统的网址后,首先看到的就是首页界面。在这里,用户能够看到在线教育平台学习数据可视化分析系统的导航栏显示系统首页、中国大学mooc、课程信息、社区互动、公告资讯、反馈建议、个人中心。系统首页界面如图所示:

在登录流程中,用户首先在Vue前端界面输入账号和密码。这些信息通过HTTP请求发送到Python后端。后端接收请求,通过与MySQL数据库交互验证用户凭证。如果认证成功,后端会返回给前端,允许用户访问系统。这个过程涵盖了从律师输入到系统验证和响应的全过程。如图所示:

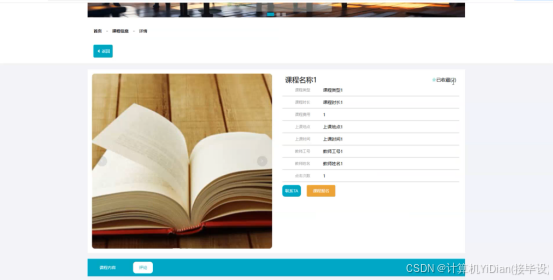

用户点击课程信息,在课程信息页面的查询栏输入课程名称、课程类型、上课地点等,进行查询,然后可以查看课程类型、课程时长、课程费用、上课地点、上课时间、教师工号、教师姓名、点击次数等信息;如需要还可以联系TA、课程报名及收藏等操作,如图所示:

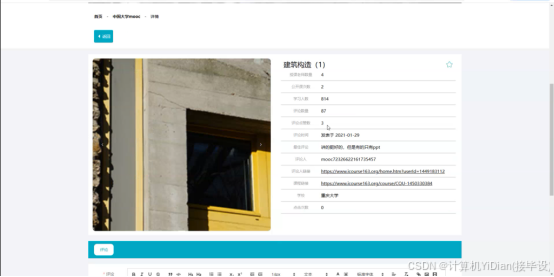

用户点击中国大学mooc,在中国大学mooc页面的查询栏输入课程名称、授课老师数量、公开课次数、学校等,进行查询,然后可以查看授课老师数量、公开课次数、学习人数、评论数量、评论点赞数、评论时间、最佳评论、评论人、评论人链接、课程链接、学校、点击次数等信息;如需要还可以点击链接查看及收藏等操作,如图所示:

在个人中心页面可以输入用户账号、用户姓名、性别、手机、头像更新信息操作,还可以对修改密码、聊天记录、课程报名、课程信息、学习进度、我的发布进行详细操作,如图所示:

系统后台管理实现效果

管理员通过登录页面填写账号、密码和角色,完成后进行登录,如图所示。

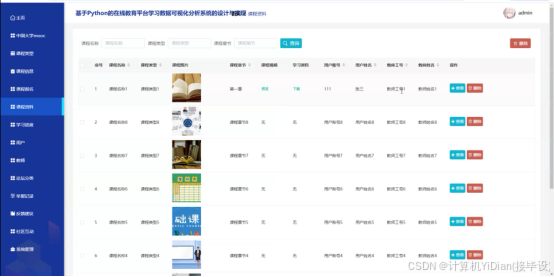

管理员登录进入在线教育平台学习数据可视化分析系统可以查看主页、中国大学mooc、课程类型、课程信息、课程报名、课程资料、学习进度、用户、教师、论坛分类、举报记录、反馈建议、社区互动、系统管理、个人中心等功能,进行详细操作,如图所示。

管理员点击课程信息;在课程信息页面通过对课程名称、 课程类型、 课程时长、 课程费用、 上课地点、上课时间、课程图片、教师工号、 教师姓名、点击次数、评论数、收藏数等信息,进行查看、修改、查看评论或删除等操作;如图所示。

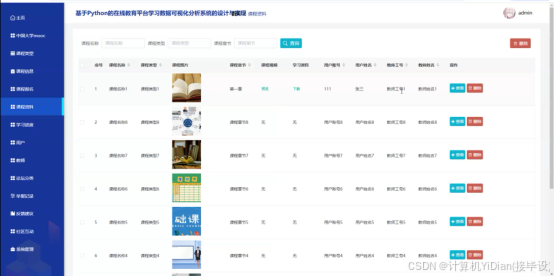

管理员点击课程报名;在课课程报名页面通过对课程名称、课程类型、课程图片、课程费用、上课地点、上课时间、报名备注、教师工号、 教师姓名、用户账号、用户姓名、是否支付等信息,进行查看或删除等操作;如图所示。

管理员点击课程资料;在课程资料页面通过对课程名称、课程类型、课程图片、课程章节、 课程视频、学习资料、用户账号、用户姓名、教师工号、教师姓名等信息,进行查看或删除等操作;如图所示。

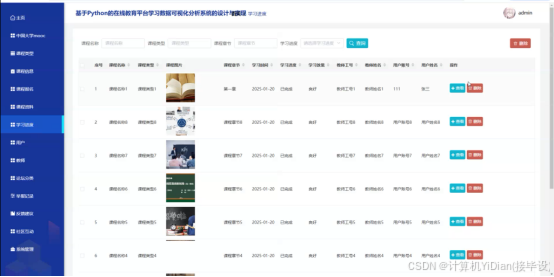

管理员点击学习进度;在学习进度页面通过对课程名称、课程类型、课程图片、课程章节、 学习时问、学习进度、学习效果、 教师工号、教师姓名、用户账号、用户姓名等信息,进行查看或删除等操作;如图所示。

教师登录到系统主页面,主要功能包括对主页、课程信息、课程报名、课程资料、学习进度、个人中心等进行操作。教师主页面如图所示:

技术栈

本系统框架使用Scrapy.

系统设计支持以下技术栈

前端开发框架:vue.js

数据库: mysql 版本不限

后端语言框架 :python(django)–pycharm/vscode

数据库工具:Navicat/SQLyog等都可以

数据可视化技术:Echart

大数据框架:Hadoop

Scrapy是一个Python编写的强大,灵活的网络爬虫框架和数据提取工具。它使用异步I/O网络库Twisted进行高效的爬取,并将提取到的数据存储到多种格式中。然而,在需要大规模爬取复杂的网站时,单机爬虫速度会受到限制。为了解决这个问题,Scrapy提供了分布式爬虫系统

#协同过滤算法

协同过滤推荐技术一般采用最近邻技术,利用用户的历史喜好信息计算用户之间的距离,然后 利用目标用户的最近邻居用户对商品评价的加权评价值来预测目标用户对特定商品的喜好程度,系统从而根据这一喜好程度来对目标用户进行推荐。基于协同过滤的推荐系统可以说是从用户的角度来进行相应推荐的,而且是自动的即用户获得的推荐是系统从购买模式或浏览行为等隐式获得的,不需要用户努力地找到适合自己兴趣的推荐信息。

关键技术和使用的工具环境等的说明

MySQL是一种关系型数据库管理系统,是大部分程序员接触的第一款关系型数据库。它相对于其他数据库来说相当轻量级,而且更加灵活。在大量的web工程中,经常作为首选的数据库,因为其开源免费的特点被大量的开发人员所使用。而且在大数据背景下,其海量的集群更为web的高并发提供了良好的后盾。

虽然Spark同样是大数据的框架和计算模型,但其实它与hadoop是相辅相成的,而且可以灵活的部署在hadoop之上,共享hadoop的文件系统。并且在数据处理上更为高效和方便、灵活。在数据量越来越庞大的现在,基于内存的spark可以很快的得到处理的结果,甚至现在已经可以支持近实时的数据处理。使得大数据的价值更加凸显。

Hadoop是由Apache基金会开源的分布式的大数据基础系统。

用户可以在不知道分布式基础设施的细节的情况下开发分布式程序。可以利用无数台节点集群进行高速计算和文件的多副本容错存储。

ECharts是百度开源的一个数据可视化框架,是web端的js框架,可以很方便的进行搭建数据可视化前端界面。官网的文档尤其简洁,极易上手开发,使得海量数据处理完成后,可以方便高效快速的进行可视化处理,直接作用于决策。使得数据的价值得到了直观的展示和提升。目前支持多种图形的绘制。

解决的思路

该系统架构主要依托scrapy框架进行架构,后台采用python动态网页语言编写,使用scrapy框架技术从网站上爬取数据,采用java/python/php/nodejs部署系统环境,使用pyhcarm作为系统的开发平台,在数据库设计和管理上使用MySQL。在人机交互的过程中,客户端不直接与数据库交互,而是通过组件与中间层建立连接,再由中间层与数据库交互。通过设计良好的框架可以减轻重新建立解决复杂问题方案的负担和精力,并且它可以被扩展以进行内部的定制化,有强大的用户社区来支持它,所以框架通常能很好的解决一个问题。

爬虫核心代码展示

import scrapy

import pymysql

import pymssql

from ..items import xiangmuItem

import time

import re

import random

import platform

import json

import os

from urllib.parse import urlparse

import requests

import emoji

class xiangmuSpider(scrapy.Spider):

name = 'xiangmuSpider'

spiderUrl = 'https://url网址'

start_urls = spiderUrl.split(";")

protocol = ''

hostname = ''

def __init__(self, *args, **kwargs):

super().__init__(*args, **kwargs)

# 列表解析

def parse(self, response):

_url = urlparse(self.spiderUrl)

self.protocol = _url.scheme

self.hostname = _url.netloc

plat = platform.system().lower()

if plat == 'windows_bak':

pass

elif plat == 'linux' or plat == 'windows':

connect = self.db_connect()

cursor = connect.cursor()

if self.table_exists(cursor, 'xiangmu') == 1:

cursor.close()

connect.close()

self.temp_data()

return

list = response.css('ul.subject-list li.subject-item')

for item in list:

fields = xiangmuItem()

fields["laiyuan"] = self.remove_html(item.css('div.pic a.nbg::attr(href)').extract_first())

if fields["laiyuan"].startswith('//'):

fields["laiyuan"] = self.protocol + ':' + fields["laiyuan"]

elif fields["laiyuan"].startswith('/'):

fields["laiyuan"] = self.protocol + '://' + self.hostname + fields["laiyuan"]

fields["fengmian"] = self.remove_html(item.css('div.pic a.nbg img::attr(src)').extract_first())

fields["xiaoshuoming"] = self.remove_html(item.css('div.info h2 a::attr(title)').extract_first())

detailUrlRule = item.css('div.pic a.nbg::attr(href)').extract_first()

if self.protocol in detailUrlRule:

pass

elif detailUrlRule.startswith('//'):

detailUrlRule = self.protocol + ':' + detailUrlRule

else:

detailUrlRule = self.protocol + '://' + self.hostname + detailUrlRule

fields["laiyuan"] = detailUrlRule

yield scrapy.Request(url=detailUrlRule, meta={'fields': fields}, callback=self.detail_parse)

# 详情解析

def detail_parse(self, response):

fields = response.meta['fields']

try:

if '(.*?)' in '''div#info span a::text''':

fields["zuozhe"] = re.findall(r'''div#info span a::text''', response.text, re.S)[0].strip()

else:

if 'zuozhe' != 'xiangqing' and 'zuozhe' != 'detail' and 'zuozhe' != 'pinglun' and 'zuozhe' != 'zuofa':

fields["zuozhe"] = self.remove_html(response.css('''div#info span a::text''').extract_first())

else:

fields["zuozhe"] = emoji.demojize(response.css('''div#info span a::text''').extract_first())

except:

pass

# 去除多余html标签

def remove_html(self, html):

if html == None:

return ''

pattern = re.compile(r'<[^>]+>', re.S)

return pattern.sub('', html).strip()

# 数据库连接

def db_connect(self):

type = self.settings.get('TYPE', 'mysql')

host = self.settings.get('HOST', 'localhost')

port = int(self.settings.get('PORT', 3306))

user = self.settings.get('USER', 'root')

password = self.settings.get('PASSWORD', '123456')

try:

database = self.databaseName

except:

database = self.settings.get('DATABASE', '')

if type == 'mysql':

connect = pymysql.connect(host=host, port=port, db=database, user=user, passwd=password, charset='utf8')

else:

connect = pymssql.connect(host=host, user=user, password=password, database=database)

return connect

# 断表是否存在

def table_exists(self, cursor, table_name):

cursor.execute("show tables;")

tables = [cursor.fetchall()]

table_list = re.findall('(\'.*?\')',str(tables))

table_list = [re.sub("'",'',each) for each in table_list]

if table_name in table_list:

return 1

else:

return 0

为什么选择我们

海量实战案例

所有实战项目源码均为博主收集和开发,亲测可用,质量保障,大家可以放心使用,当然也可根据需求定制开发。

自己的公众号(一点毕设)

源码及文档获取

需要成品或者定做开发,文章下方名片联系我即可~

大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

精彩专栏推荐订阅:在下方专栏👇🏻

Java精品实战案例《200套》

微信小程序项目精品实战案例《200套》

Python项目精品实战案例《200套》

大数据项目精品实战案例《200套》

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)