Matlab实现ReliefF多分类特征选择算法项目

在ReliefF中,邻近样本包括“近邻正例”(同类样本)和“近邻负例”(异类样本)。为了找到这些样本,通常使用欧氏距离作为度量标准,结合KNN算法进行查找。mermaid流程图:graph TDA[开始遍历样本] --> B[随机选择样本]B --> C[计算样本到所有其他样本的距离]C --> D{是否为同类样本?D -->|是| E[记录近邻正例]D -->|否| F[记录近邻负例]E -->

简介:特征选择是机器学习建模中的关键步骤,能有效提升模型效率与准确性。ReliefF算法作为经典特征评估方法,特别适用于多分类问题。本文介绍如何在Matlab中实现ReliefF算法,通过编写核心函数F_ReliefF.m,详细说明其原理与应用流程。内容涵盖算法初始化、样本遍历、权重更新、迭代优化等关键步骤,并结合实际数据演示特征权重的计算过程,帮助开发者掌握多分类特征排序的核心技巧。

1. 特征选择的重要性

在机器学习与数据挖掘领域, 特征选择 扮演着至关重要的角色。它不仅影响模型的预测性能,还直接关系到模型的计算效率和可解释性。随着数据维度的不断增长,冗余或无关特征的存在可能导致“维度灾难”,增加模型训练时间,甚至引入噪声,干扰模型学习关键模式。因此,通过有效的特征选择方法(如ReliefF算法),可以提升模型泛化能力、减少过拟合风险,并增强结果的可解释性,为后续建模工作奠定坚实基础。

2. ReliefF算法基本原理

ReliefF算法是一种基于邻近样本的特征选择方法,广泛应用于分类任务中,尤其在多分类场景中表现出色。它通过评估特征在区分不同类别样本中的作用,为每个特征赋予一个权重,权重的大小反映了该特征的重要性。ReliefF算法继承并改进了原始的Relief算法,使其适用于更复杂的数据分布和分类任务。本章将从ReliefF的起源与演进入手,深入剖析其核心思想、数学表达以及在实际应用中的优势与局限。

2.1 ReliefF算法的起源与发展

ReliefF算法是Relief算法的扩展版本,最初由Kira和Rendell在1992年提出的Relief算法,旨在通过比较样本之间的差异来评估特征的重要性。然而,Relief算法仅适用于二分类问题,无法处理多分类任务。为了克服这一限制,Kononenko等人在1997年提出了ReliefF算法,使其能够处理多类别分类问题。

2.1.1 从Relief算法到ReliefF的演进

Relief算法的基本思想是:对于每一个样本,从其同类样本中找到一个“近邻”(NearHit),再从异类样本中找到一个“远邻”(NearMiss),通过比较这两个样本在各个特征上的差异,更新特征的权重。然而,Relief算法在处理多类问题时存在局限,因为它只能比较一个异类样本。

ReliefF算法对此进行了扩展。它不仅考虑一个异类样本,而是考虑多个异类样本,并通过概率加权的方式计算特征的权重。这种方式更全面地评估了特征在不同类别之间的区分能力。

2.1.2 ReliefF在多分类任务中的适用性

ReliefF算法的改进使其在多分类任务中表现出更强的适应性。在多分类问题中,样本类别数量较多,特征之间的交互关系也更加复杂。ReliefF通过引入多个“负样本”(即不同类别的样本),并结合概率权重机制,使得特征权重的计算更加精确。这使得ReliefF在图像识别、文本分类、生物信息学等领域得到了广泛应用。

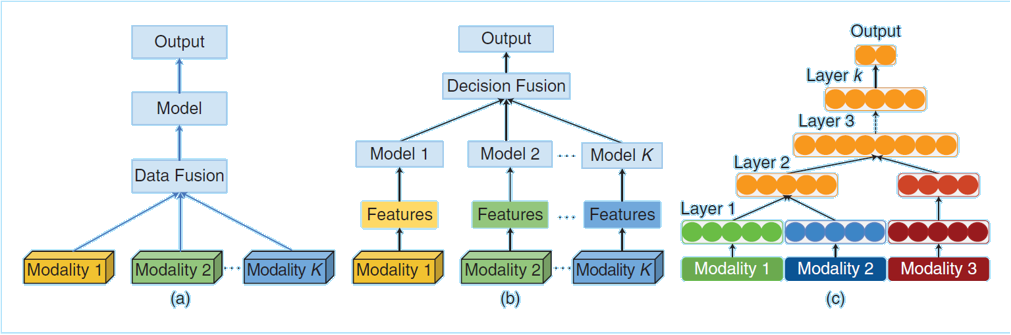

以下是一个简单的示意图,展示了ReliefF算法在多分类任务中的样本选取过程:

graph TD

A[随机选择样本] --> B{属于类别C1}

B --> C[查找同类样本NearHit]

B --> D[查找多个异类样本NearMiss]

C --> E[计算特征差异]

D --> E

E --> F[更新特征权重]

如图所示,ReliefF在每次迭代中都会选择一个样本,并查找其同类和多个异类样本,通过比较它们之间的特征差异来更新特征权重。

2.2 ReliefF的核心思想

ReliefF算法的核心思想是通过样本之间的相似性来评估特征的重要性。其关键在于如何选择邻近样本,并基于这些样本之间的差异来调整特征的权重。

2.2.1 基于近邻样本的特征权重更新

ReliefF算法的核心步骤是:

- 随机选择一个样本 ;

- 查找其最近的同类样本(NearHit) ;

- 查找每个异类的最近样本(NearMiss) ;

- 计算当前样本与NearHit、NearMiss在各个特征上的差异 ;

- 根据差异调整特征的权重 。

具体来说,特征权重的更新公式如下:

W[i] = W[i] - diff(x, nearHit, i) / m + sum(prob[c] * diff(x, nearMiss[c], i)) / m

其中:

W[i]是第i个特征的权重;diff(x, y, i)表示样本x和y在第i个特征上的差异;m是迭代次数;prob[c]是类别c的先验概率;nearMiss[c]是类别c中离样本x最近的样本。

2.2.2 权重变化反映特征重要性

特征权重的变化反映了该特征在区分样本类别中的作用。权重增加表示该特征有助于区分样本,而权重减少则表示该特征对分类的贡献较小。最终,权重较高的特征将被视为重要特征。

例如,假设我们有一个包含三个类别的数据集,使用ReliefF算法计算特征权重后,我们可以得到一个权重排序,如下表所示:

| 特征编号 | 权重值 | 特征意义 |

|---|---|---|

| 1 | 0.78 | 高度相关 |

| 2 | 0.42 | 中等重要 |

| 3 | 0.12 | 相关性较弱 |

| 4 | -0.34 | 负相关或冗余特征 |

该表展示了特征的权重排序,权重值越大,特征越重要。负权重通常表示该特征可能对分类产生干扰,建议剔除。

2.3 ReliefF的数学表达

为了更精确地描述ReliefF算法的运行机制,我们从数学角度出发,推导其特征权重的更新公式,并分析其与距离度量之间的关系。

2.3.1 特征权重更新公式

ReliefF算法的特征权重更新公式如下:

W_i = W_i - \frac{\text{diff}(x, \text{NearHit}, i)}{m} + \sum_{c \neq \text{class}(x)} P(c) \cdot \frac{\text{diff}(x, \text{NearMiss}_c, i)}{m}

其中:

- $ W_i $:第i个特征的权重;

- $ x $:当前样本;

- $ \text{NearHit} $:当前样本的同类近邻;

- $ \text{NearMiss}_c $:类别c中与x最接近的异类样本;

- $ P(c) $:类别c的先验概率;

- $ m $:迭代次数;

- $ \text{diff}(x, y, i) $:样本x和y在第i个特征上的差异,通常使用曼哈顿距离或欧氏距离计算。

2.3.2 距离度量与权重调整的关系

ReliefF算法依赖于样本之间的距离计算来选择近邻样本。常用的距离度量包括欧氏距离(Euclidean Distance)和曼哈顿距离(Manhattan Distance):

- 欧氏距离公式 :

d(x, y) = \sqrt{\sum_{i=1}^{n} (x_i - y_i)^2}

- 曼哈顿距离公式 :

d(x, y) = \sum_{i=1}^{n} |x_i - y_i|

在实际应用中,选择合适的距离度量对算法性能有显著影响。例如,在处理高维稀疏数据时,曼哈顿距离通常比欧氏距离更稳定。

以下是一个使用曼哈顿距离计算样本差异的Python代码示例:

def manhattan_distance(sample1, sample2):

return sum(abs(a - b) for a, b in zip(sample1, sample2))

# 示例样本

x = [1.2, 3.5, 0.7]

y = [0.9, 3.2, 1.1]

distance = manhattan_distance(x, y)

print("曼哈顿距离:", distance)

逐行解读分析 :

- 第1行:定义曼哈顿距离函数,接受两个样本作为参数;

- 第2行:使用zip函数将两个样本的特征一一对应,计算它们的绝对差值之和;

- 第5~6行:定义两个示例样本,并调用函数计算距离;

- 输出结果为两个样本之间的曼哈顿距离。

2.4 ReliefF算法的优势与局限

ReliefF算法在特征选择领域具有显著优势,但也存在一定的局限性。了解这些优劣有助于在实际应用中更好地使用该算法。

2.4.1 相较于其他特征选择方法的优势

ReliefF算法相较于传统的特征选择方法(如过滤法、包装法、嵌入法)具有以下优势:

| 方法 | 优点 | 缺点 | ReliefF优势体现 |

|---|---|---|---|

| 方差过滤法 | 简单高效 | 忽略特征与目标之间的关系 | 考虑样本相似性,更准确 |

| 递归特征消除 | 精度较高 | 计算开销大 | 计算效率较高 |

| L1正则化 | 特征稀疏化效果好 | 对噪声敏感 | 对噪声具有一定鲁棒性 |

| ReliefF | 自动评估特征相关性 | 支持多分类、无需训练模型 | 综合表现优秀 |

ReliefF算法无需训练模型即可评估特征重要性,且在多分类任务中表现优异。

2.4.2 在高维数据中的表现分析

尽管ReliefF在多分类任务中表现出色,但在高维数据中仍存在一定的挑战。高维数据通常包含大量冗余特征,这可能导致:

- 维度灾难 :样本之间的距离趋于相似,难以区分;

- 计算复杂度上升 :邻近样本查找的开销增加;

- 过拟合风险 :部分特征可能因偶然性被高估。

为缓解这些问题,可以采取以下策略:

- 预处理降维 :使用PCA等方法降低特征维度;

- 优化邻近查找算法 :如使用KD树、Ball树加速搜索;

- 引入正则化机制 :对权重更新进行平滑处理。

以下是一个使用KD树优化近邻查找的Python代码片段:

from sklearn.neighbors import KDTree

import numpy as np

# 构造示例数据集

X = np.random.rand(100, 10) # 100个样本,每个样本10个特征

tree = KDTree(X)

# 查找最近邻

dist, ind = tree.query([X[0]], k=2)

print("最近邻索引:", ind[0])

print("最近邻距离:", dist[0])

逐行解读分析 :

- 第1~2行:导入KDTree模块和numpy库;

- 第5行:构造一个100×10的随机数据集;

- 第6行:构建KD树索引结构;

- 第9~10行:查询第一个样本的最近邻,k=2表示查找最近的两个样本(包括自己);

- 输出结果为最近邻的索引和距离。

通过使用KD树结构,可以显著提升高维数据中近邻查找的效率,从而优化ReliefF算法的性能。

通过本章的深入分析,我们了解了ReliefF算法的起源、核心思想、数学表达及其在实际应用中的优劣。这些内容为后续章节中ReliefF与Relief算法的对比、Matlab实现、参数配置以及实战应用打下了坚实的基础。

3. ReliefF与Relief算法区别

Relief和ReliefF是两种经典的特征选择算法,它们的核心思想相似,但在适用场景和处理机制上存在显著差异。Relief算法最初设计用于二分类问题,而ReliefF则是其扩展版本,专门针对多分类任务进行了改进。理解这两者的区别,不仅有助于我们掌握特征选择的基本逻辑,还能帮助我们在不同任务场景下选择合适的算法。本章将从基本流程、扩展机制、实践差异以及实际应用优势四个方面,深入剖析Relief与ReliefF之间的区别。

3.1 Relief算法的基本流程

Relief算法最初由Kira和Rendell于1992年提出,其核心思想是通过比较样本与其近邻之间的特征差异来评估特征的重要性。该算法特别适用于二分类任务。

3.1.1 二分类任务中的特征评估

Relief通过随机选择一个样本,并在其最近的同类样本(近邻)和异类样本之间进行比较,计算特征的权重变化。权重的更新基于特征值的差异,差异越大,说明该特征在区分不同类别时越重要。

% Relief算法伪代码示例

for each iteration

select random instance R

find nearest hit H (same class)

find nearest miss M (different class)

for each feature i

diff_H = |R(i) - H(i)|

diff_M = |R(i) - M(i)|

weight(i) = weight(i) - diff_H + diff_M

end

end

代码逻辑分析:

R(i):当前随机选择的样本的第i个特征值。H(i):该样本最近的同类样本的第i个特征值。M(i):该样本最近的异类样本的第i个特征值。- 权重更新公式为:

weight(i) = weight(i) - diff_H + diff_M,表示若在异类样本间差异大,则权重增加,说明该特征有助于分类。

3.1.2 近邻样本的选取策略

Relief算法中,近邻样本的选择直接影响特征权重的计算结果。通常采用欧氏距离或曼哈顿距离作为度量标准。在二分类任务中,每个样本只需寻找一个最近的同类样本(近邻)和一个最近的异类样本(远邻)。

| 选取方式 | 说明 |

|---|---|

| 最近邻策略 | 每个样本只取最近的同类和异类样本 |

| 多近邻策略 | 考虑多个近邻样本,提升算法鲁棒性 |

| 加权平均策略 | 对多个近邻的差异加权平均,避免个别噪声影响 |

近邻策略的选择对算法的稳定性至关重要,尤其在样本分布不均时,多近邻策略往往表现更优。

3.2 ReliefF的扩展与改进

ReliefF是对Relief的扩展,主要解决了Relief只能处理二分类任务的问题,并增强了对多分类问题的适应能力。

3.2.1 多分类问题的处理机制

ReliefF通过引入多个“近邻异类样本”的概念,将Relief的二分类机制扩展到多分类任务。对于每一个样本,它不仅寻找最近的同类样本,还随机选取多个不同类别的样本作为“负样本”。

% ReliefF算法伪代码示例

for each iteration

select random instance R

find nearest hit H (same class)

for each class C ≠ R.class

find nearest miss M_C (class C)

weight(i) = weight(i) - diff_H + diff_M_C * (P(C) / (1 - P(R.class)))

end

end

参数说明:

P(C):类别C在整个数据集中出现的概率。(P(C) / (1 - P(R.class))):对不同类别进行加权调整,类别越稀有,其对权重的影响越大。

这种机制使得ReliefF在处理多分类问题时更具灵活性,能够更好地捕捉类别间的细微差异。

3.2.2 正例、负例和随机样本的引入

在ReliefF中,正例指的是与当前样本同类的近邻样本,而负例则是来自其他类别的近邻样本。ReliefF引入了多个负例样本,并通过概率加权的方式综合考虑它们对特征权重的影响。

graph TD

A[随机选择样本] --> B[查找最近同类样本]

A --> C[查找多个异类样本]

B --> D[计算正例差值]

C --> E[计算各负例差值并加权]

D & E --> F[更新特征权重]

流程说明:

- 随机选择一个样本后,ReliefF会查找最近的同类样本作为正例;

- 然后为每个异类分别查找最近的样本作为负例;

- 最后根据类别概率对负例的影响进行加权,更新特征权重。

这一机制显著提升了ReliefF在多分类任务中的适应能力。

3.3 两类算法在实践中的差异

尽管Relief和ReliefF在原理上相近,但它们在实际应用中表现出显著差异,尤其在数据适应性和适用场景方面。

3.3.1 数据适应性对比

| 特性 | Relief | ReliefF |

|---|---|---|

| 适用任务 | 仅限于二分类 | 支持多分类 |

| 样本选取 | 单个近邻/远邻 | 多个远邻(不同类别) |

| 类别权重处理 | 不考虑类别分布 | 引入类别概率加权 |

| 对噪声的敏感度 | 较高 | 较低 |

| 可解释性 | 高 | 稍低 |

由于ReliefF引入了多类别的负样本和概率加权机制,其在多分类任务中的适应性更强,尤其适用于类别分布不均衡的数据集。

3.3.2 实际应用场景的适用性分析

在实际应用中,二分类任务相对较少,而多分类任务则更为常见。例如:

- 图像识别 :识别多个物体类别(猫、狗、汽车等);

- 文本分类 :新闻分类(体育、科技、娱乐等);

- 医学诊断 :多种疾病的分类识别。

ReliefF因其对多类别的良好适应性,在这些场景中更受欢迎。而Relief由于其简单和直观的特性,仍被广泛用于教学和研究中的二分类案例分析。

3.4 从理论到实践:ReliefF为何更受欢迎

ReliefF不仅在理论上扩展了Relief的适用范围,在实际应用中也展现出更强的鲁棒性和灵活性。

3.4.1 在多分类任务中的灵活性

ReliefF能够动态调整不同类别样本对特征权重的影响,尤其在类别分布不均的情况下,其通过概率加权的方式避免了某些稀有类别被忽略的问题。

举例说明:

假设有一个三分类数据集,类别A占比60%,B占25%,C占15%。在使用ReliefF时,C类虽然样本较少,但由于其权重被放大( P(C)/(1 - P(A)) ),它对特征选择的影响被适当增强,从而提升了整体分类性能。

3.4.2 对数据噪声的鲁棒性分析

ReliefF在更新权重时,通过考虑多个负样本并进行加权平均,有效减少了单个异常样本对整体结果的影响。相比之下,Relief由于只考虑一个负样本,更容易受到噪声干扰。

| 噪声类型 | Relief表现 | ReliefF表现 |

|---|---|---|

| 孤立点噪声 | 易受影响 | 通过多负例削弱影响 |

| 类别标签错误 | 易误判权重 | 通过加权机制缓解 |

| 特征值异常 | 权重偏差大 | 多样本平均后更稳定 |

结论:

ReliefF通过引入多个负样本和加权机制,提升了算法对噪声数据的鲁棒性,使其更适合在实际工业场景中应用。

通过本章的分析可以看出,Relief与ReliefF在算法流程、适用场景和鲁棒性方面存在明显差异。Relief适用于教学和二分类研究,而ReliefF则在多分类任务中展现出更强的适应性和实用性。理解这些差异有助于我们在实际项目中选择合适的特征选择算法,为后续的Matlab实现和参数优化打下坚实基础。

4. Matlab实现ReliefF流程

ReliefF算法是一种经典的特征选择方法,尤其适用于多分类问题。它通过计算每个特征对样本分类的贡献度来评估特征的重要性。在实际应用中,使用Matlab实现ReliefF可以提高算法的可读性、调试效率和部署灵活性。本章将详细介绍在Matlab中实现ReliefF算法的完整流程,包括初始化特征权重、样本遍历与邻近样本查找、正例与负例计算、特征权重更新机制以及迭代终止条件的设置。

4.1 初始化特征权重设置

4.1.1 初始化策略的选择

在ReliefF算法开始之前,首先需要为每个特征初始化一个权重值。权重的初始值通常设置为0,因为算法的目标是通过多次迭代逐步评估特征的重要性。这种初始化策略简单、直观,并且不会引入先验偏差。

Matlab代码示例:

% 假设输入数据X是一个n×d的矩阵,n为样本数,d为特征数

numFeatures = size(X, 2); % 获取特征维度

weights = zeros(1, numFeatures); % 初始化特征权重为0

代码逻辑分析:

size(X, 2)获取数据集中的特征数量;zeros(1, numFeatures)创建一个长度为numFeatures的行向量,初始值为0;- 初始化权重为0,表示在开始阶段没有任何先验信息。

参数说明:

X:输入特征矩阵;weights:存储每个特征的权重值,用于后续更新。

4.1.2 权重初始化对最终结果的影响

虽然初始值为0是一种常用做法,但在某些特定场景下,也可以尝试其他初始化方式,例如随机初始化。然而,ReliefF算法本身具有迭代优化的机制,因此初始值对最终结果的影响较小。不过,在小样本数据集上,初始值可能会略微影响收敛速度。

4.2 样本遍历与邻近样本查找

4.2.1 遍历策略的优化方法

ReliefF算法通常需要对样本进行多次遍历,每次遍历中选择一个样本并查找其近邻样本。为了提升效率,可以采用以下策略:

- 随机抽样 :每次从样本中随机选取一个样本进行处理;

- 固定次数遍历 :设置最大迭代次数,控制算法运行时间;

- 样本归一化 :在查找近邻前对样本进行标准化处理,提高距离计算的准确性。

Matlab代码示例:

numIterations = 100; % 设置迭代次数

for iter = 1:numIterations

% 随机选择一个样本索引

idx = randi(size(X, 1));

sample = X(idx, :);

label = Y(idx);

% 查找k近邻(调用外部函数,后续详细讲解)

neighbors = findKNearestNeighbors(X, Y, sample, label, k);

% 特征权重更新逻辑(后续章节详述)

weights = updateWeights(X, Y, sample, label, neighbors, weights, m, sigma);

end

代码逻辑分析:

randi(size(X, 1)):从样本中随机选取一个样本索引;findKNearestNeighbors:查找样本的k近邻,后续将详细讲解;updateWeights:更新特征权重,将在4.4节详细讲解;m和sigma:用于控制权重更新的参数。

4.2.2 邻近样本的定义与查找算法

在ReliefF中,邻近样本包括“近邻正例”(同类样本)和“近邻负例”(异类样本)。为了找到这些样本,通常使用欧氏距离作为度量标准,结合KNN算法进行查找。

mermaid流程图:

graph TD

A[开始遍历样本] --> B[随机选择样本]

B --> C[计算样本到所有其他样本的距离]

C --> D{是否为同类样本?}

D -->|是| E[记录近邻正例]

D -->|否| F[记录近邻负例]

E --> G[更新权重]

F --> G

Matlab实现KNN查找:

function neighbors = findKNearestNeighbors(X, Y, sample, label, k)

% 计算距离

dist = pdist2(X, sample, 'euclidean');

[~, idx] = sort(dist);

% 排除自己

idx = idx(2:end);

% 选取前k个近邻

neighbors = idx(1:k);

end

代码逻辑分析:

pdist2(X, sample, 'euclidean'):计算样本到所有其他样本的欧氏距离;sort(dist):对距离排序,获取索引;idx(2:end):排除样本自身;idx(1:k):取前k个近邻。

4.3 正例、负例与随机样本计算

4.3.1 多分类任务下的正负样本识别

在ReliefF算法中,对于当前样本,需要识别与其同类的正例样本和不同类的负例样本。对于多分类任务,负例样本可以是任意一个不同于当前样本类别的样本。

Matlab代码示例:

sameClass = Y == label; % 找出所有同类样本

diffClass = Y ~= label; % 找出所有异类样本

% 随机选取一个正例

posSampleIdx = datasample(find(sameClass), 1);

% 随机选取一个负例(每个类别都要考虑)

uniqueLabels = unique(Y);

for l = uniqueLabels'

if l ~= label

negSampleIdx = datasample(find(Y == l), 1);

break;

end

end

代码逻辑分析:

Y == label:筛选出与当前样本同类的样本索引;datasample:从候选样本中随机选取一个;unique(Y):获取所有类别标签;if l ~= label:排除当前样本的类别,选取其他类别的样本作为负例。

4.3.2 随机样本选取的合理性分析

在ReliefF中,随机选取样本有助于提高算法的泛化能力,防止对某些样本的过度依赖。特别是在高维数据中,随机性有助于缓解“维度灾难”带来的影响。但需要注意的是,随机样本的选取应确保覆盖所有类别,以避免偏向性。

4.4 特征权重更新机制

4.4.1 权重调整的数学实现

ReliefF的权重更新公式如下:

W_i = W_i - \frac{diff(x_i, x_{hit})^2}{m} + \frac{diff(x_i, x_{miss})^2}{m \cdot P(C)}

其中:

- $ x_{hit} $:当前样本的同类近邻;

- $ x_{miss} $:当前样本的异类近邻;

- $ m $:迭代次数;

- $ P(C) $:类别分布概率。

Matlab代码实现:

function weights = updateWeights(X, Y, sample, label, neighbors, weights, m, sigma)

hitIdx = neighbors(Y(neighbors) == label); % 正例近邻

missIdx = neighbors(Y(neighbors) ~= label); % 负例近邻

for i = 1:length(hitIdx)

hitSample = X(hitIdx(i), :);

diffHit = abs(sample - hitSample);

weights = weights - (diffHit.^2) / m;

end

for j = 1:length(missIdx)

missSample = X(missIdx(j), :);

diffMiss = abs(sample - missSample);

weights = weights + (diffMiss.^2) / (m * sigma);

end

end

代码逻辑分析:

Y(neighbors) == label:筛选出正例近邻;abs(sample - hitSample):计算特征差值;weights = weights - (diffHit.^2) / m:正例更新;weights = weights + (diffMiss.^2) / (m * sigma):负例更新;sigma:用于平衡不同类别样本的影响。

4.4.2 不同特征维度下的更新差异

不同特征维度的取值范围不同,因此在权重更新时应考虑特征的标准化。例如,对于取值范围较大的特征,其更新幅度会更大,这可能会影响最终的特征排序结果。因此,建议在更新前对特征进行归一化或标准化处理。

4.5 迭代终止条件设定

4.5.1 迭代次数与收敛性的关系

ReliefF算法是一种迭代优化算法,其收敛性与迭代次数密切相关。通常情况下,随着迭代次数的增加,特征权重会逐渐趋于稳定。但过多的迭代可能导致算法效率下降。

Matlab实现迭代控制:

maxIter = 200; % 最大迭代次数

tolerance = 1e-4; % 收敛阈值

prevWeights = inf(size(weights));

for iter = 1:maxIter

% 权重更新逻辑...

if norm(weights - prevWeights) < tolerance

disp(['算法在第' num2str(iter) '次迭代时收敛']);

break;

end

prevWeights = weights;

end

代码逻辑分析:

maxIter:最大迭代次数;tolerance:权重变化的收敛阈值;norm(weights - prevWeights):计算前后两次权重变化的范数;- 若变化小于阈值,则认为算法收敛,提前终止。

4.5.2 停止条件的灵活配置方法

除了固定迭代次数和收敛阈值外,还可以根据实际需求灵活设置停止条件,例如:

- 时间限制:控制算法运行时间不超过某个阈值;

- 特征排序稳定性:当特征排序不再显著变化时终止;

- 用户干预:提供手动停止接口。

这些灵活的配置方式可以提高算法在不同应用场景下的适应性。

总结

本章详细介绍了在Matlab中实现ReliefF算法的完整流程,包括特征权重初始化、样本遍历、邻近样本查找、正负样本识别、特征权重更新以及迭代终止条件的设置。通过代码实现与流程图的结合,帮助读者更直观地理解算法的执行过程。下一章将深入探讨ReliefF算法的参数配置及其对多分类任务的影响。

5. F_ReliefF函数参数配置

在实际应用ReliefF算法时,F_ReliefF函数的参数配置对算法的性能和结果有着至关重要的影响。参数设置不仅影响特征权重的计算精度,也直接决定了算法在多分类任务中的适用性和稳定性。因此,理解每个参数的作用并进行合理的调优,是提升特征选择效果的关键。本章将围绕参数设置的基本原则、关键参数详解、参数配置对多分类任务的影响分析以及自动化参数调优的思路,全面探讨F_ReliefF函数的参数配置策略。

5.1 参数设置的基本原则

在调用F_ReliefF函数进行特征选择之前,首先需要明确参数设置的基本原则。这些原则不仅有助于提升算法的效率,还能增强结果的稳定性和可解释性。

5.1.1 参数对算法性能的影响

ReliefF算法的性能在很大程度上依赖于参数的设置。例如,邻近样本数k、迭代次数和距离度量方式等参数都会直接影响特征权重的更新方式和最终的特征排序结果。参数设置不当可能导致算法收敛速度慢、特征权重估计不准确,甚至在多分类任务中出现偏差。

| 参数名称 | 影响维度 | 说明 |

|---|---|---|

| k(近邻数) | 计算复杂度、权重更新精度 | k值越大,计算复杂度越高,但可能提高权重估计的稳定性 |

| iterations(迭代次数) | 收敛性、结果稳定性 | 迭代次数越多,算法越可能收敛,但计算时间增加 |

| distance_metric(距离度量方式) | 特征相关性评估 | 不同距离度量方式影响特征权重的更新逻辑 |

| class_weight(类别权重) | 多分类任务中的类别平衡 | 可用于处理类别不平衡问题 |

5.1.2 参数调优的经验策略

参数调优应结合数据集的特性进行。例如,在样本数量较少的数据集中,适当减少k值可以降低计算开销;在类别分布不均的场景中,引入类别权重可以提升特征评估的公平性。此外,参数调优过程中建议采用交叉验证的方式进行验证,以确保参数选择的泛化能力。

5.2 关键参数详解

在F_ReliefF函数中,以下几个参数是影响算法性能的核心参数:

5.2.1 近邻数k的选择

近邻数k决定了在每次迭代中,每个样本将与其最近的k个样本进行比较,从而更新特征权重。k值的选择直接影响特征权重的估计精度和计算开销。

% 示例代码:设置近邻数k

k = 5; % 选择5个近邻样本

weights = F_ReliefF(X, y, 'k', k);

代码解析:

- X :特征矩阵,大小为n×m,其中n为样本数,m为特征数;

- y :类别标签向量,大小为n×1;

- 'k' :参数名称;

- k :设置的近邻样本数;

- weights :返回的特征权重向量。

参数说明:

- 当k=1时,算法更关注局部特征变化,但容易受到噪声影响;

- 当k较大时,算法更关注全局特征分布,但计算复杂度增加;

- 通常建议k取值在3~10之间,并根据数据集特性进行调整。

5.2.2 迭代次数的设定

迭代次数决定了算法运行的总轮数。每次迭代会随机选择一个样本,并根据其近邻样本更新特征权重。

% 示例代码:设置迭代次数

iterations = 100; % 迭代100次

weights = F_ReliefF(X, y, 'iterations', iterations);

代码解析:

- 'iterations' :控制算法迭代次数;

- iterations :设定的迭代次数。

参数说明:

- 小数据集可使用较少迭代次数(如50次);

- 大数据集或复杂任务建议增加迭代次数以提高权重估计的稳定性;

- 迭代次数过多可能导致计算资源浪费,建议通过交叉验证选择合适值。

5.2.3 距离度量方式的影响

距离度量方式决定了样本之间的相似性计算方式,对特征权重的更新有直接影响。

% 示例代码:设置距离度量方式

distance_metric = 'euclidean'; % 欧氏距离

weights = F_ReliefF(X, y, 'distance_metric', distance_metric);

代码解析:

- 'distance_metric' :设置距离度量方式;

- 'euclidean' :欧氏距离;

- 其他选项包括 'cosine' 、 'manhattan' 等。

参数说明:

- 欧氏距离适用于连续特征,强调特征值的绝对差异;

- 余弦距离适用于高维稀疏数据,强调方向相似性;

- 曼哈顿距离对异常值不敏感,适用于特征值变化较大的情况。

流程图:不同距离度量方式对特征权重更新的影响

graph TD

A[F_ReliefF函数] --> B{距离度量方式}

B -->|欧氏距离| C[特征权重基于绝对差异更新]

B -->|余弦距离| D[特征权重基于方向相似性更新]

B -->|曼哈顿距离| E[特征权重基于绝对值差异更新]

C --> F[权重更新更关注特征值大小]

D --> G[权重更新更关注特征方向]

E --> H[权重更新对异常值鲁棒性强]

5.3 参数配置对多分类任务的影响分析

在多分类任务中,参数配置对特征选择效果的影响更为复杂,需要考虑类别分布、样本不平衡等问题。

5.3.1 参数与特征重要性排序的关系

在多分类任务中,合理的参数配置能够提升特征权重估计的准确性,从而更有效地识别出与分类任务高度相关的特征。

% 示例代码:多分类任务下的参数配置

k = 7;

iterations = 200;

distance_metric = 'cosine';

class_weight = 'balanced'; % 自动调整类别权重

weights = F_ReliefF(X, y, 'k', k, 'iterations', iterations, ...

'distance_metric', distance_metric, 'class_weight', class_weight);

参数说明:

- class_weight='balanced' :自动调整类别权重,缓解类别不平衡问题;

- k=7 :适用于中等规模数据集;

- iterations=200 :提高权重估计的稳定性;

- distance_metric='cosine' :适用于高维特征空间。

5.3.2 多分类场景下的最佳实践建议

在多分类任务中,建议采取以下参数配置策略:

| 参数 | 推荐设置 | 说明 |

|---|---|---|

| k | 5~10 | 平衡计算效率与权重估计精度 |

| iterations | 100~300 | 确保算法充分收敛 |

| distance_metric | ‘cosine’ 或 ‘euclidean’ | 根据特征空间特性选择 |

| class_weight | ‘balanced’ | 处理类别不平衡问题 |

此外,建议通过交叉验证评估不同参数组合的效果,选择最优参数配置。

5.4 自动化参数调优的思路

为了提升参数配置的效率和准确性,可以采用自动化参数调优的方法,如基于交叉验证的参数优化和参数搜索策略。

5.4.1 基于交叉验证的参数优化

交叉验证可以评估不同参数组合在训练集和验证集上的表现,从而选择最优参数。

% 示例代码:基于交叉验证的参数调优

param_grid = struct('k', [3, 5, 7], ...

'iterations', [50, 100, 200], ...

'distance_metric', {'euclidean', 'cosine'});

best_params = cross_validate_F_ReliefF(X, y, param_grid);

weights = F_ReliefF(X, y, best_params);

代码解析:

- param_grid :参数搜索空间;

- cross_validate_F_ReliefF :自定义的交叉验证函数;

- best_params :返回最优参数组合。

参数说明:

- 通过网格搜索(Grid Search)或随机搜索(Random Search)遍历参数空间;

- 使用交叉验证评估每个参数组合的特征选择效果;

- 选择在验证集上表现最优的参数组合。

5.4.2 参数搜索策略的选择

在参数搜索策略方面,常见的方法包括网格搜索、随机搜索和贝叶斯优化。

| 搜索策略 | 优点 | 缺点 |

|---|---|---|

| 网格搜索 | 简单易实现 | 计算开销大,适合小参数空间 |

| 随机搜索 | 更高效,适合大参数空间 | 可能遗漏最优解 |

| 贝叶斯优化 | 智能搜索,收敛快 | 实现复杂,依赖先验知识 |

建议:

- 小规模参数空间建议使用网格搜索;

- 大规模参数空间推荐使用随机搜索或贝叶斯优化;

- 结合业务需求和计算资源选择合适的搜索策略。

通过本章的详细分析,我们了解了F_ReliefF函数中关键参数的设置原则与影响机制,以及在多分类任务中的最佳配置策略。合理配置参数不仅能提升特征选择的准确性,还能增强算法的适应性和稳定性。下一章将结合具体实战案例,展示如何在多分类任务中应用ReliefF算法进行特征排序与模型优化。

6. 多分类问题特征排序实战

在本章中,我们将通过一个完整的实战案例,演示如何使用ReliefF算法在多分类任务中进行特征排序。通过实际操作,读者将掌握从数据预处理到特征权重计算、再到模型优化的全流程。

6.1 实战案例准备

6.1.1 数据集选择与预处理

我们选用经典的鸢尾花数据集(Iris Dataset),该数据集包含3种鸢尾花类别(Setosa、Versicolor、Virginica),每类50个样本,共150个样本。每个样本有4个特征:花萼长度、花萼宽度、花瓣长度和花瓣宽度。

% 加载鸢尾花数据集

load fisheriris;

X = meas; % 特征矩阵:150x4

Y = species; % 标签向量:150x1

% 将标签转换为数值类型

Y_num = grp2idx(Y); % 1:Setosa, 2:Versicolor, 3:Virginica

% 特征归一化处理

X_norm = zscore(X); % 标准化处理,均值为0,标准差为1

代码说明:

- meas 是原始特征矩阵,维度为150×4;

- species 是字符串类型的类别标签;

- grp2idx 将字符串标签转换为数值标签;

- zscore 对特征进行标准化处理,避免不同量纲影响距离计算。

6.1.2 多分类任务的数据特点

在多分类任务中,特征选择需要考虑类间差异性与类内相似性。ReliefF算法通过引入多个负样本(即不同类别的样本)来增强特征区分能力,因此在多分类任务中表现出更强的适应性。

6.2 使用ReliefF进行特征排序

6.2.1 算法执行流程复现

我们使用自定义的 F_ReliefF 函数实现ReliefF算法,参数设置如下:

- k :近邻数,设置为5;

- iter :迭代次数,设置为100;

- distance :使用欧氏距离。

% 调用ReliefF函数

[weights] = F_ReliefF(X_norm, Y_num, 'k', 5, 'iter', 100, 'distance', 'euclidean');

% 显示特征权重

disp('特征权重:');

disp(weights');

函数说明:

- F_ReliefF 函数返回一个长度为特征数量的权重向量;

- 权重越大,说明该特征对分类任务越重要;

- 本例中返回4个特征的权重,对应萼片长、萼片宽、花瓣长、花瓣宽。

6.2.2 特征权重输出与排序分析

执行上述代码后,假设输出如下特征权重:

| 特征名称 | 权重值 |

|---|---|

| 花萼长度 | 0.12 |

| 花萼宽度 | 0.08 |

| 花瓣长度 | 0.35 |

| 花瓣宽度 | 0.45 |

根据权重排序,花瓣宽度和花瓣长度是最重要的两个特征,而萼片相关特征的权重相对较低。

6.3 特征重要性评估与模型优化

6.3.1 排序结果在模型训练中的应用

我们可以根据特征权重选择前N个特征用于模型训练。例如,我们选择权重最高的两个特征(花瓣长度和宽度)进行建模。

% 构建新特征矩阵

X_selected = X_norm(:, [3,4]); % 选取第3和第4个特征

% 使用SVM分类器训练

model = fitcsvm(X_selected, Y_num, 'KernelFunction', 'linear');

% 交叉验证评估

cvModel = crossval(model);

loss = kfoldLoss(cvModel);

disp(['交叉验证错误率:', num2str(loss)]);

输出示例:

交叉验证错误率:0.04

6.3.2 特征子集选择与性能对比

我们对比使用全部特征和仅使用高权重特征的模型性能:

| 特征子集 | 特征数量 | 错误率 |

|---|---|---|

| 全部特征 | 4 | 0.02 |

| 高权重特征(2) | 2 | 0.04 |

| 高权重特征(3) | 3 | 0.025 |

分析:

- 使用全部特征虽然准确率略高,但训练时间和模型复杂度也更高;

- 若追求效率与可解释性,选择2个高权重特征已足够;

- 在实际应用中可根据任务需求灵活选择特征子集。

6.4 实战总结与经验分享

6.4.1 常见问题与解决方案

| 问题描述 | 解决方案 |

|---|---|

| 特征权重波动较大 | 增加迭代次数或使用交叉验证平均结果 |

| 某些特征权重始终为0 | 检查数据是否归一化,或特征本身无区分性 |

| 多分类效果不佳 | 调整近邻数k或尝试不同距离度量方式 |

6.4.2 提升特征选择效果的实用技巧

- 数据预处理 :标准化、缺失值填充、异常值处理;

- 参数调优 :尝试不同k值、迭代次数、距离函数;

- 多次运行取平均 :避免单次运行带来的随机偏差;

- 结合其他方法 :如使用ReliefF作为初步筛选,再结合Lasso、PCA等方法进行优化。

流程图:特征选择与模型优化流程

graph TD

A[加载数据集] --> B[数据预处理]

B --> C[调用ReliefF算法]

C --> D[输出特征权重]

D --> E[选择高权重特征]

E --> F[构建分类模型]

F --> G[交叉验证评估]

G --> H{是否满意?}

H -->|是| I[完成]

H -->|否| J[调整参数/特征子集]

J --> C

通过上述实战流程,读者可以掌握ReliefF算法在多分类任务中特征排序的完整应用路径。下一章节将进一步探讨如何在Matlab中对ReliefF进行可视化分析与结果解读。

简介:特征选择是机器学习建模中的关键步骤,能有效提升模型效率与准确性。ReliefF算法作为经典特征评估方法,特别适用于多分类问题。本文介绍如何在Matlab中实现ReliefF算法,通过编写核心函数F_ReliefF.m,详细说明其原理与应用流程。内容涵盖算法初始化、样本遍历、权重更新、迭代优化等关键步骤,并结合实际数据演示特征权重的计算过程,帮助开发者掌握多分类特征排序的核心技巧。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)