综述:超图神经网络 A Survey on Hypergraph Neural Networks: An In-Depth and Step-By-Step Guide

高阶交互(Higher-order Interactions, HOIs)在现实世界的复杂系统及应用中普遍存在。因此,针对高阶交互的深度学习研究已成为数据挖掘和机器学习领域的重要议题。由于高阶交互网络可通过超图进行数学表达,超图神经网络(Hypergraph Neural Networks, HNNs)已成为超图上表示学习的有力工具。鉴于这一新兴趋势,本文首次推出专门聚焦超图神经网络的综述,提供深

论文: A Survey on Hypergraph Neural Networks: An In-Depth and Step-By-Step Guide

期刊/会议: KDD 2024

链接: https://arxiv.org/abs/2404.01039?utm_source=chatgpt.com

作者: Sunwoo Kim, Soo Yong Lee, Yue Gao, Alessia Antelmi, Mirko Polato, Kijung Shin

关键词: 超图神经网络,自监督学习

简介: 是第一篇专门聚焦 Hypergraph Neural Networks 的 survey,系统地把架构、训练策略、应用(包括时间序列分析)都涵盖了。对于想了解超图神经网络的总体 landscape 很有帮助。

Abstract

高阶交互(Higher-order Interactions, HOIs)在现实世界的复杂系统及应用中普遍存在。因此,针对高阶交互的深度学习研究已成为数据挖掘和机器学习领域的重要议题。由于高阶交互网络可通过超图进行数学表达,超图神经网络(Hypergraph Neural Networks, HNNs)已成为超图上表示学习的有力工具。鉴于这一新兴趋势,本文首次推出专门聚焦超图神经网络的综述,提供深入且循序渐进的指导。总体而言,本综述涵盖超图神经网络的架构、训练策略及应用场景三大核心内容:

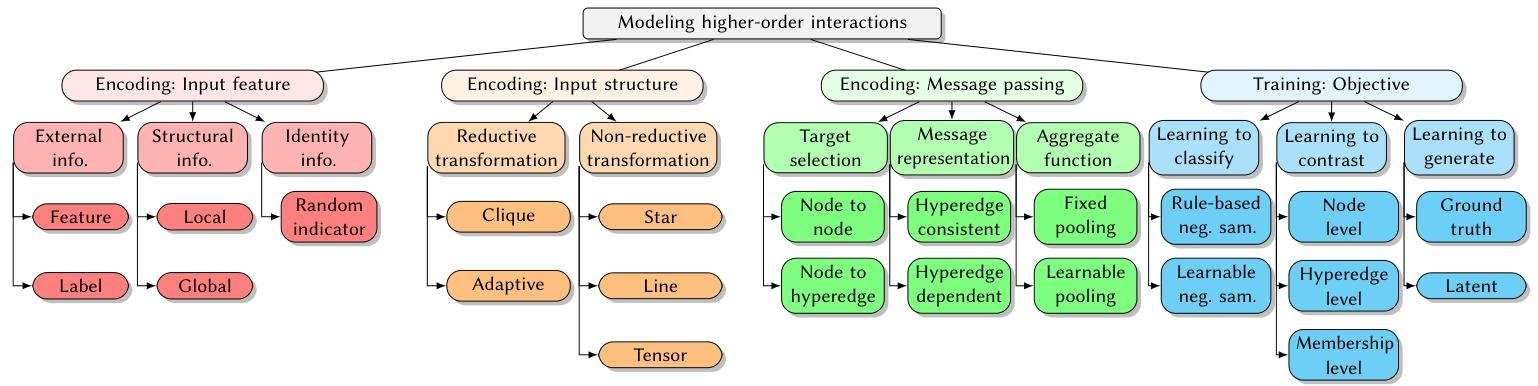

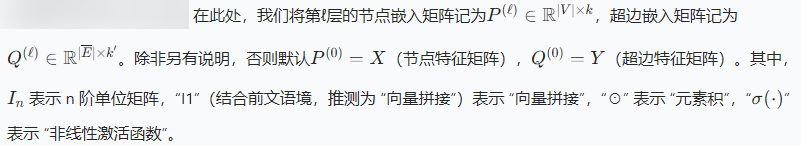

- 将现有超图神经网络拆解为四大设计组件:(1)输入特征、(2)输入结构、(3)消息传递机制、(4)训练策略;

- 分析超图神经网络如何通过每个组件处理并学习高阶交互;

- 概述超图神经网络近年来在推荐系统、生物信息与医学、时间序列分析及计算机视觉四大领域的应用;

- 最后,探讨超图神经网络当前存在的局限性,并对未来研究方向进行展望。

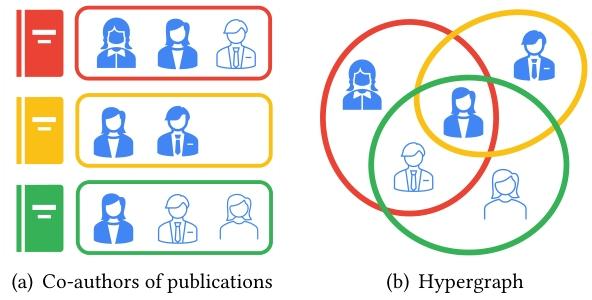

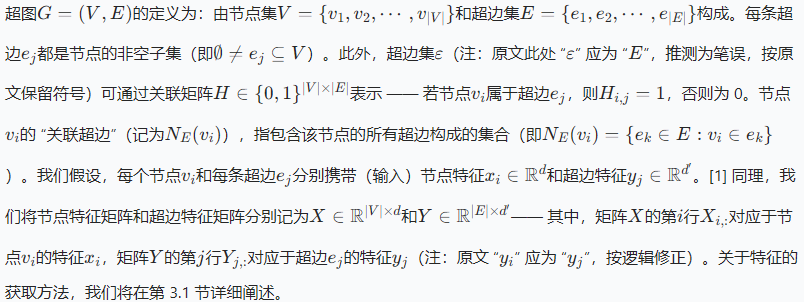

图 1:用于建模五位作者在三篇出版物中合作署名关系的示例超图。其中,每个节点代表一位作者,而每条超边包含某一出版物的所有合作作者。

1 Introduction

高阶交互(Higher-order Interactions, 简称 HOIs)在现实世界的复杂系统及各类应用中普遍存在。这类关系描述的是多向或群组级的交互,广泛存在于物理系统 [8]、微生物群落 [100]、大脑功能 [30]、社交网络 [52] 等领域(仅举几例)。高阶交互能揭示成对交互中未被发现的结构模式,并为理解网络动态提供依据。例如,研究表明,高阶交互会影响或与以下现象相关:物理系统中的同步现象 [7]、微生物群落中的细菌入侵抑制 [98]、大脑中的皮层动态活动 [161],以及社交网络中的传播行为 [22]。

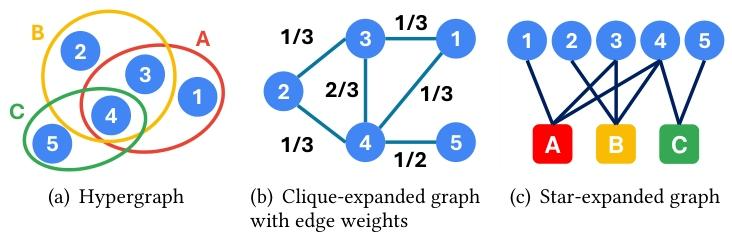

超图从数学角度表示高阶网络或高阶交互(HOIs)网络 [11],其中节点和超边分别代表实体及其高阶交互。与成对图中仅连接两个节点的边不同,超边可连接任意数量的节点,这使得超图在描述能力上具备优势。例如,如图 1 所示,研究者之间的合作署名关系可通过超图来表示。凭借其表现力与灵活性,超图常被用于在各类领域 [6, 22, 32, 43] 中对高阶网络进行建模,以揭示其结构模式 [24, 61, 62, 71–73]。

随着超图的广泛应用,对超图进行预测的需求日益增长 —— 这类预测任务包括估算节点属性或识别缺失的超边。超图神经网络(HNNs)在解决这类问题上展现出了巨大潜力。例如,它们在工业领域及科学应用领域,包括缺失代谢反应预测 [16]、大脑分类 [54]、交通预测 [169]、产品推荐 [55],以及更多(相关应用)[42, 93, 145]已展现出最先进的性能。

超图神经网络(HNNs)相关研究正呈指数级增长。与此同时,针对高阶网络的深度学习进一步研究,已成为数据挖掘和机器学习领域的一项紧迫议题 [103]。因此,我们适时推出了一篇关于超图神经网络的综述,旨在解答以下问题:

・编码(第 3 节):超图神经网络(HNNs)如何有效捕捉高阶交互(HOIs)?

・训练(第 4 节):如何通过训练目标对高阶交互(HOIs)进行编码,尤其是在外部标签稀缺或缺失的情况下?

・应用(第 5 节):超图神经网络(HNNs)有哪些典型应用?

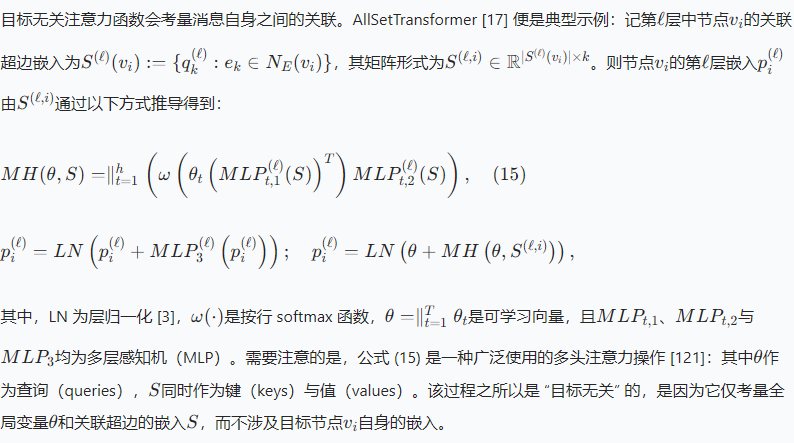

本文的研究范围主要聚焦于适用于无向、静态且同质超图的超图神经网络(HNNs),其下游任务为节点分类或超边预测。本综述旨在提供一份深入且循序渐进的指南,内容涵盖超图神经网络的设计组件(见图 2)及其相关分析(见表 2)。

图 2:高阶交互建模的分类体系。其中,“neg. sam.” 表示 “负采样”。

2 Preliminaries

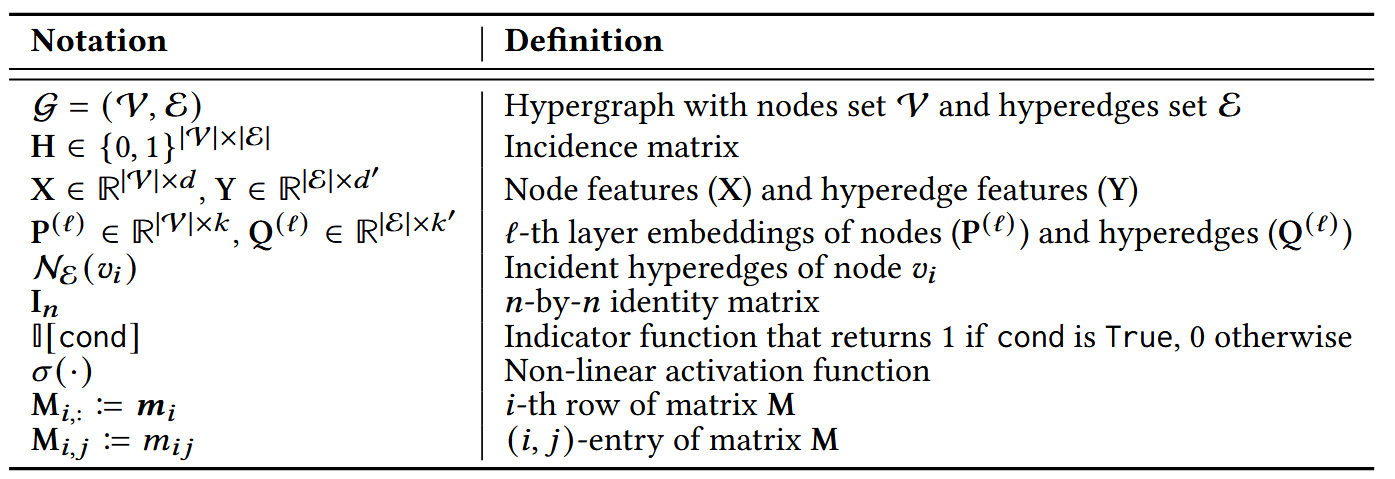

在本节中,我们给出与超图及超图神经网络(HNNs)相关的基本概念定义。常用符号请参见表 1。

超图神经网络(HNNs)是一类神经网络函数,其作用是将给定的节点、超边及其特征转化为向量表示(即嵌入)。通常,它们的输入以(X, E)或(X, Y, ε)的形式表示。超图神经网络(HNNs)首先对输入超图的结构 ε 进行预处理(见第 3.2 节)。随后,它们会在节点(及 / 或超边)之间执行消息传递,以更新节点(及 / 或超边)的嵌入(见第 3.3 节)。节点(或超边)消息大致指其供其他节点(或超边)聚合的向量表示。消息传递操作会重复执行 L 次,每次迭代对应超图神经网络(HNNs)的一层。

——[脚注 1] 有时,(外部)节点和超边特征可能未被提供。在这种情况下,可如第 3.1 节所述,采用结构特征或身份特征。

3 Encoder Design Guidance

在本节中,我们将逐步阐述超图神经网络(HNNs)如何对高阶交互(HOIs)进行编码。

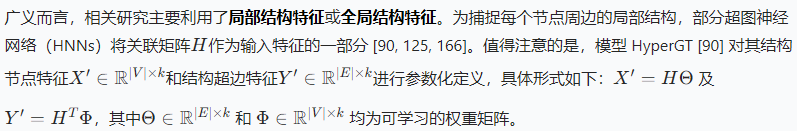

3.1 Step 1: Design features to reflect HOIs

3.1.1 外部特征或标签:

“外部特征或标签” 广义上指并非直接从超图结构中获取的信息。利用外部特征,能够让超图神经网络(HNNs)捕捉到仅靠超图结构难以体现的信息。在外部特征可获取的情况下,将外部节点特征(X)和超边特征(Y)作为超图神经网络(HNNs)的输入,是该领域的标准做法。

在广泛使用的基准数据集(超图学习相关)中,节点特征的示例包括 “词袋向量”[148]、“TF-IDF”[27]、“视觉对象嵌入”[34] 或 “带噪声的标签向量”[17]。有趣的是,与标签传播(技术)类似,“HyperND”[106] 通过将 “外部节点特征” 与 “标签向量” 拼接,构建输入节点特征 “X”。具体而言,对于具有已知标签的节点,拼接 “独热编码标签向量”;对于标签未知的节点,则拼接 “零向量”。由于 “外部超边特征” 在基准数据集中通常缺失,因此在实际应用中,超边(e_j)的输入特征可通过对其构成节点的特征取平均值得到(即 y j = ∑ w k ∈ e j x k / ∣ e j ∣ y_j = \sum_{w_k \in e_j} x_k / |e_j| yj=∑wk∈ejxk/∣ej∣)[150]。

3.1.2 结构特征:

在外部特征之外,相关研究还将结构特征用作超图神经网络(HNNs)的输入特征。结构特征通常从输入超图的结构 ε \varepsilon ε中提取,用于捕捉节点间的结构邻近性或相似性。尽管在超图结构 ε \varepsilon ε之外额外利用这些特征看似冗余,但多项研究已证实其具备理论与实证优势,尤其在超边预测 [125] 以及基于 Transformer 的超图神经网络 [20, 90, 112] 中表现突出。

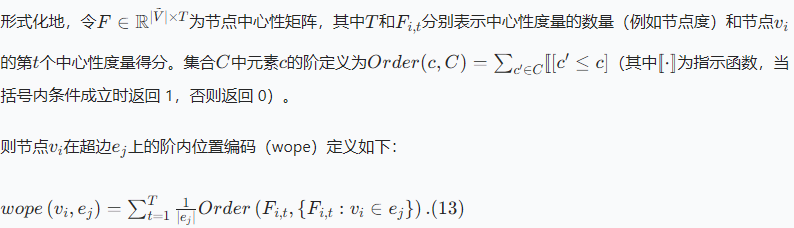

另有部分超图神经网络(HNNs)会利用每条超边内部的结构模式。从直观上看,每个节点的重要性或角色可能会因所属超边的不同而有所差异。例如,模型 WHATsNet [20] 采用了序内位置编码(within-order positional encoding),将每条超边内的节点中心性排序作为 “依赖于超边的节点特征”(具体细节见第 3.3.2 节)。此外,一项研究 [99] 将每个节点或超边周边 “超图小图”(hypergraphlet)的出现频次作为输入特征 —— 所谓 “超图小图”,指预先定义的局部结构模式,用于描述几跳范围内超边的重叠关系。

研究中还采用了基于 “全局超图语境下节点角色与邻近性” 的全局结构特征。例如,模型 Hyper-SAGNN [166] 使用 Hyper2Vec [48] 的变体模型,融入能 “保留节点邻近性” 的结构特征;模型 VilLain [74] 利用从超图结构中推断出的 “潜在节点标签分布”;模型 HyperFeat [23] 通过 “随机游走”(random walks)捕捉节点的 “结构身份”;模型 THTN [112] 则整合了 “可学习的节点中心性、独特性及位置编码”。

3.1.3 身份特征:

部分超图神经网络(HNNs)会使用身份特征,这在推荐类应用中尤为常见。通常而言,身份特征指为每个节点(及超边)唯一分配的特征,其作用是让超图神经网络(HNNs)能够为每个节点(及超边)学习到独特的嵌入[159, 176]。以往研究通常采用两种形式的身份特征:一是随机生成的特征,二是可单独学习的特征 [55, 140–142]。

3.1.4 与图神经网络(GNNs)的对比:

为了在成对图上进行表示学习,图神经网络(GNNs)同样需要节点和 / 或边特征 [40, 155, 157];但图神经网络(GNNs)的典型结构特征 [29, 41, 127],并不聚焦于高阶交互(HOIs)。

3.2 Step 2: Express hypergraphs to reflect HOIs

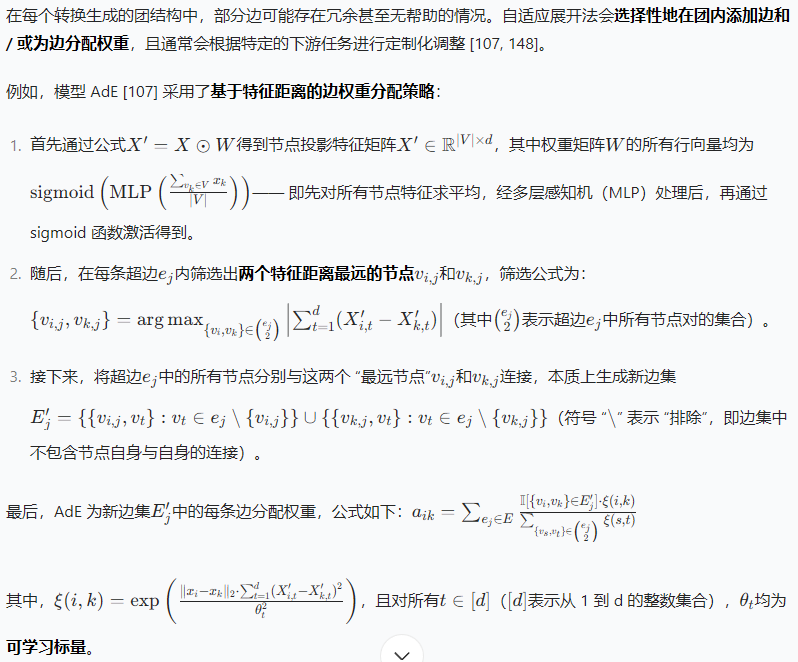

部分超图神经网络(HNNs)会对输入超图结构进行转换,以更好地捕捉潜在的高阶交互(HOIs)。它们采用的超图结构表示方式分为两类:(i)还原性表示;(ii)非还原性表示(见图 3)。

3.2.1 Reductive transformation 还原性转换

表示超图结构的一种方式是通过还原性转换。在这种方法中,原始超图中的每个节点都保留为(转换后)图中的节点,而超边则被转换为成对边(见图 3 (b))。还原性转换使得能够直接使得为普通图开发的方法(如谱滤波器 [34])可直接应用于超图。然而,这种转换可能会导致信息损失,且转换后可能无法精确还原原始超图结构。还原性转换包含两种实现方式:团展开法(clique expansion)与自适应展开法(adaptive expansion)。每种展开法均可表示为映射关系 τ : ( E , X , Y ) ↦ A \tau:(E, X, Y) \mapsto A τ:(E,X,Y)↦A,其中 A ∈ R ∣ V ∣ × ∣ V ∣ A \in \mathbb{R}^{|V| \times|V|} A∈R∣V∣×∣V∣(A为节点 - 节点邻接矩阵)。下文将详细阐述两种展开法下矩阵A中每个元素 a i j a_{ij} aij的定义。

图 3:示例超图(a)、其团展开图(b)及星展开图(c)。

Clique expansion 团展开法

Adaptive expansion 自适应展开法

3.2.2 Non-reductive transformation. 非还原性转换

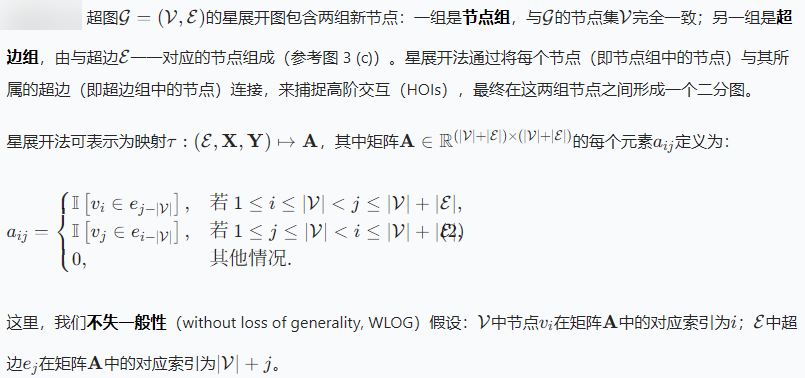

超图结构的非还原性转换包括星展开法 [17, 20, 113, 132]、线展开法 [154] 以及张量表示法 [59, 126, 131]。这类转换方法在表示超图结构时不会产生信息损失—— 也就是说,转换后可精确还原原始超边集 ε \varepsilon ε。

星展开法:

线展开法:

张量表示法:

3.2.3 与图神经网络(GNNs)的对比

图神经网络(GNNs)通常采用邻接矩阵 [67, 137]、个性化 PageRank 矩阵 [18, 38] 以及拉普拉斯矩阵 [91] 来表示图结构。

3.3 Step 3: Pass messages to reflect HOIs

结合输入特征(见第 3.1 节)与超图结构(见第 3.2 节),超图神经网络(HNNs)会学习节点(及超边)的嵌入。它们为每个节点(及超边)采用神经消息传递函数,用于从其他节点(及超边)聚合消息(即信息)。这一过程会产生三个问题:(i)应聚合哪些对象的消息?(ii)应聚合何种消息?(iii)应如何聚合这些消息?

3.3.1 Whose messages to aggregate (target selection) 聚合谁的消息(目标选择)

在星展开图上(消息传递方向为 V → E ‾ \underline{V \to E} V→E及 E → V ‾ \underline{E \to V} E→V):

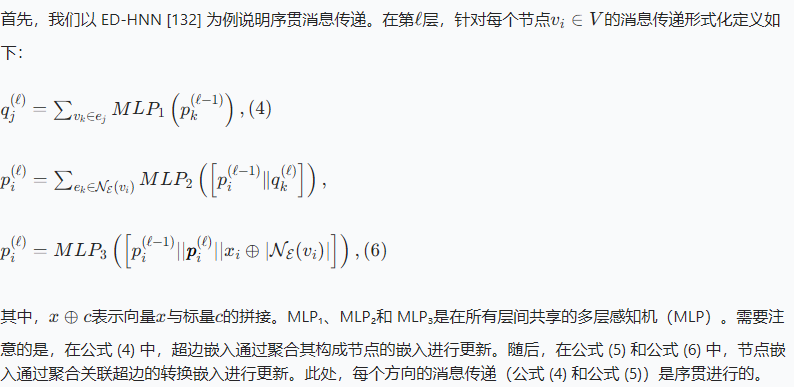

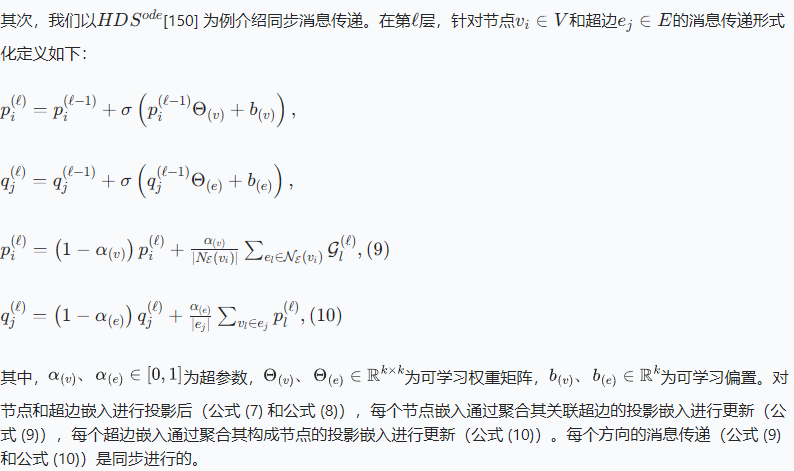

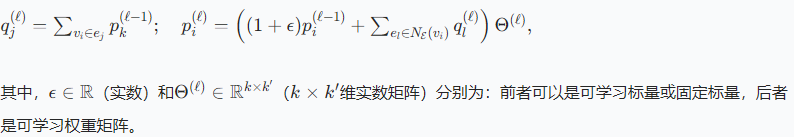

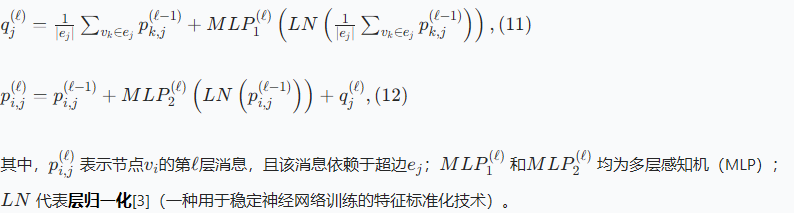

在基于星展开的超图神经网络(HNNs)中,消息传递会在 “节点组到超边组”( V → E V \to E V→E)以及 “超边组到节点组”( E → V E \to V E→V)之间进行 [17,20,25,132,150],传递方式或依次进行,或同步进行。

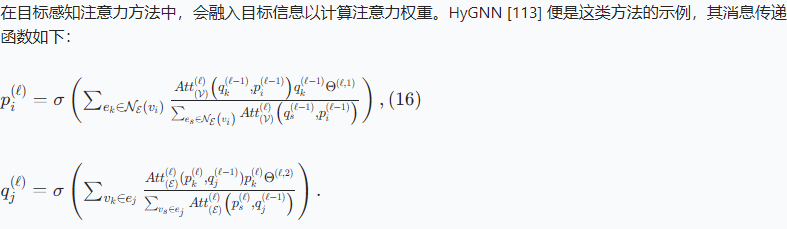

3.3.2 What messages to aggregate (message representation) 应聚合何种消息(消息表示)

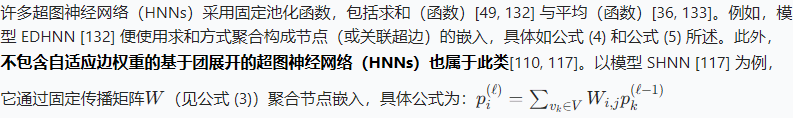

确定消息传递目标后,下一步是确定消息表示。超图神经网络(HNNs)通常将前一层的嵌入作为消息,我们将这类消息称为 “超边一致消息”[25, 49]。与之相对,近年来有多项研究提出基于消息传递目标的自适应消息转换,这类消息被我们称为 “超边依赖消息”[2, 20, 119, 170]。

超边一致消息:

这是一种被广泛采用的方法 [17, 49, 150]:直接将前一层的嵌入作为向量消息。典型示例为 UniGNN [49],这是一类超图神经网络(HNNs),通过聚合来自 “关联超边”(或 “构成节点”)的嵌入,得到节点(及超边)的嵌入。UniGIN 作为 UniGNN 的一个特例,其形式化定义如下:

超边依赖消息:

一个节点的作用或重要性,可能会因其所属的不同超边而有所差异 [19, 20]。已有多项研究 [2, 20, 119] 设计出 “超边依赖的节点消息”,使节点能向其所属的每条超边发送定制化消息。例如,模型 MultiSetMixer [119] 会为每条关联超边学习不同的节点消息以进行聚合,其消息传递函数定义如下:

此外,一些超图神经网络(HNNs)基于超边依赖的节点特征更新消息。WHATsNet [20] 引入了阶内位置编码(within-order positional encoding,wope),使节点消息能够适配每个目标。在每条超边内,WHATsNet 会根据节点的中心性对构成节点进行排序,以用于位置编码。

3.3.3 How to aggregate messages (aggregation function) 应如何聚合消息(聚合函数)

最后一步是确定针对每个节点(及超边),应如何聚合接收到的消息。

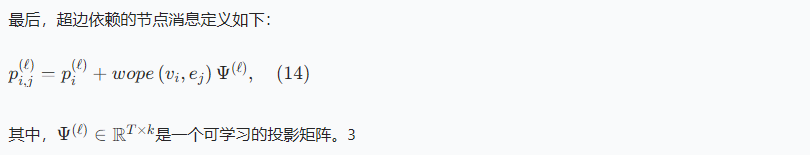

固定池化:

可学习池化:

近年来,有多项超图神经网络(HNNs)研究通过注意力机制增强其池化函数,从而在聚合过程中对消息进行加权。两种主要类型为目标无关注意力[15, 17] 和目标感知注意力[20, 113]。

3.3.4 与图神经网络(GNNs)的对比

图神经网络(GNNs)同样采用神经消息传递的方式从其他节点聚合信息 [39, 77, 85]。然而,由于 GNNs 通常直接在节点之间执行消息传递,因此它们并不适合用于学习超边(即高阶交互,HOI)表示或超边依赖的节点表示。

4 Objective Design Guidance

在本节中,我们概述了超图神经网络(HNNs)的训练目标,以实现对高阶交互(HOIs)的有效捕捉,尤其适用于标签监督较弱或缺失的场景。下文将综述三个研究方向:(i)分类学习、(ii)对比学习、(iii)生成学习。

4.1 Learning to classify

超图神经网络(HNNs)可通过将超边 [51, 68, 125, 149, 166] 分类为正超边或负超边的方式学习高阶交互(HOIs)。其中,正超边指真实存在的 “有效” 超边(即真值超边),负超边则通常是指通过启发式方法生成的 “伪” 超边,这类超边通常被认为是不可能存在的。通过对它们(正超边与负超边)进行分类学习,超图神经网络(HNNs)能够捕捉到真实存在的高阶交互(HOIs)所具备的区分性模式。

4.1.1 Heuristic negative sampling. 启发式负采样

我们在此探讨用于获取负超边的常用负采样(NS)策略 [104]:

-

尺寸负采样(Sized NS):每个负超边包含k个随机节点。

-

基序负采样(Motif NS):每个负超边包含随机选取的k个相邻节点。

-

团负采样(Clique NS):每个负超边通过如下方式生成 —— 将正超边中随机选取的一个节点,替换为另一个随机选取的、与剩余节点相邻的节点。

类似地,许多超图神经网络(HNNs)采用基于规则的负采样(NS)用于超边分类任务 [51, 68, 125, 149, 166]。另有研究则利用领域知识设计负采样(NS)策略 [16, 134]。

4.1.2 Learnable negative sampling.可学习负采样

值得注意的是,黄等人 [51] 的研究表明,使用上述负采样(NS)策略训练超图神经网络(HNNs),可能导致模型对特定类型的负超边产生过拟合。这可能是因为存在大量潜在负超边,而少量样本难以充分代表这一集合。为缓解该问题,他们采用对抗性训练方法训练一个生成器,用于采样负超边。

4.1.3 Comparison with GNNs.与图神经网络(GNNs)的对比

成对图(即普通图)中的链路预测任务,与高阶交互(HOI)分类任务相对应 [165, 176]。然而,两者之间 “可能的负边空间” 存在显著差异:在成对图中,该空间的规模为 O ( ∣ V ∣ 2 ) O(|V|^2) O(∣V∣2)(其中 O ( ⋅ ) O(\cdot) O(⋅)表示算法复杂度, ∣ V ∣ |V| ∣V∣为节点集合的大小)。

然而,在超图中,由于一条超边可包含任意数量的节点,其(可能的负超边)空间规模为 O ( 2 ∣ V ∣ ) O(2^{|V|}) O(2∣V∣)(其中 O ( ⋅ ) O(\cdot) O(⋅)表示算法复杂度, ∣ V ∣ |V| ∣V∣为节点集合的大小),这使得寻找具有代表性的 “不可能存在的” 高阶交互(HOIs)—— 即负超边 —— 变得更具挑战性 [51]。因此,通过对正超边和负超边进行分类来学习高阶交互(HOIs)的区分性模式,可能会面临更大的难度。

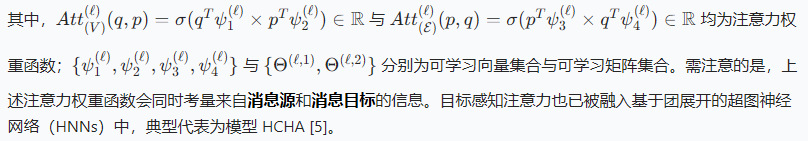

4.2 Learning to contrast

对比学习(Contrastive Learning, CL)旨在最大化从不同视角获取的数据之间的一致性。直观而言,“视角” 指的是同一数据的不同版本,包括原始数据和增强后的数据。采用对比学习训练神经网络,已被证明在捕捉输入数据的特征方面具备强大能力 [53]。针对超图神经网络(HNNs),研究人员已设计出多种对比学习技术用于学习高阶交互(HOIs)[64, 70, 136]。下文将阐述超图神经网络对比学习的三个步骤:(i)获取视角、(ii)编码、(iii)计算对比损失。

4.2.1 View creation and encoding. 视角构建与编码

首先,我们为对比任务获取视角。这一过程可通过对输入超图进行增强来实现,具体采用基于规则的方法 [64, 70] 或可学习的方法 [136]。

基于规则的增强:

该方法通过随机方式扰动节点特征与超边。针对节点:通过两种方式得到增强后的特征矩阵 —— 一是将矩阵X的部分元素(即特征值)置零 [68, 70],二是向这些元素添加高斯噪声 [108]。针对超边:通过两种方式得到增强后的超边 —— 一是从超边中移除部分节点 [70],二是扰动超边的成员构成(例如,将 e i = { v 1 , v 2 , v 3 } e_i = \{v_1, v_2, v_3\} ei={v1,v2,v3}调整为 e i ′ = { v 1 , v 2 , v 4 } e_i' = \{v_1, v_2, v_4\} ei′={v1,v2,v4})[87]。

可学习的增强:

该方法利用神经网络生成视角 [136]。具体而言,模型 HyperGCL [136] 通过基于超图神经网络(HNN)的变分自编码器(VAE)[65],生成合成超边 ε ′ \varepsilon' ε′。

编码:

随后,在两个视角上执行消息传递(共享相同参数),得到两组节点嵌入与超边嵌入对,分别记为 ( P ′ , Q ′ ) (P', Q') (P′,Q′)和 ( P ′ ′ , Q ′ ′ ) (P'', Q'') (P′′,Q′′)[68, 70]。

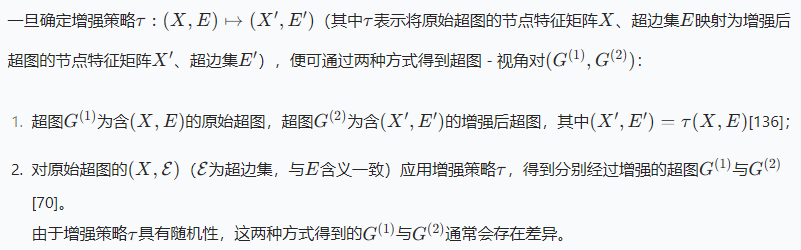

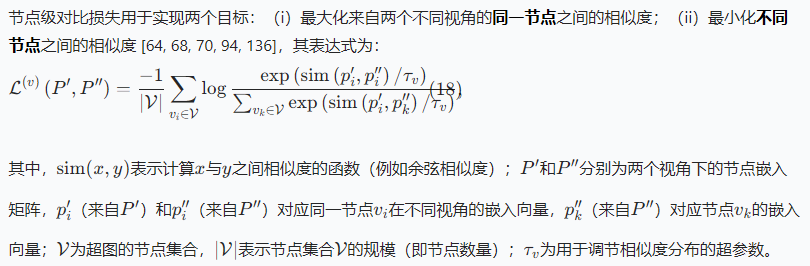

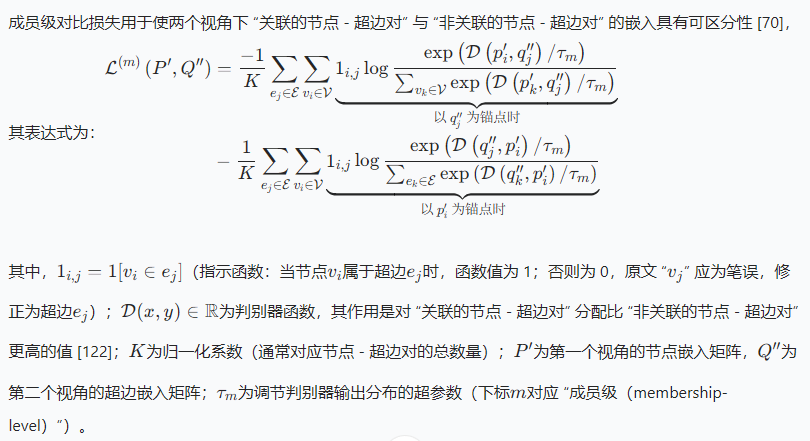

4.2.2 Contrastive loss. 对比损失函数

随后,我们选择一种对比损失函数。下文将介绍节点级、超边级和成员级的对比损失函数。此处, T x T_x Tx、 τ e \tau_e τe、 τ m ∈ R \tau_m \in \mathbb{R} τm∈R(属于实数集)均为超参数。

节点级:

超边级:

超边级对比损失的实现方式与之类似 [68, 70, 80],其表达式为:

L ( e ) ( Q ′ , Q ′ ′ ) = − 1 ∣ E ∣ ∑ e j ∈ E log exp ( sim ( q j ′ , q j ′ ′ ) / τ e ) ∑ e k ∈ E exp ( sim ( q j ′ , q k ′ ′ ) / τ e ) , \mathcal{L}^{(e)}\left(Q', Q''\right)=\frac{-1}{|\mathcal{E}|} \sum_{e_{j} \in \mathcal{E}} \log \frac{\exp \left(\text{sim}\left(q_{j}', q_{j}''\right) / \tau_{e}\right)}{\sum_{e_{k} \in \mathcal{E}} \exp \left(\text{sim}\left(q_{j}', q_{k}''\right) / \tau_{e}\right)} , L(e)(Q′,Q′′)=∣E∣−1∑ej∈Elog∑ek∈Eexp(sim(qj′,qk′′)/τe)exp(sim(qj′,qj′′)/τe),

成员级:

4.2.3 与图神经网络(GNNs)的对比

图神经网络(GNNs)通常也采用对比目标进行训练 [109, 122, 160]。它们的对比学习重点通常集中在节点级[122] 和 / 或图级[109]。

4.3 Learning to generate

超图神经网络(HNNs)也可通过学习生成超边的方式进行训练。现有超图神经网络的生成目标主要分为两类:(i)生成真实超边,以捕捉其特征;(ii)生成潜在超边,这类超边可能对指定的下游任务有益。

4.3.1 Generating ground-truth HOIs. 生成真实高阶交互(HOIs)

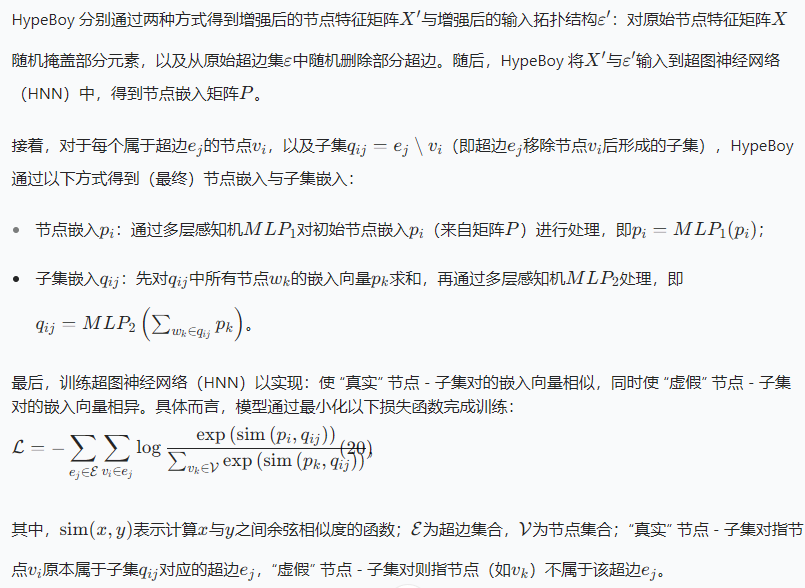

训练神经网络生成输入数据的方法,已在多个领域及下游任务中展现出显著效果 [45, 102]。在两项近期研究中,研究者通过训练超图神经网络(HNNs)生成真实超边,以实现对高阶交互(HOIs)的学习 [26, 63]。其中,Kim 等人 [63] 提出的模型 HypeBoy,将超边生成构建为一项超边补全任务—— 该任务的目标是为给定的超边子集,确定其所缺失的节点。总体而言,HypeBoy 的实现包含三个步骤:(i)超图增强、(ii)节点与超边子集编码、(iii)损失函数计算。

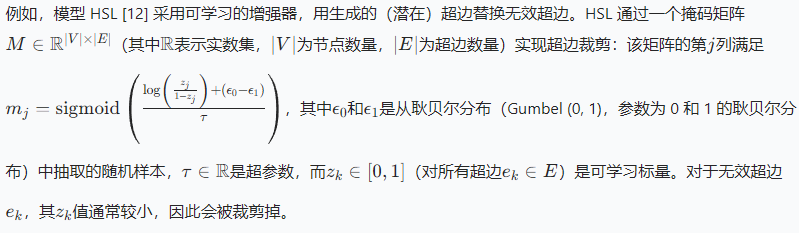

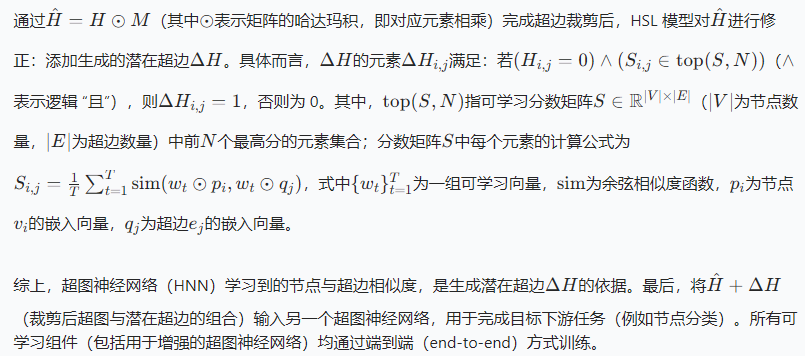

4.3.2 Generating latent HOIs.生成潜在高阶交互(HOIs)

超图神经网络(HNNs)可通过训练生成潜在超边,这一点在以下两种假设场景中尤为适用:(i)存在(半)监督下游任务;(ii)输入超图结构处于非最优状态。通常而言,相关训练方法会让超图神经网络生成具备潜在价值的超边,这些潜在超边将用于消息传递过程,以提升下游任务的性能 [12, 79, 162, 167]。

需注意的是,通过学习生成潜在超边的超图神经网络(HNNs),通常会引入额外的损失函数,以促使潜在超边与原始超边保持相似性 [162, 167]。此外,部分研究还探索了在输入超图结构不可用的场景下生成潜在高阶交互(HOIs)的方法 [37, 57, 172]。

4.3.3 与图神经网络(GNNs)的对比

多种图神经网络(GNNs)也以生成真实的成对交互 [66, 116] 或潜在的成对交互 [31] 为目标。在成对图中,两个节点嵌入的内积被广泛用于建模连接这两个节点的边的存在可能性 [31, 66]。然而,超边可连接任意数量的节点,使用内积来建模超边的存在可能性并非易事。

5 Application Guidance

超图神经网络(HNNs)已被应用于多个领域,包括推荐系统、生物信息学、医学、时间序列分析及计算机视觉。其核心问题包括超图构建与超图学习任务构建。

5.1 Recommendation

5.1.1 超图构建

在推荐系统应用中,众多研究采用由物品节点(被推荐对象)和用户超边(接收推荐的主体)构成的超图。例如,用户交互过的所有物品通过一条超边连接 [128];当存在会话(sessions)数据时,超边会依据上下文窗口将物品节点连接起来 [83, 129, 142]。

部分研究采用多超图结构:例如,Zhang 等人 [163] 的研究融入了用户级和群组级超图;Ji 等人 [55] 则构建了两个独立超图 —— 一个以物品为节点,另一个以用户为节点,这两个超图的超边均通过基于启发式的算法推导得到。与之不同的是,另有研究直接融入了可学习的超图结构[140, 141]。

5.1.2 应用任务

基于超图的建模使超图神经网络(HNNs)能够自然地应用于推荐任务,这类任务通常被构建为超边预测问题。超图神经网络已被用于序列推荐 [82, 128]、基于会话的推荐 [83, 129, 142]、群组推荐 [56, 163]、对话式推荐 [168] 以及兴趣点推荐 [69]。

5.2 Bioinformatics and medical science

5.2.1 超图构建

在生物信息学应用中,分子层面的结构常被视为节点。相关研究通过超边连接这些结构,连接依据包括:结构间的联合反应[16]、在每种药物中的存在状态[46, 113],以及与每种疾病的关联关系[46]。

部分研究采用了多节点类型:有研究将细胞系节点与药物节点纳入超图,通过超边连接存在协同作用关系的节点对 [89, 134];药物及其副作用也被视为节点,超边用于连接存在药物 - 药物相互作用的节点组合 [101];此外,药物节点或靶蛋白节点会依据其在相互作用或关联关系上的相似性,通过超边连接 [111]。另有研究采用k 近邻算法(kNN) 或可学习超边构建超图 [81, 105]。

其他一些研究采用超图对 MRI 数据进行建模。其中许多研究将感兴趣区域作为节点,而超边则通过交互强度估计 [130]、k 均值算法 [54] 或基于随机游走的采样 [14] 来连接这些节点。另一方面,在部分研究中,研究对象被作为节点,超边则用于连接通过 k 近邻算法(kNN)找到的邻居节点 [43, 96]。

最后,电子健康记录(EHR)数据常通过超图进行建模。在这类建模中,节点要么是医学编码 [13, 21, 138, 144, 145],要么是临床事件 [175];超边则用于连接由每位患者共享的医学编码或临床事件(即同一患者对应的医学编码或临床事件通过一条超边关联)。

5.2.2 应用任务

在生物信息学应用中,超图神经网络(HNNs)已被用于预测分子层面结构之间的相互作用或关联关系。因此,许多此类任务可自然地构建为超边预测任务。具体而言,相关应用任务包括:预测缺失的代谢反应 [16, 149]、药物 - 药物相互作用 [89, 101, 113, 134]、药物 - 靶点相互作用 [111]、药物 - 基因相互作用 [118]、草药 - 疾病关联关系 [46],以及微小 RNA(miRNA)- 疾病关联关系 [105]。

在磁共振成像(MRI)分析中,当以感兴趣区域(region-of-interest)作为节点时,超图神经网络(HNNs)已被用于解决超图分类问题。借助超图神经网络,研究人员已成功解决多项任务,包括:阿尔茨海默病分类 [43]、脑连接组分析 [130]、自闭症预测 [54, 96] 以及脑网络功能障碍预测 [14]。

在电子健康记录(EHR)数据的分析中,由于超边由患者的医学编码或临床事件构成,超图神经网络(HNNs)已被用于解决超边预测任务。相关研究通过超图神经网络实现了多项预测任务,包括:死亡率预测 [13]、再入院率预测 [13]、疾病诊断预测 [138]、用药方案预测 [138]、表型预测 [21, 145]、临床结局预测 [21, 144, 145] 以及临床路径预测 [175] 等。

5.3 Time series analysis

5.3.1 超图构建

在时间序列预测应用中,研究采用了多种类型的节点。根据数据差异,节点可以是城市 [133, 156]、燃气调节器 [156]、铁路路段 [156]、火车站 [133]、股票 [86, 114] 或区域 [84] 等。相关研究通常采用基于相似性或邻近性的超边[86, 114, 156],或是可学习超边[84, 86, 133] 来构建超图。

5.3.2 应用任务

在应用超图神经网络(HNNs)时,许多时间序列预测问题可构建为节点回归问题。具体而言,已有研究利用超图神经网络实现了多项预测任务,包括:出租车需求量预测 [156]、燃气压力预测 [156]、车辆速度预测 [156]、交通流量预测 [92, 115, 133, 139, 169]、电力消耗量预测 [115, 139]、气象指标预测 [115, 133]、股票(价格)预测 [86, 114] 以及犯罪(数量)预测 [84]。

5.4 Computer vision

5.4.1 超图构建

基于超图的建模方法也被应用于计算机视觉领域。相关研究将节点用于表示多种对象,包括图像块 [42]、特征 [152]、三维形状 [4]、关节点 [88, 146, 174] 以及人体 [47]。为通过超边连接节点,研究采用了 k 近邻算法(kNN)[4, 152]、模糊 C 均值算法(Fuzzy C-Means)[42] 及其他可学习函数 [88, 124, 146]。

5.4.2 应用任务

在计算机视觉任务中,已有研究利用超图神经网络(HNNs)解决多种问题,包括图像分类 [42]、目标检测 [42]、基于视频的行人重识别 [152]、图像修复 [124]、动作识别 [174]、姿态估计 [88, 146]、三维形状检索与识别 [4] 以及多人网格重建 [47]。由于所应用任务的异质性,目前尚未发现统一的超图学习任务构建方式。

6 Discussions

本文对超图神经网络(HNNs)进行综述,重点探讨其如何处理高阶交互(HOIs)问题。本综述旨在深入且全面,涵盖超图神经网络编码器(第 3 节)、训练目标(第 4 节)及应用场景(第 5 节)三大核心内容。在综述了呈指数级增长的相关文献后,本文最后提出了该领域的若干未来研究方向,以此收尾。

超图神经网络(HNN)理论

已有研究从理论层面探究了图神经网络(GNNs)的多项特性,包括图同构识别能力 [123, 143]、逼近能力 [58, 97],以及与同质性的关联 [78, 95]。然而,由于超图本身具有复杂特性,将这些理论结论直接应用于超图并非易事 [33]。因此,超图神经网络(HNNs)的诸多理论性质仍有待揭示,目前仅有部分领域已展开探索,例如其泛化能力 [171] 与迁移能力 [44]。

超图神经网络(HNNs)的优势

若不使用超图神经网络(HNNs),也可通过将超图结构简化为成对图结构,利用图神经网络(GNNs)处理超图相关任务。尽管已有研究通过实证表明,HNNs 的性能优于这类替代方案 [17, 25, 34, 63, 132],但使 HNNs 具备优势的核心因素仍不明确。此外,虽然已有研究探究了 “将高阶交互(HOIs)用于启发式分类器” 的优势 [158],但针对 HNNs 本身的专项研究,或将为改进 HNNs 模型及其训练策略提供新思路。

复杂超图

由高阶交互(HOIs)构成的网络通常具有时序性、有向性和异质性三类特征,这些特征分别通过时序超图[75]、有向超图[35] 和异质超图[50, 147] 进行建模。尽管学界已对这类超图的结构模式展开研究 [10, 62, 75, 99],但 “开发能学习此类复杂高阶交互的 HNNs 模型” 的研究尚处于早期阶段 [1, 50, 92, 120, 147, 173]。因此,亟需为复杂超图构建更多基准数据集与任务—— 合适的数据集和任务将推动相关研究,助力开发出能更好利用高阶交互复杂特性的 HNNs 模型。

Acknowledgements

本研究得到以下项目的部分资助:

韩国科学技术信息通信部(MSIT)资助的韩国信息与通信技术规划评价院(IITP)项目(编号:2022-0-00157,项目名称:《稳健、公平、可扩展的以数据为中心的持续学习》);

韩国科学技术信息通信部(MSIT)资助的韩国信息与通信技术规划评价院(IITP)项目(编号:RS-2019-II190075,项目名称:《韩国科学技术院(KAIST)人工智能研究生院项目》);

意大利国家研究委员会高性能计算、大数据与量子计算中心(ICSC)的 “FutureHPC & BigData” 分支项目(该项目由欧盟 “下一代欧盟”(NextGenerationEU)计划资助)。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)