【完整源码+数据集+部署教程】缺陷检测系统源码和数据集:改进yolo11-OREPA

【完整源码+数据集+部署教程】缺陷检测系统源码和数据集:改进yolo11-OREPA

背景意义

研究背景与意义

随着工业自动化和智能制造的快速发展,缺陷检测技术在生产过程中扮演着越来越重要的角色。传统的人工检测方法不仅效率低下,而且容易受到人为因素的影响,导致漏检和误检的发生。因此,开发高效、准确的自动化缺陷检测系统成为了当前工业界和学术界的研究热点。近年来,深度学习技术的飞速进步为缺陷检测提供了新的解决方案,尤其是基于卷积神经网络(CNN)的目标检测算法,如YOLO(You Only Look Once)系列模型,因其在实时性和准确性方面的优越表现而备受关注。

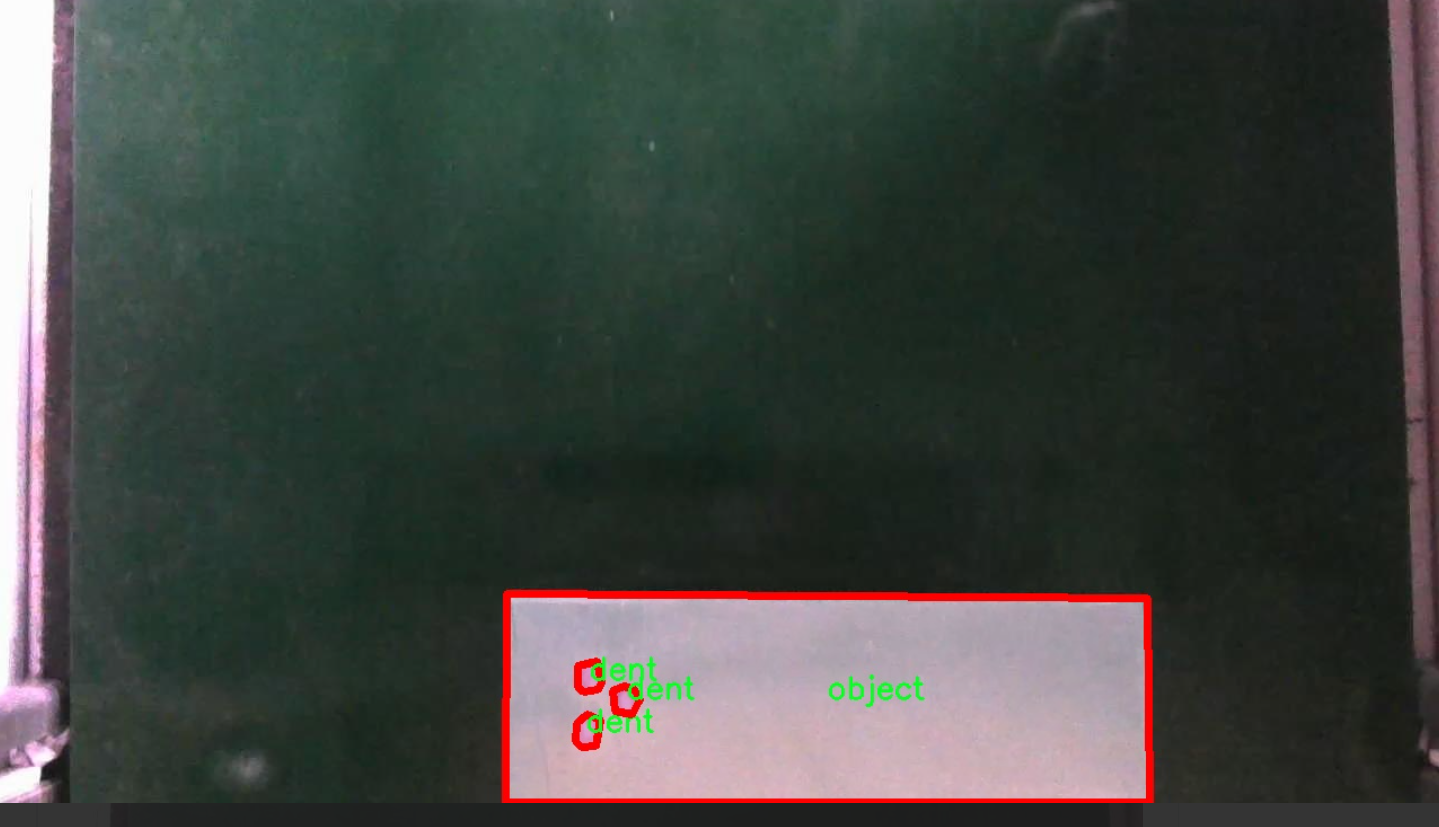

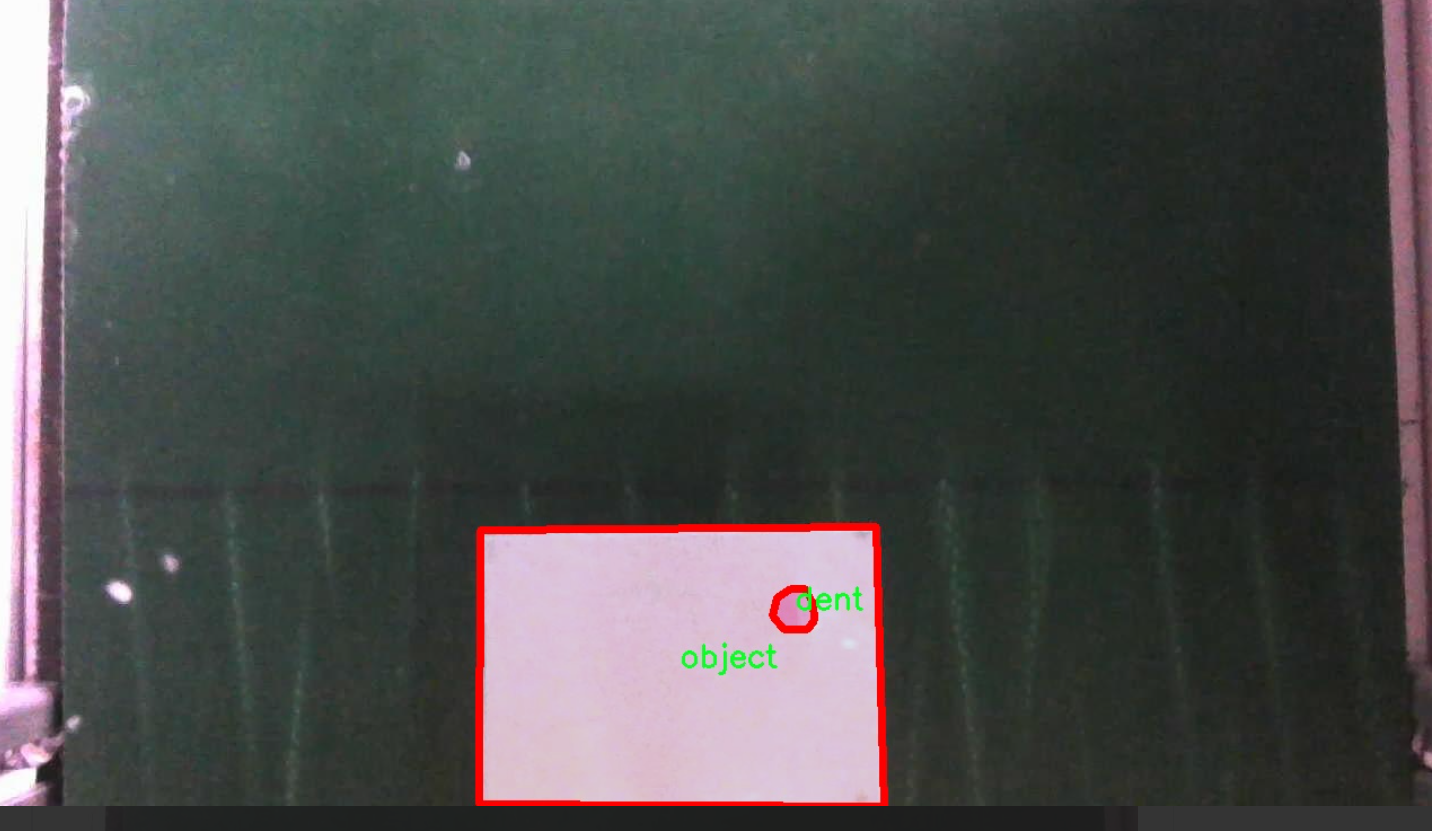

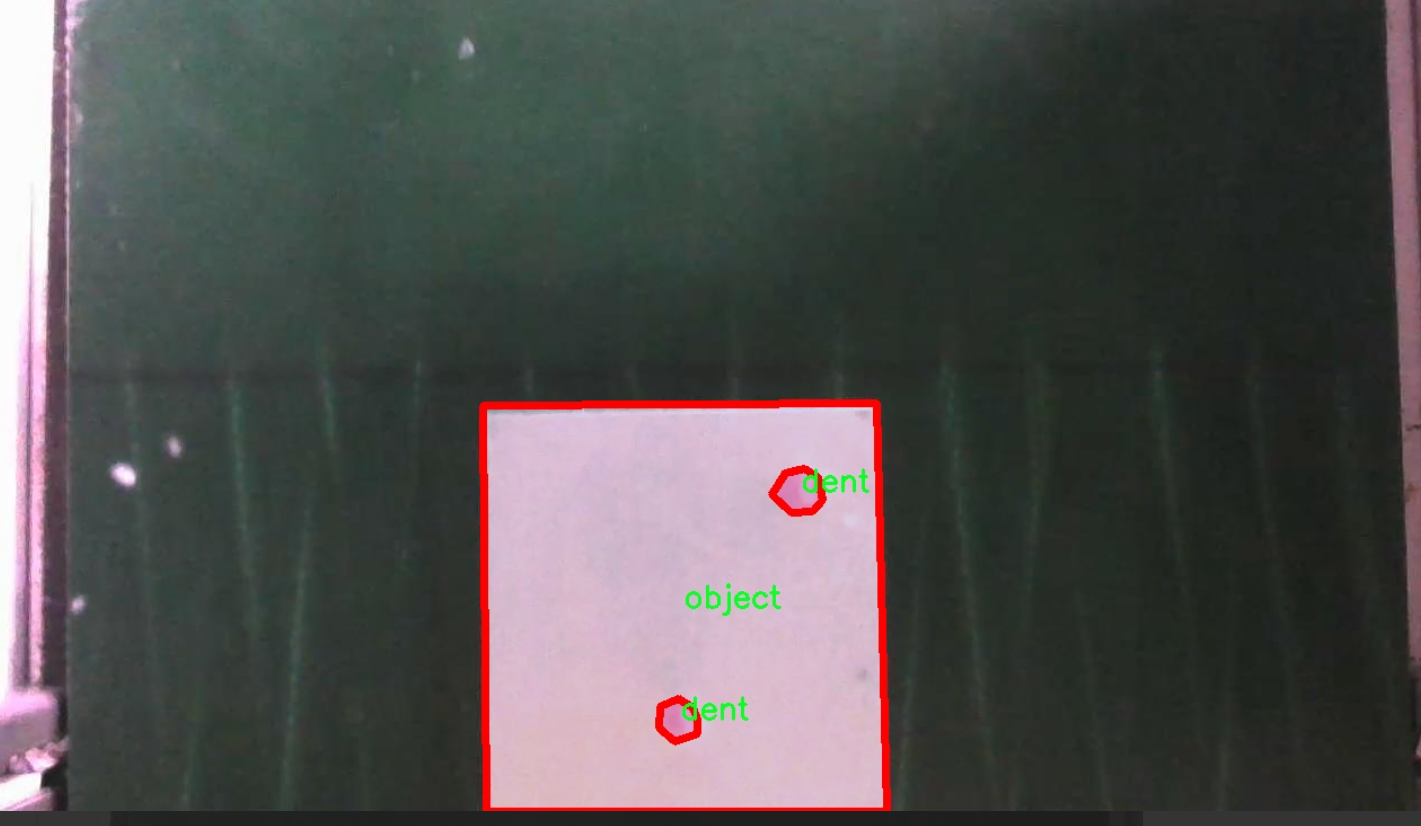

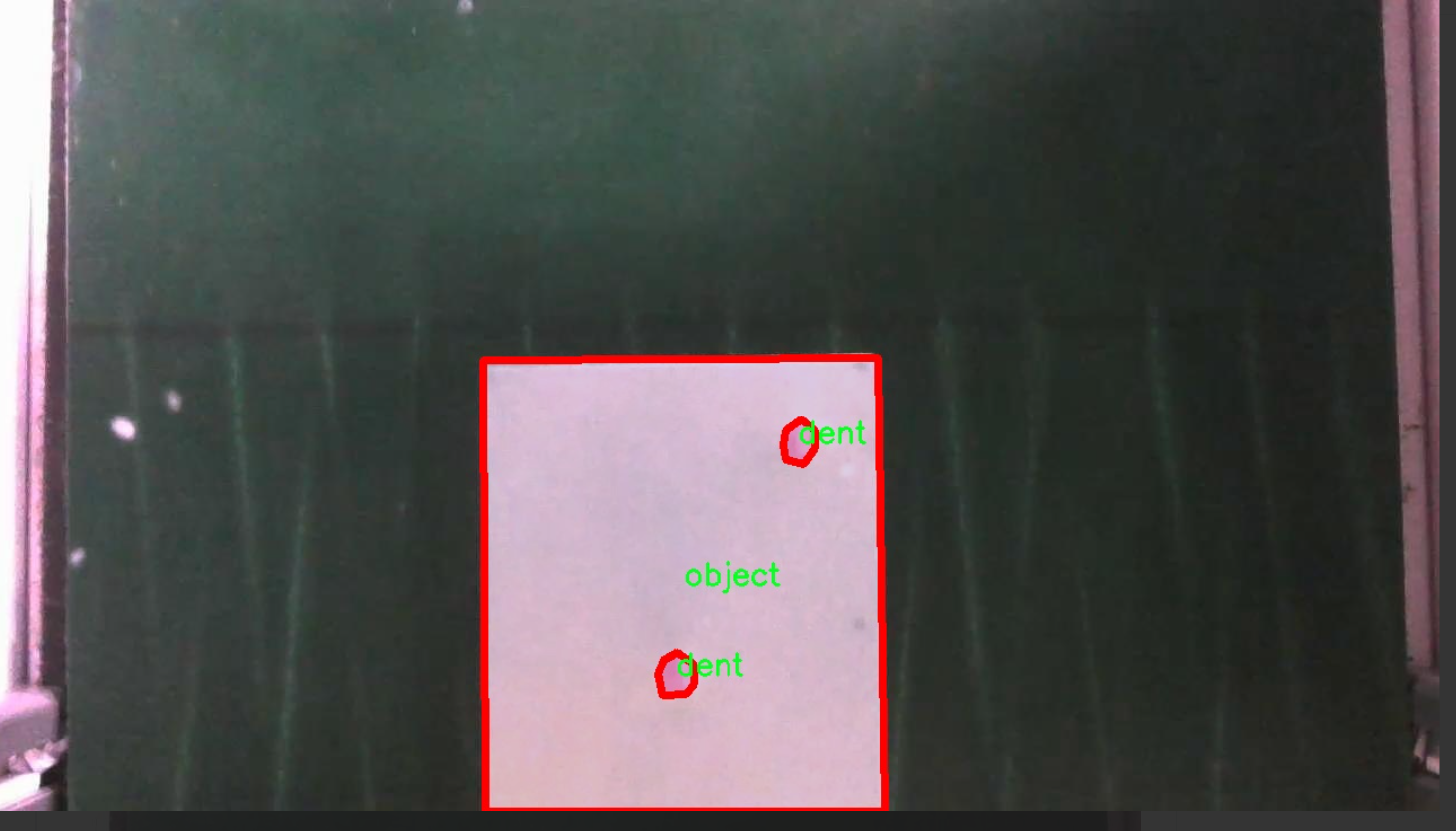

本研究旨在基于改进的YOLOv11模型,构建一个高效的缺陷检测系统。该系统将应用于多种工业场景,能够实时识别和分类不同类型的缺陷,包括黑色标记、角落缺陷、凹陷、孔洞、物体、划痕和侧面缺陷等。通过使用包含1800张图像的多类别数据集,我们希望能够训练出一个具有较高鲁棒性和准确性的模型,以应对实际生产中的复杂情况。

此外,缺陷检测系统的成功实施不仅能够提高产品质量,降低生产成本,还能显著提升生产效率,减少人工干预,推动智能制造的进一步发展。因此,本研究不仅具有重要的理论意义,还有着广泛的应用前景。通过对YOLOv11模型的改进和优化,我们期望能够为缺陷检测领域提供新的思路和方法,为相关行业的智能化转型贡献力量。

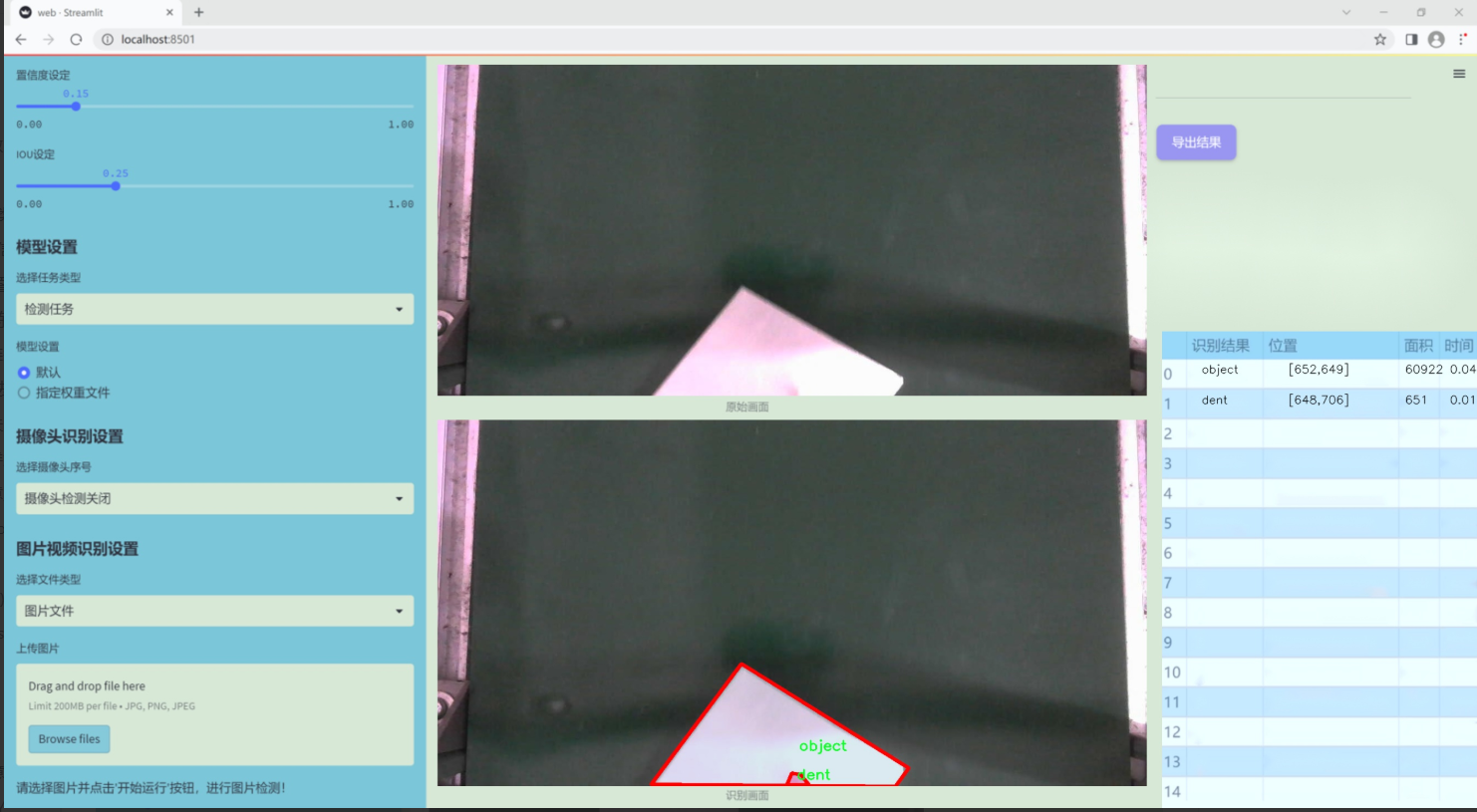

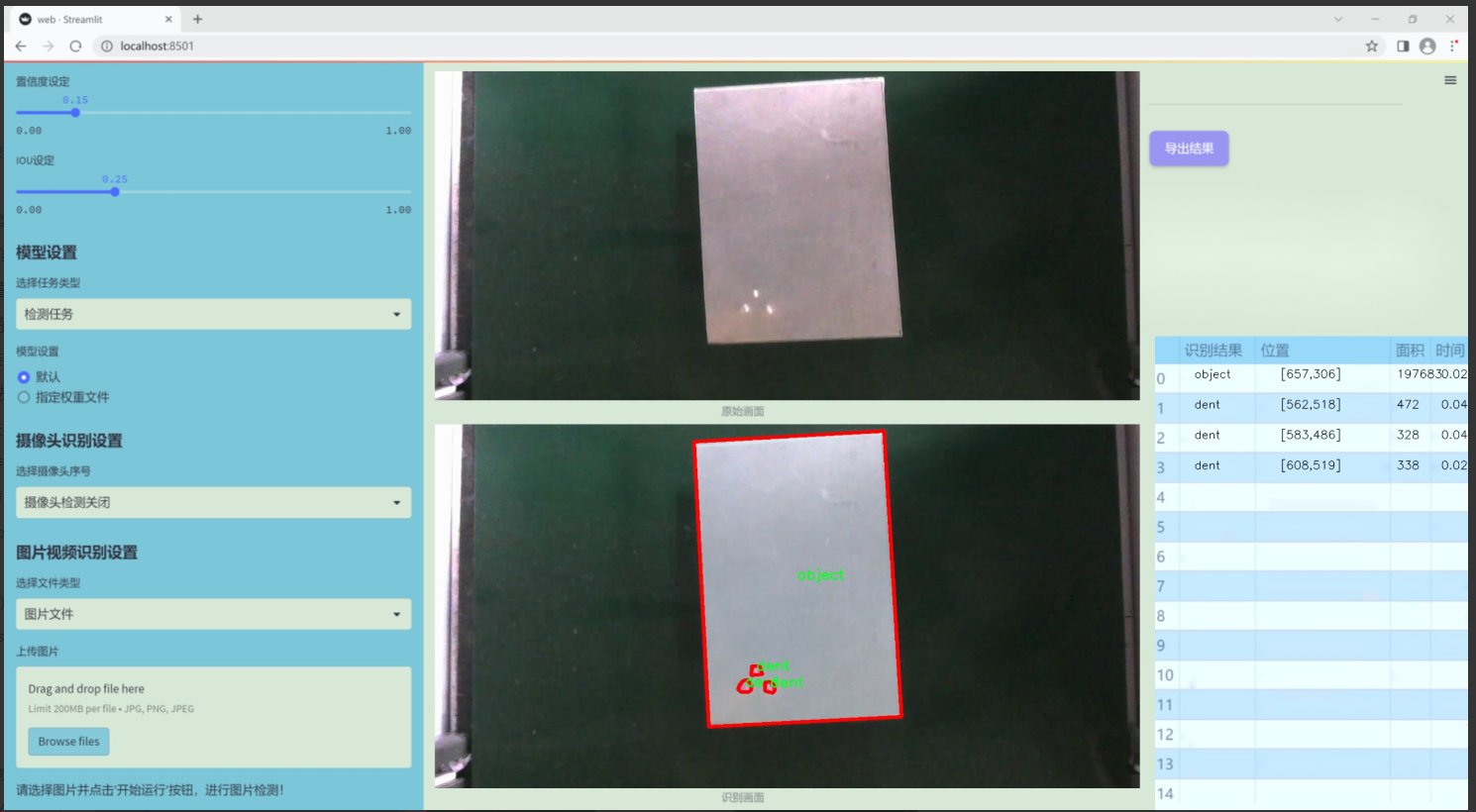

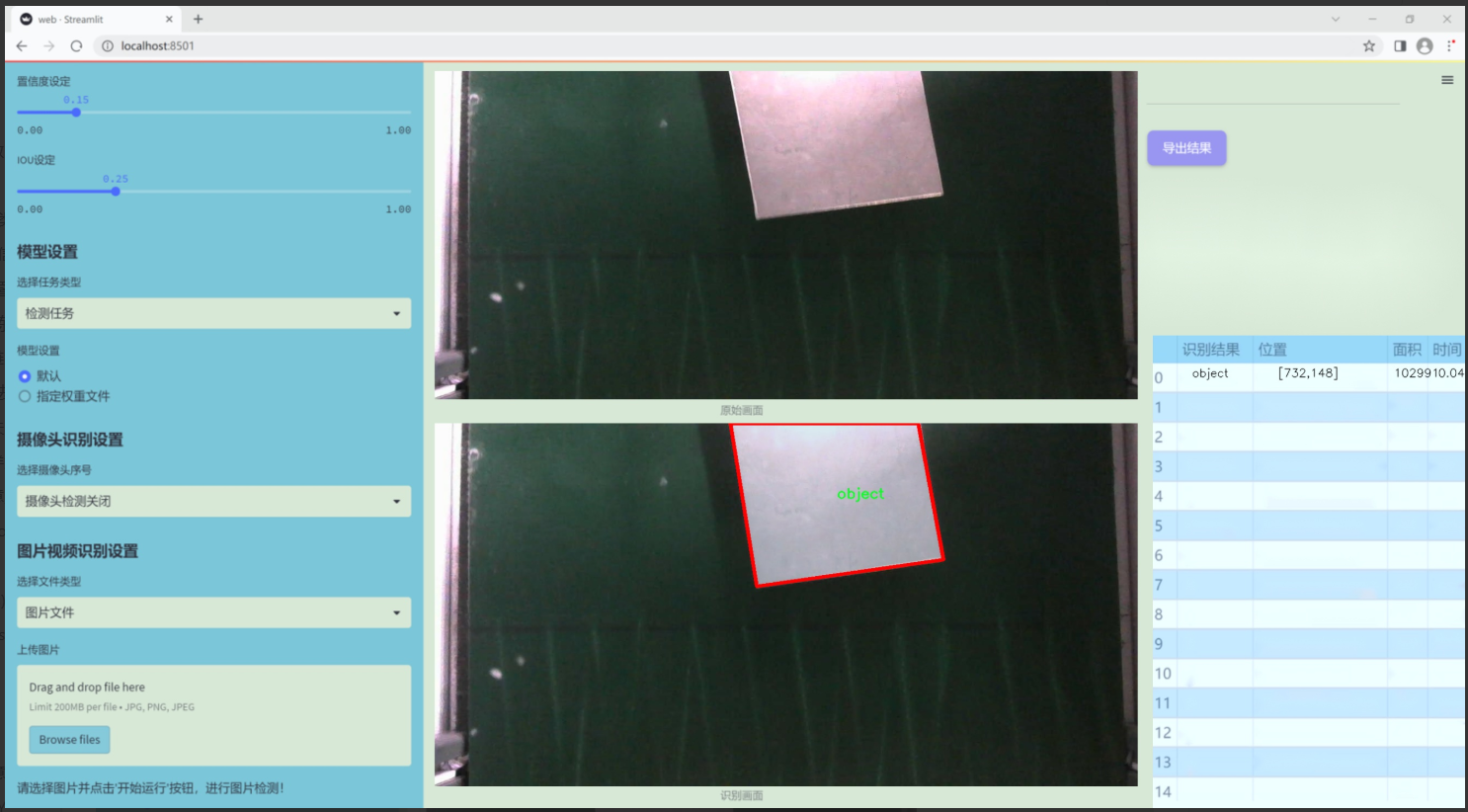

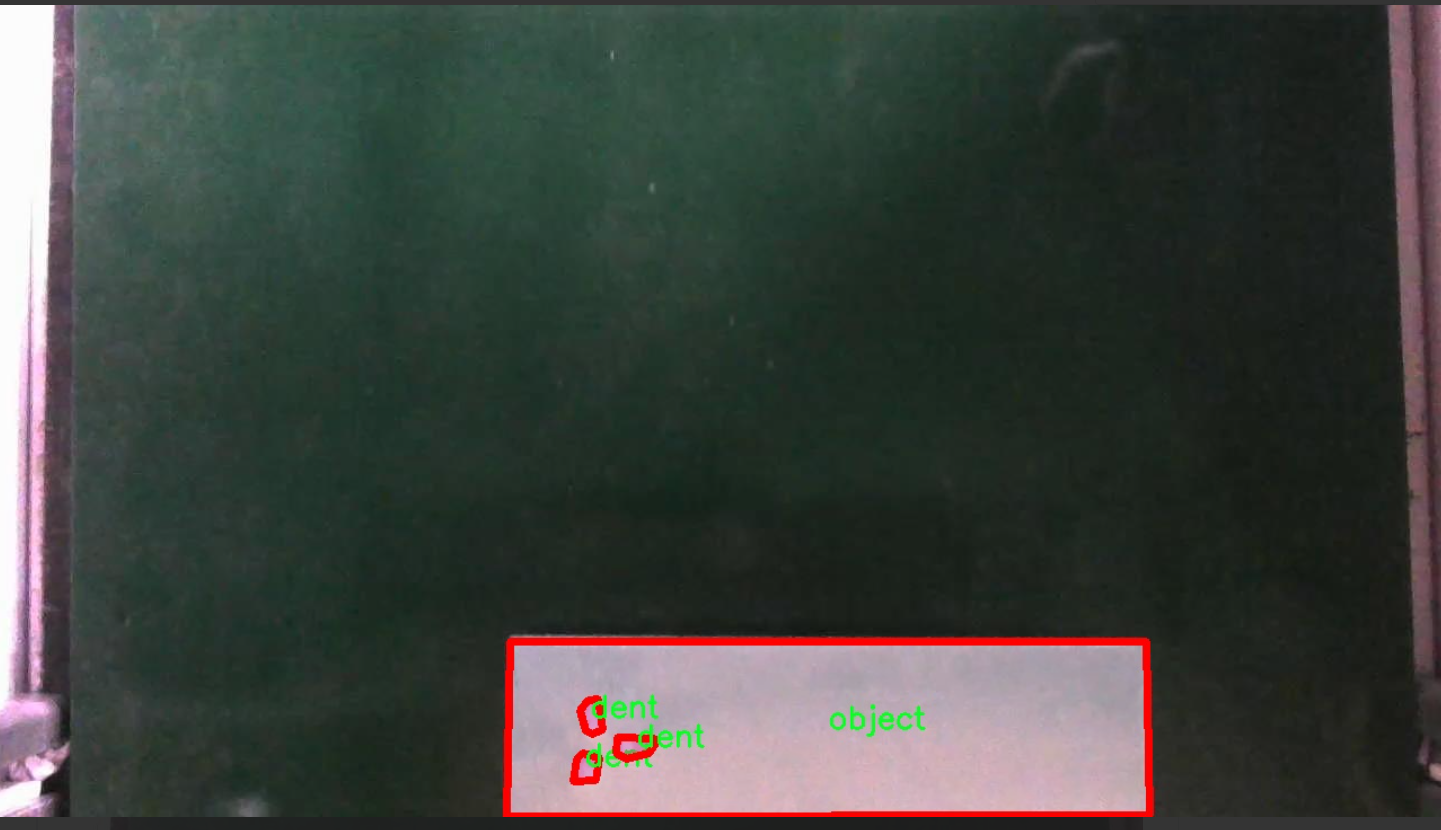

图片效果

数据集信息

本项目数据集信息介绍

本项目旨在通过改进YOLOv11模型,提升缺陷检测系统的性能。为此,我们构建了一个专门针对缺陷检测的高质量数据集。该数据集包含七个类别,分别为黑色标记、角落缺陷、凹陷、孔洞、物体、划痕和侧面缺陷。这些类别涵盖了在工业生产和质量控制中常见的多种缺陷类型,能够有效支持模型的训练与评估。

数据集的构建过程遵循严格的标准,确保每个类别的样本数量均衡且多样化,以便模型能够学习到不同缺陷的特征。黑色标记类别主要包括在产品表面上出现的色彩异常,角落缺陷则涉及到产品边缘的瑕疵。凹陷和孔洞类别则专注于物体表面的物理缺陷,反映了生产过程中的潜在问题。物体类别用于识别产品本身,而划痕和侧面缺陷则强调了表面损伤的不同形式。

数据集中每个类别的样本均经过精心标注,确保标注的准确性和一致性。这一过程不仅提高了数据集的质量,也为后续的模型训练提供了可靠的基础。通过使用该数据集,改进后的YOLOv11模型将能够更好地识别和分类不同类型的缺陷,从而在实际应用中实现更高的检测精度和效率。

总之,本项目的数据集不仅丰富多样,且具备良好的标注质量,为缺陷检测系统的研究和开发提供了坚实的基础。我们期待通过这一数据集的应用,推动缺陷检测技术的进步,为相关行业的质量控制提供有力支持。

核心代码

以下是经过简化和注释的核心代码部分,主要保留了 ChannelTransformer 类及其相关组件,以便于理解其结构和功能。

import torch

import torch.nn as nn

import numpy as np

from torch.nn import Dropout, LayerNorm

class Channel_Embeddings(nn.Module):

“”“构建通道嵌入,包括位置嵌入和补丁嵌入。”“”

def init(self, patchsize, img_size, in_channels):

super().init()

img_size = (img_size, img_size) # 将图像大小转换为元组

patch_size = (patchsize, patchsize) # 将补丁大小转换为元组

n_patches = (img_size[0] // patch_size[0]) * (img_size[1] // patch_size[1]) # 计算补丁数量

# 定义补丁嵌入层

self.patch_embeddings = nn.Sequential(

nn.MaxPool2d(kernel_size=5, stride=5), # 最大池化层

nn.Conv2d(in_channels=in_channels,

out_channels=in_channels,

kernel_size=patchsize // 5,

stride=patchsize // 5) # 卷积层

)

# 定义位置嵌入参数

self.position_embeddings = nn.Parameter(torch.zeros(1, n_patches, in_channels))

self.dropout = Dropout(0.1) # Dropout层

def forward(self, x):

"""前向传播,计算嵌入。"""

if x is None:

return None

x = self.patch_embeddings(x) # 计算补丁嵌入

x = x.flatten(2) # 展平

x = x.transpose(-1, -2) # 转置

embeddings = x + self.position_embeddings # 加上位置嵌入

embeddings = self.dropout(embeddings) # 应用Dropout

return embeddings

class ChannelTransformer(nn.Module):

“”“通道变换器模型。”“”

def init(self, channel_num=[64, 128, 256, 512], img_size=640, patchSize=[40, 20, 10, 5]):

super().init()

# 定义每个通道的嵌入层

self.embeddings_1 = Channel_Embeddings(patchSize[0], img_size=img_size // 8, in_channels=channel_num[0])

self.embeddings_2 = Channel_Embeddings(patchSize[1], img_size=img_size // 16, in_channels=channel_num[1])

self.embeddings_3 = Channel_Embeddings(patchSize[2], img_size=img_size // 32, in_channels=channel_num[2])

self.embeddings_4 = Channel_Embeddings(patchSize[3], img_size=img_size // 64, in_channels=channel_num[3]) if len(channel_num) == 4 else nn.Identity()

def forward(self, en):

"""前向传播,计算通道嵌入。"""

if len(en) == 3:

en1, en2, en3 = en

en4 = None

elif len(en) == 4:

en1, en2, en3, en4 = en

# 计算每个输入的嵌入

emb1 = self.embeddings_1(en1) if en1 is not None else None

emb2 = self.embeddings_2(en2) if en2 is not None else None

emb3 = self.embeddings_3(en3) if en3 is not None else None

emb4 = self.embeddings_4(en4) if en4 is not None else None

# 这里省略了编码和重构的部分,假设有一个编码器和重构层

# encoded1, encoded2, encoded3, encoded4 = self.encoder(emb1, emb2, emb3, emb4)

# x1 = self.reconstruct_1(encoded1) if en1 is not None else None

# x2 = self.reconstruct_2(encoded2) if en2 is not None else None

# x3 = self.reconstruct_3(encoded3) if en3 is not None else None

# x4 = self.reconstruct_4(encoded4) if en4 is not None else None

# 返回重构后的结果

return [emb1, emb2, emb3, emb4] # 这里简化为返回嵌入

示例:创建一个通道变换器实例

model = ChannelTransformer()

代码注释说明:

Channel_Embeddings 类:负责生成输入图像的补丁嵌入和位置嵌入。通过卷积和池化操作将输入图像转换为补丁表示,并添加位置嵌入以保留空间信息。

ChannelTransformer 类:是整个模型的核心,包含多个通道嵌入层。前向传播方法中,输入图像经过嵌入层处理,生成嵌入表示。

省略了编码和重构的具体实现部分,以简化代码结构,集中在通道嵌入和模型框架的理解上。

这个程序文件 CTrans.py 实现了一个基于通道的变换器(Channel Transformer),主要用于图像处理任务。代码使用了 PyTorch 框架,包含多个类和模块,每个模块负责不同的功能。

首先,文件导入了一些必要的库,包括 torch 和 torch.nn,并定义了一些基本的类。整个模型的结构由多个组件组成,主要包括通道嵌入、重构、注意力机制、前馈网络和编码器等。

Channel_Embeddings 类负责从输入图像中提取特征并生成嵌入。它使用最大池化和卷积层来处理输入图像,生成不同的补丁(patch)嵌入,并添加位置嵌入以保留空间信息。最终,经过 dropout 层处理后返回嵌入结果。

Reconstruct 类用于将嵌入重构回图像空间。它通过上采样和卷积层将特征图的维度调整到所需的输出通道数,并应用批归一化和激活函数。

Attention_org 类实现了多头注意力机制。它接收多个嵌入作为输入,并计算注意力权重。通过线性变换生成查询(Query)、键(Key)和值(Value),并计算注意力分数。最终,使用 softmax 函数归一化这些分数,得到注意力概率,并与值相乘以生成上下文层。

Mlp 类实现了一个简单的前馈神经网络,包含两个线性层和激活函数。它用于对嵌入进行进一步的处理。

Block_ViT 类是一个变换器块,结合了注意力机制和前馈网络。它对输入的嵌入进行层归一化、注意力计算和前馈处理,并将结果与原始输入相加,以实现残差连接。

Encoder 类包含多个变换器块,负责处理输入的嵌入并返回编码后的结果。它同样应用层归一化。

ChannelTransformer 类是整个模型的核心,负责初始化嵌入、编码器和重构模块。它根据输入的图像特征生成嵌入,经过编码器处理后,再通过重构模块将特征图转换回原始图像空间。

最后,GetIndexOutput 类用于从输出中提取特定索引的结果,方便后续处理。

总体而言,这个程序实现了一个复杂的图像处理模型,利用通道嵌入和多头注意力机制来提取和重构图像特征,适用于各种计算机视觉任务。

10.4 revcol.py

以下是代码中最核心的部分,并附上详细的中文注释:

import torch

import torch.nn as nn

定义一个反向传播的自定义函数

class ReverseFunction(torch.autograd.Function):

@staticmethod

def forward(ctx, run_functions, alpha, *args):

# 提取运行的函数和alpha值

l0, l1, l2, l3 = run_functions

alpha0, alpha1, alpha2, alpha3 = alpha

# 保存上下文信息

ctx.run_functions = run_functions

ctx.alpha = alpha

# 确保输入参数的数量为5

assert len(args) == 5

[x, c0, c1, c2, c3] = args

# 使用无梯度计算

with torch.no_grad():

# 逐层计算输出

c0 = l0(x, c1) + c0 * alpha0

c1 = l1(c0, c2) + c1 * alpha1

c2 = l2(c1, c3) + c2 * alpha2

c3 = l3(c2, None) + c3 * alpha3

# 保存中间结果以便反向传播使用

ctx.save_for_backward(x, c0, c1, c2, c3)

return x, c0, c1, c2, c3

@staticmethod

def backward(ctx, *grad_outputs):

# 从上下文中恢复保存的张量

x, c0, c1, c2, c3 = ctx.saved_tensors

l0, l1, l2, l3 = ctx.run_functions

alpha0, alpha1, alpha2, alpha3 = ctx.alpha

# 提取梯度输出

gx_right, g0_right, g1_right, g2_right, g3_right = grad_outputs

# 分别计算每一层的梯度

# 这里省略了具体的计算过程,核心思想是使用链式法则反向传播梯度

# 具体的实现可以参考原代码

# 返回每一层的梯度

return None, None, gx_up, g0_left, g1_left, g2_left, g3_left

定义一个网络模块

class SubNet(nn.Module):

def init(self, channels, layers, kernel, first_col, save_memory) -> None:

super().init()

self.save_memory = save_memory

# 定义每一层的alpha参数

self.alpha0 = nn.Parameter(torch.ones((1, channels[0], 1, 1)), requires_grad=True)

self.alpha1 = nn.Parameter(torch.ones((1, channels[1], 1, 1)), requires_grad=True)

self.alpha2 = nn.Parameter(torch.ones((1, channels[2], 1, 1)), requires_grad=True)

self.alpha3 = nn.Parameter(torch.ones((1, channels[3], 1, 1)), requires_grad=True)

# 定义网络的各个层

self.level0 = Level(0, channels, layers, kernel, first_col)

self.level1 = Level(1, channels, layers, kernel, first_col)

self.level2 = Level(2, channels, layers, kernel, first_col)

self.level3 = Level(3, channels, layers, kernel, first_col)

def forward(self, *args):

# 根据save_memory的值选择前向传播方式

if self.save_memory:

return self._forward_reverse(*args)

else:

return self._forward_nonreverse(*args)

定义主网络

class RevCol(nn.Module):

def init(self, kernel=‘C2f’, channels=[32, 64, 96, 128], layers=[2, 3, 6, 3], num_subnet=5, save_memory=True) -> None:

super().init()

self.num_subnet = num_subnet

self.channels = channels

self.layers = layers

# 定义网络的输入层

self.stem = Conv(3, channels[0], k=4, s=4, p=0)

# 添加多个子网络

for i in range(num_subnet):

first_col = True if i == 0 else False

self.add_module(f'subnet{str(i)}', SubNet(channels, layers, kernel, first_col, save_memory=save_memory))

def forward(self, x):

# 逐层进行前向传播

c0, c1, c2, c3 = 0, 0, 0, 0

x = self.stem(x)

for i in range(self.num_subnet):

c0, c1, c2, c3 = getattr(self, f'subnet{str(i)}')(x, c0, c1, c2, c3)

return [c0, c1, c2, c3]

代码核心部分解释:

ReverseFunction: 这是一个自定义的反向传播函数,使用 torch.autograd.Function 实现。它的 forward 方法计算前向传播的输出,并保存必要的中间结果以供反向传播使用。backward 方法则实现了反向传播的逻辑,通过链式法则计算每一层的梯度。

SubNet: 这是一个子网络模块,包含多个层级。根据 save_memory 的值选择不同的前向传播策略,支持内存优化。

RevCol: 这是主网络模块,负责构建整个网络结构,包括输入层和多个子网络。它的 forward 方法依次调用每个子网络进行前向传播。

这些部分构成了整个模型的核心逻辑,涉及到前向传播和反向传播的实现。

这个程序文件 revcol.py 实现了一个深度学习模型的反向传播机制,主要用于图像处理或计算机视觉任务。该模型采用了反向传播的策略来优化计算资源,特别是在处理大规模数据时。以下是对代码的详细讲解。

首先,文件导入了必要的库,包括 PyTorch 及其神经网络模块。接着,定义了一些辅助函数,例如 get_gpu_states、get_gpu_device、set_device_states 和 detach_and_grad,这些函数用于管理 GPU 状态、获取当前使用的 GPU 设备、设置设备状态以及处理张量的梯度。

get_gpu_states 函数用于获取当前 GPU 的随机数生成器状态,get_gpu_device 函数则用于提取输入张量所使用的 GPU 设备。set_device_states 函数可以设置 CPU 和 GPU 的随机数生成器状态,而 detach_and_grad 函数则用于从输入中分离出张量并使其能够计算梯度。

接下来,定义了一个名为 ReverseFunction 的类,它继承自 torch.autograd.Function。这个类实现了自定义的前向和反向传播方法。在前向传播中,它接受多个函数和参数,计算出一系列的中间结果,并保存必要的状态以供反向传播使用。在反向传播中,它通过保存的状态和中间结果,计算梯度并更新模型参数。

随后,定义了 Fusion、Level 和 SubNet 类。Fusion 类负责在不同层之间进行特征融合,Level 类则定义了模型的不同层次结构,包括卷积操作和融合操作。SubNet 类是一个子网络,它包含多个层次和参数,并根据是否保存内存的设置选择不同的前向传播策略。

最后,定义了 RevCol 类,这是整个模型的核心。它初始化了多个子网络,并在前向传播中依次调用这些子网络,最终返回各个层次的输出。RevCol 类的构造函数允许用户指定卷积核类型、通道数、层数以及子网络的数量等参数。

整体而言,这个程序文件实现了一个复杂的深度学习模型,采用了反向传播和特征融合的策略,以提高计算效率和模型性能。通过合理管理 GPU 状态和内存使用,模型能够在处理大规模数据时表现出色。

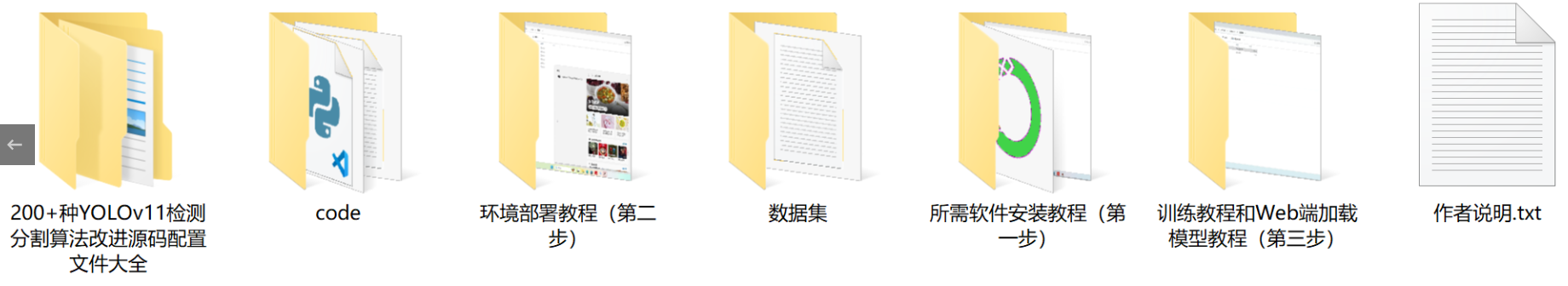

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献70条内容

已为社区贡献70条内容

所有评论(0)