基于对抗自编码器(AAE)的图像生成模型实现与Matlab代码解析

经验表明,交替训练时对抗阶段的迭代次数设为重构阶段的1/3左右比较合适。比如把数字"3"的编码z1和"8"的z2进行混合,生成中间图像时会看到数字平滑过渡,甚至出现类似"日式饭团"的融合形态。在图像生成领域,对抗自编码器(AAE)像是个会变魔术的工程师——既擅长特征压缩又懂得制造以假乱真的画面。今天咱们用Matlab扒开它的实现细节,看看这个融合自编码器和对抗训练的黑盒子到底怎么运作的。编码器最后

基于对抗自编码器(AAE)的图像生成模型 matlab代码

在图像生成领域,对抗自编码器(AAE)像是个会变魔术的工程师——既擅长特征压缩又懂得制造以假乱真的画面。今天咱们用Matlab扒开它的实现细节,看看这个融合自编码器和对抗训练的黑盒子到底怎么运作的。

先来看个精简版的AAE架构:

% 编码器结构

encoder = [

imageInputLayer([28 28 1])

convolution2dLayer(5,16,'Stride',2,'Padding','same')

reluLayer

convolution2dLayer(5,32,'Stride',2,'Padding','same')

reluLayer

fullyConnectedLayer(20)

];

% 解码器结构

decoder = [

fullyConnectedLayer(7*7*32)

reshapeLayer([7 7 32])

transposedConv2dLayer(5,16,'Stride',2,'Cropping','same')

reluLayer

transposedConv2dLayer(5,1,'Stride',2,'Cropping','same')

sigmoidLayer];编码器最后的20维输出就是潜在空间z,这里有个精妙的设计:前10维用于重构图像,后10维要和对抗网络玩猫鼠游戏。转置卷积层的参数设置挺讲究,5x5的核尺寸配合步长2能有效还原图像细节。

对抗训练部分才是AAE的灵魂所在:

% 对抗判别器

discriminator = [

featureInputLayer(10)

fullyConnectedLayer(64)

leakyReluLayer(0.2)

fullyConnectedLayer(1)

sigmoidLayer];这个轻量级的判别器就像质量检测员,专门识别潜在变量z是来自真实分布还是生成器。注意leaky ReLU的负斜率设为0.2,这比标准ReLU更适合对抗训练,能缓解梯度消失问题。

训练过程中有个双阶段循环很有意思:

- 重构阶段:让MNIST数字通过编码-解码流程,最小化像素级MSE损失

- 对抗阶段:固定编码器,训练判别器识别"假"的z;然后固定判别器,骗它把生成的z判为真

% 核心训练片段

for epoch = 1:numEpochs

% 重构阶段

[loss_recon, grad] = dlfeval(@modelGradients, ...);

% 对抗阶段

[loss_adv, grad] = dlfeval(@adversarialGradients, ...);

% 参数更新

[encoder, decoder, discriminator] = updateParameters(...);

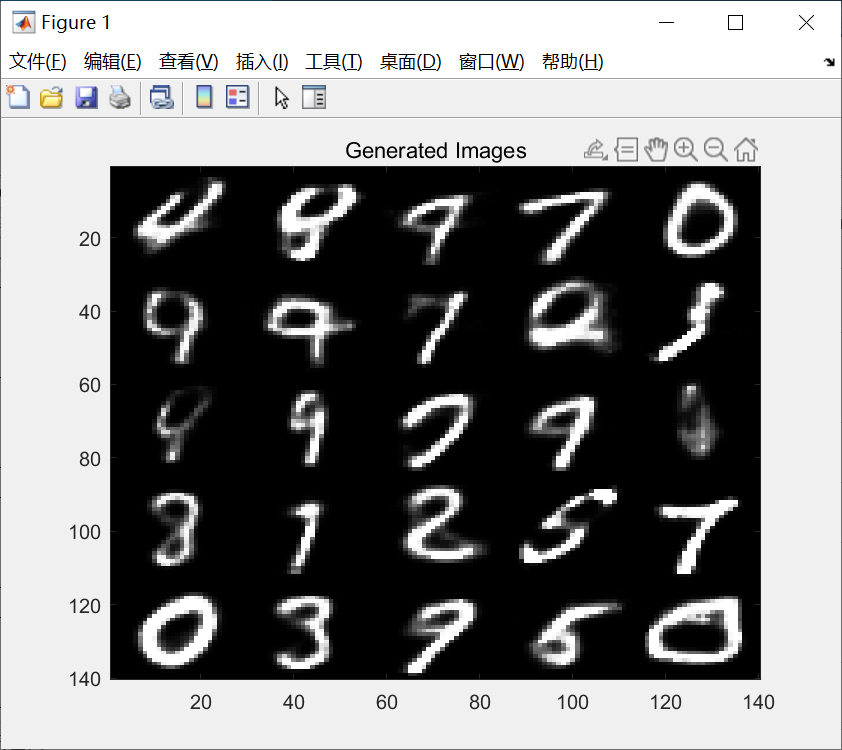

end实际跑代码时会发现,潜在空间z的分布会逐渐向标准正态分布靠拢。这个特性非常实用——想要生成新图片时,随便从N(0,1)采样个z扔给解码器,就能得到像模像样的手写数字。

不过AAE也有自己的小脾气:如果对抗训练太强,重构质量会下降;反之又会导致生成效果差。经验表明,交替训练时对抗阶段的迭代次数设为重构阶段的1/3左右比较合适。另外在解码器最后一层用sigmoid激活而非tanh,因为MNIST像素值本来就是0-1范围。

最终效果验证时可以玩个有趣的实验:在潜在空间做线性插值。比如把数字"3"的编码z1和"8"的z2进行混合,生成中间图像时会看到数字平滑过渡,甚至出现类似"日式饭团"的融合形态。这说明模型确实学到了有意义的表征,而不只是简单记忆训练样本。

(注:完整实现需要配合数据加载、参数初始化等模块,建议使用MATLAB 2021b以上版本,并安装Deep Learning Toolbox)

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)