【ComfyUI 加速】Z-image-Nunchaku 整合包分享解压即用|4G 低显存可用 支持文生图速度直接提升3倍 极速生成实测与完整教程

从实际体验来看,Nunchaku 在 40 系、50 系显卡上的加速效果非常明显,尤其是在高分辨率和连续出图的场景下,优势会被进一步放大。正在用 ComfyUI对生成速度和显存占用比较敏感同时又需要 LoRA 支持那么Z-image-Nunchaku 是一个非常值得尝试的方案。安装过程中如果遇到问题,建议直接对照整合包内的文档一步一步检查,基本都能解决。

【ComfyUI 加速】Z-image-Nunchaku 整合包分享解压即用|4G 低显存可用 生图速度直接提升3倍 极速生成实测与完整教程

标签:ComfyUI Nunchaku AI绘画加速 Stable Diffusion 显卡优化 LoRA Z-image-Nunchaku

前段时间在折腾 ComfyUI 推理加速 的时候,试了不少方案,真正让我觉得“有明显提升”的,其实并不多。

直到最近完整跑了一轮 Z-image-Nunchaku,不管是速度还是显存占用,都非常有说服力。

这篇文章就不空谈原理,直接从 实测数据、LoRA 兼容性、安装方式、工作流细节 四个角度,完整讲清楚 Z-image-Nunchaku 到底值不值得用。

📦 Z-image-Nunchaku低显存占用整合包下载地址:https://pan.quark.cn/s/f54291b8c40b

📦z-image更多版本整合包(支持文生图 图生图 洗图等功能)

https://pan.quark.cn/s/9875662d2588

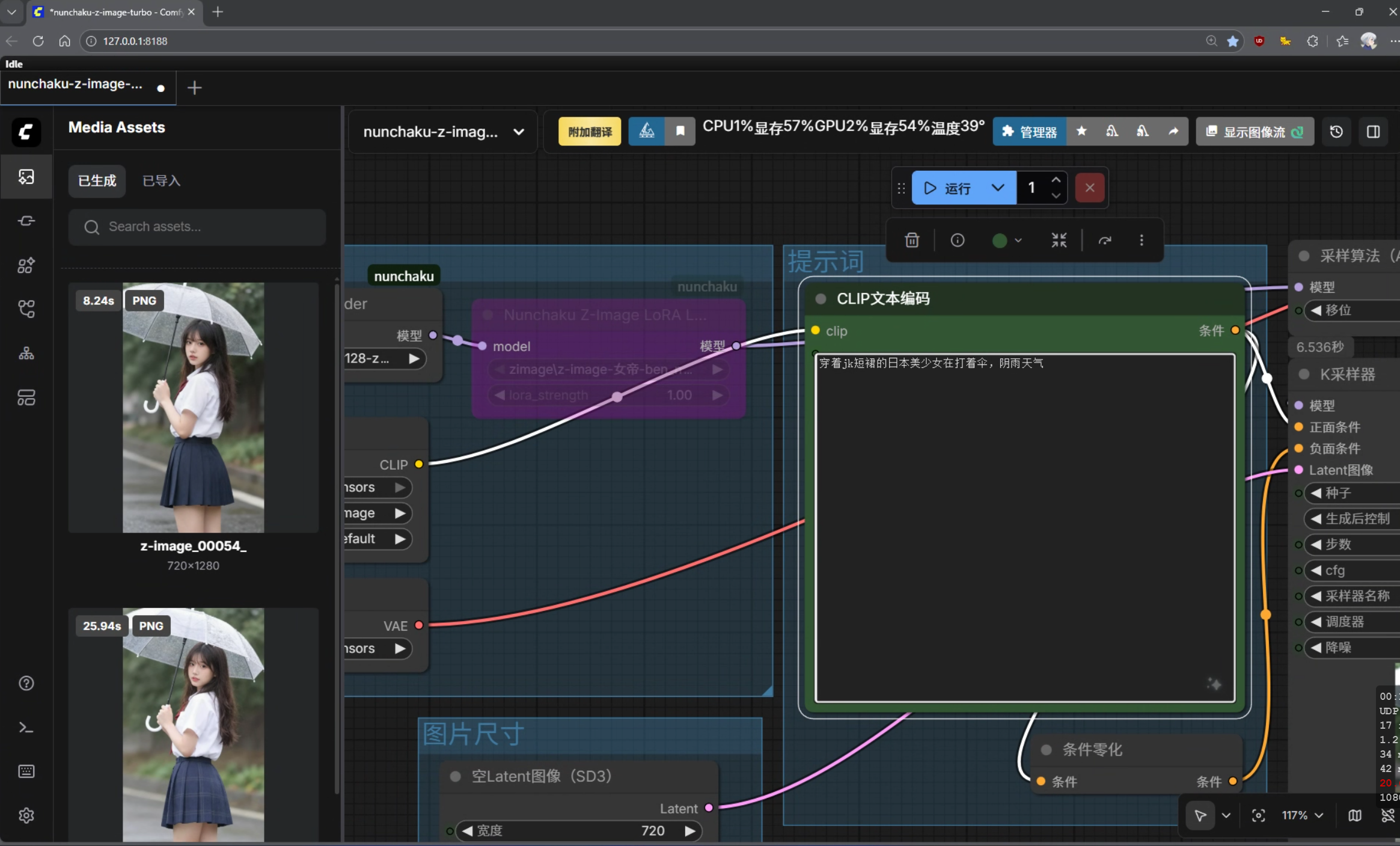

一、Z-image-Nunchaku 性能实测

评价 Z-image-Nunchaku,最核心的指标只有一个:生成速度。

测试环境说明

- 分辨率: 1024 × 1024

- 显卡: 4070 Ti 12G

- 推理环境: ComfyUI + Nunchaku

- 模型: 对应显卡版本(后文会说)

实测结果

-

第一次运行:

⏱️ 25.94 秒首次运行需要加载模型和缓存,这个时间不具备参考价值。

-

第二次运行:

⚡ 8.24 秒 -

对比测试(未使用 Nunchaku):

同样参数,通常需要 16~25 秒 -

连续生成稳定性:

连续生成两张图,时间都稳定在 9 秒出头 -

显存门槛:

理论上 4G 显存 也可以正常跑起来

📌 结论很直观:

在高分辨率下,Nunchaku 带来的加速是肉眼可感知级别,不是那种“参数优化后快 1~2 秒”的提升。

二、LoRA 兼容性测试

很多人关心一个问题:

👉 Nunchaku 能不能用 LoRA?

这里直接实测。

测试方式

- 使用

Ctrl + B启用 LoRA 节点 - 测试 LoRA:自训练的「女帝」角色 LoRA

- 视频中提到的 NOVA / NOA 本质上也都是 LoRA

测试结果

✅ 成功生成目标角色形象

无论是角色特征还是风格,都能稳定触发,说明:

Nunchaku 对 LoRA 是完全支持的

并不存在“只能裸模跑得快,用 LoRA 就翻车”的情况

三、Nunchaku 安装步骤

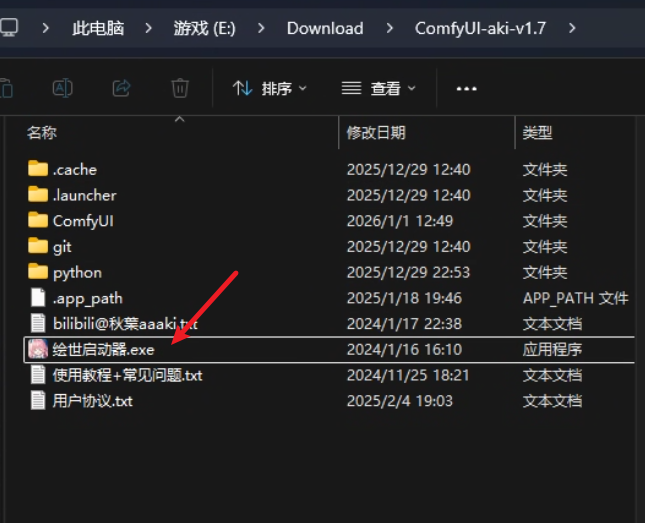

👉 (整合包:无需安装,解压即用)

📦 整合包下载地址:

https://pan.quark.cn/s/f54291b8c40b

解压后打开绘世启动器.exe即用

如果你想自己手动安装,也可以按下面步骤来。

1️⃣ 插件安装

方法 A:秋叶启动器

- 打开启动器

- 进入 版本管理 → 安装新扩展

- 粘贴

Nunchaku的 GitHub 地址进行安装

方法 B:已有插件更新

- 搜索

ComfyUI-Nunchaku - 点击 更新 / 升级

2️⃣ 安装依赖库(Wheel 轮子文件)

这是最容易出问题的一步,一定要对版本。

查看版本信息

-

启动 ComfyUI

-

在终端窗口查看:

- Python 版本(如

3.11) - PyTorch 版本(如

2.1.x / 2.7)

- Python 版本(如

下载对应 .whl 文件

- 到网盘或官方地址

- 下载 Python + PyTorch 完全对应 的轮子文件

执行安装

- 进入 ComfyUI 内部的

python目录 - 在路径栏输入

cmd回车 - 执行命令:

python.exe -m pip install 轮子文件的绝对路径

📌 注意:

版本不一致,99% 会直接安装失败。

3️⃣ 增强功能插件(LoRA 支持)

目前部分 LoRA 支持分支 还没完全合并到主分支。

操作方式

-

下载我提供的 LoRA 支持插件压缩包

-

解压后:

- 覆盖到

ComfyUI/custom_nodes/ - 不要出现多层嵌套文件夹

- 覆盖到

4️⃣ 模型下载与存放路径

模型选择建议

-

50 系显卡:

👉FP4版本 -

40 / 30 系显卡:

👉INT4版本- 推荐

256(效果优于128)

- 推荐

模型存放路径

ComfyUI/models/nunchaku/

四、Nunchaku 工作流详解

安装完成后,在 ComfyUI 节点搜索框中输入:

Nunchaku

如果能正常调出相关节点,说明环境已经 OK。

关键节点说明

1️⃣ 模型选择

-

根据显卡选择:

FP4INT4

2️⃣ 放大与画质增强

-

Hi-res Fix(修复放大)

- 画面细节更丰富

- 可能对原图有轻微调整

-

Ultimate SD Upscale / Sent-V2

- 更偏向保持原图一致性

- 适合商用或风格固定的场景

3️⃣ 随机种子增强器

-

用途:

👉 避免生成结果过于相似 -

适合:

- 批量出图

- 风格测试

- 多方案对比

总结

从实际体验来看,Nunchaku 在 40 系、50 系显卡上的加速效果非常明显,尤其是在高分辨率和连续出图的场景下,优势会被进一步放大。

如果你:

- 正在用 ComfyUI

- 对生成速度和显存占用比较敏感

- 同时又需要 LoRA 支持

那么 Z-image-Nunchaku 是一个非常值得尝试的方案。

安装过程中如果遇到问题,建议直接对照整合包内的文档一步一步检查,基本都能解决。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)