李宏毅深度强化学习导论——演员-评论员

本文主要介绍演员-评论员(Actor-Critic)算法。

引言

本文主要介绍演员-评论员(Actor-Critic)算法。

Critic

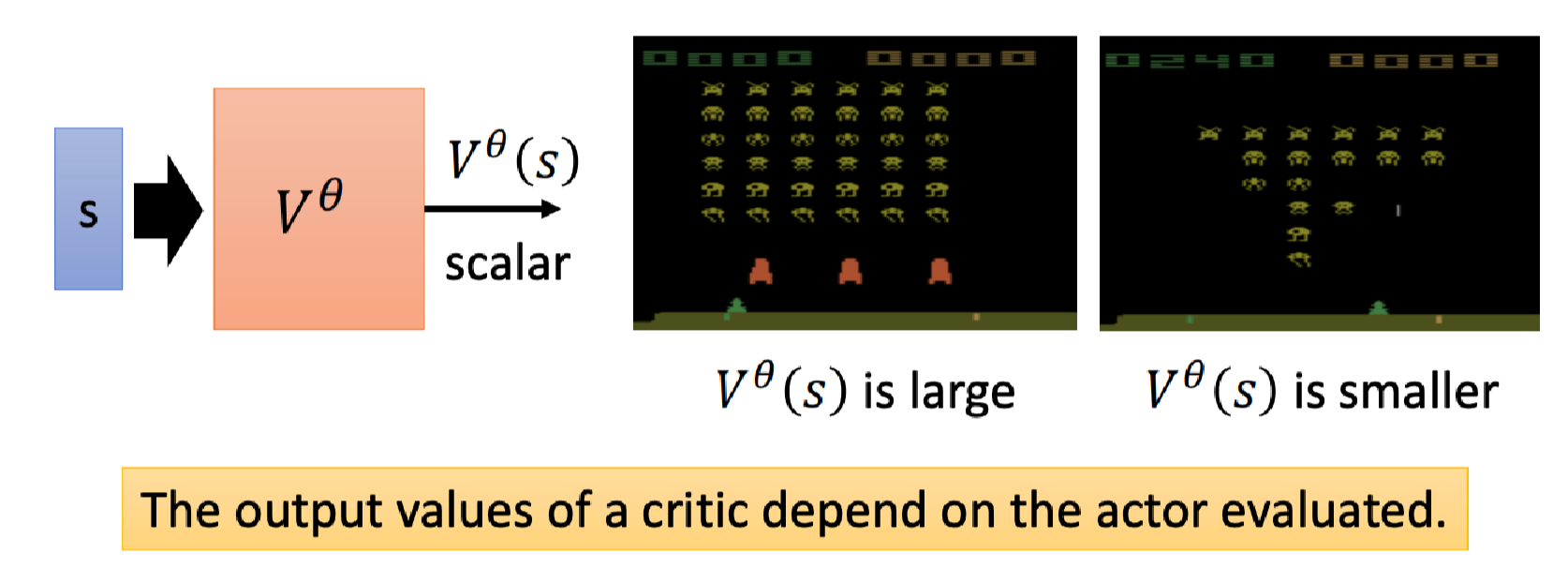

给定Actor θ\thetaθ,Critic评估当观测到sss(或进一步地采取行动aaa)的好坏。

价值函数(Value function),记为Vθ(s)V^\theta(s)Vθ(s),就是一种Critic。

它的输入是现在的游戏画面,这里的上标θ\thetaθ表示它观察的对象是θ\thetaθ这个actor,输出是一个标量。这个标量表示当看到游戏画面sss,actor θ\thetaθ接下来期望可以得到了折扣累积奖励:G1′=r1+γr2+γ2r3+⋯G^\prime_1 = r_1 + \gamma r_2 + \gamma^2 r_3 + \cdotsG1′=r1+γr2+γ2r3+⋯。

比如上图两个游戏画面中,左边有很多外星人,右边则相对少很多,因此左边估计的(价值)标量就会比右边大,当然前提是这个Actor足够厉害,不然没一会就挂了价值估计也会很低。

价值函数依赖于我们观察的Actor,同样的游戏画面不同的Actor应该要得到不同的价值。

那么如何估计价值函数?

我们可以训练一个Critic来估计价值函数,有两种常用的训练方法。

MC

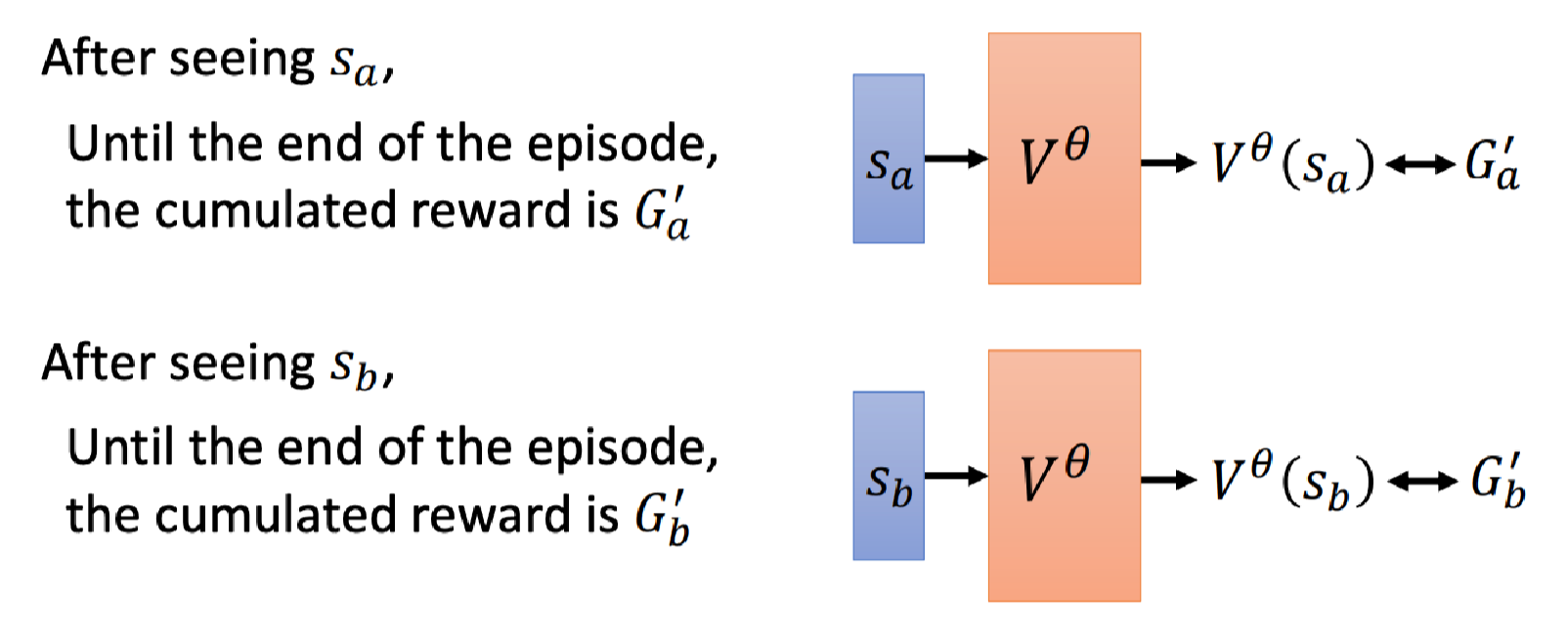

第一种是基于Monte-Carlo(蒙特卡洛,MC)的方法。

它的原理是,让Actor θ\thetaθ去和环境进行很多轮互动,然后就有很多的数据。

经过多轮游戏,我们知道看到状态sas_asa,在这轮游戏结束折扣累积奖励会使Ga′G_a^\primeGa′;看到状态sbs_bsb,在这轮游戏结束折扣累积奖励会使Gb′G_b^\primeGb′;

其实核心是计算期望,比如有很多轮游戏都看到了sas_asa,然后计算它们的均值当成看到sas_asa会后会得到的折扣累积奖励就好了。

那么我们让Critic看到sas_asa或sbs_bsb的输出分别与Ga′G_a^\primeGa′或Gb′G_b^\primeGb′越接近越好。

TD

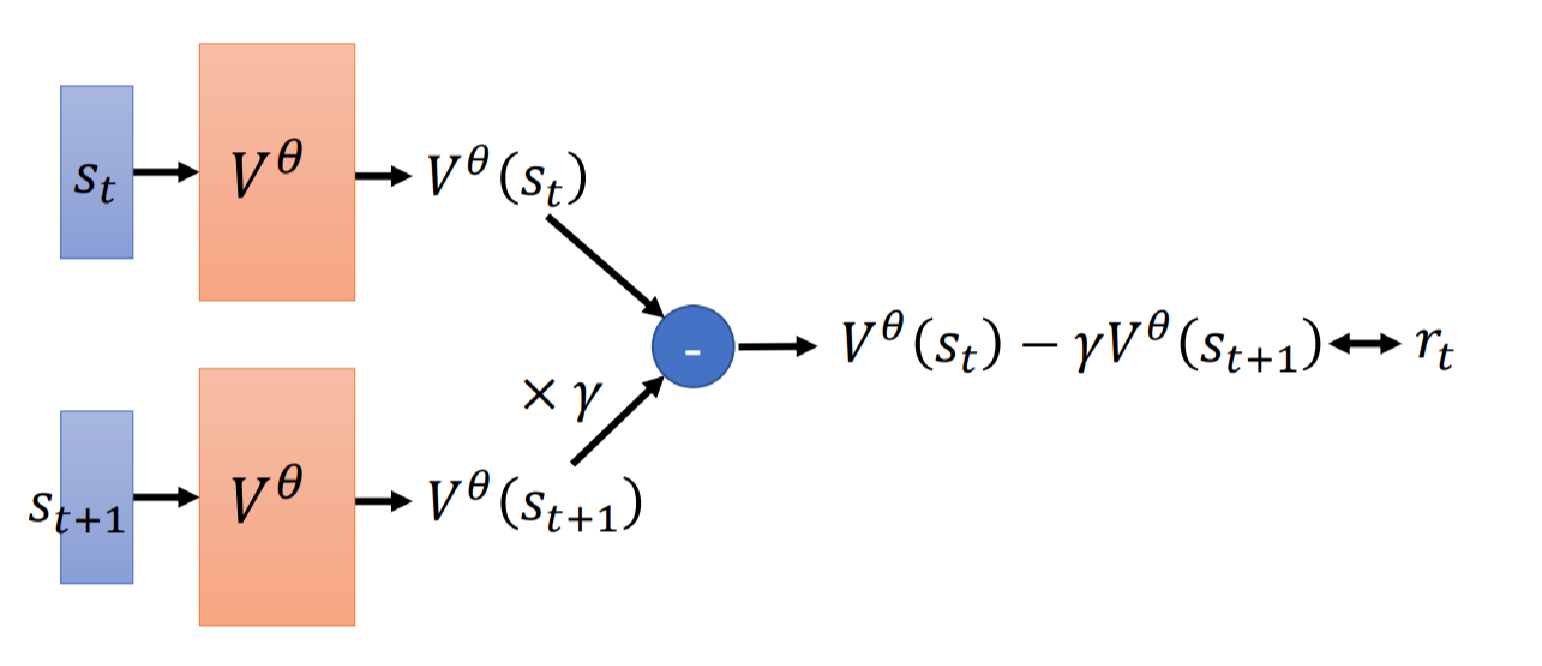

另一种是时序差分(Temporal-difference,TD)方法。MC需要需要玩完整场游戏才能得到关于累积奖励的数据,而TD方法则不同。

只要有st,at,rt,st+1s_t,a_t,r_t,s_{t+1}st,at,rt,st+1的数据就好了,分别是当前状态、当前采取的行动、所获得的奖励、采取行动后跳到的下一个状态。

我们先来看Vθ(st)V^\theta(s_t)Vθ(st)和Vθ(st+1)V^\theta(s_{t+1})Vθ(st+1)之间的关系:

Vθ(st)=rt+γrt+1+γ2rt+2⋯Vθ(st)=rt+1+γrt+2+γ2rt+3⋯(1) \begin{aligned} V^\theta(s_t) &= r_t + \gamma r_{t+1} + \gamma^2 r_{t+2} \cdots \\ V^\theta(s_t) &= r_{t+1} + \gamma r_{t+2} + \gamma^2 r_{t+3} \cdots \\ \end{aligned} \tag 1 Vθ(st)Vθ(st)=rt+γrt+1+γ2rt+2⋯=rt+1+γrt+2+γ2rt+3⋯(1)

联立两个等式我们可以看出:

Vθ(st)=rt+γVθ(st+1)(2) V^\theta(s_t) = r_t + \gamma V^\theta(s_{t+1}) \tag 2 Vθ(st)=rt+γVθ(st+1)(2)

假设我们现在有这样的数据:st,at,rt,st+1s_t,a_t,r_t,s_{t+1}st,at,rt,st+1。

那么分别把st,st+1s_t,s_{t+1}st,st+1代入价值函数中,分别得到Vθ(st)V^\theta(s_t)Vθ(st)和Vθ(st+1)V^\theta(s_{t+1})Vθ(st+1),根据等式(2)前者减去γ\gammaγ乘后者的值应该和rtr_trt尽量接近。

MC v.s. TD

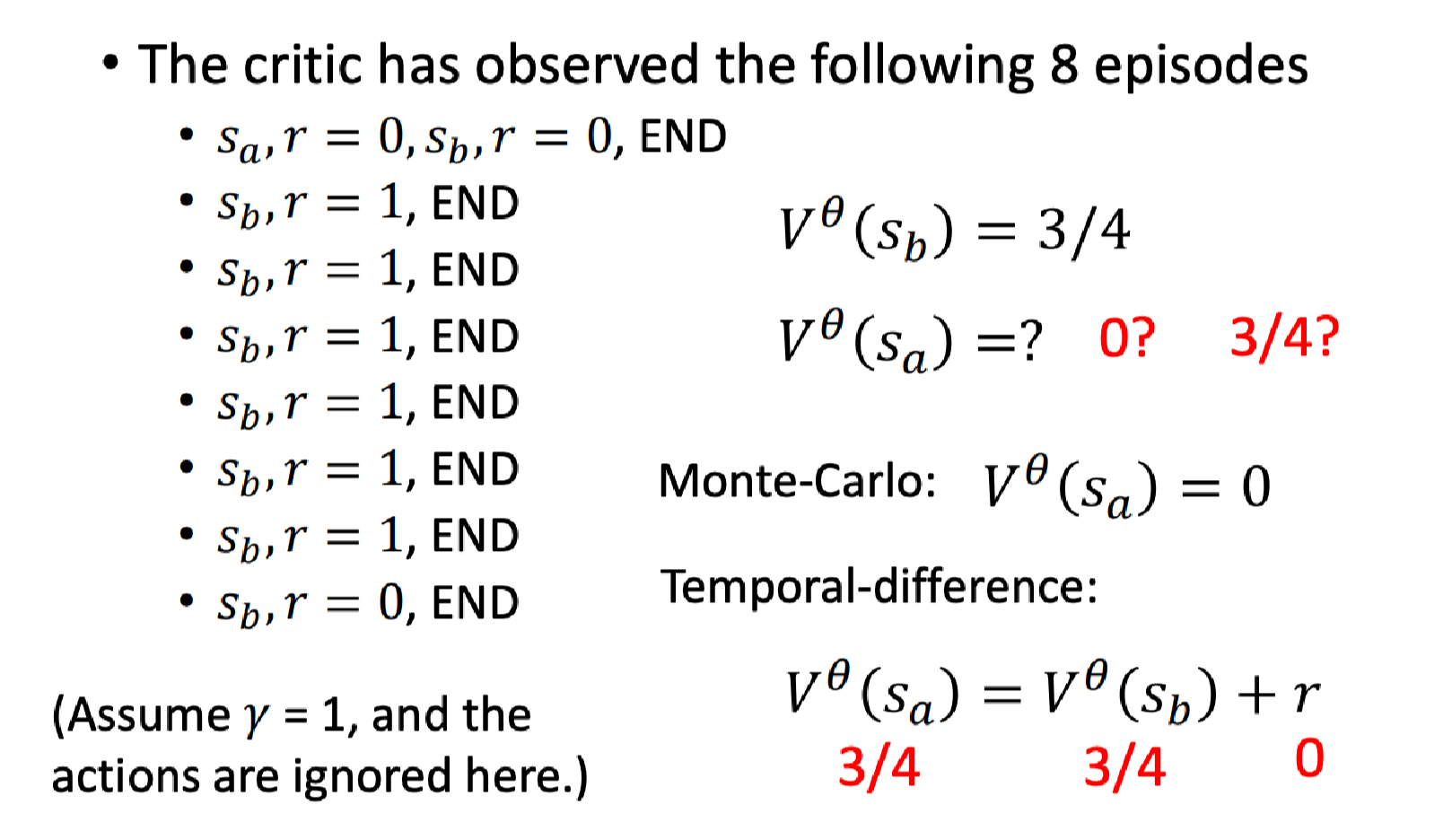

假设Critic观察到下面8个episode的数据:

用MC和TD来观察,算出来的价值函数有可能不一样。

那么Vθ(sb)V^\theta(s_b)Vθ(sb)表示看到sbs_bsb后actor θ\thetaθ期望获得的折扣累积回报:68=34\frac{6}{8}=\frac{3}{4}86=43,因为8次游戏里面有6次得到1分。

那Vθ(sa)V^\theta(s_a)Vθ(sa)怎么计算,根据MC方法有:01=0\frac{0}{1}=010=0;

根据TD方法(等式(2))有: Vθ(sa)=r+Vθ(sb)⇒34=0+Vθ(sb)V^\theta(s_a) =r + V^\theta(s_b) \Rightarrow \frac{3}{4} = 0 + V^\theta(s_b)Vθ(sa)=r+Vθ(sb)⇒43=0+Vθ(sb), 所以Vθ(sb)=34V^\theta(s_b)=\frac{3}{4}Vθ(sb)=43。

可以看到这两种方法算出来的结果不一样,但从它们的角度来说,都是对的。

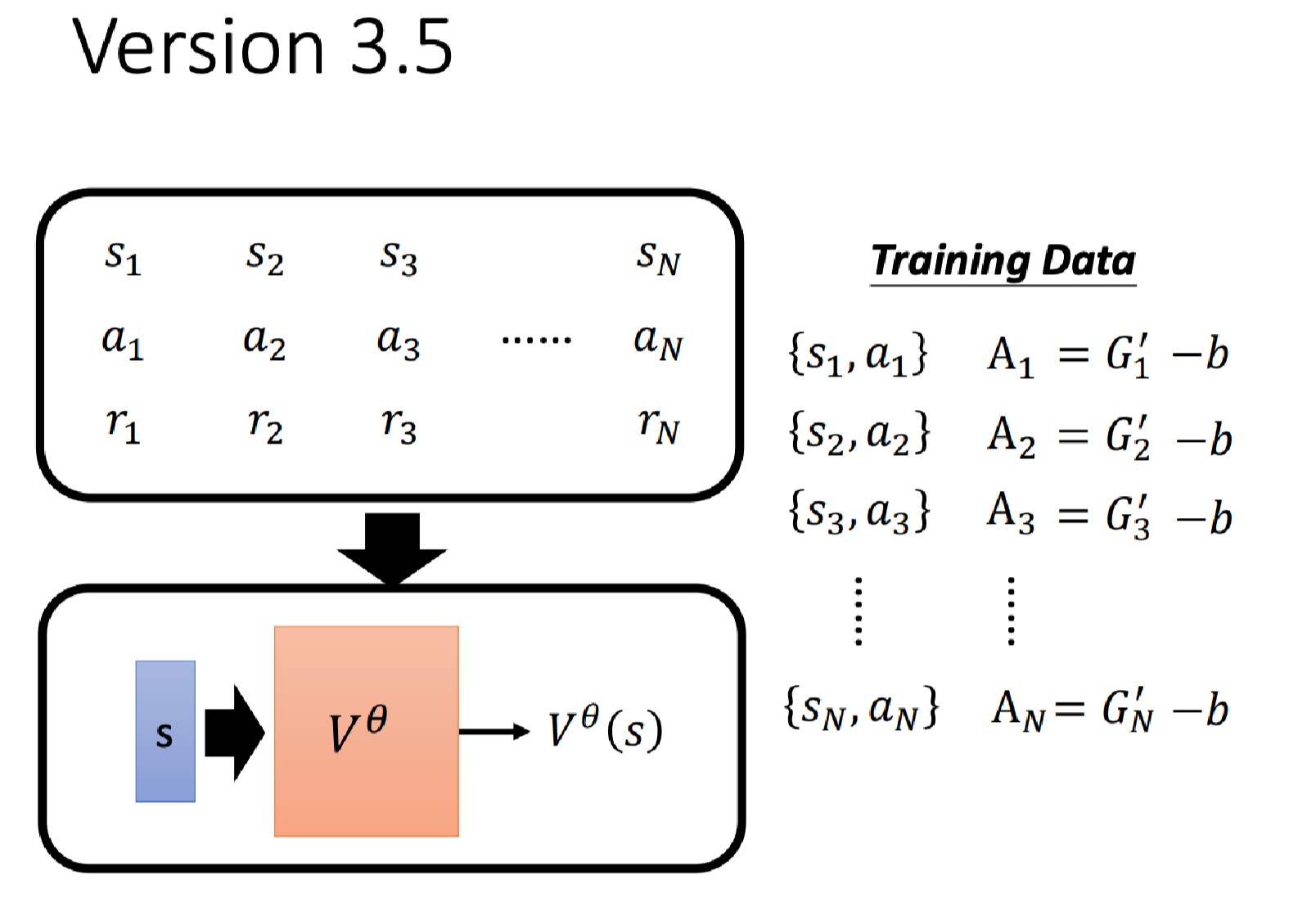

下面我们看Critic如何被用在训练Actor上。我们上篇文章说可以通过下图的方式来训练Actor:

但我们留下来一个问题,即这个偏置bbb的取值是多少?

这里有一个合理的取值,就是Vθ(s)V^\theta(s)Vθ(s)。

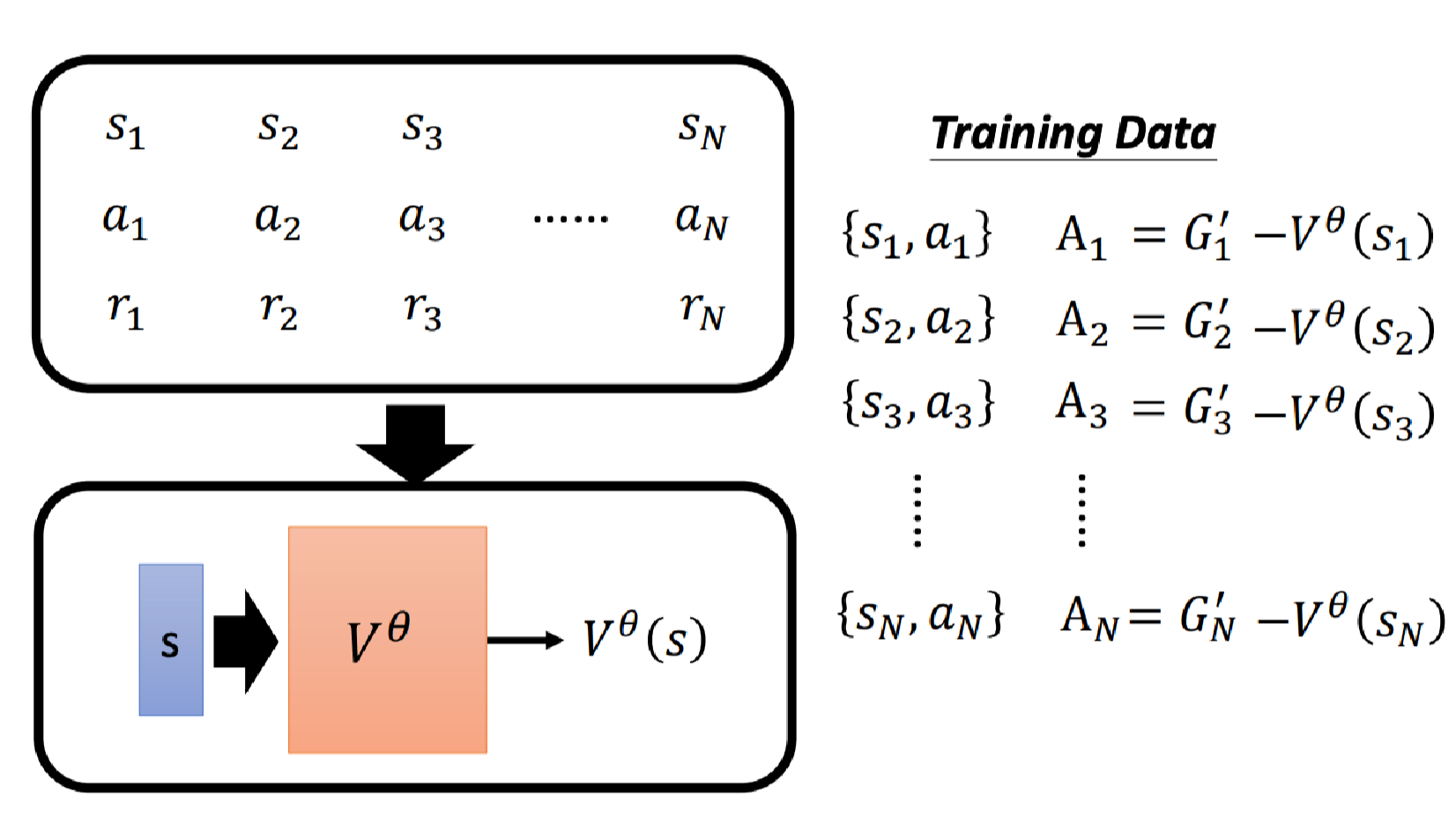

即我们根据同样的训练数据可以训练一个Critic,它可以衡量一个状态的期望累积奖励。所以:

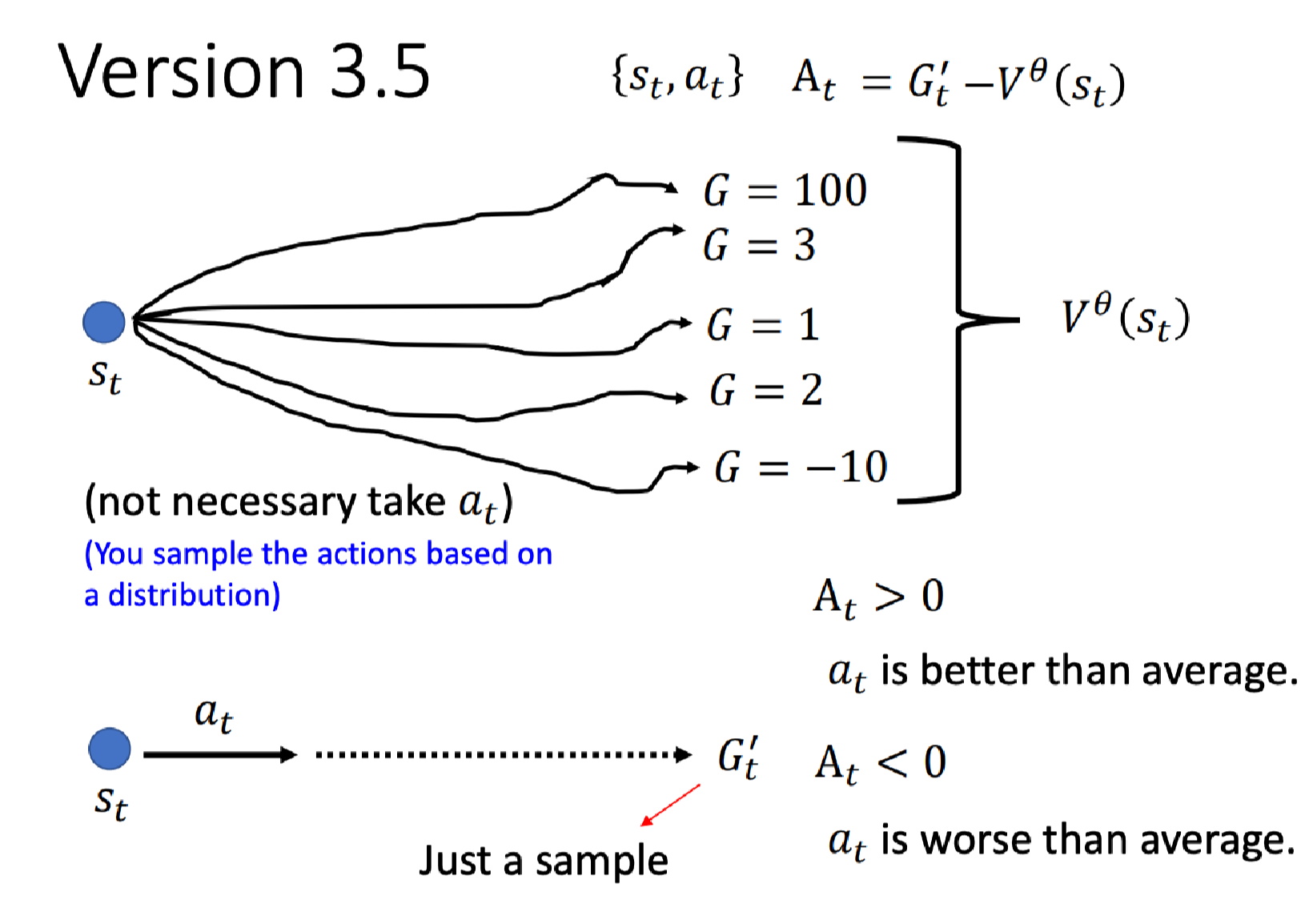

我们来理解下Vθ(st)V^\theta(s_t)Vθ(st)代表什么意思。现在有At=Gt′−Vθ(st)A_t = G_t^\prime - V^\theta(s_t)At=Gt′−Vθ(st)。

我们知道,根据概念是看到sts_tst后会得到的累积奖励期望值。但是要注意的是,看到sts_tst后,你的Actor不一定会执行ata_tat,因为在训练时Actor也要有随机性。

这样我们可以得到不同的累积奖励GGG,平均起来就得到了Vθ(st)V^\theta(s_t)Vθ(st)。

那么这里定义Gt′G_t^\primeGt′为在sts_tst下执行ata_tat最后得到的累积奖励。

如果At>0A_t > 0At>0代表Gt′>Vθ(st)G_t^\prime > V^\theta(s_t)Gt′>Vθ(st),表明动作ata_tat比(随机执行动作的)平均要好;否则如果At<0A_t < 0At<0代表比平均要差。

但是仔细思考可能会发现哪里有点不对,这里Gt′G_t^\primeGt′是一个样本的结果,而Vθ(st)V^\theta(s_t)Vθ(st)是一个均值。

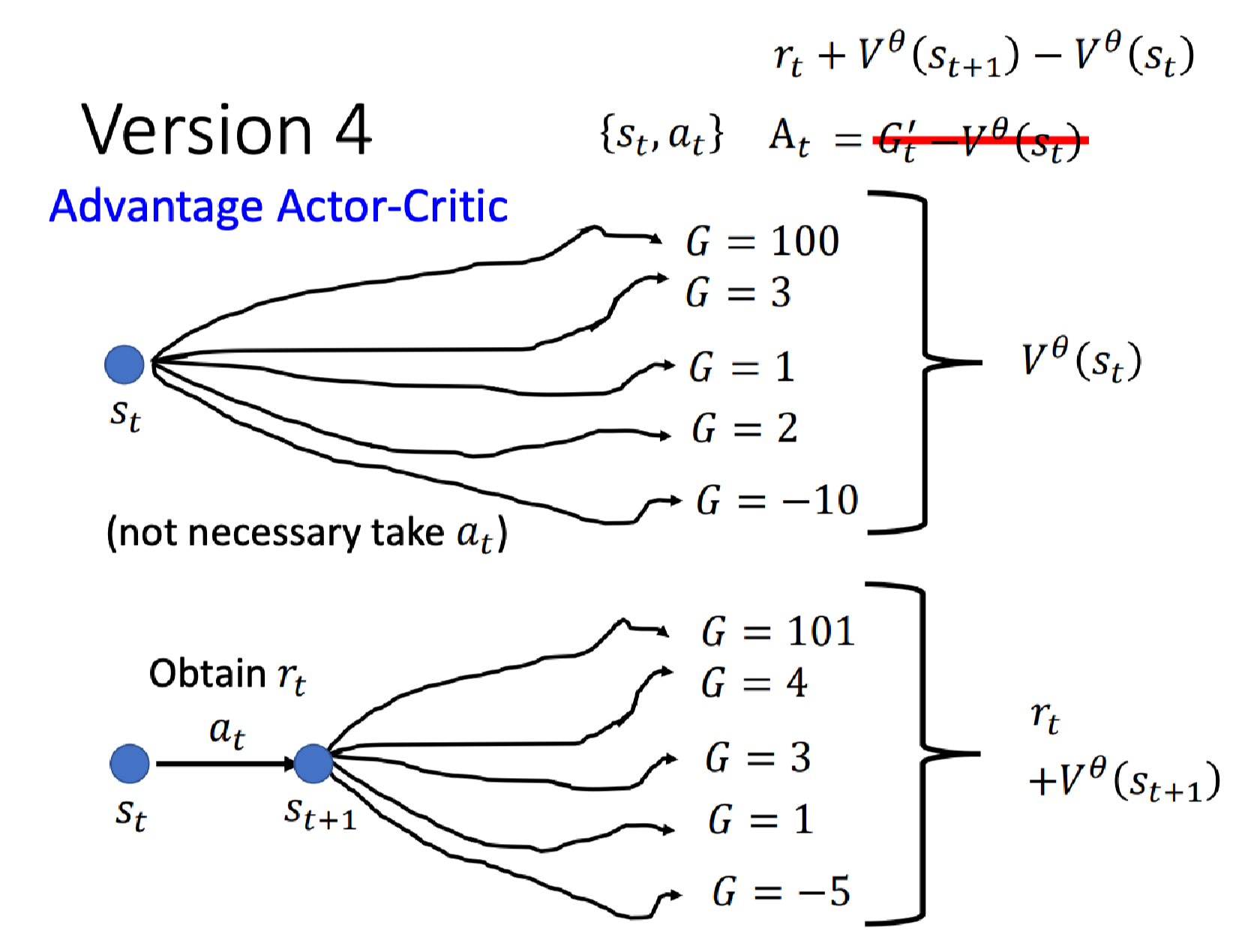

如果是拿均值减均值就得到了我们要了解的最后一个版本:

上一个版本我们是用Gt′−Vθ(st)G_t^\prime - V^\theta(s_t)Gt′−Vθ(st)来估计AtA_tAt。

现在变成了用均值,具体地,在sts_tst后执行动作ata_tat得到奖励rtr_trt,跳到状态st+1s_{t+1}st+1,然后在st+1s_{t+1}st+1处拿多个episode的均值计算出Vθ(st+1)V^\theta(s_{t+1})Vθ(st+1),或者说我们可以直接将st+1s_{t+1}st+1输入给我们的Critic就可以得到这个Vθ(st+1)V^\theta(s_{t+1})Vθ(st+1)。最后再加上rtr_trt就可以得到在sts_tst采取ata_tat后跳到st+1s_{t+1}st+1后会得到的期望累积奖励。

然后我们把Gt′G_t^\primeGt′换成rt+Vθ(st+1)r_t + V^\theta(s_{t+1})rt+Vθ(st+1)得到

At=rt+Vθ(st+1)−Vθ(st) A_t = r_t + V^\theta(s_{t+1}) - V^\theta(s_{t}) At=rt+Vθ(st+1)−Vθ(st)

这就是Advantage Actor-Critic(A2C)方法。

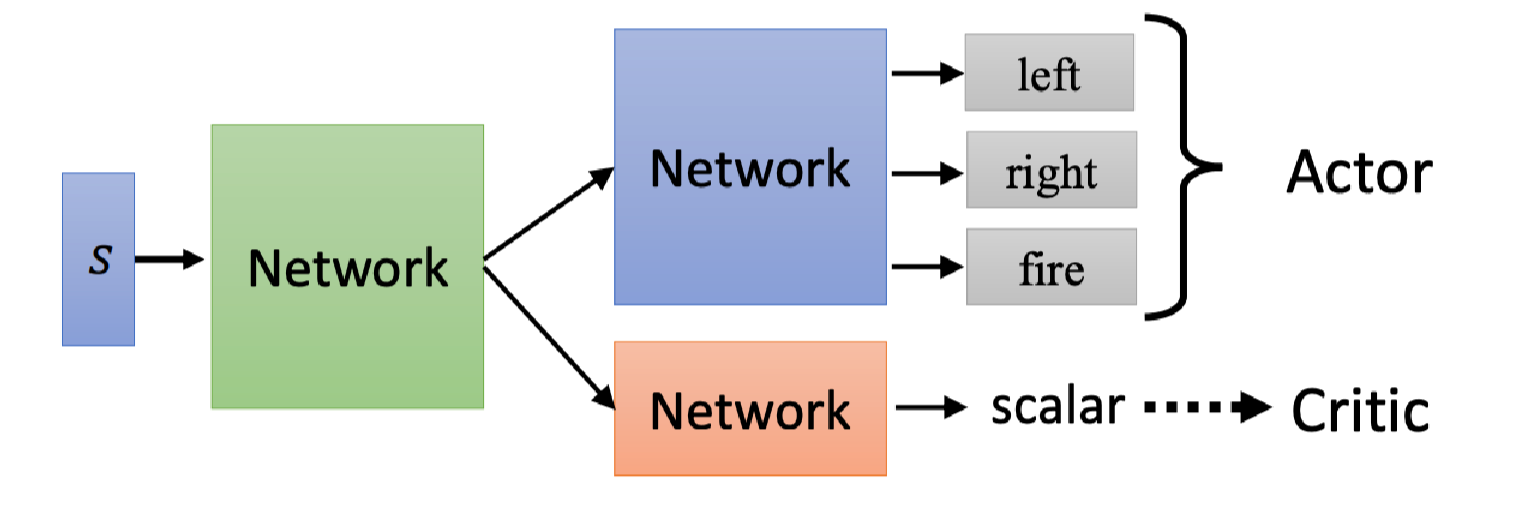

从算法描述我们可以看出Actor和Critic可以通过两个神经网络来模拟。

Actor看到游戏画面,输出要采取的动作分布;Critic看到游戏画面,输出这个Actor会得到的折扣累积奖励期望,是一个标量。

它们的输入是一样的,所以前几层的参数是可以共享的,比如输入是游戏画面时,那么前几层就是CNN网络。所以实际操作时我们可以设计成上图这样。绿色的网络代表CNN,用于游戏画面特征提取。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献41条内容

已为社区贡献41条内容

所有评论(0)