基于Python+爬虫的电影天堂影视数据可视化分析系统设计与实现

今天带来的是基于Python+爬虫的电影天堂影视数据可视化分析系统设计与实现,电影天堂影视数据可视化分析是一个多功能的数据展示平台,旨在提供给用户一个直观、互动的电影数据探索环境。通过集成登录界面,保障了用户账户的安全性;系统首页则展示了最新电影资讯和个性化推荐,为用户打造量身定制的观影体验。在电影数据管理部分,用户可以便捷地对电影信息进行增删改查,维护电影库的丰富性和准确性。我的个人信息功能则允

💗博主介绍:✌全网粉丝15W+,CSDN全栈领域优质创作者,博客之星、掘金/华为云/阿里云等平台优质作者,计算机毕设实战导师。目前专注于大学生项目实战开发,讲解,毕业答疑辅导,欢迎高校老师/同行前辈交流合作✌

💗主要服务内容:免费功能设计、选题定题、开题报告、任务书、程序开发、论文编写和辅导、论文降重、程序讲解、答辩辅导等,欢迎咨询~

👇🏻 精彩专栏 推荐订阅👇🏻

计算机毕业设计精品项目案例(持续更新)

🌟文末获取源码+数据库+文档🌟

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及论文编写等相关问题都可以和学长沟通,希望帮助更多的人

一.前言

电影天堂影视数据可视化分析是一个多功能的数据展示平台,旨在提供给用户一个直观、互动的电影数据探索环境。通过集成登录界面,保障了用户账户的安全性;系统首页则展示了最新电影资讯和个性化推荐,为用户打造量身定制的观影体验。在电影数据管理部分,用户可以便捷地对电影信息进行增删改查,维护电影库的丰富性和准确性。我的个人信息功能则允许用户更新个人资料,保持账户信息的实时性与准确性。该平台利用高级图表和数据分析工具,如条形图、折线图和饼图等,生动展示了电影数据的多维度分析结果,包括电影类型分布、票房趋势、评价分析等关键指标,帮助用户快速捕捉电影市场的动态。同时,通过对用户行为数据的分析,平台能够揭示观众偏好和观影习惯,为电影制片方和发行商提供决策支持。个性化推荐算法还能基于用户的过往行为,为其推荐可能感兴趣的电影,增强用户体验。

系统采用基于Python语言网站开发技术设计的,结合django框架和Mysql数据库管理系统对电影天堂数据相关信息进行管理。按照软件工程学理论完成各阶段设计,经过调试测试达到了管理电影天堂数据信息的能力。满足了管理员的需要。论文从系统开发过程概述、开发工具简介、系统总体设计、系统开发、软件测试等几个方面进行了介绍。最后总结了系统开发的得失。

二.技术环境

开发语言:Python

python框架:django

软件版本:python3.7/python3.8

数据库:mysql 5.7或更高版本

数据库工具:Navicat11

爬虫框架:Scrapy

大数据框架:Hadoop

开发软件:PyCharm/vs code

前端框架:vue.js

三.功能设计

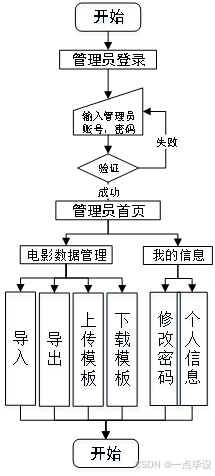

根据需求说明设计系统各功能模块。采用模块化设计方法实现一个复杂结构进行简化,分成一个个小的容易解决的板块,然后再将小的板块继续分化成功能单一的更小模块。模块化设计方法使测试调试、维护更容易,减少模块间的干扰。各模块可以同时开发提高开发效率。本系统功能结构图:

四.数据设计

系统需要数据库存储系统中的信息,MySQL数据库能够处理系统的信息,当考研信息爬虫与分析需要数据的时候,MySQL数据库能够取得数据交给服务端处理。MySQL数据库能够使用可视化软件操作,管理员可以在可视化软件对数据库的信息管理。

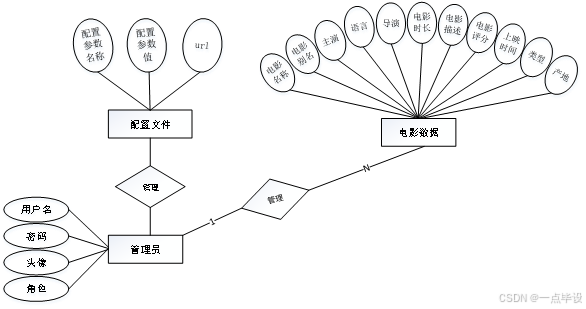

系统数据层设计包括了E-R设计,系统数据实体的设计依赖于E-R的分析和设计,通过E-R能够得到数据库表的设计,E-R能够描述系统所涉及到的实体,还能够描述系统中不同实体的联系和关系。系统总体E-R图如下所示:

五.部分效果展示

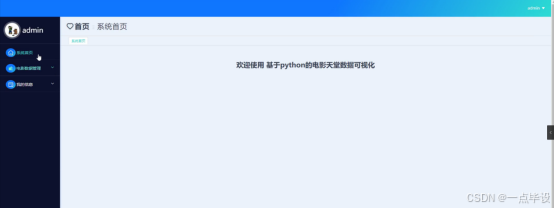

在登录流程中,用户首先在Vue前端界面输入用户名和密码。这些信息通过HTTP请求发送到Python后端。后端接收请求,通过与MySQL数据库交互验证用户凭证。如果认证成功,后端会返回给前端,允许用户访问系统。这个过程涵盖了从用户输入到系统验证和响应的全过程。如图所示。

管理员进入主页面,主要功能包括对系统首页、电影数据管理、我的信息等进行操作。管理员主页面如图所示:

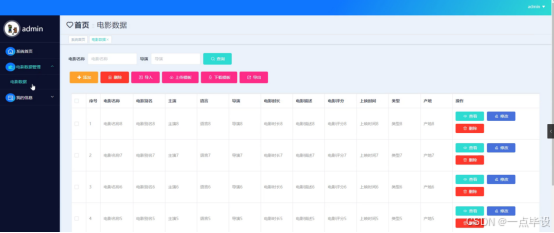

电影数据功能实现是在Django后端部分,您需要创建一个新的应用,然后在该应用下创建一个模型(models.py)来定义电影的数据结构,使用Django的ORM来处理与MySQL数据库的交互,包括电影数据信息的查询、添加、导入、上传模板、下载模板、导出或删除等操作。接着,在views.py中编写视图逻辑来处理前端请求,使用Django的URL路由(urls.py)将请求映射到相应的视图函数。对于数据的验证和序列化,可以使用Django的表单或序列化器来实现。在前端Vue.js部分,将创建相应的Vue组件,在这些组件中使用axios或其他HTTP库与Django后端的API进行交互,实现电影数据信息的查看,修改或删除等功能。状态管理可以通过Vuex来维护,比如在store目录下定义用户模块的状态、突变、动作和获取器。如图所示:

管理员点击看板查看到系统简介、标题、电影数据总数、热度、评分、评价条数、电影数据详情等实时的分析图进行可视化管理;看板大屏选择了Echart作为数据可视化工具,它是一个使用JavaScript实现的开源可视化库,能够无缝集成到Java Web应用中。Echart的强大之处在于其丰富的图表类型和高度的定制化能力,使得管理人员可以通过直观的图表清晰地把握电影天堂数据的各项数据。

为了实现对电影天堂影视数据信息的自动化收集和更新,我们采用了Apache Spark作为爬虫技术的基础。Spark的分布式计算能力使得系统能够高效地处理大规模数据,无论是从互联网上抓取最新的电影天堂数据信息,还是对内部数据进行ETL(提取、转换、加载)操作,都能够保证数据的实时性和准确性。

在大数据分析方面,系统采用了Hadoop框架。Hadoop是一个能够处理大数据集的分布式存储和计算平台,它的核心是HDFS(Hadoop Distributed File System)和MapReduce计算模型。通过Hadoop,我们可以对收集到的大量数据进行存储和分析。看板页面如图所示:

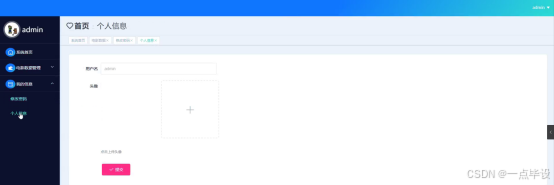

管理员点击我的信息,在我的信息页面可以对密码进行修改和对个人信息进行详细操作。如图所示:

六.部分功能代码

import scrapy

import pymysql

import pymssql

from ..items import xiangmuItem

import time

import re

import random

import platform

import json

import os

from urllib.parse import urlparse

import requests

import emoji

class xiangmuSpider(scrapy.Spider):

name = 'xiangmuSpider'

spiderUrl = 'https://url网址'

start_urls = spiderUrl.split(";")

protocol = ''

hostname = ''

def __init__(self, *args, **kwargs):

super().__init__(*args, **kwargs)

# 列表解析

def parse(self, response):

_url = urlparse(self.spiderUrl)

self.protocol = _url.scheme

self.hostname = _url.netloc

plat = platform.system().lower()

if plat == 'windows_bak':

pass

elif plat == 'linux' or plat == 'windows':

connect = self.db_connect()

cursor = connect.cursor()

if self.table_exists(cursor, 'xiangmu') == 1:

cursor.close()

connect.close()

self.temp_data()

return

list = response.css('ul.subject-list li.subject-item')

for item in list:

fields = xiangmuItem()

fields["laiyuan"] = self.remove_html(item.css('div.pic a.nbg::attr(href)').extract_first())

if fields["laiyuan"].startswith('//'):

fields["laiyuan"] = self.protocol + ':' + fields["laiyuan"]

elif fields["laiyuan"].startswith('/'):

fields["laiyuan"] = self.protocol + '://' + self.hostname + fields["laiyuan"]

fields["fengmian"] = self.remove_html(item.css('div.pic a.nbg img::attr(src)').extract_first())

fields["xiaoshuoming"] = self.remove_html(item.css('div.info h2 a::attr(title)').extract_first())

detailUrlRule = item.css('div.pic a.nbg::attr(href)').extract_first()

if self.protocol in detailUrlRule:

pass

elif detailUrlRule.startswith('//'):

detailUrlRule = self.protocol + ':' + detailUrlRule

else:

detailUrlRule = self.protocol + '://' + self.hostname + detailUrlRule

fields["laiyuan"] = detailUrlRule

yield scrapy.Request(url=detailUrlRule, meta={'fields': fields}, callback=self.detail_parse)

# 详情解析

def detail_parse(self, response):

fields = response.meta['fields']

try:

if '(.*?)' in '''div#info span a::text''':

fields["zuozhe"] = re.findall(r'''div#info span a::text''', response.text, re.S)[0].strip()

else:

if 'zuozhe' != 'xiangqing' and 'zuozhe' != 'detail' and 'zuozhe' != 'pinglun' and 'zuozhe' != 'zuofa':

fields["zuozhe"] = self.remove_html(response.css('''div#info span a::text''').extract_first())

else:

fields["zuozhe"] = emoji.demojize(response.css('''div#info span a::text''').extract_first())

except:

pass

# 去除多余html标签

def remove_html(self, html):

if html == None:

return ''

pattern = re.compile(r'<[^>]+>', re.S)

return pattern.sub('', html).strip()

# 数据库连接

def db_connect(self):

type = self.settings.get('TYPE', 'mysql')

host = self.settings.get('HOST', 'localhost')

port = int(self.settings.get('PORT', 3306))

user = self.settings.get('USER', 'root')

password = self.settings.get('PASSWORD', '123456')

try:

database = self.databaseName

except:

database = self.settings.get('DATABASE', '')

if type == 'mysql':

connect = pymysql.connect(host=host, port=port, db=database, user=user, passwd=password, charset='utf8')

else:

connect = pymssql.connect(host=host, user=user, password=password, database=database)

return connect

# 断表是否存在

def table_exists(self, cursor, table_name):

cursor.execute("show tables;")

tables = [cursor.fetchall()]

table_list = re.findall('(\'.*?\')',str(tables))

table_list = [re.sub("'",'',each) for each in table_list]

if table_name in table_list:

return 1

else:

return 0

@main_bp.route("/python05c7298x/danchexinxi/save", methods=['POST'])

def python05c7298x_danchexinxi_save():

'''

'''

if request.method == 'POST':

msg = {"code": normal_code, "msg": "success", "data": {}}

req_dict = session.get("req_dict")

if danchexinxi.count(danchexinxi, danchexinxi, {"danchebianhao":req_dict["danchebianhao"]})>0:

msg['code'] = crud_error_code

msg['msg'] = "单车编号已存在"

return jsonify(msg)

for key in req_dict:

if req_dict[key] == '':

req_dict[key] = None

error= danchexinxi.createbyreq(danchexinxi, danchexinxi, req_dict)

if error!=None:

msg['code'] = crud_error_code

msg['msg'] = error

return jsonify(msg)

为什么选择我们

大学毕业那年,曾经有幸协助指导老师做过毕业设计课题分类、论文初选(查看论文的格式)、代码刻录等打杂的事情,也帮助过同界N多同学完成过毕业设计工作,毕业后在一家互联网大厂工作8年,先后从事Java前后端开发、系统架构设计等方面的工作,有丰富的编程能力和水平,也在工作之余指导过别人完成过一些毕业设计的工作。2016年至今,团队已指导上万名学生顺利通过毕业答辩,目前是csdn特邀作者、CSDN全栈领域优质创作者,博客之星、掘金/华为云/B站/知乎等平台优质作者,计算机毕设实战导师,专注于大学生项目实战开发,讲解,毕业答疑辅导,欢迎咨询~✌

最后

💕💕

最新计算机毕业设计选题篇-选题推荐

小程序毕业设计精品项目案例-200套

Java毕业设计精品项目案例-200套

Python毕业设计精品项目案例-200套

大数据毕业设计精品项目案例-200套

💟💟如果大家有任何疑虑,欢迎在下方位置详细交流。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)