VideoMimic:视觉模仿实现上下文人形机器人控制

25年5月来自UC Berkeley 的论文“Visual Imitation Enables Contextual Humanoid Control”。如何教会类人机器人利用周围环境上下文爬楼梯和坐在椅子上?或许最简单的方法就是直接展示——随意捕捉一段人体运动视频,然后将其输入给类人机器人。VideoMimic 是一种“真实-到-模拟-到-真实”的流程,它挖掘日常视频,联合重建人类和环境,并为执

25年5月来自UC Berkeley 的论文“Visual Imitation Enables Contextual Humanoid Control”。

如何教会类人机器人利用周围环境上下文爬楼梯和坐在椅子上?或许最简单的方法就是直接展示——随意捕捉一段人体运动视频,然后将其输入给类人机器人。VideoMimic 是一种“真实-到-模拟-到-真实”的流程,它挖掘日常视频,联合重建人类和环境,并为执行相应技能的类人机器人生成全身控制策略。在真实的类人机器人上展示该流程的成果,展示稳健、可重复的上下文控制,例如上下楼梯、在椅子和长凳上坐下和站立,以及其他动态全身技能——所有这些都来自一个以环境和全局根命令为条件的策略。VideoMimic 提供了一种可扩展的途径,可以教会类人机器人在各种现实环境中进行操作。

如图所示:

如何学习与周围的世界互动——比如坐在椅子上或爬楼梯?一般观察别人做这些动作,然后自己尝试,逐渐掌握技能。随着时间的推移,即使以前从未见过,大家也能适应新的椅子和楼梯。如果人形机器人能够以这种方式学习——通过观察日常视频——它们就能掌握各种上下文下的全身技能,而无需依赖针对每种新行为和环境的手动调整奖励或动作捕捉数据。这种执行适合环境动作的能力称为上下文控制。

腿式机器人的技能学习。腿式机器人运动技能的最新进展遵循两个互补的思路。基于奖励的方法在模拟中使用无模型强化学习,通过混合任务项(例如速度跟踪)和运动自然性调节器的手动目标来塑造行为;得益于大规模并行物理引擎 [11, 12],该范式已在无需运动数据的四足机器人和人形机器人上实现了敏捷的运动。然而,每种新行为都需要调整用户定义的奖励和环境脚本 [13, 14, 15, 4, 6, 9]。数据驱动的方法则模仿参考运动(最初是动作捕捉片段或单目视频),训练模拟角色来跟踪它们,并将这一理念移植到机器人上 [1, 3, 16, 17, 7, 8]。例如,最近的研究 [18, 19] 将腿部运动定义为下一个 token 预测任务,并在运动空间中基于人体数据预训练策略,表现出色。虽然模仿绕过了奖励工程 [5],但现有研究通常假设地面平坦或手动设计的设置,限制了基于上下文-觉察的全身控制;即使是模拟人-景接触的动画系统也依赖于已实现的 MoCap 平台,因此缺乏可扩展性 [20, 21]。

基于图像和视频的人体和场景重建。早期的单目视频方法利用深度网络 [22, 23, 24] 在相对于摄像机的框架中回归人体的姿态和形状 [22],这足以满足渲染、动作识别或单人追踪 [25, 26, 27, 28, 29] 的需求,但却未定义全局轨迹,因此也未定义上下文-觉察动态;像 SfV 这样的先驱者手动调整全局尺度,甚至假设摄像机为静态,这限制其通用性。近期的方法将人体运动先验与 SfM/SLAM 相结合,以恢复度量轨迹 [30, 31, 32],但仍然只对人和摄像机进行建模。通用场景解析 [33, 34, 35] 的进展使得能够通过多视角线索或学习的先验知识 [36, 37] 实现联合人体场景重建,但这些系统尚未在机器人上得到验证。并行工作会在后处理或模拟过程中引入物理约束 [38, 39, 40, 41, 42],牺牲可扩展性换取真实感。

VideoMimic,是一种从真实-到-模拟-到-真实的流程,可以将单目视频(例如智能手机随意拍摄的视频)转化为人形机器人的可迁移技能。通过这些视频,联合恢复四维人体场景几何形状,将动作重定位到人形机器人,并训练强化学习策略来追踪参考轨迹。然后,将该策略蒸馏为一个统一的策略,该策略仅观察本体感觉、局部高度图和所需的根基方向。该蒸馏后的策略输出基于地形和身体状态的低级运动动作,使其能够在未见过的环境中执行适当的行为(例如行走、攀爬或坐下),而无需明确的任务标签或技能选择。

本文开发一个感知模块,该模块可以从单目 RGB 视频重建 3D 人体运动,并在世界坐标系中对齐场景点云。将点云转换为网格,并根据重力进行对齐,以确保与物理模拟器的兼容性。全局运动和局部姿态被重定位到具有约束的人形机器人,以确保物理合理性,并解决具身差距问题。网格和重定向数据在模拟中为目标调节的 DeepMimic [1] 方式强化学习阶段播下种子:在 MoCap 数据上进行热启动,然后训练单一策略来追踪来自多个视频在其各自高度映射环境中的运动,同时随机化质量、摩擦力、延迟和传感器噪声以实现鲁棒性。一旦追踪策略训练完成,就使用 DAgger [2] 将其蒸馏为一个不以目标关节角度为条件的策略。新策略观察本体感觉、以躯干(torso)为中心的 11×11 高度-图补丁以及机器人局部参考系中指向目标的向量。在这个精简的观察集下进行 PPO 微调产生一个通用控制器,该控制器在测试时给定高度图和根方向,选择并平滑执行适合上下文的动作,例如踏步、攀爬或坐下。具体而言,策略的每一步都仅依赖于实际部署中可用的观察结果,使其能够立即在真实硬件上运行。

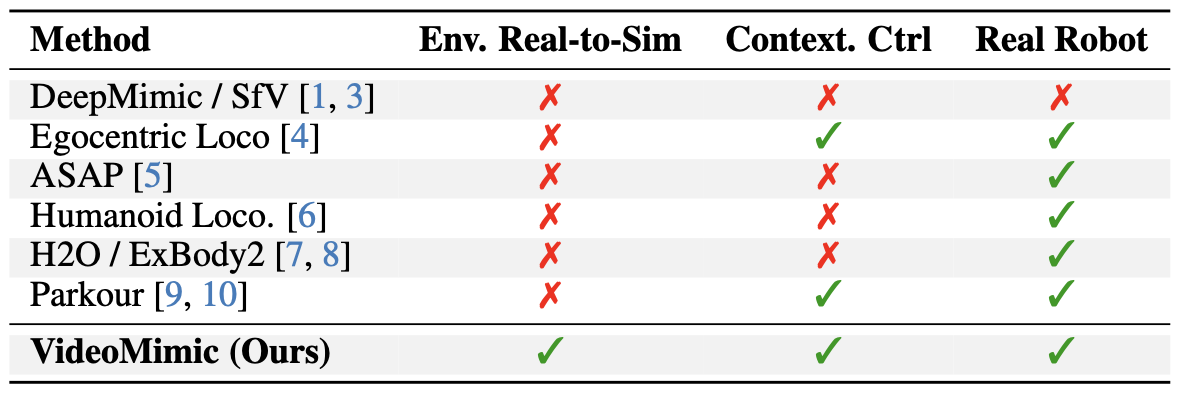

如表所示:特征比较

该方法将 4D 视频重建和机器人技能学习连接在一个数据驱动单一循环中。与之前仅单独恢复人物或场景的研究不同,以物理上有意义的尺度联合重建两者,并将其表示为适合基于物理的策略学习的网格和运动轨迹。在 123 个单目 RGB 视频上训练该方法,在真实的 Unitree G1 机器人上部署来验证该方法,该机器人能够在周围环境甚至未知环境中展现出广义的类人运动技能。

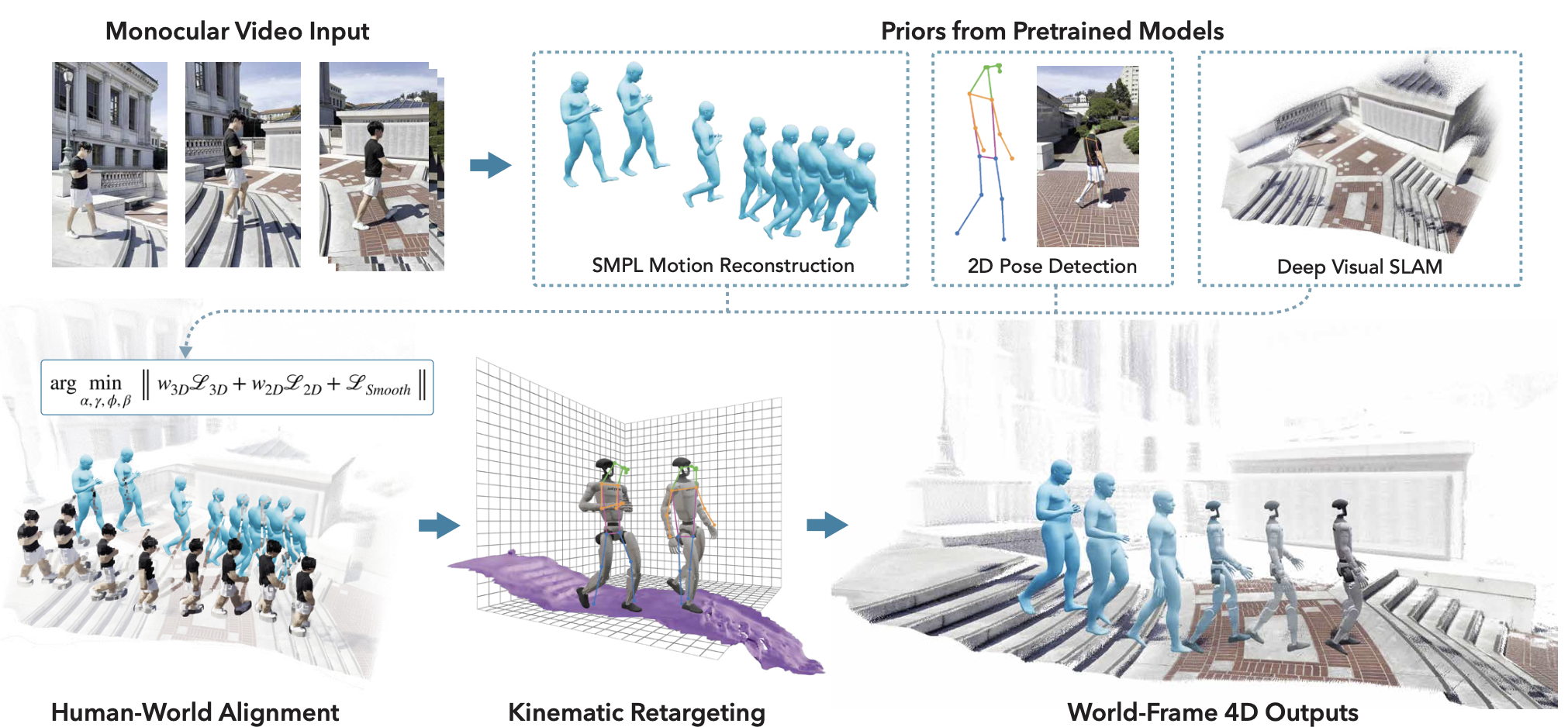

从真实-到-模拟的流程如图所示。从输入视频中提取每帧人体姿势和原始场景点云;联合优化它们以获得度量对齐的人体轨迹和场景几何;应用重力对齐并将过滤后的点云转换为轻量级网格;并在关节限制、接触和碰撞约束下将优化后的轨迹重定位到人形机器人上。

采用现成的、最先进的人体姿态估计和 SfM 方法对单目 RGB 视频进行预处理。首先,使用 Grounded SAM2 [43, 44] 跨帧检测并关联人物。为了粗略地将人物定位在世界坐标系中,遵循 SLAHMR [30] 的初始化策略,使用 (i) SfM 预测的相机焦距和 (ii) ViT 姿势检测中平均 2D 肢体长度 J ̃t_2D 与 Jt_3D 中相应度量尺度 3D肢体长度之间的比率,估计每帧的相似度因子,从而得出粗略的全局轨迹 3D (φt_0 , γt_0)。另外,还通过对每个像素 (u, v) 进行反投影,将 J ̃t_2D 提升到 3D,其深度为 Dt_u,v,以及来自 SfM 的内函数 K:J ̃t_3D = K −1 [u,v,1]TDt_u,v。然后,使用提升的关节,联合 3D 优化人体姿势和场景几何尺度。

其流程联合优化人体轨迹和场景尺度。变量包括人体的全局平移 γ1:T、全局方向 φ1:T、局部姿态 θ1:T 和场景点云尺度 α。由于 MegaSam 点云具有尺度模糊性,因此 SMPL 身体模型中的人体身高先验度量可作为度量参考,而提升的关节 J ̃^t_3D 可同时优化全局 3D 轨迹和局部姿态。因此,同时求解 α,以协调人体衍生尺度和场景几何之间的任何残余不匹配。受 He [7] 的启发,可以选择性地运行尺度自适应过程,在进行关节人体场景优化之前,搜索身高和肢体比例与 G1 机器人相匹配的 SMPL 形状 β⋆。然后从重塑的网格中提取 SMPL 关节。使用预置的 G1 尺度 SMPL β 可以有效地将场景几何体重新缩放到 G1 尺寸,从而提高类人运动的可行性(例如,实现奔跑或攀爬大型障碍物等动作),并促进参考运动学习。对于实际部署,跳过此步骤,直接在原始度量尺度场景上运行。

该目标结合 3D 中的关节距离损失 (L3D)(计算为 J ̃t_3D 和 Jt_3D 之间的 L1 距离)和 2D 投影损失 (L2D),以及一个时间平滑正则化器 (LSmooth) 3D,用于抑制帧间抖动。使用 JAX [48] 中实现的 Levenberg-Marquardt 求解器优化该目标。该优化器在 NVIDIA A100 GPU 上运行,编译 (i) 使用 GeoCalib [49] 将其与真实世界重力对齐;(ii) 将噪声密集的点云转换为轻量级网格,该网格施加有意义的几何约束,并支持节省内存的并行训练。使用 NKSR [50] 进行网格化。

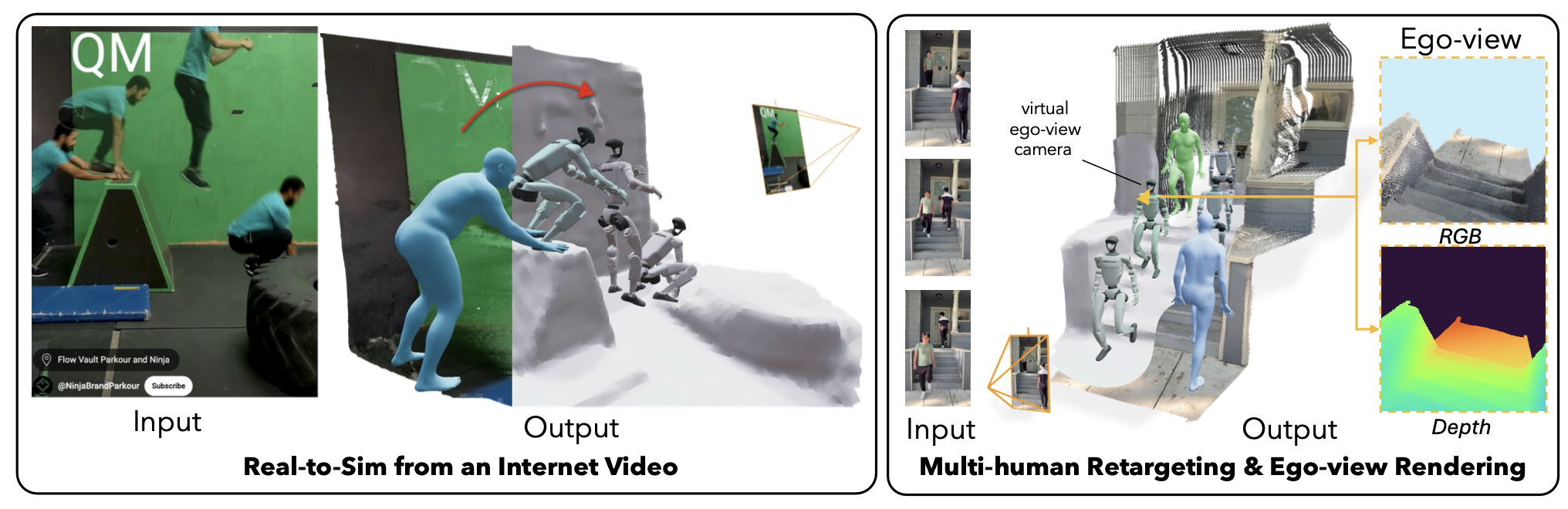

如图所示:Real-to-Sim 流程的多功能性。VideoMimic 能够实现以下功能:(i) 对具有挑战性的运动和多样化环境的互联网视频进行稳健跟踪;(ii) 同时重建和重定向多个人物;以及 (iii) 实现体现感知的自我视角 RGB-D 渲染——虽然目前的策略尚未使用,但它凸显了该框架在输入和任务之间的广泛适用性。

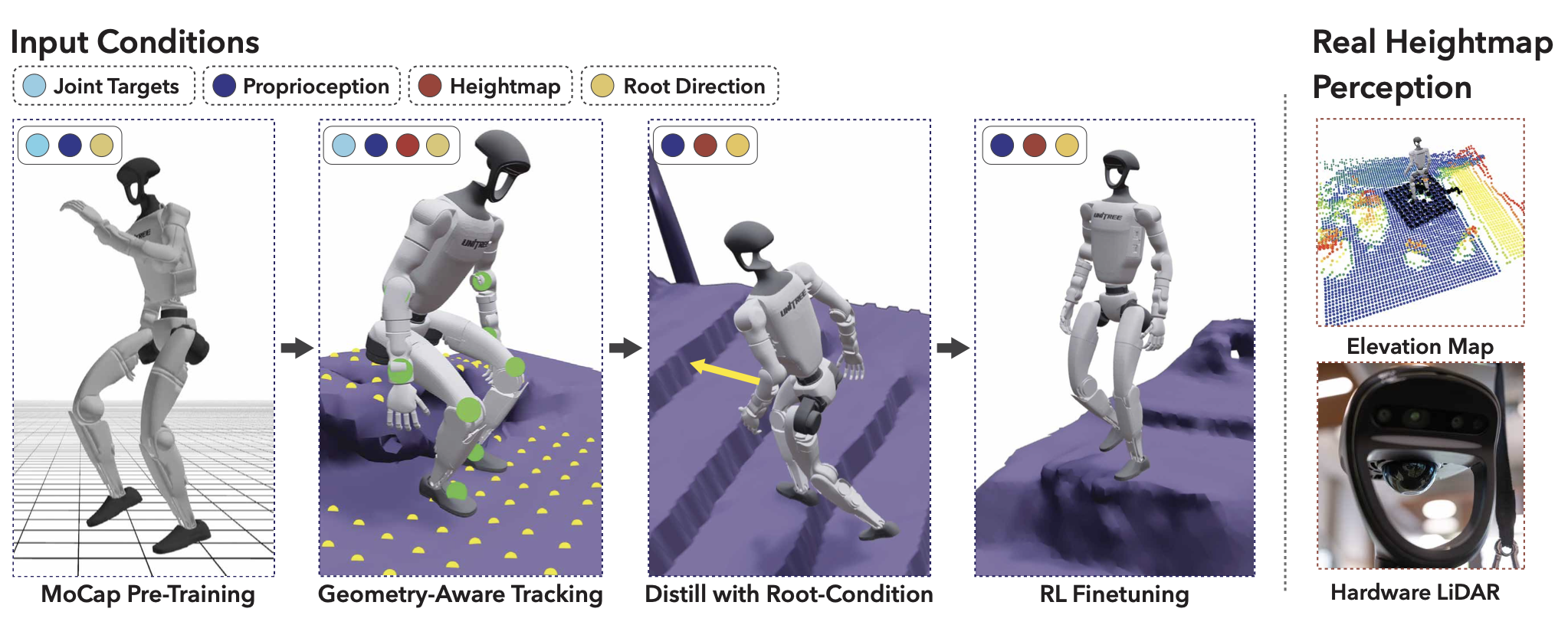

给定来自视频和场景的运动学参考,策略学习流程会生成一个基于上下文的策略,该策略可以在适当的环境上下文提示下执行来自参考的技能。如图概述学习流程:

策略学习。用 Rudin [52] 提出的近端策略优化 [51] 实现来训练策略。学习在 IsaacGym 模拟器 [12] 中进行。

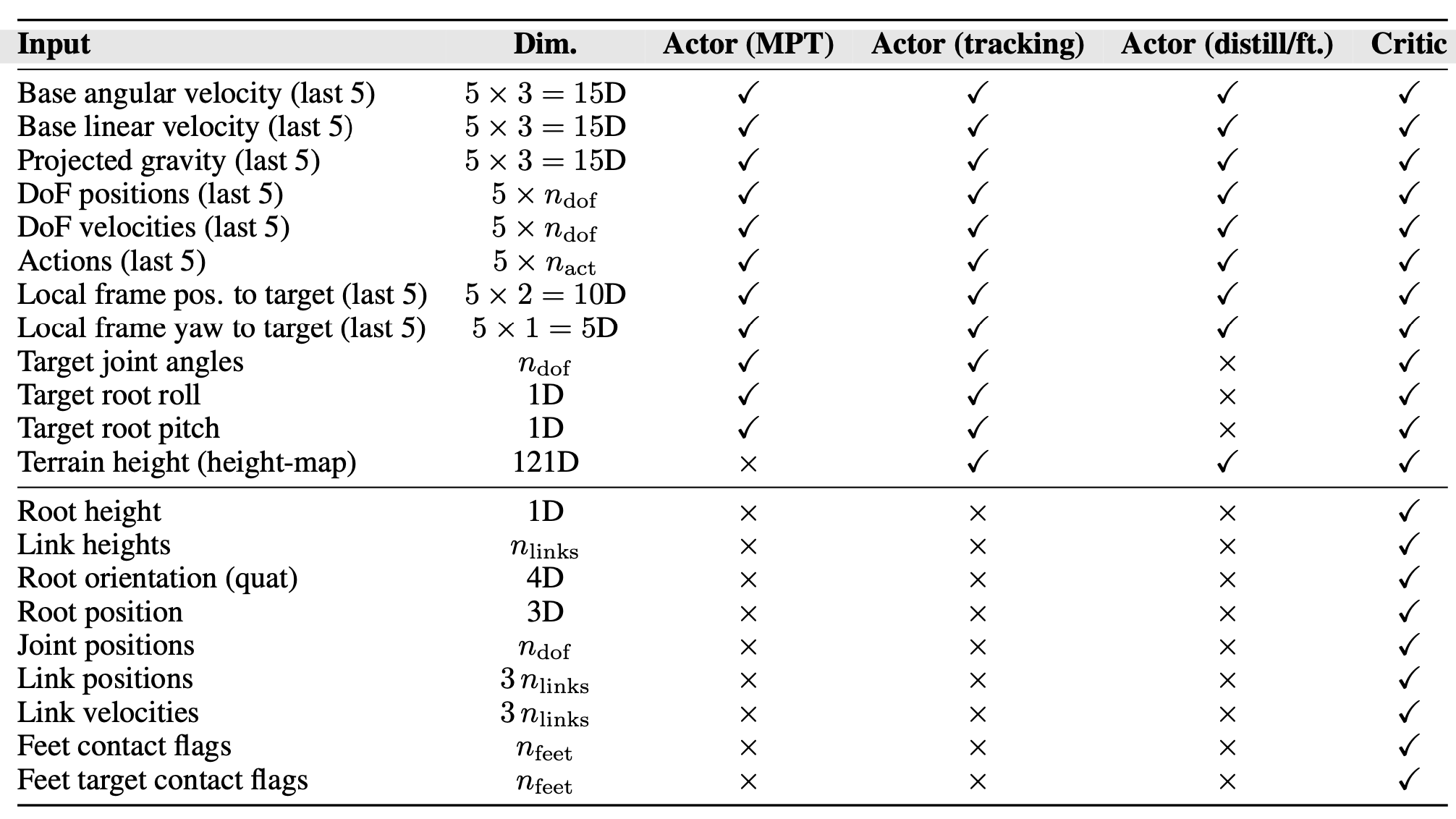

观察。策略以本体感受和目标相关观察为条件。本体感受输入包括机器人关节位置 (q)、关节速度 (q̇)、角速度 (ω)、投影重力矢量 (g) 和先前动作 (at-1) 的历史记录;我们在实践中使用的历史记录长度为 5。此外,该策略还会接收局部目标观测值:目标关节角度、目标根关节的滚动和俯仰角度,以及期望的根关节方向,这些观测值由机器人当前根关节位置与目标根关节位置之间的相对 x-y 偏移量和偏航角指定,均以机器人的局部坐标系表示。对于以高度图为条件的策略,进一步提供躯干周围的高程图。该高程图表示为一个 11 × 11 的网格,以 0.1 米的间隔进行采样,用于捕捉局部地形几何形状。最后,评判器会接收额外的特殊观测值。

批跟踪。系统利用 DeepMimic [1] 的批处理变体来学习使用强化学习来模仿动作。除了类似于 Tessler [53] 的动作负载平衡之外,还实现参考状态初始化 [1],从而提升成功率较低的动作的权重。

奖励。强化学习奖励完全围绕数据驱动的追踪术语设计——具体来说,包括链接和关节位置、关节速度以及脚部接触信号——以便将原始演示转化为物理上可执行的动作,且只需进行少量手动调整。有两个目标:(1) 减少对通常通过奖励工程引入人工构建先验知识的依赖;(2) 确保最终动作的物理可行性。这两个目标可能会发生冲突:由于参考轨迹纯粹是来自人类的运动数据,精确的追踪可能会导致非物理运动。因此,引入动作速率惩罚以及其他几个惩罚标准,旨在阻止对模拟器物理机制的利用。将按照以下描述的阶段来训练策略。

第 1 阶段:MoCap 预训练。MoCap 预训练使策略,能够从嘈杂的视频重建中学习具有挑战性的技能,同时将手工制作的先验保持在最低限度并弥合人与机器人具身之间的差距。早期的研究通过使用多智体 RL [3] 采样起始姿势或让特权模拟器模仿运动 [5] 来解决这个问题。Radosavovic [19] 则采用了一种基于人体数据的运动学预训练形式。采用一种更简单但有效的策略:首先在 MoCap 轨迹上对策略进行预训练,然后在重建的视频数据上对其进行微调——这两个阶段都在物理模拟器中使用强化学习。即使是仅限 MoCap 的策略也可以直接部署在真实机器人上,如图所示。使用重定位到 Unitree G1 的 LAFAN 运动捕捉数据 [54]。对于预训练策略,策略接收的条件是目标关节角度、目标根滚动/俯仰和期望根方向。

阶段 2:场景条件跟踪。在 MoCap 预训练之后,利用 MPT 检查点初始化策略,并通过对环境高度图进行条件调整来引入场景感知。高度图通过残差投影到 MPT 策略的潜空间中,初始权重为 0。然后,随机采样运动,并在重建的地形上执行 DeepMimic 式跟踪。在此阶段,策略会持续接收特定于运动的跟踪条件,包括目标关节角度、根部滚动/俯仰以及期望根部方向。

阶段 3:蒸馏。在批处理跟踪阶段之后,通过 DAgger [2] 蒸馏出一个不观察目标关节角度或根部滚动/俯仰观测值的策略。然后,能够使用期望根部方向观测值作为条件信号来控制机器人的位置,该位置可以由操纵杆或高级控制器提供的路径输入。通过这种方式,框架统一了之前各自独立的操纵杆跟踪和全局参考跟踪方法。蒸馏策略受益于这样一个事实:老师也接受观察随机化的训练,因此它可以学习在一定不确定性下的动作,而如果从全身观察开始训练,情况就不会如此;这在其他策略学习环境中已被证明是有帮助的 [55]。

如表所示:每个网络的观测

将控制器部署在 23-DoF Unitree G1 人形机器人上,并以 50 Hz 的频率在机上运行。按照 [58],设置相对较低的关节增益 Kp = 75,以避免过快或过硬的行为——这有助于避免机器人与椅子或楼梯等物体发生剧烈接触时发生过度剧烈的接触。分别使用 Fast-lio2 [59] 和概率地形测绘 [60] 实时计算高度图。从人类操作员那里获取操纵杆目标。包括策略运行在内的所有操作都在机上运行。通过迭代模拟到真实试验发现成功部署运动的两个关键因素:(i)放宽相对于参考运动的情节终止公差,以及(ii)在训练期间注入真实的物理扰动。

使用 PPO 算法 [51]。用折扣因子 γ = 0.99,GAE 参数 λ = 0.95。使用自适应学习率,期望的知识 (KL) 为 0.02。从 2e − 5 的非常低的学习率开始非常重要,这可以防止在所有环境都启动的某个回合中数据分布早期出现偏差时,高学习率的早期更新破坏现有的检查点。最大梯度范数为 1.0。每次部署使用 5 个学习 epochs,部署长度为 24。熵系数设置为 0.0025。用 2 块 NVIDIA 4090 GPU 进行训练,每块 GPU 包含 4096 个环境(因此实际总共包含 8192 个环境)。用 4 层 MLP,每个层包含维度 [1024, 512, 256, 128]。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献84条内容

已为社区贡献84条内容

所有评论(0)