正值AI大模型繁忙期:Mistral再开源8×22B大模型,OpenAI发布「视觉版」GPT-4 Turbo,谷歌重磅发布Gemini 1.5 Pro,Meta确认开源大模型LLaMA 3

根据科技外媒The Information4月8日发布的报道,作为对标GPT-4的大模型,LLaMA 3的大规模版本参数量可能超过1400亿,而最大的LLaMA 2版本的参数量为700亿。同一天,OpenAI发布了 GPT-4 Turbo with Vision,这是最新的 GPT-4 Turbo 模型,具有视觉功能,可处理用户上传的照片、绘图和其他图像。4月10日,Mixtral-8×7B-Mo

正值AI大模型繁忙期:Mistral再开源8×22B大模型,OpenAI发布「视觉版」GPT-4 Turbo,谷歌重磅发布Gemini 1.5 Pro,Meta确认开源大模型LLaMA 3

1.Mistral AI开源8X22B大模型,1760 亿参数、大小 281GB

4月10日,Mixtral-8×7B-MoE模型升级新版本,Mistral AI 开源了全新的Mixtral-8×22B-MoE大模型。

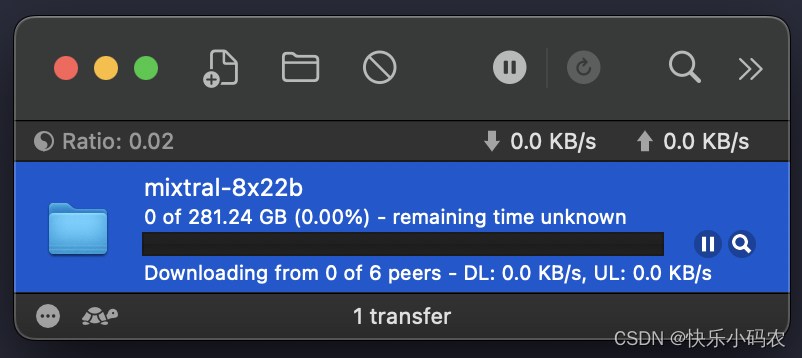

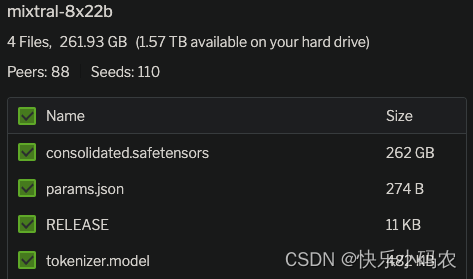

Mixtral 8x22B的文件大小为 281GB,Mistral AI已在 X 上发布了它的 Magnet 链接。用户还可以在 HuggingFace 和 Perplexity AI Labs 上下载。

根据磁链文件信息,我们可以知道:

- Mixtral-8×22B-MoE 还是8个专家组成的混合专家大模型,共有56层,48个注意力头,8名专家,2名活跃专家。

- Mixtral-8×22B-MoE 有 176B 个参数,每个专家参数规模220亿,是 Mixtral-8×7B-MoE 70亿参数的3倍。

- Mixtral-8×22B-MoE 每次激活2个专家,这意味着每次推理的参数规模是440亿,比 Mixtral-8×7B-MoE 的120亿参数规模大幅增加。

- Mixtral-8×22B-MoE 上下文长度为65K,而 Mixtral-8×7B-MoE 模型的输入是32K,上下文长度翻倍!

2.OpenAI 发布「视觉版」GPT-4 Turbo

同一天,OpenAI发布了 GPT-4 Turbo with Vision,这是最新的 GPT-4 Turbo 模型,具有视觉功能,可处理用户上传的照片、绘图和其他图像。

最新模型有128K上下文,训练数据截止到2023年12月。同时,Vision请求也可以使用JSON模式和函数调用。

在过去,开发者需要调用不同的模型来处理文本和图像信息,而 GPT-4 Turbo with Vision 则将两者合二为一,极大简化了开发流程,并带来了广泛的应用前景。

OpenAI 也分享了一些开发者正在使用该模型的有趣案例。

例如,Healthifyme团队通过GPT-4 Turbo with Vision构建的应用Snap,可以对各种美食拍照识别,为用户提供营养分析。

创意平台 Make Real 则利用GPT-4 Turbo with Vision将用户的草图转化为可运行的网站。

目前,GPT-4 Turbo with Vision 尚未应用于 ChatGPT 或开放给大众使用,不过 OpenAI 暗示该功能即将登陆 ChatGPT。

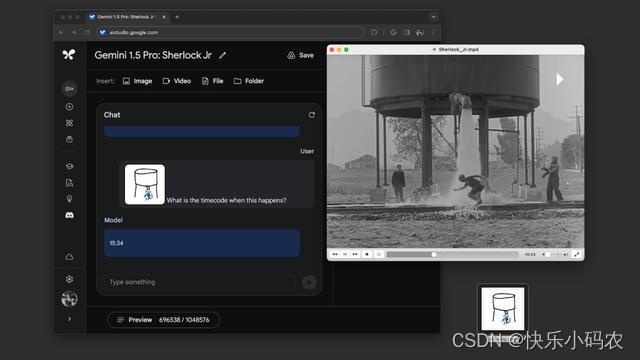

3.谷歌 Gemini Pro 1.5 上线:能自动写影评,理解视频!

同一天,Google在美国拉斯维加斯举行年度Cloud Next大会,向开发人员发布了先进的 Gemini Pro 1.5,现在可在180多个国家/地区使用。这款 Google 功能最强大的生成式 AI 模型,现已在 Google 以企业为中心的 AI 开发平台 Vertex AI上提供公开预览。

除了能生成创意文本、代码之外,Gemini 1.5 Pro最大的特色是能根据用户输入的文本提示,理解、总结上传的视频、音频内容进行深度总结,并且支持100万tokens上下文。

目前,可以在Google AI Studio开发平台中免费试用Gemini 1.5 Pro,支持中文进行提示。

Gemini 1.5 Pro于2月份推出,加入了谷歌的Gemini生成型AI模型家族。Gemini 1.5 Pro 最引人注目的是它能处理的上下文量:从 12.8 万个 token 到最多 100 万个 token。100 万个 token 大约相当于 70 万个单词,或者大约 3 万行代码。这大致是 Anthropic 的旗舰模型 Claude 3 能作为输入处理的数据量的四倍,也大约是 OpenAI 的 GPT-4 Turbo 最大上下文量的八倍。

图注:领先基础模型的上下文长度

Gemini 1.5 Pro 技术报告:https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf

该版本首次提供了本地音频(语音)理解功能和全新的文件 API,使文件处理变得更加简单。

Gemini 1.5 Pro 现在能够对在 Google AI Studio 中上传的视频的图像(帧)和音频(语音)进行推理。

4.Meta确认开源大模型LLaMA 3,下月发布

Meta也不甘示弱!LLaMA 3要来了!

在4月9日伦敦举行的一次活动中,Meta确认计划在下个月内首次发布LLaMA 3。

根据科技外媒The Information4月8日发布的报道,作为对标GPT-4的大模型,LLaMA 3的大规模版本参数量可能超过1400亿,而最大的LLaMA 2版本的参数量为700亿。

LLaMA 3将支持多模态处理,即同时理解和生成文本及图片。

LLaMA 3将延续Meta一直以来的开源路线。

LLaMA 3将有多个不同功能的版本。Meta计划用LLaMA 3为Meta的多个产品提供支持。

新模型发布将进一步提升Meta产品的AI能力,与微软、谷歌等巨头竞争。

参考资料:

https://twitter.com/MistralAI/status/1777869263778291896

https://platform.openai.com/docs/models/continuous-model-upgrades

https://cloud.google.com/blog/topics/google-cloud-next/welcome-to-google-cloud-next24

https://developers.googleblog.com/2024/04/gemini-15-pro-in-public-preview-with-new-features.html

https://baijiahao.baidu.com/s?id=1795917803427409406&wfr=spider&for=pc

https://baijiahao.baidu.com/s?id=1795928625073802996&wfr=spider&for=pc

欢迎各位关注我的个人微信公众号:HsuDan,我将分享更多自己的学习心得、避坑总结、面试经验、AI最新技术资讯。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)