PCM音频流转WAV

PCM音频流转WAV

·

记一次前端语音合成遇到的坑:PCM音频流转WAV

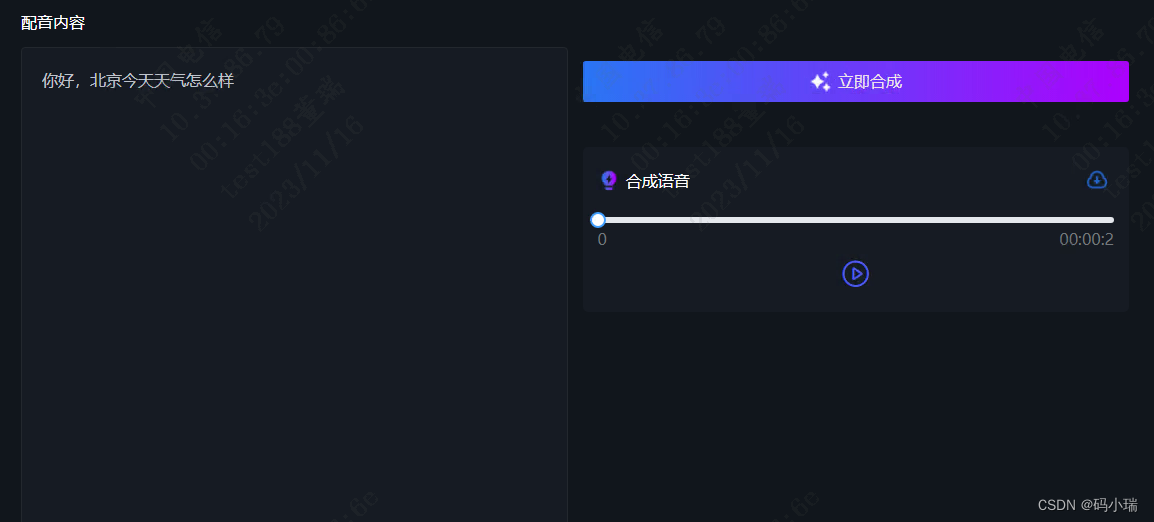

与后端使用webSocket连接,将一段文字合成语音,流程是输入一段文字通过webSoket连接发送给后端,后端是将pcm的音频流以base64编码的形式一段一段返回给我的,所以我需要将base64编码累加一起变成一段完整的base64编码的pcm音频流,之后转二进制,然后再转wav格式的音频流去播放,但是这些我都不会转啊,之前也没做过,后端真是省事,让他转好给我还说不能转,cao了dan了,然后就找资料,功夫不负有心人,找到个大神用js来转的。

-

问题

再拿到了后端给的base64的音频流,将音频流用base64解码转成byte[]数组后转为wav格式的音频流。 -

解决办法(直接附代码,也是参考大神的)

- 创建PCM2WAV类

const stream = require('stream')

const waveheader = require('waveheader') // 这里要是显示没有这个包, 直接npm install waveheader --save

class PCM2WAV {

constructor (options) {

let pcm2wav = new stream.Transform()

options = options || {}

options.size = options.size || 0

options.channels = options.channels || 1

options.sampleRate = options.sampleRate || 16000 // 这里修改采样率合成的语音可以调整说话的快慢,我也是试验了几次才知道 ,采样率,支持 11025、16000、22050、24000、44100、48000,11025我觉的还是快,我设置了8000 感觉正好(这是我的情况,可以问算法会告诉你这个语音的采样率多少合适)

pcm2wav._transform = function (chuck, encoding, done) {

if (!this._initialized) {

this.push(waveheader(options.size, {

channels: options.channels,

sampleRate: options.sampleRate

}))

this._initialized = true

}

this.push(chuck)

done()

}

return pcm2wav

}

}

export {

PCM2WAV

}

- 处理base64格式的pcm数据

let bstr = atob(pcmdata)

let n = bstr.length

let u8arr = new Uint8Array(n)

while (n--) {

u8arr[n] = bstr.charCodeAt(n)

}

- pcm转为wav格式音频数据,并测试播放wav音频

let pcm2wav = new PCM2WAV()

pcm2wav.write(u8arr, () => {

let data = pcm2wav.read()

let blob = new Blob([data], {type: 'audio/wav'})

let audio = new Audio()

audio.src = URL.createObjectURL(blob)

audio.oncanplay = () => {

audio.play()

}

})

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)