LatentSync:用于口型同步的音频条件潜在扩散模型

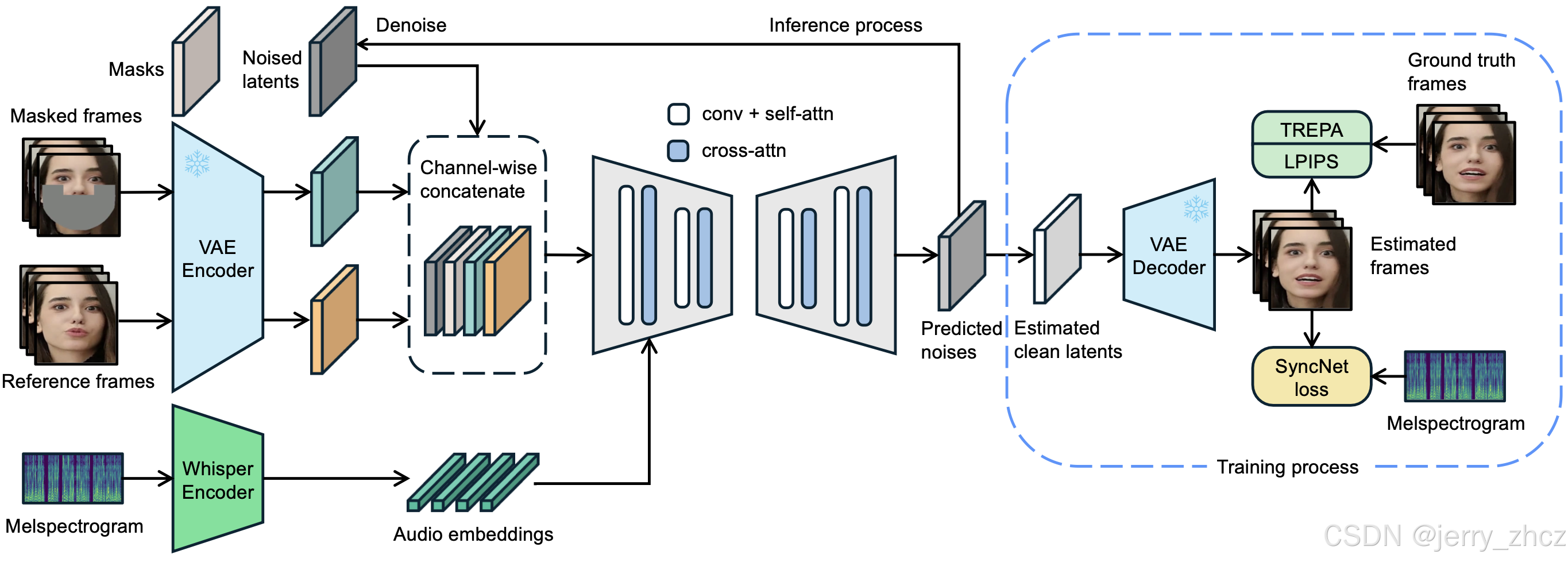

我们提出了 LatentSync,这是一个基于音频条件潜在扩散模型的端到端口型同步框架,没有任何中间运动表示,与以前基于像素空间扩散或两阶段生成的基于扩散的口型同步方法不同。此外,我们发现,由于不同帧之间的扩散过程不一致,基于扩散的口型同步方法表现出较差的时间一致性。TREPA 使用大规模自监督视频模型提取的时间表示,将生成的帧与真实帧对齐。参考帧和掩码帧在通道上连接,噪声潜伏值作为 U-Net

我们提出了 LatentSync,这是一个基于音频条件潜在扩散模型的端到端口型同步框架,没有任何中间运动表示,与以前基于像素空间扩散或两阶段生成的基于扩散的口型同步方法不同。我们的框架可以利用 Stable Diffusion 的强大功能直接对复杂的视听关联进行建模。此外,我们发现,由于不同帧之间的扩散过程不一致,基于扩散的口型同步方法表现出较差的时间一致性。我们提出了 Temporal REPresentation Alignment (TREPA) 来提高时间一致性,同时保持口型同步的准确性。TREPA 使用大规模自监督视频模型提取的时间表示,将生成的帧与真实帧对齐。

Frame,https://github.com/bytedance/LatentSync

LatentSync 使用 Whisper 将频谱图转换为音频嵌入,然后通过交叉注意力层将其集成到 U-Net 中。参考帧和掩码帧在通道上连接,噪声潜伏值作为 U-Net 的输入。在训练过程中,我们使用一步法从预测的噪声中获得估计的干净潜在值,然后对其进行解码以获得估计的干净帧。TREPA、LPIPS 和 SyncNet 损失被添加到像素空间

中。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)