CNN-GRU-Attention(12种算法优化CNN-GRU-Attention多特征输入超前24步预测)

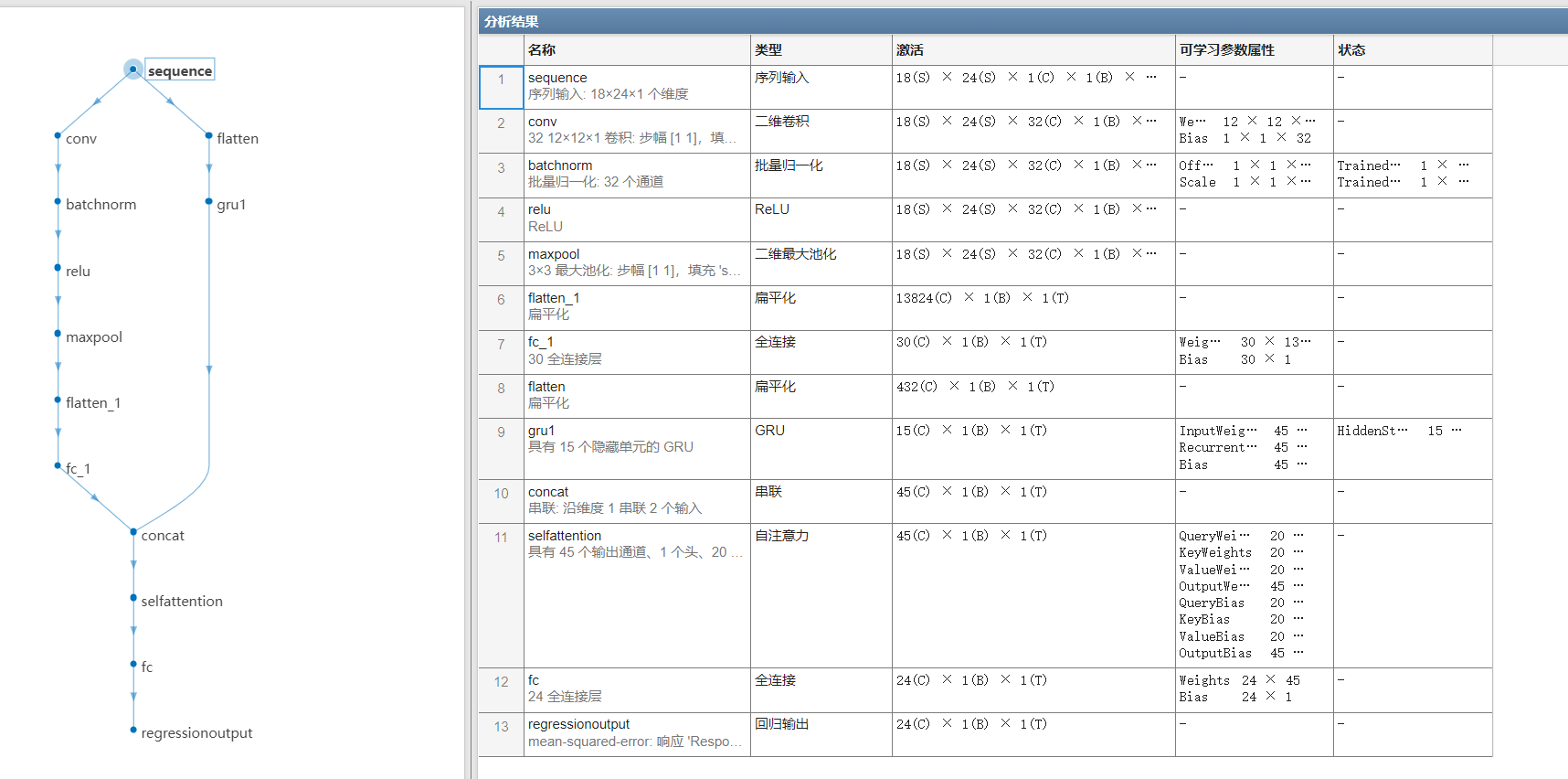

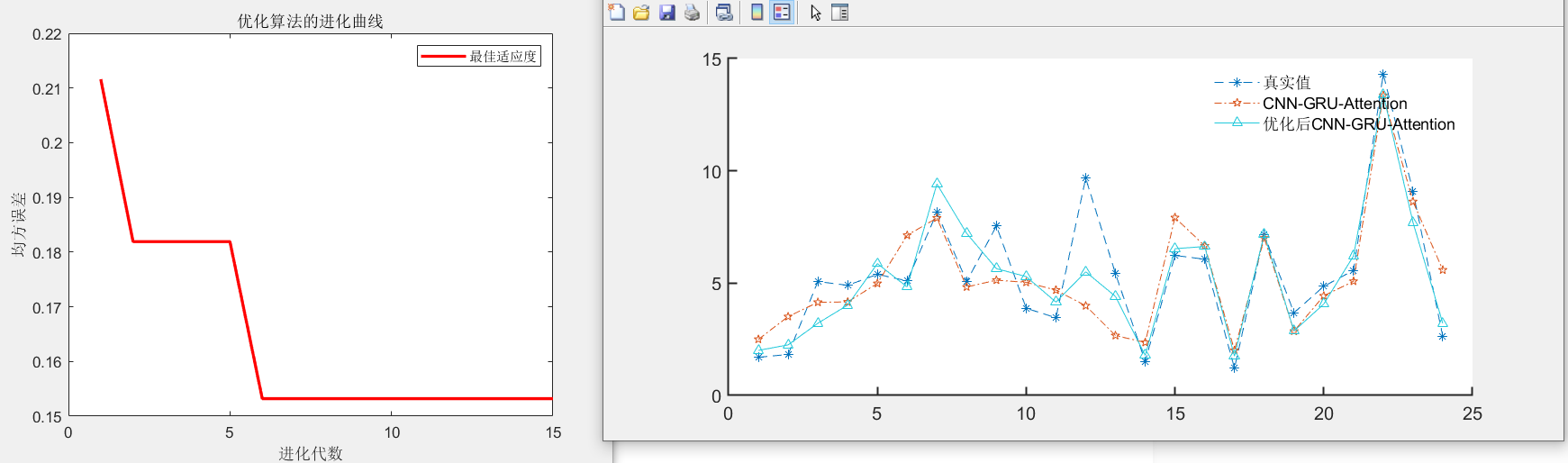

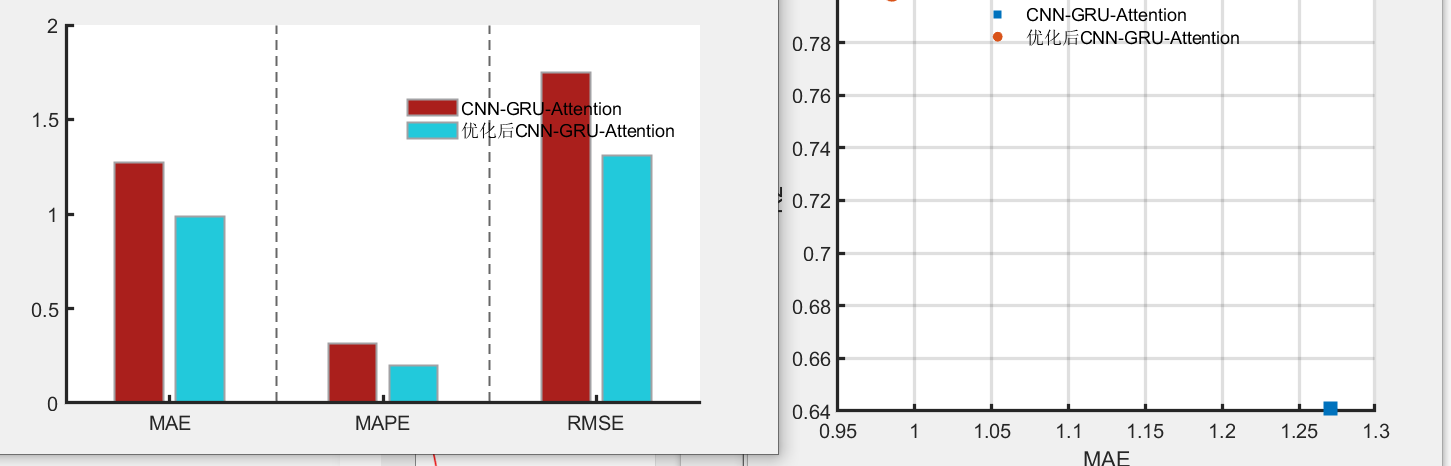

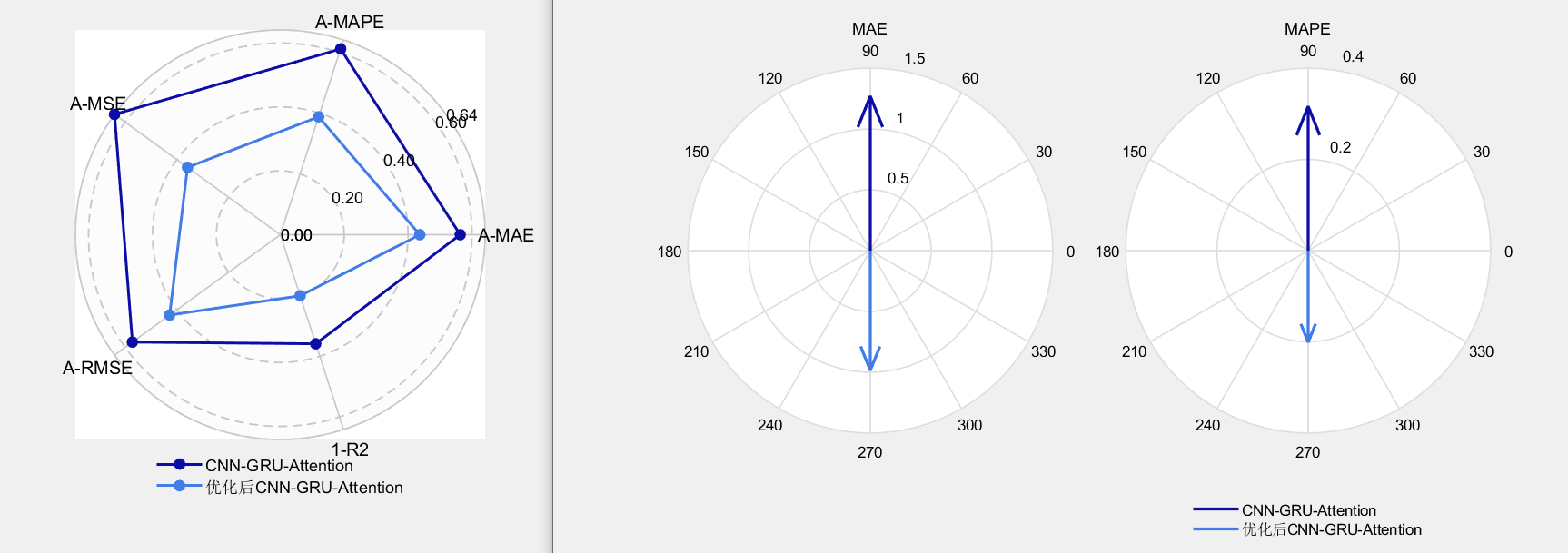

CNN-GRU-Attention模型结构结合了卷积神经网络(CNN)、门控循环单元(GRU)和注意力机制(Attention)来进行时间序列数据的预测或分类任务。以霜冰RIME优化CNN-GRU-Attention预测效果为例,其效果如图。

·

- 12种算法优化CNN-GRU-Attention模型预测的代码 采用前一天(24个小时)的特征值去预测未来24小时的输出

-

CNN-GRU-Attention(12种算法优化CNN-GRU-Attention)(多特征输入超前24步预测)代码获取戳此处代码获取戳此处代码获取戳此处 - 主要功能为:采用12种算法优化CNN-GRU-Attention模型的四个参数,分别是学习率,卷积核个数,GRU的神经元个数,注意力机制的键值。并进行了优化前后的结果比较。

- 12种算法如下:北方苍鹰算法(NGO)、蜕螂优化算法(DBO)、灰狼优化算法(GWO)、鱼鹰优化算法(OOA)、粒子群算法(PSO)、减法优化器算法(SABO)、沙猫群优化算法(SCSO)、麻雀优化算法(SSA)、白鲸优化算法(BWO)、霜冰优化算法(RIME)、鲸鱼优化算法(WOA)、哈里斯鹰优化算法(HHO)。代码中12种算法可以随意切换!

-

CNN-GRU-Attention模型结构结合了卷积神经网络(CNN)、门控循环单元(GRU)和注意力机制(Attention)来进行时间序列数据的预测或分类任务。以下是对该模型结构的详细解释:

- 卷积神经网络(CNN):

- 功能:CNN主要用于从时间序列数据中提取局部特征和模式。

- 结构:CNN通常由多个卷积层和池化层组成。卷积层负责捕捉数据中的局部特征,而池化层则用于减少特征的维度,同时保留重要的特征信息。

- 作用:通过CNN提取的特征将为后续的GRU和注意力机制提供输入。

- 门控循环单元(GRU):

- 功能:GRU是一种循环神经网络(RNN)的变体,它通过门控机制解决了传统RNN中的梯度消失问题,能够更好地捕捉序列数据中的长期依赖关系。

- 结构:GRU包含重置门(Reset Gate)和更新门(Update Gate)两个门控机制。这些门控机制允许GRU模型在处理时间序列数据时,决定哪些信息应该被保留,哪些信息应该被遗忘。

- 作用:在CNN提取的特征序列上,GRU模型对特征序列的时序前后关系进行建模,从而捕捉到序列中的长期依赖关系。

- 注意力机制(Attention):

- 功能:注意力机制允许模型在预测或分类时,将更多的关注力放在重要的时间步上,而忽略无关的信息。

- 工作原理:通过对GRU输出的隐藏层状态参数进行重新分配权值,模型可以更加关注重要的时间步并忽略无关的信息,从而提高预测的精度。

- 作用:注意力机制能够进一步提高模型对特征序列中不同部分的关注程度,从而提升预测或分类的准确性。

网络结构:

以霜冰RIME优化CNN-GRU-Attention预测效果为例,其效果如图

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)