首个国产芯片训练SOTA模型GLM-Image上线,基于昇腾玩转推理

1月14日,智谱联合华为开源新一代图像生成模型GLM-Image,模型基于昇腾Atlas 800T A2设备和昇思MindSpore AI框架完成从数据到训练的全流程,是首个在国产芯片上完成全程训练的SOTA多模态模型。GLM-Image采用自主创新的「自回归+扩散解码器」混合架构,实现了图像生成与语言模型的联合,是智谱面向以Nano Banana Pro为代表的新一代「认知型生成」技术范式的一次

1月14日,智谱联合华为开源新一代图像生成模型GLM-Image,模型基于昇腾Atlas 800T A2设备和昇思MindSpore AI框架完成从数据到训练的全流程,是首个在国产芯片上完成全程训练的SOTA多模态模型。

GLM-Image采用自主创新的「自回归+扩散解码器」混合架构,实现了图像生成与语言模型的联合,是智谱面向以Nano Banana Pro为代表的新一代「认知型生成」技术范式的一次重要探索。

GLM-Image已上线魔乐社区, 同步上线基于昇腾和MindIE的推理实践。访问下方链接即可体验~

🔗 模型直达:https://modelers.cn/models/zhipuai/GLM-Image

🔗 基于昇腾的推理实践: https://modelers.cn/models/MindIE/GLM-Image

01 模型亮点

- 架构革新,面向「认知型生成」的技术探索:采用创新的「自回归 + 扩散编码器」混合架构,兼顾全局指令理解与局部细节刻画,克服了海报、PPT、科普图等知识密集型场景生成难题,向探索以Nano Banana Pro为代表的新一代“知识+推理”的认知型生成模型迈出了重要一步。

- 首个在国产芯片完成全程训练的SOTA模型:模型自回归结构基座基于昇腾Atlas 800T A2设备与昇思MindSpore AI框架,完成了从数据预处理到大规模训练的全流程构建,验证了在国产全栈算力底座上训练前沿模型的可行性。

- 文字渲染开源SOTA:在CVTG-2K(复杂视觉文本生成)和LongText-Bench(长文本渲染)榜单获得开源第一,尤其擅长汉字生成任务。

GLM-Image是智谱对国产计算生态的一次深度探索与验证。其自回归结构基座从早期的数据预处理到最终的大规模预训练,全流程均在昇腾Atlas 800T A2设备上完成。

依托昇腾NPU和昇思MindSpore AI框架,使用动态图多级流水下发、高性能融合算子、多流并行等特性,智谱自研了模型训练套件,全面优化数据预处理、预训练、SFT和RL的端到端流程。通过动态图的多级流水优化机制,将Host侧算子下发的关键阶段流水化并高度重叠,消除下发瓶颈;通过多流并行策略,通信和计算互掩,打破文本梯度同步、图像特征广播等操作的通信墙,极致优化性能;使用AdamW EMA、COC、RMS Norm等昇腾亲和的高性能融合算子,同步提升训练的稳定性和性能。

GLM-Image是首个在国产芯片上完成全流程训练的SOTA多模态模型,验证了在国产全栈算力底座上训练高性能多模态生成模型的可行性。

02 模型效果

让我们来看看GLM-Image在实际的复杂图文任务中的表现。

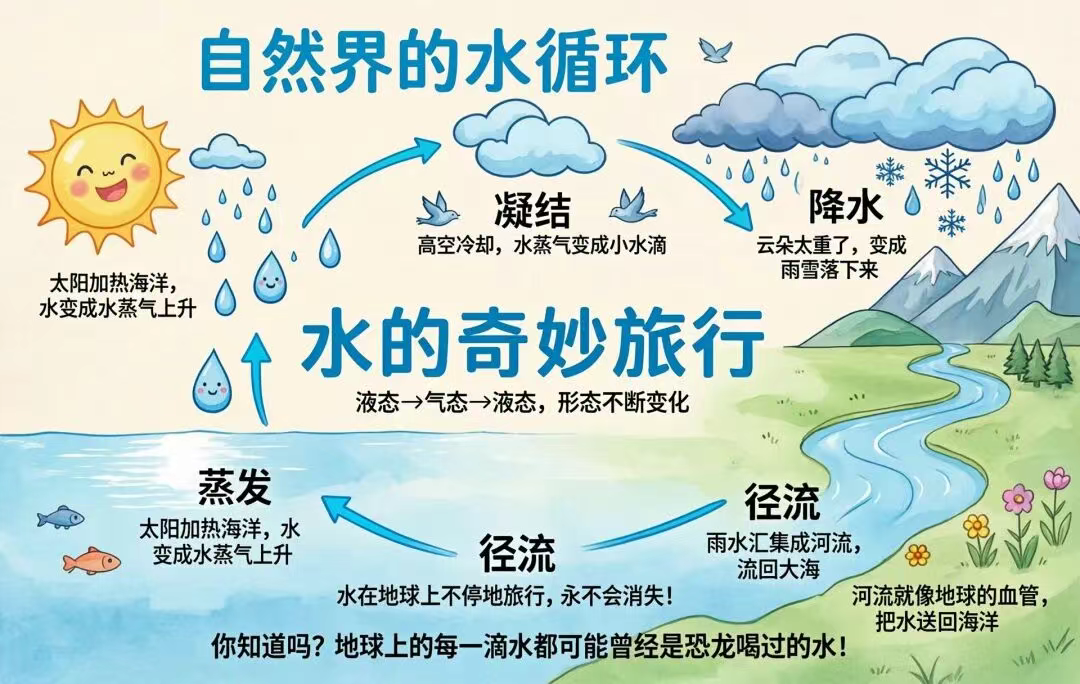

场景一:科普插画

GLM-Image 更擅长绘制包含复杂逻辑流程与文字说明的科普插画及原理示意图。

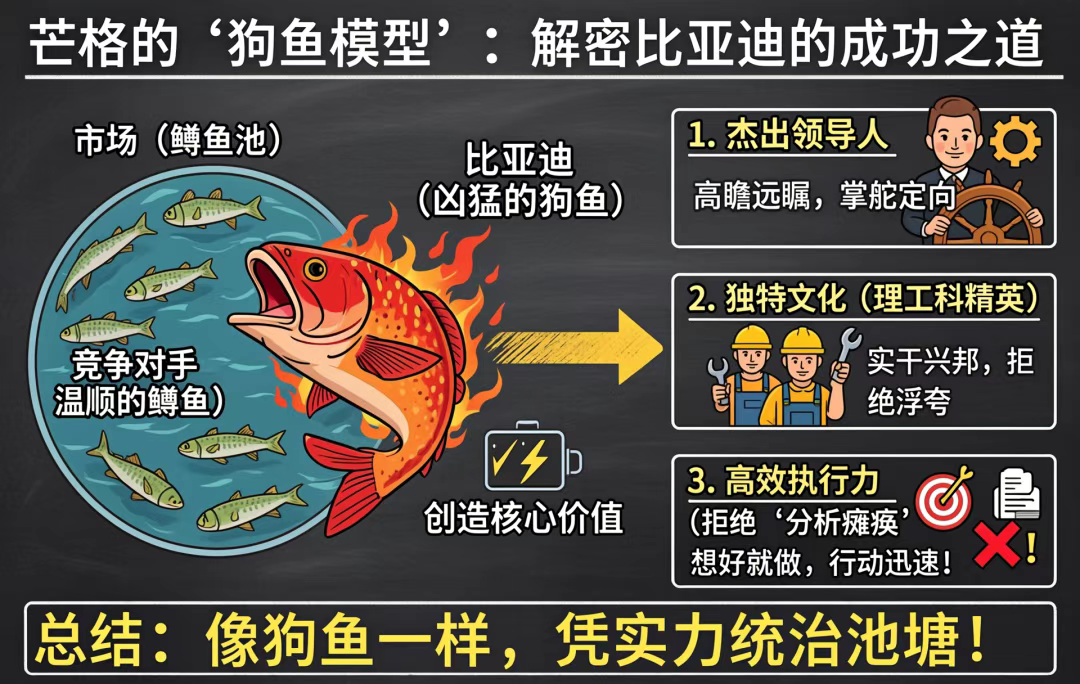

场景二:多格图画

在生成电商图、漫画等多格图画时,GLM-Image能够保持风格和主体的一致性,并保障多处文字生成的准确率。

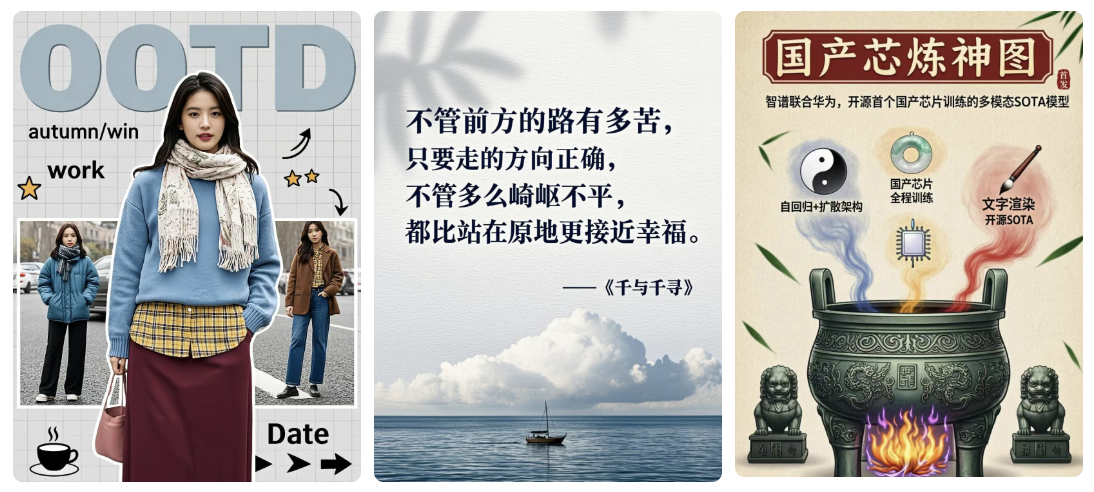

场景三:社交媒体图文封面

GLM-Image 适用于制作社交媒体封面及内容等排版复杂的图片,让您的创作更自由丰富。

场景四:商业海报

GLM-Image 能够生成构图富有设计感、文字嵌入准确的节日海报与商业宣传图。

场景五:写实摄影

在文字渲染以外,GLM-Image也同样擅长生成各种景别和尺寸的人像、宠物、风景、静物。

03 推理实践

基于昇腾的推理实践已上线魔乐社区,欢迎开发者部署体验,如有任何问题可在模型讨论区交流。

推理指导:

https://modelers.cn/models/MindIE/GLM-Image

镜像链接:

https://mindie.obs.cn-north-4.myhuaweicloud.com/zhipu/mindie_2.2.RC1-800I-A2-Glm-Image-py311-openeuler24.03-lts-aarch64.tar.gz

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)