机器学习之GD、SGD

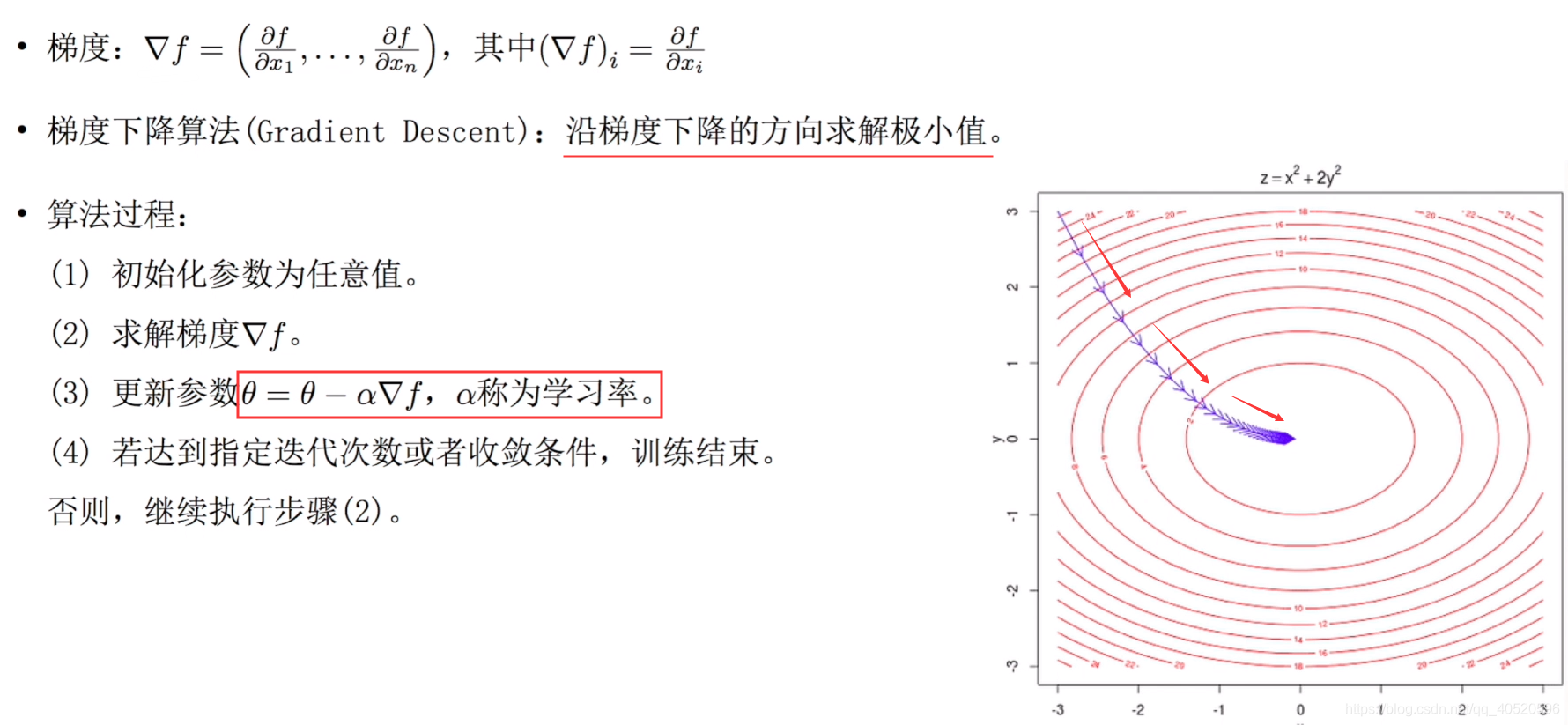

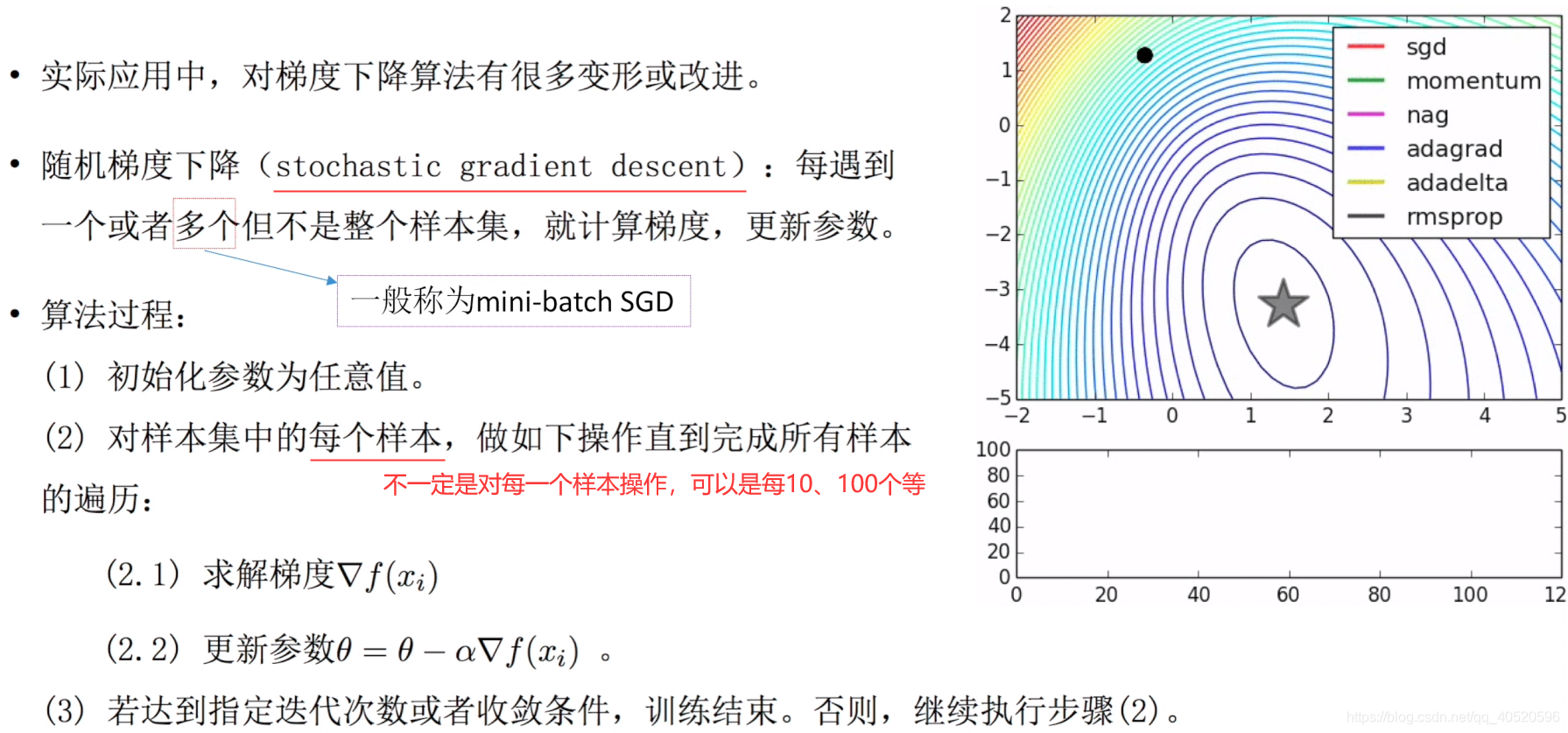

机器学习之GD、SGD1. 梯度下降法 GD2. 随机梯度下降法 SGD 1. 梯度下降法 GD 2. 随机梯度下降法 SGDSGD和之前的GD区别在于,GD是对函数进行求导,对整个训练集每个样本来计算,但是SGD则是对一个或者多个样本来操作,例如有10000个样本,但每次只对100个或1000个来计算梯度,从而更新参数;SGD存在一个弊端:因为求得的梯度...

·

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)