李宏毅机器学习(七)GPT的野望

前情提要前面我们有说,BERT做的是什么?Bert做的是填空题! GPT做的是什么? 做的是预测接下来要出现的Token是什么? 它里面的结构有点像Transformer中的DecoderGPT最有名的就是生成了一个关于独角兽的假新闻!同时也说明了它的作用就是可以写出一个文章GPT系列很难去训练,因为太大了,也很难去fine-tune! 但是GPT有一个很狂的想法: 就是说我们只给你少量或者没有参

前情提要

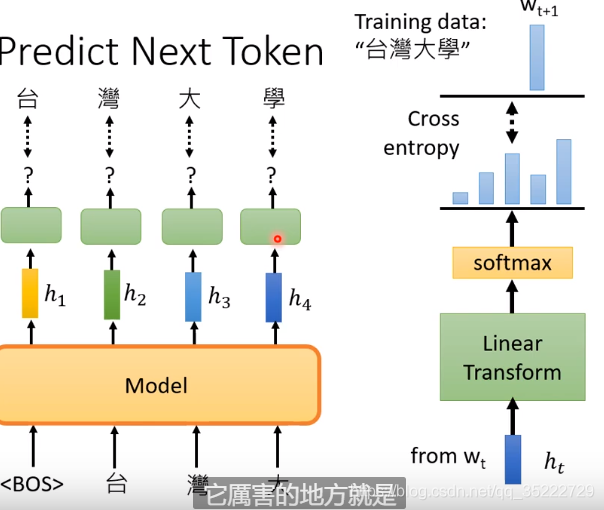

前面我们有说,BERT做的是什么? Bert做的是填空题! GPT做的是什么? 做的是预测接下来要出现的Token是什么? 它里面的结构有点像Transformer中的Decoder

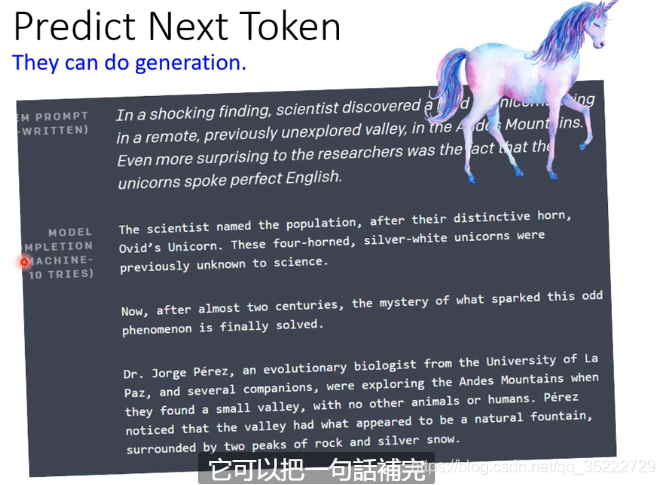

GPT最有名的就是生成了一个关于独角兽的假新闻! 同时也说明了它的作用就是可以写出一个文章

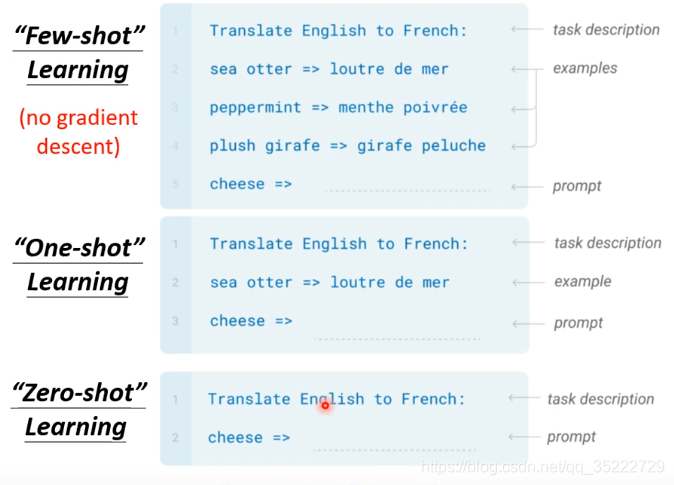

GPT系列很难去训练,因为太大了,也很难去fine-tune! 但是GPT有一个很狂的想法: 就是说我们只给你少量或者没有参考样本,在给出你提示后,让你去学习出正确的答案!

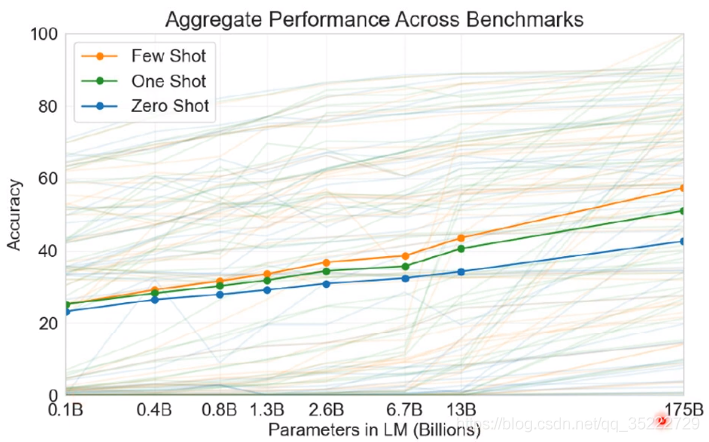

给出了42个任务! 这些是42个任务的准确率!

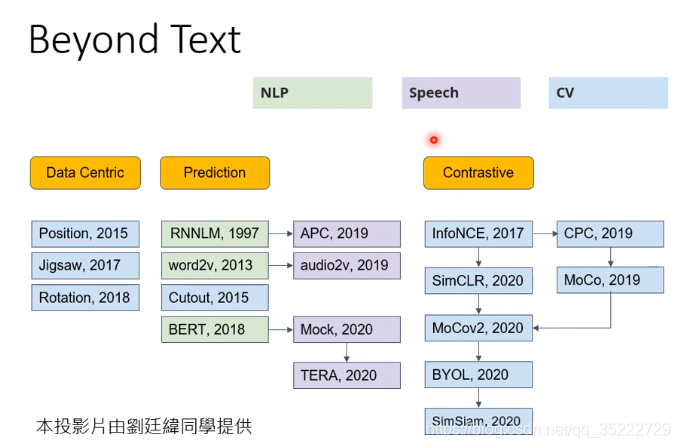

Beyond Text

当然也可以用在不同的领域上了!

Image

BYOL:Bootstrap Your Own Latent(不知道为什么会Work! Deep learning的神奇)

SimCLR

Speech

Audio Version/Bert 也可以补全语音

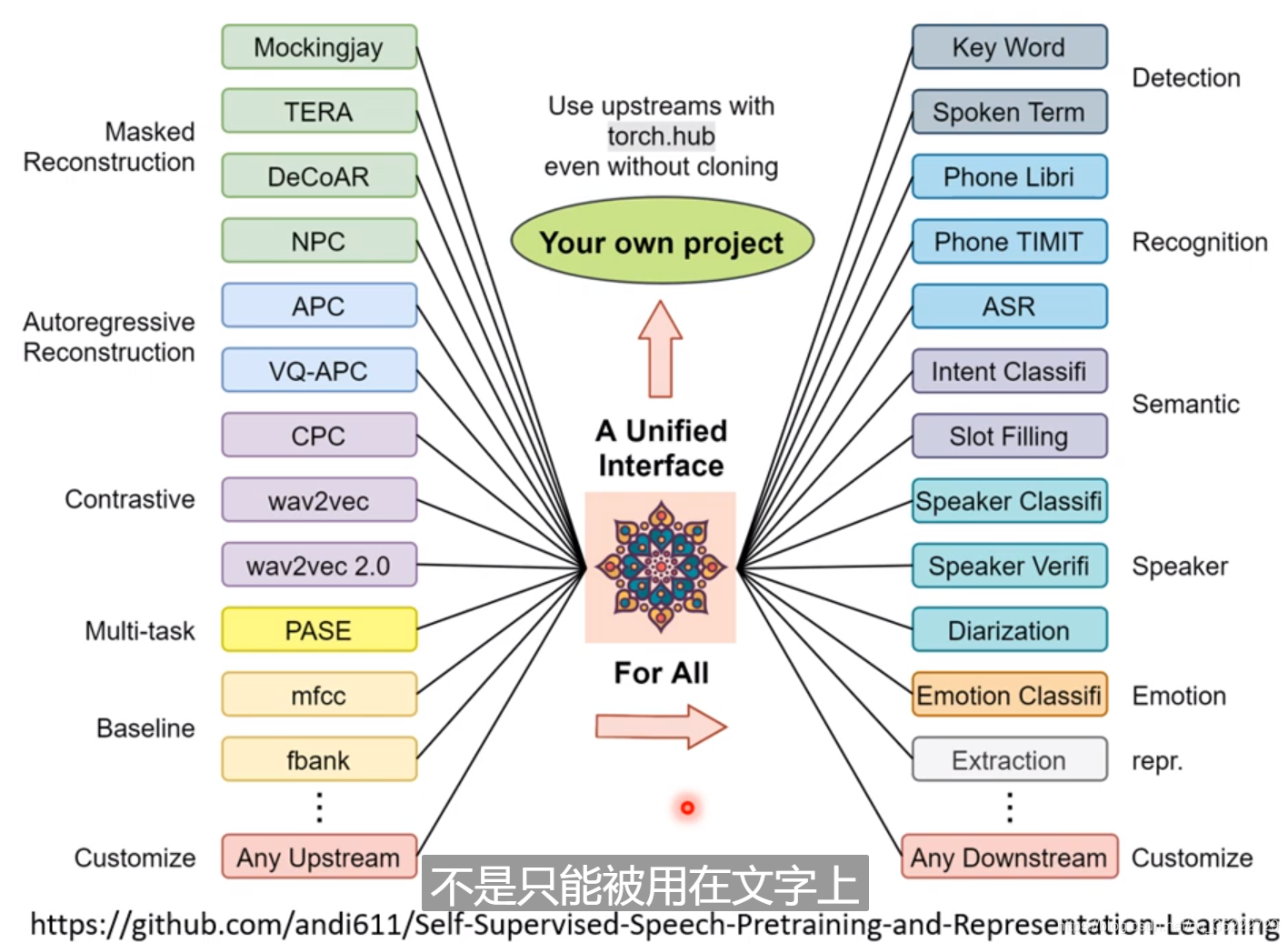

Speech GLUE- SUPERB

这是各种Self-supervised的模型!

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)