机器学习十二大算法小白学习路线

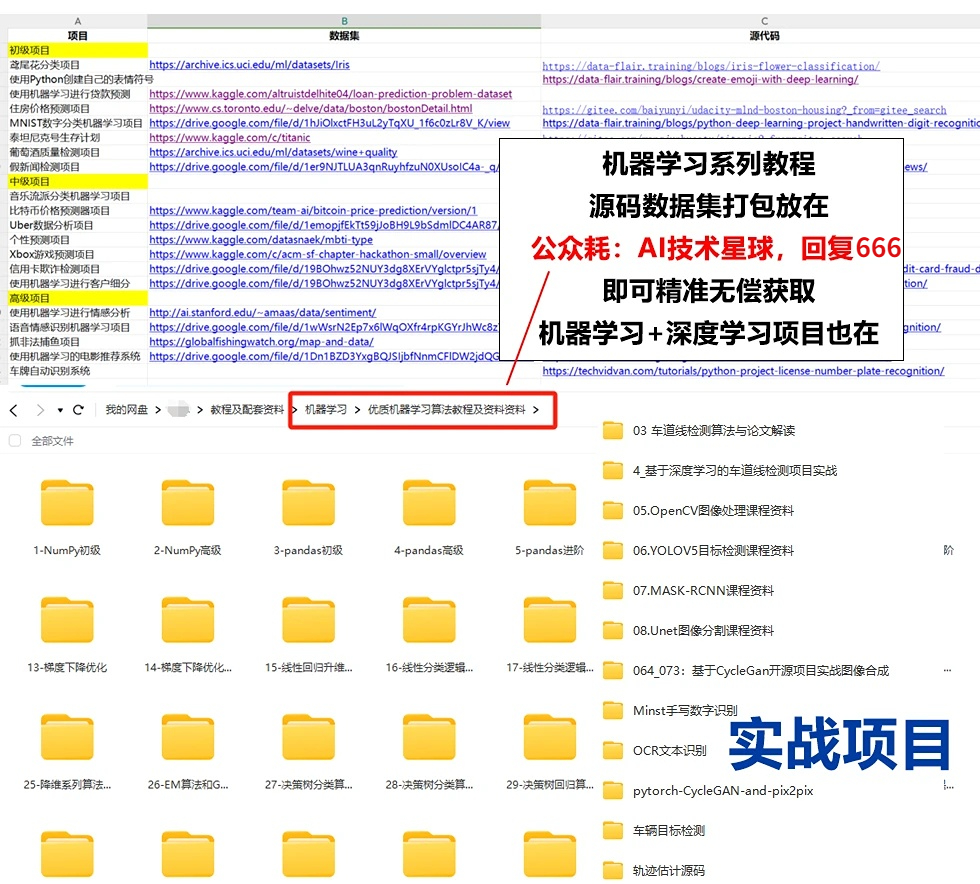

本文介绍了机器学习中的十二大经典算法,包括线性回归、逻辑回归、决策树、支持向量机、K-近邻、K-均值聚类、主成分分析、随机森林、梯度提升树、神经网络、卷积神经网络和循环神经网络。每个算法的基本原理、学习资源和实践代码都进行了详细说明,帮助初学者逐步掌握这些算法。此外,文章还提供了人工智能学习资料的获取方式,包括课程、项目、视频和论文等,旨在帮助读者系统学习并应用机器学习知识。

机器学习是人工智能的一个重要分支,它通过构建模型从数据中自动学习规律,并利用这些规律进行预测或决策。在机器学习中,有许多经典的算法,每个算法都有其独特的应用场景和优势。对于初学者来说,了解这些算法的基本原理和应用是非常重要的。本文将为你介绍机器学习中的十二大经典算法,并提供一份详细的学习路线,帮助你逐步掌握这些算法。

一、线性回归(Linear Regression)

(一)算法原理

线性回归是一种用于预测连续值目标变量的监督学习算法。它假设目标变量与特征之间存在线性关系,通过最小化预测值与真实值之间的误差来训练模型。

(二)学习资源

(三)实践代码

Python

复制

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

# 生成数据

np.random.seed(42)

X = 2 * np.random.rand(100, 1)

y = 4 + 3 * X + np.random.randn(100, 1)

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = LinearRegression()

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

mse = mean_squared_error(y_test, y_pred)

print(f'Mean Squared Error: {mse:.2f}')

# 可视化

plt.scatter(X, y, color='blue', label='Data points')

plt.plot(X_test, y_pred, color='red', linewidth=2, label='Linear regression')

plt.xlabel('X')

plt.ylabel('y')

plt.legend()

plt.show()二、逻辑回归(Logistic Regression)

(一)算法原理

逻辑回归是一种用于二分类任务的监督学习算法。它通过逻辑函数(Sigmoid 函数)将线性回归的输出映射到 [0, 1] 区间,表示样本属于某个类别的概率。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.linear_model import LogisticRegression

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = LogisticRegression(max_iter=1000)

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')三、决策树(Decision Tree)

(一)算法原理

决策树是一种通过树状结构进行分类或回归的监督学习算法。它通过递归地选择最优特征进行分裂,将数据分为多个子集,每个子集对应一个决策节点。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.tree import DecisionTreeClassifier

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = DecisionTreeClassifier()

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')四、支持向量机(SVM)

(一)算法原理

支持向量机是一种用于分类和回归的监督学习算法。它通过寻找最优分割超平面,将不同类别的数据分开。SVM 的目标是最大化间隔,即超平面到最近数据点的距离。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.svm import SVC

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = SVC(kernel='linear')

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')五、K-近邻(KNN)

(一)算法原理

K-近邻是一种用于分类和回归的监督学习算法。它通过计算样本之间的距离,找到最近的 K 个邻居,然后根据这些邻居的标签进行投票或平均,得到预测结果。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.neighbors import KNeighborsClassifier

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = KNeighborsClassifier(n_neighbors=3)

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')六、K-均值聚类(K-Means Clustering)

(一)算法原理

K-均值聚类是一种用于无监督学习的聚类算法。它通过将数据分为 K 个簇,每个簇包含相似的数据点。算法的目标是最小化簇内距离的平方和。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.cluster import KMeans

import matplotlib.pyplot as plt

# 生成数据

X = np.random.rand(100, 2)

# 创建模型

model = KMeans(n_clusters=3)

# 训练模型

model.fit(X)

# 预测

y_pred = model.predict(X)

# 可视化

plt.scatter(X[:, 0], X[:, 1], c=y_pred, cmap='viridis')

plt.scatter(model.cluster_centers_[:, 0], model.cluster_centers_[:, 1], s=300, c='red', marker='X')

plt.title('K-Means Clustering')

plt.show()七、主成分分析(PCA)

(一)算法原理

主成分分析是一种用于降维的无监督学习算法。它通过将数据投影到主成分方向上,减少数据的维度,同时保留尽可能多的信息。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.decomposition import PCA

from sklearn.datasets import load_iris

import matplotlib.pyplot as plt

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 创建模型

pca = PCA(n_components=2)

# 训练模型

X_pca = pca.fit_transform(X)

# 可视化

plt.scatter(X_pca[:, 0], X_pca[:, 1], c=y, cmap='viridis')

plt.xlabel('Principal Component 1')

plt.ylabel('Principal Component 2')

plt.title('PCA of Iris Dataset')

plt.show()八、随机森林(Random Forest)

(一)算法原理

随机森林是一种集成学习算法,通过构建多个决策树并结合它们的预测结果来提高模型的性能。它通过随机选择特征和样本,减少过拟合的风险。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.ensemble import RandomForestClassifier

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = RandomForestClassifier(n_estimators=100)

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')九、梯度提升树(Gradient Boosting)

(一)算法原理

梯度提升树是一种集成学习算法,通过逐步构建多个弱学习器(通常是决策树),并优化损失函数来提高模型的性能。它通过梯度下降法逐步减少误差。

(二)学习资源

(三)实践代码

Python

复制

from sklearn.ensemble import GradientBoostingClassifier

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = GradientBoostingClassifier(n_estimators=100)

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'Accuracy: {accuracy:.2f}')十、神经网络(Neural Networks)

(一)算法原理

神经网络是一种模拟人类大脑神经元结构的计算模型,通过多层神经元的连接和激活函数进行复杂的模式识别和预测任务。

(二)学习资源

(三)实践代码

Python

复制

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

# 加载数据

iris = load_iris()

X = iris.data

y = iris.target

# 数据标准化

scaler = StandardScaler()

X = scaler.fit_transform(X)

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 构建模型

model = Sequential([

Dense(64, activation='relu', input_shape=(4,)),

Dense(32, activation='relu'),

Dense(3, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(X_train, y_train, epochs=50, batch_size=10)

# 评估模型

loss, accuracy = model.evaluate(X_test, y_test)

print(f'Accuracy: {accuracy:.2f}')十一、卷积神经网络(CNN)

(一)算法原理

卷积神经网络是一种专门用于处理图像数据的神经网络,通过卷积层、池化层和全连接层提取图像特征,适用于图像分类、目标检测等任务。

(二)学习资源

(三)实践代码

Python

复制

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

from tensorflow.keras.datasets import mnist

from tensorflow.keras.utils import to_categorical

# 加载数据

(X_train, y_train), (X_test, y_test) = mnist.load_data()

# 数据预处理

X_train = X_train.reshape((-1, 28, 28, 1)).astype('float32') / 255

X_test = X_test.reshape((-1, 28, 28, 1)).astype('float32') / 255

y_train = to_categorical(y_train, 10)

y_test = to_categorical(y_test, 10)

# 构建模型

model = Sequential([

Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

MaxPooling2D((2, 2)),

Flatten(),

Dense(128, activation='relu'),

Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(X_train, y_train, epochs=5, batch_size=64)

# 评估模型

loss, accuracy = model.evaluate(X_test, y_test)

print(f'Accuracy: {accuracy:.2f}')十二、循环神经网络(RNN)

(一)算法原理

循环神经网络是一种用于处理序列数据的神经网络,通过循环结构捕捉时间序列中的依赖关系,适用于文本生成、时间序列预测等任务。

(二)学习资源

(三)实践代码

Python

复制

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import SimpleRNN, Dense

from tensorflow.keras.datasets import mnist

from tensorflow.keras.utils import to_categorical

# 加载数据

(X_train, y_train), (X_test, y_test) = mnist.load_data()

# 数据预处理

X_train = X_train.reshape((-1, 28, 28)).astype('float32') / 255

X_test = X_test.reshape((-1, 28, 28)).astype('float32') / 255

y_train = to_categorical(y_train, 10)

y_test = to_categorical(y_test, 10)

# 构建模型

model = Sequential([

SimpleRNN(128, input_shape=(28, 28)),

Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(X_train, y_train, epochs=5, batch_size=64)

# 评估模型

loss, accuracy = model.evaluate(X_test, y_test)

print(f'Accuracy: {accuracy:.2f}')总结

通过本文提供的学习路线,你可以从零基础逐步掌握机器学习中的十二大经典算法。这些算法涵盖了监督学习、无监督学习和深度学习等多个领域,是机器学习领域的基石。希望这些内容能够帮助你快速入门机器学习,并在实际项目中应用所学知识。

免费分享一些我整理的人工智能学习资料给大家,包括一些AI常用框架实战视频、图像识别、OpenCV、NLQ、机器学习、pytorch、计算机视觉、深度学习与神经网络等视频、课件源码、国内外知名精华资源、AI热门论文、行业报告等。

为了更好的系统学习AI,推荐大家收藏一份。

下面是部分截图,关注VX公众号【AI技术星球】发送暗号 666 领取

一、人工智能课程及项目

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献73条内容

已为社区贡献73条内容

所有评论(0)