Dify+Ollama实现本地化部署DeepSeek

本文给大家介绍如何通过Ollama部署本地大模型,Dify如何接入Ollama部署的本地大模型。

目录

一、环境配置

1、安装Docker Desktop

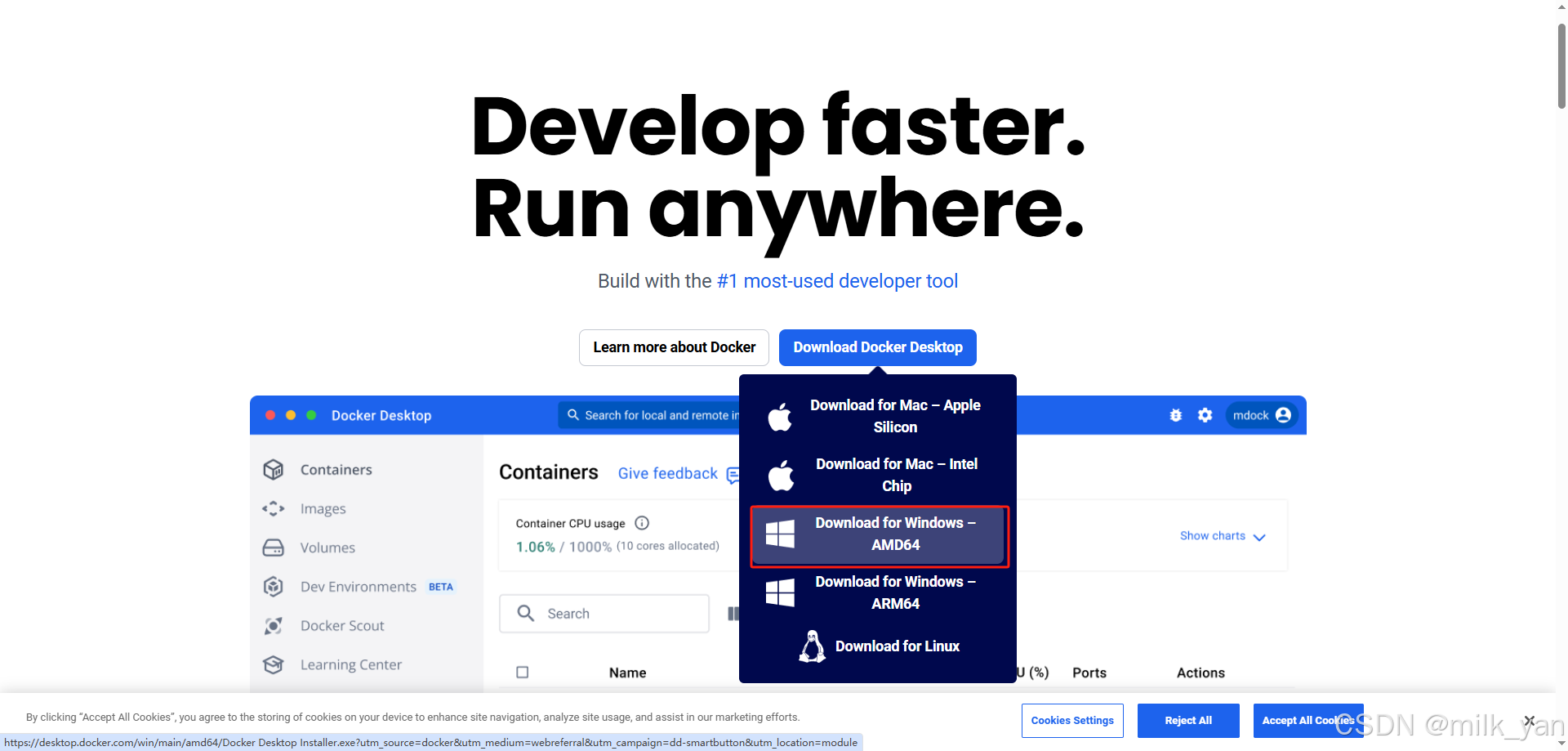

1.首先进入官网https://www.docker.com/;根据电脑的型号下载对应的安装包。

2.运行![]() exe文件安装docker desktop。

exe文件安装docker desktop。

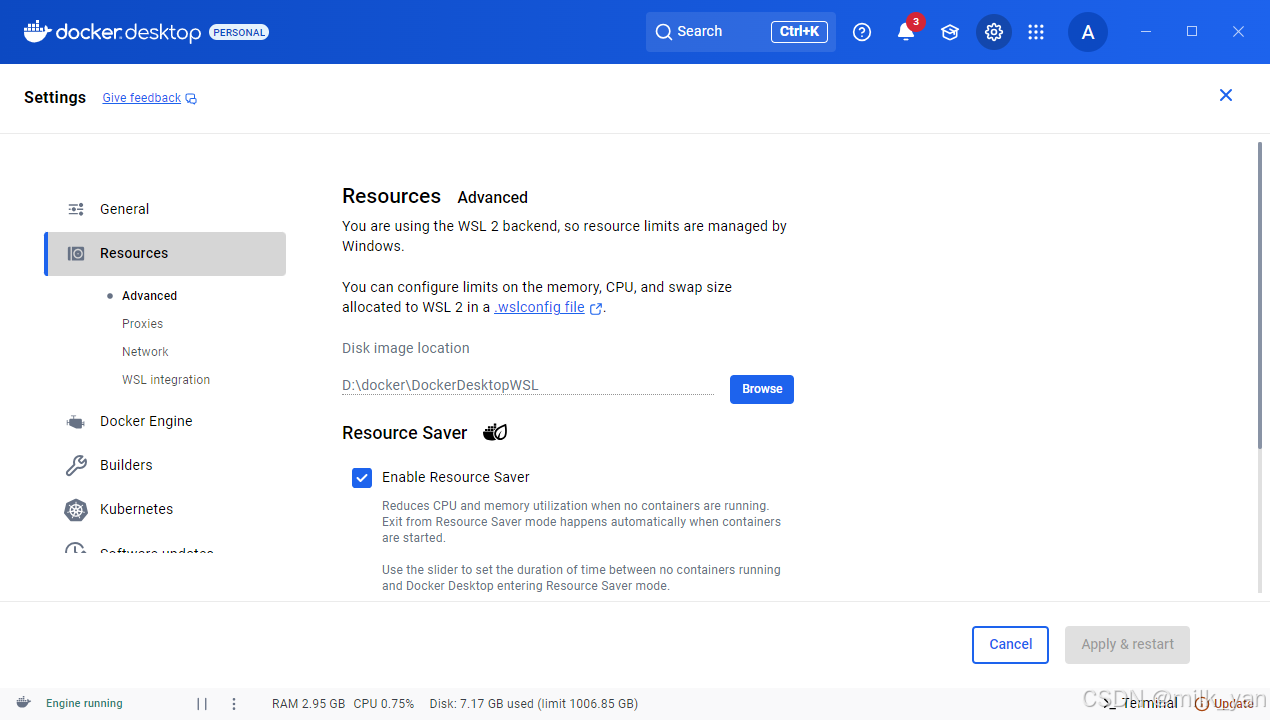

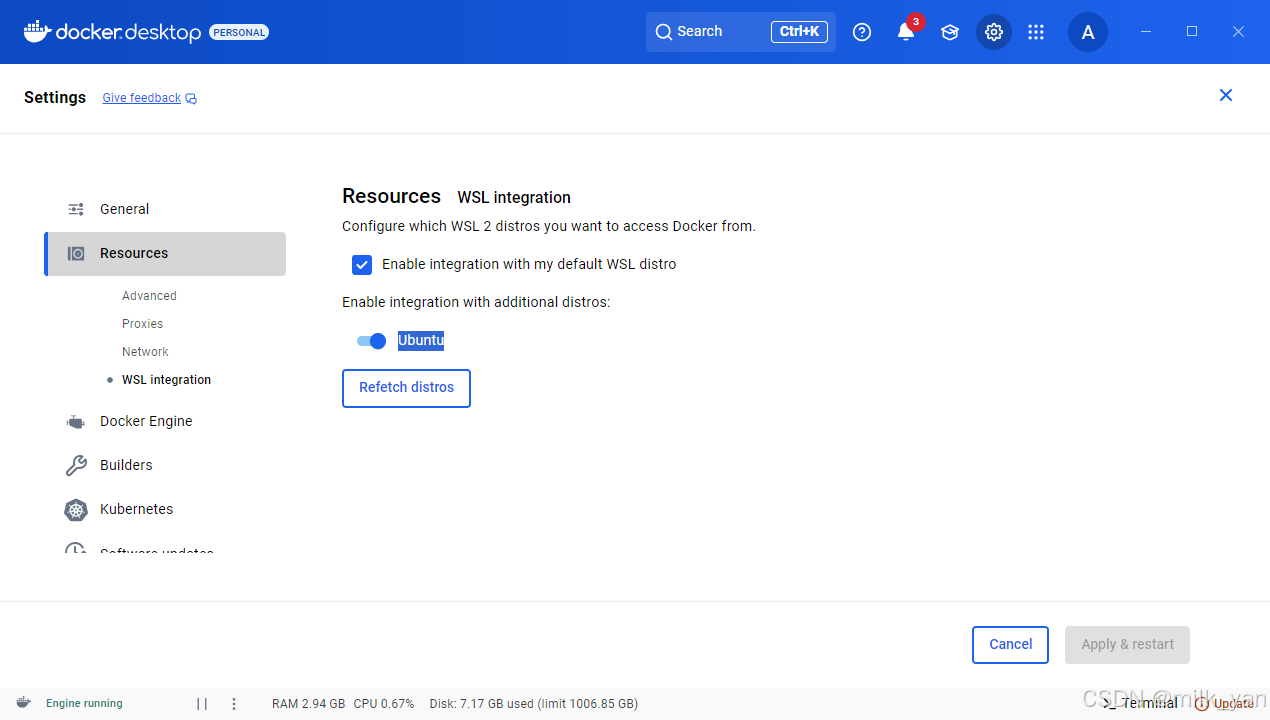

3.运行docker desktop,然后点击change settings --- Resources --- WSL intergration勾选Enable integration with my default WSL distro和Ubuntu选项;点击同目录下的Advanced,可以更换一下镜像地址到电脑的其他盘。

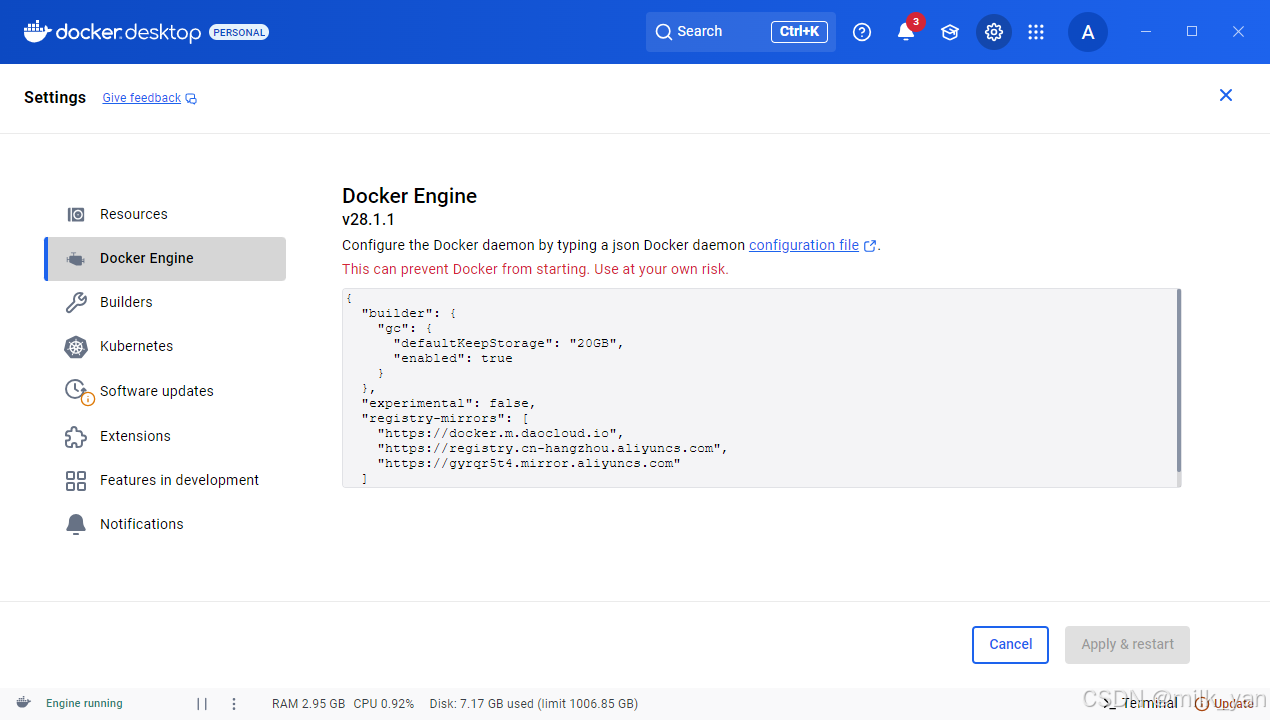

4.由于https://registry-1.docker.io/v2/不提供镜像下载了,需更换可以提供镜像下载的地址;点击Docker Engine;然后新增镜像加速器地址:

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"registry-mirrors": [

"https://docker.m.daocloud.io",

"https://registry.cn-hangzhou.aliyuncs.com",

"https://gyrqr5t4.mirror.aliyuncs.com"

]

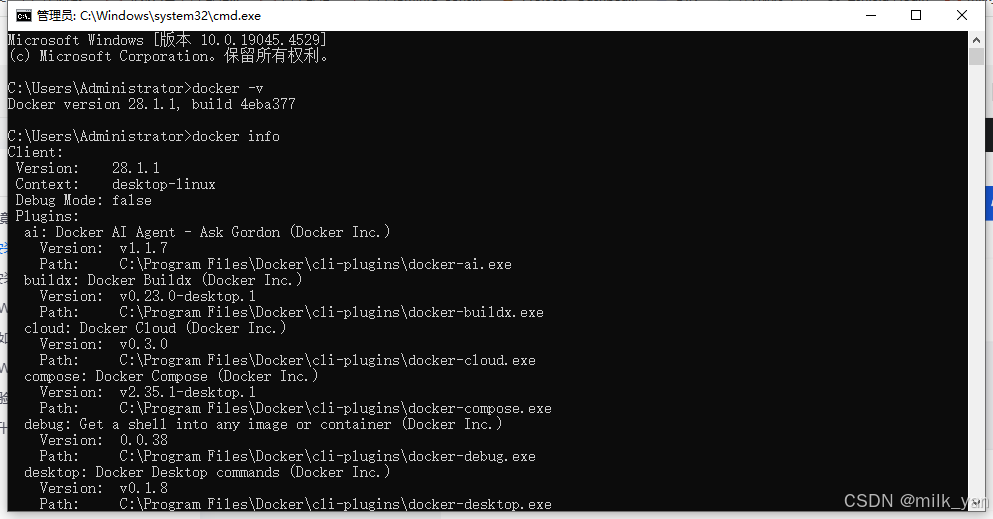

} 5.打开cmd窗口,输入docker -v 查看docker版本;输入docker info 查看docker信息

5.打开cmd窗口,输入docker -v 查看docker版本;输入docker info 查看docker信息

2、安装WSL

Windows 默认不安装WSL(Windows Subsystem for Linux),但从 Windows 10 版本 2004 及更高版本(以及 Windows 11)开始,系统已内置 WSL 功能,只需手动启用即可使用。

1. WSL 的默认状态

-

未自动安装:Windows 不会默认安装 WSL,但支持快速通过命令或设置启用。

-

内置兼容性:系统内核已包含 WSL 所需组件,无需额外下载系统镜像。

2. 如何启用 WSL

-

方法一:通过命令(管理员权限运行)

wsl --install

此命令会自动启用 WSL 功能,并默认安装 Ubuntu 发行版(首次运行需重启)。

-

方法二:手动启用

打开 “控制面板” → “程序” → “启用或关闭 Windows 功能”。

勾选 “适用于 Linux 的 Windows 子系统” 和 “虚拟机平台”(WSL 2 需要)。

重启电脑后,从 Microsoft Store 安装所需的 Linux 发行版(如 Ubuntu、Debian 等)。

3. WSL 版本差异

-

WSL 1:早期版本,兼容性好,但性能较低。

-

WSL 2(推荐):基于虚拟机技术,性能接近原生 Linux。需满足:

-

Windows 10 版本 1903 或更高(建议 2004+)。

-

启用 “虚拟机平台” 功能。

-

4. 验证是否已安装

-

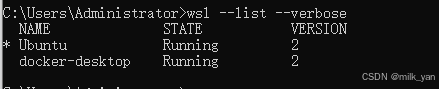

运行命令:

wsl --list --verbose

若显示已安装的发行版及其版本(WSL 1/WSL 2),则说明配置成功。

5.升级版本(如果是WSL1)

Docker 依赖 WSL 2 的网络,所以如果不是 WSL 2我们需要升级一下版本;

wsl --set-version Ubuntu 2 # 升级发行版

wsl --set-default-version 2 # 设为默认版本wsl --list --verbose # 查看版本

二 、下载安装Ollama

大模型的本地部署方式有很多,可以直接部署,也可以借助其他工具进行部署,为了方便使用和管理,通常是借助其他工具进行部署,例如Ollama或者LM Studio,相比于LM Studio,Ollama下载模型方便且兼容性好。

1.首先进入Ollama的官网https://ollama.com/,然后点击Download即可,这一步可能需要挂vpn,否则会访问不了

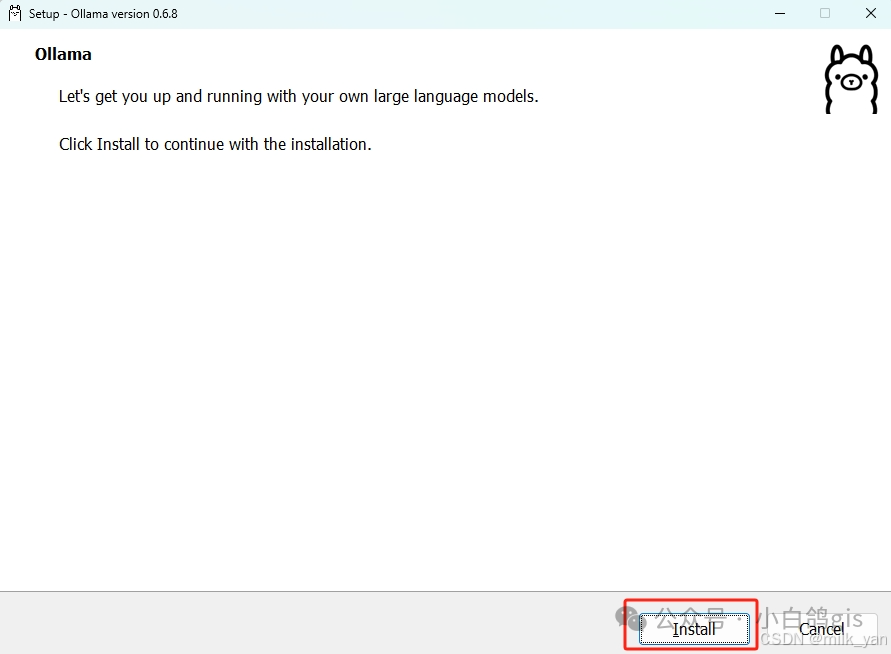

2.下载好后,打开安装包即可安装,对于Windows用户来说一路点击下一步就好了,Ollama默认是安装到C盘。

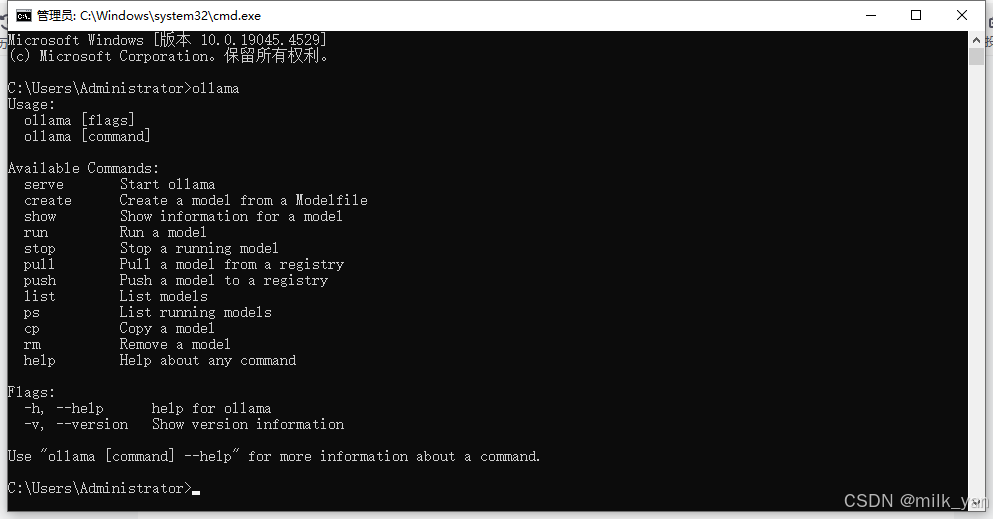

3.安装完成之后可以进行一下验证,打开cmd,输入ollama,如果像下面这样显示即表示安装成功了。

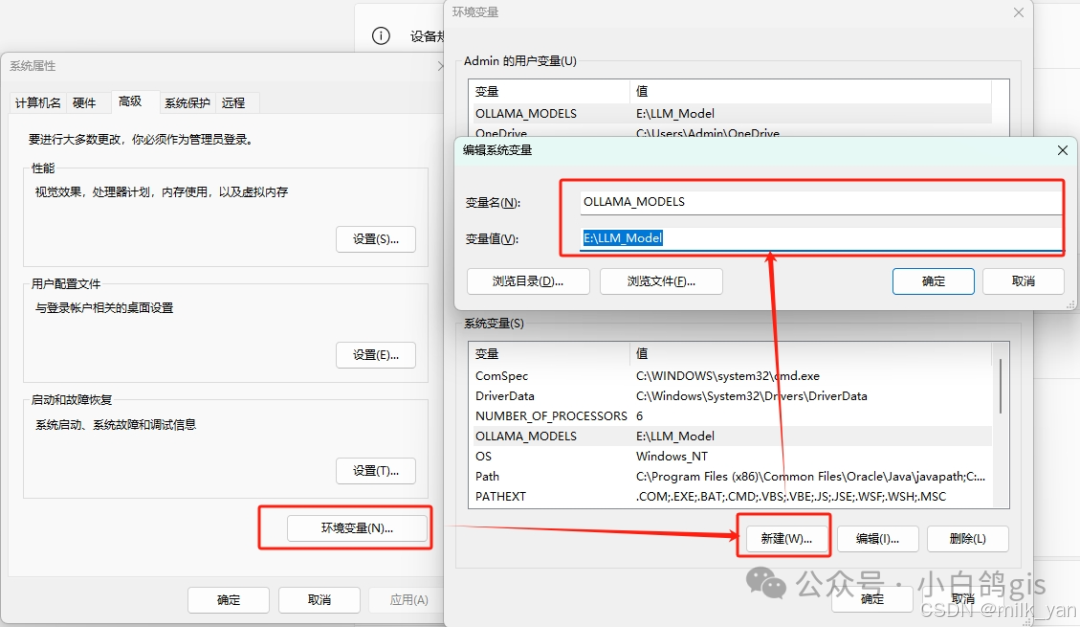

4.安装成功后可以在系统变量设置一下模型的下载路径,在桌面找到“此电脑”,右键“属性”,然后点击“高级系统设置”,找到“环境变量”,在系统变量下点击“新建”,在变量名输入“OLLAMA_MODELS”,在变量值输入自己想放置模型的路径。

重启一下Ollama,注意一定要重启,否则环境配置不生效,下载的模型还是默认在C盘。

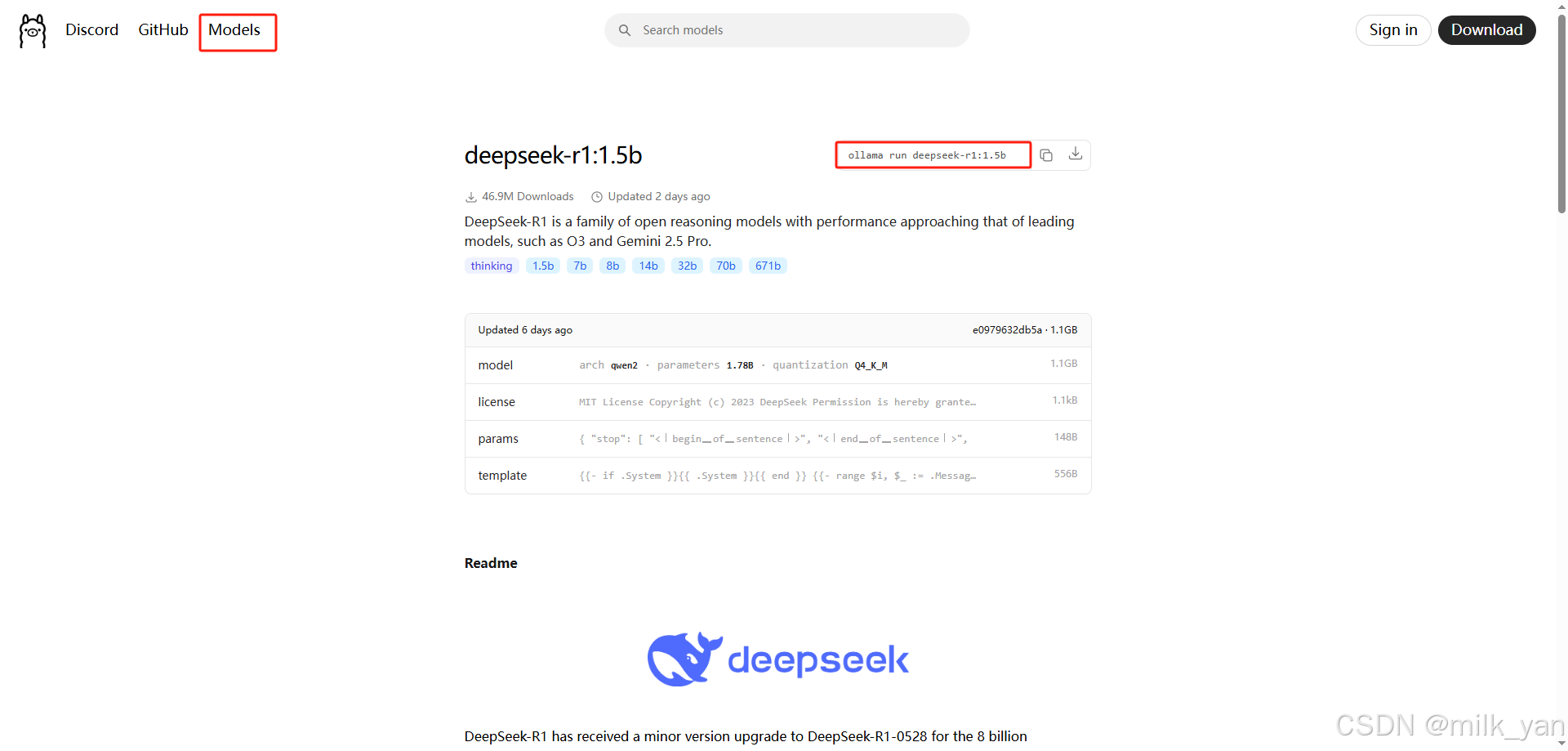

5.安装完ollama后可以进行模型的部署了,此处有两种办法,一种是在线安装,直接在Ollama的模型库里找,然后通过命令安装,Ollama会自动下载并部署模型;另一种是离线安装,离线安装是指从其他资源网站下载好模型(.gguf文件),例如从hugging face上下载模型,然后通过modlefile文件进行安装。此处以在线安装作为示例。

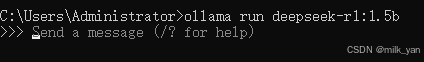

打开cmd,输入ollama run deepseek-r1:1.5b,即开始自动拉取模型,等待完成即可。

因为我这里已经拉取过了,所以直接启动了模型!

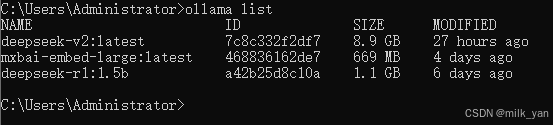

可以输入 ollama list 查看已经存在的模型:

三、安装Dify

Dify是一个开源的 LLM 应用开发平台。提供从 Agent 构建到 AI workflow 编排、RAG 检索、模型管理等能力,轻松构建和运营生成式 AI 原生应用。比 LangChain 更易用。

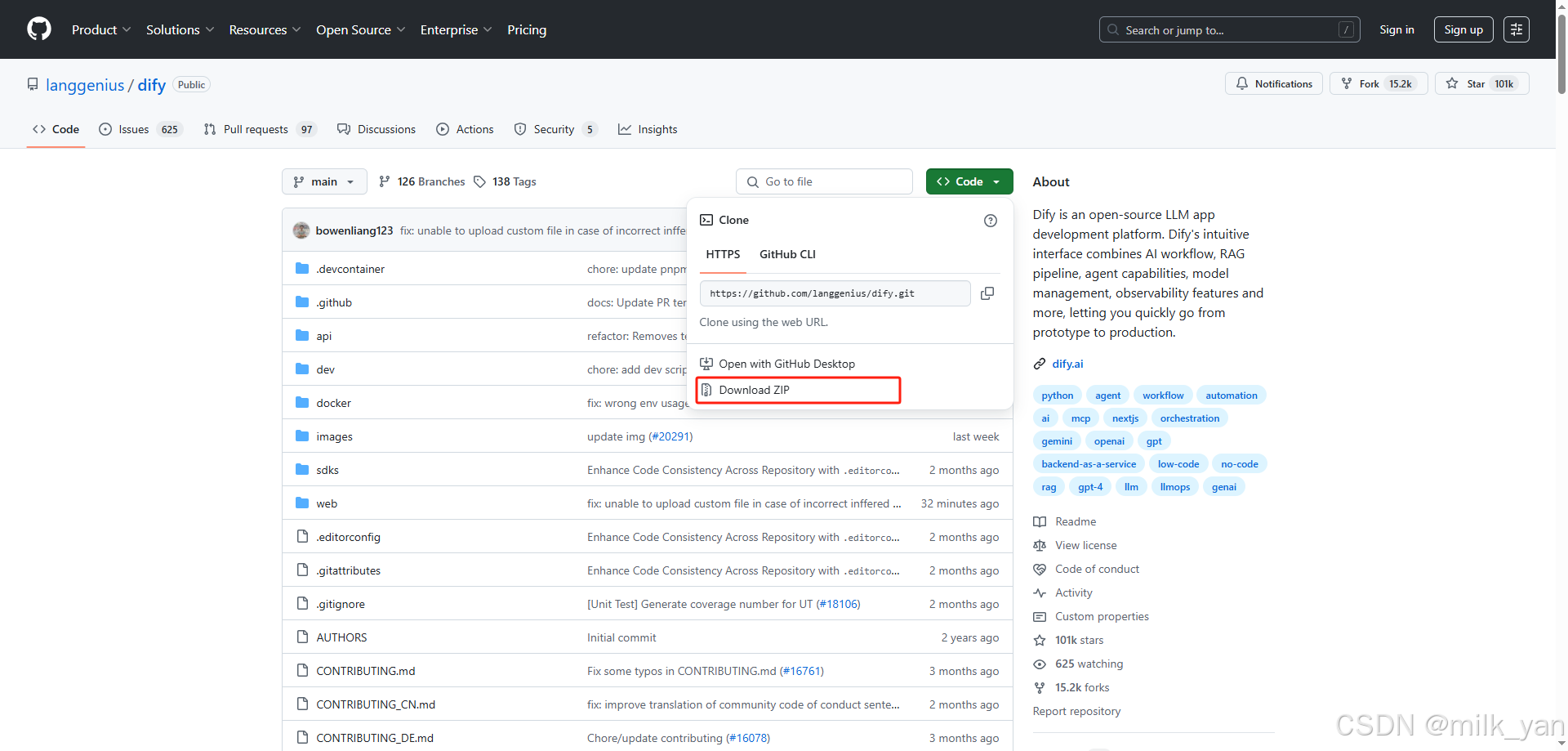

1.下载Dify

访问https://github.com/langgenius/dify.git,然后下载zip压缩包。

2.配置变量

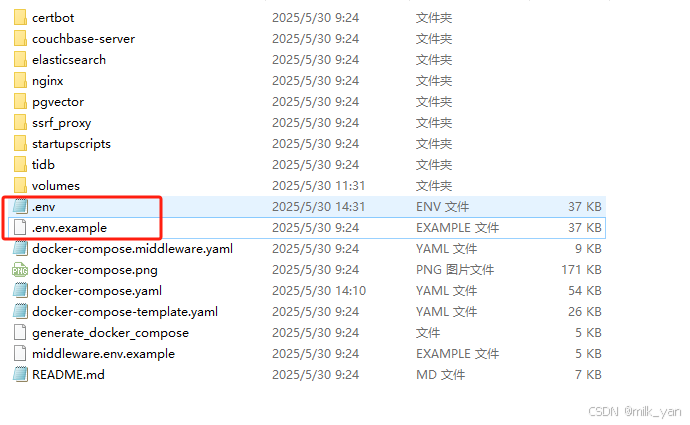

解压文件后进入到dify/docker目录下,将.env.example修改为.env(或者复制一份为.env)

因为后续需要集成ollama,所以打开.env文件加两行配置:

# 启用自定义模型

CUSTOM_MODEL_ENABLED=true

# 指定 Ollama 的 API地址(根据部署环境调整IP)

OLLAMA_API_BASE_URL=http://host.docker.internal:11434

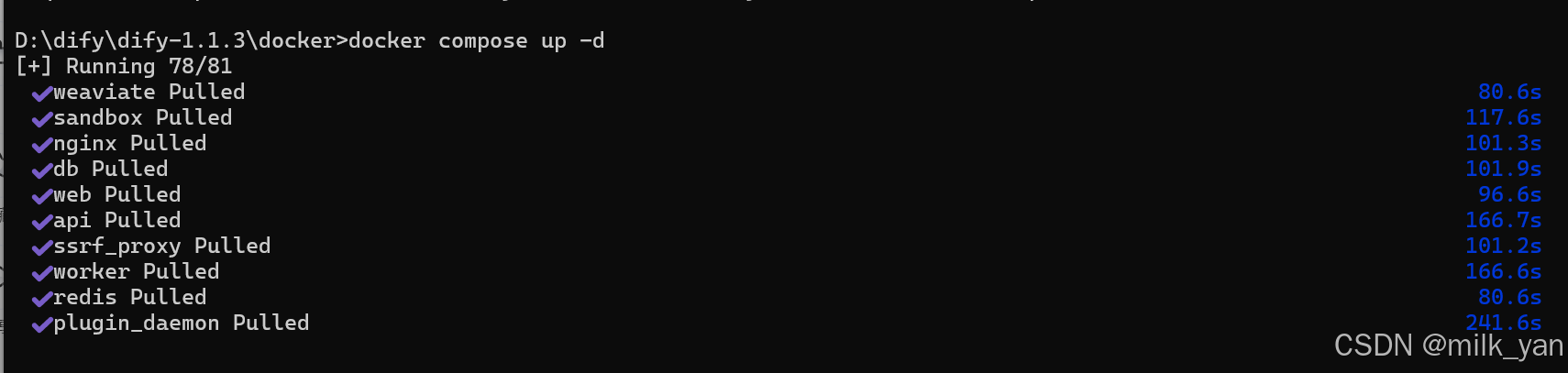

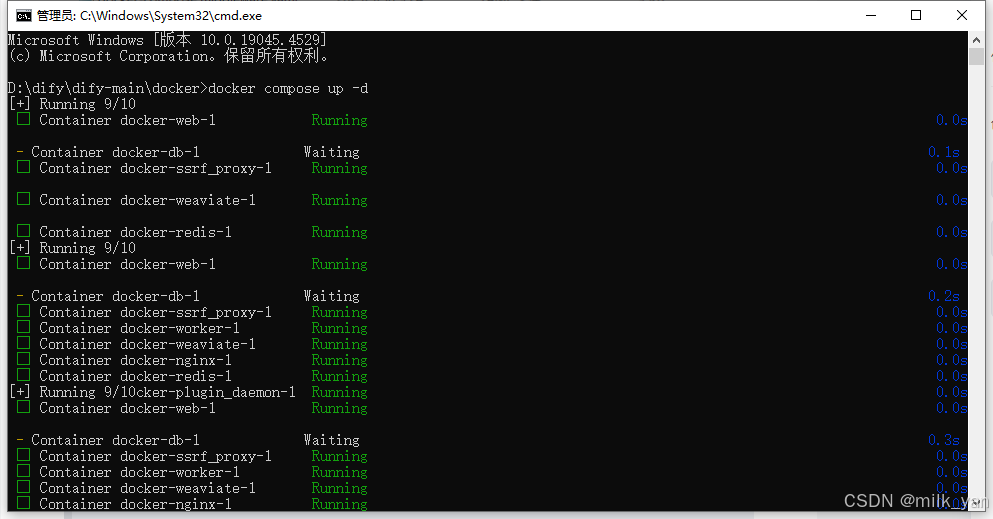

3. 启动Dify容器

进入 Dify 源代码的 Docker 目录,在此路径下打开cmd窗口,运行命令

docker compose up -d

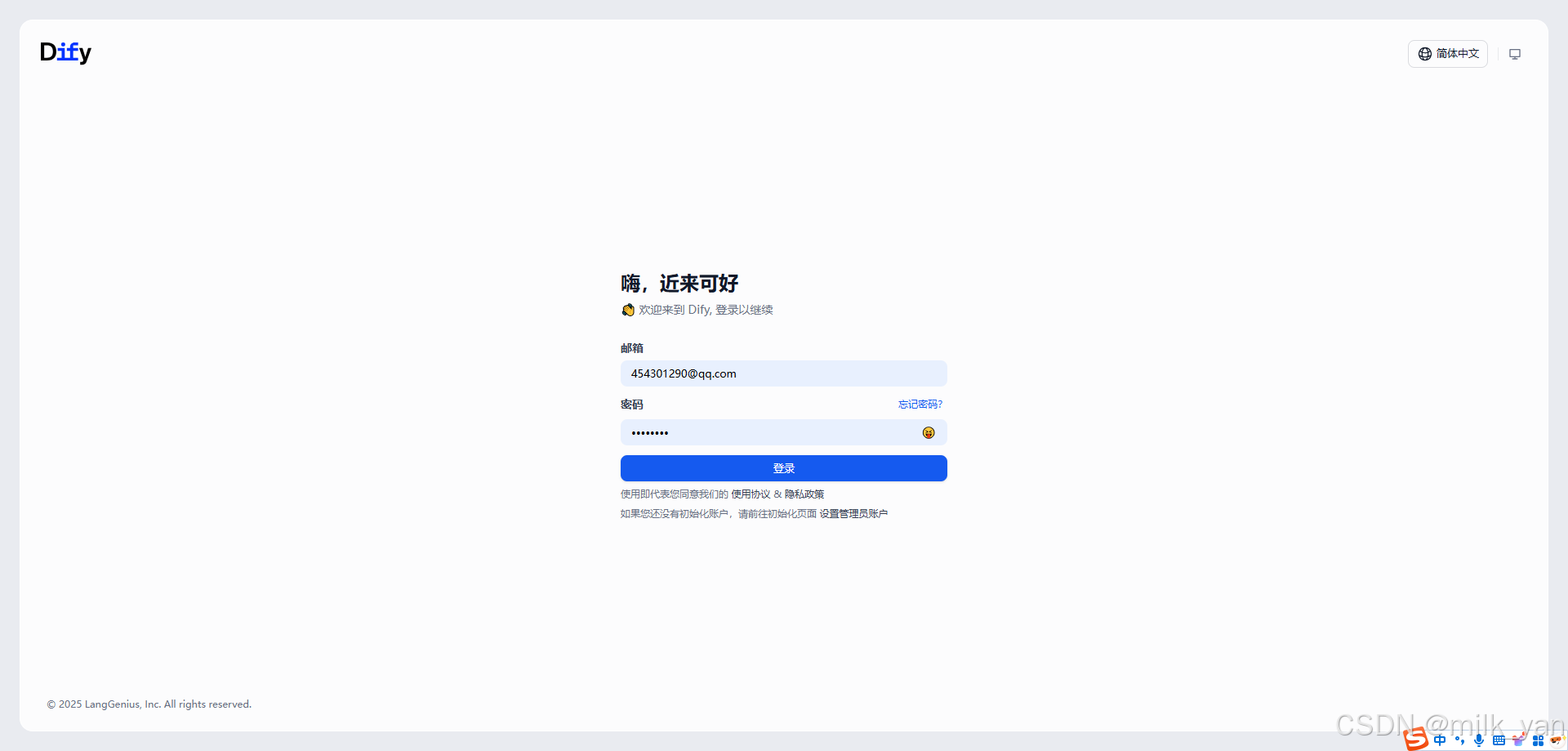

4.访问Dify

tips:首先是需要注册一下的,然后进入到登录界面

四、Dify接入本地大模型

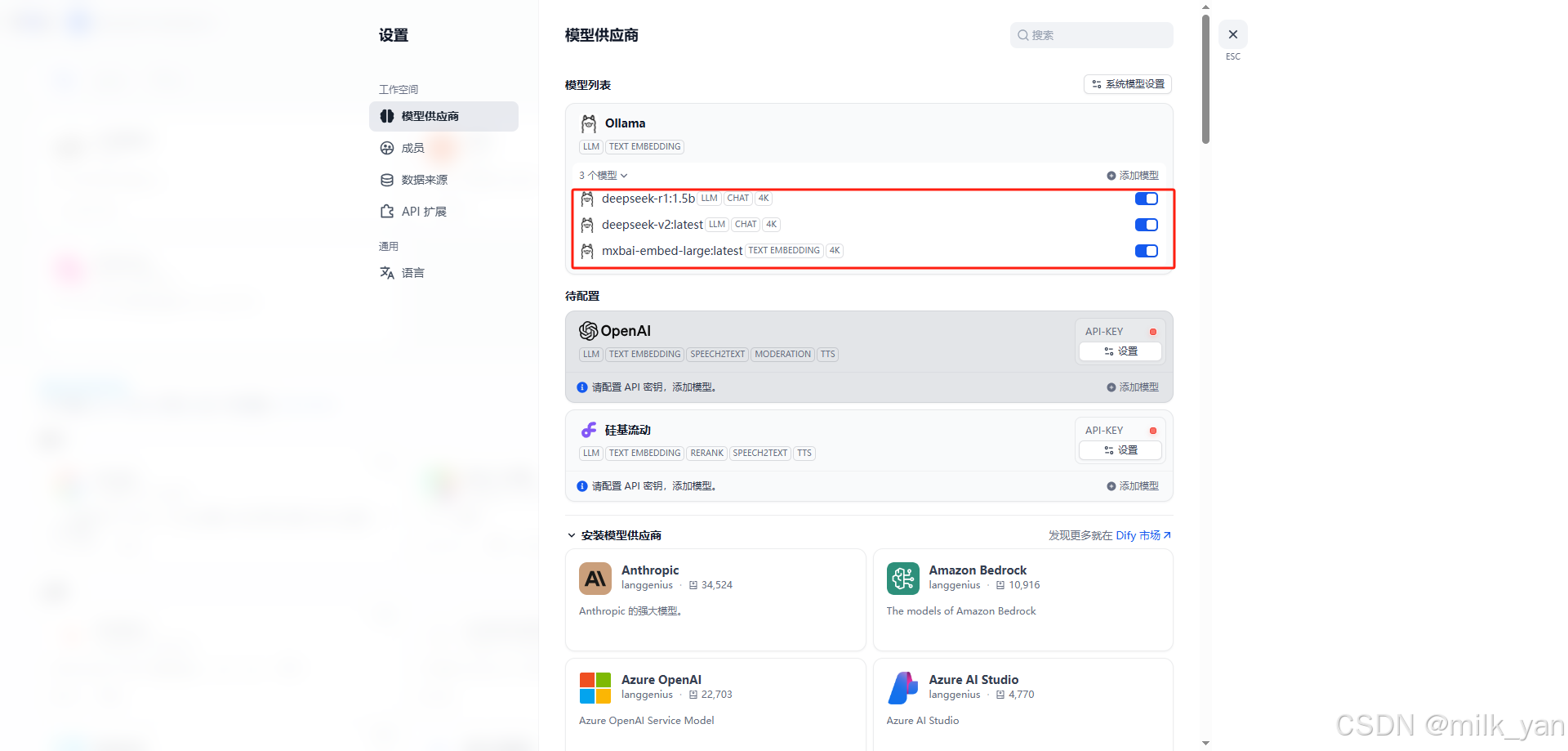

登录进dify地址后点击页面右上角头像的设置,在模型供应商中找到Ollama并点击安装。

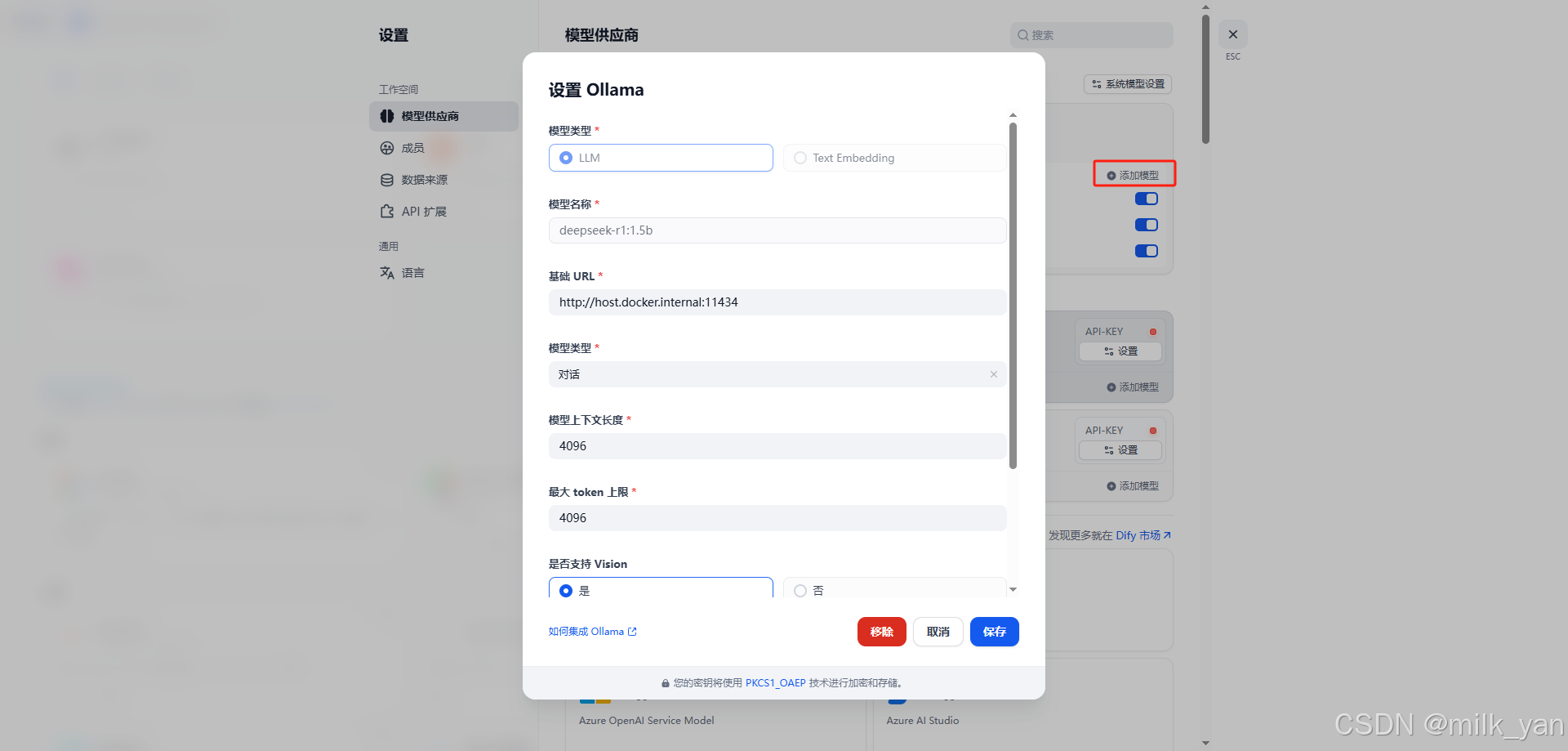

等待安装完成后进行模型配置,此处配置包括两部分,一个是LLM模型配置,所谓LLM即是大语言模型,此处可以是deepseek的模型也可以是chatgpt的模型或者是其他模型,其主要作用就是对话;另一个是Text Embedding模型,也叫文本嵌入模型,它是应用于知识库的模型,其主要功能是把知识库中的文本转换成向量,因为计算机无法直接理解自然语言,但是当把自然语言转换成向量之后,就可以通过数学的方式去进行理解和计算,例如你输入一个问题,从知识库中获得结果,本质就是把问题转换成向量并在知识库中检索和问题相似度最高的向量。此处可以用deepseek-r1模型进行配置,也可以使用其他专门的模型进行配置。

在模型名称中填写上一步下载的模型,如果不知道模型名称可以打开cmd,输入ollama list查看已经安装的模型。基础URL代表的是Ollama 服务地址,Ollama是默认暴露11434端口进行API调用,如果Dify是通过Docker部署的话,在基础URL中填入http://host.docker.internal:11434即可,如果是其他方式部署的Dify,可以参考帮助文档:https://docs.dify.ai/zh-hans/development/models-integration/ollama。剩余参数保持默认即可。最后点击保存

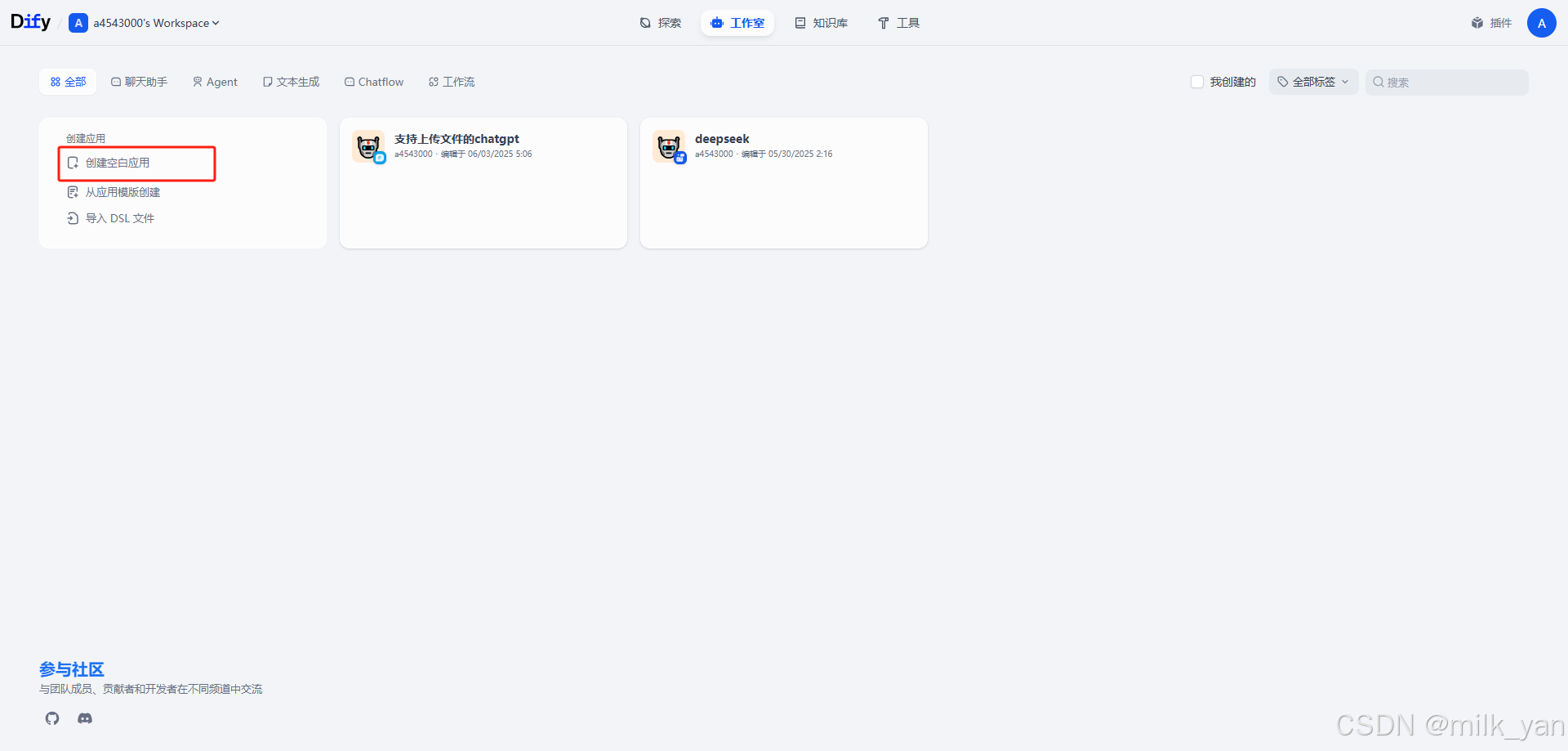

点击工作室创建空白应用

点击工作室创建空白应用

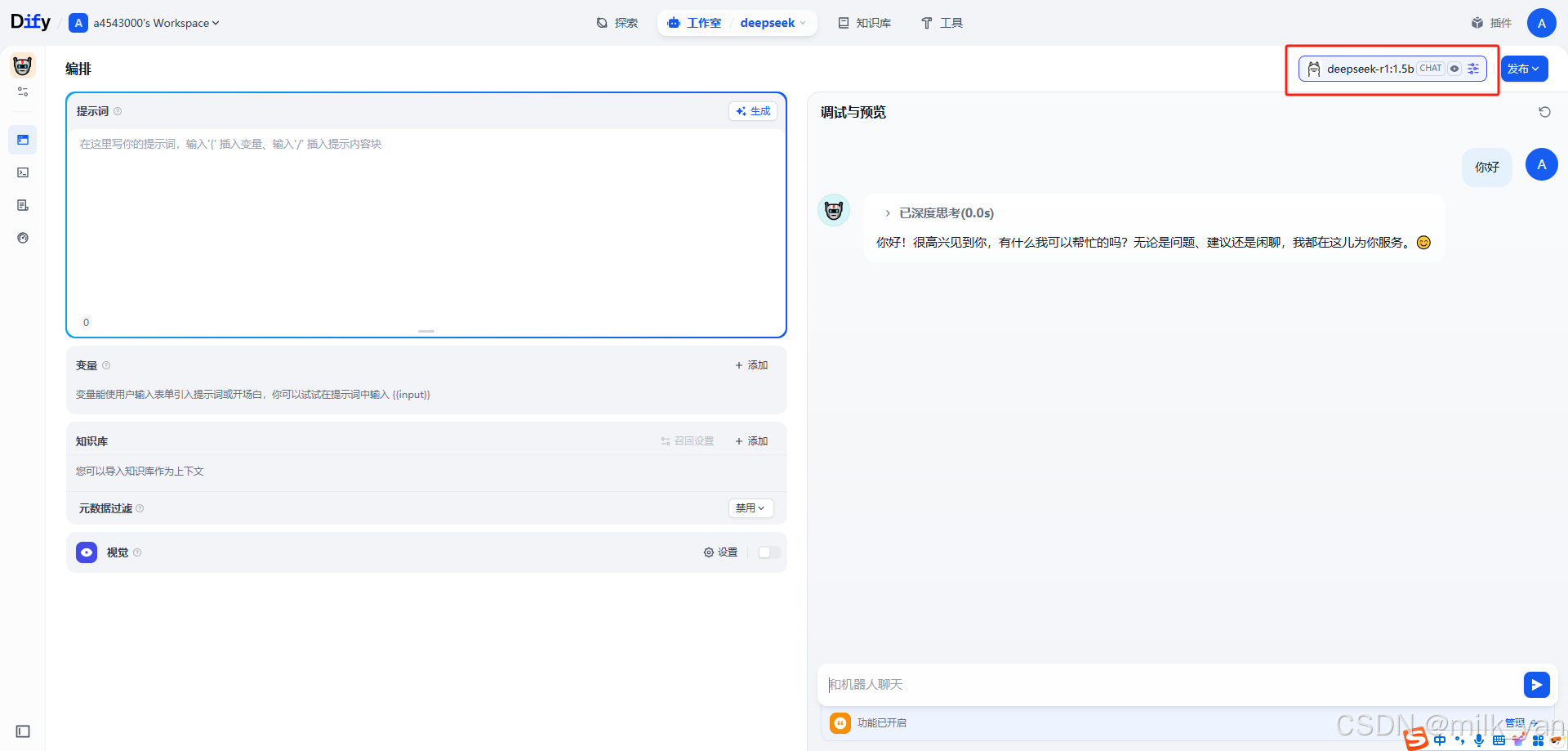

然后选择好自己的大模型,就可以对话啦

五、结语

通过Dify与DeepSeek的结合,我们实现了本地大模型的集成和智能体对话,后续会更新Dify和知识库的结合 。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)