学术速运|利用基于结构的编码器和预训练来增强蛋白质语言模型

Enhancing Protein Language Models with Structure-based Encoder and Pre-training

题目:Enhancing Protein Language Models with Structure-based Encoder and Pre-training

文献来源:https://doi.org/10.48550/arXiv.2303.06275 (Published at the MLDD workshop, ICLR 2023)

代码:https://github.com/DeepGraphLearning/GearNet

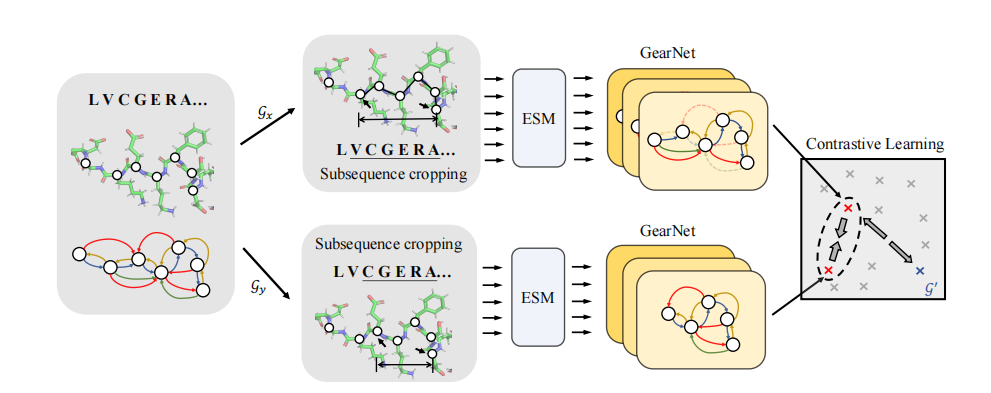

简介:在大规模蛋白质序列语料库上预先训练的蛋白质语言模型(PLMs)在各种下游蛋白质理解任务上取得了令人印象深刻的性能。尽管能够隐式地捕获残基间的接触信息,但基于转换器的PLMs不能明确地编码蛋白质结构,以获得更好的具有结构感知能力的蛋白质表征。此外,对现有蛋白质结构的预训练尚未探索出改善这些PLM的能力,尽管结构对确定功能很重要。为了解决这些限制,在这项工作中,作者使用基于结构的编码器和预训练来增强了PLM。首先探索可行的模型架构,以结合最先进的PLM(即ESM-1b1)和最先进的蛋白质结构编码器(即GearNet)的优点。作者通过实证验证了串联连接两个编码器的ESM-GearNet是最有效的组合模型。为了进一步提高ESM-GearNet的有效性,使用对比学习对大量未标记的蛋白质结构进行了预训练,它对共发生子序列的表示进行对齐,以捕获它们的生物学相关性。在EC和GO蛋白功能预测基准上的大量实验表明,ESM-GearNet优于之前的plm和结构编码器,通过ESM-GearNet基于结构的预训练进一步实现了明显的性能提高。

主要内容:

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)