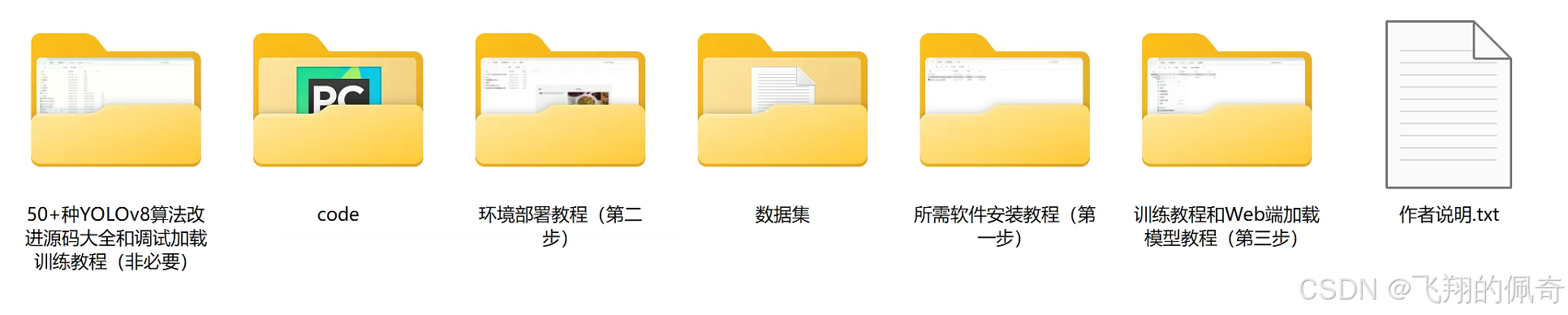

【完整源码+数据集+部署教程】 电子元件缺陷分割系统源码&数据集分享 [yolov8-seg-efficientViT&yolov8-seg-C2f-ODConv等50+全套改进创新点发刊_一键训练

【完整源码+数据集+部署教程】 电子元件缺陷分割系统源码&数据集分享[yolov8-seg-efficientViT&yolov8-seg-C2f-ODConv等50+全套改进创新点发刊_一键训练

背景意义

随着电子技术的迅猛发展,电子元件的广泛应用使得其生产和质量控制变得愈发重要。电子元件的缺陷不仅会影响产品的性能和可靠性,还可能导致严重的经济损失和安全隐患。因此,及时、准确地检测和分割电子元件中的缺陷,成为了电子制造行业亟待解决的关键问题。传统的缺陷检测方法多依赖人工目视检查和简单的图像处理技术,效率低下且容易受到人为因素的影响,难以满足现代生产的高效性和准确性要求。

近年来,深度学习技术的迅猛发展为缺陷检测提供了新的解决方案。尤其是基于卷积神经网络(CNN)的目标检测和分割模型,如YOLO(You Only Look Once)系列,因其高效的实时处理能力和优越的检测精度,逐渐成为工业视觉检测领域的研究热点。YOLOv8作为该系列的最新版本,结合了更先进的网络结构和训练策略,展现出更强的特征提取能力和更快的推理速度,适合用于复杂场景下的缺陷检测任务。

本研究旨在基于改进的YOLOv8模型,构建一个针对电子元件缺陷的分割系统。我们将利用一个包含3300张图像的数据集,该数据集涵盖了10个类别的电子元件缺陷,包括弯曲的腿、主体、硬币、集成电路(IC)、IC形状、腿、引脚、划痕、不可读和不需要的缺陷。这些类别的多样性使得模型能够在不同的缺陷类型上进行有效的学习和识别,从而提高系统的通用性和适应性。

在此背景下,改进YOLOv8模型的研究意义主要体现在以下几个方面:首先,通过深度学习技术的引入,能够大幅提高电子元件缺陷检测的自动化水平,减少人工干预,提高生产效率。其次,基于实例分割的技术,能够实现对缺陷的精确定位和分类,为后续的质量控制和缺陷分析提供可靠的数据支持。此外,改进的YOLOv8模型将通过优化网络结构和训练策略,提升检测精度,降低误检率,从而增强系统的实用性和可靠性。

最后,随着电子元件制造技术的不断进步,未来将面临更加复杂的缺陷检测挑战。本研究所构建的电子元件缺陷分割系统,不仅为当前的工业应用提供了有效的解决方案,也为后续相关研究提供了理论基础和实践经验。通过不断优化和迭代,该系统有望在更广泛的应用场景中发挥重要作用,推动电子制造行业的智能化发展。因此,本研究不仅具有重要的学术价值,也具有显著的实际应用意义。

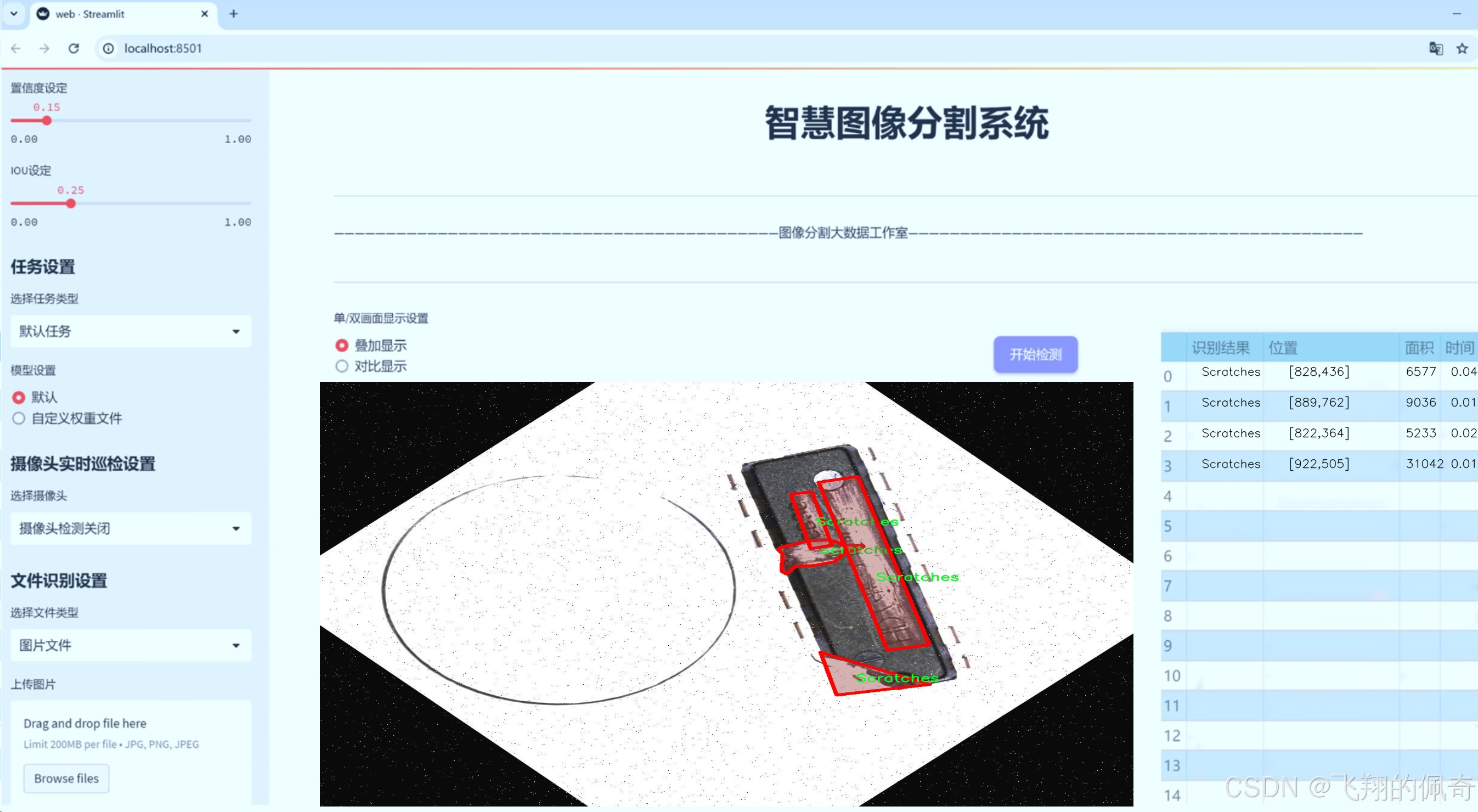

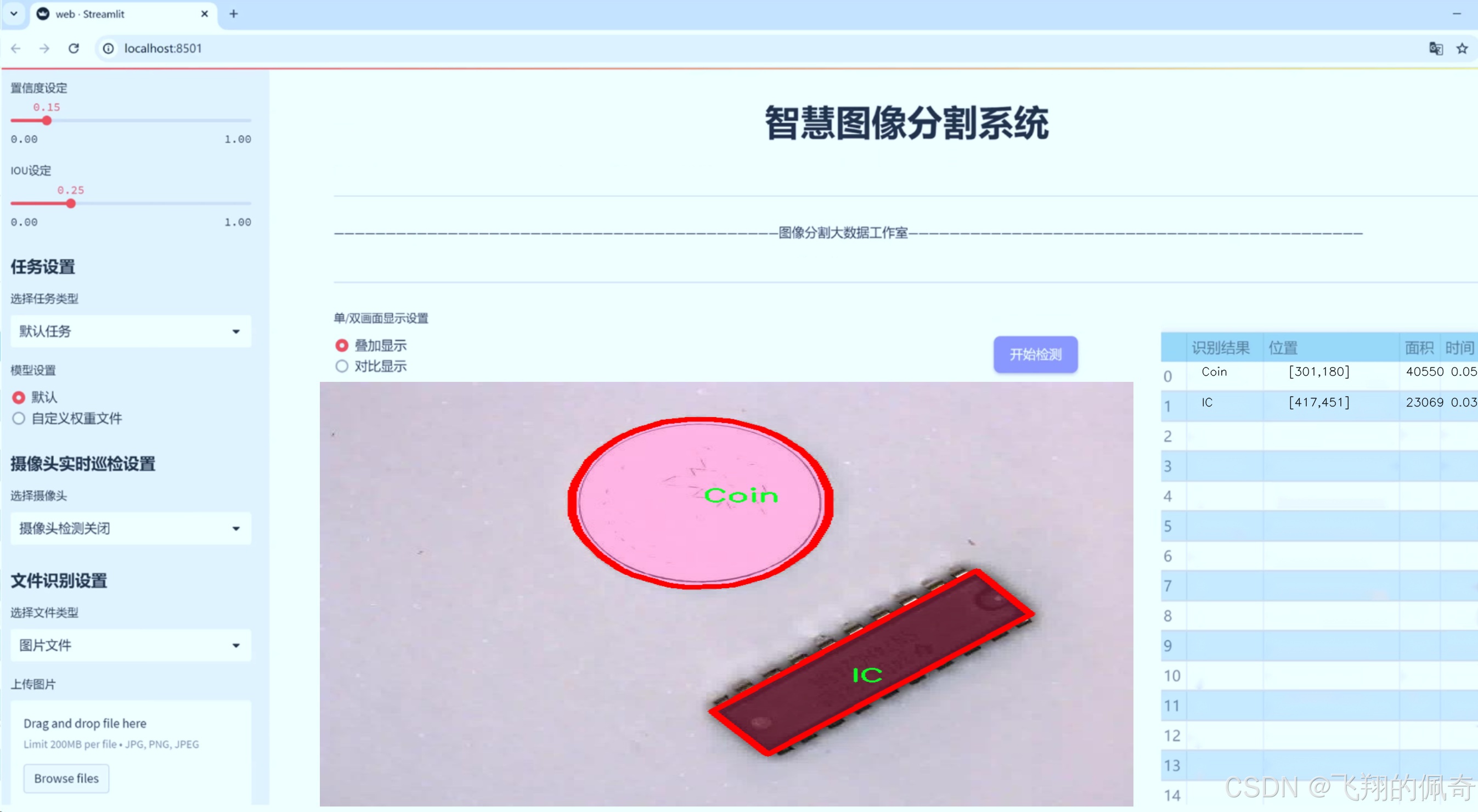

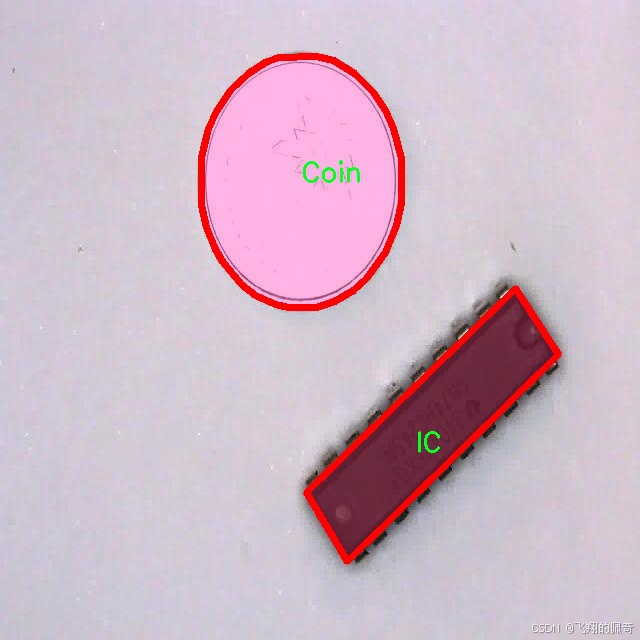

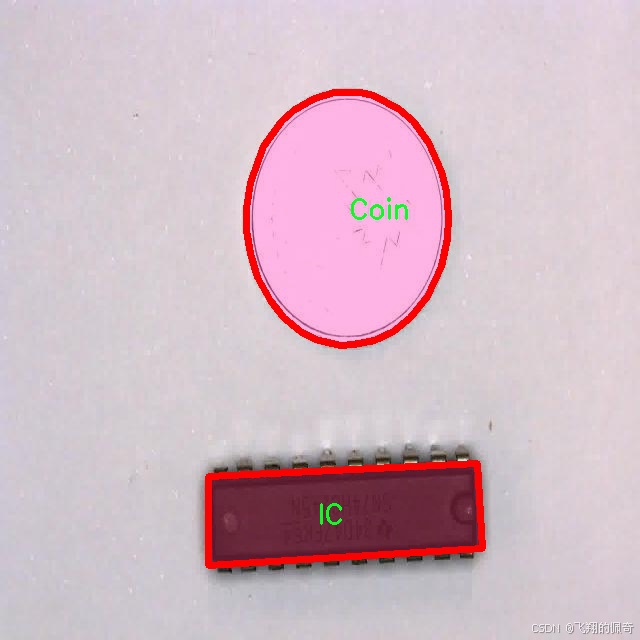

图片效果

数据集信息

在现代电子制造业中,电子元件的质量控制至关重要。为了提升缺陷检测的效率和准确性,我们构建了一个专门用于训练改进YOLOv8-seg的电子元件缺陷分割系统的数据集,命名为“peepeepoopoo”。该数据集旨在为研究人员和工程师提供一个丰富的基础,以便在深度学习框架下进行电子元件缺陷的自动检测与分割。数据集包含了10个类别,涵盖了电子元件在生产和使用过程中可能出现的各种缺陷,这些类别分别是:Bent_Legs(弯曲的腿)、Body(主体)、Coin(焊点)、IC(集成电路)、IC_Shape(集成电路形状)、Legs(腿部)、Pin(引脚)、Scratches(划痕)、Unreadable(不可读)、Unwanted(不需要的缺陷)。

在数据集的构建过程中,我们特别注重数据的多样性和代表性。每个类别的样本均来自于真实的生产环境,确保了数据集的实际应用价值。例如,Bent_Legs类别的样本展示了由于机械故障或操作不当导致的元件腿部弯曲现象,这种缺陷可能会影响元件的稳定性和性能。Body类别则涵盖了电子元件主体的各种外观问题,包括表面缺陷和结构损伤。Coin类别专注于焊点的质量,焊点的缺陷可能会导致电气连接不良,从而影响整个电路的功能。

在IC和IC_Shape类别中,我们收录了多种集成电路的样本,这些样本不仅包括正常的IC形状,还包括由于制造缺陷导致的形状异常。这些数据对于训练模型识别和分割IC的形状至关重要,能够帮助工程师快速定位问题。Legs和Pin类别则关注元件的腿部和引脚,这些部分在焊接过程中容易出现缺陷,影响元件的可靠性。

此外,Scratches类别的样本展示了元件表面划痕的情况,这些划痕可能会导致元件在使用过程中的性能下降。Unreadable类别则包括了因印刷不清晰或损坏而导致的不可读信息,这在电子元件的追溯和识别中是一个重要问题。最后,Unwanted类别则涵盖了那些不必要的缺陷,如多余的焊料或杂质,这些缺陷在生产过程中可能会被忽视,但对产品质量有着潜在的影响。

通过对“peepeepoopoo”数据集的深入分析和应用,我们期望能够训练出更为精准的YOLOv8-seg模型,从而在电子元件的缺陷检测和分割任务中取得显著的进展。该数据集不仅为学术研究提供了宝贵的资源,也为实际生产中的质量控制提供了强有力的支持。随着深度学习技术的不断发展,我们相信该数据集将成为电子元件缺陷检测领域的重要基石,推动行业的技术进步与创新。

核心代码

```python

# Ultralytics YOLO 🚀, AGPL-3.0 license

# 从当前包的 base 模块导入三个函数:add_integration_callbacks、default_callbacks 和 get_default_callbacks

from .base import add_integration_callbacks, default_callbacks, get_default_callbacks

# 定义当前模块的公开接口,指定可以被外部访问的名称

__all__ = 'add_integration_callbacks', 'default_callbacks', 'get_default_callbacks'

代码分析与注释

-

模块说明:

# Ultralytics YOLO 🚀, AGPL-3.0 license:这行注释说明了该代码属于 Ultralytics YOLO 项目,并且遵循 AGPL-3.0 许可证。

-

导入语句:

from .base import add_integration_callbacks, default_callbacks, get_default_callbacks:- 这一行代码从当前包的

base模块中导入了三个函数。 add_integration_callbacks:可能用于添加集成回调的功能。default_callbacks:可能是一些默认的回调函数或设置。get_default_callbacks:可能用于获取默认的回调函数。

- 这一行代码从当前包的

-

公开接口定义:

__all__ = 'add_integration_callbacks', 'default_callbacks', 'get_default_callbacks':- 这行代码定义了模块的公开接口,指定了在使用

from module import *时可以导入的名称。 - 通过定义

__all__,可以控制哪些对象可以被外部访问,增强模块的封装性。

- 这行代码定义了模块的公开接口,指定了在使用

核心部分总结

这段代码的核心在于导入了必要的回调函数,并通过 __all__ 定义了模块的公开接口,确保其他模块在使用时只访问到指定的功能。```

这个文件是Ultralytics YOLO项目中的一个初始化文件,位于ultralytics/utils/callbacks目录下。它的主要作用是导入和组织回调函数相关的功能。

首先,文件开头的注释部分表明了该项目的名称(Ultralytics YOLO)以及其使用的许可证类型(AGPL-3.0)。这说明该项目是开源的,并且遵循特定的开源协议。

接下来,文件通过from .base import ...语句从同一目录下的base模块中导入了三个函数:add_integration_callbacks、default_callbacks和get_default_callbacks。这些函数可能与回调机制有关,回调机制通常用于在特定事件发生时执行特定的代码,常见于训练过程中的监控和日志记录等功能。

最后,__all__变量定义了当使用from module import *语句时,哪些名称会被导入。这里定义的名称包括add_integration_callbacks、default_callbacks和get_default_callbacks,这意味着这三个函数是该模块的公共接口,用户可以直接使用它们。

总的来说,这个文件的主要功能是将回调相关的功能集中在一起,方便其他模块或用户进行调用和使用。

```python

import cv2

import numpy as np

class GMC:

"""

一般化运动补偿 (GMC) 类,用于视频帧中的跟踪和物体检测。

"""

def __init__(self, method='sparseOptFlow', downscale=2):

"""初始化视频跟踪器,指定跟踪方法和缩放因子。"""

self.method = method # 设置跟踪方法

self.downscale = max(1, int(downscale)) # 设置缩放因子,确保至少为1

# 根据选择的跟踪方法初始化检测器、提取器和匹配器

if self.method == 'orb':

self.detector = cv2.FastFeatureDetector_create(20)

self.extractor = cv2.ORB_create()

self.matcher = cv2.BFMatcher(cv2.NORM_HAMMING)

elif self.method == 'sift':

self.detector = cv2.SIFT_create(nOctaveLayers=3, contrastThreshold=0.02, edgeThreshold=20)

self.extractor = cv2.SIFT_create(nOctaveLayers=3, contrastThreshold=0.02, edgeThreshold=20)

self.matcher = cv2.BFMatcher(cv2.NORM_L2)

elif self.method == 'ecc':

self.warp_mode = cv2.MOTION_EUCLIDEAN # 设置变换模式

self.criteria = (cv2.TERM_CRITERIA_EPS | cv2.TERM_CRITERIA_COUNT, 5000, 1e-6) # 设置终止条件

elif self.method == 'sparseOptFlow':

self.feature_params = dict(maxCorners=1000, qualityLevel=0.01, minDistance=1, blockSize=3)

elif self.method in ['none', 'None', None]:

self.method = None

else:

raise ValueError(f'Error: Unknown GMC method:{method}') # 抛出未知方法错误

# 初始化变量

self.prevFrame = None # 存储前一帧

self.prevKeyPoints = None # 存储前一帧的关键点

self.prevDescriptors = None # 存储前一帧的描述符

self.initializedFirstFrame = False # 标记是否已处理第一帧

def apply(self, raw_frame, detections=None):

"""根据指定的方法对原始帧应用物体检测。"""

if self.method in ['orb', 'sift']:

return self.applyFeatures(raw_frame, detections) # 应用特征检测

elif self.method == 'ecc':

return self.applyEcc(raw_frame, detections) # 应用ECC算法

elif self.method == 'sparseOptFlow':

return self.applySparseOptFlow(raw_frame, detections) # 应用稀疏光流法

else:

return np.eye(2, 3) # 返回单位矩阵

def applyEcc(self, raw_frame, detections=None):

"""应用ECC算法进行运动补偿。"""

height, width, _ = raw_frame.shape # 获取帧的高度和宽度

frame = cv2.cvtColor(raw_frame, cv2.COLOR_BGR2GRAY) # 将帧转换为灰度图

H = np.eye(2, 3, dtype=np.float32) # 初始化变换矩阵

# 根据缩放因子对图像进行缩放

if self.downscale > 1.0:

frame = cv2.resize(frame, (width // self.downscale, height // self.downscale))

# 处理第一帧

if not self.initializedFirstFrame:

self.prevFrame = frame.copy() # 复制当前帧作为前一帧

self.initializedFirstFrame = True # 标记为已初始化

return H

# 运行ECC算法,结果存储在H中

try:

(cc, H) = cv2.findTransformECC(self.prevFrame, frame, H, self.warp_mode, self.criteria, None, 1)

except Exception as e:

LOGGER.warning(f'WARNING: find transform failed. Set warp as identity {e}') # 记录警告

return H

def applyFeatures(self, raw_frame, detections=None):

"""应用特征检测方法进行运动补偿。"""

height, width, _ = raw_frame.shape # 获取帧的高度和宽度

frame = cv2.cvtColor(raw_frame, cv2.COLOR_BGR2GRAY) # 将帧转换为灰度图

H = np.eye(2, 3) # 初始化变换矩阵

# 根据缩放因子对图像进行缩放

if self.downscale > 1.0:

frame = cv2.resize(frame, (width // self.downscale, height // self.downscale))

# 查找关键点

keypoints = self.detector.detect(frame, None) # 检测关键点

# 处理第一帧

if not self.initializedFirstFrame:

self.prevFrame = frame.copy() # 复制当前帧作为前一帧

self.prevKeyPoints = copy.copy(keypoints) # 复制关键点

self.prevDescriptors = None # 描述符暂时不使用

self.initializedFirstFrame = True # 标记为已初始化

return H

# 计算描述符

keypoints, descriptors = self.extractor.compute(frame, keypoints)

# 匹配描述符

knnMatches = self.matcher.knnMatch(self.prevDescriptors, descriptors, 2) # KNN匹配

# 过滤匹配

matches = []

for m, n in knnMatches:

if m.distance < 0.9 * n.distance: # 过滤掉较差的匹配

matches.append(m)

# 计算变换矩阵

if len(matches) > 4: # 至少需要5个匹配点

prevPoints = np.array([self.prevKeyPoints[m.queryIdx].pt for m in matches])

currPoints = np.array([keypoints[m.trainIdx].pt for m in matches])

H, _ = cv2.estimateAffinePartial2D(prevPoints, currPoints, cv2.RANSAC) # 估计变换矩阵

else:

LOGGER.warning('WARNING: not enough matching points') # 记录警告

# 更新前一帧和关键点

self.prevFrame = frame.copy()

self.prevKeyPoints = copy.copy(keypoints)

self.prevDescriptors = descriptors # 更新描述符

return H

def applySparseOptFlow(self, raw_frame, detections=None):

"""应用稀疏光流法进行运动补偿。"""

height, width, _ = raw_frame.shape # 获取帧的高度和宽度

frame = cv2.cvtColor(raw_frame, cv2.COLOR_BGR2GRAY) # 将帧转换为灰度图

H = np.eye(2, 3) # 初始化变换矩阵

# 根据缩放因子对图像进行缩放

if self.downscale > 1.0:

frame = cv2.resize(frame, (width // self.downscale, height // self.downscale))

# 查找关键点

keypoints = cv2.goodFeaturesToTrack(frame, mask=None, **self.feature_params) # 检测特征点

# 处理第一帧

if not self.initializedFirstFrame:

self.prevFrame = frame.copy() # 复制当前帧作为前一帧

self.prevKeyPoints = copy.copy(keypoints) # 复制关键点

self.initializedFirstFrame = True # 标记为已初始化

return H

# 计算光流

matchedKeypoints, status, err = cv2.calcOpticalFlowPyrLK(self.prevFrame, frame, self.prevKeyPoints, None)

# 仅保留有效的匹配点

prevPoints = []

currPoints = []

for i in range(len(status)):

if status[i]:

prevPoints.append(self.prevKeyPoints[i])

currPoints.append(matchedKeypoints[i])

prevPoints = np.array(prevPoints)

currPoints = np.array(currPoints)

# 计算变换矩阵

if len(prevPoints) > 4: # 至少需要5个匹配点

H, _ = cv2.estimateAffinePartial2D(prevPoints, currPoints, cv2.RANSAC) # 估计变换矩阵

else:

LOGGER.warning('WARNING: not enough matching points') # 记录警告

# 更新前一帧和关键点

self.prevFrame = frame.copy()

self.prevKeyPoints = copy.copy(keypoints)

return H

代码核心部分解释:

- 类的初始化 (

__init__):根据指定的跟踪方法初始化检测器、提取器和匹配器,同时设置缩放因子和一些状态变量。 - 应用方法 (

apply):根据选择的跟踪方法调用相应的处理函数。 - ECC算法 (

applyEcc):实现了基于ECC的运动补偿,处理第一帧并计算变换矩阵。 - 特征检测方法 (

applyFeatures):实现了基于特征的运动补偿,使用ORB或SIFT算法检测关键点,计算描述符并进行匹配。 - 稀疏光流法 (

applySparseOptFlow):实现了稀疏光流法进行运动补偿,检测特征点并计算光流。

以上是对代码核心部分的提炼和详细注释,帮助理解其功能和实现逻辑。```

这个程序文件定义了一个名为 GMC 的类,主要用于视频帧中的目标跟踪和检测。该类实现了多种跟踪算法,包括 ORB、SIFT、ECC 和稀疏光流(Sparse Optical Flow),并支持对帧进行下采样以提高计算效率。

在类的初始化方法 __init__ 中,用户可以指定跟踪方法和下采样因子。根据选择的跟踪方法,程序会初始化相应的特征检测器、描述符提取器和匹配器。例如,如果选择 ORB 方法,程序会创建一个 ORB 特征提取器和一个暴力匹配器;如果选择 SIFT 方法,则会创建 SIFT 特征提取器和相应的匹配器;而对于 ECC 方法,程序会设置一些迭代参数和终止条件。

类中定义了多个方法来处理视频帧。apply 方法根据指定的跟踪方法调用相应的处理函数。applyEcc 方法实现了 ECC 算法,首先将当前帧转换为灰度图像,并根据下采样因子进行处理。对于第一帧,程序会初始化数据;对于后续帧,程序会使用 cv2.findTransformECC 函数计算图像之间的变换矩阵。

applyFeatures 方法则实现了基于特征的方法,如 ORB 或 SIFT。它首先检测当前帧中的关键点,并计算描述符。然后,程序会通过匹配描述符来找到对应的关键点,并使用 RANSAC 算法估计刚性变换矩阵。该方法还会处理第一帧的初始化。

applySparseOptFlow 方法实现了稀疏光流算法。它使用 cv2.goodFeaturesToTrack 函数检测关键点,并通过 cv2.calcOpticalFlowPyrLK 计算关键点的光流。最后,程序同样会估计刚性变换矩阵。

整个类的设计旨在为视频处理提供灵活的跟踪和检测功能,用户可以根据需求选择不同的算法和参数。通过这种方式,GMC 类能够在处理视频帧时提供高效的运动补偿和目标跟踪能力。

```python

import sys

import subprocess

def run_script(script_path):

"""

使用当前 Python 环境运行指定的脚本。

Args:

script_path (str): 要运行的脚本路径

Returns:

None

"""

# 获取当前 Python 解释器的路径

python_path = sys.executable

# 构建运行命令,使用 streamlit 运行指定的脚本

command = f'"{python_path}" -m streamlit run "{script_path}"'

# 执行命令

result = subprocess.run(command, shell=True)

# 检查命令执行的返回码,如果不为0则表示出错

if result.returncode != 0:

print("脚本运行出错。")

# 实例化并运行应用

if __name__ == "__main__":

# 指定要运行的脚本路径

script_path = "web.py" # 这里可以直接指定脚本路径

# 调用函数运行脚本

run_script(script_path)

代码注释说明:

-

导入模块:

sys:用于访问与 Python 解释器相关的变量和函数。subprocess:用于执行外部命令。

-

run_script函数:- 功能:接受一个脚本路径,使用当前 Python 环境运行该脚本。

- 参数:

script_path是要运行的脚本的路径。 - 过程:

- 使用

sys.executable获取当前 Python 解释器的路径。 - 构建一个命令字符串,使用

streamlit模块运行指定的脚本。 - 使用

subprocess.run执行构建的命令,并通过shell=True允许在 shell 中执行。 - 检查命令的返回码,如果返回码不为0,表示脚本运行出错,打印错误信息。

- 使用

-

主程序部分:

- 使用

if __name__ == "__main__":确保只有在直接运行该脚本时才会执行以下代码。 - 指定要运行的脚本路径(这里直接写为

"web.py")。 - 调用

run_script函数,传入脚本路径以执行该脚本。```

这个程序文件名为ui.py,主要功能是通过当前的 Python 环境来运行一个指定的脚本。代码中首先导入了必要的模块,包括sys、os和subprocess,以及一个自定义的路径处理模块abs_path。

- 使用

在 run_script 函数中,程序接受一个参数 script_path,这是要运行的脚本的路径。函数首先获取当前 Python 解释器的路径,这通过 sys.executable 实现。接着,程序构建一个命令字符串,使用 streamlit 来运行指定的脚本。这个命令的格式是 "{python_path}" -m streamlit run "{script_path}",其中 python_path 是当前 Python 解释器的路径,script_path 是传入的脚本路径。

然后,程序使用 subprocess.run 来执行这个命令,shell=True 表示在一个新的 shell 中运行命令。执行后,程序检查返回码,如果返回码不为零,表示脚本运行出错,程序会打印出相应的错误信息。

在文件的最后部分,使用 if __name__ == "__main__": 来确保只有在直接运行该文件时才会执行下面的代码。这里指定了要运行的脚本路径为 web.py,并调用 run_script 函数来执行这个脚本。

总体来说,这个程序的目的是提供一个简单的接口,通过当前的 Python 环境来运行一个 Streamlit 应用脚本,方便用户进行应用的启动和调试。

```python

import os

import torch

import yaml

from ultralytics import YOLO # 导入YOLO模型库

if __name__ == '__main__': # 确保该模块被直接运行时才执行以下代码

# 设置训练参数

workers = 1 # 数据加载的工作进程数

batch = 8 # 每个批次的样本数量

device = "0" if torch.cuda.is_available() else "cpu" # 判断是否使用GPU

# 获取数据集配置文件的绝对路径

data_path = abs_path(f'datasets/data/data.yaml', path_type='current')

# 将路径格式转换为Unix风格

unix_style_path = data_path.replace(os.sep, '/')

# 获取目录路径

directory_path = os.path.dirname(unix_style_path)

# 读取YAML文件,保持原有顺序

with open(data_path, 'r') as file:

data = yaml.load(file, Loader=yaml.FullLoader)

# 修改YAML文件中的路径项

if 'train' in data and 'val' in data and 'test' in data:

data['train'] = directory_path + '/train' # 设置训练集路径

data['val'] = directory_path + '/val' # 设置验证集路径

data['test'] = directory_path + '/test' # 设置测试集路径

# 将修改后的数据写回YAML文件

with open(data_path, 'w') as file:

yaml.safe_dump(data, file, sort_keys=False)

# 加载YOLO模型配置和预训练权重

model = YOLO(r"C:\codeseg\codenew\50+种YOLOv8算法改进源码大全和调试加载训练教程(非必要)\改进YOLOv8模型配置文件\yolov8-seg-C2f-Faster.yaml").load("./weights/yolov8s-seg.pt")

# 开始训练模型

results = model.train(

data=data_path, # 指定训练数据的配置文件路径

device=device, # 使用的设备(GPU或CPU)

workers=workers, # 数据加载的工作进程数

imgsz=640, # 输入图像的大小为640x640

epochs=100, # 训练100个epoch

batch=batch, # 每个批次的大小为8

)

代码注释说明:

- 导入必要的库:导入了操作系统、PyTorch、YAML处理库和YOLO模型库。

- 主程序入口:使用

if __name__ == '__main__':确保只有在直接运行该脚本时才执行后续代码。 - 设置训练参数:定义了数据加载的工作进程数、批次大小和设备(GPU或CPU)。

- 获取数据集配置文件路径:使用

abs_path函数获取数据集配置文件的绝对路径,并将其转换为Unix风格路径。 - 读取和修改YAML文件:读取YAML文件,修改其中的训练、验证和测试集路径,并将修改后的内容写回文件。

- 加载YOLO模型:根据指定的配置文件和预训练权重加载YOLO模型。

- 开始训练模型:调用

model.train方法开始训练,传入必要的参数如数据路径、设备、工作进程数、图像大小和训练轮数。```

该程序文件train.py是一个用于训练 YOLO(You Only Look Once)模型的脚本,主要依赖于 PyTorch 和 Ultralytics 提供的 YOLO 实现。程序的主要功能是加载数据集、配置模型并开始训练。

首先,程序导入了必要的库,包括 os、torch、yaml 和 matplotlib,其中 matplotlib 被设置为使用 TkAgg 后端以支持图形界面显示。接着,程序通过 if __name__ == '__main__': 确保以下代码仅在直接运行该脚本时执行。

在程序中,设置了一些训练参数,如 workers(数据加载的工作进程数)、batch(每个批次的样本数,默认为8)以及 device(用于训练的设备,优先选择 GPU,如果不可用则使用 CPU)。接下来,程序通过 abs_path 函数获取数据集配置文件 data.yaml 的绝对路径,并将路径中的分隔符统一为 Unix 风格的斜杠。

程序读取 YAML 文件以获取数据集的配置信息,并检查是否包含训练、验证和测试数据的路径。如果存在这些路径,程序将其修改为基于当前目录的绝对路径,并将更新后的数据写回到 YAML 文件中。这一步是为了确保模型能够正确找到数据集。

随后,程序加载 YOLO 模型的配置文件和预训练权重。这里的模型配置文件是 yolov8-seg-C2f-Faster.yaml,并加载了相应的权重文件 yolov8s-seg.pt。需要注意的是,不同的模型对设备的要求可能不同,如果遇到显存不足的错误,可以尝试更换其他模型配置文件。

最后,程序调用 model.train() 方法开始训练模型,传入了训练数据的配置文件路径、设备、工作进程数、输入图像大小(640x640)、训练的 epoch 数(100)以及批次大小(8)。训练过程将在控制台输出进度和结果。

整体来看,该程序是一个完整的训练流程,从数据集的配置到模型的加载与训练,适合于需要使用 YOLO 进行目标检测或分割任务的用户。

```python

import torch

import torch.nn as nn

from torch.nn.modules.utils import _pair as to_2tuple

from functools import partial

class Mlp(nn.Module):

""" 多层感知机模块 """

def __init__(self, in_features, hidden_features=None, out_features=None, act_layer=nn.GELU, drop=0.):

super().__init__()

out_features = out_features or in_features # 输出特征数

hidden_features = hidden_features or in_features # 隐藏层特征数

self.fc1 = nn.Conv2d(in_features, hidden_features, 1) # 第一个卷积层

self.dwconv = DWConv(hidden_features) # 深度卷积层

self.act = act_layer() # 激活函数

self.fc2 = nn.Conv2d(hidden_features, out_features, 1) # 第二个卷积层

self.drop = nn.Dropout(drop) # Dropout层

def forward(self, x):

""" 前向传播 """

x = self.fc1(x)

x = self.dwconv(x)

x = self.act(x)

x = self.drop(x)

x = self.fc2(x)

x = self.drop(x)

return x

class Attention(nn.Module):

""" 注意力模块 """

def __init__(self, d_model):

super().__init__()

self.proj_1 = nn.Conv2d(d_model, d_model, 1) # 线性投影

self.activation = nn.GELU() # 激活函数

self.spatial_gating_unit = LSKblock(d_model) # 空间门控单元

self.proj_2 = nn.Conv2d(d_model, d_model, 1) # 线性投影

def forward(self, x):

""" 前向传播 """

shortcut = x.clone() # 残差连接

x = self.proj_1(x)

x = self.activation(x)

x = self.spatial_gating_unit(x)

x = self.proj_2(x)

x = x + shortcut # 残差连接

return x

class Block(nn.Module):

""" 基本块,包括注意力和MLP """

def __init__(self, dim, mlp_ratio=4., drop=0., drop_path=0., act_layer=nn.GELU):

super().__init__()

self.norm1 = nn.BatchNorm2d(dim) # 归一化层

self.norm2 = nn.BatchNorm2d(dim) # 归一化层

self.attn = Attention(dim) # 注意力模块

self.mlp = Mlp(in_features=dim, hidden_features=int(dim * mlp_ratio), act_layer=act_layer, drop=drop) # MLP模块

def forward(self, x):

""" 前向传播 """

x = x + self.attn(self.norm1(x)) # 注意力模块

x = x + self.mlp(self.norm2(x)) # MLP模块

return x

class LSKNet(nn.Module):

""" LSKNet网络结构 """

def __init__(self, img_size=224, in_chans=3, embed_dims=[64, 128, 256, 512], depths=[3, 4, 6, 3]):

super().__init__()

self.num_stages = len(depths) # 网络阶段数

for i in range(self.num_stages):

# 创建图像嵌入层

patch_embed = OverlapPatchEmbed(img_size=img_size // (2 ** i), in_chans=in_chans if i == 0 else embed_dims[i - 1], embed_dim=embed_dims[i])

# 创建块

block = nn.ModuleList([Block(dim=embed_dims[i]) for _ in range(depths[i])])

setattr(self, f"patch_embed{i + 1}", patch_embed)

setattr(self, f"block{i + 1}", block)

def forward(self, x):

""" 前向传播 """

outs = []

for i in range(self.num_stages):

patch_embed = getattr(self, f"patch_embed{i + 1}")

block = getattr(self, f"block{i + 1}")

x, _, _ = patch_embed(x) # 嵌入层

for blk in block:

x = blk(x) # 块的前向传播

outs.append(x) # 保存输出

return outs

class DWConv(nn.Module):

""" 深度卷积模块 """

def __init__(self, dim=768):

super(DWConv, self).__init__()

self.dwconv = nn.Conv2d(dim, dim, 3, 1, 1, bias=True, groups=dim) # 深度卷积

def forward(self, x):

""" 前向传播 """

return self.dwconv(x)

def lsknet_t(weights=''):

""" 创建LSKNet_t模型 """

model = LSKNet(embed_dims=[32, 64, 160, 256], depths=[3, 3, 5, 2])

if weights:

model.load_state_dict(torch.load(weights)['state_dict']) # 加载权重

return model

if __name__ == '__main__':

model = lsknet_t('lsk_t_backbone-2ef8a593.pth') # 实例化模型

inputs = torch.randn((1, 3, 640, 640)) # 随机输入

for i in model(inputs):

print(i.size()) # 输出每个阶段的输出尺寸

代码说明:

- Mlp:实现了一个多层感知机模块,包含两个卷积层和一个深度卷积层,使用GELU激活函数和Dropout。

- Attention:实现了一个注意力机制模块,包含两个线性投影和一个空间门控单元。

- Block:组合了注意力模块和MLP模块,形成一个基本的网络块。

- LSKNet:构建了整个网络结构,包含多个阶段,每个阶段由图像嵌入层和多个块组成。

- DWConv:实现了深度卷积操作,用于特征提取。

- lsknet_t:提供了一个函数用于创建LSKNet_t模型,并可选择加载预训练权重。```

这个程序文件定义了一个名为lsknet.py的深度学习模型,主要用于图像处理任务。该模型是基于 PyTorch 框架构建的,包含多个类和函数,具体功能如下:

首先,文件导入了必要的库,包括 PyTorch 的核心模块和一些辅助功能模块。接着,定义了一个名为 Mlp 的类,这个类实现了一个多层感知机(MLP),包含两个卷积层和一个深度卷积层,使用 GELU 激活函数和 dropout 技术来防止过拟合。

接下来,定义了 LSKblock 类,这是模型的一个基本构建块。它使用了多个卷积层,包括深度卷积和空间卷积,来提取特征并进行注意力机制的计算。该块的前向传播方法中,通过对输入进行卷积操作和注意力计算,生成一个加权的输出。

然后,定义了 Attention 类,负责实现注意力机制。它包含两个卷积层和一个空间门控单元(即 LSKblock),通过对输入进行投影、激活和注意力计算,生成增强的特征表示。

Block 类则是模型的另一个基本构建块,结合了归一化、注意力机制和 MLP。它通过残差连接和层级缩放参数来增强模型的学习能力。

OverlapPatchEmbed 类用于将输入图像转换为补丁嵌入。它通过卷积操作将图像划分为小块,并进行归一化处理,以便后续的特征提取。

LSKNet 类是整个模型的核心,负责构建整个网络结构。它根据指定的参数(如嵌入维度、深度、丢弃率等)创建多个阶段的嵌入层、块和归一化层,并在前向传播中依次处理输入数据,生成多层次的特征输出。

此外,文件中还定义了 DWConv 类,表示深度卷积操作,和 update_weight 函数,用于更新模型权重。最后,提供了两个函数 lsknet_t 和 lsknet_s,用于创建不同配置的 LSKNet 模型,并可以加载预训练权重。

在文件的最后部分,提供了一个示例代码,展示如何实例化模型并对随机输入进行前向传播,输出每一层的特征图大小。这为使用该模型进行实际任务提供了基础。

```python

import torch

import torch.nn as nn

import torch.nn.functional as F

class DFL(nn.Module):

"""

分布焦点损失(DFL)的核心模块。

该模块用于实现分布焦点损失,参考文献:Generalized Focal Loss

"""

def __init__(self, c1=16):

"""初始化卷积层,输入通道数为c1。"""

super().__init__()

# 创建一个1x1的卷积层,输出通道为1,不使用偏置

self.conv = nn.Conv2d(c1, 1, 1, bias=False).requires_grad_(False)

# 初始化卷积层的权重为[0, 1, ..., c1-1]

x = torch.arange(c1, dtype=torch.float)

self.conv.weight.data[:] = nn.Parameter(x.view(1, c1, 1, 1))

self.c1 = c1 # 保存输入通道数

def forward(self, x):

"""对输入张量x应用DFL模块,并返回处理后的张量。"""

b, c, a = x.shape # 获取输入的批量大小、通道数和锚点数

# 对输入进行变形并应用卷积层,最后返回形状为[b, 4, a]的张量

return self.conv(x.view(b, 4, self.c1, a).transpose(2, 1).softmax(1)).view(b, 4, a)

class Proto(nn.Module):

"""YOLOv8掩码原型模块,用于分割模型。"""

def __init__(self, c1, c_=256, c2=32):

"""

初始化YOLOv8掩码原型模块,指定原型和掩码的数量。

输入参数为输入通道数c1,原型数量c_,掩码数量c2。

"""

super().__init__()

self.cv1 = Conv(c1, c_, k=3) # 第一个卷积层

self.upsample = nn.ConvTranspose2d(c_, c_, 2, 2, 0, bias=True) # 上采样层

self.cv2 = Conv(c_, c_, k=3) # 第二个卷积层

self.cv3 = Conv(c_, c2) # 第三个卷积层

def forward(self, x):

"""通过上采样和卷积层执行前向传播。"""

return self.cv3(self.cv2(self.upsample(self.cv1(x))))

class HGStem(nn.Module):

"""

PPHGNetV2的StemBlock,包含5个卷积层和一个最大池化层。

"""

def __init__(self, c1, cm, c2):

"""初始化StemBlock,指定输入输出通道数和最大池化的核大小。"""

super().__init__()

self.stem1 = Conv(c1, cm, 3, 2) # 第一个卷积层

self.stem2a = Conv(cm, cm // 2, 2, 1, 0) # 第二个卷积层

self.stem2b = Conv(cm // 2, cm, 2, 1, 0) # 第三个卷积层

self.stem3 = Conv(cm * 2, cm, 3, 2) # 第四个卷积层

self.stem4 = Conv(cm, c2, 1, 1) # 第五个卷积层

self.pool = nn.MaxPool2d(kernel_size=2, stride=1, padding=0, ceil_mode=True) # 最大池化层

def forward(self, x):

"""PPHGNetV2骨干层的前向传播。"""

x = self.stem1(x) # 通过第一个卷积层

x = F.pad(x, [0, 1, 0, 1]) # 对输出进行填充

x2 = self.stem2a(x) # 通过第二个卷积层

x2 = F.pad(x2, [0, 1, 0, 1]) # 对输出进行填充

x2 = self.stem2b(x2) # 通过第三个卷积层

x1 = self.pool(x) # 通过最大池化层

x = torch.cat([x1, x2], dim=1) # 将两个输出在通道维度上拼接

x = self.stem3(x) # 通过第四个卷积层

x = self.stem4(x) # 通过第五个卷积层

return x # 返回最终输出

class Bottleneck(nn.Module):

"""标准瓶颈模块。"""

def __init__(self, c1, c2, shortcut=True, g=1, k=(3, 3), e=0.5):

"""初始化瓶颈模块,指定输入输出通道、shortcut选项、组数、卷积核和扩展因子。"""

super().__init__()

c_ = int(c2 * e) # 隐藏通道数

self.cv1 = Conv(c1, c_, k[0], 1) # 第一个卷积层

self.cv2 = Conv(c_, c2, k[1], 1, g=g) # 第二个卷积层

self.add = shortcut and c1 == c2 # 是否使用shortcut连接

def forward(self, x):

"""前向传播,应用YOLO FPN到输入数据。"""

return x + self.cv2(self.cv1(x)) if self.add else self.cv2(self.cv1(x)) # 返回经过卷积处理的输出

以上代码包含了YOLO模型中一些核心模块的实现,包括分布焦点损失(DFL)、掩码原型(Proto)、StemBlock(HGStem)和标准瓶颈(Bottleneck)。每个模块都包含了初始化和前向传播的实现,并附有详细的中文注释以便理解其功能和作用。```

这个程序文件是一个实现了多个深度学习模块的Python文件,主要用于构建YOLO(You Only Look Once)系列模型,特别是YOLOv8。文件中包含了多种神经网络层的定义,这些层通常用于图像处理和目标检测任务。

首先,文件导入了PyTorch库,使用了torch和torch.nn模块,这些是构建和训练神经网络的基础工具。文件中定义了一些常用的卷积层和变换层,包括标准卷积、深度卷积、Ghost卷积等。

文件中定义的类包括:

-

DFL:这是一个实现了分布焦点损失(Distribution Focal Loss)的模块。它通过卷积层处理输入数据,并将其转换为焦点损失的输出。

-

Proto:这个模块用于YOLOv8的掩膜原型,主要用于分割模型。它通过一系列卷积层和上采样层来处理输入。

-

HGStem:这是PPHGNetV2的StemBlock,包含多个卷积层和一个最大池化层,用于提取特征。

-

HGBlock:这个模块实现了PPHGNetV2的HG_Block,包含多个卷积层和可选的轻量卷积(LightConv),用于特征提取。

-

SPP和SPPF:这两个模块实现了空间金字塔池化(Spatial Pyramid Pooling),用于处理不同尺度的特征图,以增强模型的鲁棒性。

-

C1、C2、C2f、C3、C3x、RepC3、C3TR、C3Ghost:这些类实现了不同类型的CSP(Cross Stage Partial)瓶颈结构,主要用于特征提取和网络的深度学习。它们通过不同的卷积组合和跳跃连接来提高网络的表现。

-

GhostBottleneck:实现了Ghost瓶颈结构,旨在减少模型的计算量和参数数量,同时保持较好的性能。

-

Bottleneck和BottleneckCSP:这些是标准的瓶颈模块,通常用于构建深层网络,通过减少参数数量和计算量来提高效率。

每个模块都有其特定的初始化方法和前向传播方法,前向传播方法定义了如何通过网络层处理输入数据并生成输出。通过组合这些模块,可以构建出复杂的神经网络架构,适用于各种计算机视觉任务,如目标检测和图像分割。

整体而言,这个文件是YOLOv8模型实现的重要组成部分,提供了多种可重用的网络层,旨在提高模型的性能和效率。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献145条内容

已为社区贡献145条内容

所有评论(0)