ollama 容器部署映射端口号修改

本文介绍了Ollama服务的端口查看与修改方法。默认情况下,Ollama监听11434端口,可通过netstat或ss命令确认。修改端口需编辑/etc/systemd/system/ollama.service文件,在[Service]部分添加OLLAMA_HOST环境变量(如0.0.0.0:11435)。修改后需重启服务并验证新端口是否生效。

目录

前言

我们有两种部署ollama的方法,一种是直接通过curl命令安装在宿主机上面,一种是通过镜像部署。对于使用curl命令安装的方法,在Linux系统上安装Ollama后,其服务的默认端口是 11434。通常为了解决端口冲突或允许从其他设备访问,需要查看和修改这个端口。

一、如何查看当前端口

安装后,Ollama服务默认会监听本机地址(127.0.0.1)的11434端口。你可以使用以下命令来确认它是否正在运行及监听端口:

| 方法 | 命令 | 说明 |

|---|---|---|

| 查看监听端口 | sudo netstat -tulpn | grep :11434 |

查看11434端口是否被Ollama进程监听。 |

| 或 | sudo ss -tulpn | grep :11434 |

使用更现代的 ss 命令,效果类似。 |

| 查看服务状态 | sudo systemctl status ollama |

直接检查Ollama服务的运行状态。 |

二、如何修改对外映射的端口

修改端口需要编辑Ollama的服务配置文件。主要步骤和核心配置如下:

1. 编辑服务配置文件

使用你熟悉的文本编辑器(如 sudo vi 或 sudo nano)打开配置文件:

sudo vi /etc/systemd/system/ollama.service2. 修改环境变量

在 [Service] 部分,找到或添加 Environment="OLLAMA_HOST=..." 这一行。

- 如果你想允许局域网内其他设备访问,可以将监听地址设置为

0.0.0.0,并指定一个新端口(例如11435):

Environment="OLLAMA_HOST=0.0.0.0:11435"- 如果仅需改变端口但依旧只允许本机访问,可以设置:

Environment="OLLAMA_HOST=127.0.0.1:11435"3. 完整配置文件参考

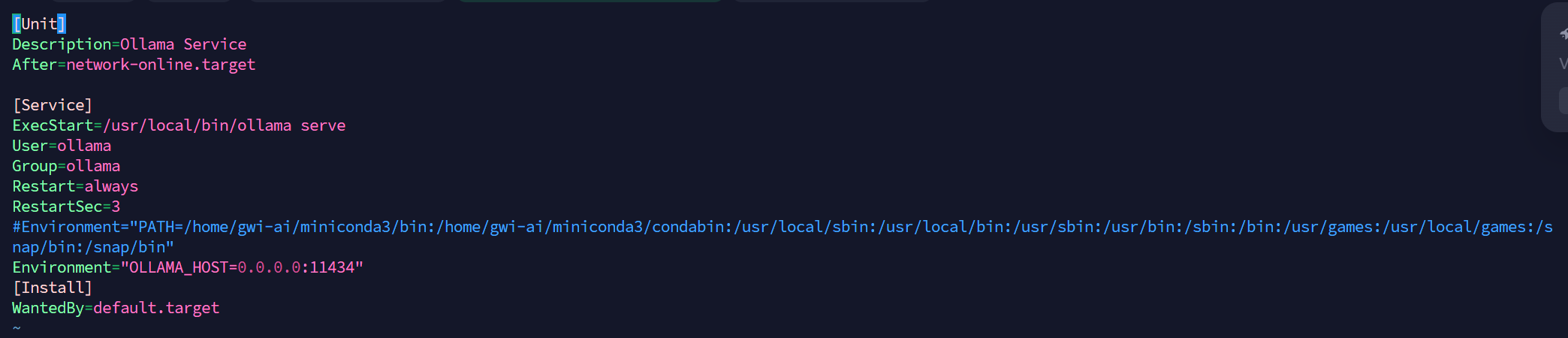

文件1:

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/local/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

#Environment="PATH=/home/gwi-ai/miniconda3/bin:/home/gwi-ai/miniconda3/condabin:/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin:/snap/bin"

Environment="OLLAMA_HOST=0.0.0.0:11434"

[Install]

WantedBy=default.target

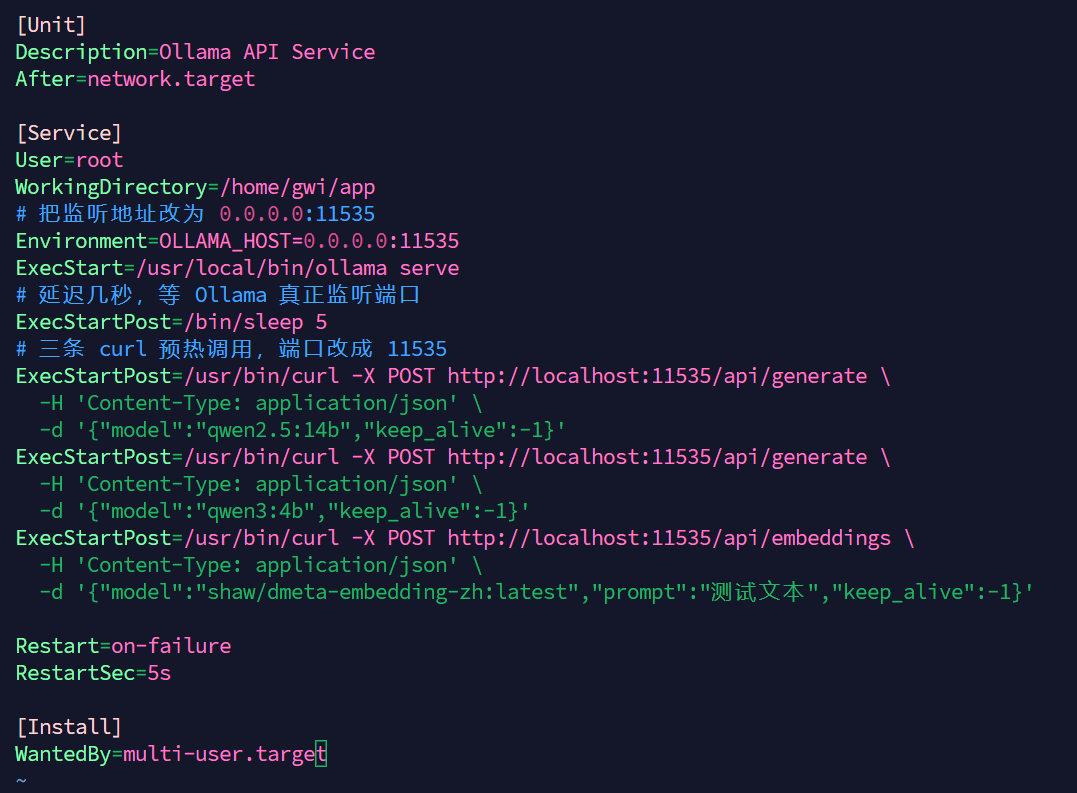

文件2:

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/local/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

#Environment="PATH=/home/gwi-ai/miniconda3/bin:/home/gwi-ai/miniconda3/condabin:/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin:/snap/bin"

Environment="OLLAMA_HOST=0.0.0.0:11434"

[Install]

WantedBy=default.target

4. 保存并重启服务

保存对文件的修改后,依次执行以下命令使配置生效:

sudo systemctl daemon-reload

sudo systemctl restart ollama5. 验证修改

再次使用 sudo netstat -tulpn \| grep :新端口号(如11435)命令,检查Ollama是否已开始监听你设置的新端口。

⚠️ 修改端口后的重要注意事项

修改端口后,常规的 ollama run、ollama list 等命令会失效,因为它们默认仍尝试连接旧端口。你有以下两种方式解决:

-

每次执行时指定端口:在任何

ollama命令前,通过环境变量临时指定新端口。

OLLAMA_HOST=127.0.0.1:11435 ollama list- 一劳永逸的方法:将环境变量

OLLAMA_HOST添加到你的用户环境(如~/.bashrc)中,这样所有终端会话都会自动使用新端口。

echo 'export OLLAMA_HOST="127.0.0.1:11435"' >> ~/.bashrc

source ~/.bashrc如果你还需要配置其他选项(如模型下载路径、并发请求数等),可以在同一个配置文件中添加对应的环境变量。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)