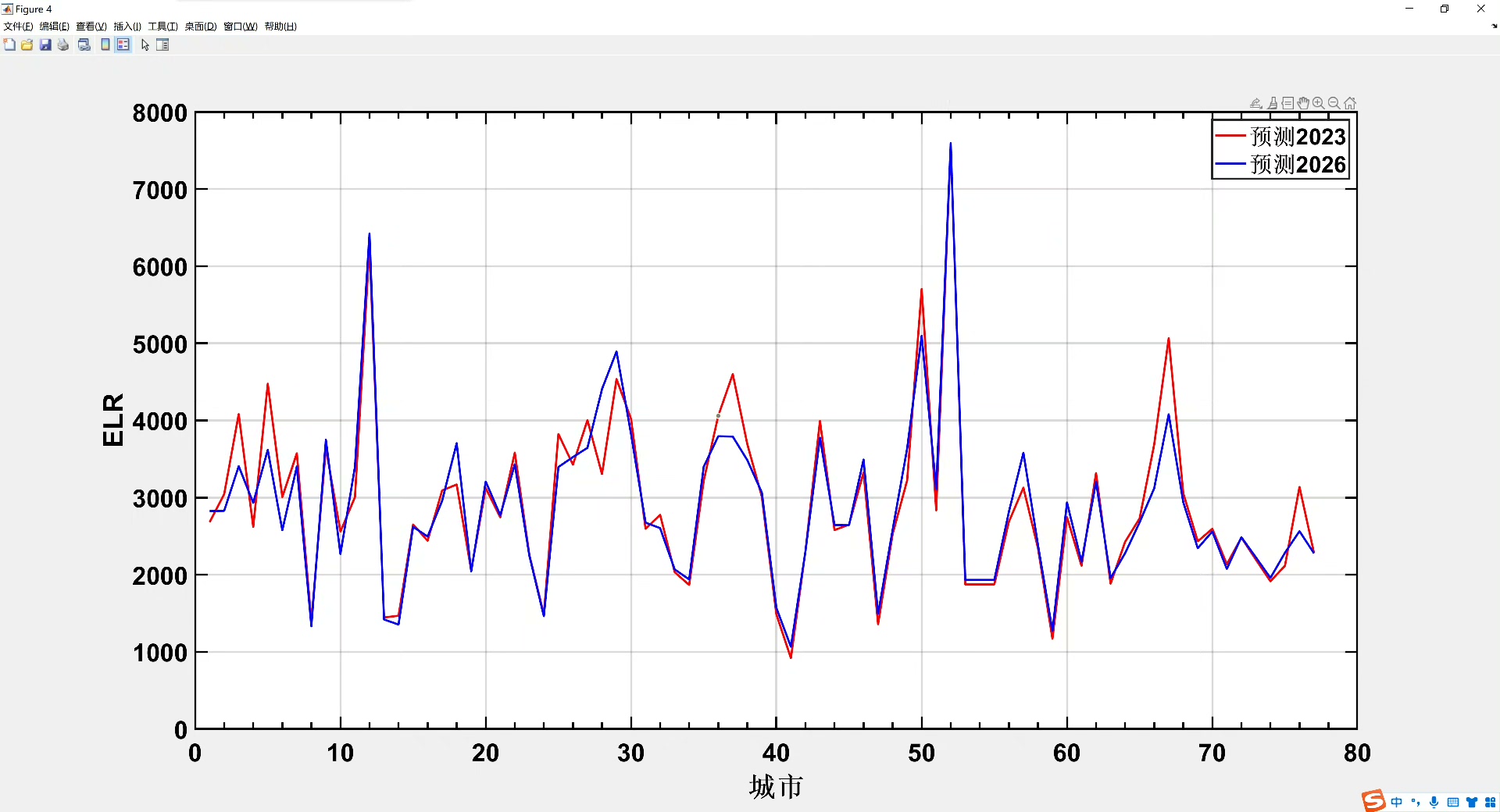

基于MATLAB的LSTM长短期记忆网络预测及数据回归分析

这里藏了个调参技巧:LearnRateDropPeriod配合piecewise能让学习率每50轮衰减一次,既保证前期快速收敛,又避免后期震荡。数据预测这事儿,说难不难,说简单也头疼。说到底,LSTM在MATLAB里就像个智能温度计——你得先摸准数据的脾气,它才能给你靠谱的预测。多试几次超参数,观察loss曲线的变化趋势,比死记硬背理论公式管用多了。要是发现预测曲线总比真实值慢半拍,别慌——这是典

基于MATLAB的'LSTM长短期记忆网络预测 基于MATLAB平台,对数据进行回归预测

数据预测这事儿,说难不难,说简单也头疼。最近在MATLAB里折腾LSTM(长短期记忆网络),发现这货对时间序列数据预测确实有点东西。咱们今天不整那些虚头巴脑的理论,直接上代码带实战。

先别急着跑代码,咱们得把数据收拾干净。假设你手头有个传感器采集的温度数据集,存成csv了。MATLAB处理这种表格数据最拿手:

data = readtable('sensor_data.csv');

rawData = data.Temperature;但原始数据直接喂给LSTM会消化不良,得做个归一化。别小看这一步,处理不好直接导致模型学歪:

[normalizedData, dataParams] = mapminmax(rawData', 0, 1); % 压缩到0-1区间

sequenceLength = 24; % 按24小时周期切分

XTrain = [];

YTrain = [];

for i = 1:length(normalizedData)-sequenceLength

XTrain{end+1} = normalizedData(:,i:i+sequenceLength-1);

YTrain{end+1} = normalizedData(:,i+sequenceLength);

end这里有个坑要注意:循环里的end+1虽然方便,但数据量大了会卡脖子。真遇到大数据集建议预分配内存。

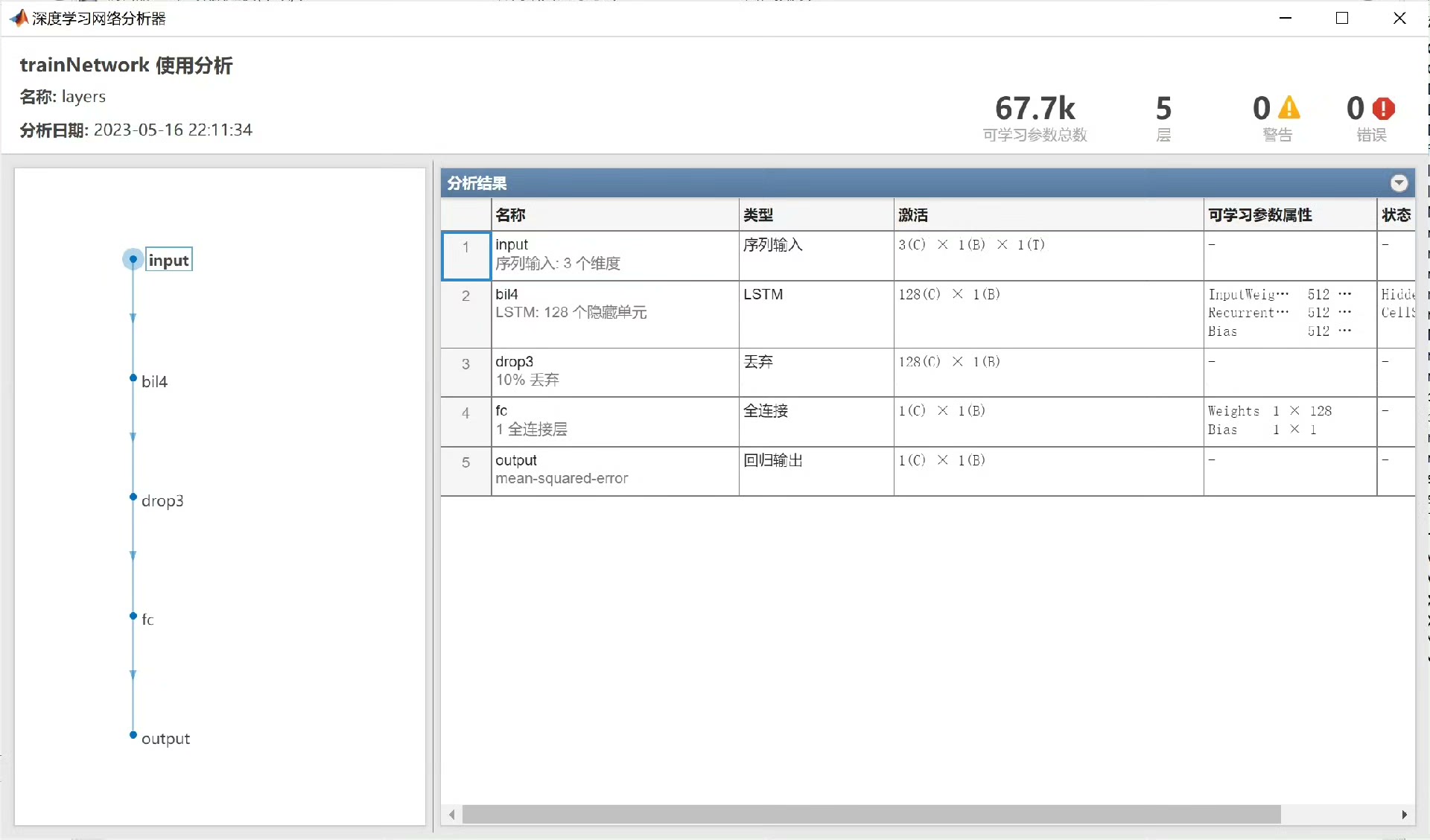

接下来构建LSTM网络的核心部分。MATLAB的深度学习工具箱让这事儿变得巨简单:

numFeatures = 1; % 单变量时间序列

numHiddenUnits = 128; % 隐藏层神经元数量

layers = [

sequenceInputLayer(numFeatures)

lstmLayer(numHiddenUnits, 'OutputMode', 'sequence')

fullyConnectedLayer(50)

dropoutLayer(0.2) % 防过拟合的保险丝

fullyConnectedLayer(1)

regressionLayer];重点说下lstmLayer里的OutputMode参数。'sequence'模式会把每个时间步的输出都保留,适合做多步预测。但咱们这次只是预测下一个时间点,用默认值就行。

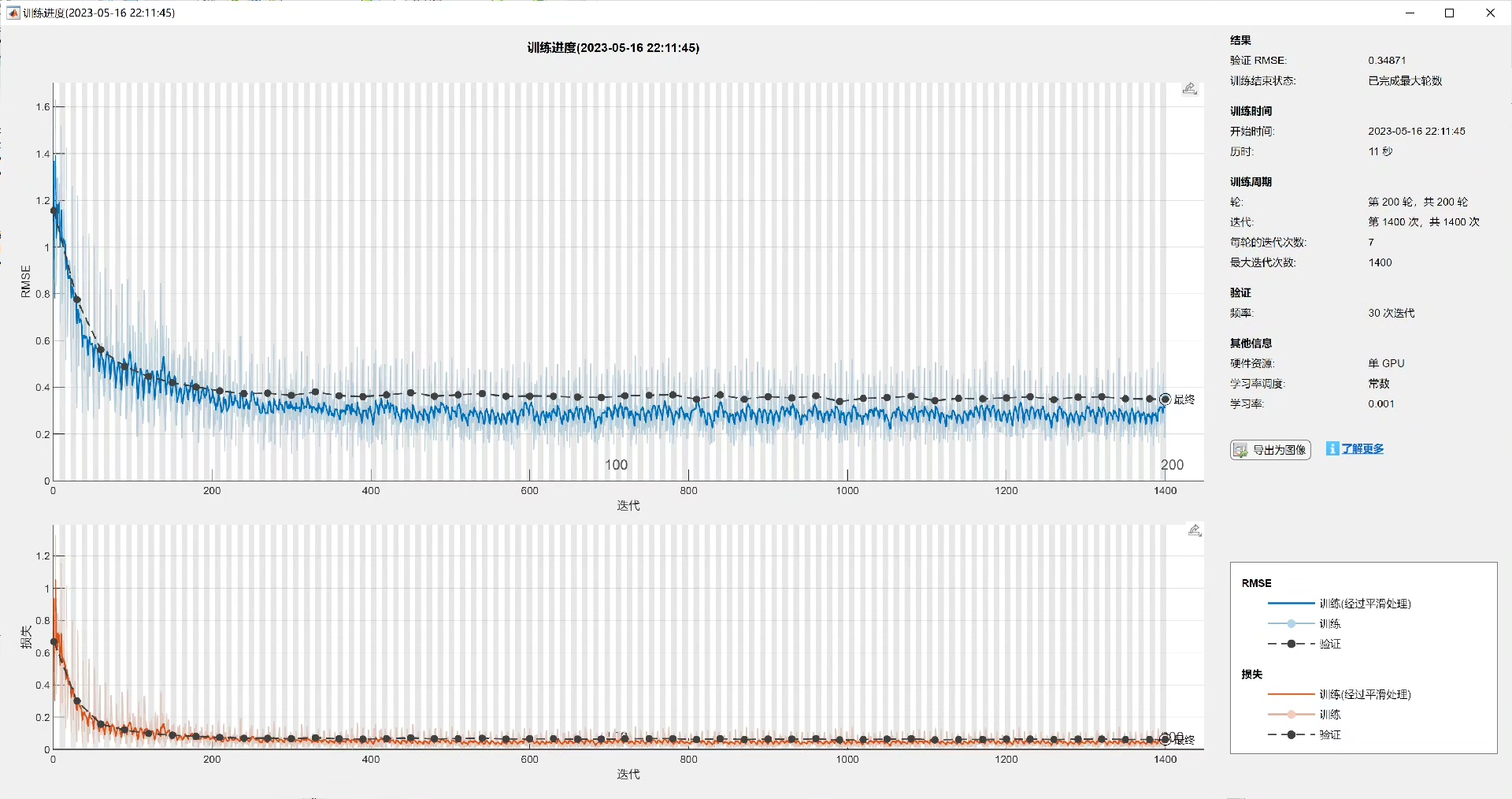

训练参数设置讲究个平衡艺术:

options = trainingOptions('adam', ...

'MaxEpochs', 200, ...

'MiniBatchSize', 64, ...

'InitialLearnRate', 0.001, ...

'LearnRateSchedule', 'piecewise', ...

'LearnRateDropPeriod', 50, ...

'Verbose', 0);这里藏了个调参技巧:LearnRateDropPeriod配合piecewise能让学习率每50轮衰减一次,既保证前期快速收敛,又避免后期震荡。不过新手容易把这值设得太大,导致学习率过早衰减。

训练模型就一行代码的事:

net = trainNetwork(XTrain, YTrain, layers, options);跑起来之后建议打开MATLAB的Training Progress窗口,盯着那个loss曲线看。要是曲线跳disco(剧烈震荡),八成是学习率设高了;要是躺平不动,可能网络结构需要调整。

预测阶段记得把数据反归一化:

YPred = predict(net, XTest);

predictedData = mapminmax('reverse', YPred, dataParams);这里有个隐藏bug:如果测试集数据的最大最小值超出训练集范围,反归一化会翻车。稳妥的做法是在预处理阶段就固定归一化参数。

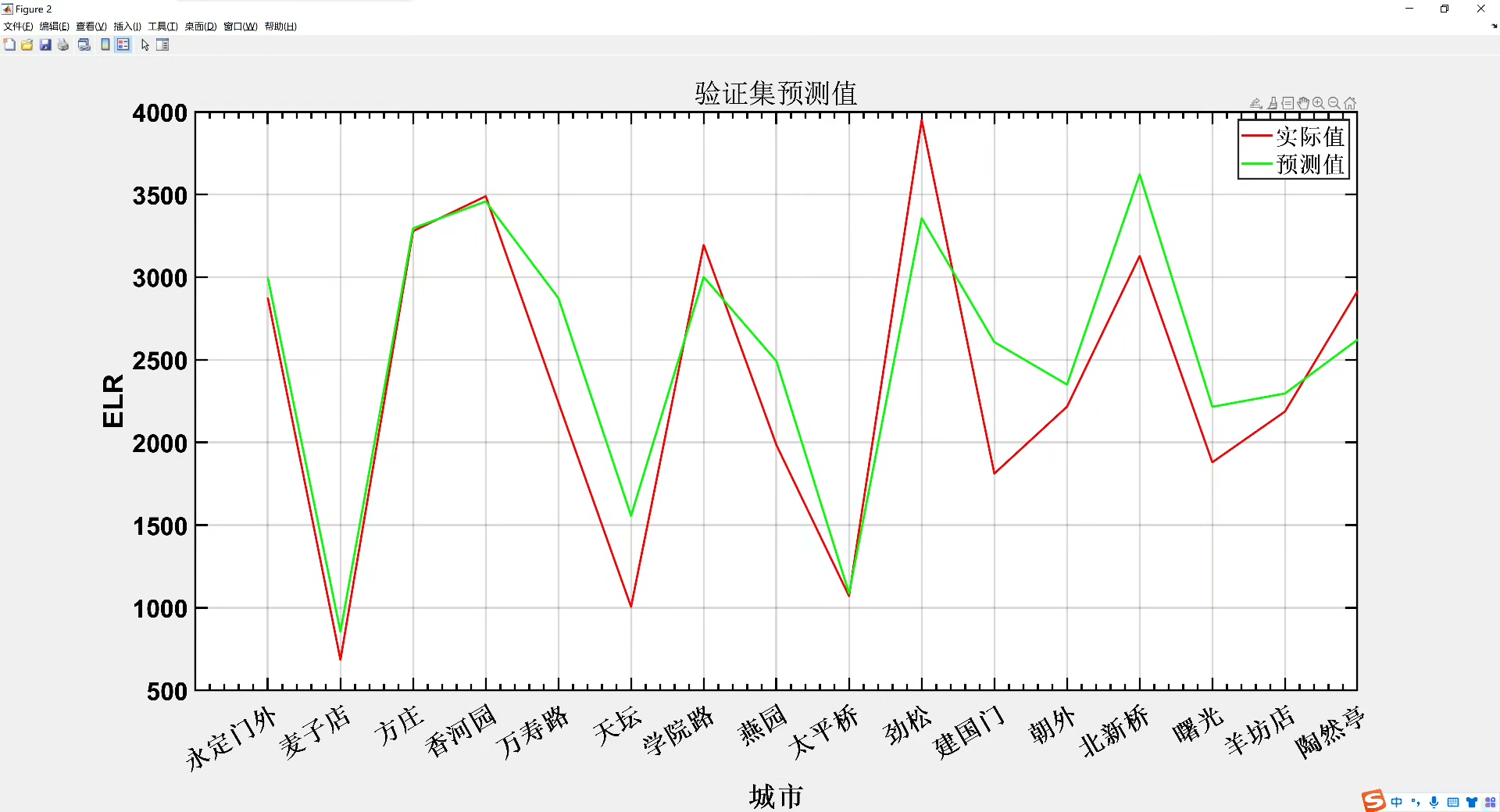

最后画个对比图验货:

plot(1:numTest, actualData, 'b', 1:numTest, predictedData, 'r--');

legend({'真实值', '预测值'});

title('LSTM预测效果对比');

xlabel('时间步');

ylabel('温度值');要是发现预测曲线总比真实值慢半拍,别慌——这是典型的时间序列预测滞后现象。可以试试在输入特征里加入滞后特征,或者改用seq2seq结构。

几个实战经验:

- 数据不够时,把lstmLayer的OutputMode改为'last'反而可能效果更好

- 遇到验证集loss突然飙升,在trainingOptions里加'Shuffle' 'every-epoch'

- 用GPU加速训练时,记得把数据转成gpuArray格式

说到底,LSTM在MATLAB里就像个智能温度计——你得先摸准数据的脾气,它才能给你靠谱的预测。多试几次超参数,观察loss曲线的变化趋势,比死记硬背理论公式管用多了。

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)