【完整源码+数据集+部署教程】 柑橘果实成熟度分割系统源码&数据集分享 [yolov8-seg-fasternet&yolov8-seg-AIFI等50+全套改进创新点发刊_一键训练教程_Web前端

【完整源码+数据集+部署教程】 柑橘果实成熟度分割系统源码&数据集分享[yolov8-seg-fasternet&yolov8-seg-AIFI等50+全套改进创新点发刊_一键训练教程_Web前端

背景意义

随着全球人口的不断增长和城市化进程的加快,农业生产面临着前所未有的挑战。柑橘类水果作为全球重要的经济作物之一,其生产与管理的效率直接影响到农民的收入和食品安全。在柑橘的种植过程中,果实的成熟度是影响其市场价值和销售时机的关键因素。传统的人工检测方法不仅耗时耗力,而且受主观因素影响较大,容易导致误判。因此,开发一种高效、准确的柑橘果实成熟度分割系统显得尤为重要。

近年来,计算机视觉和深度学习技术的迅猛发展为农业智能化提供了新的解决方案。YOLO(You Only Look Once)系列模型因其高效的实时目标检测能力而受到广泛关注。特别是YOLOv8模型,其在精度和速度上的优势使其成为图像分割和目标检测领域的热门选择。本研究旨在基于改进的YOLOv8模型,构建一个针对柑橘果实成熟度的分割系统,以实现对不同成熟度果实的自动识别和分类。

本研究所使用的数据集CITRUSCAN包含4900张柑橘果实的图像,涵盖了成熟度的三个主要类别:成熟(Ripe)、腐烂(Rotten)和未成熟(Unripe)。这些图像不仅数量充足,而且涵盖了不同光照、角度和背景下的果实图像,为模型的训练提供了丰富的样本。这一数据集的构建,旨在提高模型的泛化能力,使其能够在实际应用中更好地适应不同的环境和条件。

通过对YOLOv8模型的改进,我们可以在特征提取、网络结构和损失函数等方面进行优化,以提高模型在柑橘果实成熟度分割任务中的表现。例如,针对柑橘果实的特征,我们可以设计特定的卷积层和激活函数,以更好地捕捉果实的颜色、形状和纹理特征。同时,通过引入数据增强技术,可以有效提升模型的鲁棒性,减少过拟合现象。

本研究的意义不仅在于提升柑橘果实成熟度的检测精度,更在于推动农业智能化的发展。通过自动化的成熟度分割系统,农民可以实时获取果实的成熟状态,从而合理安排采摘时间,减少损失,提高产量。此外,该系统还可以为果品的分级和市场营销提供数据支持,助力农业产业链的优化与升级。

综上所述,基于改进YOLOv8的柑橘果实成熟度分割系统的研究,不仅具有重要的理论价值,也具有广泛的应用前景。它将为农业生产提供智能化的解决方案,推动农业的可持续发展,最终实现提高农民收入和保障食品安全的目标。

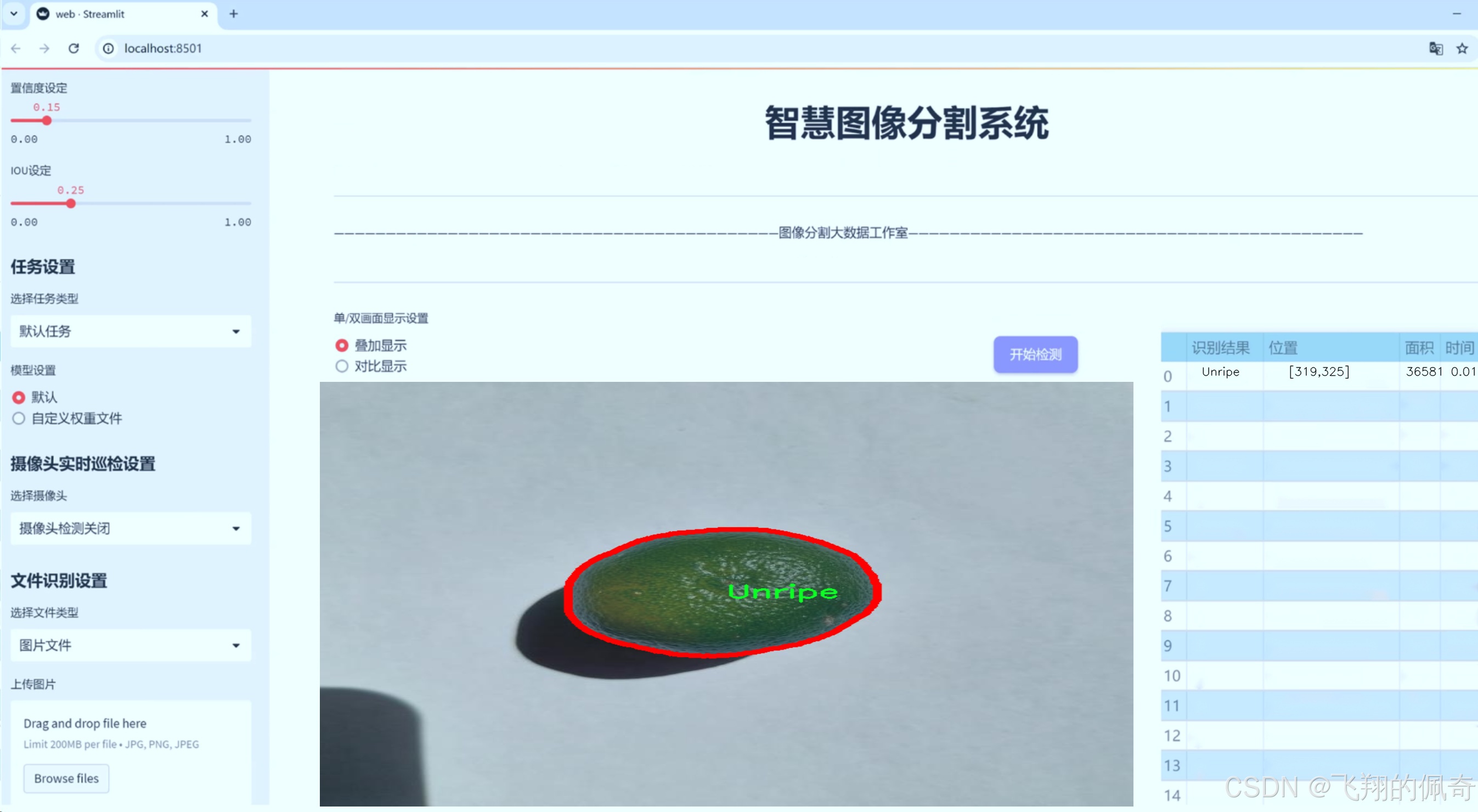

图片效果

数据集信息

在现代农业生产中,柑橘类水果的成熟度评估是提高果品质量和市场竞争力的重要环节。为此,构建一个高效的果实成熟度分割系统显得尤为重要。本研究采用了名为“CITRUSCAN”的数据集,以改进YOLOv8-seg模型在柑橘果实成熟度分割任务中的表现。该数据集专门针对柑橘类水果的不同成熟状态进行了精心设计,旨在为计算机视觉领域的研究人员提供一个可靠的基础。

“CITRUSCAN”数据集包含三种主要的成熟度类别,分别为“Ripe”(成熟)、“Rotten”(腐烂)和“Unripe”(未成熟)。这三类标签不仅反映了柑橘果实的生长状态,也为后续的图像处理和深度学习模型训练提供了清晰的目标。每个类别的样本均经过严格筛选,确保数据的多样性和代表性,涵盖了不同品种、不同生长环境及不同光照条件下的柑橘果实图像。这种多样性使得模型在实际应用中能够更好地适应各种复杂的场景,提高了模型的泛化能力。

数据集中的图像数据经过高质量的标注,确保每一张图像都准确地反映了果实的成熟状态。标注过程不仅考虑了果实的外观特征,还结合了专家的经验,以确保数据的真实性和有效性。此外,数据集还提供了丰富的图像背景信息,包括果实的生长环境、光照条件以及可能的遮挡情况,这些信息对于训练一个鲁棒的分割模型至关重要。

在训练过程中,改进的YOLOv8-seg模型将利用“CITRUSCAN”数据集中的图像和标签信息,通过深度学习算法提取特征并进行学习。模型将通过多层卷积神经网络(CNN)对输入图像进行处理,逐步识别和分割出不同成熟度的柑橘果实。由于数据集的类别数量相对较少,模型在训练时能够快速收敛,并在验证集上实现较高的准确率和召回率。这为后续的实际应用奠定了坚实的基础。

此外,数据集的构建还考虑到了可扩展性和适应性。随着研究的深入,未来可以在“CITRUSCAN”数据集的基础上,增加更多的成熟度类别或扩展到其他水果的成熟度评估任务。这种灵活性使得数据集不仅适用于当前的研究需求,也为后续的研究提供了广阔的空间。

综上所述,“CITRUSCAN”数据集在柑橘果实成熟度分割任务中扮演着至关重要的角色。通过高质量的图像数据和精确的标注信息,该数据集为改进YOLOv8-seg模型提供了坚实的基础,推动了农业智能化和自动化的发展。随着技术的不断进步,基于该数据集的研究成果将有助于实现更高效的果实成熟度评估,进而提升农业生产的整体效率和经济效益。

核心代码

```python

import os

from pathlib import Path

from contextlib import contextmanager

@contextmanager

def spaces_in_path(path):

"""

处理路径中包含空格的上下文管理器。如果路径包含空格,将其替换为下划线,

复制文件/目录到新路径,执行上下文代码块,然后将文件/目录复制回原位置。

参数:

path (str | Path): 原始路径。

返回:

(Path): 如果路径中有空格,则返回替换空格为下划线的临时路径,否则返回原始路径。

"""

if ' ' in str(path):

path = Path(path) # 转换为Path对象

with tempfile.TemporaryDirectory() as tmp_dir: # 创建临时目录

tmp_path = Path(tmp_dir) / path.name.replace(' ', '_') # 新路径

# 复制文件或目录

if path.is_dir():

shutil.copytree(path, tmp_path) # 复制目录

elif path.is_file():

tmp_path.parent.mkdir(parents=True, exist_ok=True) # 创建父目录

shutil.copy2(path, tmp_path) # 复制文件

try:

yield tmp_path # 返回临时路径

finally:

# 将文件/目录复制回原位置

if tmp_path.is_dir():

shutil.copytree(tmp_path, path, dirs_exist_ok=True)

elif tmp_path.is_file():

shutil.copy2(tmp_path, path)

else:

yield path # 如果没有空格,直接返回原路径

def increment_path(path, exist_ok=False, sep='', mkdir=False):

"""

增加文件或目录路径的后缀,例如将 'runs/exp' 增加为 'runs/exp2', 'runs/exp3' 等。

参数:

path (str, pathlib.Path): 要增加的路径。

exist_ok (bool, optional): 如果为True,路径不会增加,直接返回原路径。默认为False。

sep (str, optional): 路径和增加数字之间的分隔符。默认为''。

mkdir (bool, optional): 如果路径不存在,是否创建目录。默认为False。

返回:

(pathlib.Path): 增加后的路径。

"""

path = Path(path) # 转换为Path对象

if path.exists() and not exist_ok:

path, suffix = (path.with_suffix(''), path.suffix) if path.is_file() else (path, '')

# 增加路径

for n in range(2, 9999):

p = f'{path}{sep}{n}{suffix}' # 生成新路径

if not os.path.exists(p): # 检查路径是否存在

break

path = Path(p)

if mkdir:

path.mkdir(parents=True, exist_ok=True) # 创建目录

return path # 返回增加后的路径

def file_size(path):

"""返回文件或目录的大小(MB)。"""

if isinstance(path, (str, Path)):

mb = 1 << 20 # 1 MB = 1024 * 1024 bytes

path = Path(path)

if path.is_file():

return path.stat().st_size / mb # 返回文件大小

elif path.is_dir():

return sum(f.stat().st_size for f in path.glob('**/*') if f.is_file()) / mb # 返回目录下所有文件的大小

return 0.0 # 如果路径无效,返回0

核心部分说明:

-

spaces_in_path: 这个上下文管理器处理路径中包含空格的情况,确保在处理时不会因为空格导致路径错误。它会在执行代码块前复制文件或目录到一个临时路径,并在代码块执行完后将其复制回原位置。 -

increment_path: 这个函数用于生成一个新的文件或目录路径,如果路径已存在,可以通过增加数字来避免冲突。它提供了灵活的选项来控制是否创建目录以及如何处理已有路径。 -

file_size: 这个函数计算并返回指定文件或目录的大小,以MB为单位。它支持处理文件和目录,并能够递归计算目录下所有文件的总大小。

这些功能在文件管理和路径处理时非常有用,尤其是在处理大量文件和目录时。```

这个文件是Ultralytics YOLO项目中的一个工具模块,主要用于处理文件和目录的操作。它包含了一些类和函数,帮助用户在处理文件时更加方便和高效。

首先,文件中定义了一个WorkingDirectory类,这个类是一个上下文管理器,允许用户在指定的工作目录中执行代码。通过使用@WorkingDirectory(dir)装饰器或with WorkingDirectory(dir):语句,用户可以临时更改当前工作目录,并在代码块执行完毕后自动恢复到原来的目录。这对于需要在特定目录下执行文件操作的场景非常有用。

接下来,定义了一个名为spaces_in_path的上下文管理器。这个管理器用于处理路径中包含空格的情况。如果路径中有空格,它会将空格替换为下划线,并将文件或目录复制到新的路径中执行代码块,最后再将文件或目录复制回原来的位置。这种处理方式可以避免在某些操作中因路径包含空格而导致的问题。

文件中还有一个increment_path函数,用于递增文件或目录的路径。这个函数会检查指定的路径是否存在,如果存在且exist_ok参数为False,则会在路径后面添加一个数字后缀(例如runs/exp2、runs/exp3等)。如果指定的路径是一个文件,它会保留文件的扩展名;如果是目录,则直接在路径后添加数字。该函数还可以根据mkdir参数创建目录。

此外,文件中还定义了几个用于获取文件信息的函数,包括file_age、file_date和file_size。file_age函数返回自上次修改以来的天数,file_date函数返回可读的文件修改日期,而file_size函数则返回文件或目录的大小(以MB为单位)。这些函数可以帮助用户快速获取文件的基本信息。

最后,get_latest_run函数用于查找指定目录下最新的last.pt文件,通常用于恢复训练。它会搜索给定目录及其子目录中的所有last*.pt文件,并返回最新的一个路径。

总体来说,这个文件提供了一系列实用的工具函数和上下文管理器,旨在简化文件和目录的操作,特别是在机器学习和深度学习的工作流程中。

```python

import torch

import torch.nn as nn

import torch.nn.functional as F

# 定义一个包含多种卷积操作的模块

class DiverseBranchBlock(nn.Module):

def __init__(self, in_channels, out_channels, kernel_size, stride=1, padding=None, dilation=1, groups=1):

super(DiverseBranchBlock, self).__init__()

# 初始化参数

self.kernel_size = kernel_size

self.out_channels = out_channels

self.groups = groups

# 自动计算填充

if padding is None:

padding = kernel_size // 2 # 确保填充为卷积核大小的一半

assert padding == kernel_size // 2

# 定义主卷积层

self.dbb_origin = self.conv_bn(in_channels, out_channels, kernel_size, stride, padding, dilation, groups)

# 定义平均池化分支

self.dbb_avg = nn.Sequential(

nn.AvgPool2d(kernel_size=kernel_size, stride=stride, padding=0),

nn.BatchNorm2d(out_channels)

)

# 定义1x1卷积分支

self.dbb_1x1_kxk = nn.Sequential(

nn.Conv2d(in_channels, out_channels, kernel_size=1, stride=stride, padding=0, groups=groups, bias=False),

nn.BatchNorm2d(out_channels)

)

def conv_bn(self, in_channels, out_channels, kernel_size, stride, padding, dilation, groups):

# 定义卷积层和批归一化层

conv_layer = nn.Conv2d(in_channels, out_channels, kernel_size, stride=stride, padding=padding, dilation=dilation, groups=groups, bias=False)

bn_layer = nn.BatchNorm2d(out_channels)

return nn.Sequential(conv_layer, bn_layer)

def forward(self, inputs):

# 前向传播

out = self.dbb_origin(inputs) # 主卷积输出

out += self.dbb_avg(inputs) # 加上平均池化分支的输出

out += self.dbb_1x1_kxk(inputs) # 加上1x1卷积分支的输出

return out # 返回最终输出

代码注释说明:

-

DiverseBranchBlock 类:这是一个自定义的神经网络模块,包含多种卷积操作,适用于深度学习模型中的特征提取。

-

init 方法:初始化方法,设置输入通道、输出通道、卷积核大小、步幅、填充、扩张率和分组卷积的参数。

-

conv_bn 方法:定义一个卷积层和一个批归一化层的组合,返回一个顺序容器(Sequential)。

-

forward 方法:定义前向传播过程,依次通过主卷积层、平均池化分支和1x1卷积分支,最终返回加和后的输出。

通过这些注释,代码的功能和结构更加清晰,便于理解和维护。```

这个程序文件定义了一个名为 DiverseBranchBlock 的神经网络模块,主要用于构建卷积神经网络中的一个复杂的分支结构。文件中包含了一些辅助函数和类,用于实现不同的卷积操作和批归一化(Batch Normalization)功能。

首先,文件导入了必要的库,包括 PyTorch 的核心库和一些功能模块。接着,定义了一些转换函数,这些函数用于处理卷积核和偏置的融合、合并等操作。例如,transI_fusebn 函数将卷积核与批归一化层的参数结合在一起,返回融合后的卷积核和偏置。

接下来,定义了几个转换函数,这些函数分别处理不同类型的卷积操作,如 transII_addbranch 用于将多个卷积核和偏置相加,transIII_1x1_kxk 处理 1x1 和 kxk 卷积的组合,transIV_depthconcat 则用于将多个卷积结果在深度维度上连接。

conv_bn 函数用于创建一个包含卷积层和批归一化层的序列模块,方便后续使用。

IdentityBasedConv1x1 类继承自 nn.Conv2d,实现了一种特殊的 1x1 卷积层,能够在卷积操作中保留输入的特征。这一层通过在卷积核中添加一个身份矩阵来实现。

BNAndPadLayer 类则实现了一个结合了批归一化和填充操作的层。它在前向传播中对输入进行批归一化处理后,如果需要,还会在边缘添加填充,以保持输出的形状。

DiverseBranchBlock 类是该文件的核心,构造了一个复杂的分支模块。它的构造函数接收多个参数,定义了不同的卷积和批归一化结构。根据输入参数的不同,模块可以选择使用不同的卷积层和分支结构。

在 DiverseBranchBlock 中,首先会根据是否处于部署模式(deploy)来决定使用哪种卷积结构。如果处于部署模式,则直接使用一个卷积层;否则,构建多个卷积和批归一化的组合。

该模块的 forward 方法定义了前向传播的过程,计算输入经过不同分支后的输出,并将结果相加。最后,通过非线性激活函数进行处理。

此外,模块还提供了一些初始化方法,如 init_gamma 和 single_init,用于初始化批归一化层的权重。

总的来说,这个文件实现了一个灵活且高效的卷积模块,能够在不同的应用场景中进行调整和优化,适用于现代深度学习模型的构建。

```python

import torch

from torch import nn

import torch.nn.functional as F

from torch.nn.init import xavier_uniform_, constant_

class DCNv3(nn.Module):

def __init__(self,

channels=64,

kernel_size=3,

stride=1,

pad=1,

dilation=1,

group=4,

offset_scale=1.0,

center_feature_scale=False,

remove_center=False):

"""

DCNv3模块的初始化函数

:param channels: 输入和输出的通道数

:param kernel_size: 卷积核的大小

:param stride: 卷积的步幅

:param pad: 卷积的填充

:param dilation: 卷积的扩张

:param group: 分组卷积的组数

:param offset_scale: 偏移量的缩放因子

:param center_feature_scale: 是否使用中心特征缩放

:param remove_center: 是否移除中心像素

"""

super().__init__()

if channels % group != 0:

raise ValueError(f'channels must be divisible by group, but got {channels} and {group}')

self.channels = channels

self.kernel_size = kernel_size

self.stride = stride

self.dilation = dilation

self.pad = pad

self.group = group

self.group_channels = channels // group

self.offset_scale = offset_scale

self.center_feature_scale = center_feature_scale

self.remove_center = int(remove_center)

# 定义卷积层、偏移量线性层和掩码线性层

self.dw_conv = nn.Conv2d(channels, channels, kernel_size, stride=1, padding=pad, groups=channels)

self.offset = nn.Linear(channels, group * (kernel_size * kernel_size - remove_center) * 2)

self.mask = nn.Linear(channels, group * (kernel_size * kernel_size - remove_center))

self.input_proj = nn.Linear(channels, channels)

self.output_proj = nn.Linear(channels, channels)

self._reset_parameters()

def _reset_parameters(self):

"""重置模型参数"""

constant_(self.offset.weight.data, 0.)

constant_(self.offset.bias.data, 0.)

constant_(self.mask.weight.data, 0.)

constant_(self.mask.bias.data, 0.)

xavier_uniform_(self.input_proj.weight.data)

constant_(self.input_proj.bias.data, 0.)

xavier_uniform_(self.output_proj.weight.data)

constant_(self.output_proj.bias.data, 0.)

def forward(self, input):

"""

前向传播函数

:param input: 输入张量,形状为 (N, H, W, C)

:return: 输出张量,形状为 (N, H, W, C)

"""

N, H, W, _ = input.shape

# 输入投影

x = self.input_proj(input)

x_proj = x # 保存输入投影的结果

# 进行深度卷积

x1 = input.permute(0, 3, 1, 2) # 将输入的通道维度移到前面

x1 = self.dw_conv(x1).permute(0, 2, 3, 1) # 进行深度卷积并恢复维度顺序

# 计算偏移量和掩码

offset = self.offset(x1)

mask = self.mask(x1).reshape(N, H, W, self.group, -1)

mask = F.softmax(mask, -1).reshape(N, H, W, -1) # 计算掩码的softmax

# 应用DCN操作

x = DCNv3Function.apply(

x, offset, mask,

self.kernel_size, self.kernel_size,

self.stride, self.stride,

self.pad, self.pad,

self.dilation, self.dilation,

self.group, self.group_channels,

self.offset_scale,

256,

self.remove_center)

# 如果启用中心特征缩放

if self.center_feature_scale:

center_feature_scale = self.center_feature_scale_module(

x1, self.center_feature_scale_proj_weight, self.center_feature_scale_proj_bias)

center_feature_scale = center_feature_scale[..., None].repeat(

1, 1, 1, 1, self.channels // self.group).flatten(-2)

x = x * (1 - center_feature_scale) + x_proj * center_feature_scale # 结合输入和输出

x = self.output_proj(x) # 最后的输出投影

return x # 返回输出

代码注释说明

- 类的定义:

DCNv3类是一个深度可分离卷积模块的实现,主要用于特征提取。 - 初始化函数:在构造函数中定义了卷积层、偏移量和掩码的线性层,以及输入和输出的投影层。

- 参数重置:

_reset_parameters方法用于初始化模型参数,确保在训练开始时参数是合理的。 - 前向传播:

forward方法实现了输入数据的前向传播,包括输入的投影、深度卷积、偏移量和掩码的计算,以及最终的输出投影。

通过以上注释,可以更好地理解代码的结构和功能。```

这个程序文件实现了一个名为DCNv3的深度学习模块,主要用于计算机视觉任务中的卷积操作。DCNv3是动态卷积的一个变种,具有更高的灵活性和性能。文件中包含多个类和函数,下面是对其主要部分的说明。

首先,文件引入了一些必要的库,包括PyTorch的核心模块和一些功能模块。接着定义了两个类to_channels_first和to_channels_last,它们用于在不同的通道格式之间转换,分别将输入的张量从“通道最后”格式转换为“通道第一”格式,反之亦然。

build_norm_layer函数用于构建归一化层,支持批归一化(Batch Normalization)和层归一化(Layer Normalization),并根据输入和输出格式进行相应的转换。build_act_layer函数则用于构建激活函数层,支持ReLU、SiLU和GELU等常用激活函数。

_is_power_of_2函数用于检查一个数是否是2的幂,这在DCNv3的实现中是一个性能优化的建议。

CenterFeatureScaleModule类实现了中心特征缩放的功能,通过线性变换生成一个缩放因子,用于调整特征图的输出。

DCNv3_pytorch类是DCNv3模块的核心实现,构造函数中定义了卷积层、偏置、掩码等多个线性层,并进行了参数初始化。前向传播方法中,输入张量经过线性变换和深度卷积处理后,计算出偏移量和掩码,并调用dcnv3_core_pytorch函数进行动态卷积操作。若启用中心特征缩放,则会对输出进行相应的调整。

DCNv3类是DCNv3模块的另一种实现,使用了自定义的卷积类Conv,并与DCNv3_pytorch类类似地定义了各个层和前向传播方法。该类也支持中心特征缩放和移除中心的功能。

最后,DCNv3_DyHead类是DCNv3模块的一个变体,专注于动态头部的实现。它的构造函数和前向传播方法与前面的类类似,但主要用于处理动态卷积的特定需求。

总体来说,这个文件实现了一个灵活且高效的动态卷积模块,适用于各种计算机视觉任务,尤其是在需要动态调整卷积操作的场景中。通过不同的类和函数,提供了丰富的功能以满足不同的需求。

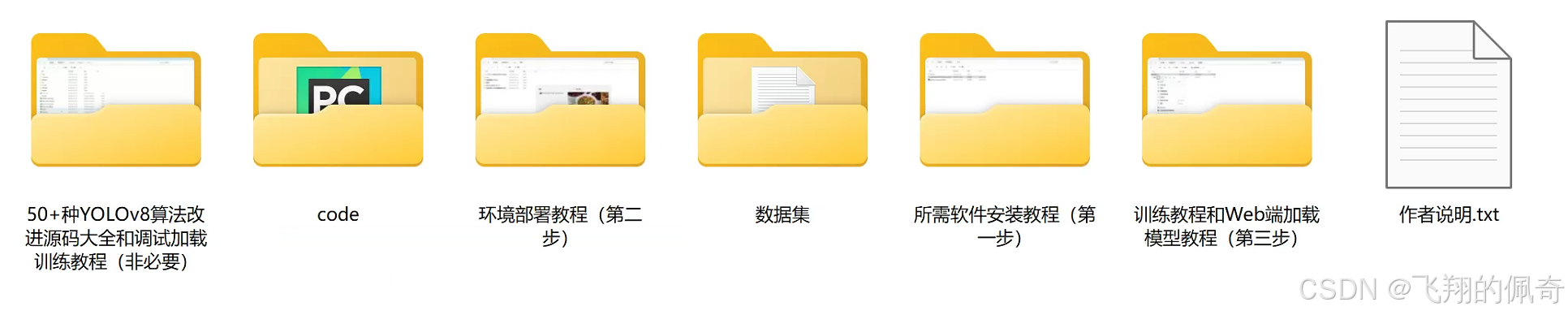

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献145条内容

已为社区贡献145条内容

所有评论(0)