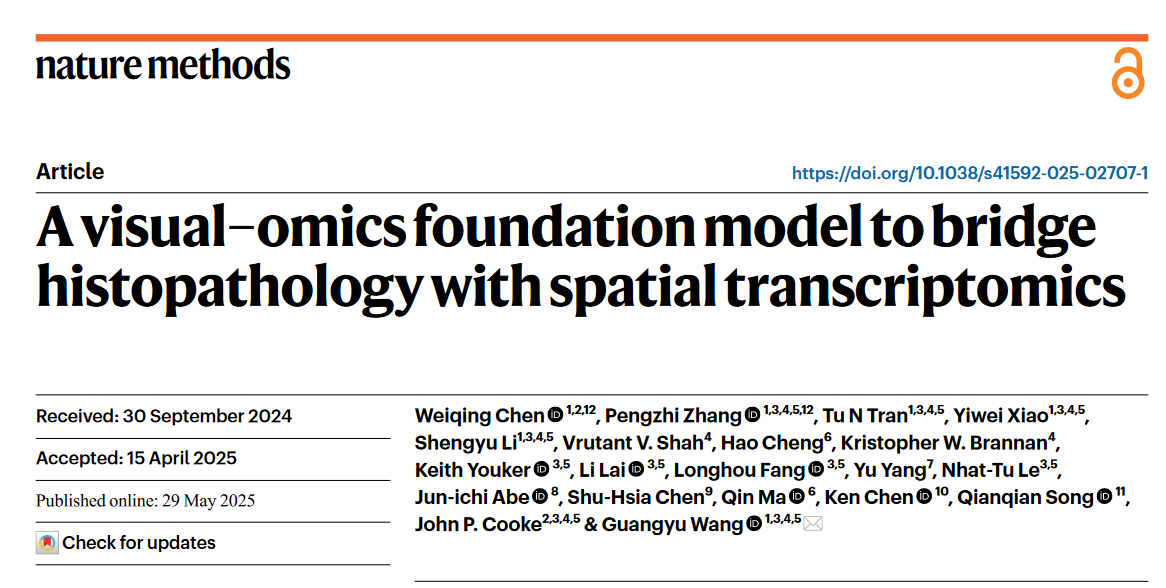

Nature Methods | LOKI 平台:将空间转录组与 H&E 图像连接的视觉-组学模型 | 让病理切片“看见”基因表达

随着单细胞测序、空间转录组等技术的迅猛发展,科研人员获得了前所未有的细胞和组织水平的基因表达信息。然而,这些丰富的组学数据往往与临床诊断中最常见的 H&E 染色组织切片相互割裂,限制了对组织空间异质性的深度理解。现有基于视觉-语言的基础模型(如 PLIP、OpenAI CLIP)主要用自然语言描述取代分子信息,因此难以反映潜在的分子机制。训练目标是最大化图像-转录组配对的相似度,同时最小化错误配对

引言:视觉-组学融合的背景

随着单细胞测序、空间转录组等技术的迅猛发展,科研人员获得了前所未有的细胞和组织水平的基因表达信息。然而,这些丰富的组学数据往往与临床诊断中最常见的 H&E 染色组织切片相互割裂,限制了对组织空间异质性的深度理解。

现有基于视觉-语言的基础模型(如 PLIP、OpenAI CLIP)主要用自然语言描述取代分子信息,因此难以反映潜在的分子机制。

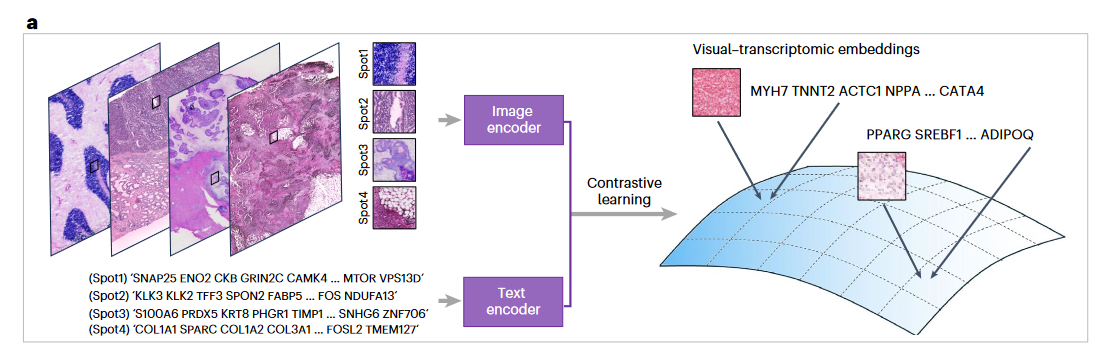

为解决这一问题,Chen 等人(Nature Methods, 2025) 构建了视觉-组学基础模型 OmiCLIP,并基于此开发了 LOKI 平台,用以在统一的潜在空间中对齐、解析和预测组学与图像之间的关系。

OmiCLIP 使用 2.2 百万对空间转录组–H&E 图像配对样本 进行训练,从而构建了跨模态表征模型。

简单来说,这项研究提出的 LOKI 平台,让我们能够仅通过一张普通的病理切片,就预测出组织中不同区域的基因表达状态。

它把传统病理学中“能看到形态、看不到分子”的局限,变成了“从图像中读出转录组信息”。

对科研人员,这意味着空间转录组实验的成本大幅降低;对医生,这意味着每一张切片都蕴含潜在的“分子诊断”价值。**

OmiCLIP:连接空间转录组与 H&E 图像的核心

模型原理与训练思路

OmiCLIP 通过视觉编码器(ViT)和转录组编码器(Transformer)分别提取图像与基因表达特征,并采用 跨模态对比学习(contrastive learning) 进行训练,使两种模态在潜在空间中对齐。模型输入的“基因句子”由前 300 个变异度最高的基因组成。

训练目标是最大化图像-转录组配对的相似度,同时最小化错误配对样本的距离,从而实现空间表达模式的视觉特征捕获。

该模型不仅能重建空间转录组中的主要空间结构特征,还能在未见样本上实现良好的泛化能力。

LOKI 平台:多功能视觉-组学一体化分析框架

LOKI 平台基于 OmiCLIP 的嵌入表示,构建了五个核心功能模块,实现空间组学-病理影像的系统性应用:

| 模块 | 功能描述 | 应用场景 |

|---|---|---|

| Loki-Align | 对齐空间转录组与病理图像,将两者嵌入到统一潜在空间中 | 跨平台/跨物种对比分析 |

| Loki-Annotate | 基于组学特征的图像标注,自动识别细胞亚群或组织区域 | 图像分割与自动注释 |

| Loki-Decompose | 将 H&E 图像预测的信号分解为细胞类型组成 | 无需空间组学的组织细胞比例估算 |

| Loki-Retrieve | 实现从组织图像到空间表达谱的反向检索 | 组织病理-分子层级对照分析 |

| Loki-PredEx | 预测给定 H&E 图像的空间基因表达模式 | 无需测序即可估算基因表达图谱 |

这一框架实现了视觉-组学的“全链路桥接”:

从图像特征识别 → 细胞亚群推断 → 空间转录组预测 → 分子机制探索。

平台创新与未来前景

- 实现跨模态映射:OmiCLIP-LOKI 通过组学与图像的统一潜在空间对齐,使得传统病理影像可承载分子层级信息。

- 泛化能力强:模型在不同物种、不同组织类型、不同平台上均表现出稳定性能。

- 扩展潜力大:LOKI 框架为 AI-病理、空间多组学、精准诊断提供了通用基础,可与下游模型(如 PredEx、OmniPath)进一步结合。

资源与开源

本文所介绍的 LOKI 平台(基于 OmiCLIP) 的源代码可在 GitHub 上获得:

The ST-bank database is available at https://github.com/

GuangyuWangLab2021/Loki/

同时,预训练好的 OmiCLIP / Loki 模型权重也已上传至 Hugging Face 模型库:

https://huggingface.co/WangGuangyuLab/Loki?utm_source=chatgpt.com

参考文献

Chen W. et al.

A visual–omics foundation model to bridge histopathology with spatial transcriptomics.

Nature Methods, 2025. DOI: 10.1038/s41592-025-02707-1

👋 欢迎关注我的生信学习专栏~ 如果觉得文章有帮助,别忘了点赞、关注、评论,一起学习

魔乐社区(Modelers.cn) 是一个中立、公益的人工智能社区,提供人工智能工具、模型、数据的托管、展示与应用协同服务,为人工智能开发及爱好者搭建开放的学习交流平台。社区通过理事会方式运作,由全产业链共同建设、共同运营、共同享有,推动国产AI生态繁荣发展。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)